连夜爆肝!DeepSeek又搞大事,网友:这谁顶得住啊

当别人家的AI还在学走路时,DeepSeek的MoE模型已经开着火箭往前冲了——所以问题来了,明天他们又要搞什么大新闻?反正我是准备好连夜蹲GitHub了,你呢?

·

连夜爆肝!DeepSeek又搞大事,网友:这谁顶得住啊?

兄弟们!今天凌晨三点我正刷着手机准备睡觉,突然被群里一串“卧槽”炸醒——DeepSeek开源周第二弹直接甩出王炸! 这波操作直接把AI圈炸成了烟花现场,有人甚至说:“昨天还在用FlashMLA,今天DeepEP就杀到了,这节奏是要把我CPU干烧啊!”

到底发生了什么?全球首个专治MoE模型“拖延症”的神器——DeepEP通信库,开源了! 简单来说,这玩意儿能让AI训练和推理快得像吃了德芙,丝滑到飞起!

一、听说MoE模型要集体“卷”起来了?

先给课代表划重点:DeepEP专门对付AI界的“堵车现场”——通信效率! 以前训练千亿参数的MoE模型,就像让一群专家挤地铁上班,动不动就卡在换乘站。现在DeepEP直接给专家们开了直升机通勤:

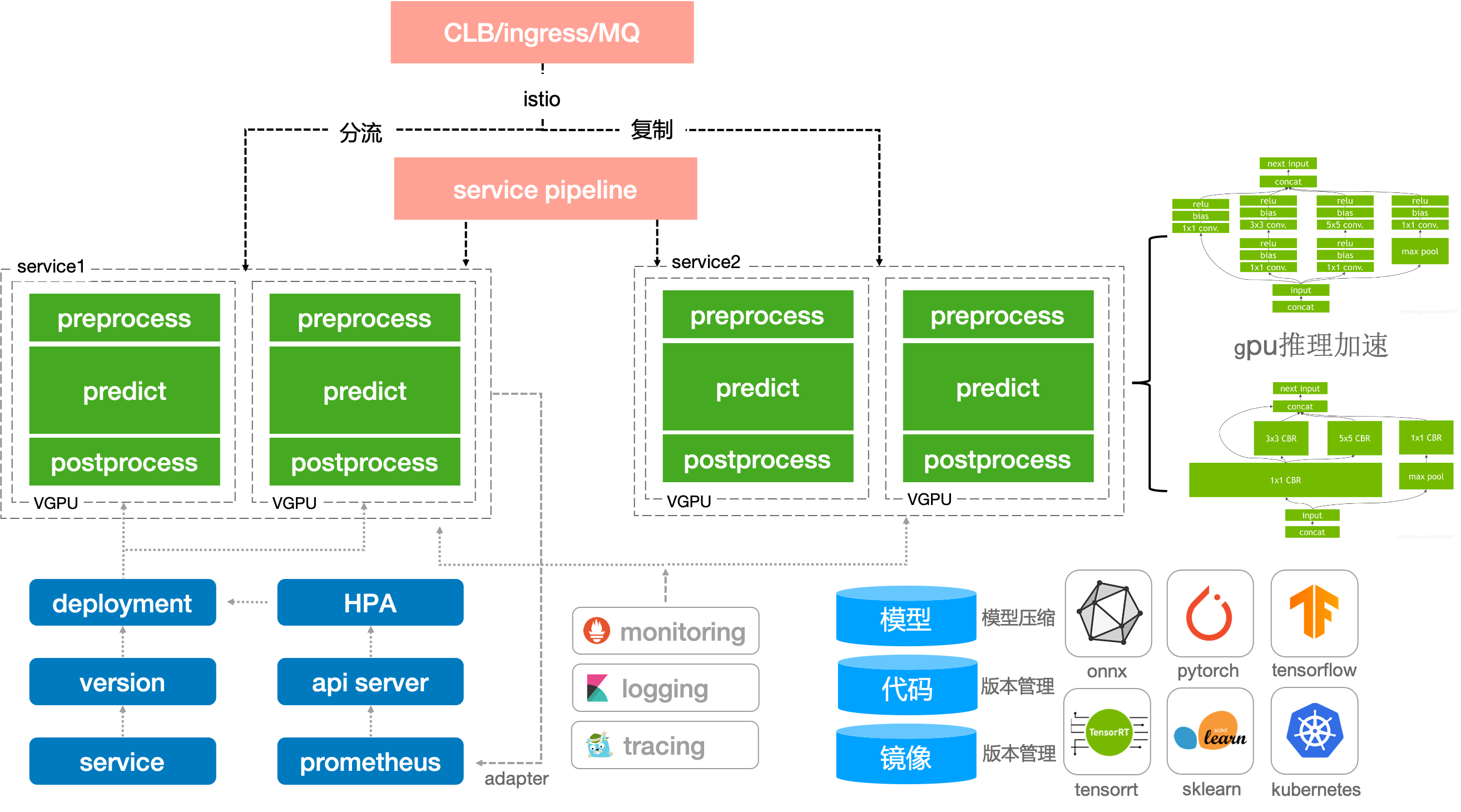

- 全宇宙最野的“堵车终结术”:用NVLink和RDMA技术打通任督二脉,单机多卡像坐高铁,跨节点集群直接瞬移,网友锐评:“这波操作让GPU学会了影分身!”

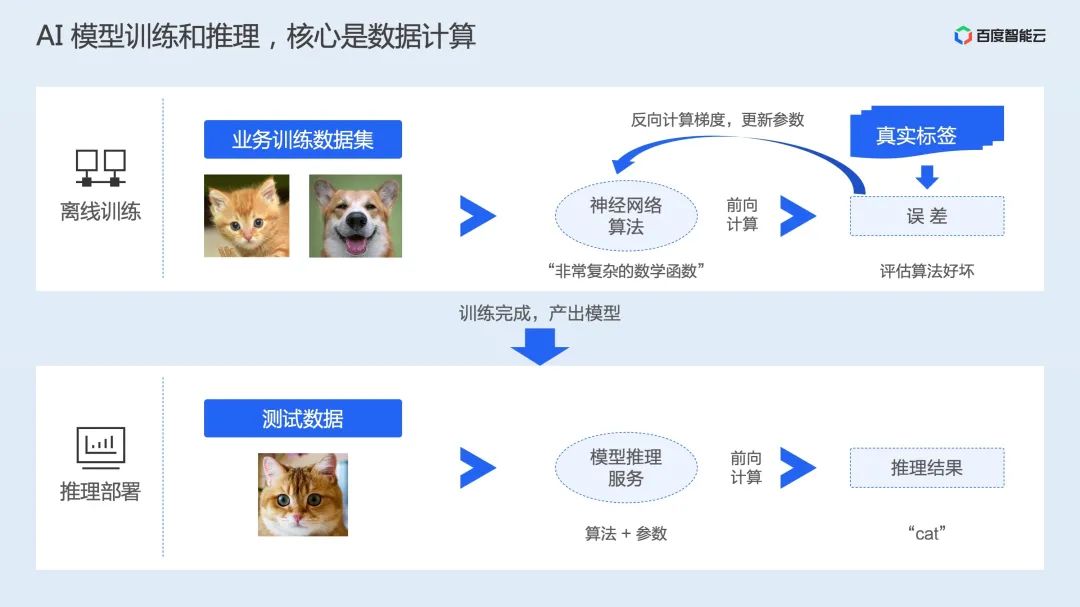

- 训练推理两开花:训练时高吞吐预填充内核疯狂灌数据,推理时低延迟解码内核快到能跟光速掰手腕,有程序员实测后哭诉:“我的咖啡刚泡好,它已经跑完三圈了!”

- FP8黑科技加持:直接让显存占用和通信开销上演“瘦身奇迹”,算力利用率拉满到让显卡发出“我还能肝”的呐喊!

最骚的是计算和通信还能玩“时间管理”——通过动态调控GPU资源,实现零等待的流水线并行。用网友的话说:“原来GPU也能学会左右互搏术?”

二、开发者集体狂欢:GitHub星图已炸

从今天凌晨开源到现在,GitHub上的盛况堪比春运:

- DeepEP刚上线就怒摘1800星

- 昨天开源的FlashMLA更夸张,24小时狂揽8400星

评论区已经变成大型段子现场:

“建议DeepSeek改名叫Deep卷,这开源速度比我刷短视频还快!”

“以前觉得AI训练费显卡,现在发现最费的是我的F5键…”

“别的公司开源要钱,DeepSeek开源要命——我的肝要不够用了!”

就连学界大佬都坐不住了:清华教授翟季冬揭秘,DeepSeek团队为了提升效率,居然用上了英伟达底层PTX语言来控制SM资源!这操作被网友戏称为“直接给GPU写血书”。

三、前方高能预警!神秘代码正在逼近

现在全网都在猜:DeepSeek开源列车下一站是啥?

- 有人押注是“让显卡原地起飞的显存优化神器”

- 有人赌五毛会是“让炼丹师集体失业的自动调参工具”

- 最离谱的猜测来自某匿名用户:“我怀疑他们在憋个能自动写周报的AI,毕竟程序员都去肝开源了…”

但有一件事可以确定——这周千万别早睡! 按照DeepSeek的“阴间作息”,昨天9:34发FlashMLA,今天10:24扔DeepEP,明天怕不是要搞个零点突袭?

(突然压低声音)说个内部消息:据说用了DeepEP后,某些实验室的训练成本直接砍半,负责人现在天天在办公室唱《好日子》…

最后灵魂拷问: 当别人家的AI还在学走路时,DeepSeek的MoE模型已经开着火箭往前冲了——所以问题来了,明天他们又要搞什么大新闻?反正我是准备好连夜蹲GitHub了,你呢?

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)