复旦NLP团队2025新书《大规模语言模型:从理论到实践(第2版)》重磅来袭!

各位读者朋友们,相信你一定还记得,在各大平台AI大模型图书推荐榜单中,《大规模语言模型:从理论到实践》一书始终位居排行榜前列,在2023年末那个时间点,这本书是少有的把大模型相关技术系统汇总整理,既有理论又有实践的。时隔不到两年,大语言模型领域的发展可谓突飞猛进,大语言模型的能力在多个方面实现了显著突破,在推理能力、上下文理解深度及多模态处理能力等方面取得了长足进步。特别是在 2024 年 12

各位读者朋友们,相信你一定还记得,在各大平台AI大模型图书推荐榜单中,**《**大规模语言模型:从理论到实践》 一书始终位居排行榜前列,在2023年末那个时间点,这本书是少有的把大模型相关技术系统汇总整理,既有理论又有实践的。

时隔不到两年,大语言模型领域的发展可谓突飞猛进,大语言模型的能力在多个方面实现了显著突破,在推理能力、上下文理解深度及多模态处理能力等方面取得了长足进步。特别是在 2024 年 12 月,DeepSeek-V3的发布,以及 2025 年 1 月 DeepSeek-R1 的问世,更是引发了国内外的广泛关注和强烈反响,我国在大语言模型领域取得了新的里程碑式进展。

与此同时,大语言模型在理论研究、预训练方法、后训练技术及解释性等方面也取得了重要进展。业界对大语言模型的研究更加深入,逐渐揭示出许多与传统深度学习和自然语言处理范式不同的特点。

例如,大语言模型仅需 60 条数据就能学习并展现出强大的问题回答能力,显示了其惊人的泛化性。然而,本书作者们也发现大语言模型存在一定的脆弱性。例如,在一个拥有 130 亿个参数的模型中,仅修改一个特定参数,就可能导致模型完全丧失生成有意义信息的能力。

这些发现促使本书的作者**“复旦大学NLP团队”张奇、桂韬、郑锐、黄萱菁** 几位老师对本书第 1 版进行修订升级,补充最新的研究成果和技术内容。

《大规模语言模型:从理论到实践(第2版)》的出版上市,希望可以让读者快速掌握大语言模型的研究与应用,更好地应对相关技术挑战,为推动这一领域的进步贡献力量。

这本《大规模语言模型:从理论到实践(第2版)》已经上传CSDN,还有完整版的大模型 AI 学习资料,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

PDF书籍: 完整版本链接获取

👉[CSDN大礼包🎁:《

大规模语言模型:从理论到实践(第2版)》免费分享(安全链接,放心点击)]👈

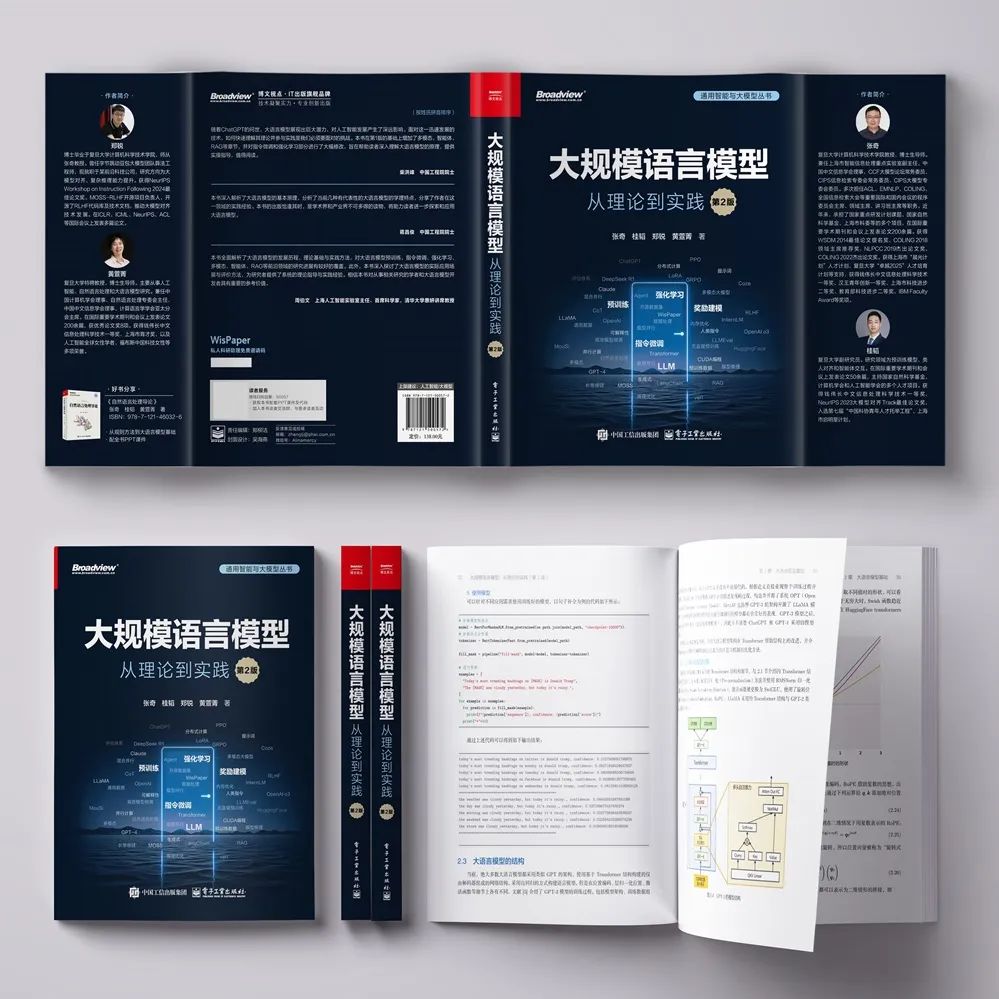

新增50%以上全新内容

《大规模语言模型:从理论到实践(第2版)》除对大语言模型的构建进行深入解析外,还进一步对如何增强大语言模型的能力、如何提升大模型的效率,以及如何将大语言模型应用于实际场景进行了深入讨论。

内容涵盖多模态大语言模型、大模型智能体、检索增强生成、大语言模型效率优化、大语言模型评估和大语言模型应用开发等多个热门方向,全面展示了当前大语言模型在不同领域的最新进展与应用潜力。

在本书第 1 版的基础上添加了 4 章全新内容,同时对其他章节进行了大量修订和重写。

- 新增内容覆盖MOE、多模态、智能体、RAG、大模型效率优化、预训练、指令微调、强化学习、对齐、评估、应用开发等多方面。

本书目录

向上滑动阅览

第 1章 绪论1

1.1 大语言模型的基本概念1

1.2 大语言模型的发展历程4

1.3 大语言模型的构建流程8

1.4 本书的内容安排10

第 2章 大语言模型基础13

2.1 Transformer结构13

2.1.1 嵌入表示层14

2.1.2 注意力层15

2.1.3 前馈层18

2.1.4 残差连接与层归一化19

2.1.5 编码器和解码器结构20

2.2 生成式预训练语言模型GPT 25

2.2.1 自监督预训练25

2.2.2 有监督下游任务微调26

2.2.3 预训练语言模型实践27

2.3 大语言模型的结构32

2.3.1 LLaMA的模型结构33

2.3.2 注意力机制优化39

2.4 混合专家模型46

2.4.1 稀疏混合专家模型47

2.4.2 稠密混合专家模型49

2.4.3 软混合专家模型50

2.5 实践思考51

第 3章 大语言模型预训练数据52

3.1 数据来源52

3.1.1 通用数据53

3.1.2 领域数据55

3.2 数据处理56

3.2.1 质量过滤56

3.2.2 冗余去除57

3.2.3 隐私消除58

3.2.4 词元切分59

3.3 数据影响分析64

3.3.1 数据规模64

3.3.2 数据质量66

3.3.3 数据多样性69

3.4 开源数据集70

3.4.1 Pile 70

3.4.2 ROOTS 73

3.4.3 RefinedWeb 75

3.4.4 CulturaX77

3.4.5 SlimPajama 78

3.5 实践思考82

第 4章 分布式训练83

4.1 分布式训练概述83

4.2 分布式训练的并行策略85

4.2.1 数据并行86

4.2.2 模型并行90

4.2.3 混合并行98

4.2.4 计算设备内存优化99

4.3 分布式训练的集群架构103

4.3.1 高性能计算集群的典型硬件组成103

4.3.2 参数服务器架构104

4.3.3 去中心化架构105

4.4 DeepSpeed实践110

4.4.1 基础概念112

4.4.2 LLaMA分布式训练实践115

4.5 实践思考126

第 5章 指令微调127

5.1 指令微调训练127

5.1.1 指令微调数据127

5.1.2 指令微调数据构建方法129

5.1.3 指令微调数据评估与影响135

5.1.4 指令微调训练策略141

5.1.5 开源指令数据集142

5.2 高效模型微调144

5.2.1 LoRA 144

5.2.2 LoRA的变体148

5.3 模型上下文窗口扩展150

5.3.1 具有外推能力的位置编码150

5.3.2 插值法151

5.4 DeepSpeed-Chat SFT实践153

5.4.1 代码结构155

5.4.2 数据预处理157

5.4.3 自定义模型159

5.4.4 模型训练161

5.4.5 模型推理162

5.5 实践思考162

第 6章 强化学习164

6.1 强化学习概述164

6.1.1 强化学习基础概念165

6.1.2 强化学习与有监督学习的区别166

6.2 策略梯度方法168

6.2.1 策略梯度168

6.2.2 REINFORCE算法170

6.2.3 广义优势估计171

6.2.4 近端策略优化算法173

6.2.5 RLOO算法175

6.2.6 GRPO算法177

6.3 推理模型的强化学习179

6.3.1 DeepSeek-R1 179

6.3.2 Kimi k1.5 182

6.4 基于人类反馈的强化学习185

6.4.1 基于人类反馈的强化学习流程185

6.4.2 奖励模型 186

6.5 verl实践191

6.6 实践思考199

第 7章 多模态大语言模型200

7.1 多模态大语言模型基础200

7.1.1 典型的多模态大语言模型201

7.1.2 多模态大语言模型的挑战204

7.2 大语言模型与多模态融合架构205

7.2.1 视觉语言模型架构205

7.2.2 语音语言模型架构209

7.2.3 多模态大语言模型架构213

7.3 多模态大语言模型训练策略217

7.3.1 数据处理218

7.3.2 视觉语义关联219

7.3.3 多模态文本对齐220

7.4 MiniGPT-4实践222

7.4.1 MiniGPT-4模型架构222

7.4.2 MiniGPT-4训练策略225

7.5 实践思考229

第 8章 大模型智能体231

8.1 智能体基础231

8.1.1 智能体发展历史231

8.1.2 大模型智能体应用范式232

8.2 大模型智能体架构235

8.2.1 感知模块236

8.2.2 规划模块237

8.2.3 记忆模块238

8.2.4 工具使用模块239

8.3 大模型智能体训练241

8.3.1 工具学习241

8.3.2 推理规划244

8.3.3 长期记忆250

8.4 大模型智能体实践252

8.4.1 手工编写代码252

8.4.2 LangChain框架259

8.4.3 智能体平台Coze实践276

8.5 实践思考279

第 9章 检索增强生成280

9.1 检索增强生成基础280

9.1.1 RAG系统的框架281

9.1.2 RAG任务分级282

9.1.3 RAG系统的难点286

9.2 Modular RAG架构287

9.2.1 索引模块288

9.2.2 检索前优化模块291

9.2.3 检索模块293

9.2.4 检索后优化模块296

9.2.5 生成模块297

9.2.6 编排模块298

9.3 RAG系统设计模式301

9.3.1 线性模式301

9.3.2 条件模式302

9.3.3 分支模式303

9.3.4 循环模式304

9.4 RAG系统优化306

9.4.1 文本嵌入模型微调306

9.4.2 查询优化308

9.4.3 幻觉感知的生成模型优化311

9.4.4 重排模型优化312

9.4.5 检索与生成联合优化315

9.5 RAG系统评估316

9.5.1 RAG系统评估的挑战316

9.5.2 评估目标317

9.5.3 评估数据集319

9.5.4 评估指标320

9.6 RAG实践324

9.6.1 构建基础RAG系统324

9.6.2 查询分解与检索结果融合的RAG系统326

9.7 实践思考328

第 10章 大语言模型效率优化330

10.1 效率优化基础330

10.2 模型优化334

10.2.1 Transformer代替架构334

10.2.2 模型量化336

10.2.3 模型稀疏化339

10.2.4 知识蒸馏342

10.3 低精度训练345

10.3.1 FP8编码345

10.3.2 FP8大语言模型训练346

10.4 高效推理351

10.4.1 算法级别的推理优化351

10.4.2 系统级别的推理优化356

10.5 vLLM推理框架实践358

10.6 实践思考361

第 11章 大语言模型评估362

11.1 模型评估概述362

11.2 大语言模型评估体系364

11.2.1 知识与能力364

11.2.2 伦理与安全367

11.2.3 垂直领域371

11.3 大语言模型评估方法376

11.3.1 评估指标376

11.3.2 评估方法381

11.4 大语言模型评估实践386

11.4.1 基础模型评估387

11.4.2 SFT模型和RL模型评估389

11.5 实践思考399

第 12章 大语言模型应用开发401

12.1 大语言模型典型应用场景401

12.1.1 内容创作与生成401

12.1.2 对话系统与聊天机器人402

12.1.3 翻译与多语言处理403

12.1.4 信息抽取与知识图谱404

12.1.5 代码生成与编程辅助404

12.1.6 智能搜索与推荐405

12.1.7 教育与培训406

12.1.8 企业管理与决策支持407

12.1.9 法律与合规407

12.2 大语言模型应用开发案例408

12.2.1 浏览器智能插件408

12.2.2 论文搜索助理412

12.3 大语言模型本地部署实践413

12.3.1 llama.cpp 414

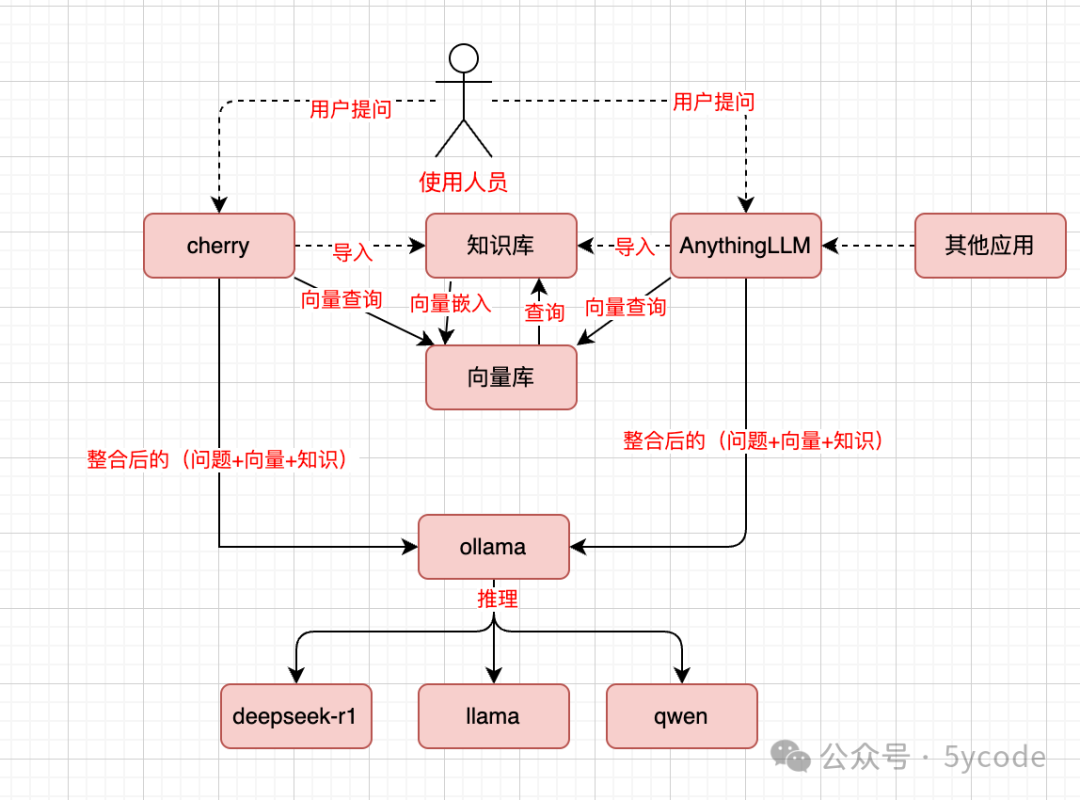

12.3.2 Ollama 417

12.3.3 Open WebUI 419

12.4 实践思考420

参考文献 422

索引 451

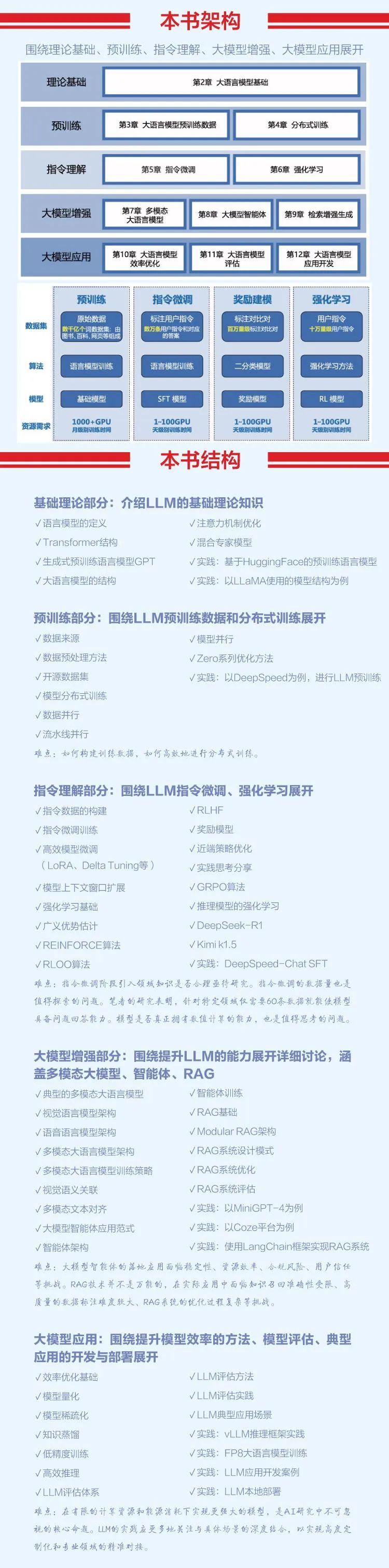

本书共分为12章,围绕大语言模型基础理论、预训练、指令理解、大模型增强和大模型应用五个部分展开。

第1部分介绍大语言模型的基础理论。

第2部分介绍大语言模型的预训练,包括大语言模型预训练数据和分布式训练。

第3部分介绍大语言模型如何理解并服从人类指令,包括指令微调和强化学习。

第4部分介绍大语言模型增强技术,包括多模态大语言模型、大模型智能体和检索增强生成。

第5部分介绍大模型应用,包括大语言模型效率优化、大语言模型评估和大语言模型应用开发。

这本《大规模语言模型:从理论到实践(第2版)》已经上传CSDN,还有完整版的大模型 AI 学习资料,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

PDF书籍: 完整版本链接获取

👉[CSDN大礼包🎁:《

大规模语言模型:从理论到实践(第2版)》免费分享(安全链接,放心点击)]👈

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)