国产大模型DeepSeek-V3开源后刷屏,性能比肩GPT-4o!

为自研 MoE 模型,671B 参数,激活 37B,在 14.8T token 上进行了预训练。当前版本的 DeepSeek-V3 暂不支持多模态输入输出。

DeepSeek-V3 是一款 671B 的专家混合(Mixture of Experts,MoE)模型,它在性能上与 Sonnet 3.5 和 GPT-4o 等重量级模型的表现相当。671B 参数,激活 37B,在 14.8T token 上进行了预训练。当前版本的 DeepSeek-V3 暂不支持多模态输入输出。

| 89903 | |

| 14485 |

主要特点

-

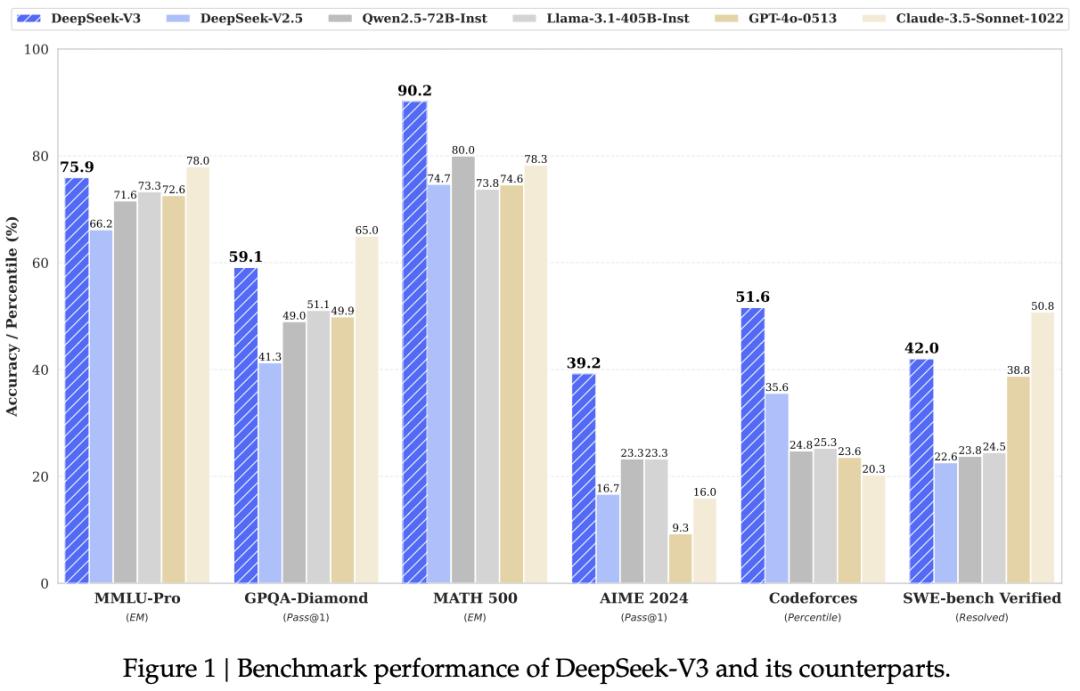

性能对齐海外领军闭源模型:多项评测成绩超越了 Qwen2.5-72B 和 Llama-3.1-405B 等其他开源模型,并在性能上和世界顶尖的闭源模型 GPT-4o 以及 Claude-3.5-Sonnet 不分伯仲

-

百科知识:DeepSeek-V3 在知识类任务(MMLU, MMLU-Pro, GPQA, SimpleQA)上的水平相比前代 DeepSeek-V2.5 显著提升,接近当前表现最好的模型 Claude-3.5-Sonnet-1022。

-

长文本:长文本测评方面,在DROP、FRAMES 和 LongBench v2 上,DeepSeek-V3 平均表现超越其他模型。

-

代码:DeepSeek-V3 在算法类代码场景(Codeforces),远远领先于市面上已有的全部非 o1 类模型,并在工程类代码场景(SWE-Bench Verified)逼近 Claude-3.5-Sonnet-1022。

-

数学:在美国数学竞赛(AIME 2024, MATH)和全国高中数学联赛(CNMO 2024)上,DeepSeek-V3 大幅超过了所有开源闭源模型。

-

中文能力:DeepSeek-V3 与 Qwen2.5-72B 在教育类测评 C-Eval 和代词消歧等评测集上表现相近,但在事实知识 C-SimpleQA 上更为领先。

-

-

生成速度提升至 3 倍:生成吐字速度从 20 TPS 大幅提高至 60 TPS,相比 V2.5 模型实现了 3 倍的提升

-

无辅助损失的负载均衡策略:通过动态监控并调整专家的工作负载,让它们均衡运行,同时不影响整体模型性能。

-

多词元预测(MTP):支持模型同时预测多个未来词元。

Hugging Face: https://huggingface.co/deepseek-ai/DeepSeek-V3-Base

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)