deepseek从入门到精通(1)

DeepSeek:从入门到精通》(清华版)读书笔记(1)资料分享:https://pan.baidu.com/s/1sI0ZoOtFne5Qte7ccJcgAg?pwd=mgbv提示语( Prompt) 是用户输入给AI系统的指令或信息,用于引导AI生成特定的输出或执行特定的任务。简单来说 ,提示语就是我们与AI“对话” 时所使用的语言,它可以是一个简单的问题 ,一段详细的指令,也可以是一个复杂的

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

前言

《DeepSeek:从入门到精通》(清华版)读书笔记(1)

资料分享:https://pan.baidu.com/s/1sI0ZoOtFne5Qte7ccJcgAg?pwd=mgbv

一、DeepSeek是什么

DeepSeek是一家专注通用人工智能(AGI)的中国科技公司,主攻大模型研发与应用。

DeepSeek-R1是其开源的推理模型 ,擅长处理复杂任务且可免费商用。

二、DeepSeek可以做什么

直接面向用户或者支持开发者 ,提供智能对话 、文本生成 、语义理解 、计算推理 、代码生成补全等应用场景,支持联网搜索与深度思考模式,同时支持文件上传,能够扫描读取各类文件及图片中的文字内容。

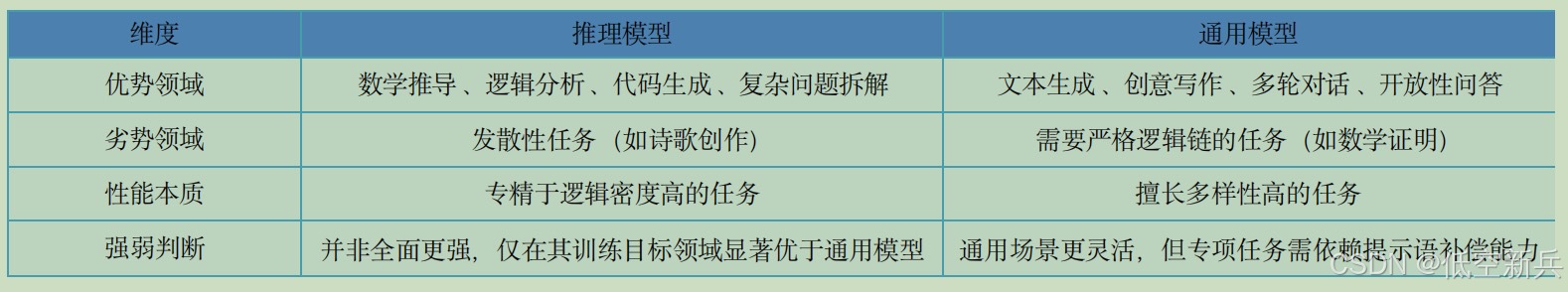

三、推理模型和通用模型

推理大模型: 推理大模型是指能够在传统的大语言模型基础上,强化推理 、逻辑分析和决策能力的模型 。它们通常具备额外的技术,比如强化学习 、神经符号推理 、元学习等 ,来增强其推理和问题解决能力。

例如:DeepSeek-R1,GPT-o3在逻辑推理 、数学推理和实时问题解决方面表现突出。

非推理大模型: 适用于大多数任务,非推理大模型一般侧重于语言生成 、上下文理解和自然语言处理,而不强调深度推理能力 。此类模型通常通过对大量文本数据的训练,掌握语言规律并能够生成合适的内容 ,但缺乏像推理模型那样复杂的推理和决策能力 。

例如:GPT-3 、GPT-4( OpenAI),BERT( Google),主要用于语言生成 、语言理解 、文本分类 、翻译等任务。

四、提示语

(一)什么是提示语

提示语( Prompt) 是用户输入给AI系统的指令或信息,用于引导AI生成特定的输出或执行特定的任务 。简单来说 ,提示语就是我们与AI“对话” 时所使用的语言,它可以是一个简单的问题 ,一段详细的指令,也可以是一个复杂的任务描述。

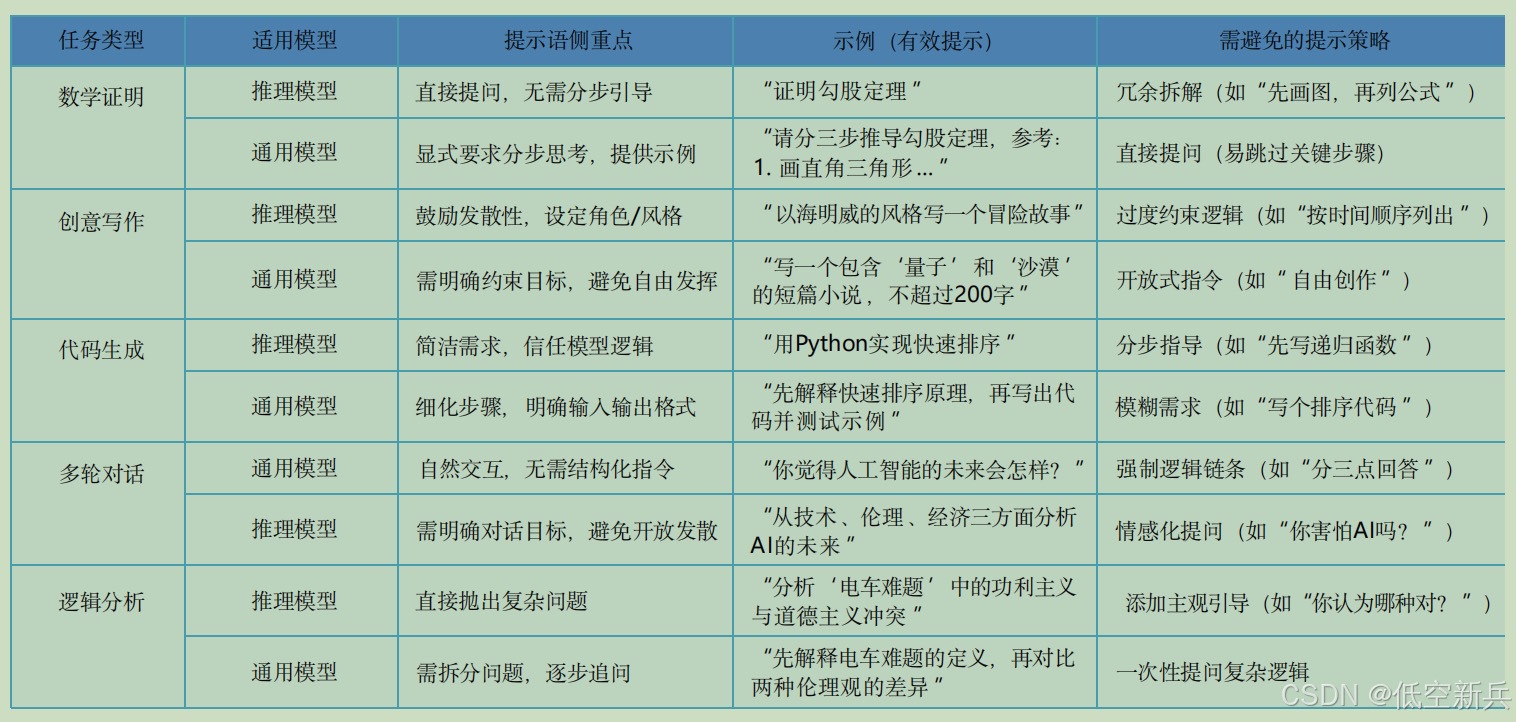

(二)提示语策略差异

1.推理模型(适用数学任务,简介指令,聚焦目标,信任其内化能力,要什么直接说)

(1)提示语更简洁,只需明确任务目标和需求(因其已内化推理逻辑)

(2)无需逐步指导,模型自动生成结构化推理过程(若强行拆解步骤,反而可能限制其能力)

(3)不要对推理模型用“启发式”提示(如角色扮演),可能干扰其逻辑主线。

2.通用模型(适用创意任务,结构化,补偿性引导,缺什么补什么)

(1)需显式引导推理步骤(如通过CoT提示),否则可能跳过关键逻辑)

(2)依赖提示语补偿能力短板(如要求分布思考、提供事例)

(3)不要对通用模型“过度信任”(如直接询问复杂推理问题,需分步验证结果)

(三)提示语示例

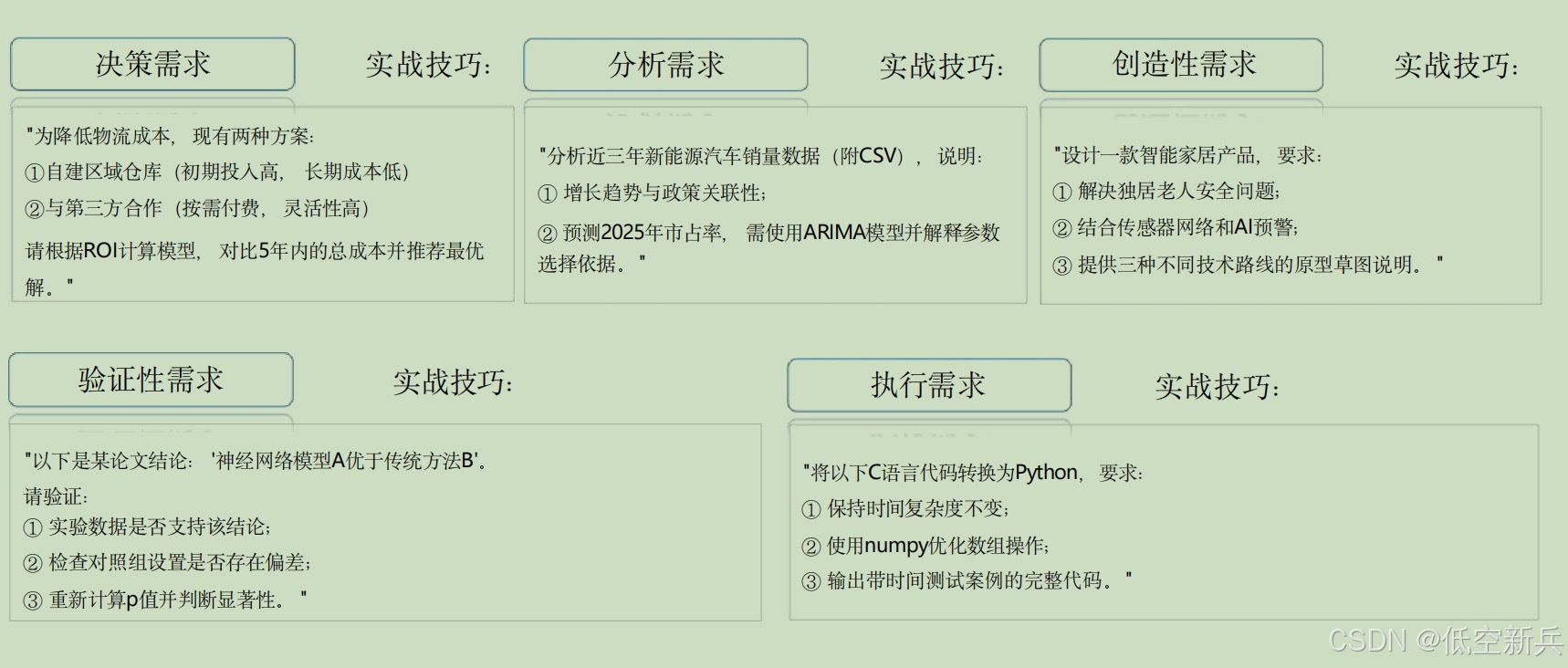

(四)调教AI的秘籍

1.精准定义任务,减少模糊性。

明确的核心问题,具体化的生成指令,去除多余信息。

2.适当分解复杂任务,降低AI认知负荷。

分段生成,逐层深入,设置逻辑结构。

3.引入引导性问题,提升生成内容的深度。

设置多个层次的问题,促使AI对比或论证,引导思维的多样性。

4.控制提示语长度,确保生成的准确性。

避免嵌套复杂的指令,保持简洁性,使用分布提示。

5.灵活运用开放式提示与封闭性提示。

开放性提示:提出开放性问题,允许AI根据多个角度进行生成。

封闭式提示:提出具体问题或设定明确限制,要求AI给出精准回答。

(五)常见陷阱与应对(提示语设计误区)

1.缺乏迭代陷阱:期待一次性完美结果

陷阱症状:

(1)过度复杂的初始提示语;

(2)对初次输出结果不满意就放弃;

(3)缺乏对AI输出的分析和反馈

应对策略:

(1)采用增量方法:从基础提示语开始 ,逐步添加细节和要求。

(2)主动寻求反馈:要求AI对其输出进行自我评估,并提供改进建议 。

(3)准备多轮对话:设计一系列后续问题,用于澄清和改进初始输出。

2.过度指令和模糊指令陷阱:当细节淹没重点或意图不明确

陷阱症状:

(1)提示语异常冗长或过于简短

(2)AI输出与期望严重不符

(3)频繁需要澄清或重新解释需求

应对策略:

(1)平衡详细度 :提供足够的上下文 ,但避免过多限制。

(2)明确关键点:突出最重要的2-3个要求。

(3)使用结构化格式:采用清晰的结构来组织需求。

(4)提供示例:如果可能 ,给出期望输出的简短示例。

3.当AI只告诉你想听的

陷阱症状:

(1)提示语中包含明显立场或倾向

(2)获得的信息总是支持特定观点

(3)缺乏对立或不同观点的呈现

应对策略:

(1)自我审视:在设计提示语时 ,反思自己可能存在的偏见。

(2)使用中立语言 :避免在提示语中包含偏见或预设立场。

(3)要求多角度分析:明确要求AI提供不同的观点或论据。

(4)批判性思考:对AI的输出保持警惕 ,交叉验证重要信息。

4.当AI自信地胡说八道

陷阱症状:

(1)AI提供的具体数据或事实无法验证。

(2)输出中包含看似专业但实际上不存在的术语或概念。

(3)对未来或不确定事件做出过于具体的预测。

应对策略:

(1)明确不确定性:鼓励AI在不确定时明确说明。

(2)事实核查提示:要求AI区分已知事实和推测。

(3)多源验证:要求AI从多个角度或来源验证信息。

(4)要求引用:明确要求AI提供信息来源 ,便于验证。

5.低估AI的伦理限制

陷阱症状:

(1)要求AI生成有争议 、不道德或非法内容。

(2)对AI的拒绝或警告感到困惑或不满 。

(3)尝试绕过AI的安全机制。

(4)忽视AI输出可能带来的伦理影响。

应对策略:

(1)了解界限:熟悉AI系统的基本伦理准则和限制 。

(2)合法合规:确保你的请求符合法律和道德标准 。

(3)伦理指南:在提示语中明确包含伦理考虑和指导原则。

(4)影响评估:要求AI评估其建议或输出的潜在社会影响。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)