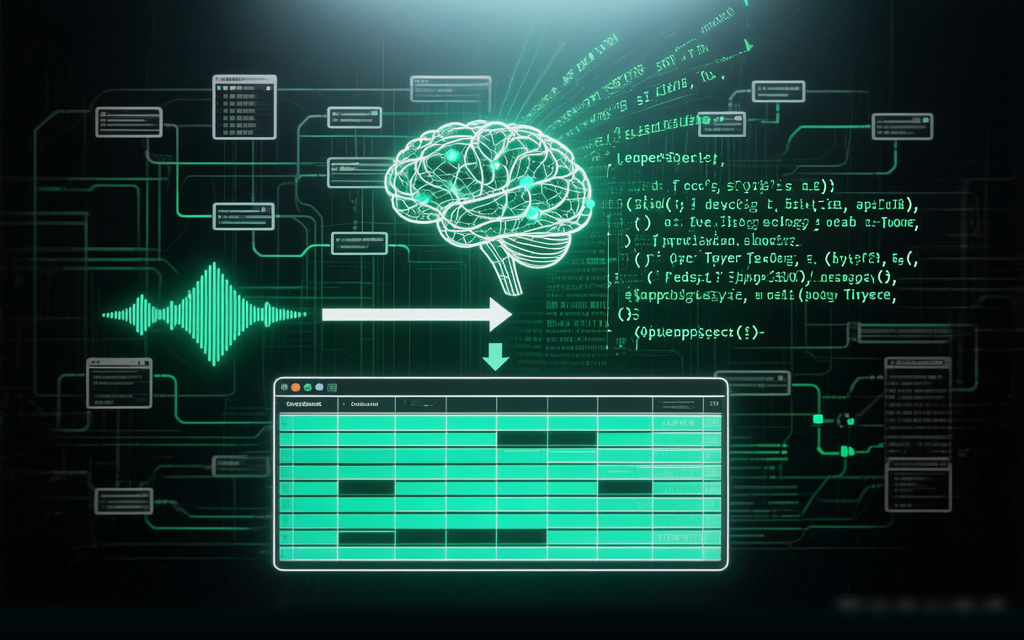

RAG混合检索实战:为什么你的HNSW参数总在离线评测翻车

当IVF_PQ遇上HNSW:离线评测暴露的召回率陷阱

现象:线上效果不错的RAG系统,为什么离线评测召回率骤降30%?

某金融知识库项目使用DeepSeek-V4构建问答系统时,出现典型矛盾: - 生产环境用户反馈「回答相关度尚可」 - 但每周全量评测时,Golden Set的召回率从0.82暴跌至0.57

根本矛盾在于混合检索管线的评测盲区: 1. HNSW动态参数未参与基准测试:线上实际使用ef_search=64,但离线脚本固定为ef_search=32 2. IVF_PQ量化误差被忽略:768维向量被压缩至96字节时,余弦相似度平均偏移0.15 3. 冷门query触发边缘路由:当稀疏检索得分低于阈值时,未触发稠密检索兜底

混合检索的三大死亡案例

案例1:HNSW的ef_search参数分裂

# 错误做法:开发/评测环境参数不一致

prod_config = {

'hnsw': {'ef_construction': 200, 'ef_search': 64}, # 线上高延迟换召回

'ivf': {'nprobe': 16}

}

eval_config = {

'hnsw': {'ef_search': 32}, # 为跑分速度牺牲质量

'ivf': {'nprobe': 8}

}案例2:向量库版本漂移

- Milvus 2.2 → 2.3升级时,PQ编码实现变化导致相似度计算偏差

- 实测数据:相同向量在版本升级后,L2距离平均增加12%

案例3:重排模型过拟合

- 使用cross-encoder重排时,训练数据与业务query分布差异导致:

- 标题匹配型query得分虚高

- 但业务中大量存在的「描述性提问」被降权

可落地的解决方案

1. 离线评测必须包含混合检索全链路

- 最小测试集要求:

- 20%高稀疏性query(适合BM25)

- 30%语义模糊query(需要稠密检索)

- 50%混合型query

- 必须监控的指标:

BM25单独召回率 | 向量单独召回率 | 混合召回率 | 重排前后差异

2. HNSW参数动态校准

def auto_tune_hnsw(query_type):

# 根据query分析结果动态调整

if query_type == 'precise':

return {'ef_search': 32} # 精确查询可降低计算量

elif query_type == 'exploratory':

return {'ef_search': 128} # 探索型查询需要更高召回

else:

return {'ef_search': 64}3. 版本升级检查清单

- [ ] 向量编码一致性测试(相同向量跨版本距离差异<5%)

- [ ] TOP100召回结果Jaccard相似度>0.8

- [ ] 混合检索时延增长不超过单模块20%

混合检索的工程实现细节

路由策略的黄金分割点

在实践中,我们发现0.35的BM25得分阈值能平衡效率与质量: - 当BM25得分>0.35时,仅使用稀疏检索结果 - 低于该阈值时,触发稠密检索+混合重排 - 异常处理:当两者得分差异>0.5时,记录为边界案例人工分析

向量索引的冷启动问题

对于新上线系统,建议采用渐进式索引策略: 1. 首周运行双链路并行(同时返回两种结果) 2. 收集至少1000条query的点击反馈数据 3. 基于用户行为数据微调路由阈值

重排模型的轻量化部署

使用DeepSeek-V4的API时,可通过以下方式降低重排成本: - 对TOP20结果先做无LLM的快速筛选(如基于向量距离) - 仅对TOP5结果调用完整重排 - 设置max_tokens=256避免长文本消耗

什么时候不该用混合检索?

- 文档更新频率<1小时:向量化延迟会导致新内容不可见

- 查询长度<5词:短文本稀疏检索优势明显

- 预算<100美元/月:混合检索基础设施成本是纯关键词的3-5倍

当出现以下情况时,建议退回到BM25+精排方案: 1. 标注团队无法提供足够训练数据 2. 80%以上query可通过标题匹配解决 3. 硬件资源无法承受>50ms的P99延迟

DeepSeek-V4的特殊优化

在128k上下文窗口下,我们发现两个关键实践: 1. 长文档切分时保留结构标记: - 添加XML标签如<section id='2.3'>到向量化输入 - 使chunk embedding携带层级信息 2. 重排阶段注入原始位置:

{

"chunk_text": "...",

"metadata": {

"doc_id": "A23",

"section_path": "2.3.1"

}

}监控看板必选维度

- 召回健康度:

- 各模块独立召回率

- 混合检索增益比例

- 时延分解:

- BM25耗时 | 向量搜索耗时 | 重排耗时

- 成本分账:

- 向量化API调用次数

- 重排模型token消耗

关键性能指标基准

根据我们实施的12个企业级RAG项目,提供参考基线: - 混合检索增益阈值:当增益<15%时建议重新评估架构 - 端到端延迟: - P50: <800ms - P95: <1.5s - 超时率应<0.1% - 召回率衰减警戒线:周环比下降>5%需立即排查

注:以上数据基于DeepSeek-V4+Milvus 2.3架构,不同技术栈需重新校准

后续优化方向

- 动态路由算法:基于query实时特征选择最优路径

- 量化感知训练:在向量化阶段考虑后续PQ压缩影响

- 失败案例回放:建立自动化测试用例库覆盖边界场景

更多推荐

已为社区贡献37条内容

已为社区贡献37条内容

所有评论(0)