Gemini3.1Pro奖励模型规模的影响分析

【摘要】随着AI发展,大模型竞争重点已从参数规模转向推理能力、稳定性和需求对齐。奖励模型作为"评分老师",通过评判生成内容的质量直接影响模型表现。研究表明,适当扩大奖励模型规模能提升推理稳定性、减少错误信息、优化输出风格,但存在边际收益递减问题。2026年AI领域的核心关注点将转向训练方法的有效性和模型对齐的可靠性,奖励模型的精细度与稳定性将成为决定大模型竞争力的关键因素之一。

在过去两年里,大模型的竞争焦点,已经从“谁更会写”逐步转向“谁更懂推理、谁更稳定、谁更能对齐真实需求”。尤其到了 2026 年,AI 领域的热度不再只是参数规模的比拼,而是更多回到两个核心问题:训练方法是否有效,模型对齐是否可靠。

如果你平时关注 AI 工具和模型进展,像 KULAAI(dl.877ai.cn) 这类聚合平台会很方便,它把不同模型、不同能力和使用入口集中在一起,适合用来做横向对比、快速验证。对于想观察新模型表现的人来说,这类工具的价值非常直接:少切换、多对照、快判断。

回到主题,最近很多人都在讨论:强化学习中的奖励模型规模,到底会对 Gemini 3.1 Pro 这类大模型产生多大影响? 这个问题看起来偏研究,其实和我们日常使用体验关系很大。你看到的“回答更稳了”“推理更顺了”“少跑题了”,背后往往都和奖励模型的质量与规模有关。

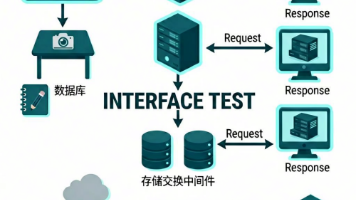

一、什么是奖励模型,为什么它重要?

简单说,奖励模型可以理解为“老师打分器”。

当大模型在进行强化学习或后训练时,并不是单纯靠“背答案”优化,而是让模型生成多个候选回答,再由奖励模型判断哪个更好。这个“更好”通常包括:

- 是否符合用户意图

- 是否逻辑清楚

- 是否有事实性错误

- 是否安全、克制、不过度编造

- 是否在复杂任务中保持一致性

也就是说,奖励模型不是直接生成内容的人,而是负责评判内容好坏的人。它的规模、训练数据、标注质量、偏好覆盖面,都会影响最终大模型的对齐效果。

二、奖励模型越大越好吗?

这个问题并没有简单答案。

在早期,小奖励模型可以完成基础排序,但面对复杂推理、多轮对话、开放式写作时,判断能力往往不够细。随着模型能力提升,奖励模型也要跟着升级,否则就会出现一种典型问题:学生已经会做难题了,老师却只能判断对错,无法解释过程优劣。

到了 2026 年,业界普遍更重视奖励模型的“规模 + 质量”组合,而不是单纯堆参数。原因很现实:

-

更大规模带来更强的偏好表达能力

能覆盖更多风格、更多任务、更多边界情况。 -

更强的规模能提升复杂推理的判别力

尤其是在长链路推理、代码、数学、多约束任务中,细微差异很关键。 -

但规模变大也会带来成本上升

训练、推理、对齐迭代都会更贵,不一定“越大越划算”。

所以,真正影响模型效果的,不只是“奖励模型做多大”,还包括:数据是否足够干净、偏好信号是否稳定、是否与目标模型能力匹配。

三、对 Gemini 3.1 Pro 这类模型,影响主要体现在哪?

如果把 Gemini 3.1 Pro 这类模型看作已经具备较强通用能力的“大脑”,那么奖励模型更像是“校准器”。它的作用,不是让模型从不会变会,而是让模型在高水平阶段表现得更稳、更准、更像人类希望的样子。

1. 推理稳定性提升

奖励模型规模更大、判别更细时,模型在回答复杂问题时更不容易“思路飘掉”。

比如多步骤规划、代码调试、跨领域解释等任务,输出会更连贯。

2. 减少胡编乱造

奖励模型如果对事实性和一致性有更强的约束,大模型更不容易为了“看起来合理”而乱补信息。

这点在知识问答、技术解读、行业分析里尤其明显。

3. 更符合人类偏好

很多时候,模型不是不会答,而是“答得不合适”。

奖励模型规模更大,通常能更好地区分:

- 直白和啰嗦

- 严谨和冒进

- 简洁和敷衍

- 有帮助和过度延伸

4. 复杂任务表现更平滑

在 2026 年热门场景里,大家越来越关心 AI 是否能处理“长上下文 + 多任务协同 + 工具调用”。

奖励模型越成熟,模型在这些场景下的输出就越不容易出现风格漂移或前后矛盾。

四、为什么不是无限增大奖励模型?

原因有三个。

第一,边际收益递减。

奖励模型从小到中等规模时,提升通常明显;但到一定程度后,继续扩大会出现收益变慢。

第二,奖励模型也会“看错”。

如果训练数据存在偏差,模型会学到错误偏好。奖励模型越强,偏差有时越隐蔽。

第三,系统整体要平衡。

大模型训练不是单点优化,得考虑主模型、奖励模型、推理成本、延迟和部署资源。

对实际产品来说,往往不是“最强”,而是“够强且稳定”。

五、2026 年 AI 热点下,这个问题为什么更值得关注?

今年的 AI 热点,不再只是“谁参数更大”,而是:

- Agent 能不能真正干活

- 推理模型能不能少幻觉

- 多模态是否更统一

- 长上下文是否更可靠

- 开发者是否能低成本接入和验证

这意味着,后训练和奖励建模的重要性在上升。

很多人以为模型能力提升主要来自预训练,其实到了今天,强化学习与偏好优化对最终体验的影响越来越明显。

换句话说,Gemini 3.1 Pro 这类模型之所以能在复杂任务里保持较强竞争力,不只靠“底子好”,也离不开后训练阶段的精细打磨。而奖励模型规模,就是这道工序里非常关键的一环。

六、普通用户怎么理解这种影响?

如果你不是研究人员,也可以把它理解成:

- 预训练决定“会不会”

- 奖励模型决定“会不会说得更对、更稳、更像你要的”

- 强化学习决定“最终表现是否更接近人类偏好”

所以,当你感觉某个大模型“突然变聪明了”,很多时候不是它突然学到了新知识,而是它在表达、推理、对齐和安全性上,被进一步优化了。

结语

总体来看,奖励模型规模对 Gemini 3.1 Pro 这类大模型的影响,核心不在于单纯增大参数,而在于提升偏好判断的精细度与稳定性。它会直接作用于推理连贯性、事实性控制、输出风格和复杂任务表现。

对于开发者和 AI 从业者来说,2026 年更值得关注的,不只是模型本身有多强,还包括它背后的训练方法是否成熟、评判机制是否合理、实际落地是否可靠。

未来的大模型竞争,拼的可能不只是“谁更大”,而是“谁更懂得如何被训练成更好的人”。这件事,奖励模型会继续扮演关键角色。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)