DeepSeek V4 全面解读:百万上下文开源模型的普惠之路

DeepSeek V4系列大模型震撼发布,带来百万token上下文窗口和革命性架构创新。包含1.6万亿参数的Pro版和2840亿参数的Flash版,采用混合注意力机制(CSA+HCA)将计算量降至前代的27%,实现超低成本推理。在编程竞赛、知识问答等多项评测中超越主流开源模型,部分指标接近顶级闭源产品。定价仅为Claude Opus的1/200,MIT开源协议使其成为开发者新选择。该系列通过架构优

2026年4月24日,DeepSeek在没有任何预热的情况下,将V4系列预览版推送上线。距离上一代主力模型V3发布,整整过去了484天。在这484天里,AI圈经历了多轮洗牌——OpenAI迭代了至少四次,Anthropic也推出了两版以上的模型更新。DeepSeek在这个期间几乎没有任何大版本动作,一度被外界质疑是否掉队。

现在看来,沉默是因为在憋一个更大的。

一、DeepSeek V4是什么?

简单说,DeepSeek V4是DeepSeek推出的新一代大语言模型系列预览版。它拥有百万字超长上下文窗口,在Agent能力、世界知识与推理性能方面达到开源领域领先水平。

系列包含两个版本:DeepSeek-V4-Pro和DeepSeek-V4-Flash。Pro版总参数量1.6万亿,每次推理激活490亿参数,是目前全球最大的开源MoE模型,超越了阿里Kimi K2.6的1.1万亿和智谱GLM-5.1的7540亿。Flash版是轻量选手,2840亿总参数、130亿激活参数,主打极速和极低成本的日常推理。

两个版本有几个共同标配:100万token原生上下文窗口、支持非思考与思考双模式推理、MIT开源协议。用一句大白话说:去年还是“旗舰专属”的百万上下文能力,被DeepSeek做成了全系标配。

定价上更是直接拉开了差距:

| 版本 | 输入(缓存命中) | 输入(未命中) | 输出(每百万token) |

|---|---|---|---|

| V4-Pro | 1元 | 12元 | 24元 |

| V4-Flash | 0.2元 | 1元 | 2元 |

作为参照,Claude Opus 4.6的输入定价约150元/百万token,Sonnet 4.6约105元。V4-Flash的输出价格,只有Claude Opus 4.7的两百分之一左右。这不是烧钱补贴打价格战,而是架构效率提升带来的真实成本下降——这一点后面会细说。

需要提醒的是,Pro版本当前服务吞吐量有限。官方预计下半年华为昇腾950超节点大批量上市后,价格会有更大幅度的下调。此外,旧版API接口(deepseek-chat和deepseek-reasoner)将于2026年7月24日停用,届时将统一迁移到V4的接口体系。

二、V4能做什么?

第一,百万上下文的超长文本处理。

原生支持100万token的上下文窗口。这意味着你可以一次性扔进去三本《三体》体量的小说,或者一整年的财报合集,模型能在全文范围内做跨章节推理和理解。这是官方服务的标配,不是需要额外付费解锁的“高级功能”。

第二,Agent编码能力显著增强。

这可能是V4最被开发者关注的升级点。模型针对Claude Code、OpenClaw、CodeBuddy等主流Agent框架做了专项优化,支持跨用户消息边界的连贯推理保留。内部R&D基准测试中(约200个来自50多位工程师的真实工作任务),V4-Pro-Max通过率67%,优于Claude Sonnet 4.5的47%,交付质量接近Opus 4.6非思考模式。

不是让模型帮你补全一行代码,而是给它一个任务——“把这个模块的功能改完,跑通所有测试,出个PR”——它能自己读代码、规划步骤、调用工具、执行改动、验证结果,整个链路自己走完。

第三,双模式推理。

模型支持非思考模式和思考模式。复杂Agent场景下建议启用思考模式,通过reasoning_effort参数调节推理强度(设为max时效果最强)。非思考模式则用于日常对话和简单任务,速度更快。

第四,知识密集型问答。

V4在世界知识和教育知识评测上大幅领先前代开源模型,中文知识方面优势尤为明显,适合教育、科研、专业咨询等场景。白领日常办公的中文写作、信息分析、文档生成编辑等任务也表现稳定。

第五,多领域专家融合。

通过OPD(在线策略蒸馏)技术,模型整合了数学、代码、Agent等多个领域的专家能力,不用在不同模型之间来回切换。

三、架构上的“降本”才是真本事

Transformer模型处理长文本有一个致命问题:注意力机制的计算量随上下文长度呈平方级增长。上下文翻一倍,计算量可能翻四倍。这也是为什么百万级上下文的模型要么需要天价算力,要么只能活在论文里。

DeepSeek V4动了一个大手术:把注意力机制拆成两套,交替使用。

**CSA(压缩稀疏注意力)**负责精准抓取。它把每4个token的KV缓存压缩成1个摘要条目,然后通过Lightning Indexer计算索引分数,执行Top-k稀疏选择,只唤醒最重要的1024个条目参与计算。最后配合一个128 token的滑动窗口和Attention Sink机制,保留局部依赖,避免模型“抓大放小”时丢掉关键细节。

**HCA(重度压缩注意力)**负责全局视野。它直接做128倍的大幅压缩,把一长串token合并为单个条目,然后对整个压缩后的序列做密集注意力,但不采用稀疏选择。这能帮助模型在极低成本下捕捉横跨数十万token的远距离依赖。

两套注意力层交替堆叠,一个在细处精准抓取,一个在全局范围感知模式。最终的效果是:在100万token上下文下,V4-Pro单token推理所需的计算量仅为V3.2的27%,KV缓存占用仅10%。V4-Flash更低,分别只有10%和7%。

V3.2已经是以效率著称的模型了,V4在此基础上又砍掉了七成以上的算力开销。

除此之外,V4还有几个关键技术组件:

- mHC(流形约束超连接):传统残差连接在极深网络里容易导致信号不稳定,mHC将残差映射矩阵通过Sinkhorn-Knopp算法投影到双随机矩阵流形,约束谱范数不超过1,保证深层信号传播的稳定性。

- Muon优化器:替代了行业标配的AdamW。通过混合Newton-Schulz迭代对梯度矩阵执行正交化,分快速收敛和精确稳定两个阶段,支持大规模MoE的高效训练。这是Muon在千亿级模型上的首次大规模验证。

- FP4量化感知训练:对MoE专家权重和CSA索引器的QK路径做FP4量化存储,用FP8扩展动态范围实现无损反量化,进一步降低内存与计算开销。未来硬件支持到位后,理论上还能再提升约三分之一的效率。

这些名词堆在一起可能像天书,但背后的逻辑就一条:不靠堆算力把模型做大,而是用架构创新把每一分算力花在该花的地方。DeepSeek的底色一直不是“快”,而是“省”和“稳”。

四、性能到底怎么样?

知识能力

SimpleQA验证集上得分57.9%,超越所有已评测开源模型约20个百分点,仅次于Gemini-3.1-Pro的75.6%。中文知识方面优势更明显,Chinese-SimpleQA达到84.4%,大幅领先Kimi K2.6的75.9%和GLM-5.1的75.0%。教育知识上,MMLU-Pro 87.5%、GPQA Diamond 90.1%,与GPT-5.4持平,略低于Gemini-3.1-Pro。

推理与代码

数学竞赛方面,HMMT 2026 Feb得分95.2%,IMOAnswerBench达到89.8%,超越K2.6和GLM-5.1,接近GPT-5.4和Opus 4.6。代码竞赛层面,Codeforces评分3206——这是开源模型首次在这个硬指标上追平闭源顶级模型,与GPT-5.4的3168分相当,当前全球人类选手排名第23位。

高难度推理上,Apex Shortlist达到90.2%,超越GPT-5.4的78.1%和Opus 4.6的85.9%。LiveCodeBench Pass@1得分93.5%,领先全部对比模型,包括Claude Opus 4.6的88.8%和Gemini 3.1 Pro的91.7%。

Agent能力

软件工程基准SWE Verified达到80.6%,与Claude Opus 4.6的80.8%基本持平;多语言版本SWE Multilingual 76.2%。终端操作Terminal Bench 2.0达到67.9%,超越Opus 4.6的65.4%、K2.6的66.7%和GLM-5.1的63.5%。

工具调用泛化方面,MCPAtlas Public 73.6%、Toolathlon 51.8%,在覆盖广泛工具和MCP服务的评测中表现突出。这说明模型不是只会写代码,而是真正能调用外部工具完成复杂工作流。

长上下文能力

MRCR 1M百万级检索得分83.5%,超越Gemini-3.1-Pro的76.3%,但距离Claude Opus 4.6 Max的92.9%仍有明显差距。128K以内的检索性能高度稳定,1M时仍能保持较强能力。真实场景长文档理解CorpusQA 1M得分62.0%,优于Gemini-3.1-Pro的53.8%。

总体来看,DeepSeek官方在技术报告里的自我评价相当诚实:与最先进闭源模型在知识与推理上大约还有三到六个月的差距。在满血表现上,V4的Agent编程体验优于Sonnet 4.5,交付质量接近Opus 4.6非思考模式,但和Opus 4.6思考模式之间仍有一段路要走。

五、V4与Claude的比较

当业界评价V4时,Claude是绕不开的参照系。Claude是Anthropic旗下的闭源模型系列,从4.0到4.6再到4.7,每次迭代都在推理、知识、编码和长文本能力上持续突破,代表了当前闭源商业模型的顶级水平。

V4和Claude的对比,可以从几个维度展开。

模型本身的能力层面

在编程竞赛类硬指标上,V4-Pro已经在LiveCodeBench(93.5% vs 88.8%)和Codeforces(3206 vs Claude未公开同口径评分)两个维度上超过了Claude Opus 4.6。在软件工程真实任务上,SWE Verified得分80.6%与Opus 4.6的80.8%几乎完全打平。知识记忆方面,SimpleQA-Verified上V4-Pro的57.9%大幅领先Opus 4.6 Max的46.2%。

但在几个关键领域,Claude仍然更胜一筹:超长文本精准检索(MRCR 1M 83.5% vs 92.9%,差距近10个百分点);复杂多步推理的极限深度(HLE等指标上Opus 4.6 Max分数更高);思考模式下的整体交付质量。

成本层面,差距巨大。

Claude Opus 4.6输入定价约150元/百万token,Sonnet 4.6约105元。V4-Pro输出价24元,Flash版更是低至2元。换言之,用同样的预算,你可以在DeepSeek上跑4到8倍甚至百倍的token量。这个差价不是促销策略造成的,而是架构效率的体现——前面提到的CSA/HCA混合注意力、FP4量化、Muon优化器等技术让V4的真实算力消耗大幅低于传统架构的模型。

生态层面,各有侧重。

Claude已经是完整的产品生态。Claude Code作为终端Agent框架,提供了TUI交互界面、Subagent代理机制、Skills技能库、Hooks生命周期管理、Headless批处理模式等一整套工程化工具链。它是一个产品,不只是模型。

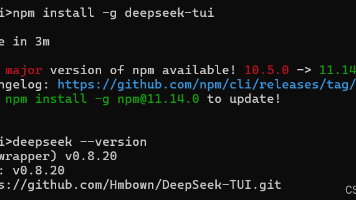

DeepSeek V4走的是另一条路。通过提供Anthropic API兼容层,V4可以无缝接入Claude Code的完整工作流——在配置中把API端点指向DeepSeek,选择deepseek-v4-pro模型,Claude Code的整个工具链和Subagent系统就能跑在V4的推理能力上。

一位开发者做了实际成本测算:一天写200万token的场景,这套组合的月度账单能从数千美金压到三位数人民币。Aliyun开发者社区的实测结论是:“写代码、改bug、跑Skills、生成报表、自动化部署,全部丝滑。”JeecgBoot团队的横评也证实,在OA流程搭建、BI大屏生成、报表钻取、部署脚本等实际工程场景中,V4与Claude Sonnet 4.6几乎打平。

痛点也有:V4目前是纯文本模型,不支持视觉输入。发报错截图、UI设计稿、架构图给它都没用。好消息是官方已确认识图功能在灰度推送中,这块短板很快会补上。

整体来看,Claude在模型单项能力的极限和产品工具链的成熟度上仍然是领先者。而DeepSeek V4的意义在于:用一个数量级的性价比差距,让顶级Agent编程体验从“企业级预算”降到“个人开发者随手可得”的水平。两个模型处在不同的赛道位置上,但V4的追赶速度,显然快于大多数人的预期。

六、从V1到V4:DeepSeek的底色

DeepSeek成立于2023年7月,背后是创始人梁文锋和幻方量化长达十余年的深度学习积累。这家公司的底色从来不是“快”,更不是“嗓门大”,如果用三个词概括过去三年的风格,是:省、稳、等得起。

2023年底推出的V3,用6710亿总参数加MoE架构,把单次训练成本压到500万美元出头,成为开源模型性价比的极致标杆。2025年初的R1,验证了纯强化学习驱动推理能力涌现的可能——不依赖海量人工标注,也能训练出强推理模型。

此次V4的发布被推迟了相当长的时间。一个重要原因是,DeepSeek在这484天里把整套训练和推理系统从英伟达CUDA生态迁移到了华为昇腾芯片上。万亿参数级别,这不是换个驱动那么简单,要重写底层调度逻辑、重做精度对齐、重新搭建通信架构。目的很明确:走通国产算力这条路,不再被单一生态卡脖子。

从这个角度看,V4不只是一次模型更新。它是V3的MoE效率路线、R1的强化学习路径、混合注意力架构的探索、Muon优化器的首次千亿级验证、mHC残差连接的稳定性改造——所有这些技术积累在2026年的一次集中兑现。

七、开源模型能走到哪里?

2026年的AI行业,主旋律正在从“谁的模型最强”转向“谁的Agent能把活干完”。开发者不再只盯着MMLU分数,而是关心Agent能不能在几十分钟的复杂工作流里持续运行不出错,能不能以可接受的成本承担真正有交付意义的工程任务。

DeepSeek V4的发布,让开源模型第一次在编程能力上稳稳站到了和顶级闭源模型同一台阶的边缘。在多项编程基准上追平甚至超越Claude Opus 4.6,在数学推理上接近GPT-5.4,在Agent任务上优于Sonnet 4.5。同时,用开源协议和极致成本,把曾经少数人才能负担的能力变成了普惠基础设施。

它不是独孤求败的“最强模型”,DeepSeek官方也没有这样宣称。它是一个让开发者拥有选择权的选项——你可以用开源权重自行部署,可以用极低成本接入API,可以把它嵌入到任何主流Agent框架里。它的核心价值不只是在某个评分榜上登顶,而是对整个AI编程生态准入成本的实质性降低。

当然,距离山顶还有几步。超长上下文的精准检索、思考模式下的极限推理深度、多模态能力的全面覆盖,这些都是摆在V5面前的作业。万亿参数规模的国产算力适配才刚刚开始,昇腾950超节点批量上市后的实际性价比表现也还有待观察。

但有一点已经很清楚:从V3.2到V4的这次跨越,开源与闭源之间的能力鸿沟被大幅收窄了。V4为这条路线立下了一个新的参照系,也给开发者留下了一个可以自由挑选、成本可控的选项。这对整个AI行业来说,无论如何都是好事。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)