从安装到对话:Ollama运行通义千问2.5-7B-Instruct全流程

本文介绍了基于星图GPU平台自动化部署通义千问2.5-7B-Instruct镜像的完整流程。该平台支持一键拉取模型并集成Ollama运行环境,适用于本地化AI应用开发。通过星图GPU,用户可高效实现模型微调、智能对话与API集成,显著降低大模型使用门槛。

从安装到对话:Ollama运行通义千问2.5-7B-Instruct全流程

1. 引言

随着大语言模型技术的快速发展,越来越多开发者希望在本地环境中快速部署和使用高性能模型。然而,复杂的依赖配置、硬件适配与推理框架搭建常常成为入门门槛。Ollama 的出现极大简化了这一过程——它提供了一套极简的命令行工具,支持一键拉取、运行和管理主流开源大模型,适用于从实验到轻量级生产的多种场景。

本文将围绕 通义千问2.5-7B-Instruct 模型,详细介绍如何通过 Ollama 在本地完成从环境准备、模型部署到 API 调用的完整流程。该模型作为阿里云 Qwen2.5 系列中的中等体量指令微调版本,具备强大的中英文理解能力、代码生成、数学推理及结构化输出支持,且对消费级显卡友好,非常适合个人开发者或中小企业进行本地化 AI 应用开发。

通过本教程,你将掌握:

- 如何安装并配置 Ollama 运行时环境

- 如何加载 qwen2.5:7b 模型并进行交互式对话

- 如何通过 OpenAI 兼容接口调用模型实现程序化集成

- 实际应用中的常见问题与优化建议

2. 技术背景与模型特性解析

2.1 什么是 Ollama?

Ollama 是一个专为本地运行大型语言模型设计的轻量级工具链,支持 macOS、Linux 和 Windows 平台。其核心优势在于:

- 极简安装:一条命令即可完成安装。

- 模型即服务:自动下载、缓存并启动模型服务(默认监听

11434端口)。 - 多后端支持:可自动检测 CUDA、Metal 或 CPU,并利用 GPU 加速推理。

- OpenAI 兼容 API:提供

/v1/chat/completions接口,便于迁移现有应用。 - 社区生态丰富:支持 vLLM、LMStudio 等主流框架集成,插件体系完善。

Ollama 不仅降低了大模型使用的门槛,也为隐私敏感型任务提供了安全可控的本地执行环境。

2.2 通义千问2.5-7B-Instruct 模型特点

通义千问2.5-7B-Instruct 是阿里于 2024 年 9 月发布的 70 亿参数指令微调模型,属于 Qwen2.5 系列的重要成员,定位“中等体量、全能型、可商用”。以下是其关键特性分析:

| 特性维度 | 具体表现 |

|---|---|

| 参数规模 | 7B 完整权重,非 MoE 架构,FP16 格式约 28GB |

| 上下文长度 | 最高支持 128K tokens,适合处理百万级汉字长文档 |

| 性能基准 | C-Eval、MMLU、CMMLU 均位列 7B 模型第一梯队 |

| 编程能力 | HumanEval 通过率超 85%,媲美 CodeLlama-34B |

| 数学能力 | MATH 数据集得分 80+,超越多数 13B 模型 |

| 输出控制 | 支持 Function Calling 与 JSON 强制格式输出 |

| 对齐策略 | 采用 RLHF + DPO 双重对齐,有害请求拒答率提升 30% |

| 量化支持 | GGUF/Q4_K_M 仅需 4GB 显存,RTX 3060 即可流畅运行 |

| 多语言支持 | 支持 16 种编程语言、30+ 自然语言,跨语种零样本可用 |

| 商用许可 | 开源协议允许商业用途,已在 vLLM、Ollama 等平台集成 |

核心价值总结:qwen2.5:7b 在性能、实用性与资源消耗之间实现了优秀平衡,特别适合需要本地化、低延迟、高安全性 AI 能力的应用场景。

3. 环境准备与 Ollama 安装

3.1 系统要求

虽然 Ollama 支持纯 CPU 运行,但为了获得良好体验,推荐以下最低配置:

- 操作系统:Ubuntu 20.04+/CentOS 7+/macOS 12+/Windows 10+

- 内存:至少 16GB RAM(建议 32GB)

- 显卡(GPU):NVIDIA GPU(CUDA 支持),显存 ≥ 8GB(如 RTX 3060/3070)

- 磁盘空间:预留至少 10GB 用于模型存储(GGUF 量化版更小)

若使用 NVIDIA 显卡,请确保已正确安装驱动和 CUDA Toolkit(12.x 版本兼容性最佳)。

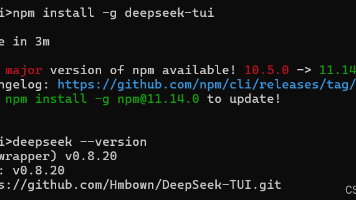

3.2 安装 Ollama

Ollama 提供跨平台的一键安装脚本,执行以下命令即可完成安装:

curl -fsSL https://ollama.com/install.sh | sh

安装完成后,可通过以下命令验证是否成功:

ollama --version

预期输出类似:

ollama version is 0.1.41

3.3 启动 Ollama 服务

Ollama 默认以守护进程方式运行,首次使用需手动启动服务:

ollama serve

此命令会启动后台服务,默认监听 http://localhost:11434。你可以新开终端继续操作,无需保持该窗口常驻前台。

4. 拉取并运行 qwen2.5:7b 模型

4.1 查找模型

Ollama 内置模型库可通过网页访问:https://ollama.com/library

搜索 qwen2.5 可找到多个版本,其中 qwen2.5:7b 表示 7B 参数的基础指令微调模型。

4.2 下载并运行模型

使用如下命令直接拉取并运行模型:

ollama run qwen2.5:7b

首次运行时,Ollama 将自动从镜像源下载模型分片(基于 GGUF 量化格式),整个过程可能持续数分钟至十几分钟,具体取决于网络速度。

示例输出日志:

pulling manifest

pulling 2bada8a74506... 100% ▕█████████████████████████████████████████████████████████████████████████████▏ 4.7 GB

pulling 66b9ea09bd5b... 100% ▕█████████████████████████████████████████████████████████████████████████████▏ 68 B

verifying sha256 digest

writing manifest

success

>>>

下载完成后,你会进入交互式对话模式,提示符变为 >>>,此时可以开始提问。

4.3 交互式对话测试

输入以下问题进行初步测试:

>>> 广州有什么好玩的地方?

模型返回示例:

广州是一座充满活力和魅力的城市,拥有许多值得探索的好玩之处:

1. **珠江夜游**:夜晚乘坐船游览珠江,可以观赏到两岸璀璨的灯光以及各式各样的现代化建筑。

2. **白云山**:作为广州市内著名的公园之一,白云山有丰富的自然景观和历史遗迹……

...

注意:若响应缓慢,可能是未启用 GPU。可通过

nvidia-smi检查 GPU 使用情况,确认 Ollama 是否正确识别 CUDA 设备。

5. 通过 API 调用模型(Python 客户端)

Ollama 提供与 OpenAI 高度兼容的 RESTful API,便于集成到现有系统中。以下演示如何使用 Python 调用 qwen2.5:7b 模型。

5.1 安装依赖

pip install openai

注意:此处使用的

openai是官方 SDK,但只需更改 base_url 即可对接 Ollama。

5.2 编写调用代码

from openai import OpenAI

# 创建客户端,指向本地 Ollama 服务

client = OpenAI(

base_url='http://localhost:11434/v1/',

api_key='ollama' # 忽略此项,Ollama 不验证密钥

)

# 发起对话请求

chat_completion = client.chat.completions.create(

messages=[

{

'role': 'user',

'content': '广州有什么好玩的地方?',

}

],

model='qwen2.5:7b',

stream=False # 关闭流式输出

)

# 打印回复内容

print(chat_completion.choices[0].message.content)

5.3 运行结果

执行上述脚本后,应输出与 CLI 模式一致的回答内容。这表明模型已成功暴露为标准 API 服务,可用于 Web 应用、Agent 系统或其他自动化流程。

5.4 流式输出支持

若希望实现逐字输出效果(如聊天机器人打字动画),可开启 stream=True:

stream = client.chat.completions.create(

model="qwen2.5:7b",

messages=[{"role": "user", "content": "请用三句话介绍广州"}],

stream=True,

)

for chunk in stream:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

6. 常用 Ollama 命令汇总

以下是日常开发中常用的 Ollama CLI 命令清单:

| 功能 | 命令 |

|---|---|

| 安装指定模型 | ollama pull qwen2.5:7b |

| 列出已安装模型 | ollama list |

| 查看正在运行的模型 | ollama ps |

| 运行模型(交互模式) | ollama run qwen2.5:7b |

| 删除模型 | ollama rm qwen2.5:7b |

| 查看模型详细信息 | ollama show qwen2.5:7b --modelfile |

| 启动服务 | ollama serve |

| 推送自定义模型 | ollama push <namespace/model> |

所有命令均可通过

ollama --help获取完整帮助文档。

7. 常见问题与优化建议

7.1 模型加载慢或卡住

- 原因:网络不佳导致无法从海外 CDN 下载模型。

- 解决方案:

- 使用国内镜像加速(部分第三方平台提供代理下载)

- 手动下载

.gguf文件并导入(需修改 Modelfile) - 更换为

qwen2.5:7b-q4_K_M明确指定量化版本

7.2 GPU 未被识别

- 检查项:

- 是否安装 NVIDIA 驱动?

- 是否安装 CUDA Toolkit?

- 执行

nvidia-smi是否正常显示 GPU 信息?

- 修复方法:

- Ubuntu 用户可尝试重装

nvidia-cuda-toolkit - 设置环境变量:

export OLLAMA_GPU_ENABLE=1

- Ubuntu 用户可尝试重装

7.3 内存不足崩溃

- 建议措施:

- 使用量化模型(如

q4_K_M)降低显存占用 - 减少上下文长度(context_length ≤ 8192)

- 关闭不必要的后台程序释放内存

- 使用量化模型(如

7.4 提升推理速度的小技巧

- 使用更高性能的量化格式(如

q5_K_Svsq4_K_M) - 启用批处理(batch_size > 1)提高吞吐

- 在支持 Metal 的 Mac 上使用原生加速

8. 总结

本文系统地介绍了如何使用 Ollama 部署和调用 通义千问2.5-7B-Instruct 模型,涵盖环境搭建、模型运行、API 集成及常见问题处理等关键环节。通过 Ollama 的极简设计,即使是初学者也能在短时间内让一个高性能大模型在本地运行起来。

核心收获总结如下:

- 易用性强:Ollama 实现了“一行命令跑大模型”的愿景,极大降低了技术门槛。

- 性能出色:qwen2.5:7b 在 7B 级别中综合表现领先,尤其在中文理解、代码与数学任务上优势明显。

- 部署灵活:支持 GPU/CPU/NPU 多种硬件,适配不同设备条件。

- 生态开放:兼容 OpenAI 接口,易于集成进现有 AI 工程体系。

- 可商用授权:为企业级应用提供了合法合规的技术选型路径。

未来,随着本地大模型推理效率的不断提升,像 Ollama + qwen2.5 这样的组合将在智能客服、知识库问答、自动化脚本生成等领域发挥更大价值。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)