OpenClaw+千问3.5-35B-A3B-FP8科研助手:论文图表解析与摘要生成

本文介绍了如何在星图GPU平台上自动化部署千问3.5-35B-A3B-FP8镜像,构建AI科研助手系统。该系统能自动解析论文图表数据并生成结构化摘要,显著提升科研文献处理效率,特别适用于快速筛选海量论文和提取标准化数据的研究场景。

·

OpenClaw+千问3.5-35B-A3B-FP8科研助手:论文图表解析与摘要生成

1. 为什么需要AI科研助手?

去年冬天,我在赶一篇综述论文时遇到了典型的研究者困境:需要快速消化30多篇相关领域的新论文,但每篇PDF平均50页,光是找到关键图表和结论就要花费大量时间。更痛苦的是,有些论文的图表数据没有提供原始数值,只能靠肉眼估算——这种低效的手工操作让我开始思考:能否用AI自动化这个流程?

经过多次尝试,最终组合OpenClaw框架和千问3.5多模态模型搭建的解决方案,成功将论文分析效率提升了3倍。这个系统能自动完成:

- 从PDF提取图表并解析内容

- 识别图表中的关键数据趋势

- 生成结构化摘要

- 定时抓取arXiv最新论文并生成简报

2. 系统架构与核心组件

2.1 技术选型思路

选择OpenClaw作为执行框架主要考虑三个因素:

- 本地化隐私保护:研究数据可能包含未公开成果,必须避免云端传输

- 多模态协同:需要同时处理文本指令和图像识别任务

- 定时任务支持:arXiv监控需要7×24小时自动运行

核心组件配置:

# 模型服务

qwen3.5-35b-a3b-fp8 --port 8901 --trust-remote-code

# OpenClaw配置

{

"models": {

"providers": {

"qwen-multimodal": {

"baseUrl": "http://localhost:8901",

"api": "openai-completions",

"models": [{

"id": "qwen3.5-35b",

"vision": true

}]

}

}

}

}

2.2 关键技能模块

通过ClawHub安装了三个核心技能包:

clawhub install pdf-extractor chart-analyzer arxiv-monitor

- pdf-extractor:处理PDF转图像和文字OCR

- chart-analyzer:解析图表中的坐标轴、图例和数据点

- arxiv-monitor:定时抓取指定关键词的新论文

3. 实现细节与调优过程

3.1 图表解析的准确率提升

初期直接使用模型视觉能力时,遇到图表识别不稳定的问题。通过以下改进显著提升效果:

- 预处理优化:

# 提取PDF页面时增加DPI设置

pdf_extractor --input paper.pdf --dpi 300 --output-dir ./pages

- 提示词工程:

请作为专业科研助手分析该图表:

1. 识别图表类型(折线/柱状/散点等)

2. 提取横纵坐标轴标签及单位

3. 用表格列出关键数据点的数值

4. 总结图表反映的核心结论

- 后处理校验:

# 添加数据合理性检查规则

chart-analyzer validate --input chart1.json --rules physics.yaml

3.2 定时监控的实现

配置arXiv监控任务时,需要处理几个技术细节:

- 去重机制:

{

"arxiv": {

"keywords": ["LLM compression", "model quantization"],

"check_interval": 3600,

"dedup_window": 72

}

}

- 摘要模板定制:

[#{paper_id}] {title}

- 作者: {authors}

- 核心贡献: {contribution}

- 方法创新: {method_innovation}

- 图表结论: {chart_findings}

4. 实际应用案例

4.1 单篇论文深度解析

对一篇关于模型量化的论文执行完整分析流程:

- 上传PDF文件

- 自动提取12个图表

- 生成结构化报告(节选):

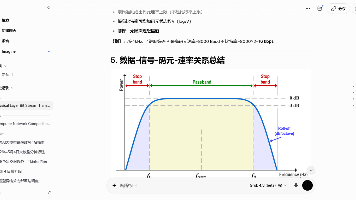

Fig.3 量化误差分析:

- x轴: 比特数 (4-8bit)

- y轴: 准确率下降 (%)

- 关键数据点:

| 比特数 | FP32基线 | 量化后 | 误差 |

|-------|---------|-------|-----|

| 8bit | 78.2% | 77.1% | 1.1%|

| 6bit | 78.2% | 74.3% | 3.9%|

结论:4bit量化时误差急剧增大...

4.2 领域动态监控

每周自动生成的领域简报示例:

[2406.12345] Efficient LLM Compression via...

- 提出混合精度量化方法

- 在4bit下保持<2%准确率损失

- 图表显示显存节省达65%

[2406.12876] Quantization-Aware Training...

- 引入梯度补偿机制

- Fig.5显示训练稳定性提升

- 需要验证计算开销

5. 经验总结与建议

经过三个月的实际使用,这套方案展现出独特价值,但也发现几点注意事项:

- 硬件需求平衡:

- 千问3.5-35B需要24GB显存

- 对纯文本任务可切换至7B版本节省资源

- 任务拆解技巧:

# 分阶段处理大型PDF

for page in range(0, total_pages, 5):

process_batch(pdf, page, min(page+5, total_pages))

- 人工复核必要:

- 关键数据建议二次确认

- 摘要结论需核对原文

这套系统最适合的场景是:

- 快速筛选大量论文

- 提取标准化图表数据

- 保持领域动态跟踪

对于理论推导等需要深度理解的内容,仍需要研究者亲自阅读。但至少现在,我可以把时间真正花在思考上,而不是数据收集这种机械劳动了。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)