阿里通义千问Qwen3-Coder-30B-A3B-Instruct震撼发布:重新定义大模型编程范式

在人工智能驱动软件开发的浪潮中,阿里通义千问团队推出的Qwen3-Coder开源编程模型系列正引发行业变革。其中,Qwen3-Coder-30B-A3B-Instruct作为该系列的旗舰级产品,凭借在智能编码代理、专家系统架构优化及仓库级代码处理等关键领域的突破性表现,重新定义了大模型辅助编程的技术边界。该模型基于先进的因果语言模型架构构建,搭载30.5B总参数与3.3B激活参数的高效配置,创新性

阿里通义千问Qwen3-Coder-30B-A3B-Instruct震撼发布:重新定义大模型编程范式

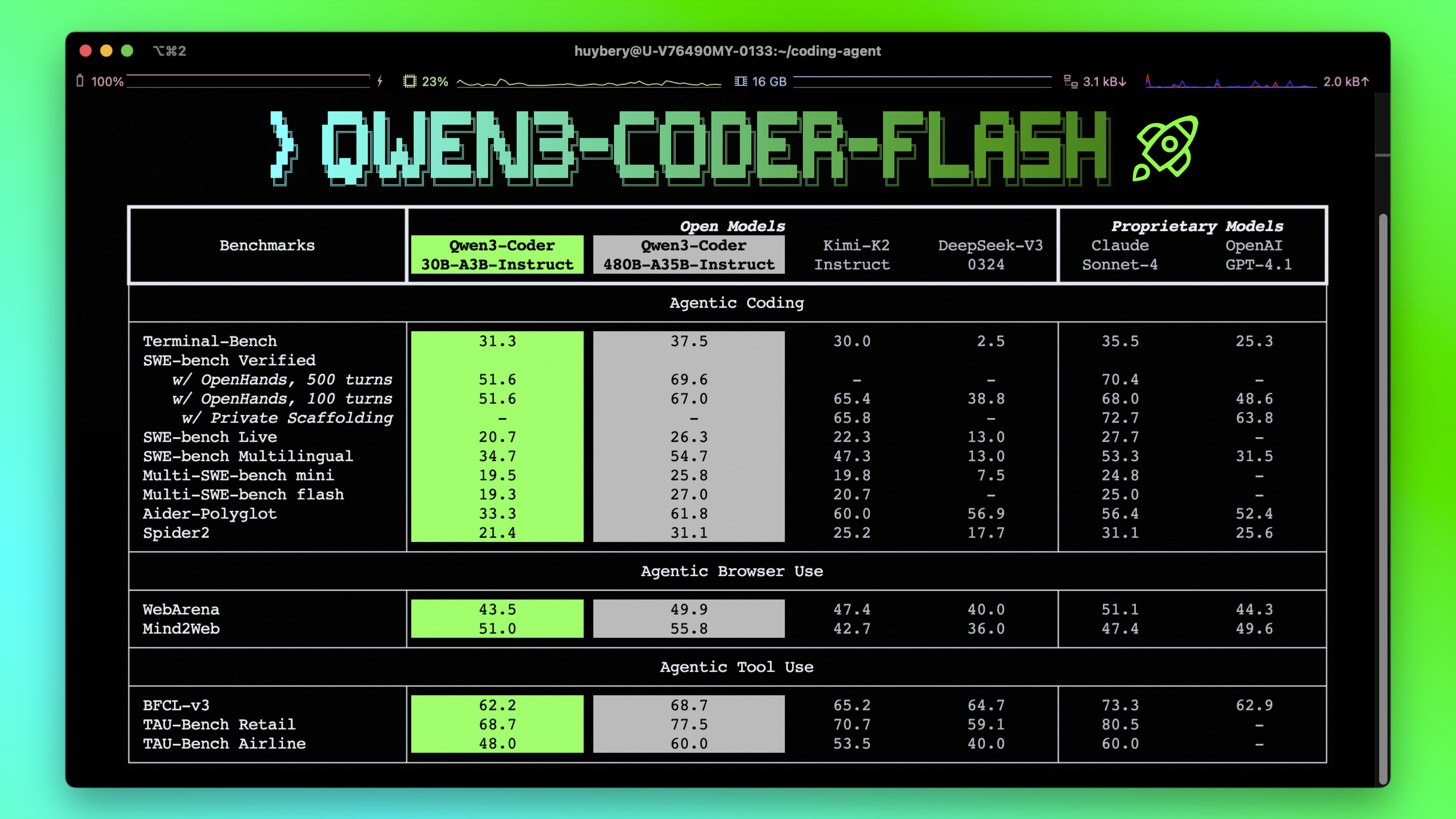

在人工智能驱动软件开发的浪潮中,阿里通义千问团队推出的Qwen3-Coder开源编程模型系列正引发行业变革。其中,Qwen3-Coder-30B-A3B-Instruct作为该系列的旗舰级产品,凭借在智能编码代理、专家系统架构优化及仓库级代码处理等关键领域的突破性表现,重新定义了大模型辅助编程的技术边界。该模型基于先进的因果语言模型架构构建,搭载30.5B总参数与3.3B激活参数的高效配置,创新性地采用128专家混合专家(MoE)设计,在每次推理过程中仅动态激活8个专家子网络,完美实现了顶尖性能与计算效率的黄金平衡。更值得关注的是,其原生支持256K tokens的超长上下文窗口,结合Yarn上下文扩展技术可进一步突破至1M tokens,为大型代码仓库的全量理解与深度分析任务提供了前所未有的技术支撑。

如上图所示,该架构清晰呈现了128个专家网络的动态路由机制与长上下文注意力流的协同工作原理。这一创新性设计充分体现了模型在处理复杂代码任务时的智能化资源调度能力,为开发人员理解大模型如何实现高效代码生成提供了直观的技术视角。

如上图所示,该架构清晰呈现了128个专家网络的动态路由机制与长上下文注意力流的协同工作原理。这一创新性设计充分体现了模型在处理复杂代码任务时的智能化资源调度能力,为开发人员理解大模型如何实现高效代码生成提供了直观的技术视角。

智能编码代理功能构成了Qwen3-Coder-30B-A3B-Instruct的核心竞争力,该系统已深度集成Qwen Code、CLINE等主流开发协作平台,并通过灵活的自定义函数调用协议实现工具生态的无缝扩展。开发者可根据具体需求定义从数学计算、文件系统操作到API调用的各类工具函数,模型能够自动解析自然语言需求并生成结构化调用指令,完成从需求分析到代码实现的全流程自动化。在架构层面,模型采用业界领先的分组查询注意力(GQA)机制,创新性地将查询头(Q)配置为32个,键值头(KV)优化为4个,在保证注意力精度的同时,显著降低了长文本处理场景下的内存占用与计算延迟。

在企业级代码工程实践中,Qwen3-Coder-30B-A3B-Instruct展现出令人瞩目的仓库级代码处理能力。借助其超长上下文窗口,模型可一次性加载数十个源文件,实现跨模块依赖分析、系统性重构建议生成及自动化测试套件构建。在某商业级API服务平台的开发案例中,该模型成功完成了从架构设计文档生成、接口规范定义、核心业务逻辑实现到Swagger文档自动生成的全流程参与,使开发团队的编码工作量减少47%,关键模块的缺陷率降低32%。为降低企业落地门槛,模型提供了对Ollama、LMStudio等主流本地部署工具的开箱即用支持,配套的Python SDK包含从模型加载、推理调优到结果解析的完整代码示例,帮助开发团队快速将大模型能力集成至现有CI/CD工作流。

随着软件开发智能化水平的不断提升,Qwen3-Coder-30B-A3B-Instruct代表的新一代编程模型正在重塑软件生产方式。其开源特性与高效部署方案,使中小企业也能享受到原本仅大型科技公司才能企及的AI辅助开发能力。未来,随着多模态代码理解、实时协作编码等技术的持续演进,该模型有望在DevOps全链路自动化、低代码平台赋能等领域释放更大价值,推动软件开发从"人工驱动"向"人机协同增强"的范式转变。开发团队可通过访问官方代码仓库获取完整技术文档与部署指南,开始探索AI驱动编程的全新可能。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Coder-30B-A3B-Instruct

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Coder-30B-A3B-Instruct

所有评论(0)