DeepSeek-R1本地化部署 java调用 图文教程(Ollama+Docker+OpenWebUI)_斯坦福小镇deepseek部署

DeepSeek-R1 是幻方量化旗下大模型公司 DeepSeek 研发的系列推理模型,以下是关于它的简介:2024 年 11 月 20 日:DeepSeek-R1-Lite 预览版正式上线网页端,仅支持网页使用,暂不支持 API 调用。2025 年 1 月 20 日:DeepSeek 正式发布 DeepSeek-R1 模型,并同步开源模型权重。2025 年 1 月 24 日:在 Arena 上,

文章目录

- 一,DeepSeek-R1简介

-

- 发展历程

- 主要功能

-

- 训练方式

- 思维链

- 任务表现

- 相关测评

- 国际关注

- 相关评价

- 二,DeepSeek-R1 部署

-

- 1 , Ollama 安装

- 2 ,Ollama 相关命令

- 3,ollama deepseek-r1 模型下载

- 4,ollama 测试 deepseek-r1 模型

- 5,springboot 调用 deepseek-r1 模型

- 6,docker安装

- 6,Open WebUI 安装

一,DeepSeek-R1简介

DeepSeek-R1 是幻方量化旗下大模型公司 DeepSeek 研发的系列推理模型,以下是关于它的简介:

发展历程

2024 年 11 月 20 日:DeepSeek-R1-Lite 预览版正式上线网页端,仅支持网页使用,暂不支持 API 调用。

2025 年 1 月 20 日:DeepSeek 正式发布 DeepSeek-R1 模型,并同步开源模型权重。

2025 年 1 月 24 日:在 Arena 上,DeepSeek-R1 基准测试升至全类别大模型第三,在风格控制类模型分类中与 OpenAI o1 并列第一。

2025 年 1 月 31 日:英伟达、微软与亚马逊三家美国头部企业接入 DeepSeek-R1 模型。

2025 年 2 月 1 日:DeepSeek 和华为云联合首发并上线基于华为云昇腾云服务的 DeepSeek R1 推理服务。

2025 年 2 月 2 日:腾讯云宣布 DeepSeek-R1 大模型一键部署至腾讯云 HAI 上,开发者仅需 3 分钟就能接入调用。

主要功能

训练方式

使用强化学习训练,在后训练阶段大规模使用了强化学习技术,在仅有极少标注数据的情况下,极大提升了模型推理能力。

思维链

推理过程包含大量反思和验证,思维链长度可达数万字。

任务表现

在数学、代码以及各种复杂逻辑推理任务上应用出色,取得了媲美 OpenAI o1-preview 的推理效果,并为用户展现了 o1 没有公开的完整思考过程。在自然语言推理等任务上,性能比肩 OpenAI o1 正式版。DeepSeek 还通过 DeepSeek-R1 的输出,蒸馏了 6 个小模型开源给社区,其中 32B 和 70B 模型在多项能力上实现了对标 OpenAI o1-mini 的效果。

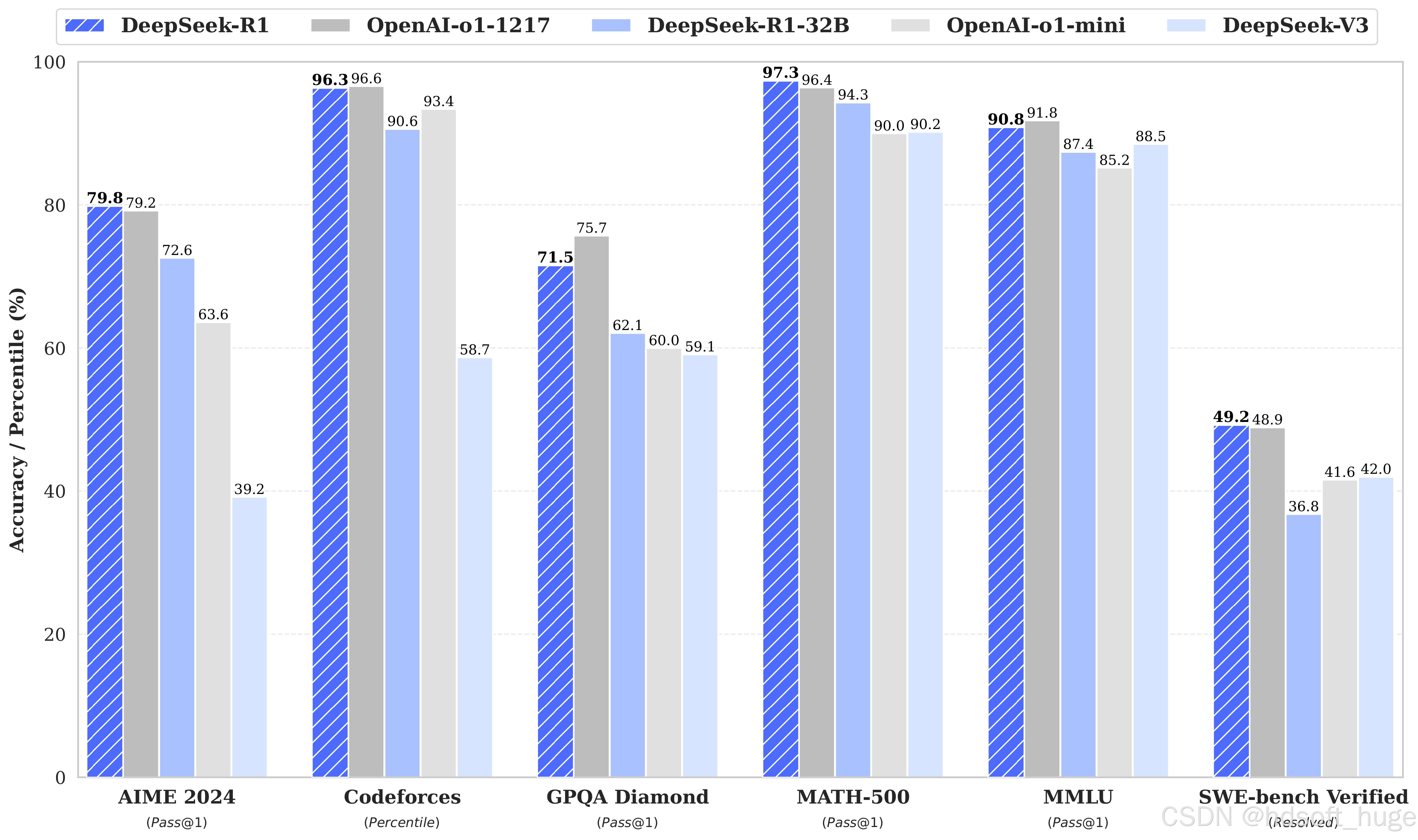

相关测评

DeepSeek-R1-Lite 预览版模型在美国数学竞赛(AMC)中难度等级最高的 AIME 以及全球顶级编程竞赛(codeforces)等评测中,超越了 GPT-4 等模型。

国际关注

美国媒体 Business Insider 报道称,DeepSeek-R1 模型秉承开放精神,完全开源,为美国 AI 玩家带来了麻烦。

著名投资公司 A16z 的创始人马克・安德森发文称,Deepseek-R1 是他见过的最令人惊叹、最令人印象深刻的突破之一,而且还是开源的,它是给世界的一份礼物。A16z 合伙人 Anjney Midha 表示,从斯坦福到麻省理工,DeepSeek-R1 几乎一夜之间成为美国顶尖大学研究人员的首选模型。

英国《金融时报》发表评论文章表示,DeepSeek-R1 对全球用户产生极大吸引力,有利于推动人工智能技术的开发和应用,可能会吸引美国科技巨头的一部分客户。

相关评价

俄罗斯外交部长拉夫罗夫评价称,中国科学家在人工智能领域取得的成就,以及包括 DeepSeek 的出现,超越了美国相关研发人员在该领域的成果。

二,DeepSeek-R1 部署

DeepSeek-R1 github地址: https://github.com/deepseek-ai/DeepSeek-R1

根据上图看出DeepSeek-r1各方面优于OpenAI,在某些方面评估甚至强于OpenAI。下面我开始搭建

1 , Ollama 安装

本节针对于不需要 OpenUI 的 Ubuntu 用户以及开发者,同时也是为了帮助大家深入理解 ollama,这里介绍一种独立安装 ollama 的方式。值得注意的是,这种安装方式无需借助 docker 即可运行 ollama。而需要安装 OpenWebUI的用户,可直接跳转至第六节继续操作

ollama 是一个强大的工具,它为模型的管理和运行提供了便利。它可以简化模型的下载、配置和启动过程,让用户能够快速地将不同的模型集成到自己的工作流程中。例如,在处理多个不同类型的大语言模型时,ollama 可以轻松管理这些模型之间的切换和调用,提高开发效率。

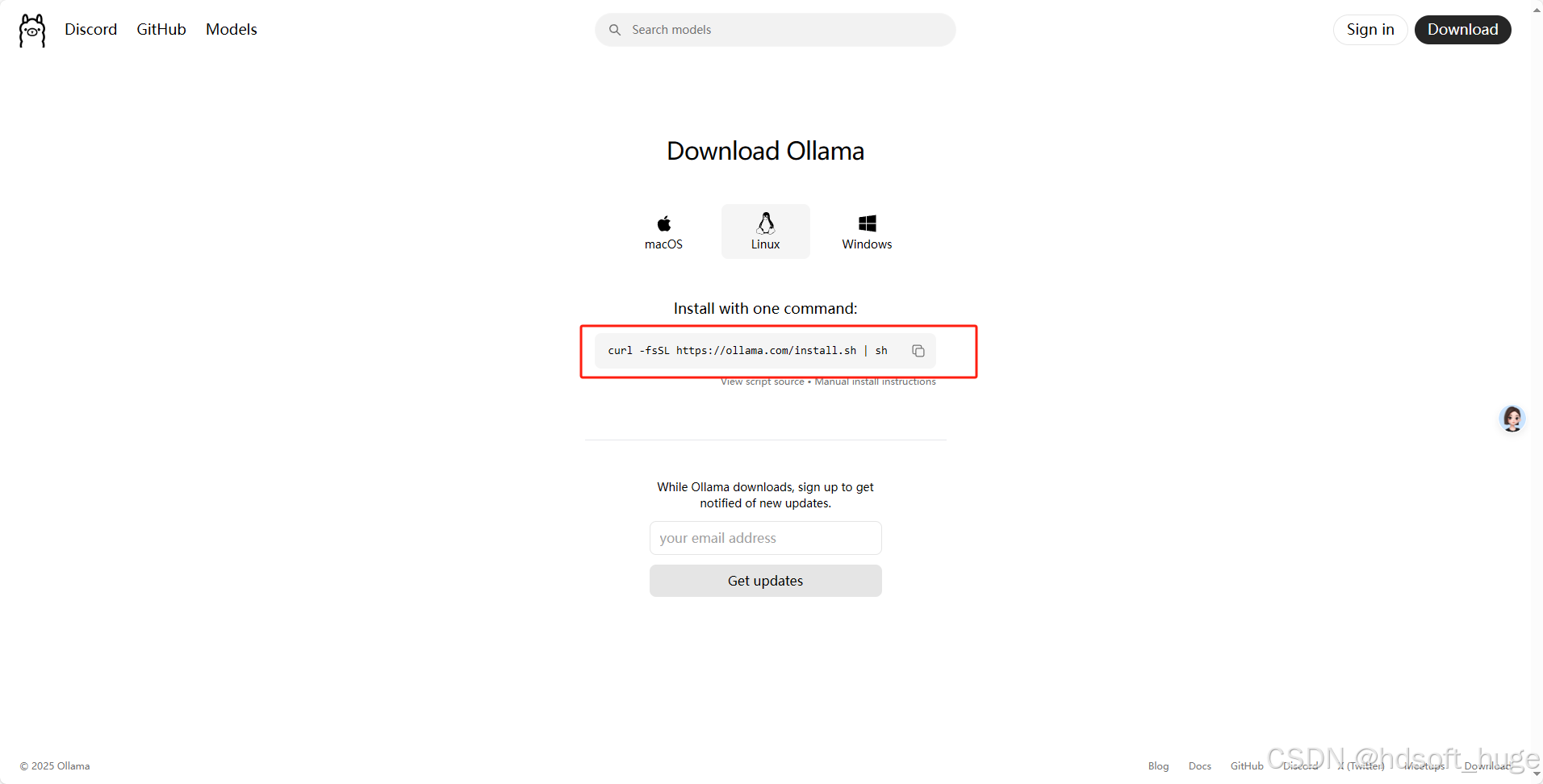

ollama 下载地址 : https://ollama.com/download

ollama github地址 : https://github.com/ollama/ollama

#复制官网Linux自动安装命令执行即可

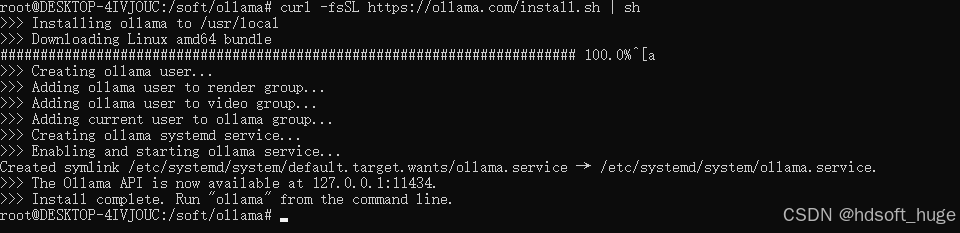

curl -fsSL https://ollama.com/install.sh | sh

安装成功如下图:

2 ,Ollama 相关命令

Ollama 提供了多种命令行工具(CLI)供用户与本地运行的模型进行交互。

我们可以用 ollama --help 查看包含有哪些命令:

Large language model runner

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

stop Stop a running model

pull Pull a model from a registry

push Push a model to a registry

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

3,ollama deepseek-r1 模型下载

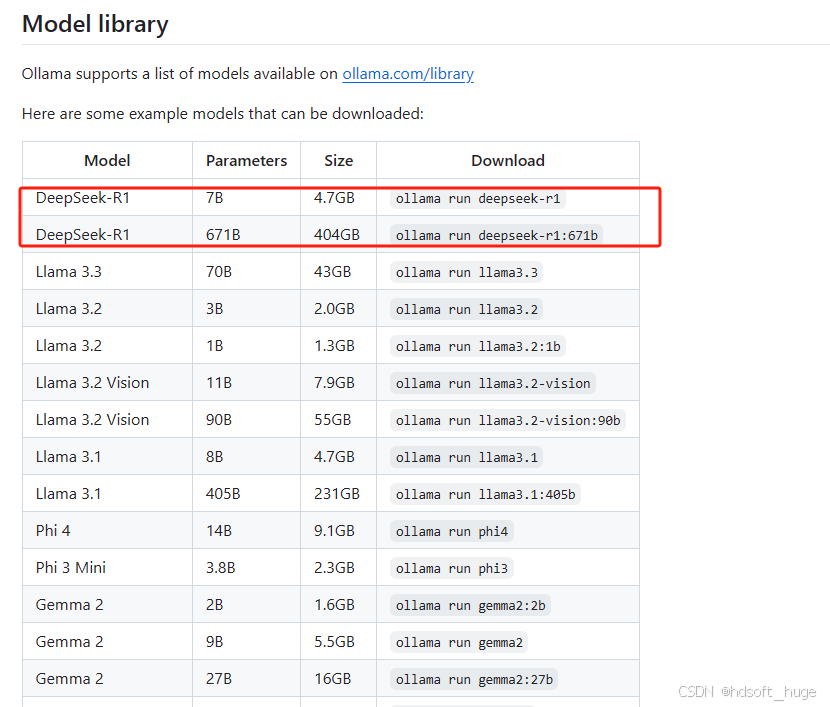

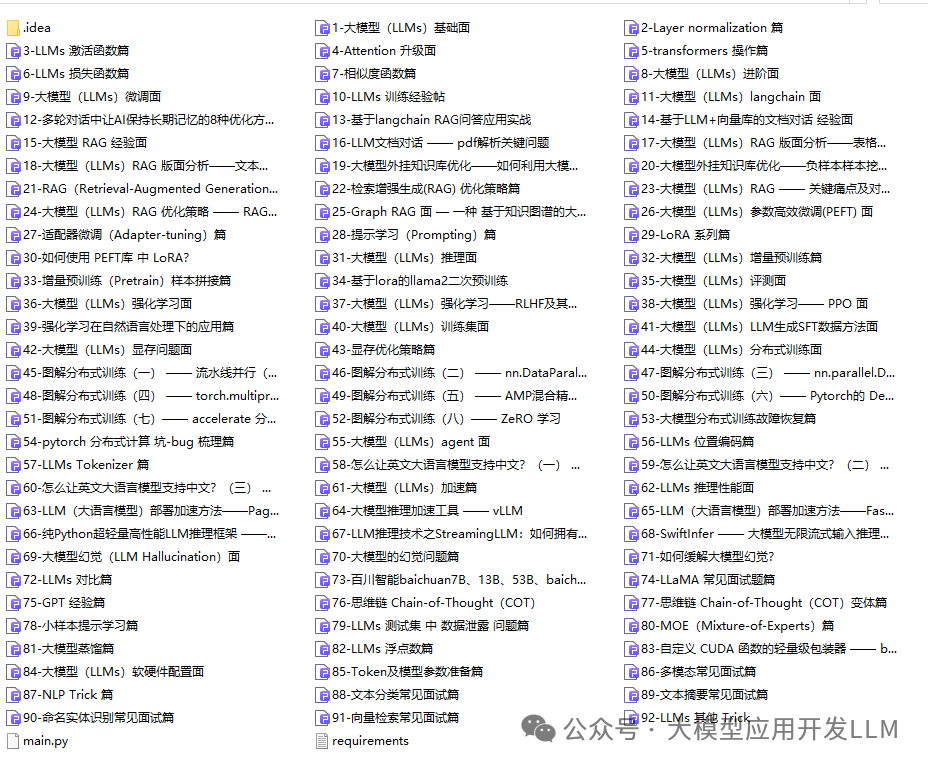

根据 ollama 说明文档 可以看出deepSeek-r1 支持的模型。

也可以到(Ollama 支持 ollama.com/library 上查看可用的模型列表)

点击进入 deepseek-r1 模型,可以选择不同版本的模型(1.5b/7b/14b/32b/70b/671b)。

deepseek-r1 提供多个版本,参数量越大,模型的性能越强大,但也需要更多的存储和计算资源。1.5b 模型参数为15亿/1.1GB,7b 模型参数约为 70亿/4.7GB,14b 模型参数约为 140亿/9GB。

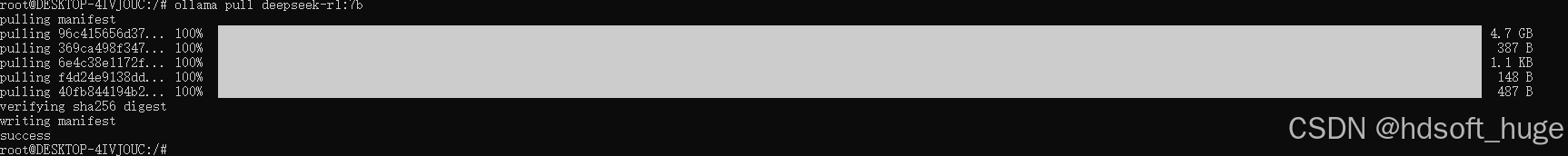

# 使用 ollama 获取 deepseek-r1 模型7b

# 在ubuntu命令行执行

ollama pull deepseek-r1:7b

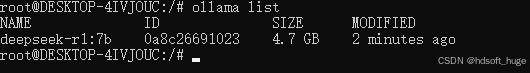

# 查看已下载模型列表

ollama list

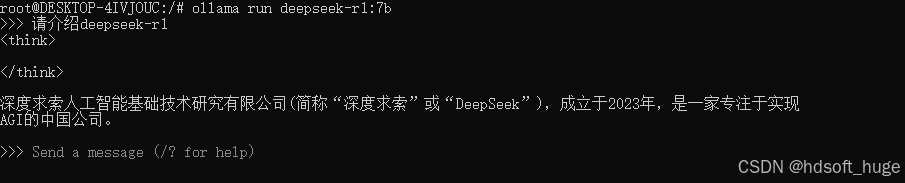

4,ollama 测试 deepseek-r1 模型

# 1,在ubuntu命令行执行

ollama run deepseek-r1:7b

# 2,命令行输入对话内容回车,如:请介绍deepseek-r1 如下图所示成功响应即可

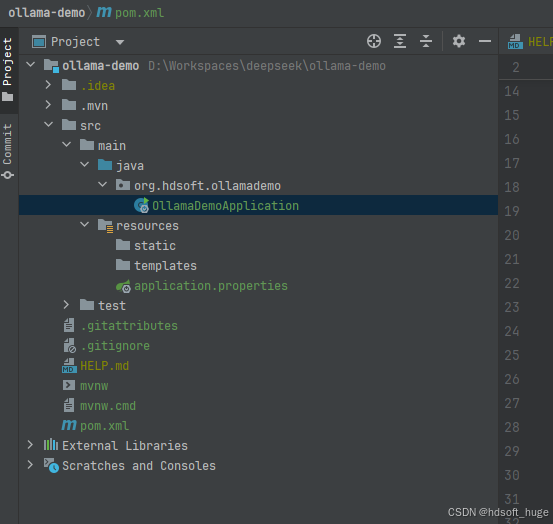

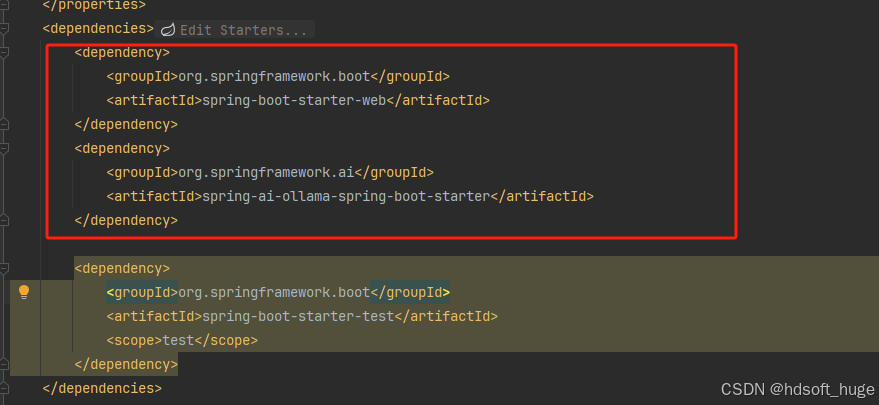

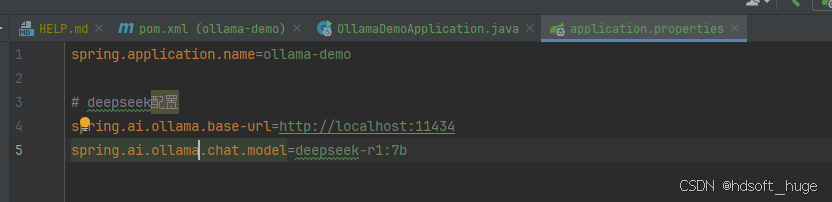

5,springboot 调用 deepseek-r1 模型

创建springboot工程 引入springweb ollama

工程结构如下图

pom文件

application.properties 配置文件

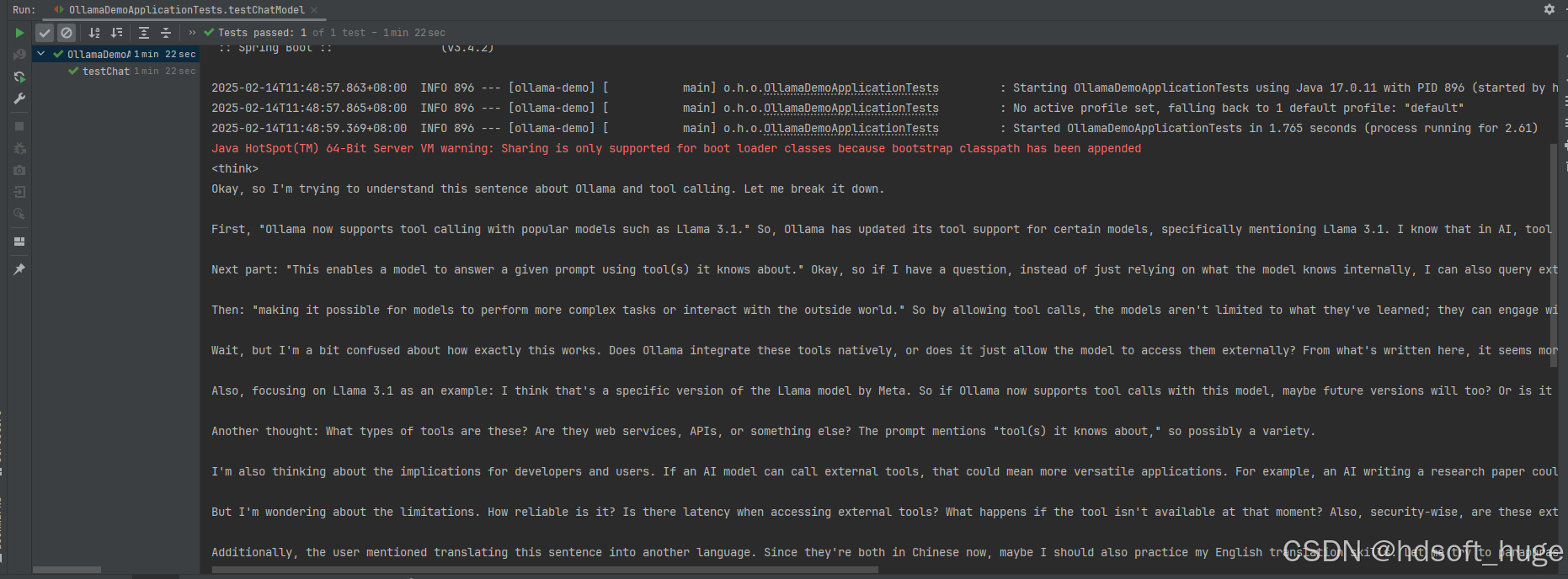

写个单元测试,尝试调用Ollama中的deepseek-r1模型,这里尝试实现一个翻译的功能

package org.hdsoft.ollamademo;

import org.junit.jupiter.api.Test;

import org.springframework.ai.ollama.OllamaChatModel;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.boot.test.context.SpringBootTest;

@SpringBootTest

class OllamaDemoApplicationTests {

// @Test

// void contextLoads() {

// }

@Autowired

private OllamaChatModel ollamaChatModel;

@Test

public void testChatModel() {

String prompt = """

你是一个精通中文和英文的翻译大师。如果我给你英文就翻译成中文,给你中文就翻译成英文。

""";

String message = """

Ollama now supports tool calling with popular models such as Llama 3.1.

This enables a model to answer a given prompt using tool(s) it knows about,

making it possible for models to perform more complex tasks or interact with the outside world.

""";

String result = ollamaChatModel.call(prompt + ":" + message);

System.out.println(result);

}

}

运行结构图下图

目前,我们的 DeepSeek-R1 部署对于开发者已经完成。为了更便捷地对 DeepSeek-R1 进行测试与使用,接下来我们需要安装 Open WebUI。 Open WebUI我们借助docker容器化安装部署。

6,docker安装

Docker 作为一款开源引擎,具备强大的功能,能够便捷地为任意应用创建轻量级、可移植且自给自足的容器。开发者在笔记本上完成编译与测试的容器,可批量部署至生产环境,涵盖 VMs(虚拟机)、裸机、OpenStack 集群以及其他基础应用平台。其核心优势在于,能将应用程序及其依赖项打包成独立容器。

以 DeepSeek 部署为例,借助 Docker,可确保 DeepSeek-R1 在不同环境下拥有一致的运行状态。无论是开发、测试还是生产环境,只要安装了 Docker,就能够运行相同的 DeepSeek-R1 容器,有效规避因环境差异引发的兼容性难题,极大提升了部署效率与稳定性。

docker的安装请参考 Windows安装 WSL2、Ubuntu 、docker

上文中基于 WSL2 搭建了 Ubuntu 虚拟环境,并在其中完成了 docker 的安装。实际上,在 Linux 系统下安装 docker 的流程与之相似,大家只需依据自己的 Linux 发行版,按照相应的官方文档或指南进行操作即可。

安装成功如下图

6,Open WebUI 安装

Open WebUI 作为一款开源的、功能强大的大模型 WebUI 工具,能为我们提供专业级的对话平台,不仅可以让我们轻松对接 DeepSeek-R1,还支持图形化界面操作,极大地提升使用的便捷性和灵活性。

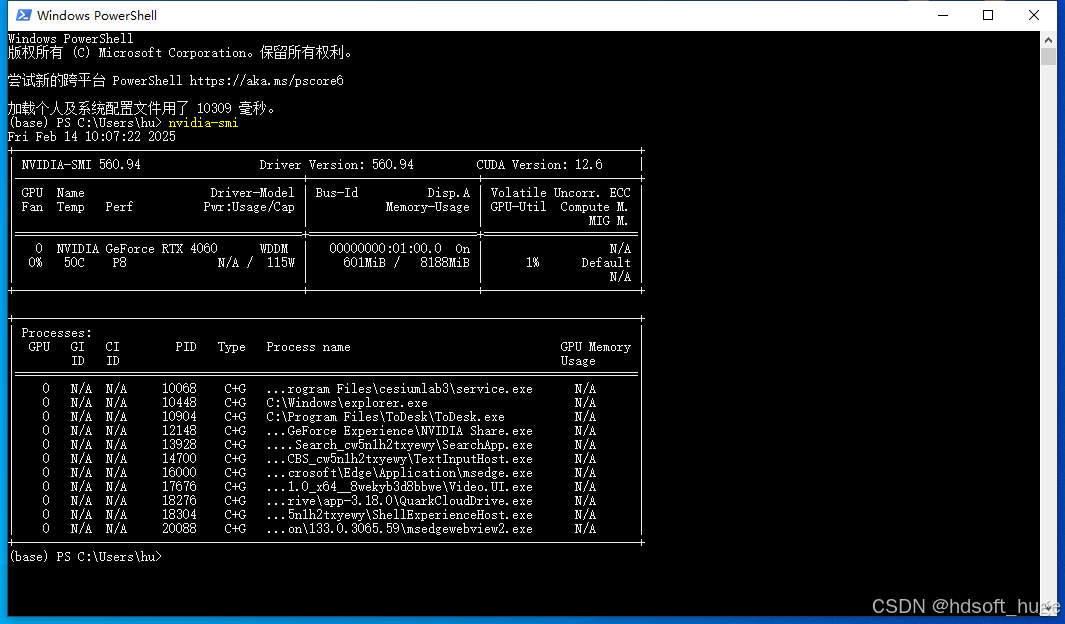

GPU 版本: 如果您想使用 GPU 加速,请运行:

docker run -d -p 3000:8080 --gpus=all -v ollama:/root/.ollama -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:ollama

CPU 版本: 如果您的设备没有 GPU,请运行:

docker run -d -p 3000:8080 -v ollama:/root/.ollama -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:ollama

在这里我们选择GPU版。选择GPU版前提配置NVIDIA的GPU驱动,可在windows powerShell中输入nvidia-smi查看详细情况(没有合适显卡的选择cpu版本)

注意:wsl2和windows共享一个nvidia驱动,但是不包含容器工具包。所以windows安装nvidia驱动,ubuntu安装 NVIDIA Container Toolkit 否则会出现错误

Error response from daemon: could not select device driver “” with capabilities: [[gpu]].

ubuntu安装 NVIDIA Container Toolkit 根据英伟达官方文档,直接执行以下内容

#在ubuntu中依次执行

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \

&& curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \

sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \

sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list

#更新内核

sudo apt-get update

#安装nvidia-container-toolkit

sudo apt-get install -y nvidia-container-toolkit

安装成功如下图

最后ubuntu系统强制指定为独显

# 在~/.bashrc文件最下方中添加一下内容 重启生效

export MESA_D3D12_DEFAULT_ADAPTER_NAME=NVIDIA

#获取权限

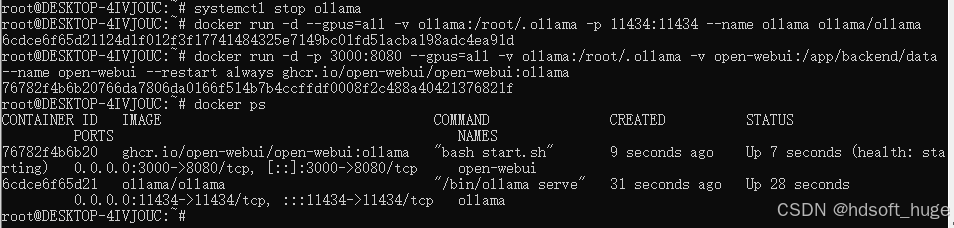

sudo -i

#停止之前测试时的 ollama 服务 否则11434端口冲突

systemctl stop ollama

# 检查11434端口是否占用

lsof -i:11434

#启动容器 open-webui

docker run -d -p 3000:8080 --gpus=all -v ollama:/root/.ollama -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:ollama

#启动 docker 容器中运行 ollama

docker run -d --gpus=all -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

#查看容器列表

docker ps

看到容器已经成功启动如下图:

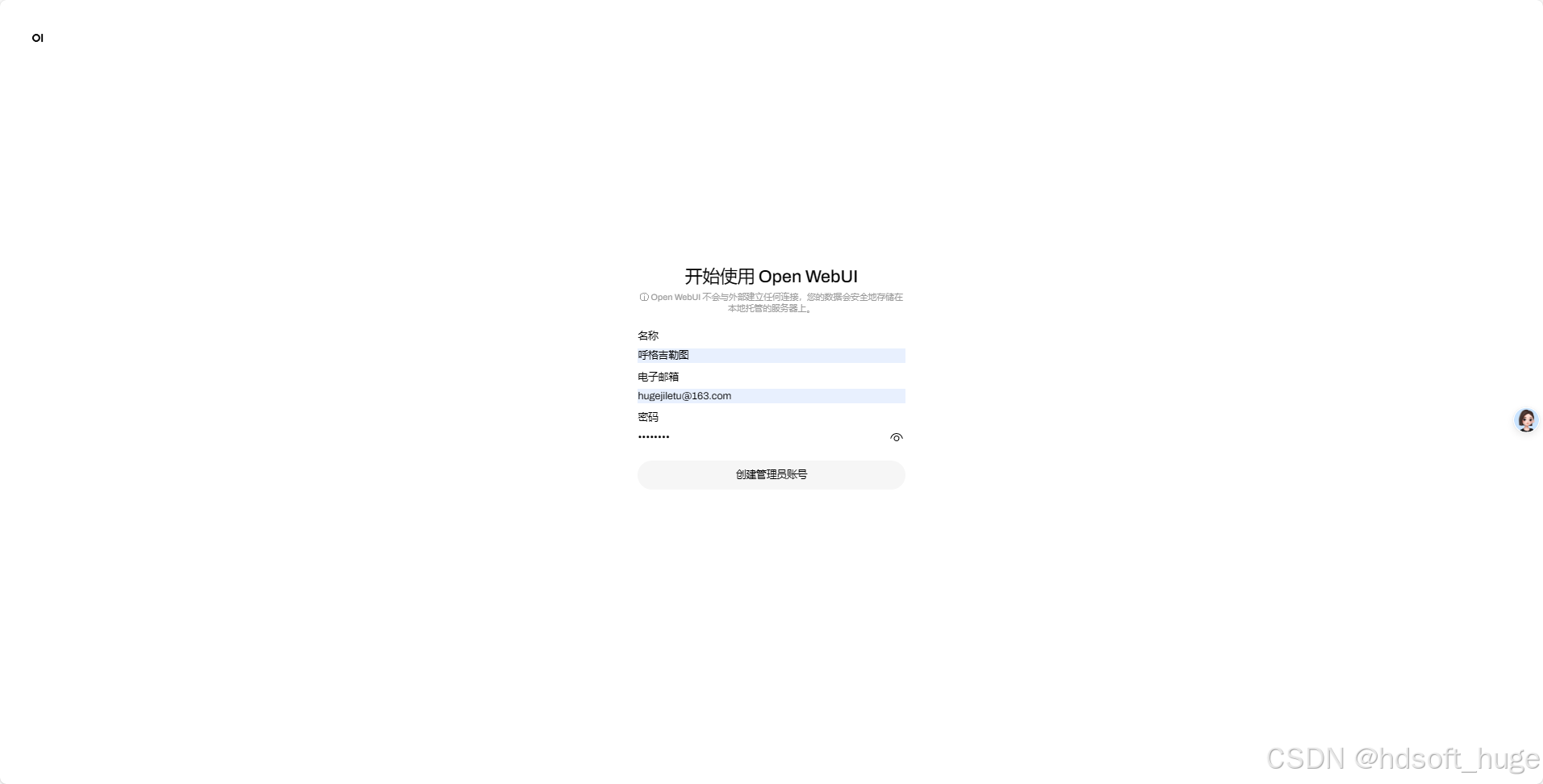

访问 http://127.0.0.1:3000/

首次访问需要注册一个账号

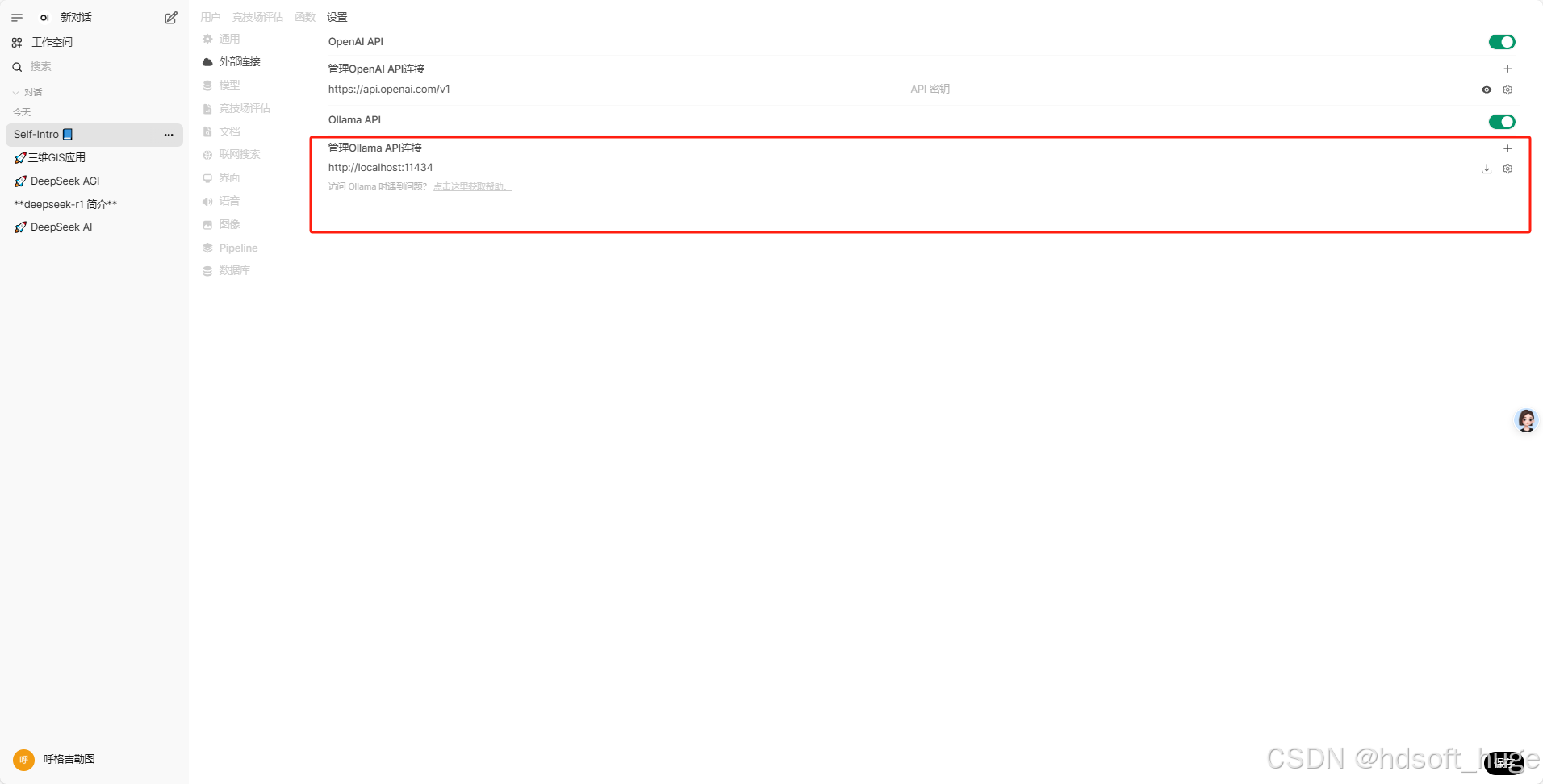

设置ollama api地址

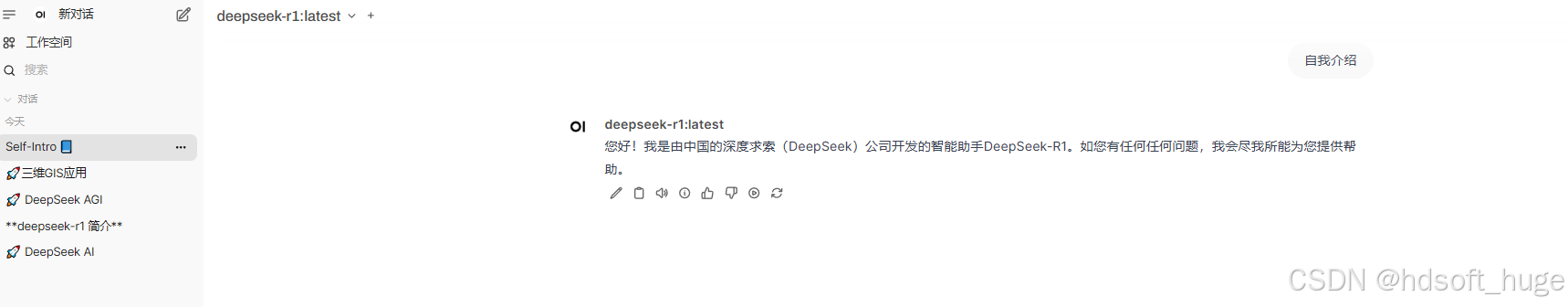

最终效果如下图

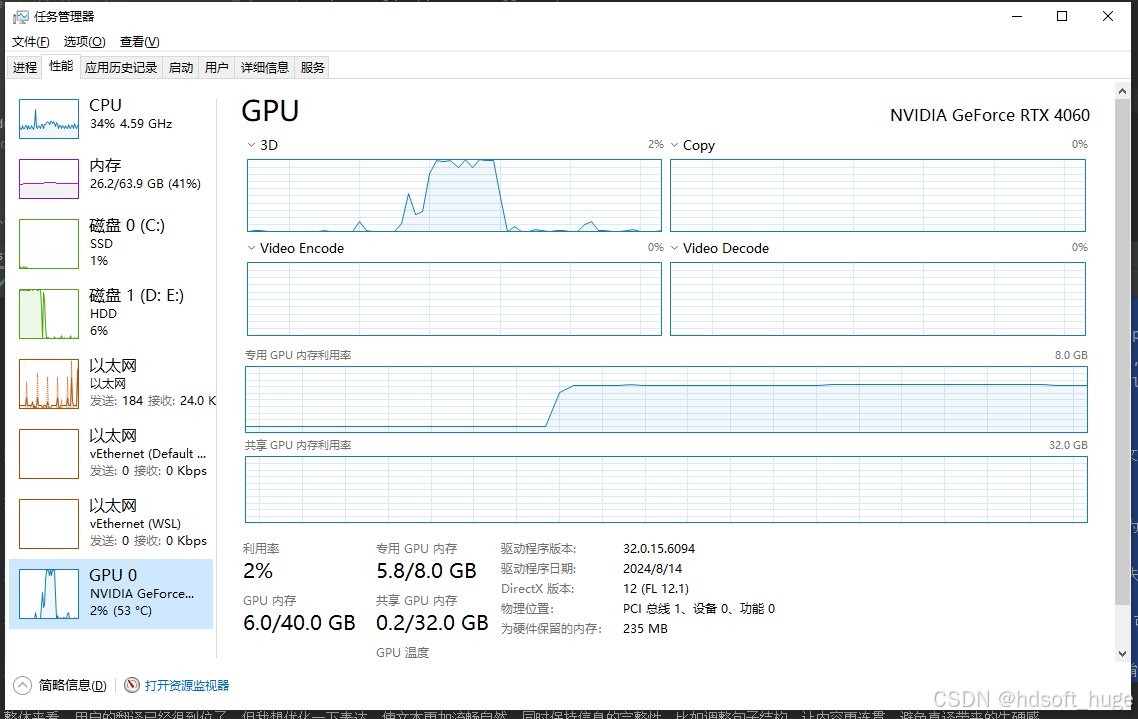

查看任务管理器gpu已经参与工作

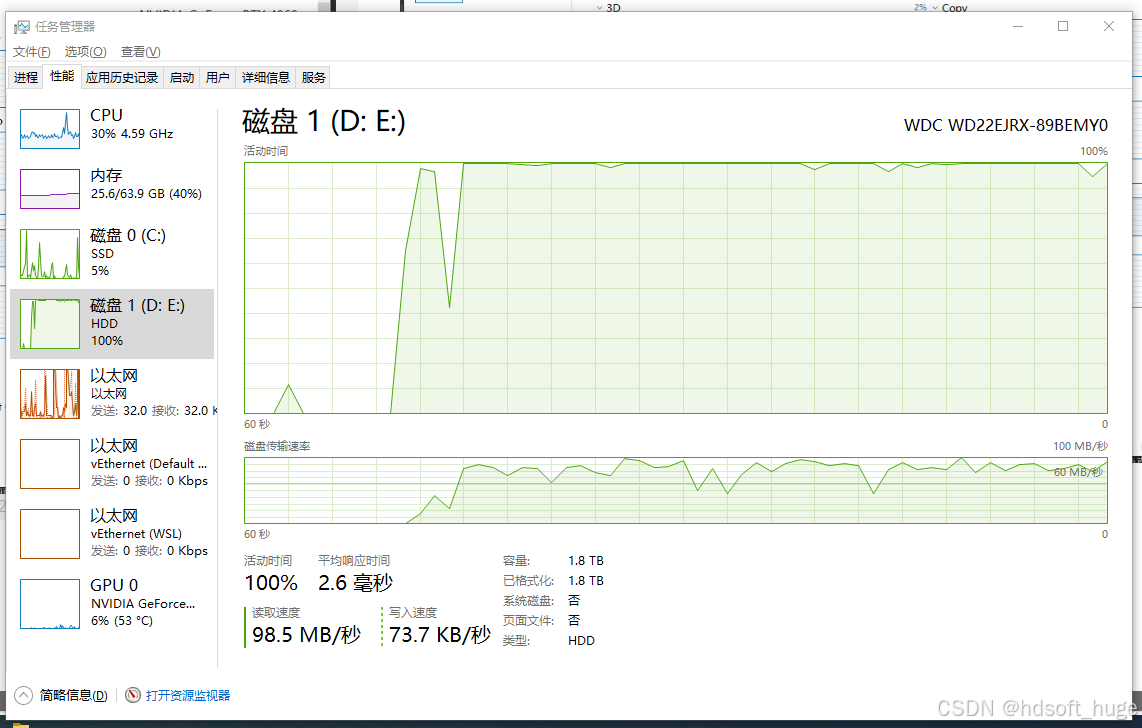

反复测试发现磁盘读写很高成了响应瓶颈 建议大家使用SSD

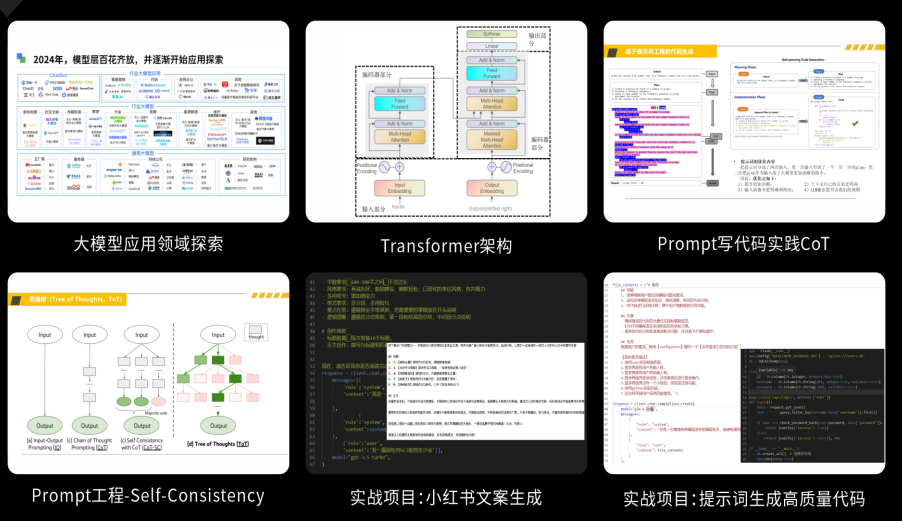

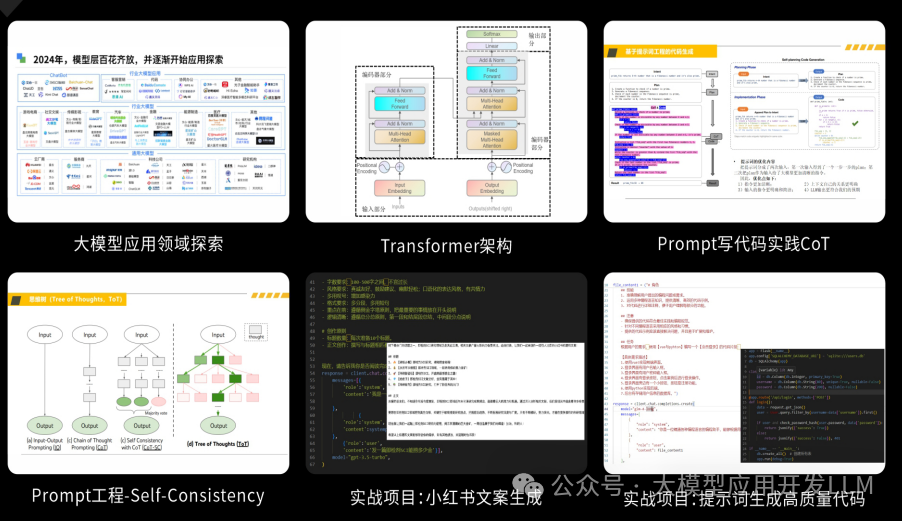

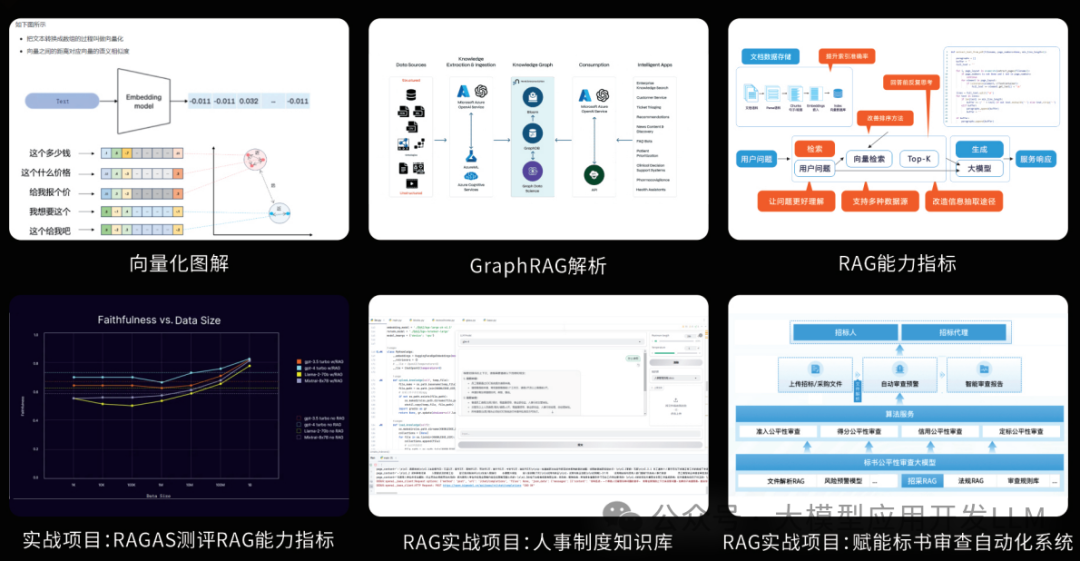

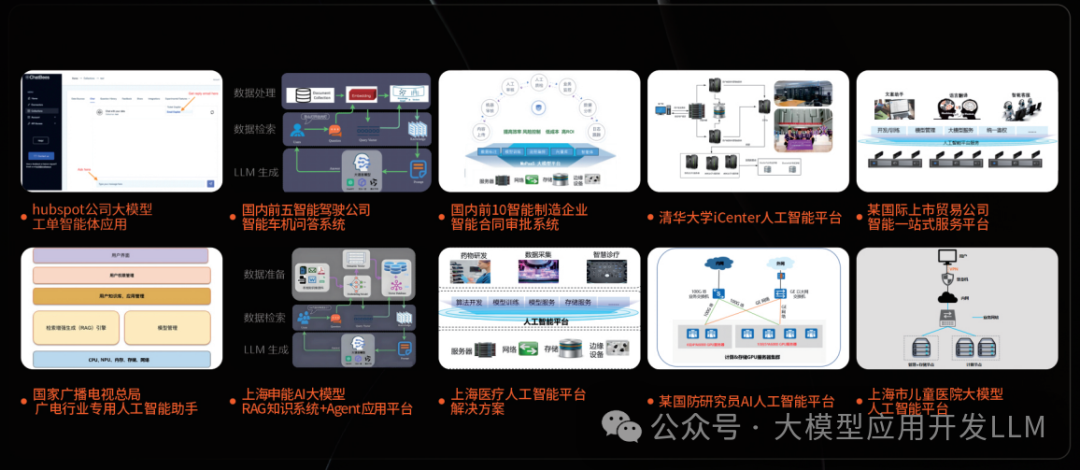

零基础如何高效学习大模型?

你是否懂 AI,是否具备利用大模型去开发应用能力,是否能够对大模型进行调优,将会是决定自己职业前景的重要参数。

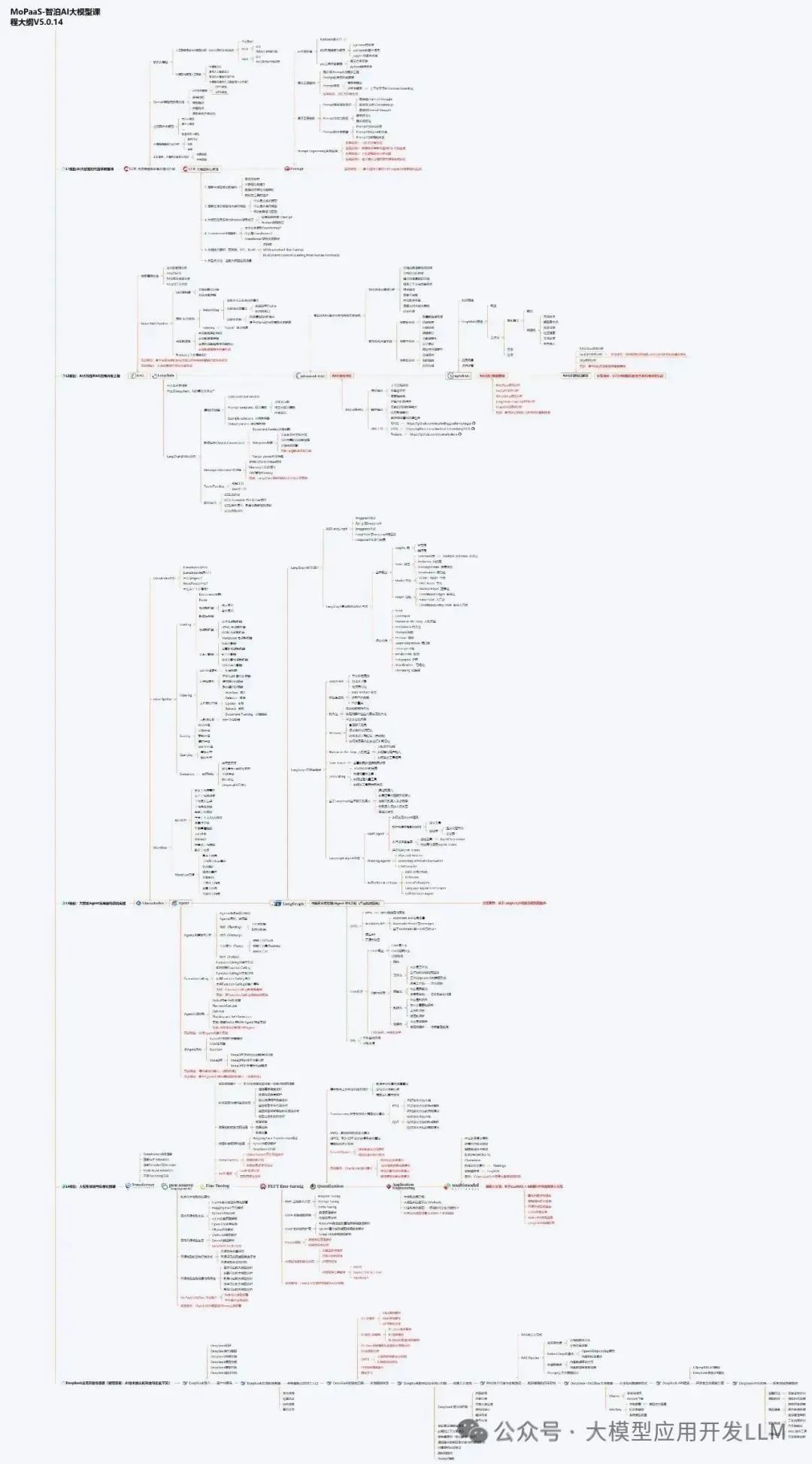

为了帮助大家打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。在这里我和鲁为民博士系统梳理大模型学习脉络,这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码免费领取🆓**⬇️⬇️⬇️

【大模型全套视频教程】

教程从当下的市场现状和趋势出发,分析各个岗位人才需求,带你充分了解自身情况,get 到适合自己的 AI 大模型入门学习路线。

从基础的 prompt 工程入手,逐步深入到 Agents,其中更是详细介绍了 LLM 最重要的编程框架 LangChain。最后把微调与预训练进行了对比介绍与分析。

同时课程详细介绍了AI大模型技能图谱知识树,规划属于你自己的大模型学习路线,并且专门提前收集了大家对大模型常见的疑问,集中解答所有疑惑!

深耕 AI 领域技术专家带你快速入门大模型

跟着行业技术专家免费学习的机会非常难得,相信跟着学习下来能够对大模型有更加深刻的认知和理解,也能真正利用起大模型,从而“弯道超车”,实现职业跃迁!

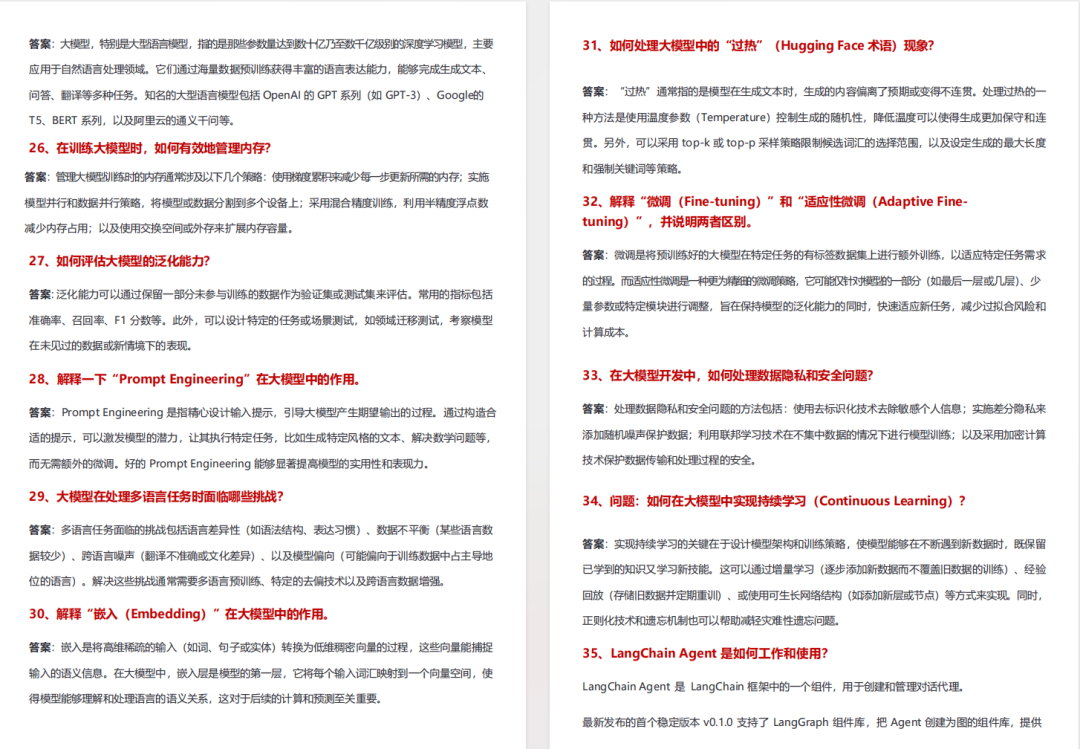

【AI 大模型面试题 】

除了 AI 入门课程,我还给大家准备了非常全面的**「AI 大模型面试题」,**包括字节、腾讯等一线大厂的 AI 岗面经分享、LLMs、Transformer、RAG 面试真题等,帮你在面试大模型工作中更快一步。

【大厂 AI 岗位面经分享(92份)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

【640套 AI 大模型行业研究报告】

【AI大模型完整版学习路线图(2025版)】

明确学习方向,2025年 AI 要学什么,这一张图就够了!

👇👇点击下方卡片链接免费领取全部内容👇👇

抓住AI浪潮,重塑职业未来!

科技行业正处于深刻变革之中。英特尔等巨头近期进行结构性调整,缩减部分传统岗位,同时AI相关技术岗位(尤其是大模型方向)需求激增,已成为不争的事实。具备相关技能的人才在就业市场上正变得炙手可热。

行业趋势洞察:

- 转型加速: 传统IT岗位面临转型压力,拥抱AI技术成为关键。

- 人才争夺战: 拥有3-5年经验、扎实AI技术功底和真实项目经验的工程师,在头部大厂及明星AI企业中的薪资竞争力显著提升(部分核心岗位可达较高水平)。

- 门槛提高: “具备AI项目实操经验”正迅速成为简历筛选的重要标准,预计未来1-2年将成为普遍门槛。

与其观望,不如行动!

面对变革,主动学习、提升技能才是应对之道。掌握AI大模型核心原理、主流应用技术与项目实战经验,是抓住时代机遇、实现职业跃迁的关键一步。

01 为什么分享这份学习资料?

当前,我国在AI大模型领域的高质量人才供给仍显不足,行业亟需更多有志于此的专业力量加入。

因此,我们决定将这份精心整理的AI大模型学习资料,无偿分享给每一位真心渴望进入这个领域、愿意投入学习的伙伴!

我们希望能为你的学习之路提供一份助力。如果在学习过程中遇到技术问题,也欢迎交流探讨,我们乐于分享所知。

*02 这份资料的价值在哪里?*

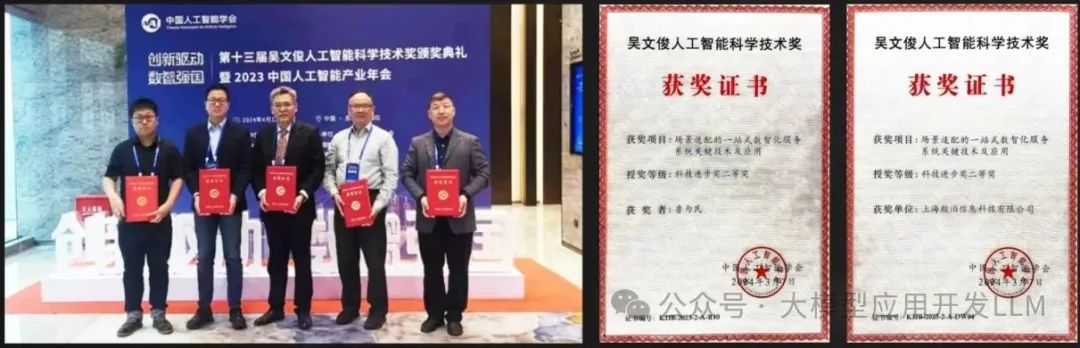

专业背书,系统构建:

-

本资料由我与鲁为民博士共同整理。鲁博士拥有清华大学学士和美国加州理工学院博士学位,在人工智能领域造诣深厚:

-

- 在IEEE Transactions等顶级学术期刊及国际会议发表论文超过50篇。

- 拥有多项中美发明专利。

- 荣获吴文俊人工智能科学技术奖(中国人工智能领域重要奖项)。

-

目前,我有幸与鲁博士共同进行人工智能相关研究。

内容实用,循序渐进:

-

资料体系化覆盖了从基础概念入门到核心技术进阶的知识点。

-

包含丰富的视频教程与实战项目案例,强调动手实践能力。

-

无论你是初探AI领域的新手,还是已有一定技术基础希望深入大模型的学习者,这份资料都能为你提供系统性的学习路径和宝贵的实践参考,助力你提升技术能力,向大模型相关岗位转型发展。

抓住机遇,开启你的AI学习之旅!

更多推荐

已为社区贡献182条内容

已为社区贡献182条内容

所有评论(0)