[特殊字符] 三步本地部署大模型DeepSeek:小白也能玩转AI!

最近两年是大模型的爆发期,从ChatGPT-3推出,其强大的推理能力远超人们的预期。2025年1月,国内DeepSeek上线,在以下八大领域表现出色:🧠 推理📖 自然语言理解与生成🖼️ 图像与视频分析🎙️ 语音识别与合成🎯 个性化推荐📊 大数据处理与分析🌈 跨模态学习⚡ 实时交互与响应本文只需三步,就能在本地运行一个大模型!Ollama 是一个开源的本地大语言模型运行框架,专为在本地

🌟 大模型时代来了!

最近两年是大模型的爆发期,从ChatGPT-3推出,其强大的推理能力远超人们的预期。2025年1月,国内DeepSeek上线,在以下八大领域表现出色:

-

🧠 推理

-

📖 自然语言理解与生成

-

🖼️ 图像与视频分析

-

🎙️ 语音识别与合成

-

🎯 个性化推荐

-

📊 大数据处理与分析

-

🌈 跨模态学习

-

⚡ 实时交互与响应

本文只需三步,就能在本地运行一个大模型!

🛠️ 第一步:下载Ollama(本地大模型运行神器)

Ollama 是一个开源的本地大语言模型运行框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计,支持:

-

macOS

-

Windows

-

Linux

-

Docker 容器

借助 Ollama,你可以轻松在本地运行、管理和与大型语言模型交互,大大简化部署操作!

📥 下载方式:

-

打开 Ollama 官网

-

根据你的操作系统下载对应版本

-

按照提示安装即可

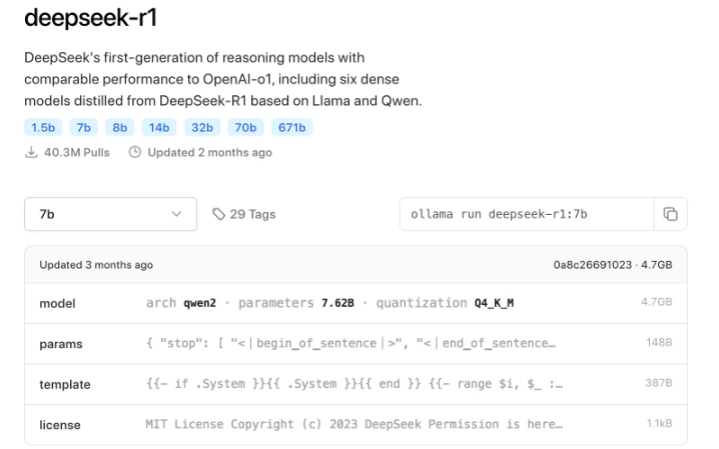

🤖 第二步:下载DeepSeek-R1模型

Ollama 提供了丰富的模型列表,包括:

-

Llama

-

Gemma

-

最新的DeepSeek-R1

本文以最近爆火的 DeepSeek-R1 为例,选择 7B 版本(70亿参数,大小4.7GB)。

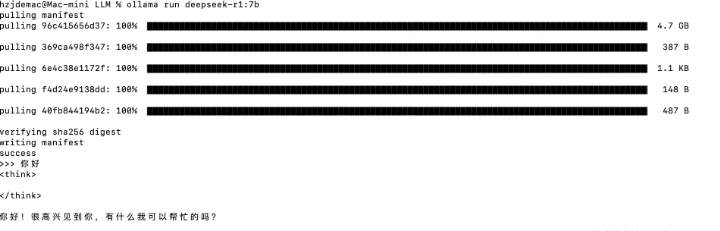

⚡ 安装并运行模型

在终端输入以下命令:

ollama run deepseek-r1:7b

安装成功后,终端会进入交互式对话模式!

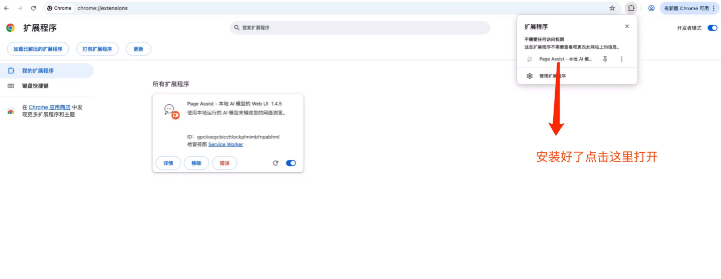

🌐 第三步:安装谷歌浏览器插件 Page Assist(可选但推荐)

虽然终端可以交互,但浏览器插件更方便!

📌 安装方式:

-

直接安装:在 Chrome 插件商店 搜索 Page Assist 并安装

-

离线安装:文末提供网盘备份(如需)

🎉 到这里,你的本地大模型就部署完成啦!

⚠️ 注意事项

-

本地性能有限:受内存限制,本地运行效果不如云端“满血版”,适合当聊天助手玩玩~

-

不用时建议关闭:模型会占用几个GB的内存,可以通过终端命令关闭:

ollama ps # 查看运行中的模型 ollama stop deepseek-r1:7b # 关闭模型

-

更多命令:输入

ollama --help查看完整指令

🎁 总结

只需三步:

-

下载 Ollama

-

安装 DeepSeek-R1 模型

-

(可选)安装 Page Assist 插件

你的本地 AI 助手就搞定了! 🎉

💬 互动话题:

-

你尝试过哪些本地大模型?

-

觉得 DeepSeek 表现如何?

👇 评论区见!

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)