DeepSeek 学习笔记 (1)

DeepSeek 在这个春节大放异彩,横扫朋友圈和长辈酒局,一起来学习一下,打算体验一下用DeepSeek 学习DeepSeek, 玩一把 “自举”.

·

缘起

DeepSeek 在这个春节大放异彩,横扫朋友圈和长辈酒局,一起来学习一下,打算体验一下用DeepSeek 学习DeepSeek, 玩一把 “自举”.

参考资料

https://arxiv.org/abs/2412.19437 (100个作者署名的文章,也是少见)

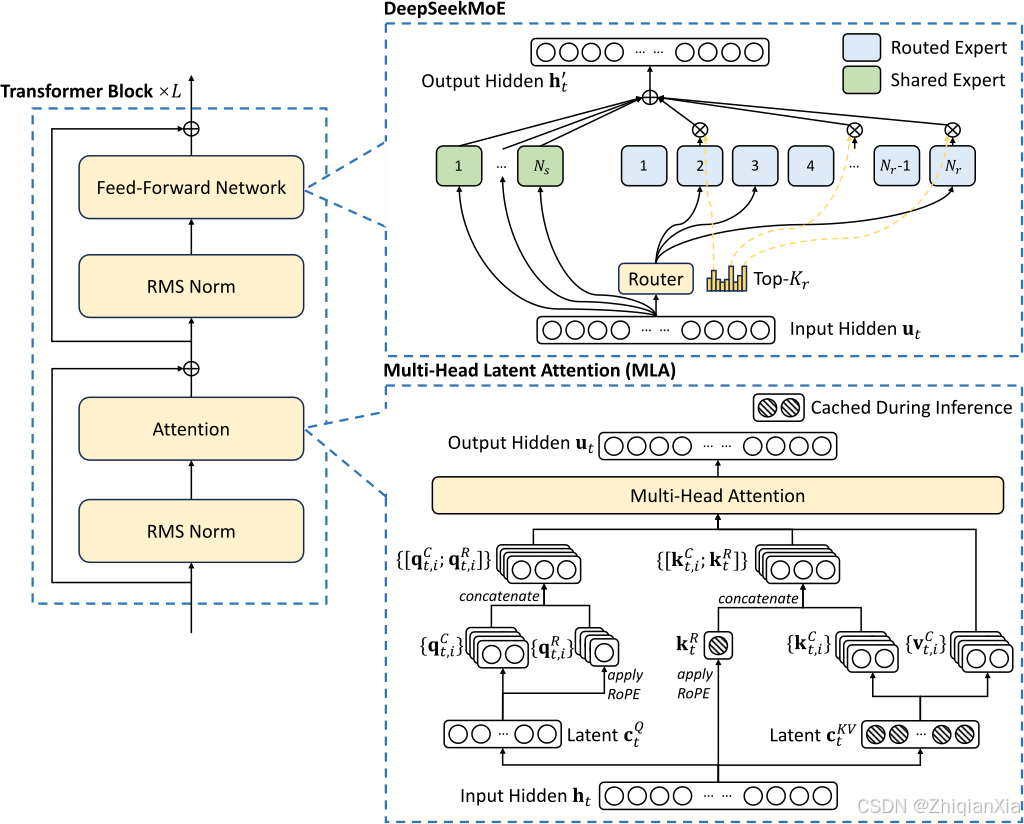

模型架构

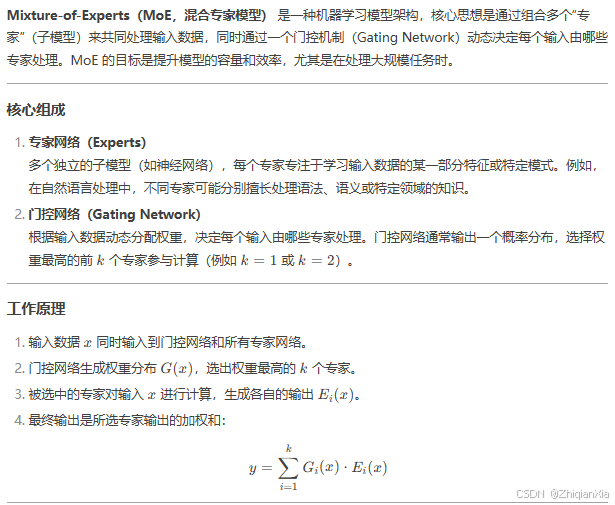

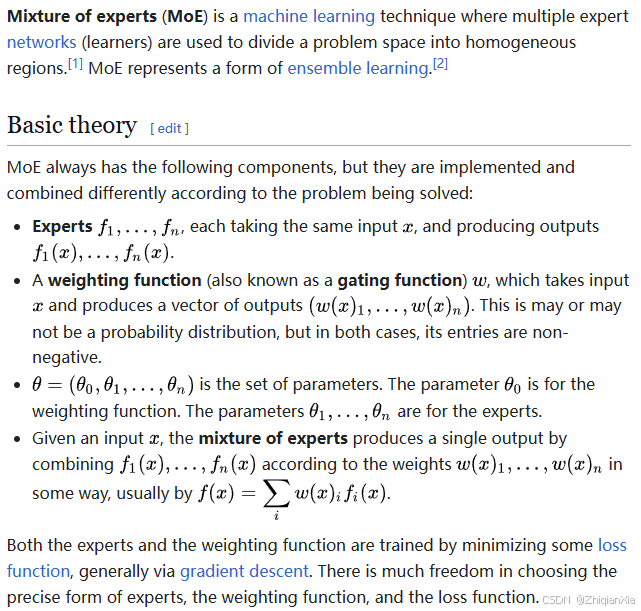

Q1: 什么是 Mixture-of-Experts (MoE) :

DeepSeek 回答:

Wiki版回答:

个人思考🤔:

从架构图和DeepSeek 回答中,系统层面可以看出,这个模块的技术核心是如何选择对应"专家",即门控系统与路由算法的设计, 这里核心算法应该是一个TopK 的思想.

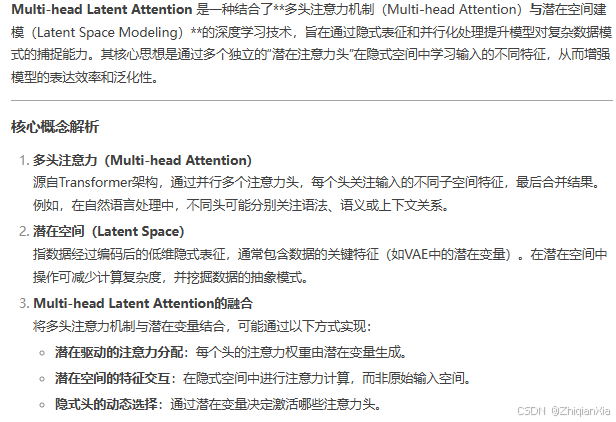

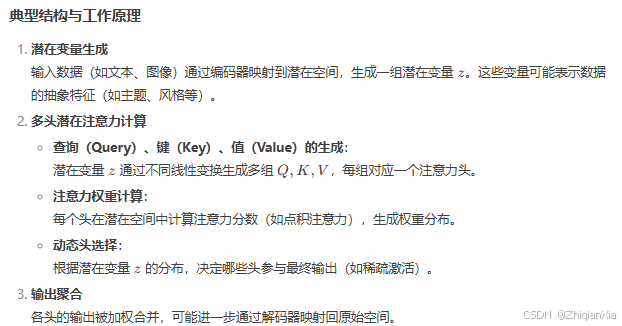

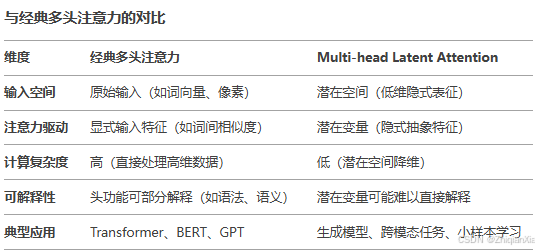

Q2: 什么是MLA?

DeepSeek 回答.

一个优质博主的总结:https://zhuanlan.zhihu.com/p/700214123

个人思考🤔:我暂时不是很明白,这些矩阵是怎么算出来的.

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)