本地部署DeepSeek-R1,搭建本地知识库

本章主要是通过ollama来安装运行deepseek模型,通过RAGFlow提供知识库服务

本地部署DeepSeek-R1,搭建本地知识库

本章节内容是参照哔哩哔哩上的【一拳S7】作者分享的视频教程(【喂饭教程】20分钟教会你本地部署DeepSeek-R1,并搭建自己的知识库!小白也能轻松上手!!)搭建的。

概述:本章主要是通过ollama来安装运行deepseek模型,通过RAGFlow提供知识库服务

一、环境准备

| 序号 | 内容 | 说明 |

|---|---|---|

| 1 | PC配置 | 华为MetaBook16s CPU:i7, 内存32G,【此项只做为本人环境的记录,不是必备条件】 |

| 2 | 操作系统 | Windows 11 家庭中文版 |

| 3 | deepseek | 官网地址:https://www.deepseek.com/ |

| 4 | ollama | 版本:0.5.7(截止发稿时的最新release), 官网地址: https://ollama.com/ |

| 5 | deepseek-R1 | deepseek推理模型,大小:4.7GB,详情参见 Ollama官网->Models页面 |

| 6 | RAGFlow | 版本:v0.16.0 RAGFlow 是一款基于深度文档理解构建的开源 RAG(Retrieval-Augmented Generation)引擎。RAGFlow 可以为各种规模的企业及个人提供一套精简的 RAG 工作流程,结合大语言模型(LLM)针对用户各类不同的复杂格式数据提供可靠的问答以及有理有据的引用。 |

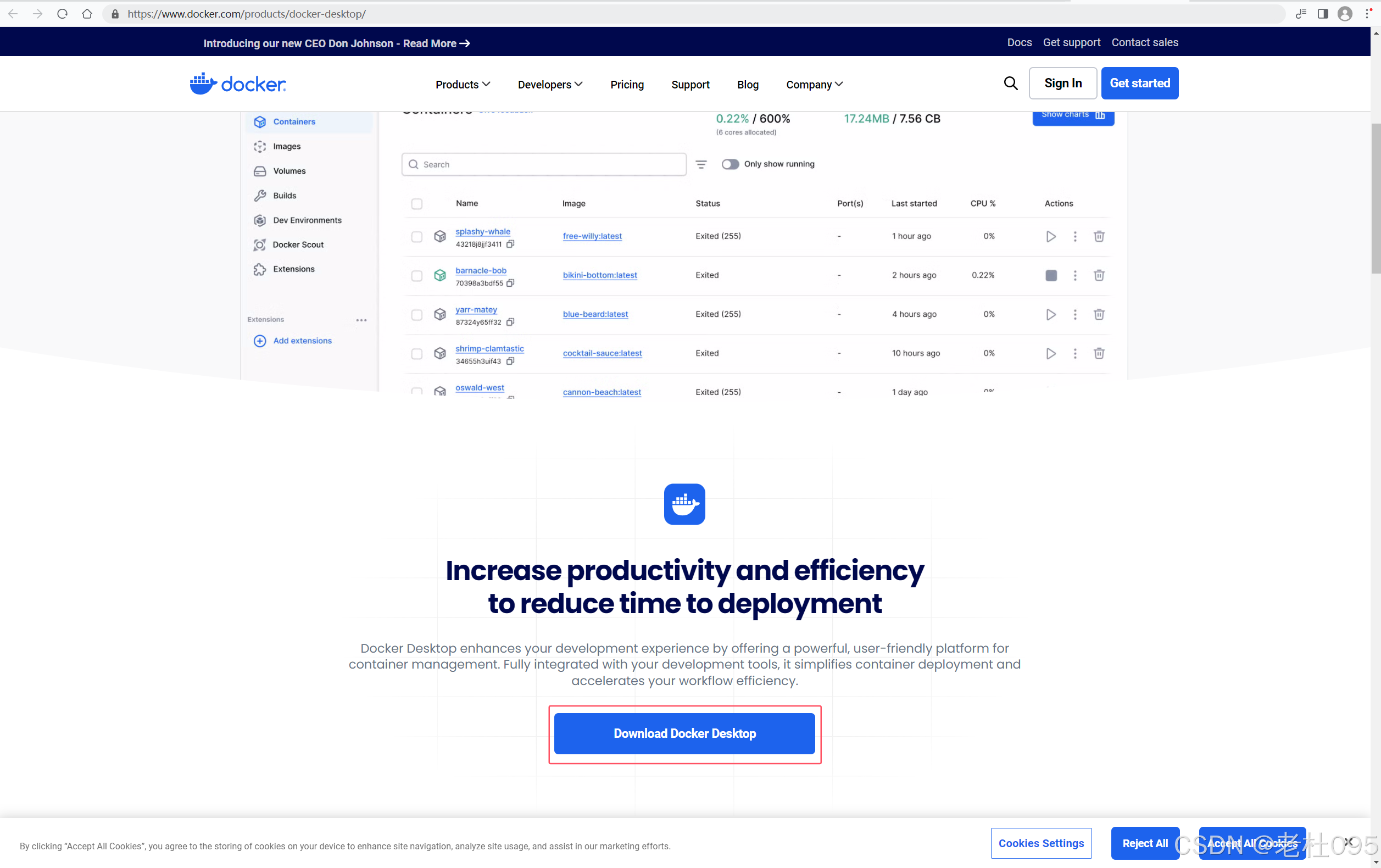

| 7 | Docker Desktop | Windows环境下用于管理、运行Docker镜像、容器的可视化管理工具 官方网址:https://www.docker.com/products/docker-desktop/ |

二、安装过程

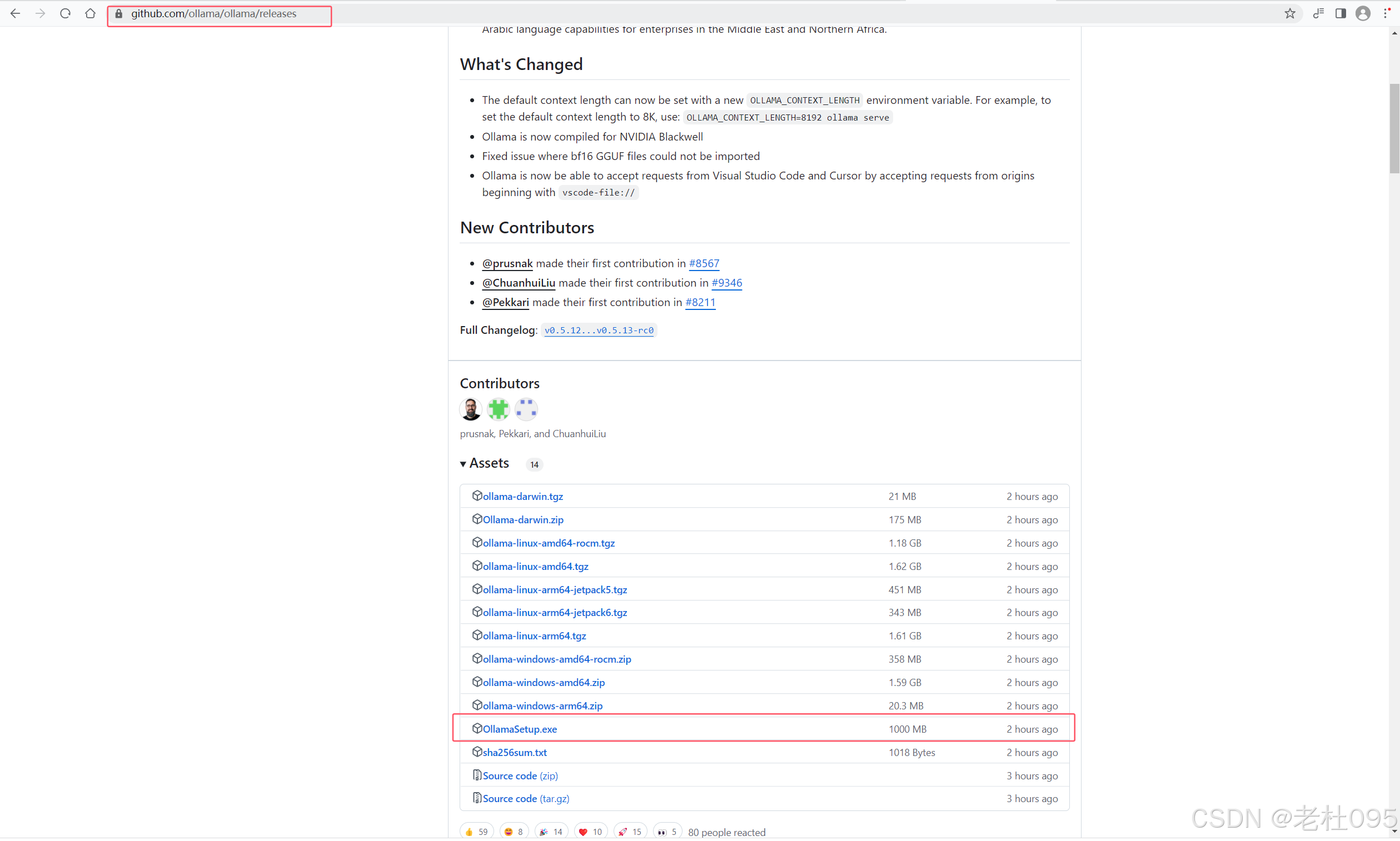

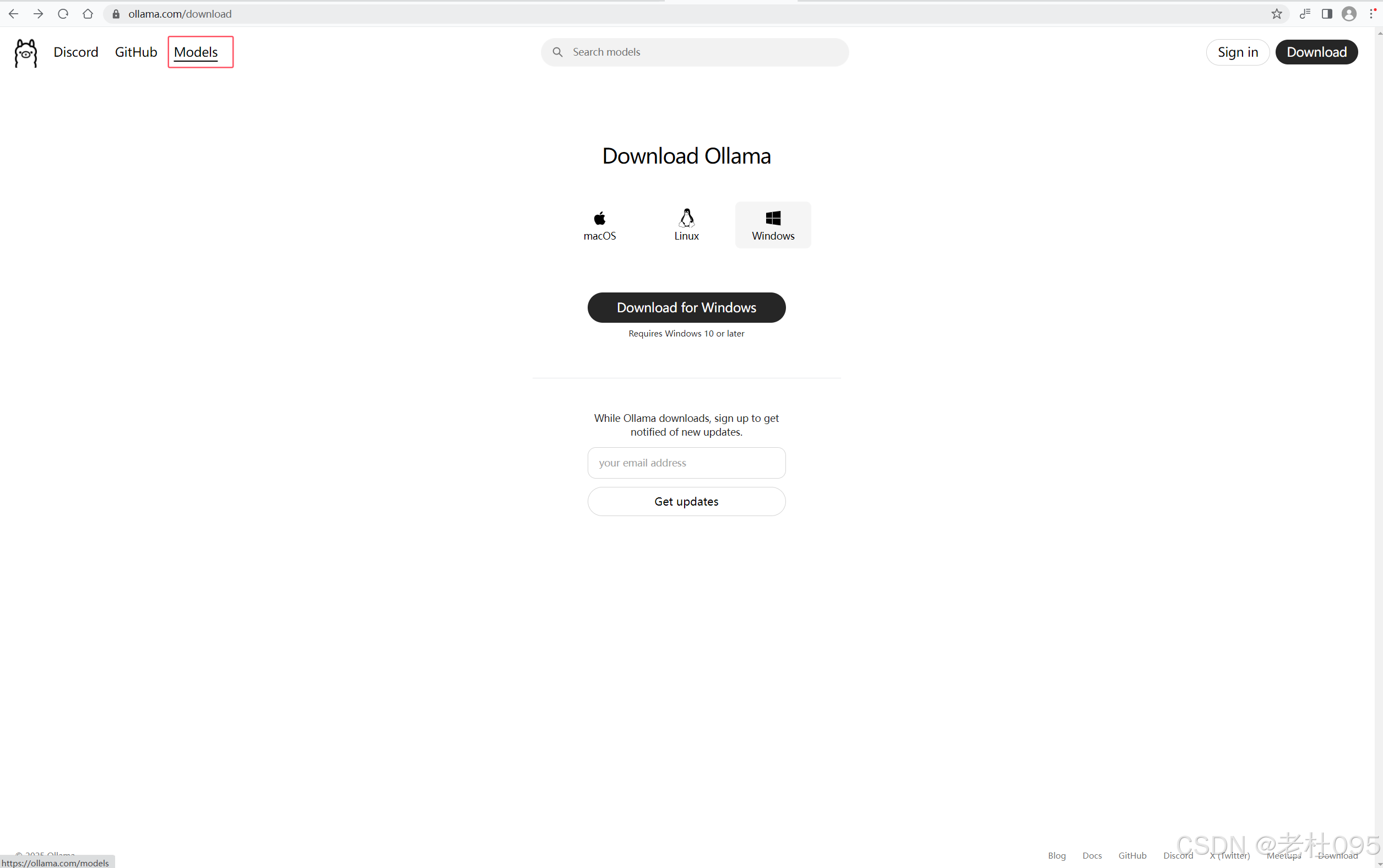

1、下载安装ollama

1)、下载ollama

官方网站下载较慢,本章节是通过github上进行下载的,下载地址:下载地址: https://github.com/ollama/ollama/releases

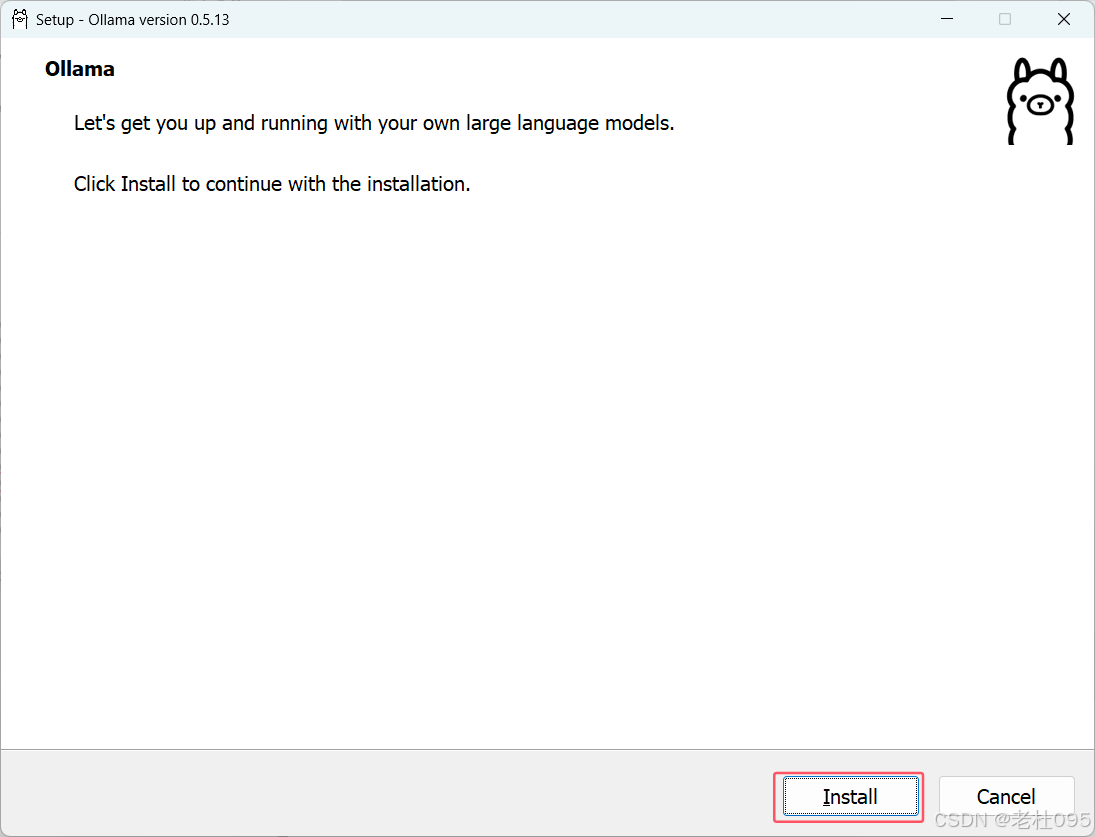

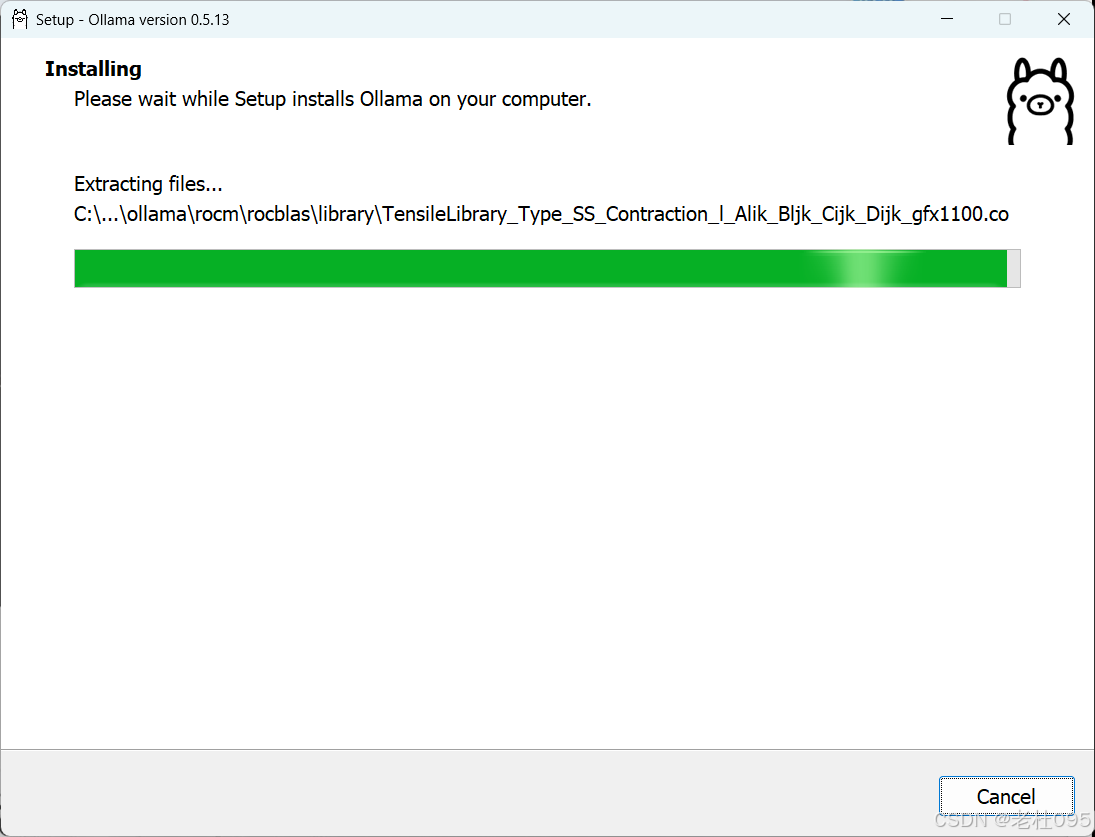

2)、安装ollama

双击【OllamaSetup.exe】安装文件,执行安装

3)、验证ollama

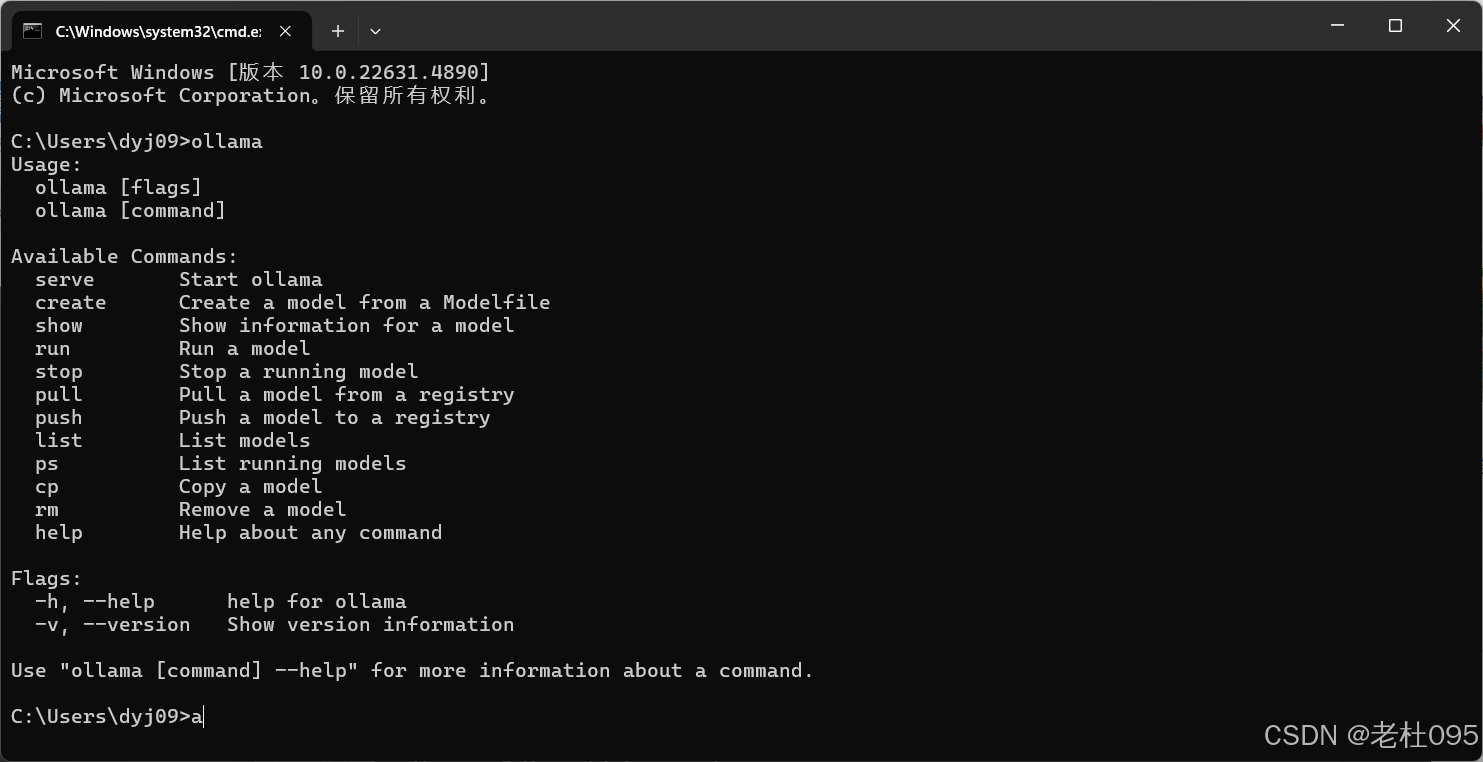

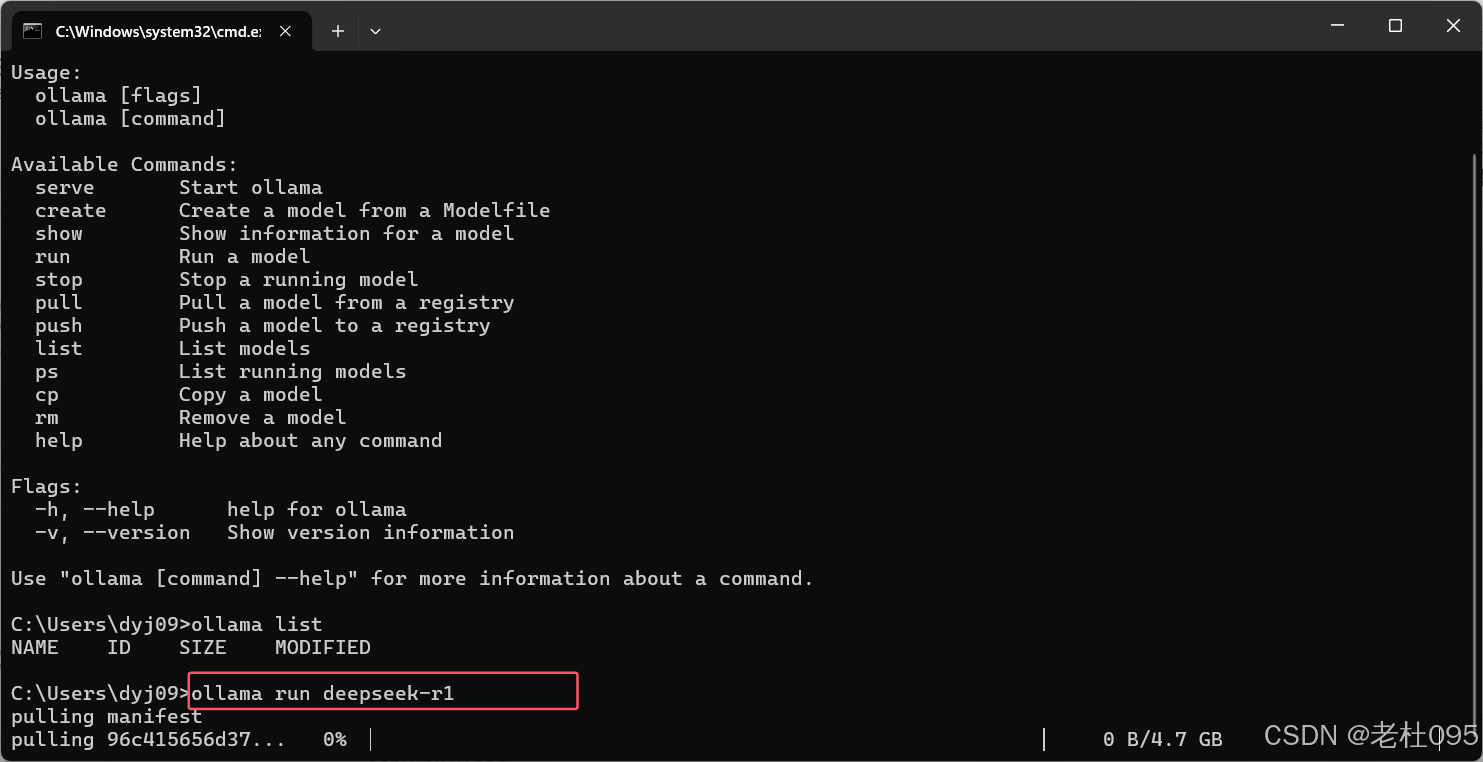

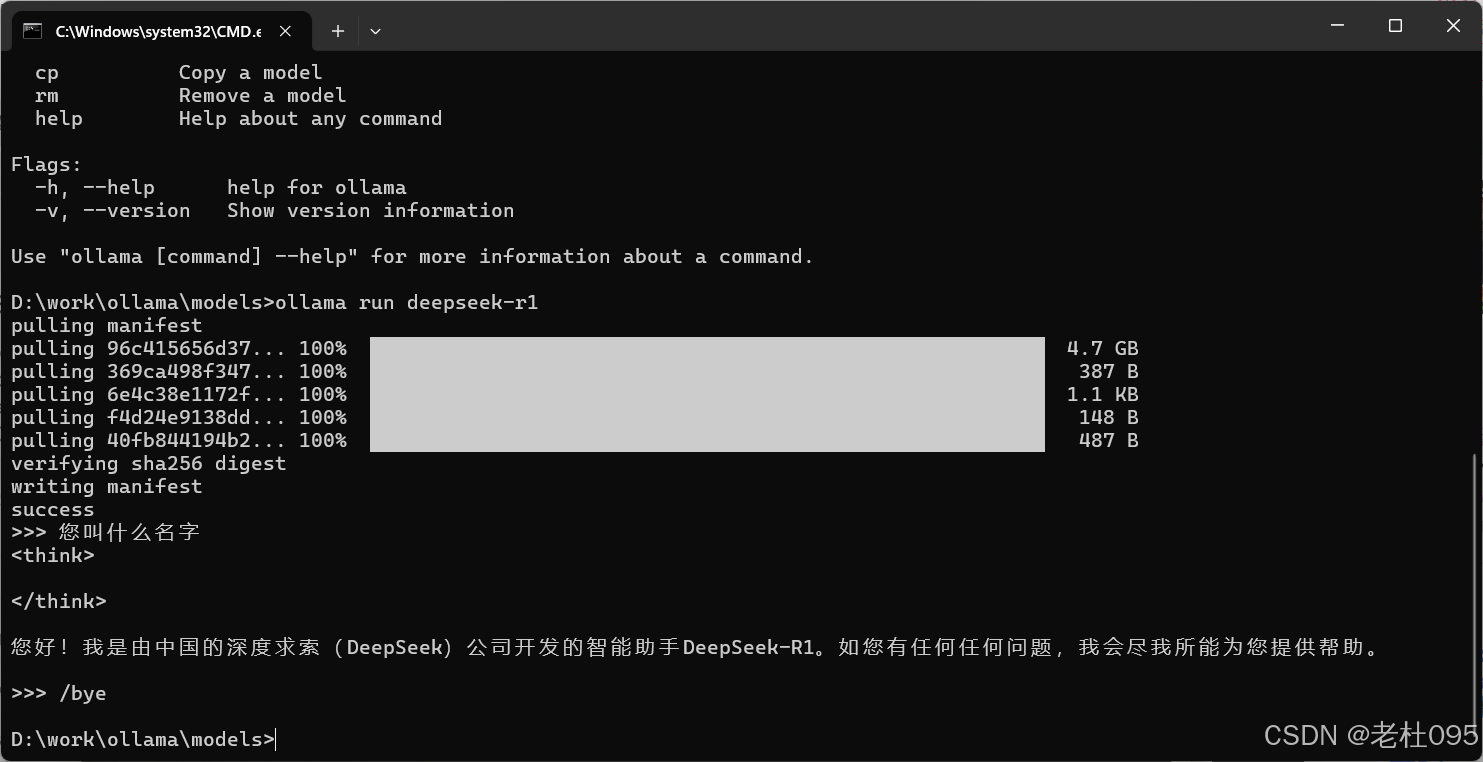

在cmd命令窗口执行ollama命令出现下图所示命令使用用法说明输出则安装成功。

【ollama用法】

- ollama list: 用户输出本地已安装的模型

4)、ollama本地环境变量配置

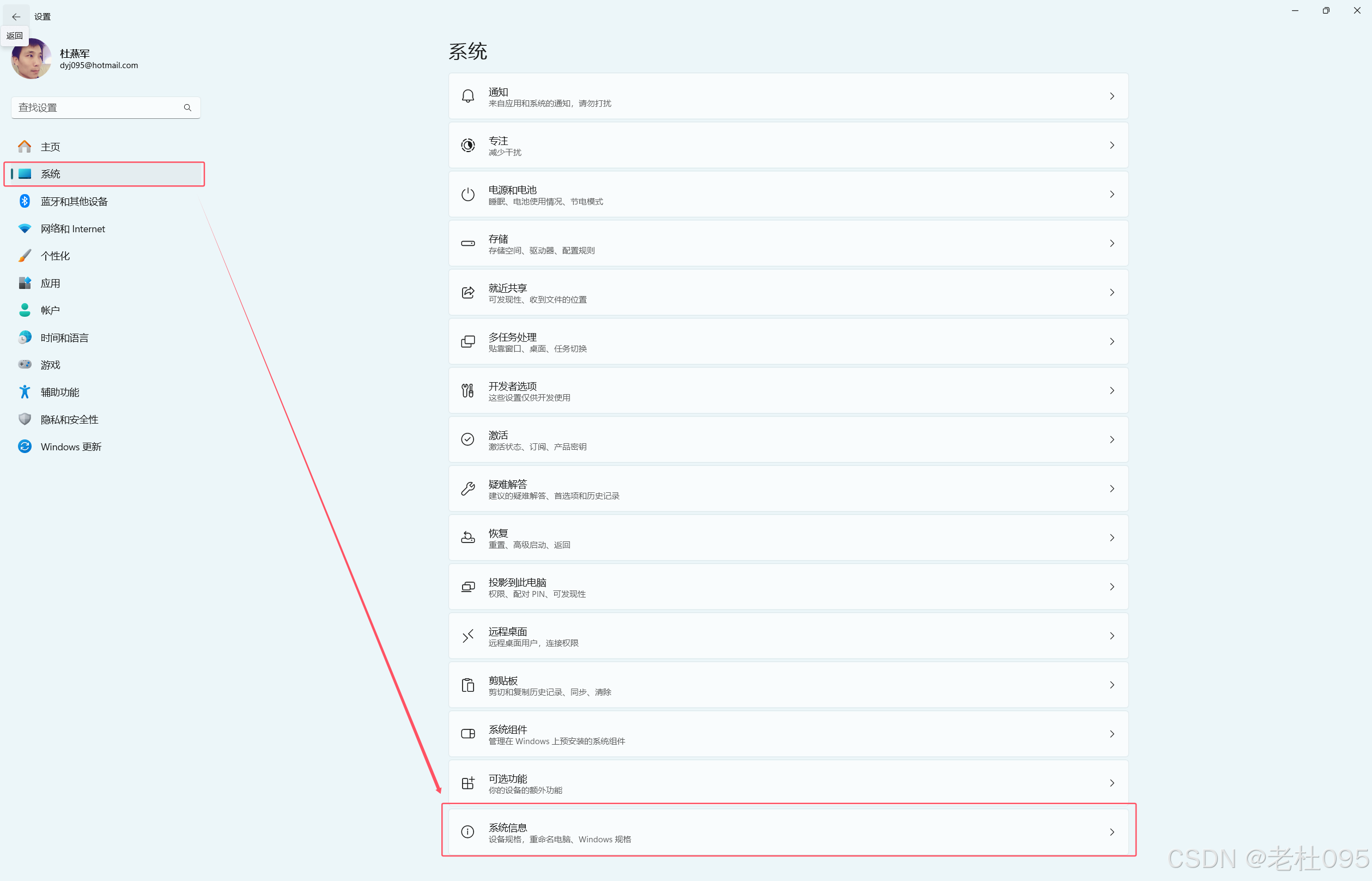

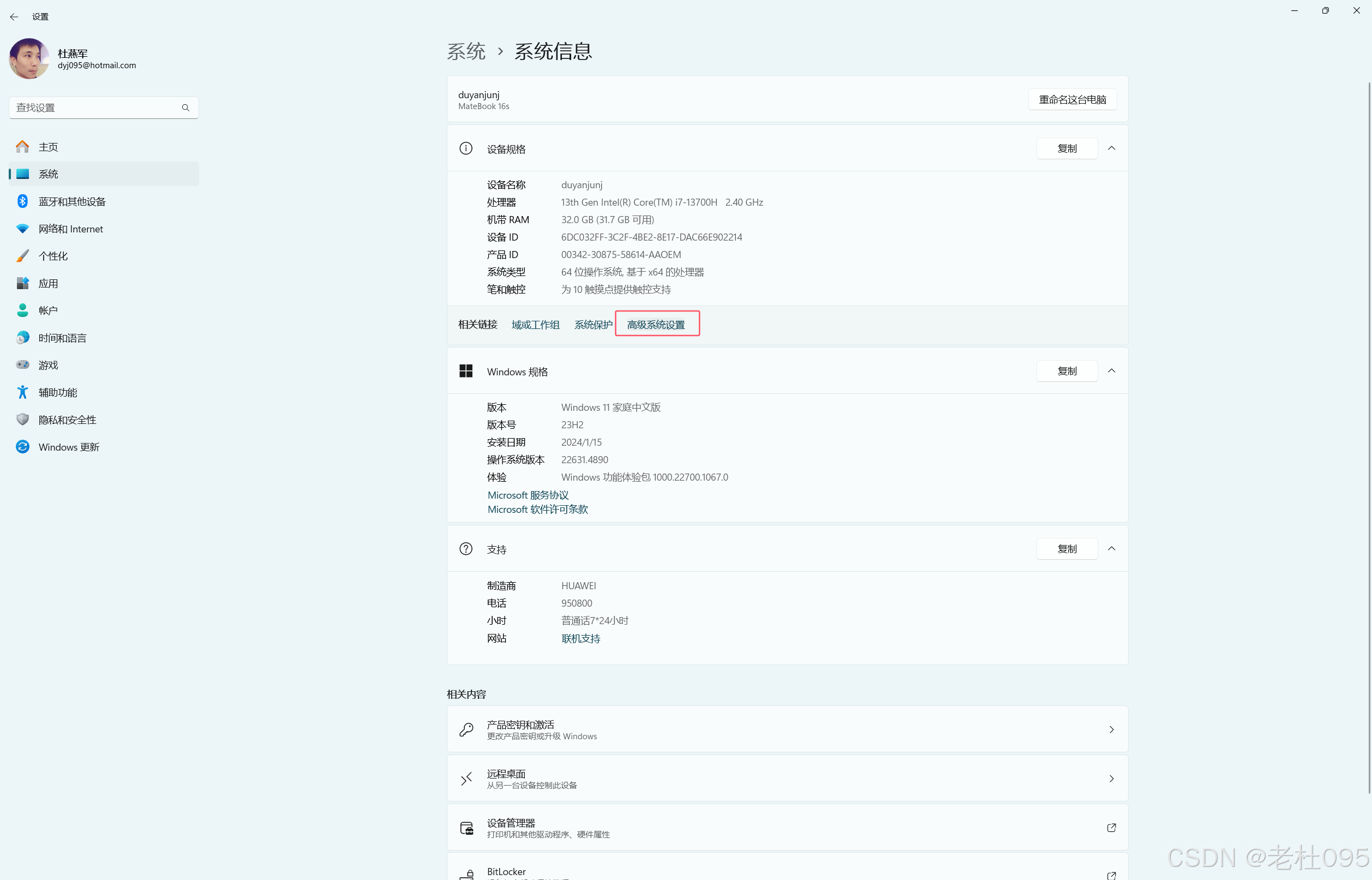

1、进入环境变量设置窗口: 设置 -> 系统 -> 系统信息 -> 高级系统设置 -> 环境变量

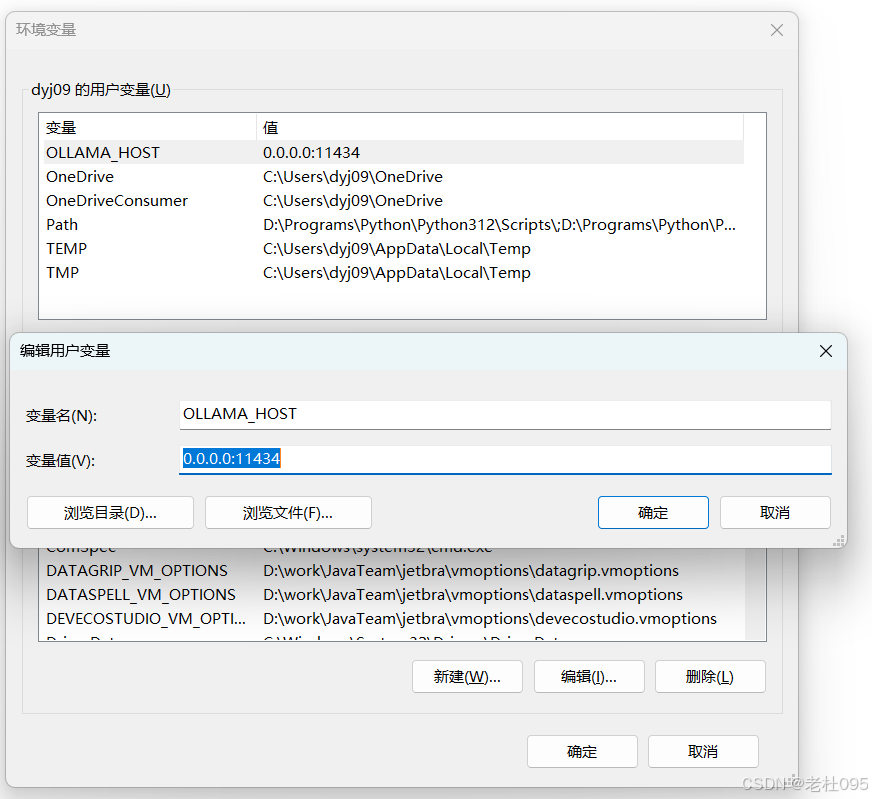

2、添加环境变量: OLLAMA_HOST=0.0.0.0:11434 【必须配置】

- 说明:0.0.0.0表示ip,表示ollama服务监听监听本地所有IP,11434: ollama服务监听端口

3、添加环境变量: OLLAMA_MODELS=D:\work\ollama\models 【选配】

- 说明:ollama模型默认会下载到C盘,此参数可以配置ollama模型下载到其它路径下,如果C盘空间够用则不需要配置

- 注意: 如果配置此参数后仍下载到C盘,【解决方案】:打开任务管理器,结束掉 "ollama"开头的进程,再回到命令窗口重新执行下载模型命令

(1)、进入环境变量设置窗口

(2)、添加环境变量: OLLAMA_HOST

(3)、添加环境变量: OLLAMA_MODELS

2、下载deepseek模型

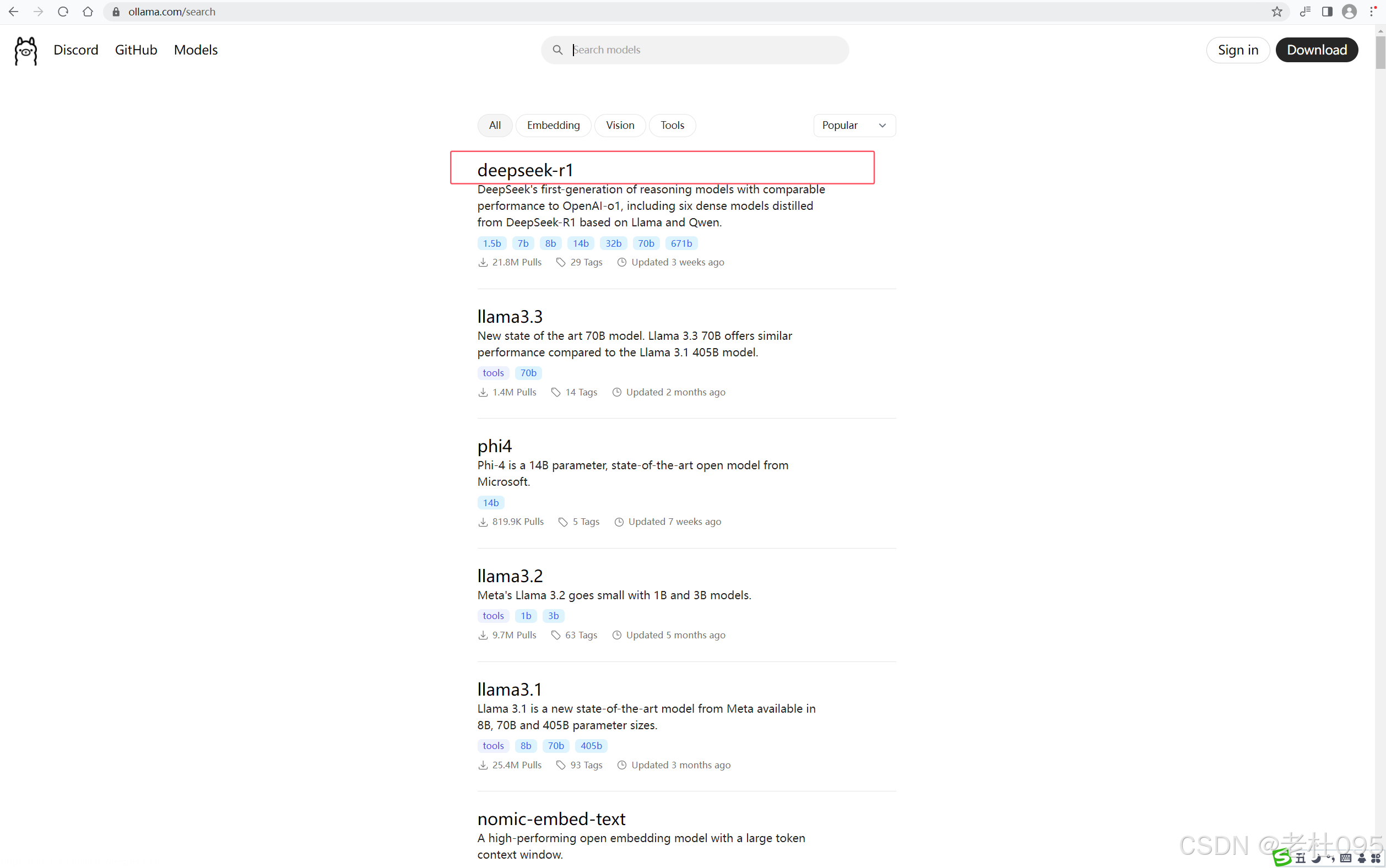

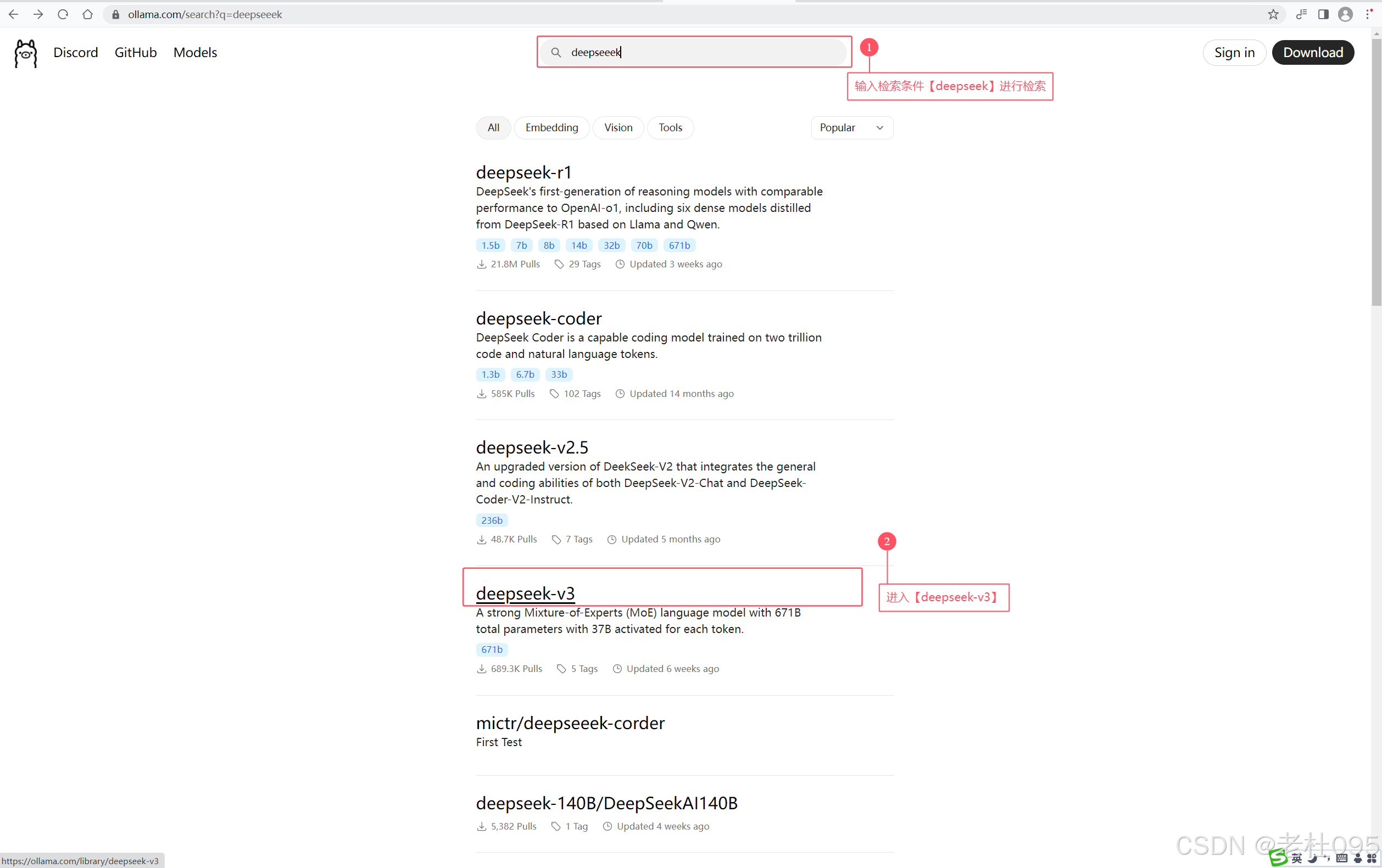

从官方网站首页点【Models】链接进入模型检索页面

1)、下载安装deepseek-R1模型

(1)、下载deepseek-R1模型

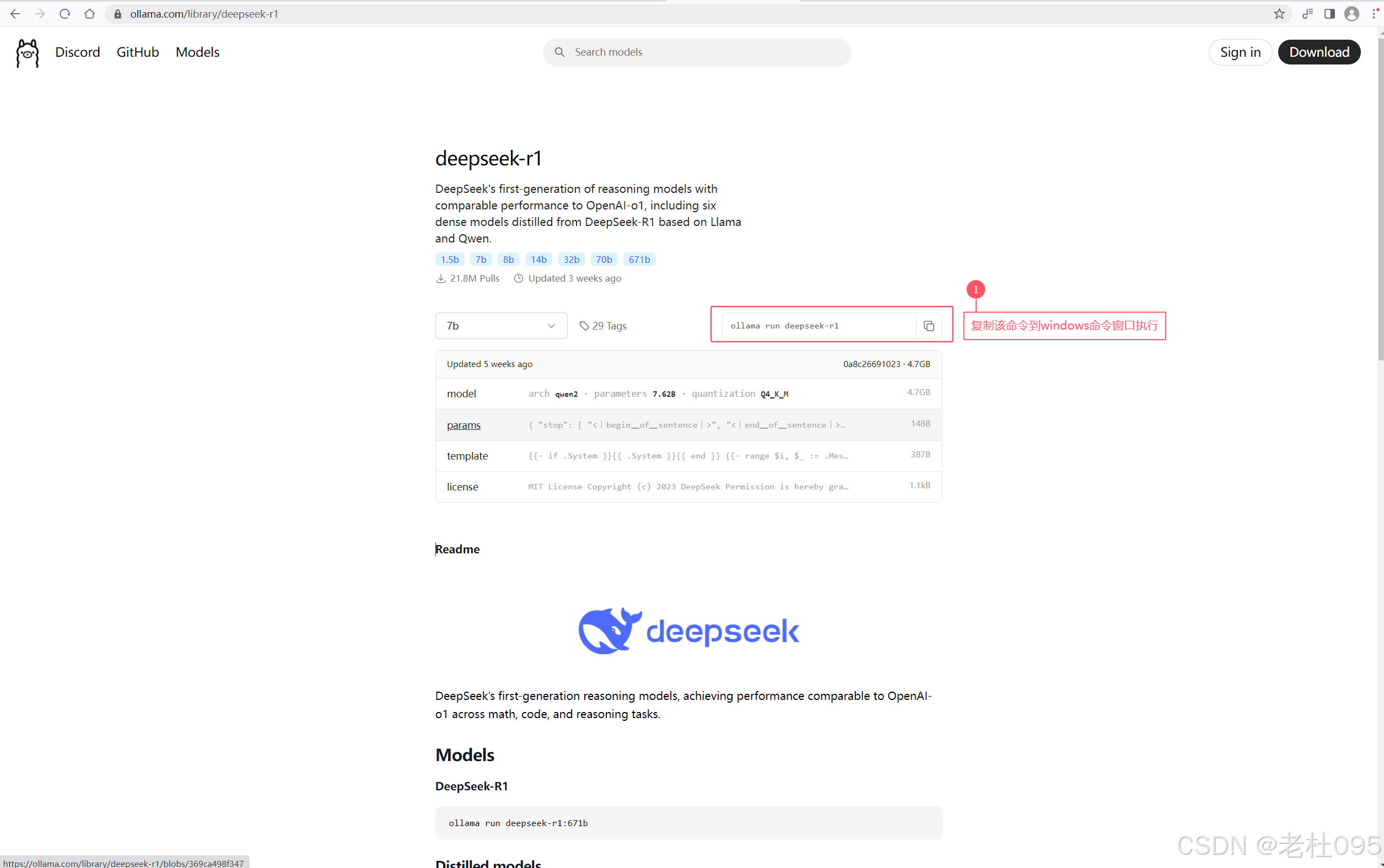

在Ollama官方网站->Models页面进入【deepseek-r1】

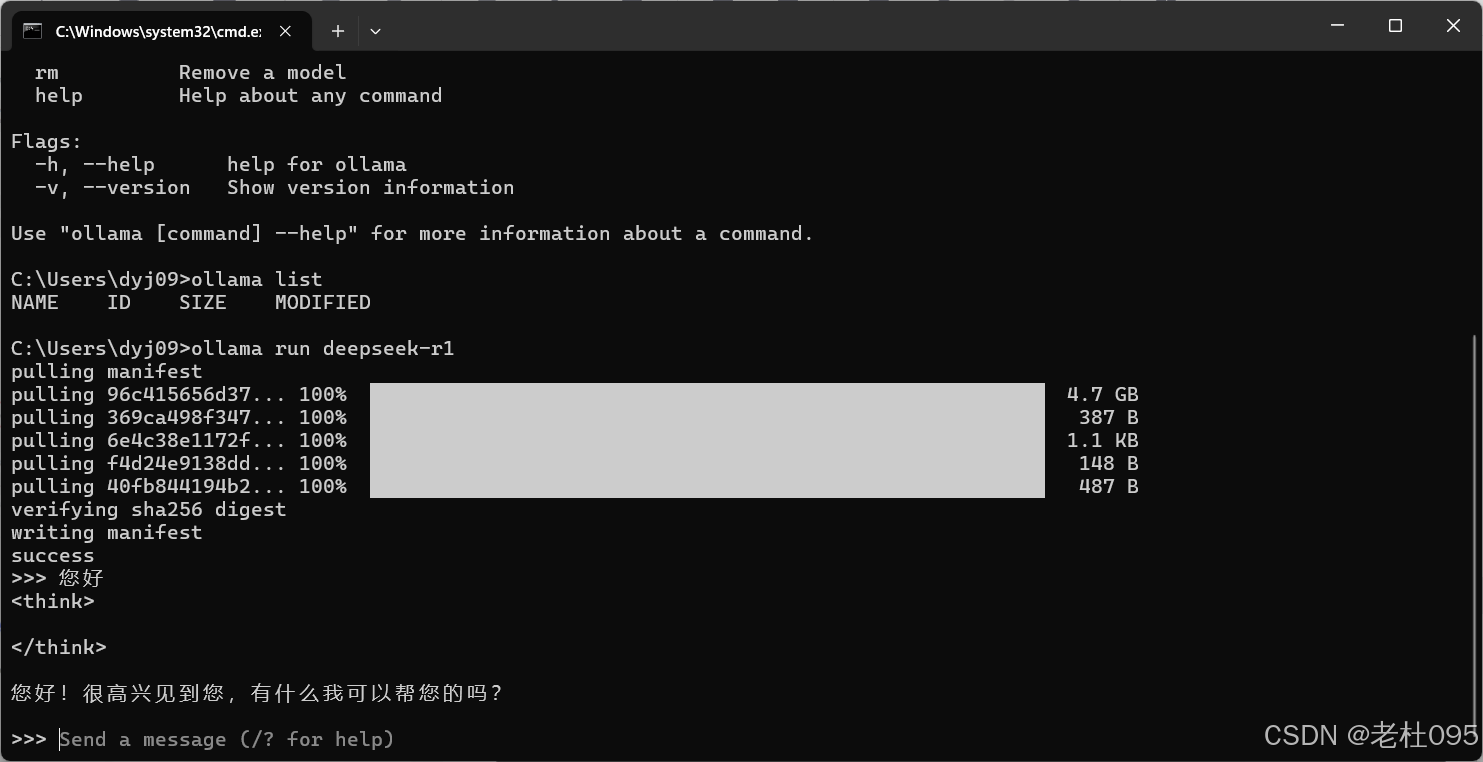

(2)、测试deepseek-R1模型

在Windows命令行窗口运行下面命令

C:\Users\dyj09> ollama run deepseek-r1

- ollama run deepseek-r1:运行deepseek-r1

- /bye:结束deepseek-r1测试程序

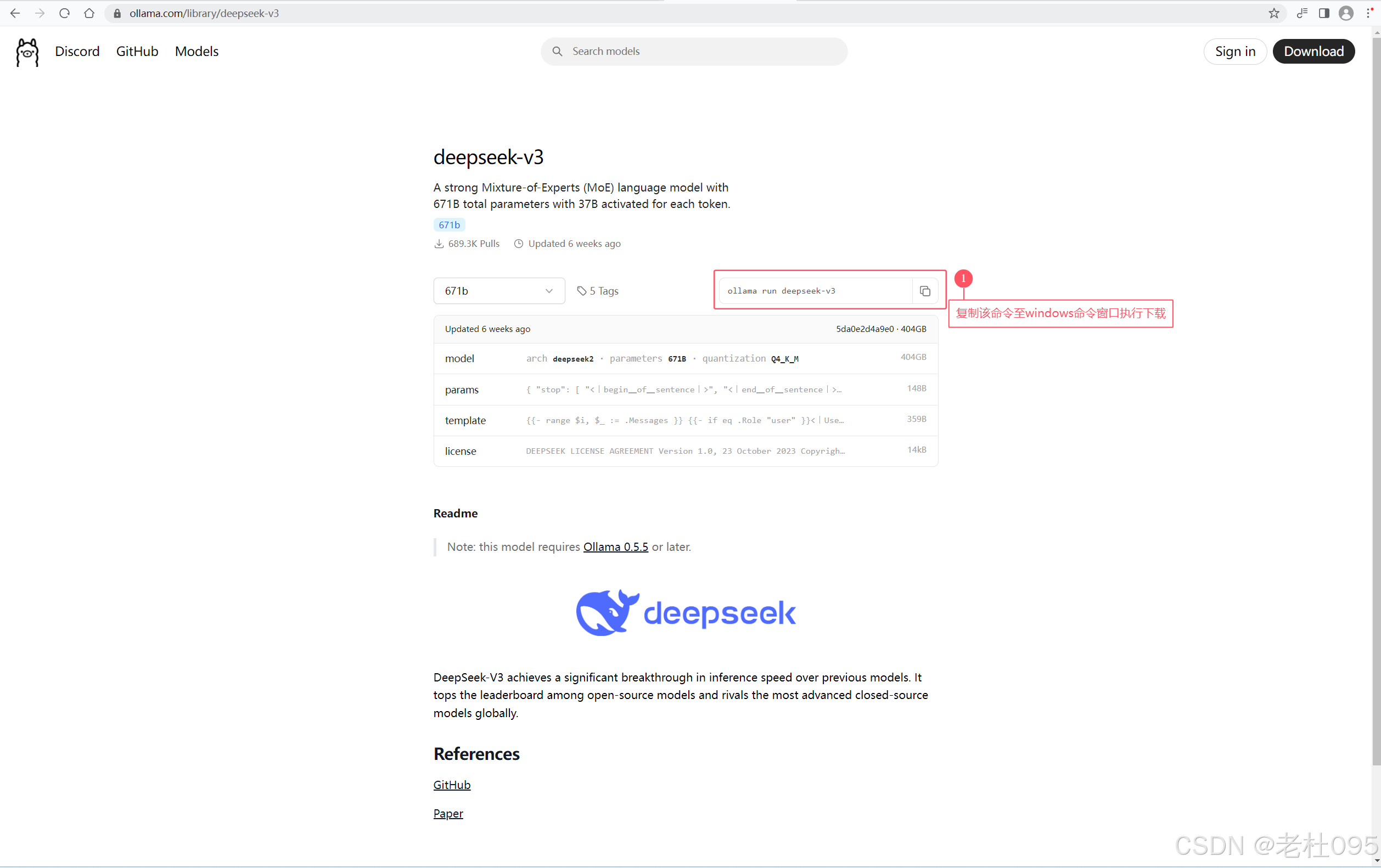

2)、下载deepseek-V3模型

在Ollama官方网站->Models页面进入【deepseek-v3】

大小:400GB,由于太大,就不在本地下载了,感兴趣的可以自行按下面的操作进行下载安装

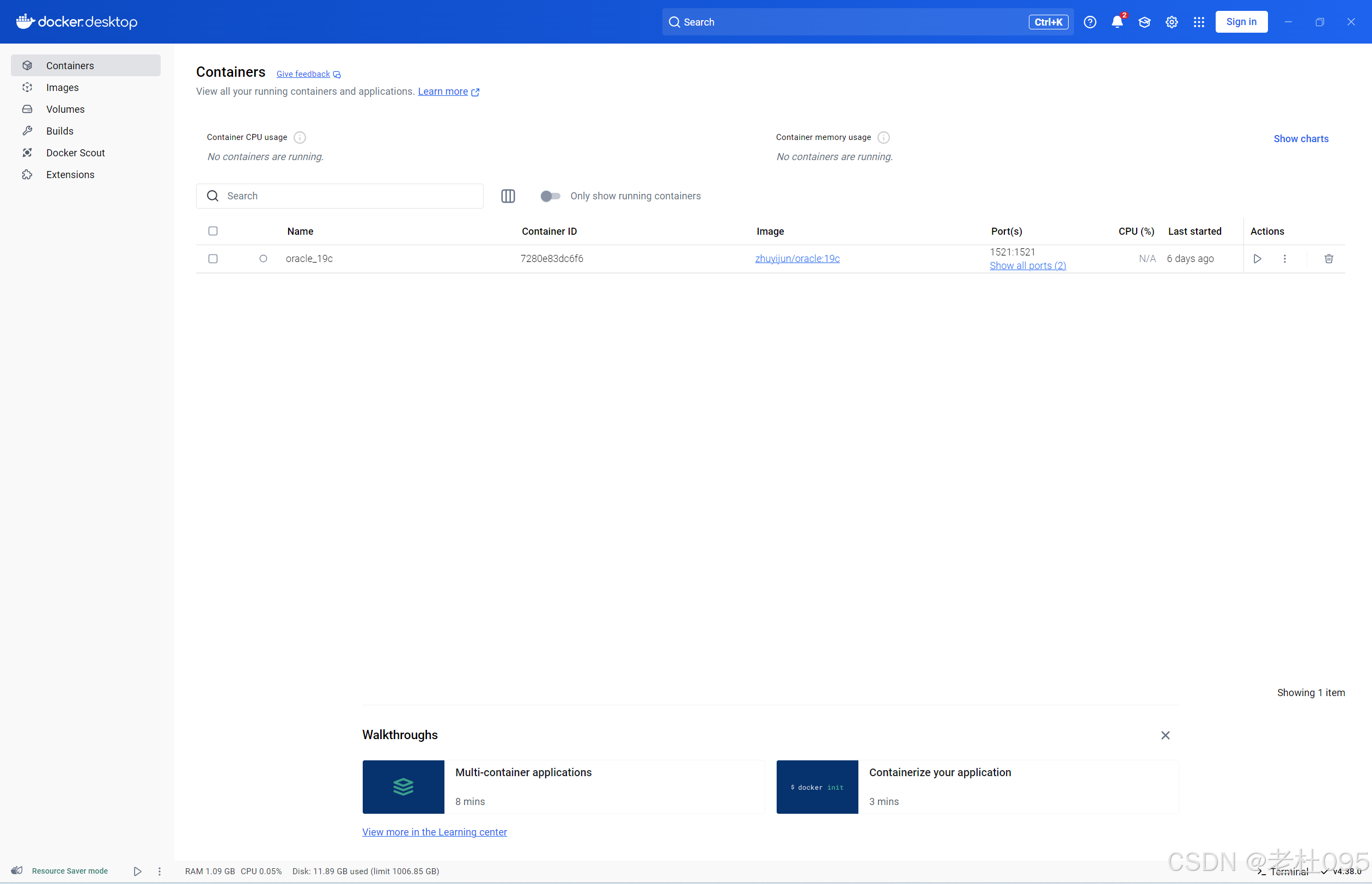

3、安装Docker Desktop

Docker Desktop是Windows环境下运行管理Docker镜像、容器的桌面可视化管理工具。

- **说明:**如果已经安装了Docker Desktop的小伙伴们可以跳过此步,只需要启动Docker Desktop软件即可

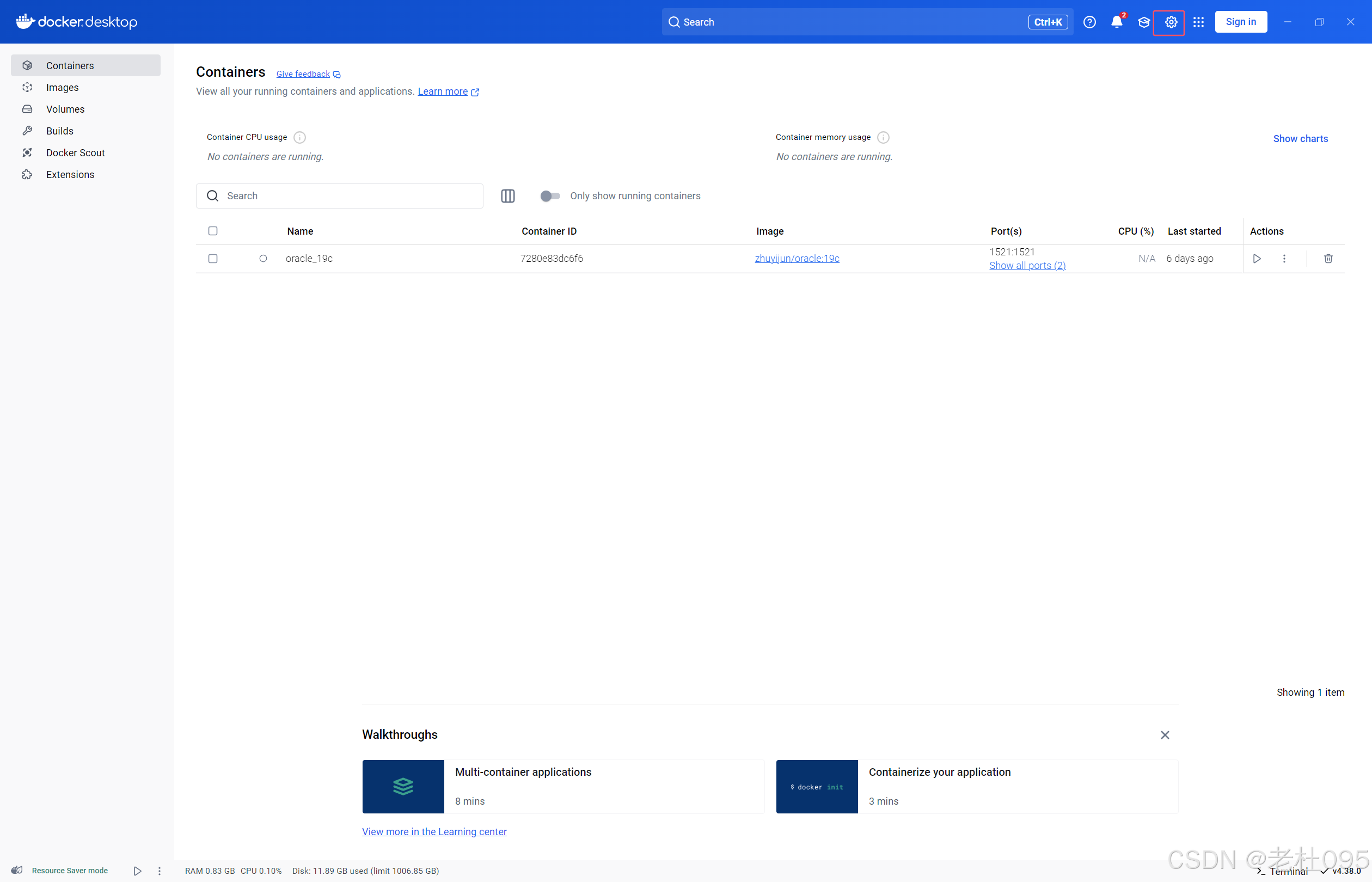

Docker Desktop启动后的窗口

1)、下载安装Docker Desktop

进入官网:https://www.docker.com/products/docker-desktop/

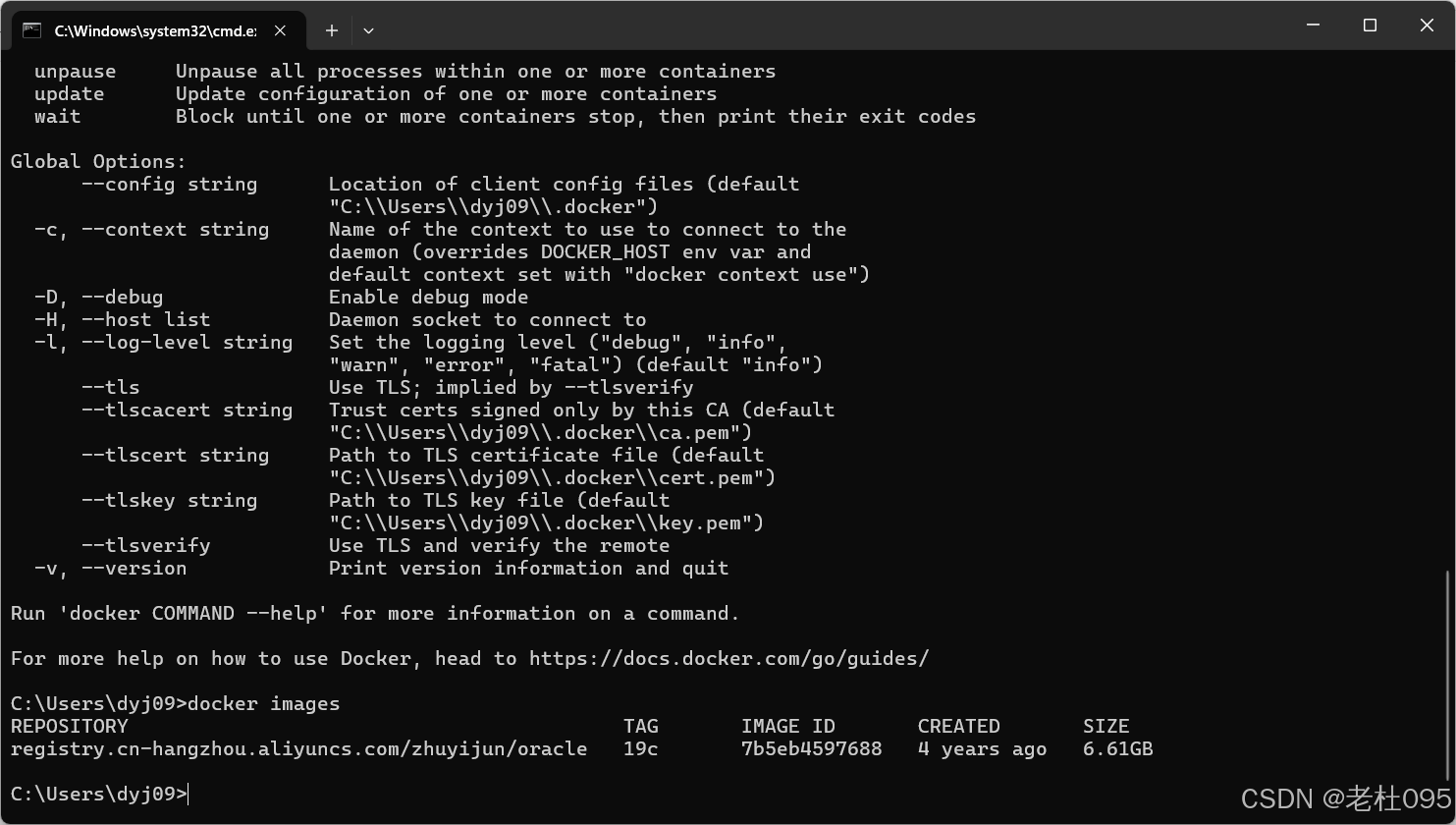

下载完成后双击安装,安装完成后打开命令行执行docker images显示本地已下载的docker镜像如果执行成功则说明已安装成功

- 不需要执行登录,启动后跳过登录即可

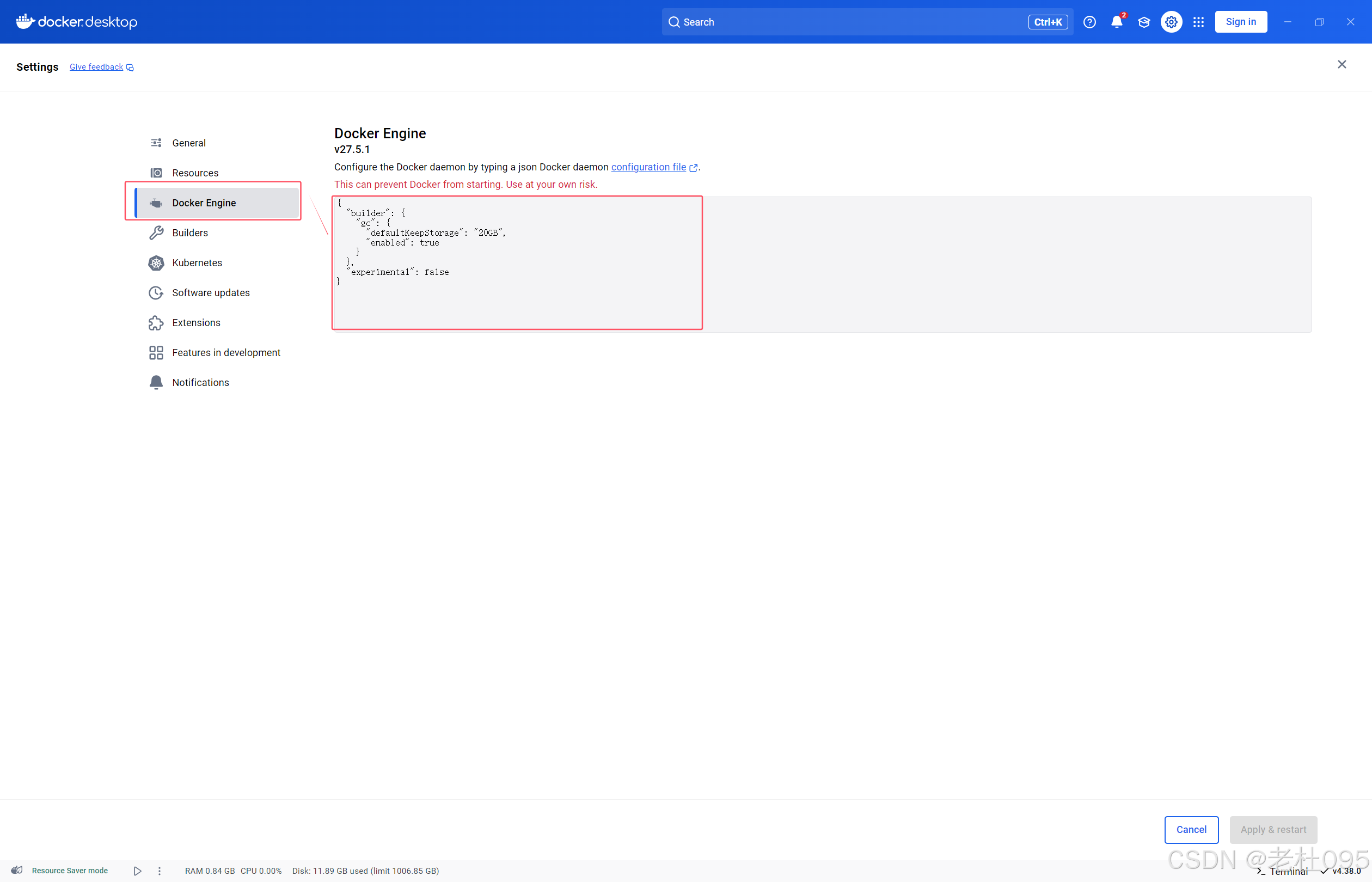

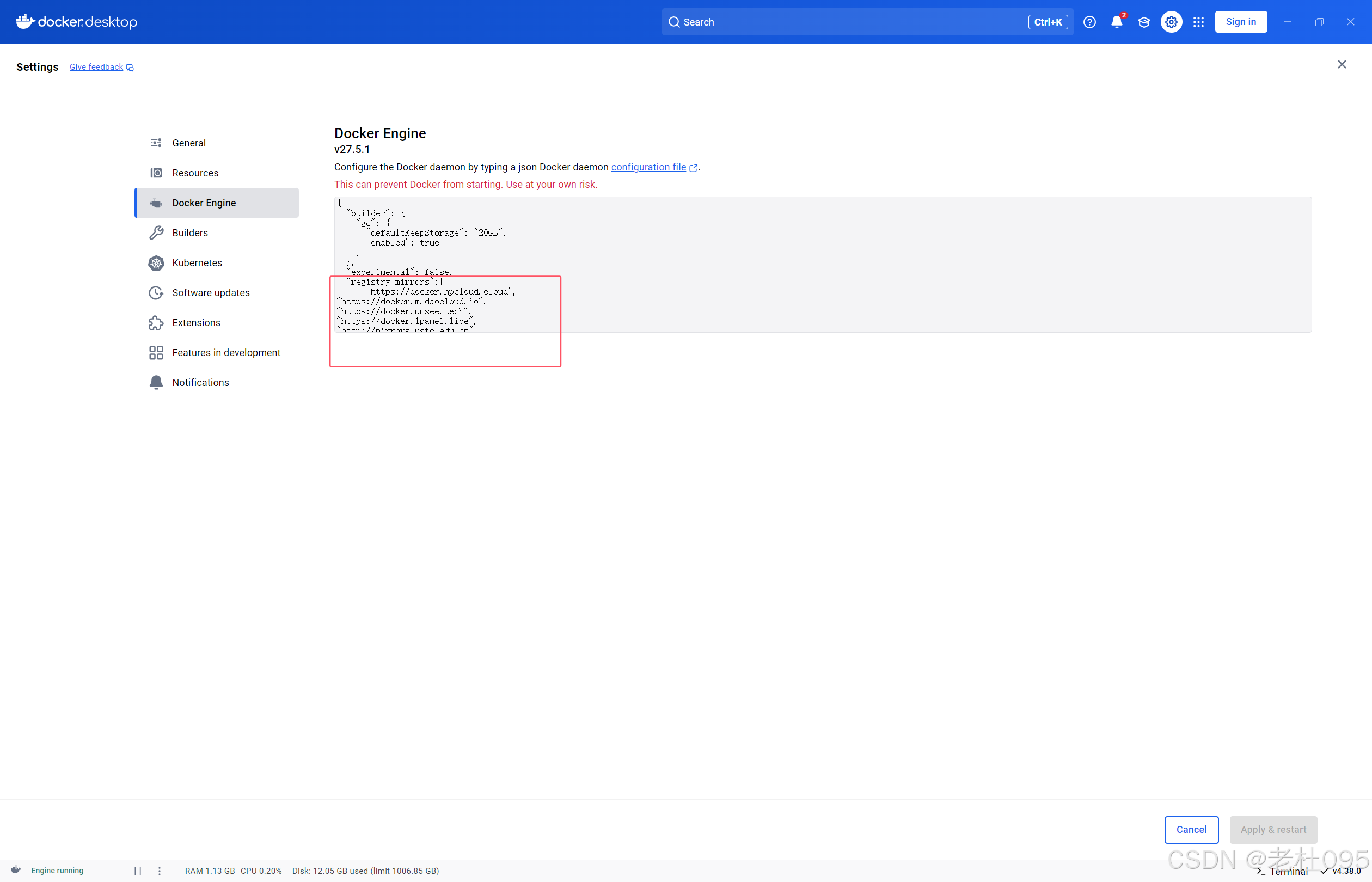

2)、配置docker国内镜像仓库

(1)、点击【设置】按钮,进入Docker Desktop设置界面

(2)、将下面配置加上Docker Engine配置json中

将下面配置添加至Docker Engine配置

"registry-mirrors":[

"https://docker.hpcloud.cloud",

"https://docker.m.daocloud.io",

"https://docker.unsee.tech",

"https://docker.1panel.live",

"http://mirrors.ustc.edu.cn",

"https://docker.chenby.cn",

"http://mirror.azure.cn",

"https://dockerpu11.org",

"https://dockerhub.icu",

"https://hub.rat.dev",

"https://proxy.1panel.live",

"https://docker.1panel.top",

"https://docker.m.daocloud.io",

"https://docker.1ms.run",

"https://docker.ketches.cn"

]

完整的配置信息为:

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors":[

"https://docker.hpcloud.cloud",

"https://docker.m.daocloud.io",

"https://docker.unsee.tech",

"https://docker.1panel.live",

"http://mirrors.ustc.edu.cn",

"https://docker.chenby.cn",

"http://mirror.azure.cn",

"https://dockerpu11.org",

"https://dockerhub.icu",

"https://hub.rat.dev",

"https://proxy.1panel.live",

"https://docker.1panel.top",

"https://docker.m.daocloud.io",

"https://docker.1ms.run",

"https://docker.ketches.cn"

]

}

4、安装RAGFlow

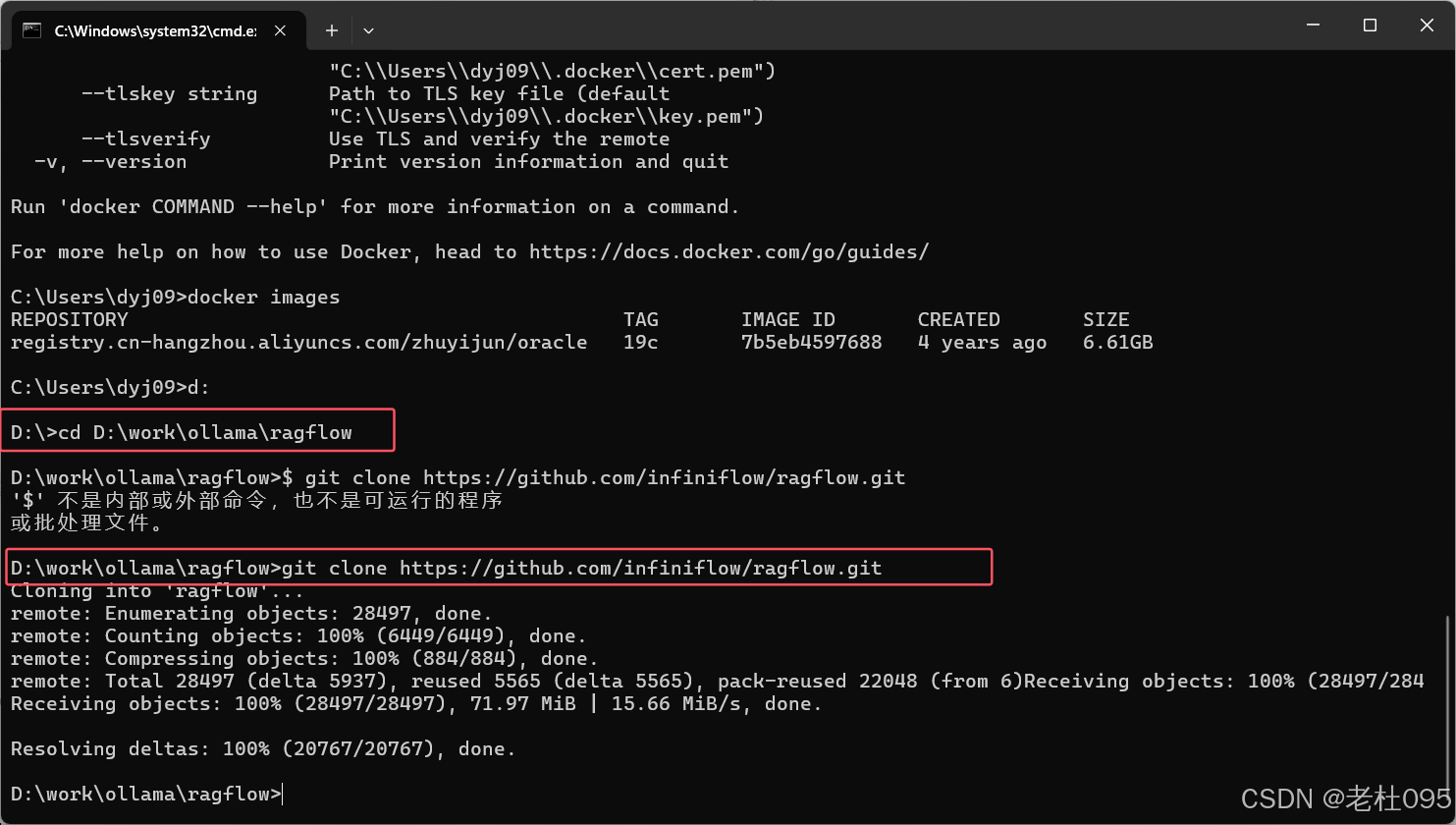

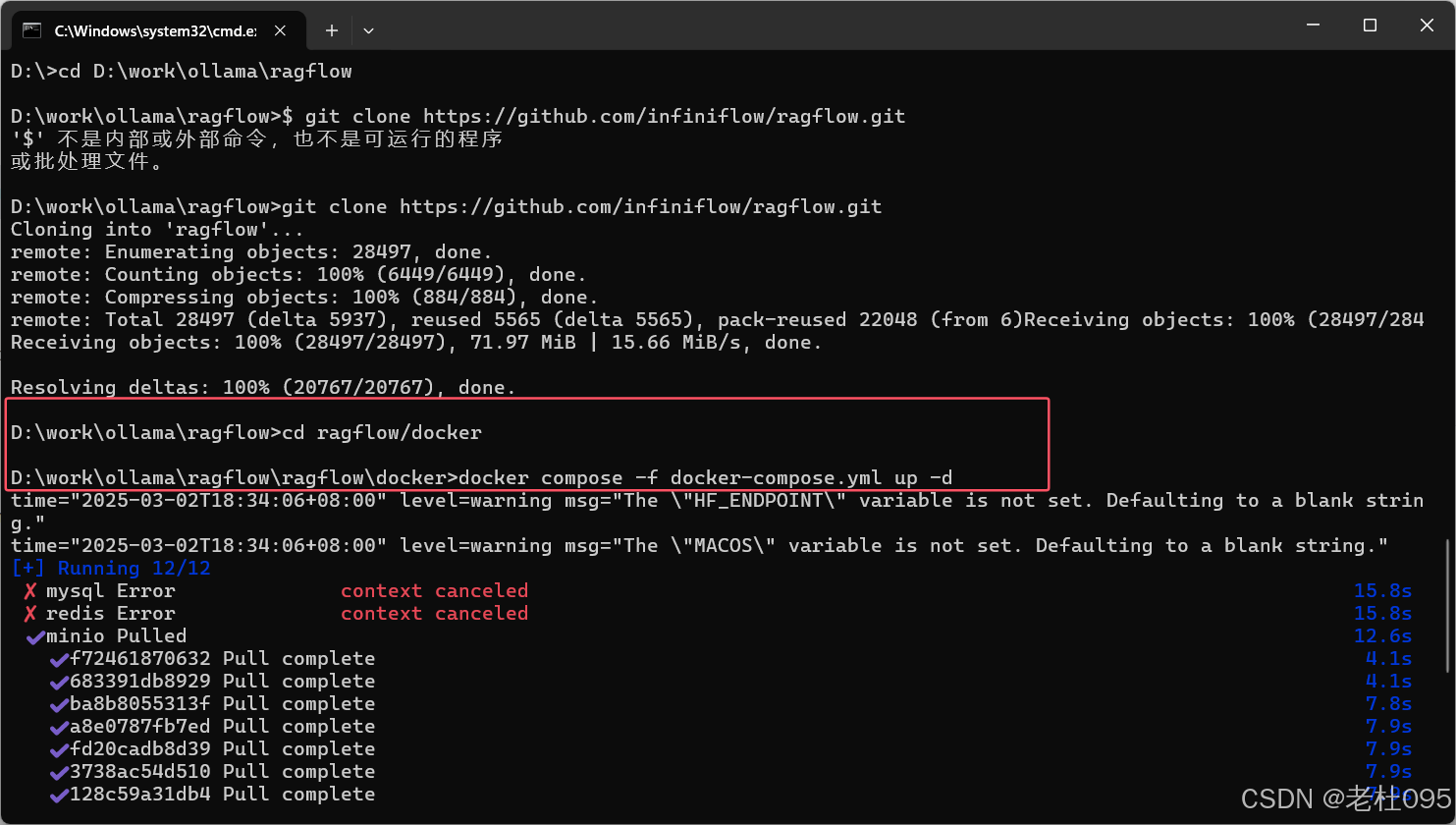

1)、下载ragflow源码

找一个存入ragflow源码的目录,本文我是存放在D:\work\ollama\ragflow

执行命令:

git clone https://github.com/infiniflow/ragflow.git

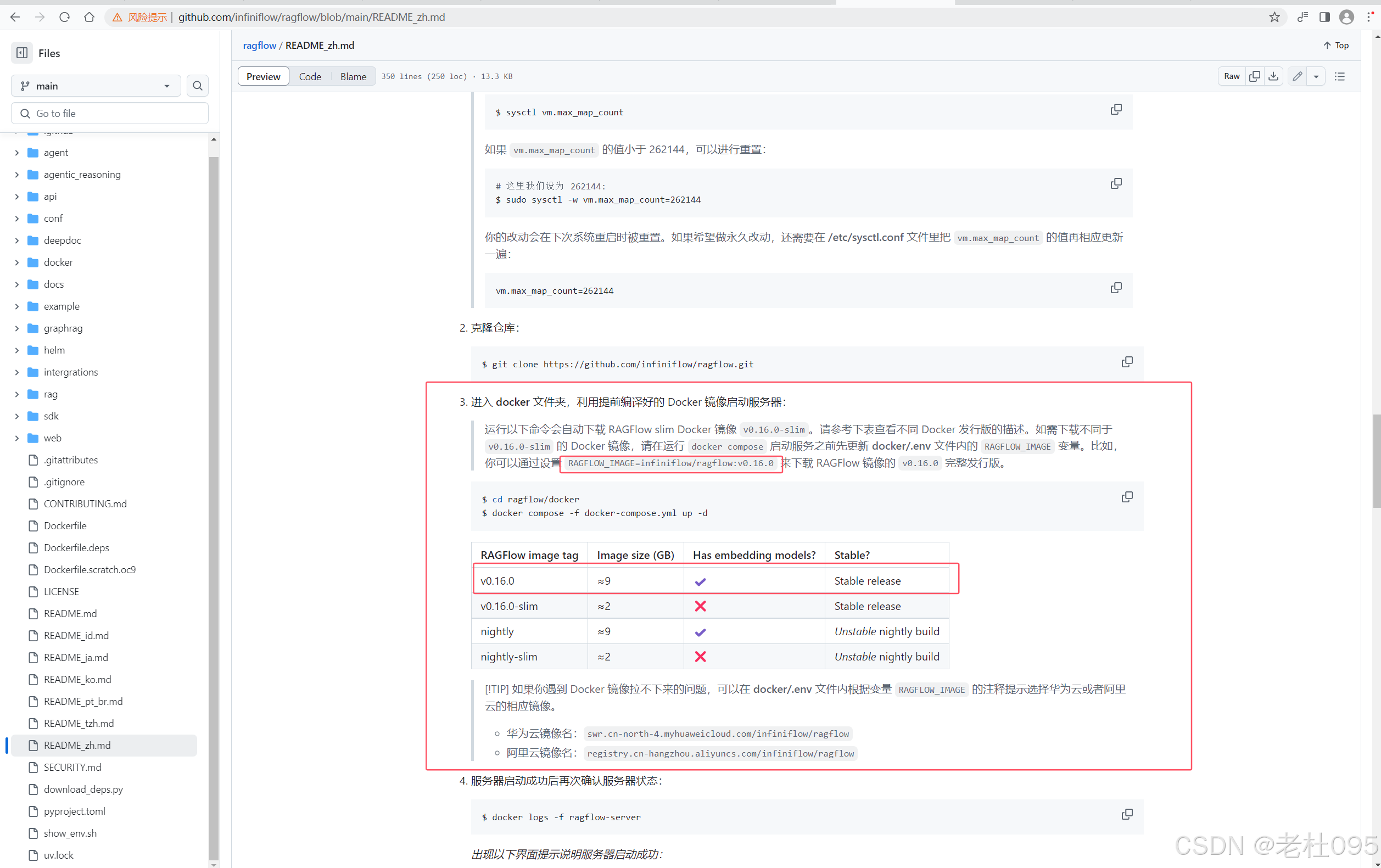

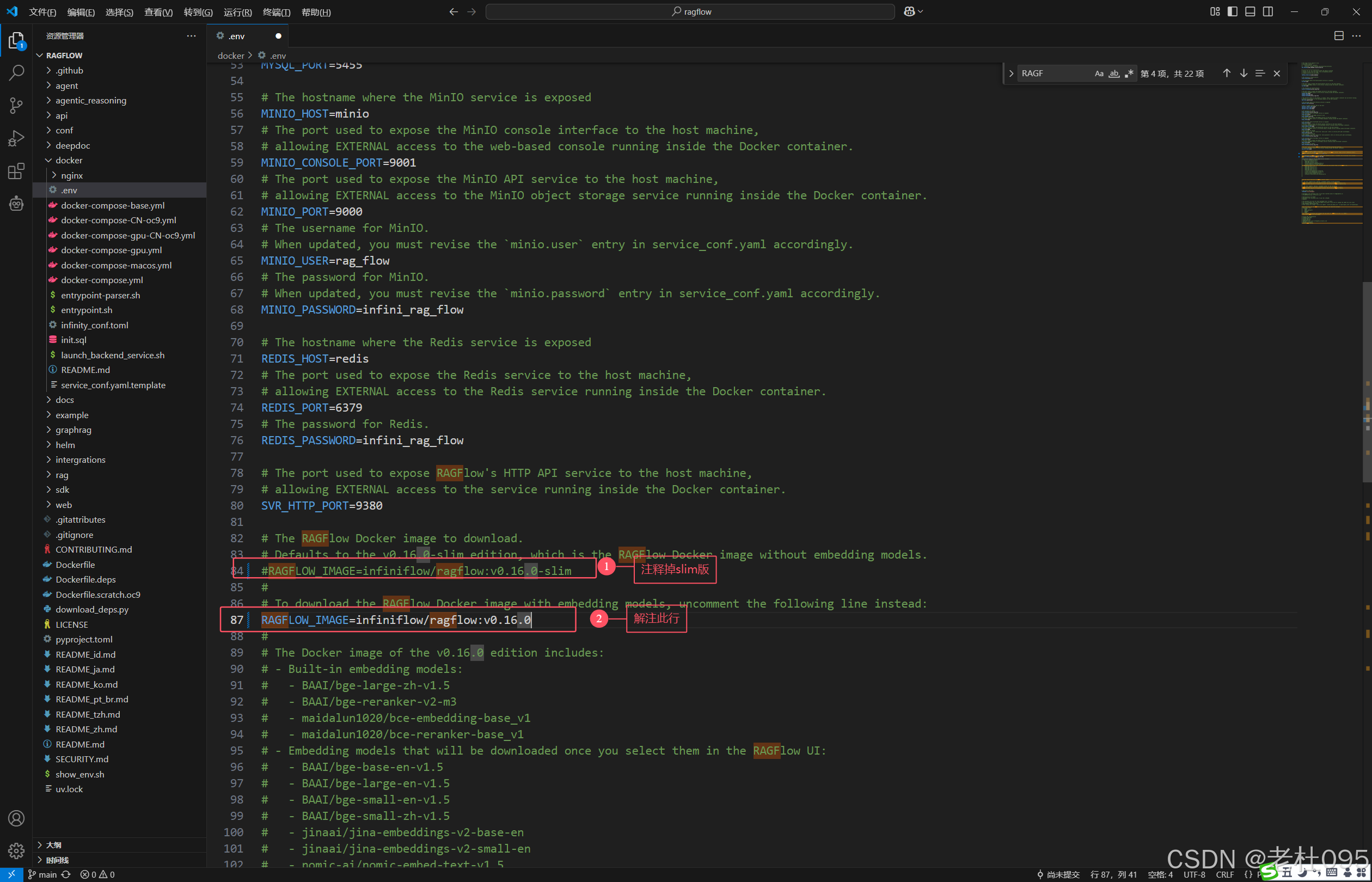

2)、修改参数

根据官方文档说明,默认是v0.16.0-slim版,该版本没有embedding模型,所以我们需要改为v0.16.0

- 进入环境配置文件:ragflow\docker.env配置文件

- 修改参数RAGFLOW_IMAGE=infiniflow/ragflow:v0.16.0

3)、启动RAGFlow容器

执行下面命令进行启动RAGFlow容器

- 注意:

- 1、首次执行命令时会先从镜像源拉取Docker镜像;

- 2、如果失败,则尝试修改Docker Engine中的镜像源地址进行多次尝试,修改方法参见第二章->3、安装Docker Desktop -> 2)、配置docker国内镜像仓库

> cd ragflow/docker

> docker compose -f docker-compose.yml up -d

(1)、第一次启动时会自动拉取线上镜像,如下图所示:

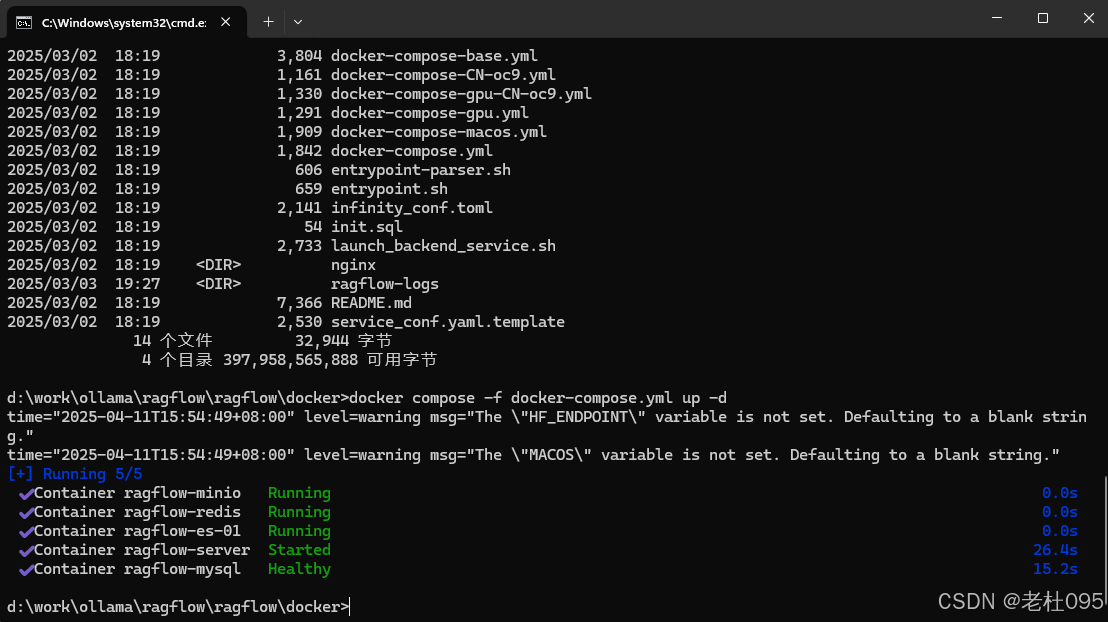

(2)、如果已拉取成功,执行上述命令会启动所有镜像,如所图所示:各镜像的状态是Running 或 Healthy 或 Started

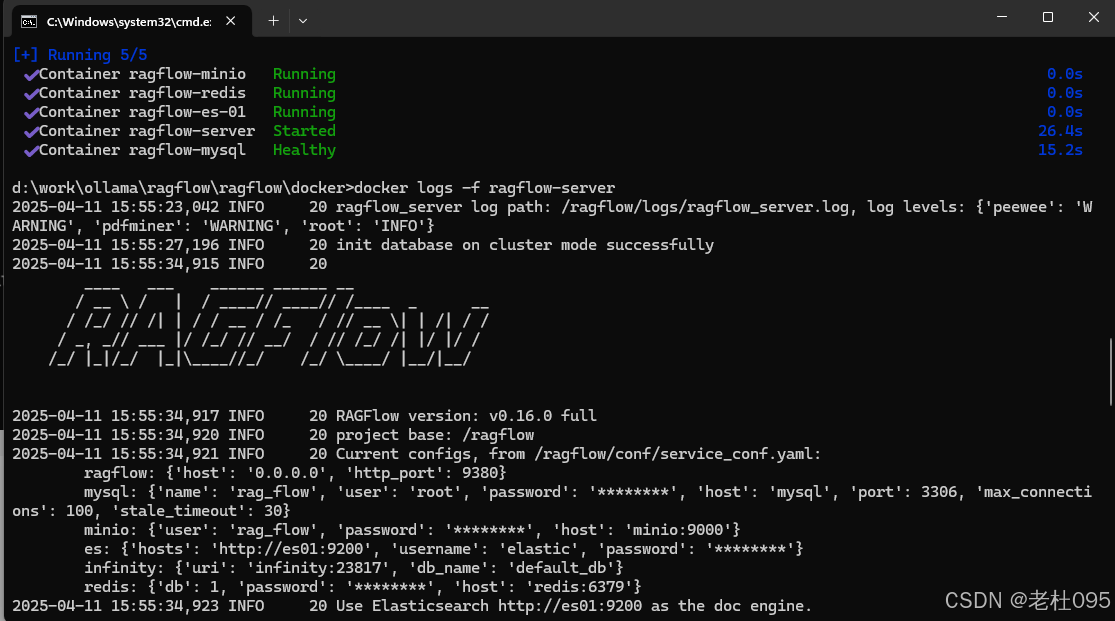

(3)、验证RagFlow服务

d:\work\ollama\ragflow\ragflow\docker> docker logs -f ragflow-server

出现上图所示的效果,一直滚动输出日志,则说明ragflow服务启动成功

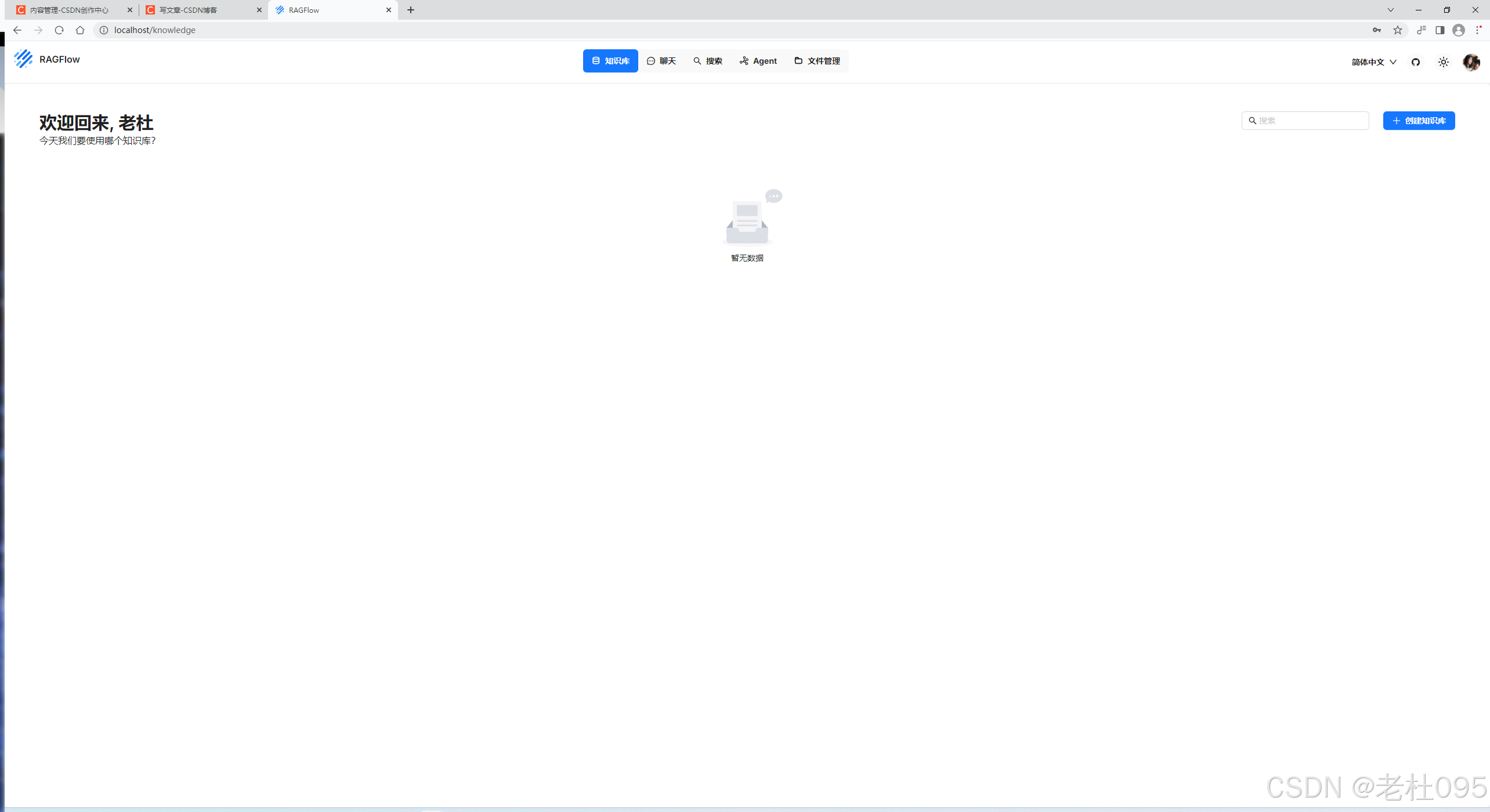

(4)、访问RagFlow服务

在浏览器中输入http://localhost 即可访问RagFlow Web服务

(5)、注册账号/登录

首次登录时,需要先注册账号,在登录画面点击【Sign up】链接进行注册账号,注册成功后即可立即登录

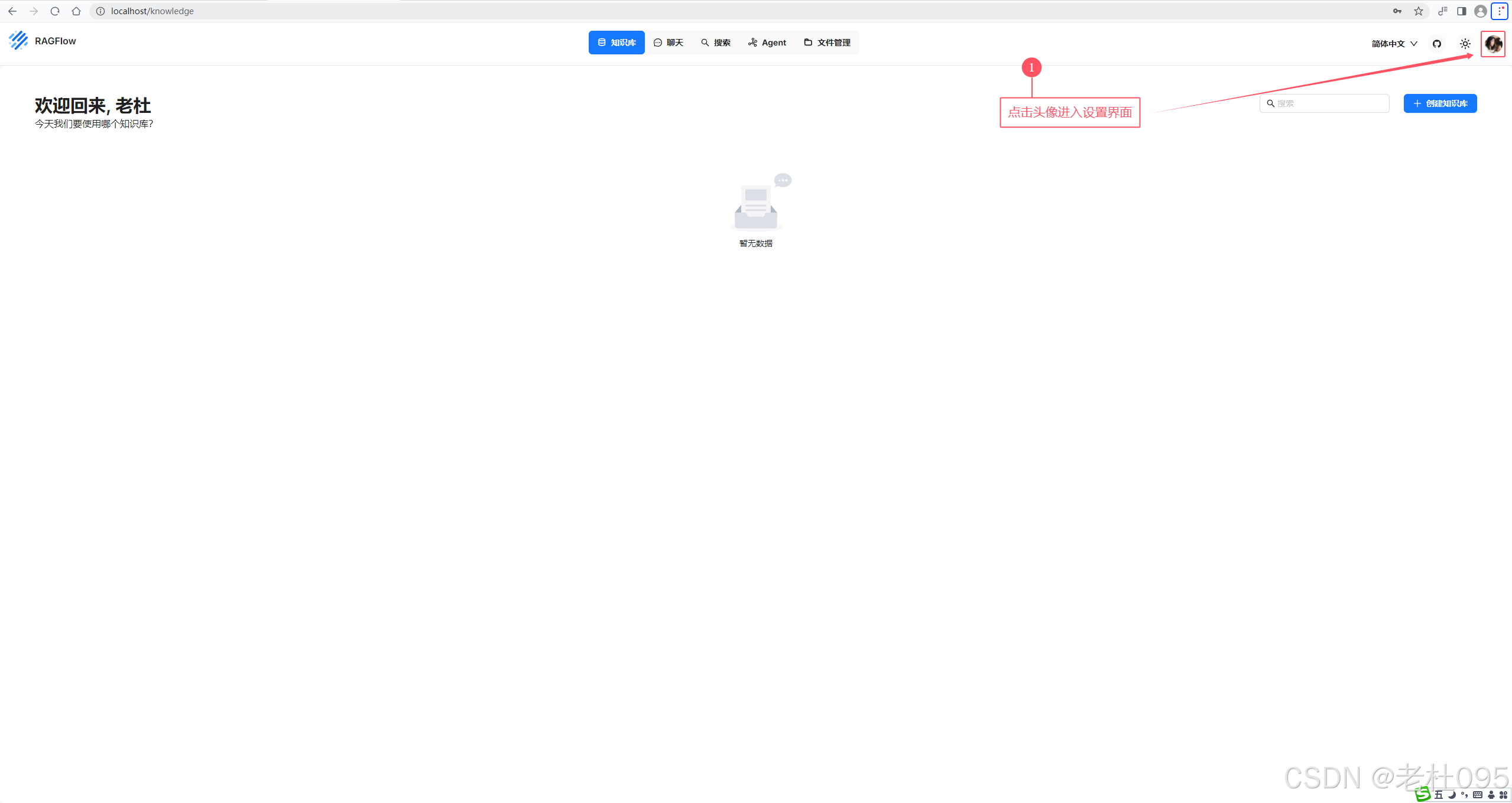

登录成功后如下图所示

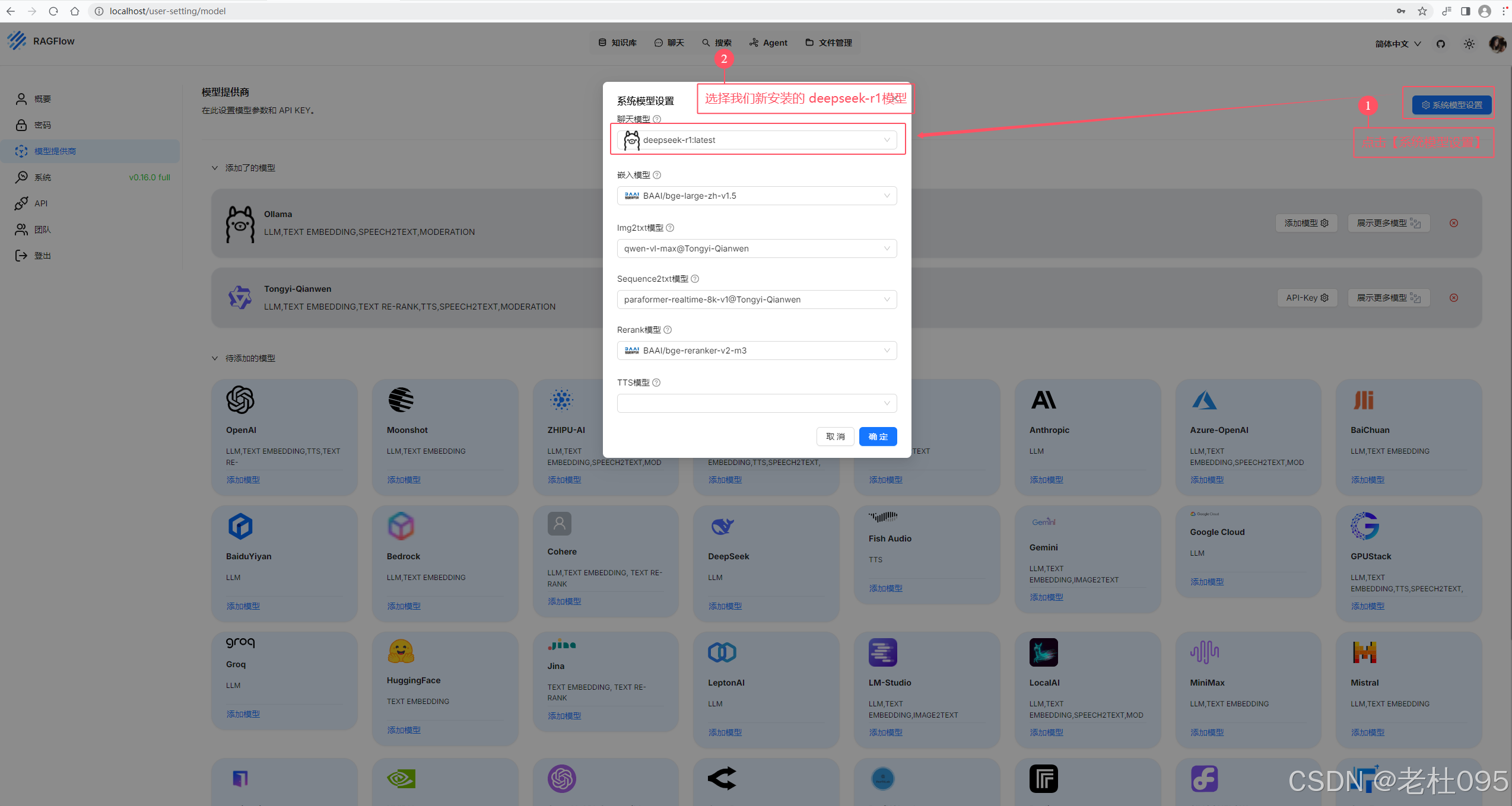

4)、配置RAGFlow模型

(1)、进入设置画面

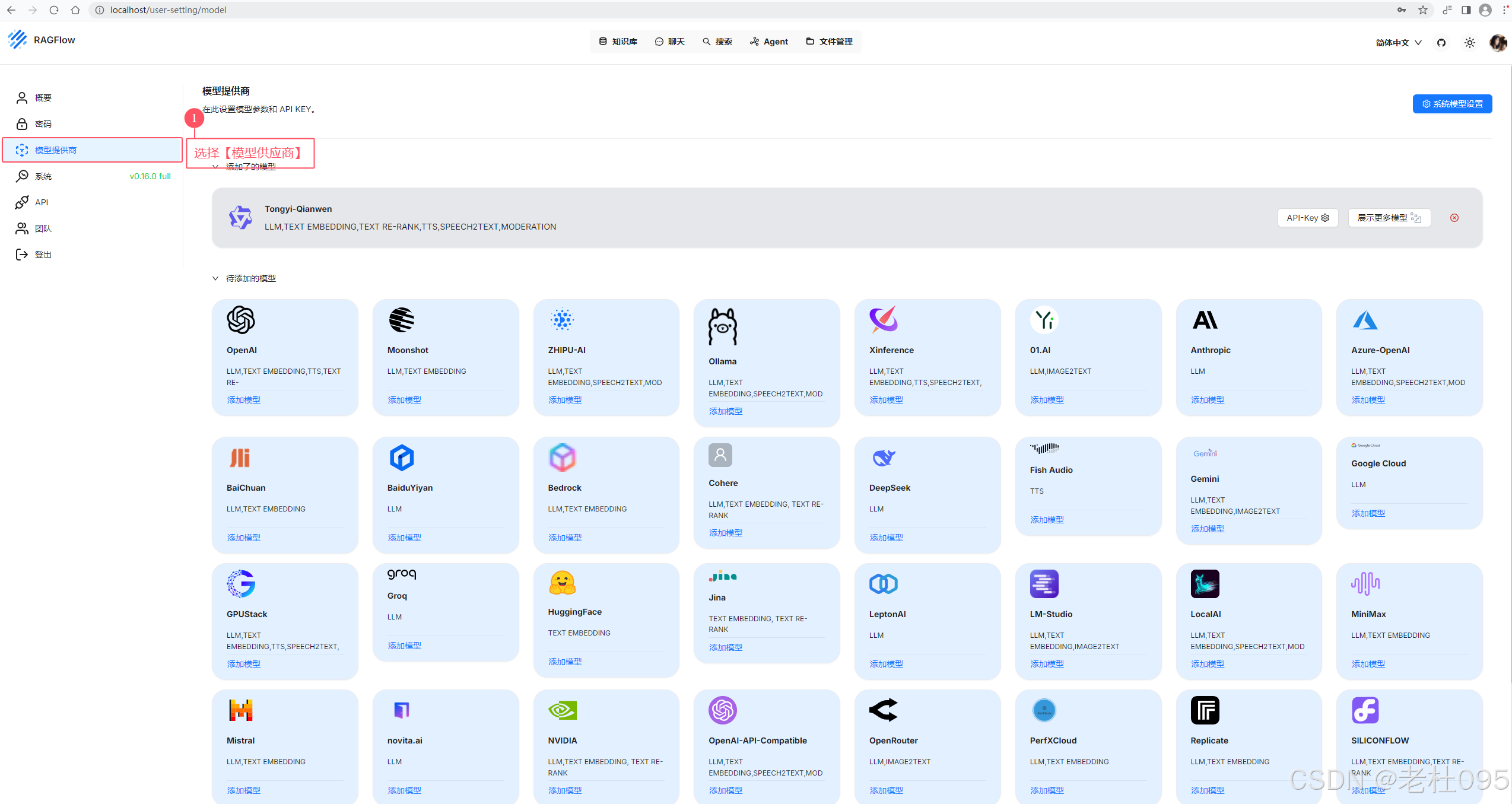

(2)、进入【模型供应商】管理画面

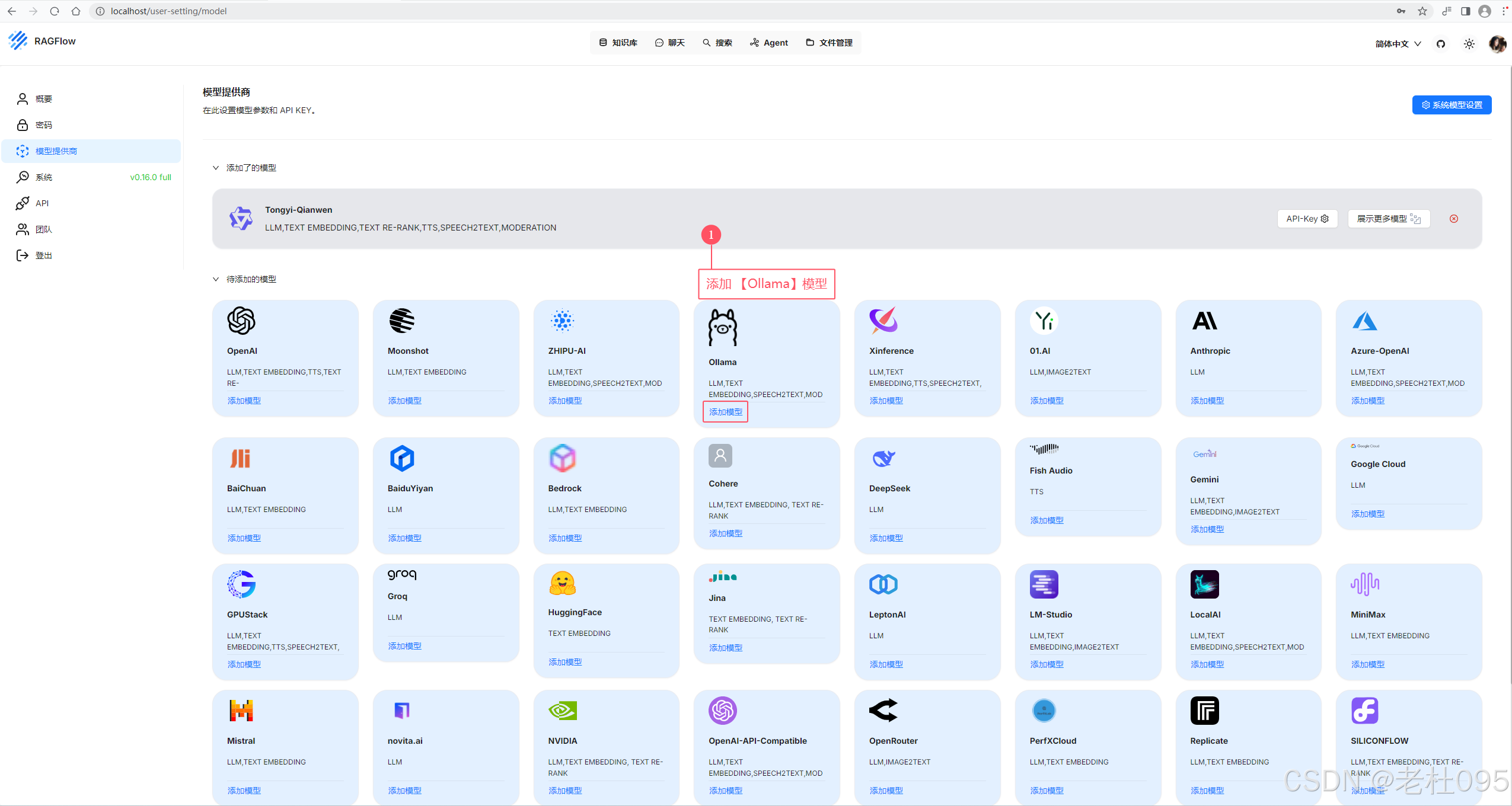

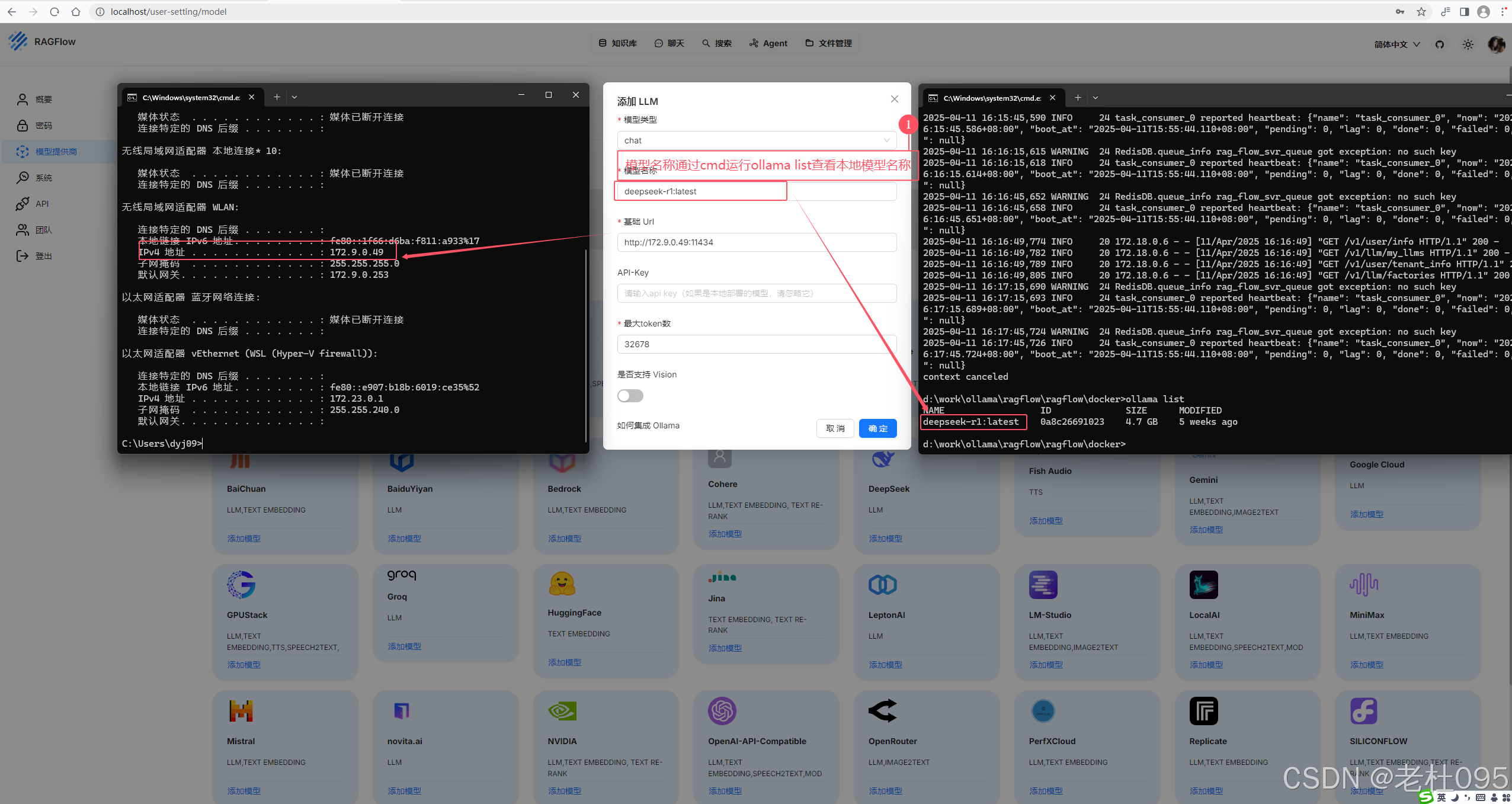

(3)、添加【Ollama】模型

此处模型类型采用【chat】类型,名称与本地的模型名称一致即可,访问地址中的ip采用本地可访问的真实IP

此时模型配置完成!

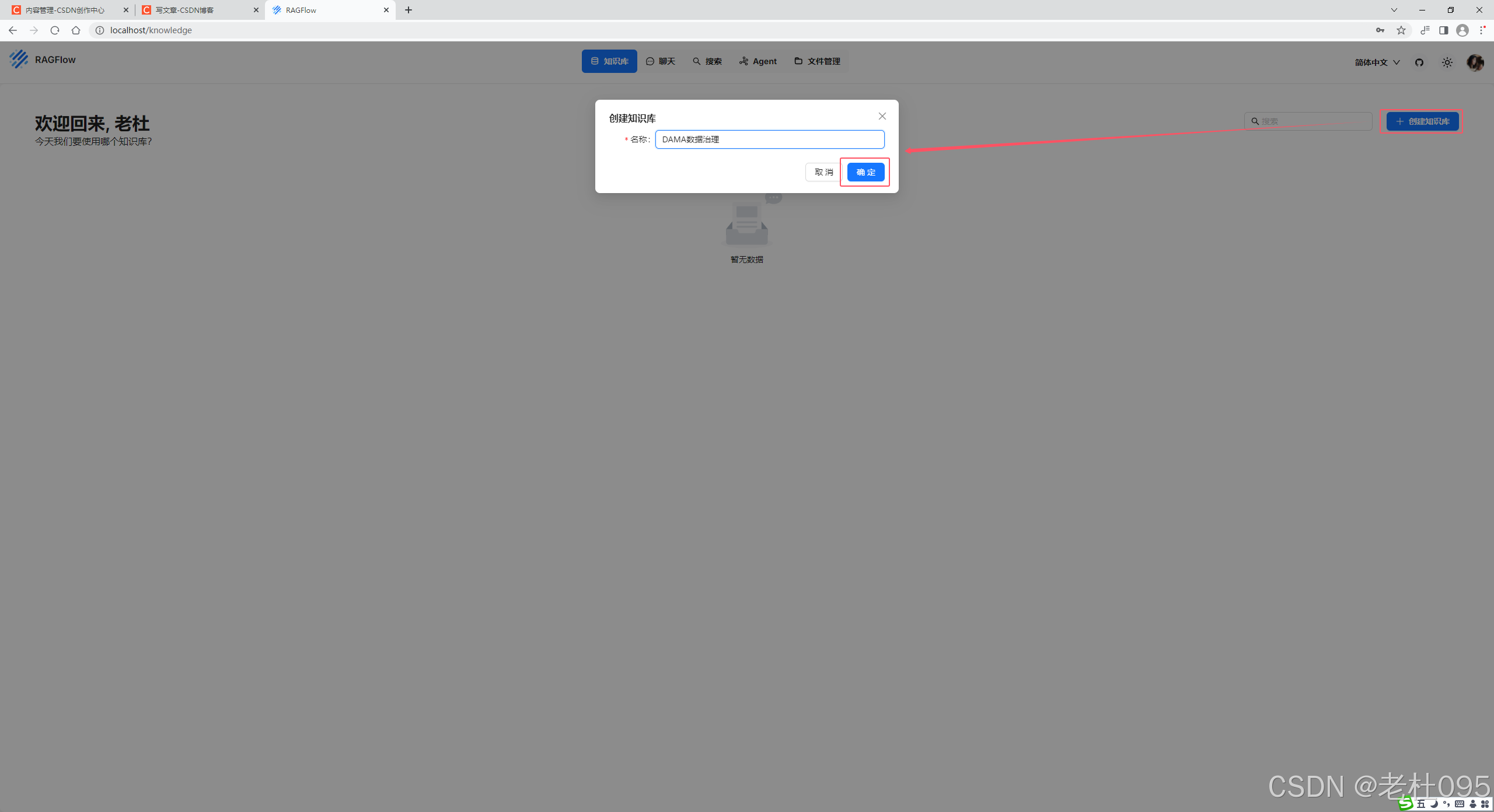

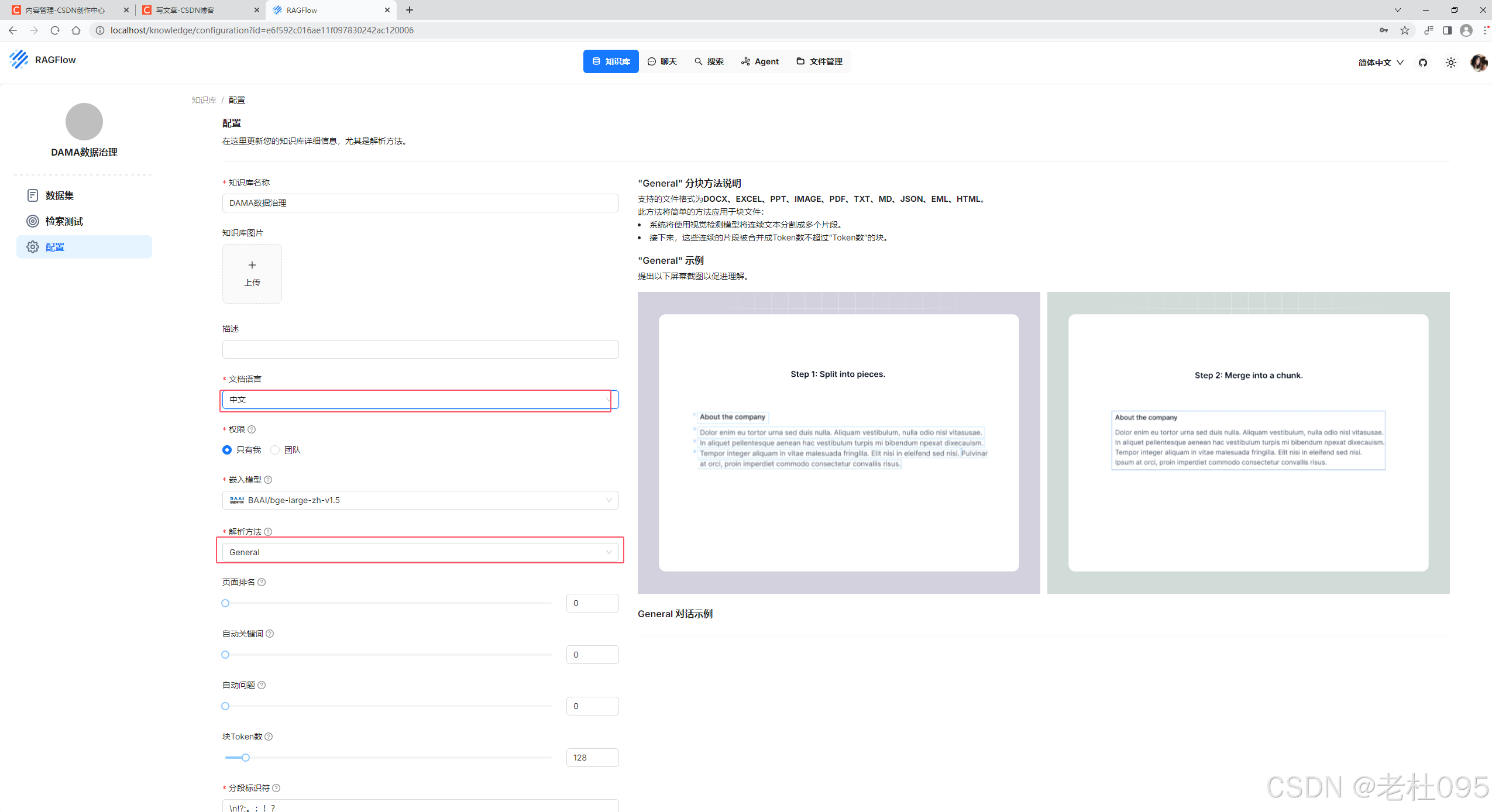

5、构建知识库

1)、创建知识库

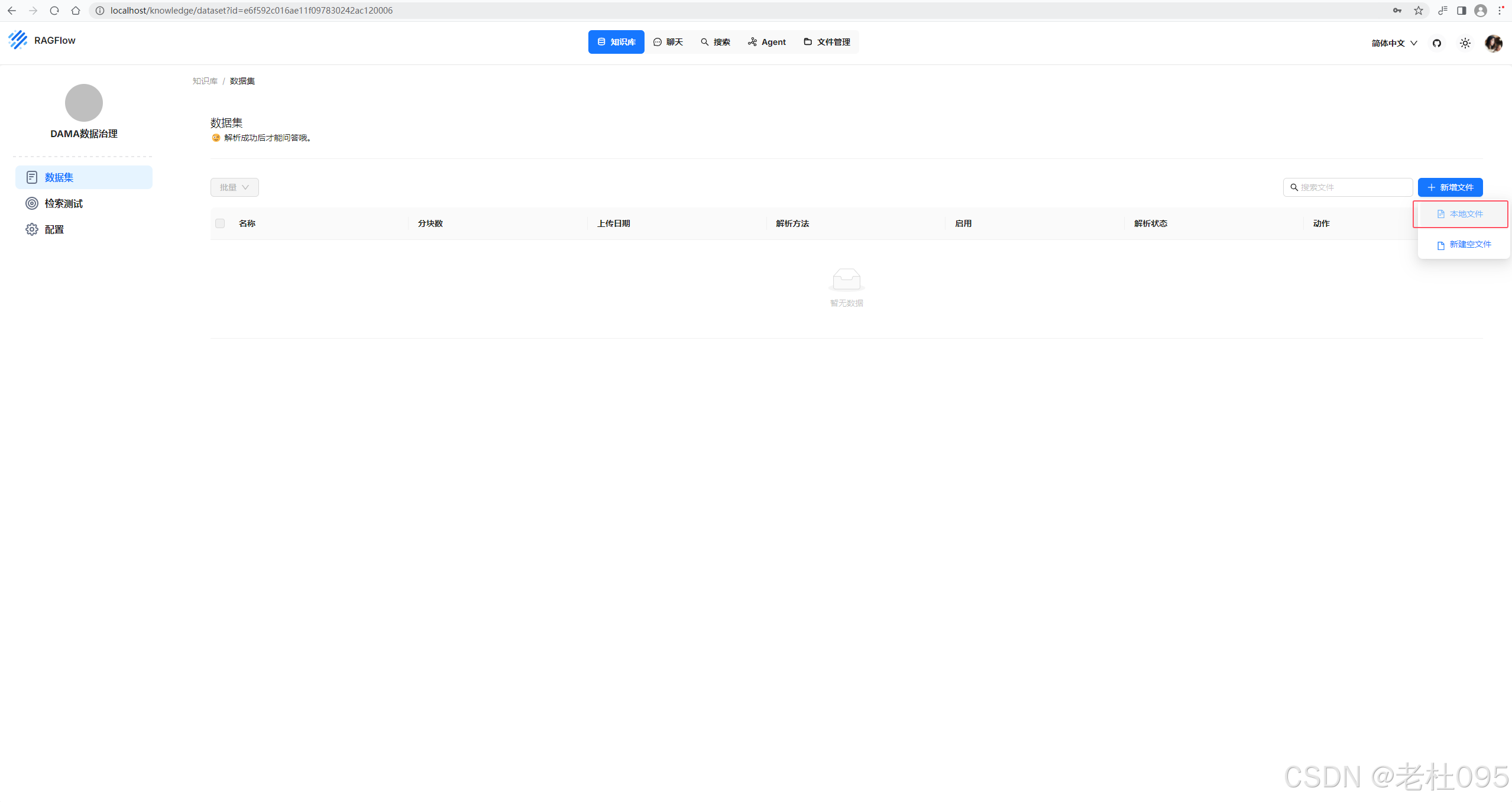

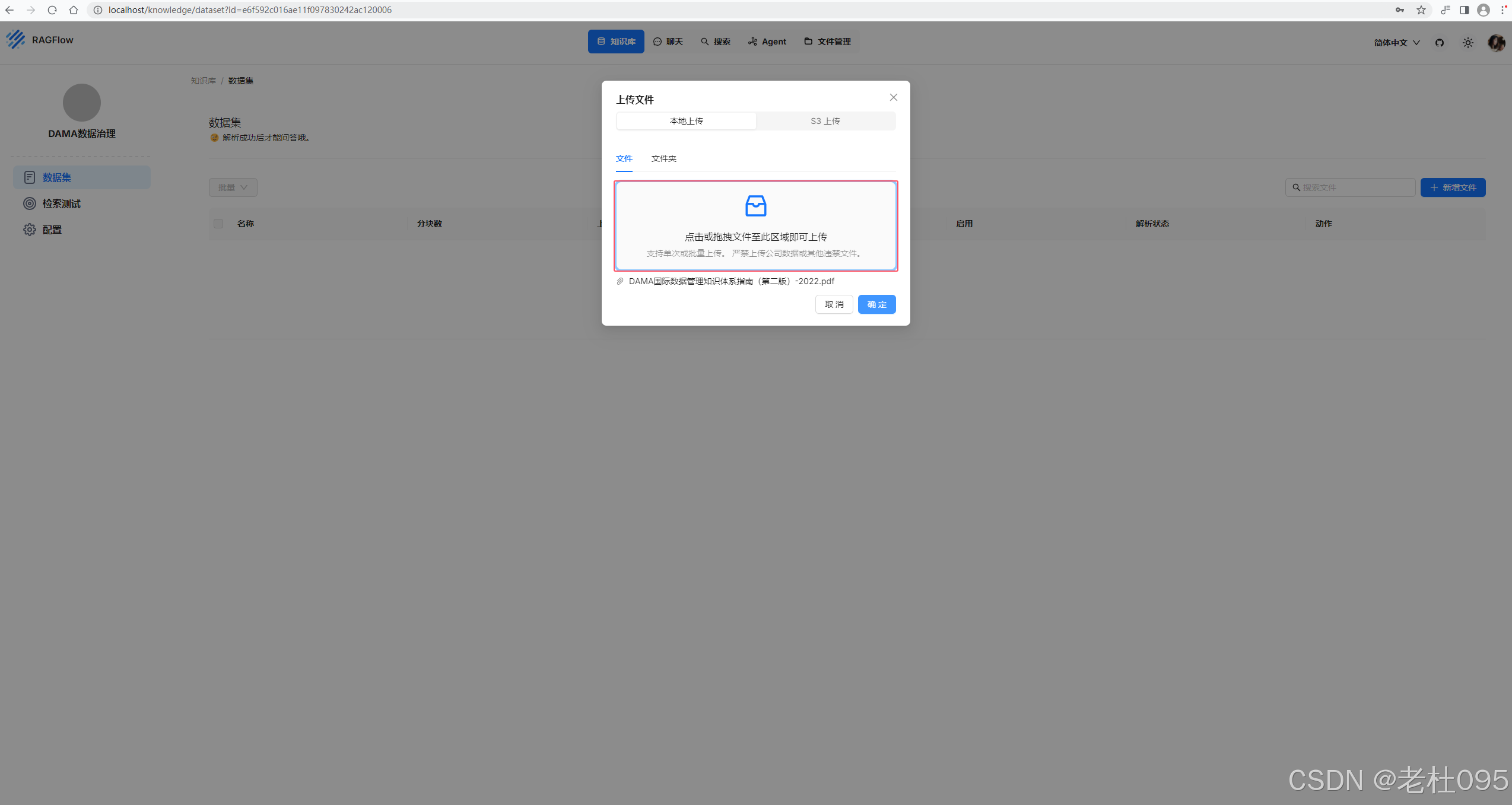

2)、添加文件

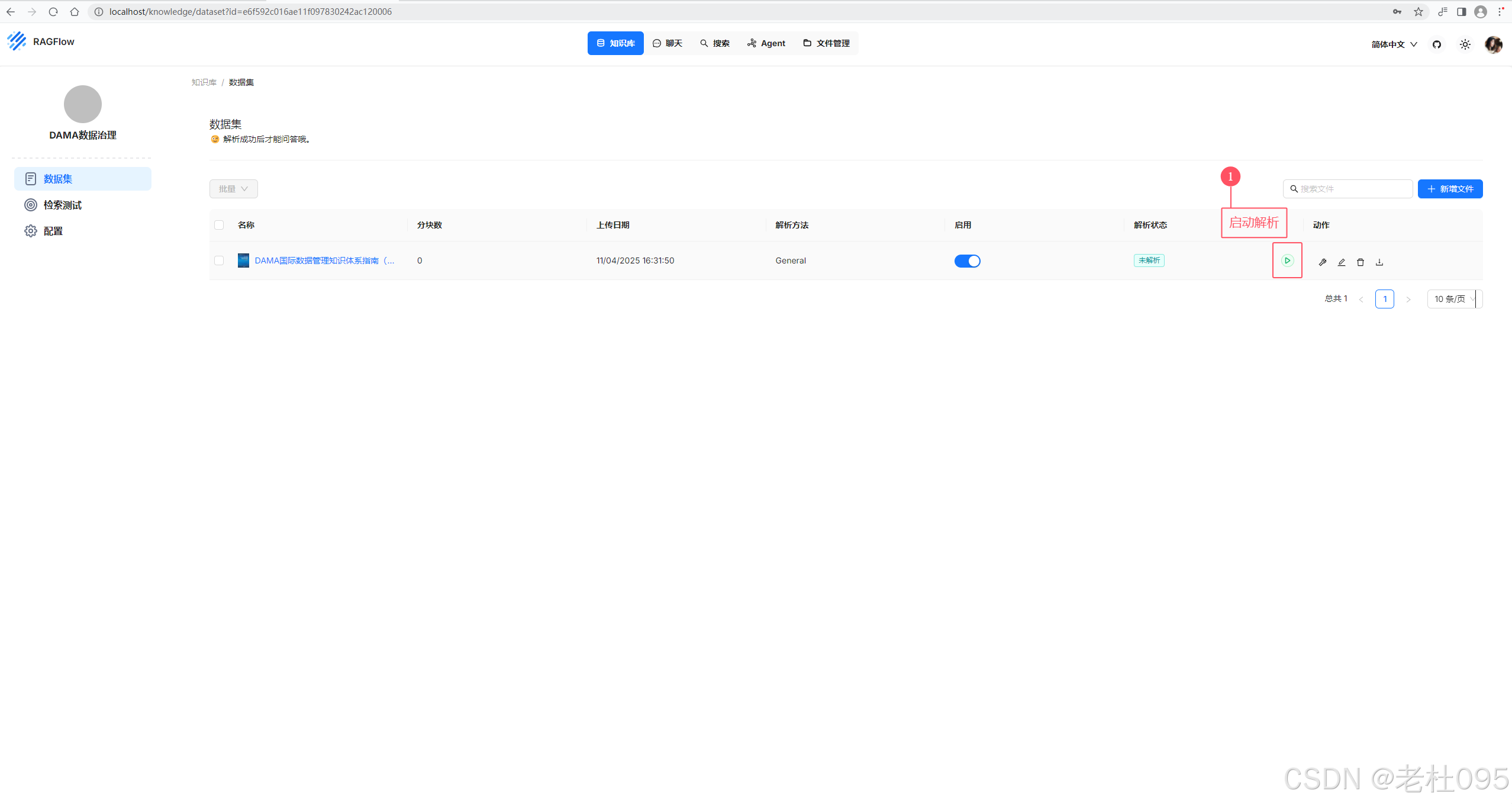

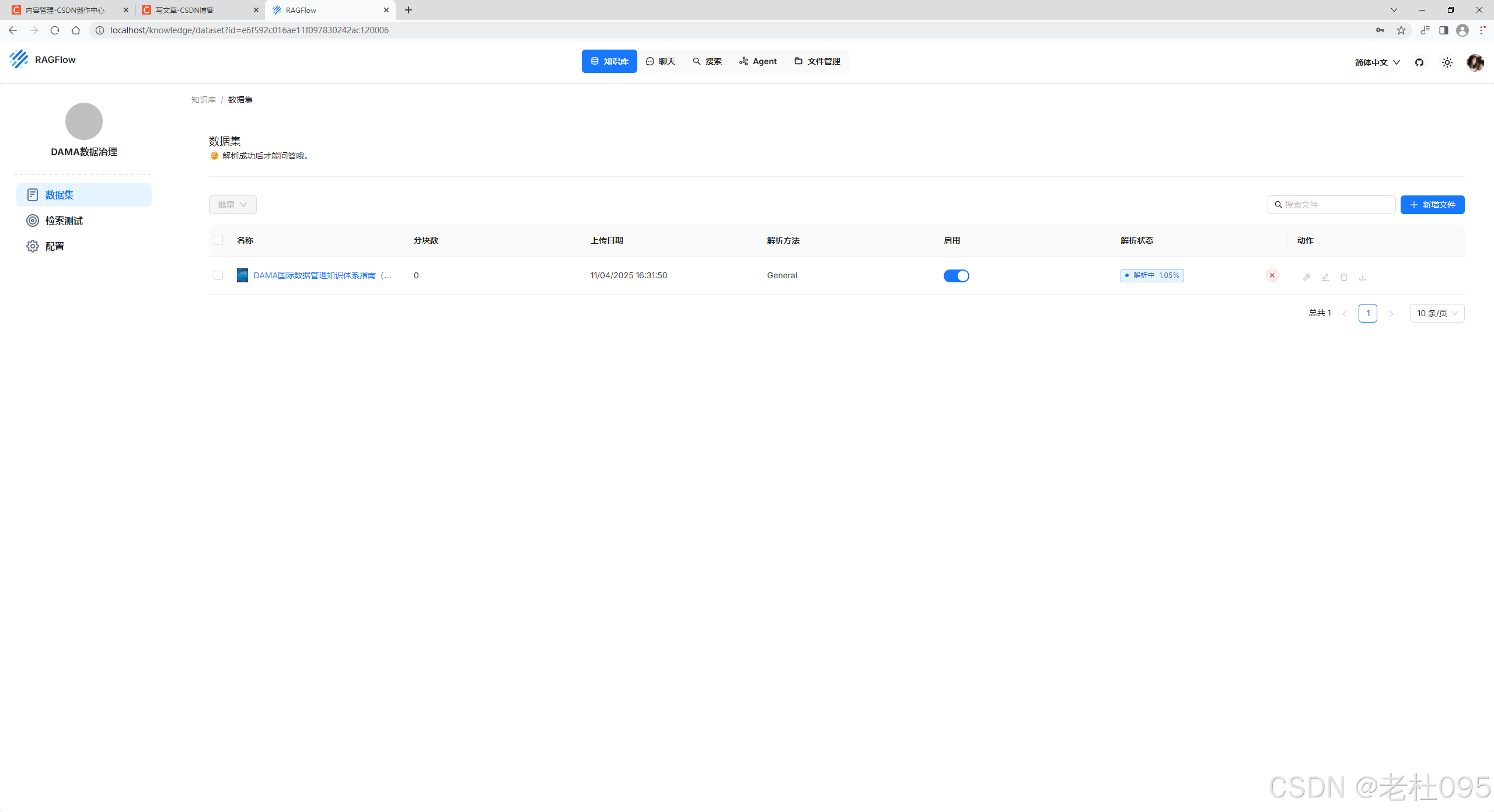

3)、启动解析

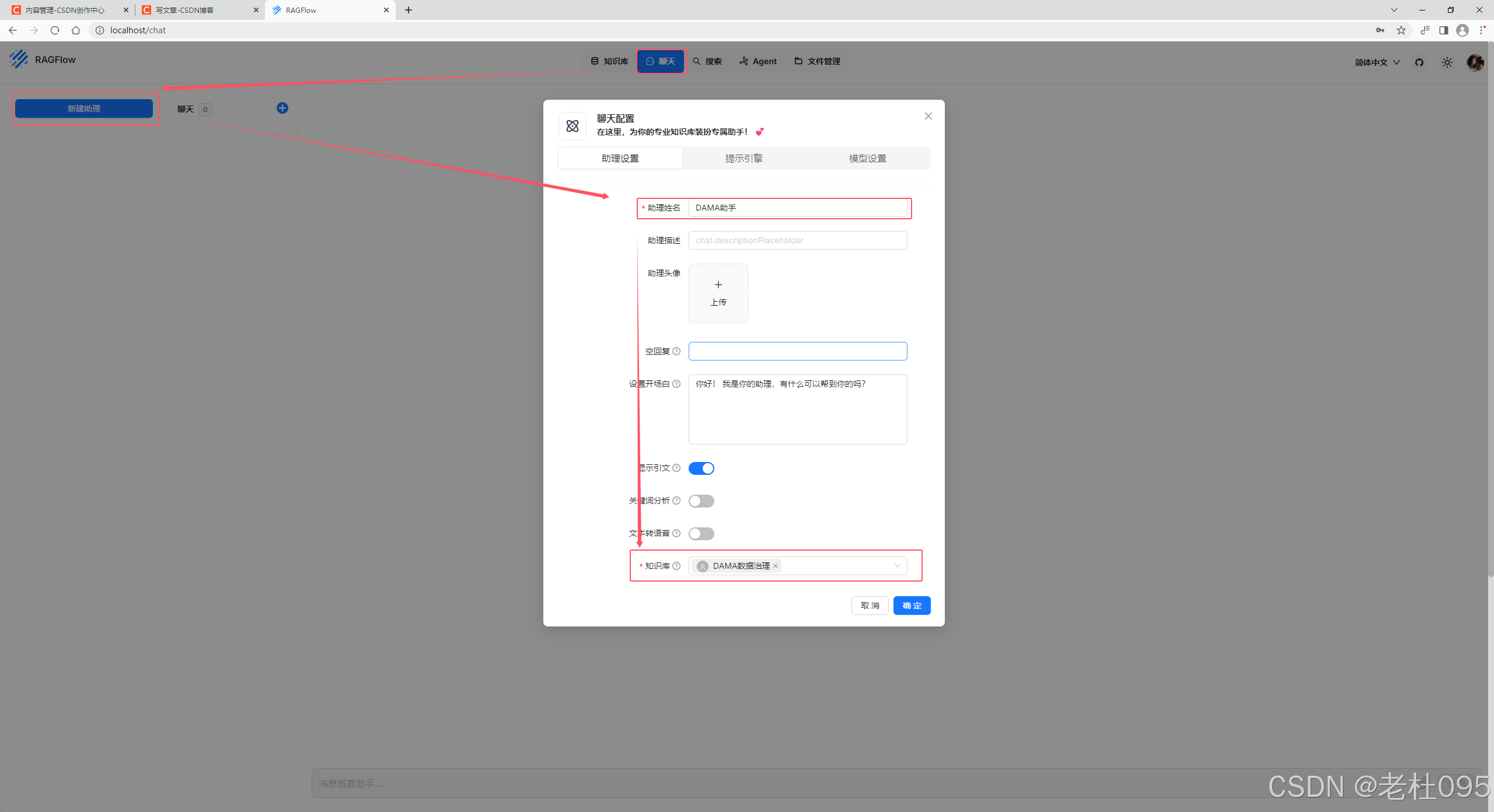

4)、创建聊天助理

只配置名称和 我们自己创建的知识库,其它默认配置即可

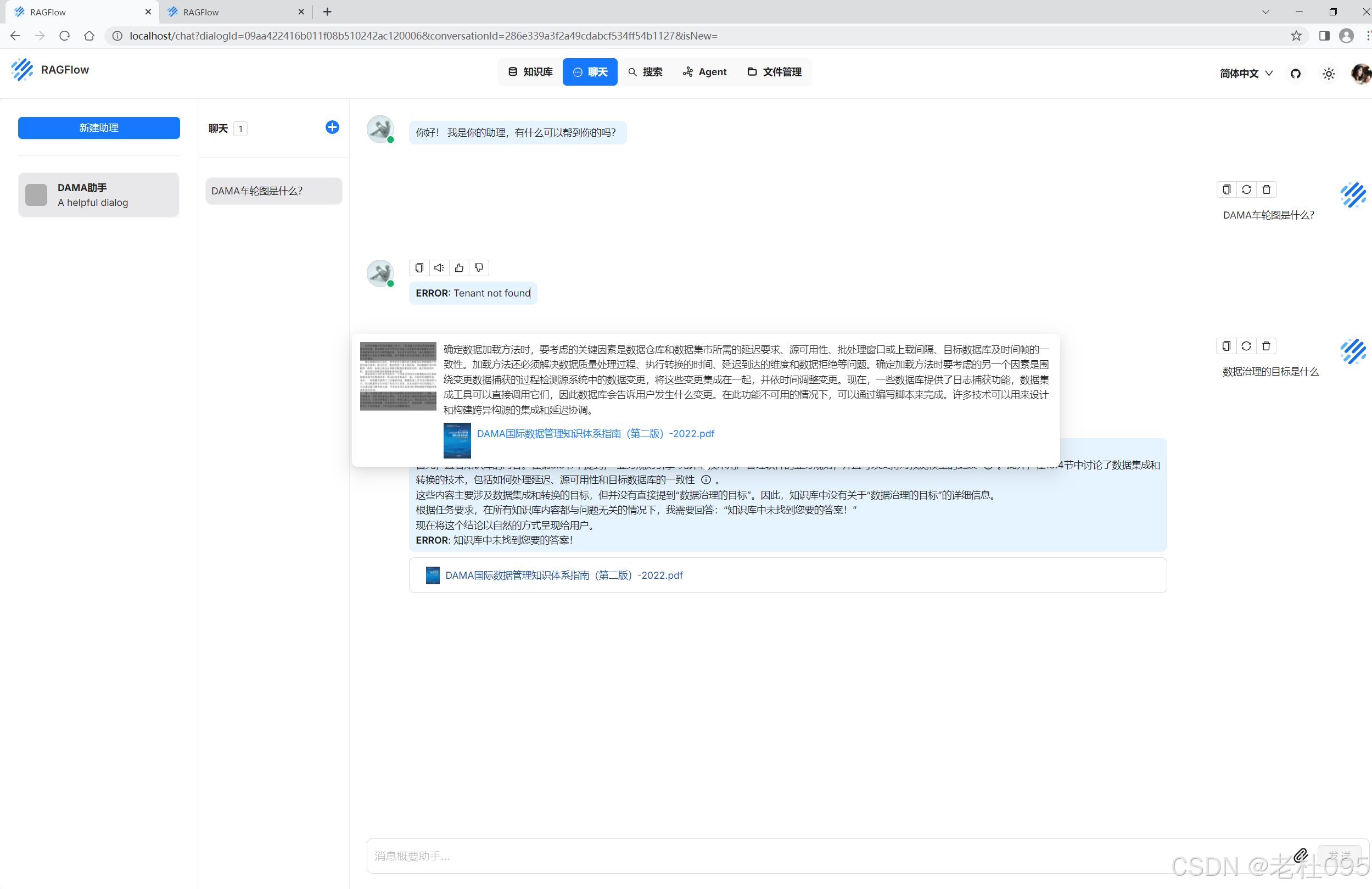

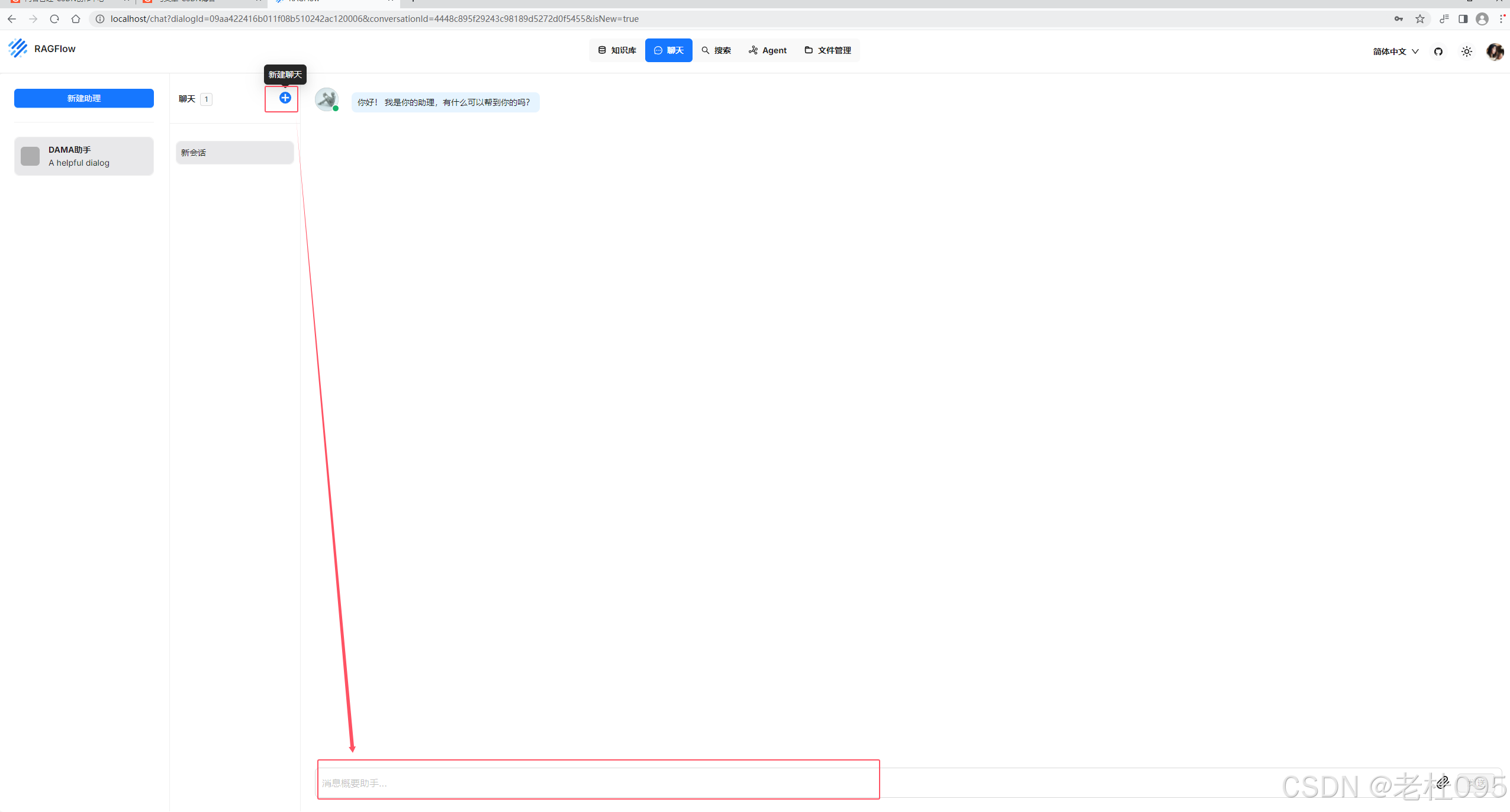

创建好聊天助理后即可 【新建聊天】创建聊天会话,如下图所示即可通过对话实现检索知识库了

5)、聊天

注意: 需要等知识库中的文档解析完成后再进行聊天

至此,所有的配置已全部完成!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)