0代码!教会你用Dify+DeepSeek搭建RAG知识库(附完整DSL)

0代码!教会你用Dify+DeepSeek搭建RAG知识库(附完整DSL)

0代码!教会你用Dify+DeepSeek搭建RAG知识库(附完整DSL)

你是不是也曾有过这样的体验:问DeepSeek某个专业问题,它给你一番头头是道的回答,结果你去核实后发现是瞎编的?或者你手上有一堆PDF文档资料,不想一页页翻阅,而是希望能像搜索引擎一样直接问问题就能得到准确答案?

今天我要分享的这个组合简直是职场效率神器 — 零代码、零门槛,帮你把手上的专业资料变成私人AI顾问!

不管是产品文档、研究报告、企业资料库,还是你的专业笔记,通通可以变成一个既精准又智能的AI助手。关键是,连写代码都不需要!

![[配图]](https://i-blog.csdnimg.cn/direct/843666e3562b4c23b466defc7a0a4c6e.png)

"大模型不准确"这个老大难问题,RAG技术轻松解决!

每次用通用AI模型问具体问题,你是不是也担心它会"胡说八道"?这就是我们俗称的"模型幻觉"问题。模型毕竟知识有限,截止日期后的信息它不知道,你公司内部的资料它也不可能了解。

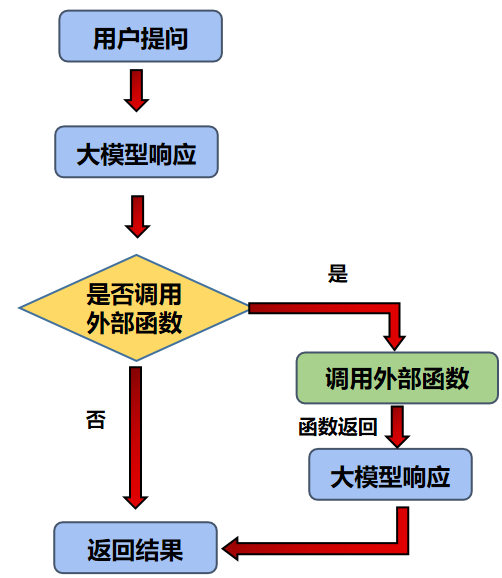

这时候,RAG技术就派上用场了。RAG是"检索增强生成"的缩写,简单说就是:

![[配图]](https://i-blog.csdnimg.cn/direct/2899a4c484974c8dbea9f17360a4eba7.png)

1️⃣ 你问问题前,系统先去你指定的资料库里找相关内容

2️⃣ 找到后,把这些内容作为"提示"给到AI

3️⃣ AI根据这些真实资料来回答问题,不再凭空想象

这就像你请了个超级助理,每次问问题之前,ta都会先翻阅你给的参考资料,然后才给你答案,精准度自然大大提升!

从入门到上手:Dify+DeepSeek组合的超强威力

我之前尝试过不少RAG方案,但大多需要敲代码或者花钱买服务。直到发现了Dify+DeepSeek这个组合,简直相见恨晚!

Dify是一个开源的AI应用开发平台,最厉害的是它有可视化界面,拖拖拽拽就能创建复杂的AI应用。而DeepSeek则是咱们国人的开源大模型,不仅理解能力强,甚至在某些专业领域超越了那些知名大模型。

这个组合的优势在于:

1️⃣ 支持完全本地部署,不用担心数据泄露

2️⃣ 零代码配置,全靠点点点

3️⃣ 灵活的知识库管理,PDF、Word、Excel通通能用

4️⃣ 模型可自由切换,不被单一厂商锁定

打造专属知识库的四步法

我把整个过程简化成四步,即使是技术小白也能轻松上手:

![[工作流图]](https://i-blog.csdnimg.cn/direct/bcc0453cafa1490699ca1e9cb3ae4e31.png)

第一步:准备你的Dify环境

可以基于Docker搭建(Dify支持Docker部署,按照文档一步步来即可):https://github.com/langgenius/dify

也可以直接使用Dify Cloud:https://cloud.dify.ai/apps

![[首页配图]](https://i-blog.csdnimg.cn/direct/4a23067ebce74308b0f8c5a8fcb6286b.png)

环境准备完成后,就能看到Dify的界面,创建账号后就可以开始使用了。

第二步:配置模型,连通魔法的关键

🔗 硅基流动入口(新用户注册还有免费额度,足够个人使用了):https://cloud.siliconflow.cn/i/6b7AJN4K

在Dify中需要配置两种关键模型,我们可以使用硅基流动等平台提供的模型:

![[配图]](https://i-blog.csdnimg.cn/direct/59007d51cd504e65aa23bf7cc6eac6af.png)

大语言模型:负责思考和生成答案,这里我直接用deepseek-ai/DeepSeek-R1。它的理解能力和输出质量都相当惊艳,尤其是处理中文专业资料时表现出色。(如果遇到连接通信异常问题,也可以选用其它平台的api或者用私有化部署的 LLM)

![[配图]](https://i-blog.csdnimg.cn/direct/4c4ed56d7eed4b6ca2281811377b72d8.png)

向量模型:这是实现精准检索的关键,它会把文档和问题都转换成"向量"(想象成一串xy数字),通过计算向量间的距离来找到最相关的内容。本文选用的向量服务是基于 bge-m3 模型开发的BAAI/bge-m3。

![[配置硅基完成图]](https://i-blog.csdnimg.cn/direct/29397475b75a46698a2431c53f0b0725.png)

配置过程很简单,在Dify的设置页面添加模型,填入API地址和密钥即可。如果你想完全本地化,也可以使用Ollama等工具部署本地向量模型。

第三步:创建知识库,让AI"读懂"你的资料

![[创建主页图]](https://i-blog.csdnimg.cn/direct/1b045330d3324c3989781234619383ec.png)

这一步是关键中的关键,直接决定了你的AI助手有多聪明。

在Dify中创建知识库非常简单,上传文件后,系统会自动处理,本文以经典的**清华大学104页《DeepSeek:从入门到精通.pdf》**为例:

![[拼图]](https://i-blog.csdnimg.cn/direct/bc89c5b371cd46958aa601dd1dfec955.png)

1️⃣ 选择数据源:上传本地文件作为知识库语料

2️⃣ 文本分段与清洗:选择父子分段提高精确度,并设置Embedding模型(选择硅基的bge-m3模型)

3️⃣ 处理并完成:创建知识库,并自动进行文件数据分段嵌入处理

但有几个小技巧可以让效果更好:

1. 选择父子分段模式:这是Dify推荐的分段策略,能在保持上下文完整的同时提高检索精度。父区块保持较大的文本单位(如段落),子区块以较小的文本单位(如句子)用于精确检索。

2. 调整相似度阈值:默认是0.7,如果你发现回答不够准确,可以适当提高这个值;如果回答太少,则可以稍微降低。

3. 启用Rerank模型:这相当于给检索结果再排序,进一步提高准确率。在硅基流动平台上就有不少免费的Rerank模型。

上传完成后,系统会自动进行向量化处理。完成后就可以开始使用了!

第四步:创建应用,开始智能问答

最后一步,我们需要创建一个应用来使用这个知识库。Dify提供了多种应用模板,最简单的是"聊天助手":

![[配图]](https://i-blog.csdnimg.cn/direct/8490c5682ef646e79413932452fd4a17.png)

1️⃣ 创建应用后,在上下文设置中添加你的知识库:

![[添加知识库图]](https://i-blog.csdnimg.cn/direct/ee4f8f66843b4f19b6a650008dca2208.png)

2️⃣ 添加LLM大语言模型DeepSeek R1 -> 设置上下文 -> 并输入提示词:

请根据文本内容{{#context#}}回答,不要发散,说人话!

![[添加deeepseek图]](https://i-blog.csdnimg.cn/direct/64572f09ab6e4a7281747b21f30c9cd9.png)

3️⃣ 最后添加一个直接回复节点即可:

![[结果图]](https://i-blog.csdnimg.cn/direct/81b149407eaf464ba83cb9e36c2a59a1.png)

然后咱们点击预览就可以开始提问了!

我用清华大学104页《DeepSeek:从入门到精通.pdf》这份PDF进行了测试,效果相当满意👇

![[问答拼图]](https://i-blog.csdnimg.cn/direct/f1baa0b6947846fab99b3fd24cd9c962.png)

当我问"DeepSeek能做什么"时,系统迅速从PDF中检索出相关内容,然后给出了精准回答,完全基于文档内容,没有任何"幻觉"!

更让我惊喜的是,即使问一些需要综合理解的问题,比如"DeepSeek和其他模型相比有什么优势",它也能从多个片段中提取关键信息,组织成有条理的回答👍

结语

相比动辄几百上千的AI应用服务,这套开源组合基本不需要什么成本,却能实现媲美商业服务的效果,简直是下列小伙伴的效率神器:

学生党:把教材和笔记上传,复习时直接提问关键知识点

研究人员:把论文库变成智能助手,再也不用手动翻阅海量文献

职场人士:将公司文档、产品手册等变成私人顾问,随时查询

内容创作者:整理自己的素材库,需要时AI帮你找出最相关的内容

即使你是彻底的技术小白,按照上面的步骤也能轻松搭建属于自己的智能知识库。

开始行动吧,让AI不再"胡说八道",而是变成你的专业知识管家!

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)