真香了!Spring AI接入DeepSeek,开发效率起飞

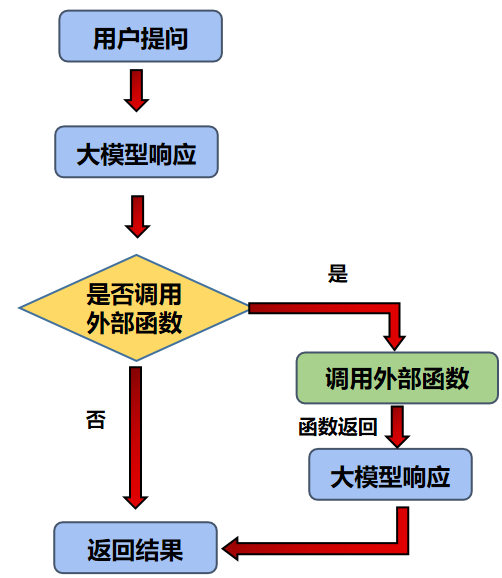

你可以把 Spring AI 理解成 Java 生态里的 LangChain 或者 LlamaIndex,只不过它是为 Java 项目量身打造的。,剩下的都它帮你搞定。对我来说,这就像终于找到了一个靠谱的“AI 中间人”。你可以理解为,Spring AI 把“接模型”这个事,给彻底标准化了。而 DeepSeek 本身也支持 OpenAI 的 API 接口规范,这事就更方便了,像拼积木一样,接上就能

Spring AI 是什么,它到底图个啥?

你可以把 Spring AI 理解成 Java 生态里的 LangChain 或者 LlamaIndex,只不过它是为 Java 项目量身打造的。

它的核心思想特别简单:让你不用关心模型具体是哪家的,只需要用统一的 API 接入,剩下的都它帮你搞定。对我来说,这就像终于找到了一个靠谱的“AI 中间人”。

它有几个我特别喜欢的地方:

- 接口统一,写一次逻辑,到处都能用;

- 配置简单,写个 yml 文件,模型换个供应商都不带动代码的;

- 社区资源逐渐丰富,关键是还有 Spring Boot 的原生加持,和我现有项目契合度高。

你可以理解为,Spring AI 把“接模型”这个事,给彻底标准化了。而 DeepSeek 本身也支持 OpenAI 的 API 接口规范,这事就更方便了,像拼积木一样,接上就能用。

第一种方案:用 DeepSeek 的 OpenAI 兼容接口

这个方法简单粗暴,本质就是骗 Spring AI 说我们在用 OpenAI,实则背后是 DeepSeek 在干活。这种“伪装术”用得好,不但节省开发时间,连测试成本都能压下来。

Maven 依赖加上:

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-openai-spring-boot-starter</artifactId>

<version>0.8.1</version>

</dependency>

这个依赖其实是 Spring AI 官方出的,帮你封装好了调用逻辑,不用你操心 RestTemplate、异常处理啥的。

配置文件改一改(关键)

在 application.yml 中加上这些配置:

spring:

ai:

openai:

base-url: https://api.deepseek.com/v1

api-key: sk-your-deepseek-key-here

chat:

options:

model: deepseek-chat

注意啊,base-url 这个一定要改成 DeepSeek 提供的地址,不然请求还是会打到 OpenAI 去;api-key 得是 DeepSeek 的密钥,这个申请起来稍微有点麻烦,据说官网 API 服务目前有些限制,这边推荐两个超稳定的渠道,大家自行获取。

腾讯云:https://curl.qcloud.com/T3M5yBHp

硅基流动(SiliconCloud):https://cloud.siliconflow.cn/i/VXZzAOed

控制器写个简单接口试试水:

@RestController

@RequestMapping("/ai")

publicclass ChatController {

privatefinal ChatClient chatClient;

public ChatController(ChatClient.Builder chatClientBuilder) {

this.chatClient = chatClientBuilder.build();

}

@GetMapping("/chat")

public String generate(@RequestParam(value = "message") String message) {

return chatClient.prompt(message).call().content();

}

}

请求 /ai/chat?message=你好,你会发现,DeepSeek 乖乖返回结果了,速度还挺快,体验完全不像国产模型那种卡顿的节奏。

如果你想在代码里动态指定模型?

可以用这种方式:

ChatResponse response = chatModel.call(

new Prompt("给我列出5个知名的物理学家。",

OpenAiChatOptions.builder()

.withModel("deepseek-chat")

.withTemperature(0.5)

.build()

));

这个方法适合需要多模型切换或者个性化参数配置的场景,比如 A 任务你想让它多想想,B 任务你想要它快点答,不用动配置文件,代码里就能改。

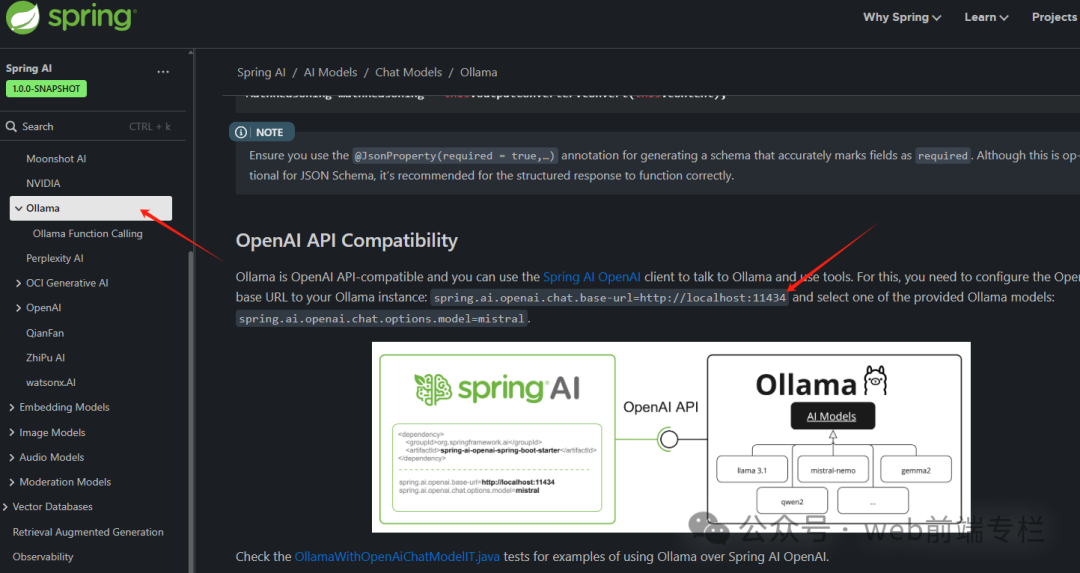

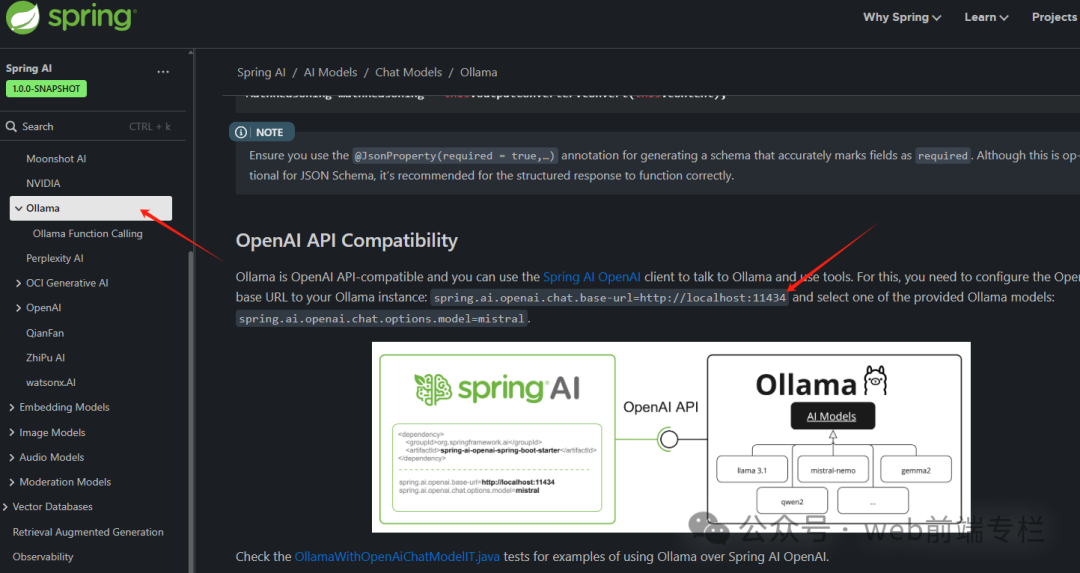

第二种方案:本地部署 DeepSeek 模型

说实话,如果你和我一样,有些“云服务焦虑症”——担心接口限流、服务停摆、数据泄露,那本地部署大模型简直就是一针强心剂。

DeepSeek R1 模型提供了一个蒸馏轻量版本,可以跑在本地,通过 Ollama 工具一键部署。整个流程非常丝滑,甚至比跑个 Docker 容器还简单。这个方式我最喜欢的一点就是:所有数据都不出你的服务器,想怎么玩就怎么玩。

本地部署先搞起来

简单说就是:

ollama run deepseek-r1:1.5b

运行后,它会监听在本地 11434 端口,相当于你本机起了一个 AI 服务。

Maven 依赖换一下:

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-ollama-spring-boot-starter</artifactId>

<version>0.8.1</version>

</dependency>

这个 starter 是专门用来接 Ollama 的,Spring AI 也内置支持了。

application.yml 再改一波:

spring:

ai:

ollama:

base-url: http://localhost:11434

chat:

model: deepseek-r1:1.5b

模型名称得跟你在 Ollama 里拉下来的保持一致,不然请求会挂掉。

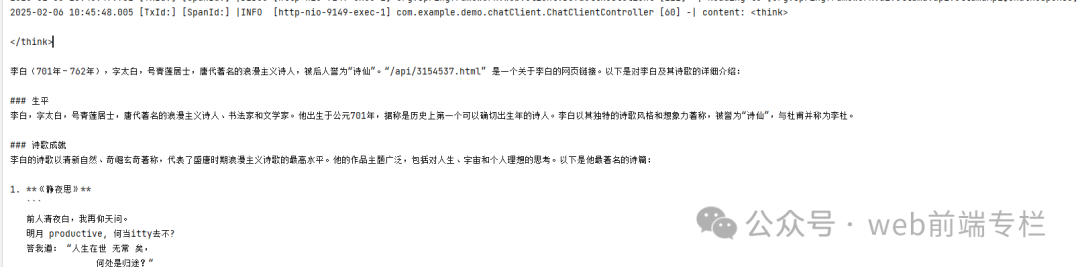

控制器升级支持响应流:

@RestController

@RequestMapping("/ai")

publicclass ChatController {

privatefinal ChatClient chatClient;

public ChatController(ChatClient.Builder chatClient) {

this.chatClient = chatClient.build();

}

@GetMapping("/chat")

public ResponseEntity<Flux<String>> chat(@RequestParam(value = "message") String message) {

try {

Flux<String> response = chatClient.prompt(message).stream().content();

return ResponseEntity.ok(response);

} catch (Exception e) {

return ResponseEntity.badRequest().build();

}

}

}

这种写法可以返回响应流(stream),用户体验就更好了,打字式的返回,给人一种“哇,AI 正在思考”的错觉。写聊天机器人或者长文本生成非常合适。

说到这儿,不得不感叹一下,Spring AI 把一件很麻烦的事做得真的挺顺畅。从接 DeepSeek 的过程来看,无论是伪装模式,还是本地部署,整个流程都非常清晰。你只要熟悉一点点 Spring Boot 的配置,基本就能上手。

我目前在测试环境跑了一周时间,DeepSeek 的中文表现挺稳,流畅度也不错。尤其是在对话型应用里,能根据上下文保持连贯性,已经完全可以应付大多数应用场景了。

如果你之前因为接 AI 模型头大、配置痛苦、API 改来改去而退缩过,现在真的可以尝试一下 Spring AI,把接入门槛降到地板上,用最少的代码做最实用的事。

我的DeepSeek部署资料已打包好(自取↓)

https://pan.quark.cn/s/7e0fa45596e4

但如果你想知道这个工具为什么能“听懂人话”、写出代码 甚至预测市场趋势——答案就藏在大模型技术里!

❗️为什么你必须了解大模型?

1️⃣ 薪资爆炸:应届大模型工程师年薪40万起步,懂“Prompt调教”的带货主播收入翻3倍

2️⃣ 行业重构:金融、医疗、教育正在被AI重塑,不用大模型的公司3年内必淘汰

3️⃣ 零门槛上车:90%的进阶技巧不需写代码!会说话就能指挥AI

(附深度求索BOSS招聘信息)

⚠️警惕:当同事用DeepSeek 3小时干完你3天的工作时,淘汰倒计时就开始了。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?老师啊,我自学没有方向怎么办?老师,这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!当然这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献76条内容

已为社区贡献76条内容

所有评论(0)