别被 “一键部署” 骗了!使用Ollama本地部署DeepSeek 避坑指南

最近最火的莫过于DeepSeek,现在网上关于 AI 模型部署的文章一抓一大把,动不动就是 “一键部署,轻松上手”、“30 分钟搭好一个本地能跑起来的大模型”。可现实是,当你真上手用 Ollama 搭建 DeepSeek 模型时,那简直就是踩坑大冒险!今天咱就来好好唠唠那些坑,帮你顺利搭建属于自己的 DeepSeek。

前言

最近最火的莫过于DeepSeek,现在网上关于 AI 模型部署的文章一抓一大把,动不动就是 “一键部署,轻松上手”、“30 分钟搭好一个本地能跑起来的大模型”。可现实是,当你真上手用 Ollama 搭建 DeepSeek 模型时,那简直就是踩坑大冒险!今天咱就来好好唠唠那些坑,帮你顺利搭建属于自己的 DeepSeek。

Ollama 是什么

Ollama 则是咱们搭建模型的得力助手,它就像是一个智能的建筑工人,能够帮助我们快速、轻松地部署各种大型语言模型。使用 Ollama,我们不需要掌握复杂的技术知识,只需要几个简单的命令,就能让模型在本地运行起来。它还提供了简洁易用的界面,让我们可以方便地与模型进行交互,就像和朋友聊天一样自然。

ollama地址:www.ollama.com/download

不同模型版本对应的需求

以下是显存需求的大致参照表:

通过此表,可以帮助您快速选择适合自己需求的 DeepSeek版本。

Ollama 安装和配置详细步骤

安装前准备

在安装 Ollama 之前,要确保你的系统满足基本要求。通常,Ollama 支持主流的操作系统,如 Linux、macOS 和 Windows。至少有 32GB 的内存和足够的存储空间。我使用的是Ubuntu服务器,32核,64G内存,P100(计算卡)。

同时,要保证系统已经安装了必要的依赖,比如在 Linux 系统上可能需要安装一些基础的开发工具包。

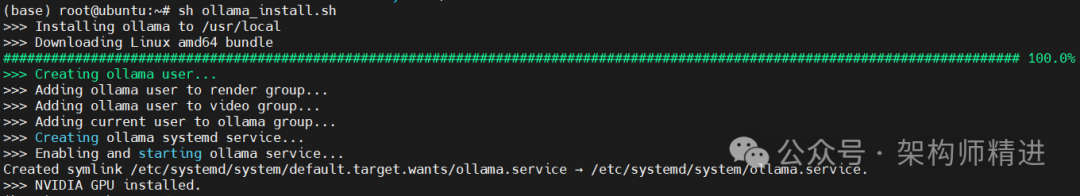

Step 1:安装 Ollama

在 Linux 系统上安装 Ollama 相对简单。打开终端,输入以下命令:

curl https://ollama.com/install.sh | sh

这个命令会从 Ollama 的官方服务器下载安装脚本并执行。

遇到的第一个坑

正常情况下通过上面的步骤就能安装成功,然而,在安装之际,网络状况却成了 “绊脚石”,致使 Ollama 的下载进度特别慢,甚至会弹出了 “Error: pull model manifest” 的问题提示,这无疑是雪上加霜,让原本就不顺利的安装过程变得更加艰难。不过别慌,解决办法这就奉上:

1、下载ollama_install.sh并保存

curl -fsSL https://ollama.com/install.sh -o ollama_install.sh

2、使用github文件加速替换github下载地址

sed -i 's|https://ollama.com/download/ollama-linux|https://gh.llkk.cc/https://github.com/ollama/ollama/releases/download/v0.5.7/ollama-linux|g' ollama_install.sh

3、替换后增加可执行权限

chmod +x ollama_install.sh

4、执行sh下载安装

sh ollama_install.sh

安装完成后,你可以通过以下命令验证是否安装成功:

ollama --version

如果能正确显示 Ollama 的版本信息,说明安装成功。

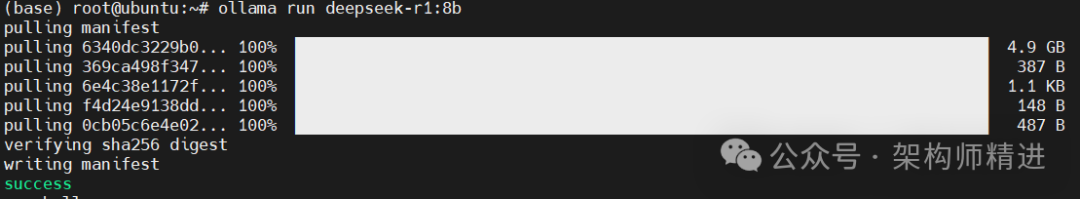

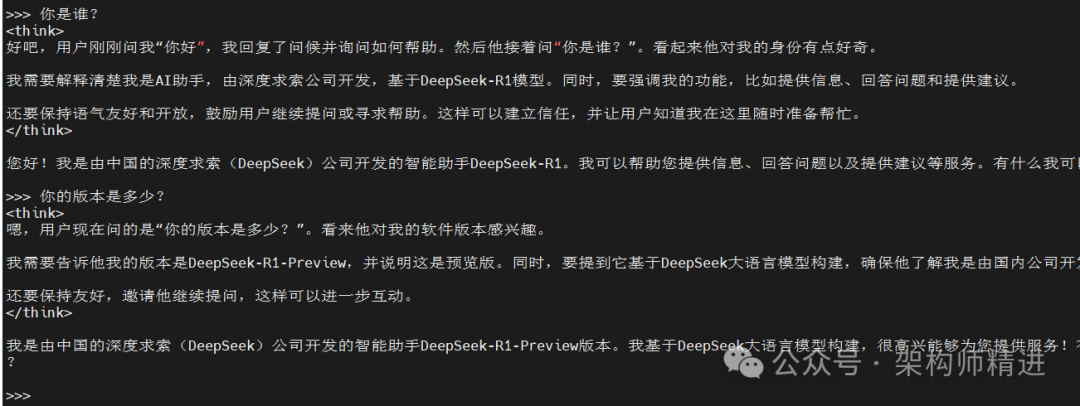

Step 2:启动模型

输入以下命令来启动模型:

ollama run deepseek-r1:14b

这一步整体还算顺利,没什么大毛病。唯一小闹心的就是初次下载时,速度就像老黄牛拉车,磨磨蹭蹭的。但别着急,只要下载成功,后续就能顺顺当当的。要是下载失败了也别气馁,就多试那么几次,说不定哪一回就成啦。

当你看到终端输出一些信息后,就说明模型已经成功启动啦!这时候,你就可以和 DeepSeek开始聊天啦。

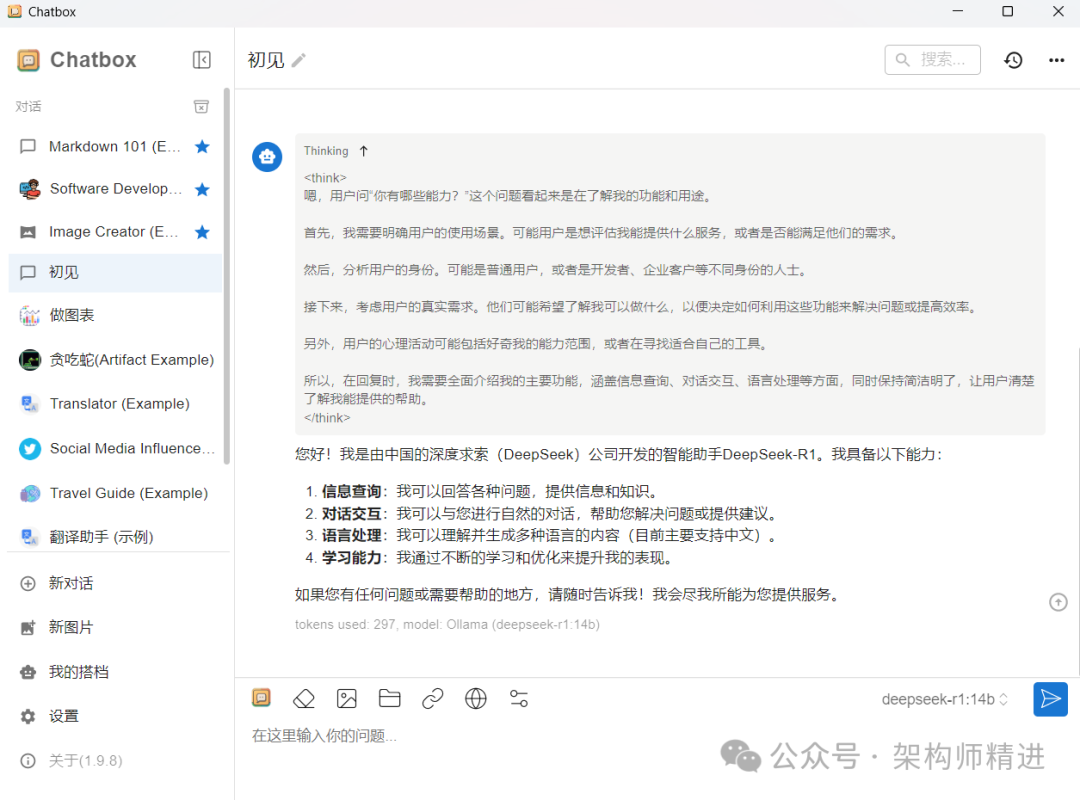

Step 3:安装chatbox

cmd 黑窗口用起来实在是太憋屈啦,有没有带 UI 界面的,用起来能更顺手些。要说和 Ollama 搭配使用,体验感拉满的 UI 界面,首推 Ollama 官方的 docs.openwebui.com 。要是你对 Docker 部署轻车熟路,或者懂点代码,那完全可以参考相关教程手动安装,感受一把技术操作的乐趣。

如果你就想简单点,下载个客户端,用鼠标点点就能轻松上手,那选 chatbox 就对啦。安装方式跟装其他软件没啥两样,双击运行安装程序就行,超省心。点击这个链接 chatboxai.app/zh 就能下载,快去试试吧!

遇到的第二个坑

在服务器上成功安装 Ollama 并启动 DeepSeek 之后,我们遇到了第二个问题。通过本地命令行可以正常调用接口,但当尝试从外部电脑访问服务器上的 DeepSeek 接口时,始终无法成功。

查阅官方文档后发现,要实现外网访问,需要对 Ollama 进行配置修改,使其监听地址为 0.0.0.0 并修改端口。具体步骤如下:

第一步:修改文件

vim /etc/systemd/system/ollama.service

第二步:增加配置

[Service]``Environment="OLLAMA_HOST=0.0.0.0:11434"

第三步:重新加载

sudo systemctl daemon-reload``sudo systemctl restart ollama``sudo systemctl status ollama

配置完之后,在浏览器中访问http://服务器IP:11434/ ,返回“Ollama is running”。说明配置成功了。接下来在chatbox 中设置Ollama 的地址即可。

通过以上几步,我们就可以使用Ollama 在本地部署DeepSeek大模型了。

最后

虽然搭建过程中充满了各种坑,但当我最终成功部署好 DeepSeek 模型,看到它正常运行并给出准确回答时,那种成就感简直无法言喻。就像历经千辛万苦终于登上了山顶,看到了美丽的风景。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

DeepSeek全套安装部署资料

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献49条内容

已为社区贡献49条内容

所有评论(0)