OpenWebUI 整合 Ollama + DeepSeek 本地部署使用指南

OpenWebUI 是一款专为本地大语言模型(LLMs)设计的开源、可扩展且功能丰富的自托管 Web 用户界面,支持完全离线运行,适用于需要数据隐私和安全保障的场景。其核心目标是为开发者及企业提供便捷的模型调试、交互与管理工具,同时兼容多种模型运行框架(如 Ollama、OpenAI 兼容 API 等),降低大模型应用的技术门槛。

OpenWebUI 整合 Ollama + DeepSeek 本地部署使用指南(2025 最新版)

目录

OpenWebUI 是一款专为本地大语言模型(LLMs)设计的开源、可扩展且功能丰富的自托管 Web 用户界面,支持完全离线运行,适用于需要数据隐私和安全保障的场景。其核心目标是为开发者及企业提供便捷的模型调试、交互与管理工具,同时兼容多种模型运行框架(如 Ollama、OpenAI 兼容 API 等),降低大模型应用的技术门槛。

一、核心功能与特性

1、直观的交互界面

OpenWebUI 的界面设计灵感源自 ChatGPT,提供清晰的聊天式交互体验,支持响应式布局(适配桌面与移动端),并集成代码语法高亮、Markdown/LaTeX 渲染、语音输入、多模态交互(如图像生成)等功能,极大提升了用户操作的友好性。

2、多模型与多场景支持

模型管理:

支持同时连接多个本地或远程模型服务(如 Ollama、DeepSeek 等),可无缝切换模型,并直接通过 Web 界面下载、删除或创建模型文件(如 GGUF 格式)。

高级功能集成:

内置检索增强生成(RAG)引擎,允许模型结合本地文档库生成更精准的回复;支持预设提示词、协作式群聊(多模型协同)以及 RLHF(人类反馈强化学习)数据标注,适用于智能客服、内容创作等场景。

3、安全与权限控制

通过基于角色的访问控制(RBAC),管理员可精细化配置用户权限(如模型访问、数据管理),并启用多因素认证、会话有效期策略等安全机制。后端采用反向代理设计,避免直接暴露模型服务至局域网,增强系统整体安全性。

4、离线部署与隐私保护

OpenWebUI 无需依赖云服务即可运行,所有数据(包括聊天记录、模型配置)均存储于本地,特别适合对数据敏感性要求高的企业或研究机构。

OpenWebUI 凭借其易用性、安全性和强大的功能集成,成为本地大模型管理的优选工具。无论是个人开发者探索 LLM 能力,还是企业构建私有化 AI 服务,均可通过其灵活的设计实现高效部署与运维。项目持续更新,社区活跃,未来或将进一步扩展多语言支持与跨平台适配能力

二、环境准备与前置条件

前面我已经本地部署好了ollama+deepseek,有不熟悉的可以参考我这篇文章内网本地部署deepseek模型(ollama+deepseek)。

openwebui我这只介绍最最简单的一种方式用B站大佬汤团猪的整合包。

下载地址:

openwebui百度网盘下载地址

整合包解压密码(ttplanet汤团猪),记得用7z解压,7z解压!

解压后点击run.bat就能运行

openwebui启动需要一点时间,请耐心等待。

启动完成后

打开网页用localhost:8080即可登陆。

第一次打开网页会要求创建管理员账号,按要求创建账号后进入

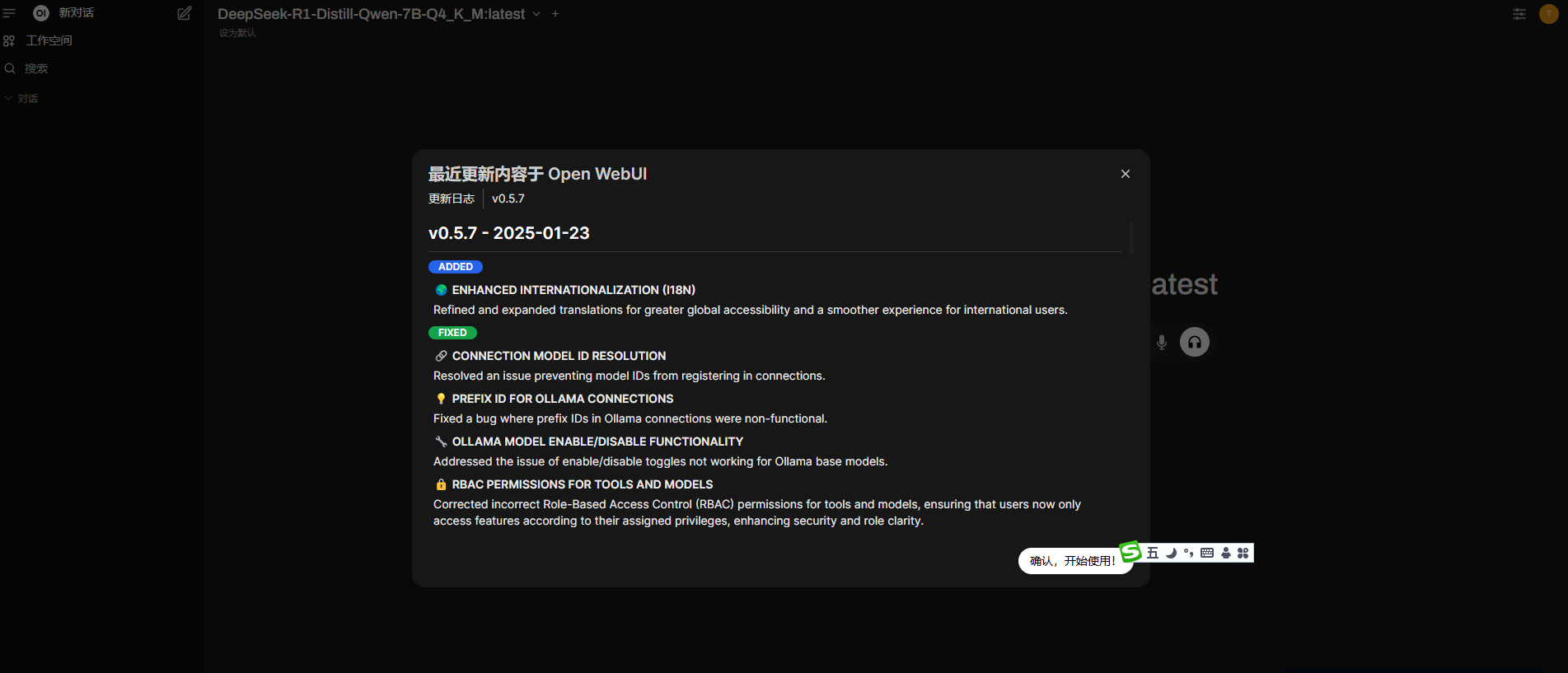

点击确认后进入

选择管理员面板进入设置

三、用户与权限管理

-

用户账户管理

第一种 管理直接创建创建新用户:管理员面板 → 添加用户 → 设置用户名/密码/邮箱 → 选择用户类型(管理员/普通用户/待激活)

-

-

第二种 开放注册

-

管理员面板 → 设置 → 通用 → 勾引允许新用户注册→默认用户角色选择(管理员/普通用户/待激活),新用户注册尽量不要选择管理员

-

用户组配置:选择权限组 → 点右侧+号添加权限组→ 选择具体权限组进行编辑如下图

-

多级权限控制

- 按用户组分配模型访问权限

- 限制普通用户的操作权限(如禁止模型删除/下载)

这里注意无论你如何限制权限,记得把最上面的访问模型列表打开,否则用户无法访问模型,这就失去了部署大语言模型的意义。

然后再点击权限下面的用户,把相应的用户放到相应的权限组里就可以了,最后记得保存。

-

四、模型管理

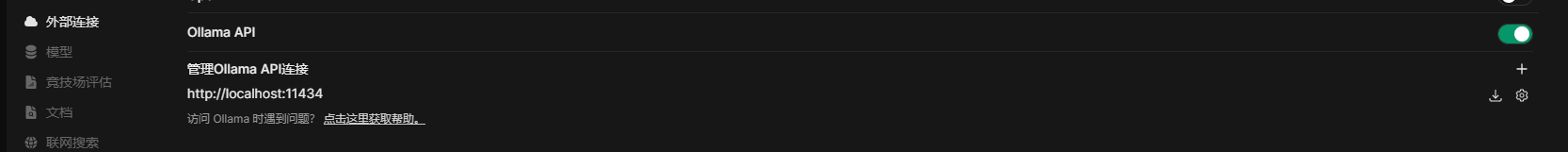

增加ollama 连接地址

管理员面板 → 设置 → 外部连接→勾选ollama api,默认会加上http://localhost:11434的连接地址,如果你的ollama端口或地址有变化,请按实际修改。

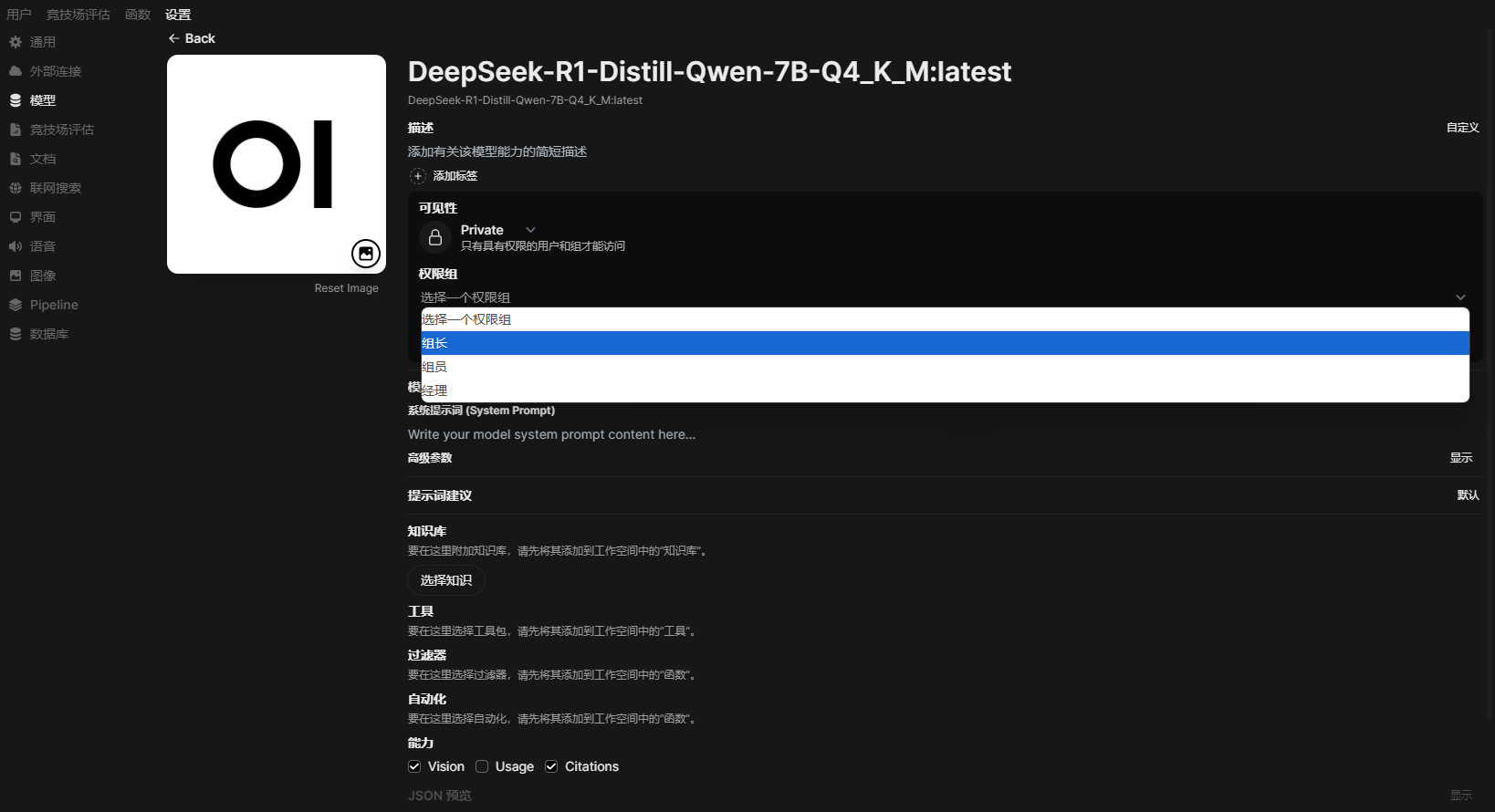

模型设置

设置 → 模型→模型启用→编辑

模型可见性设置有两种(priviate/public),设置为priviate时,权限组里至少要选择一个具体的权限组。

最后记得保存。

五、知识库设置

- 大语言模型无法直接读取知识库文档,需要把知识库文档转换成向量数据,他才能识别

openwebui自带了一个sentence-transformers语义向量模型并不是很好用。

可以在ollama里安装bge-m3或nomic-embed-text这两个向量模型,安装方法同deepseek一样,可参考我这篇文章内网本地部署deepseek模型(ollama+deepseek)。 - 设置 → 文档

- 语言向量模型名称记得跟ollama安装的模型对应

可以命令行里用ollama list查看,再复制模型名称,粘贴即可。(记得检查一下名称后面不要有空格,不然会出错) - 选择左侧工作空间→ 知识库→ 点右侧加号创建知识库

选择文档上传即可。

也可以点右上角的访问控制访问权限。

全部设置好后,在左侧开启新对话就可以开始使用大语言模型,使用知识库可在问题后面加(#知识库名称),大模型就会去查找知识库。

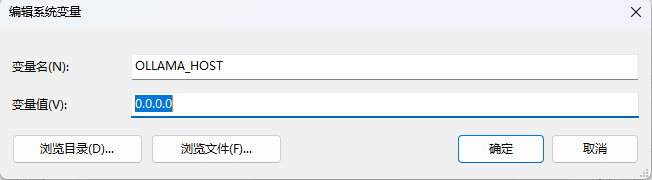

最后补充一点,若openwebui和ollama安装在不同一台电脑内,需要在ollama的电脑上添加环境变量OLLAMA_HOST

本文梳理了OpenWebUI开源框架的几个主要配置,旨在帮助大家快速上手openwebui,欢迎大家批评指正。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)