新手级教程,Windows本地部署DeepSeek-r1

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模

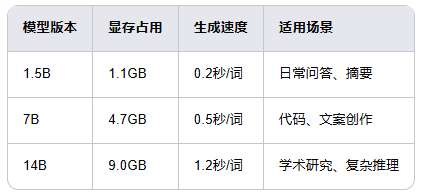

一、硬件配置建议(附性价比方案)

(一)入门级配置

-

配置要求:8GB内存 + i5 CPU + 30GB硬盘

-

适用场景:支持1.5B-8B轻量模型,适合基础问答、文案生成等简单任务。

-

推荐模型:

deepseek-r1:1.5b(仅需1.1GB显存)。

(二)基础级配置

-

配置要求:16GB内存 + RTX 4060显卡

-

适用场景:流畅运行7B模型,性能接近OpenAI-01,适合创作、代码场景。

-

推荐模型:

deepseek-r1:7b。

(三)高性能配置

-

配置要求:32GB内存 + RTX 4090显卡

-

适用场景:支持14B+大模型,解锁完整创作能力。

-

推荐模型:

deepseek-r1:14b(需9GB显存)。

二、核心部署步骤(含避坑指南)

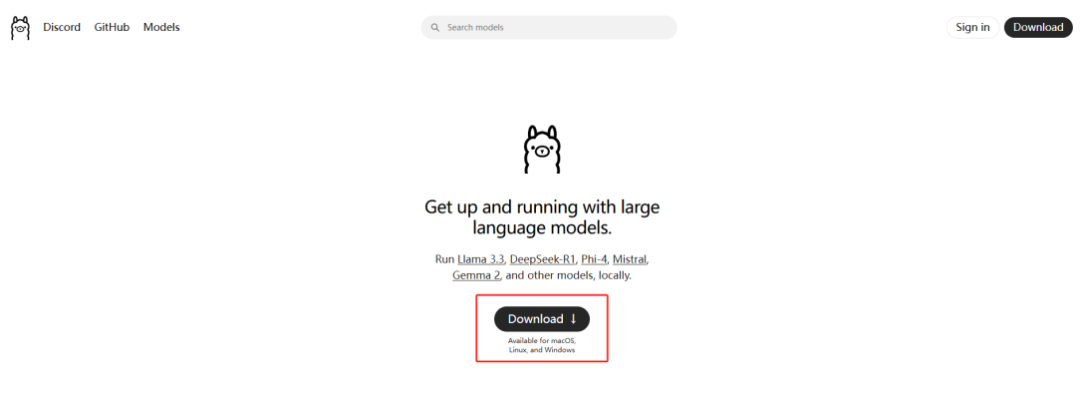

(一)安装Ollama

-

访问官网 https://ollama.com/,下载Windows安装包(默认安装在C盘)。

-

下载完成后,找到

OllamaSetup.exe文件并启动安装。 -

安装成功后,系统会提示“Ollama is running”。

-

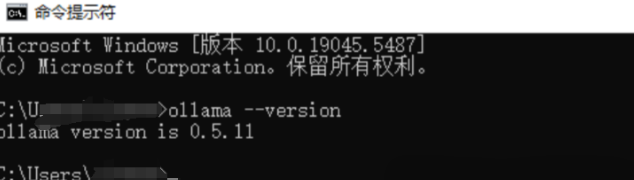

验证安装:在命令行输入

ollama --version,显示版本号即为成功。

-

启动服务:输入

ollama serve,确保服务在后台常驻运行。 -

注意:安装前需预留C盘10GB空间,或通过环境变量修改模型存储路径。

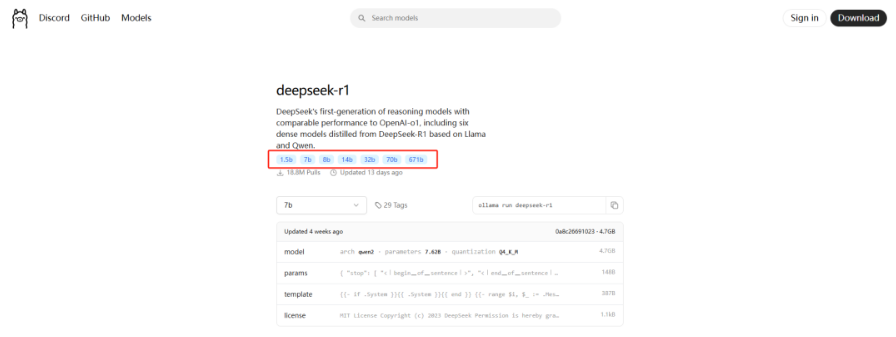

(二)下载模型

-

在官网搜索

deepseek-r1,并根据硬件配置选择合适的参数版本(如1.5B、7B、14B)。

-

使用以下命令下载模型:

-

1.5B轻量版(低配首选):

ollama run deepseek-r1:1.5b -

7B均衡版(推荐配置):

ollama run deepseek-r1:7b -

14B高性能版(需24G+显存):

ollama run deepseek-r1:14b

- 运行与验证:

-

输入

ollama list查看已安装模型。 -

启动对话:

ollama run deepseek-r1:1.5b。 -

技巧:如果下载中断,可输入

ollama pull deepseek-r1:1.5b继续。

- 模型管理命令:

-

查看已安装模型:

ollama list -

删除旧模型:

ollama rm 模型名

三、配置Web页面进行聊天

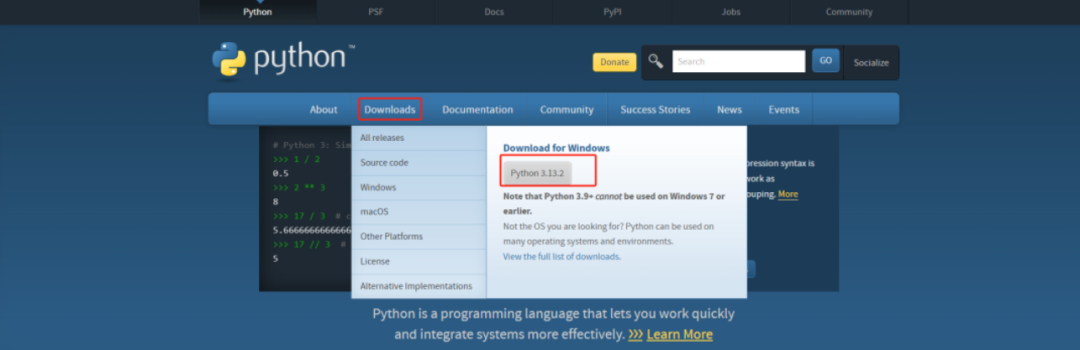

(一)安装Python环境

-

登录https://www.python.org/,下载安装文件。

-

安装时勾选“Add python.exe to PATH”。

-

验证安装是否成功:在命令行输入

python --version,有版本输出则表示成功。

(二)安装Node.js

-

登录https://nodejs.org/zh-cn,下载安装文件。

-

安装完成后,验证是否成功:输入

node -v && npm -v。

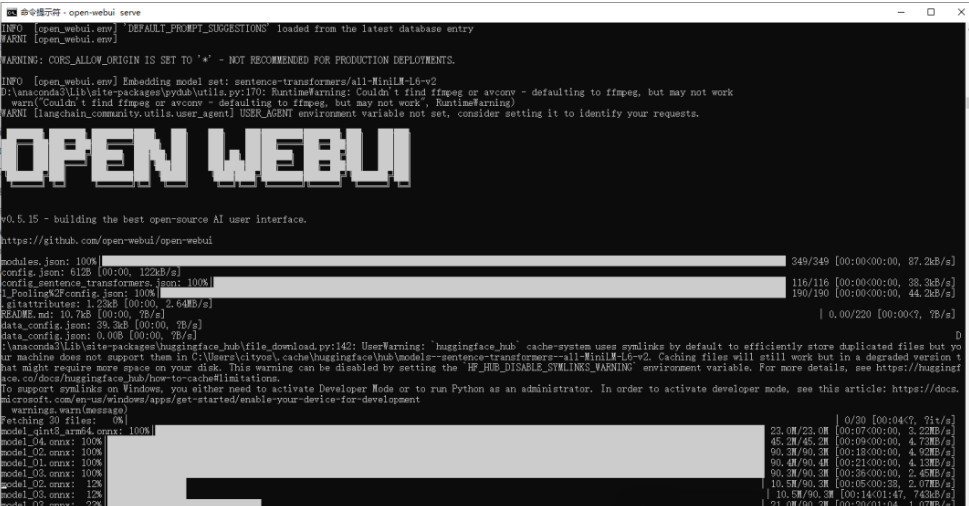

(三)安装Open WebUI

-

输入

pip install open-webui进行安装。 -

安装成功后,输入

open-webui serve启动服务。 -

在浏览器中输入

http://127.0.0.1:8080访问Open WebUI。 -

输入相关信息,创建管理员账号即可开始对话。

(四)注意事项

-

安装Python时,确保版本为3.10+,并勾选“Add to PATH”。

-

安装Node.js时,确保版本为18+。

-

一键启动命令:

-

安装工具:

pip install open-webui -

启动服务:

open-webui serve -

访问

http://127.0.0.1:8080,创建账号即可开始对话。

四、进阶玩法扩展

(一)联网功能

通过浏览器插件Page Assist实现,支持实时网页内容解析。安装后开启“联网搜索”开关即可。

(二)多模型切换

在Open WebUI界面可同时管理Llama、Phi等2000+模型。

(三)企业级部署

使用Dify平台搭建知识库系统,支持API对接与权限管理。

五、常见问题解答

-

模型下载卡顿:切换网络环境或使用镜像源。

-

显存不足报错:尝试量化版本(如

deepseek-r1:7b-q4)或升级驱动。 -

对话响应延迟:关闭后台程序,输入

ollama stop重启服务。

六、效果对比实测

效果对比实测,如下所示:

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献146条内容

已为社区贡献146条内容

所有评论(0)