KTransformers:低预算用户的LLM推理优化神器,轻松部署DeepSeek-R1-671B!

作者:算力魔方创始人/英特尔创新大使刘力

一,引言

在当今 AI 时代,大规模语言模型(LLM)的推理优化已成为技术前沿的热门话题。然而,高昂的硬件成本和复杂的部署流程让许多开发者望而却步。别担心!今天,我们为你带来了一个强大的解决方案——“KTransformers”!

KTransformers是一个专为低预算用户设计的框架,旨在高效运行 DeepSeek-R1-671B 等大规模模型。它基于显卡与 CPU 混合推理方案,并采用 Intel AMX 指令扩展以提升性能。无论你是 AI 初学者还是资深开发者,KTransformers 都能帮你轻松入门并快速部署。本文将详细介绍 KTransformer 的安装过程,包括环境准备、依赖安装、模型下载与测试运行。

💡 小贴士:如果你对 AI 推理优化感兴趣,或者正在寻找低成本、高性能的解决方案,那么这篇文章绝对值得你收藏和分享!

文献参考来源:https://github.com/kvcache-ai/ktransformers二,环境准备

在安装 KTransformers 之前,需确保系统满足以下硬件和软件要求:

1硬件要求

-

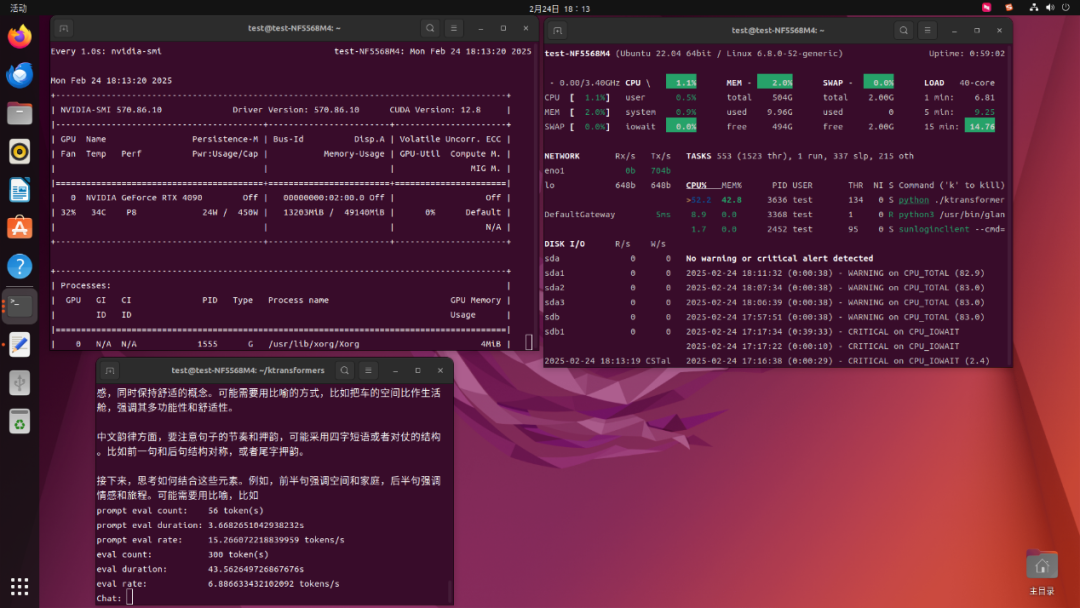

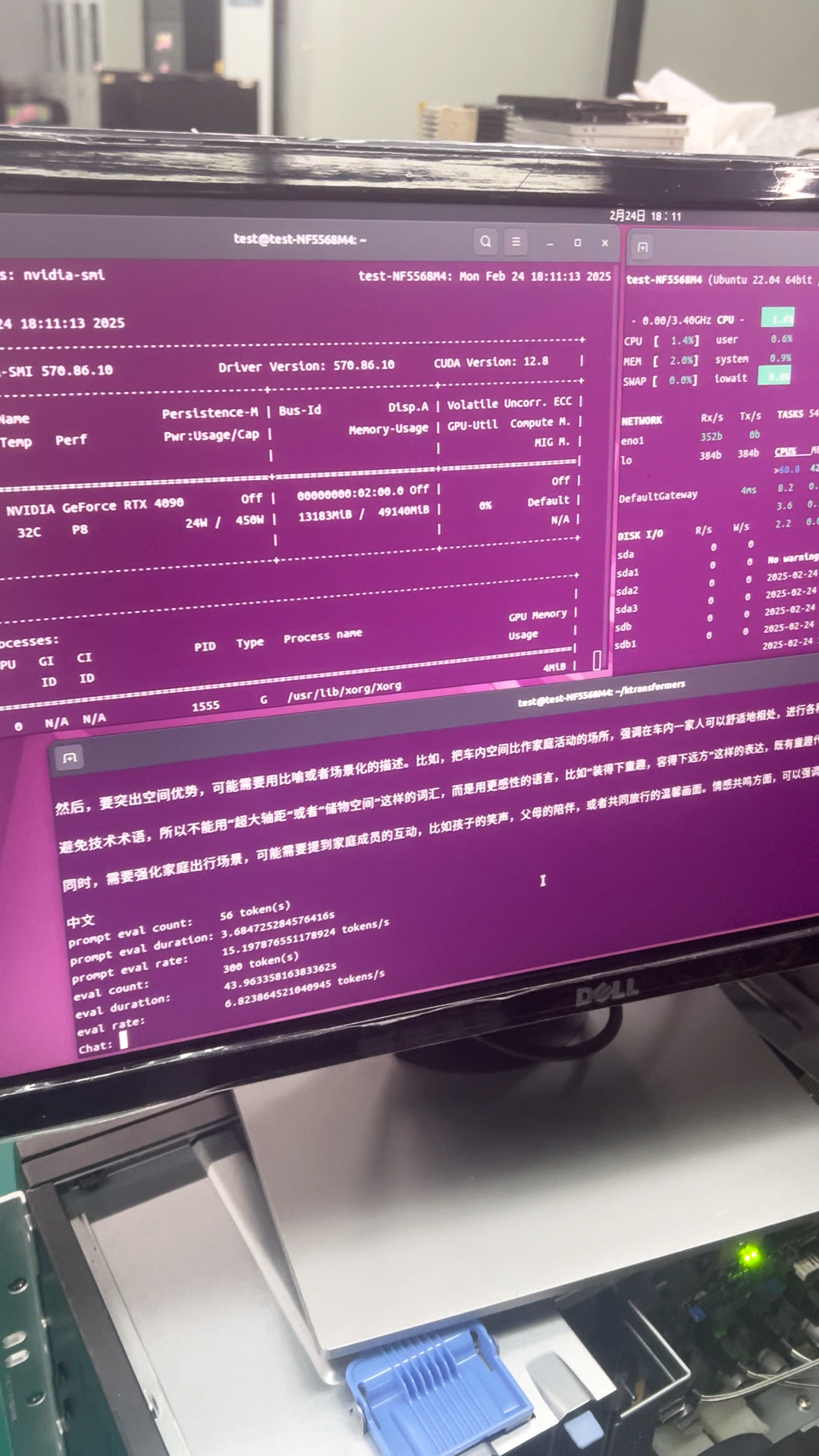

CPU:双路服务器CPU

-

GPU:至少一块 NVIDIA RTX 4090

-

内存:512 GB 服务器内存

-

存储:至少 500G 以上

2软件要求

-

操作系统:Ubuntu 22.04

-

CUDA 版本:12.1 及以上(推荐 12.8)

-

Python 版本:3.11

3环境配置步骤

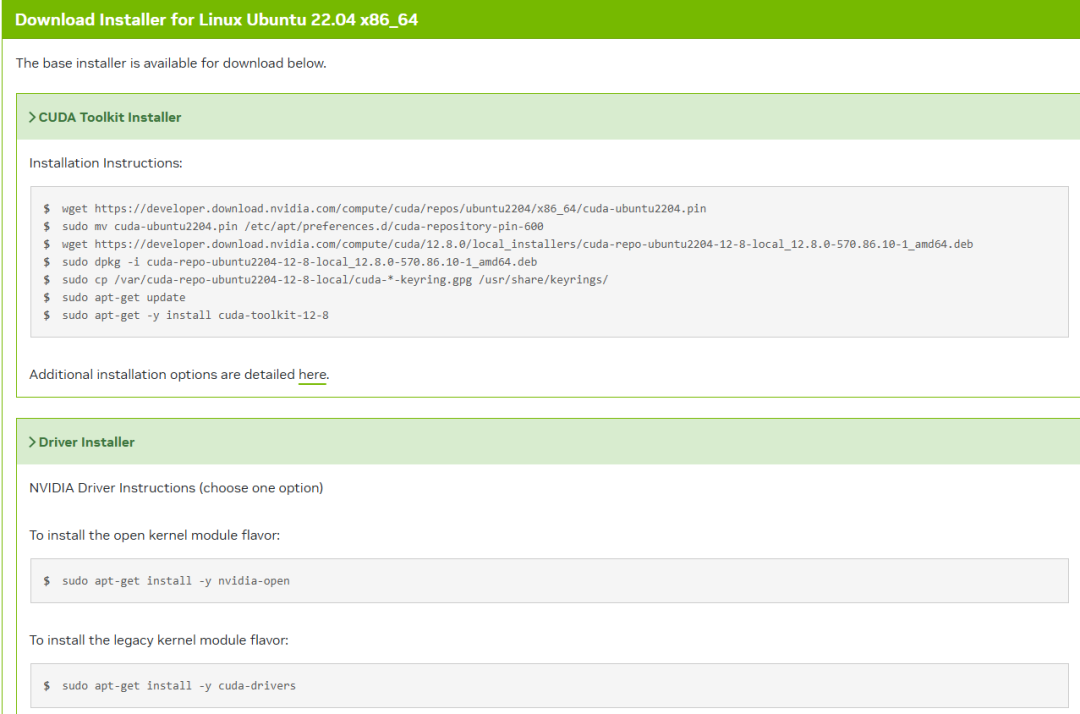

1,安装 CUDA 并添加 CUDA 环境变量:

export PATH=/usr/local/cuda/bin:$PATHexport LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATHexport CUDA_PATH=/usr/local/cud

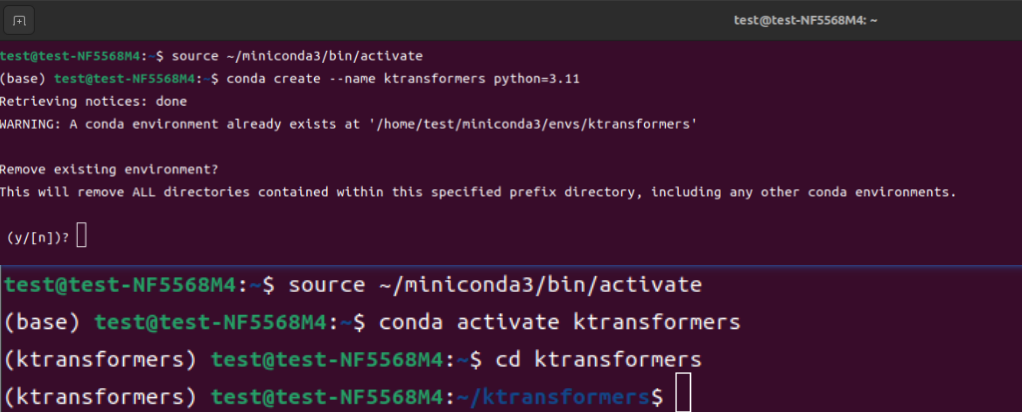

2,创建 Conda 环境:

conda create --name ktransformers python=3.11conda activate ktransformers

3,安装编译工具链:

sudo apt-get updatesudo apt-get install build-essential cmake ninja-build

三,安装 KTransformers

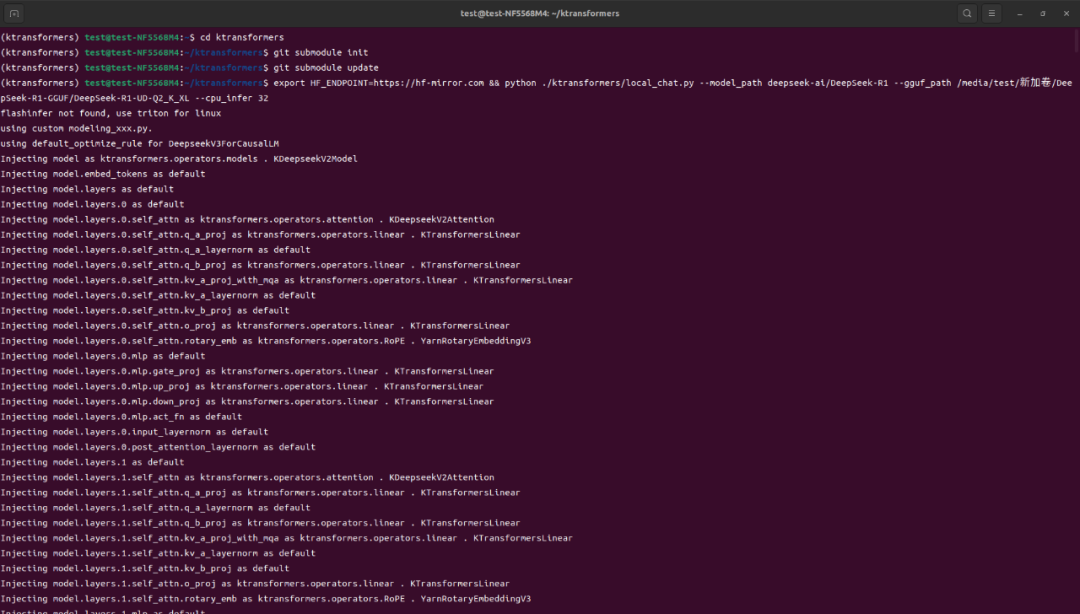

克隆代码与初始化

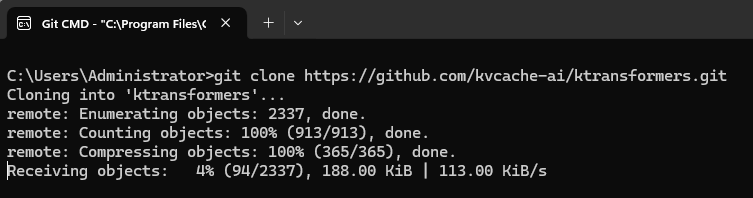

1,克隆 KTransformers 仓库:

git clone https://github.com/kvcache-ai/ktransformers.git

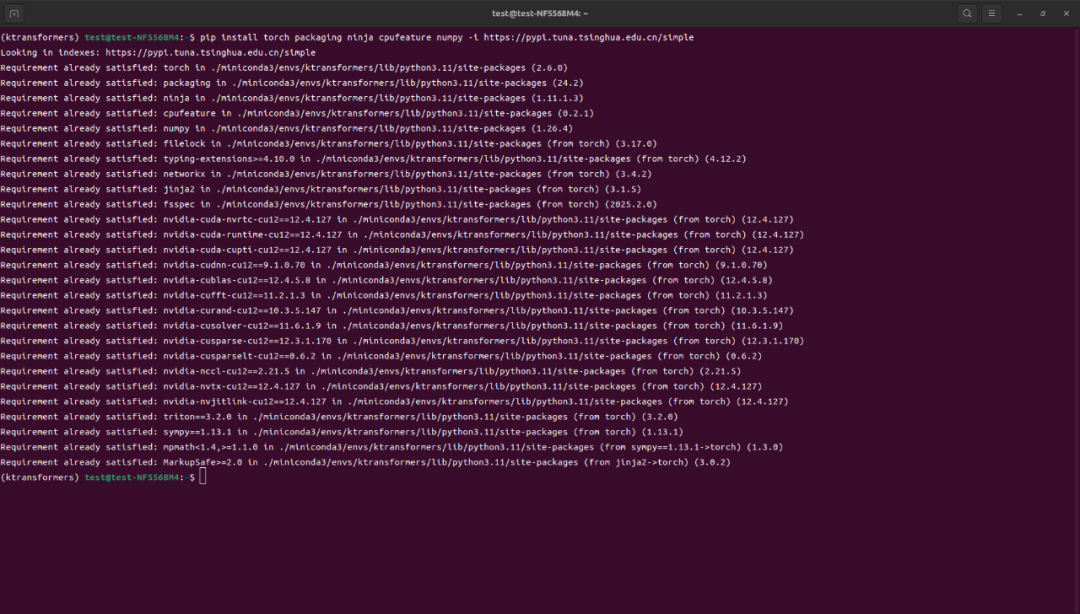

2,安装依赖:

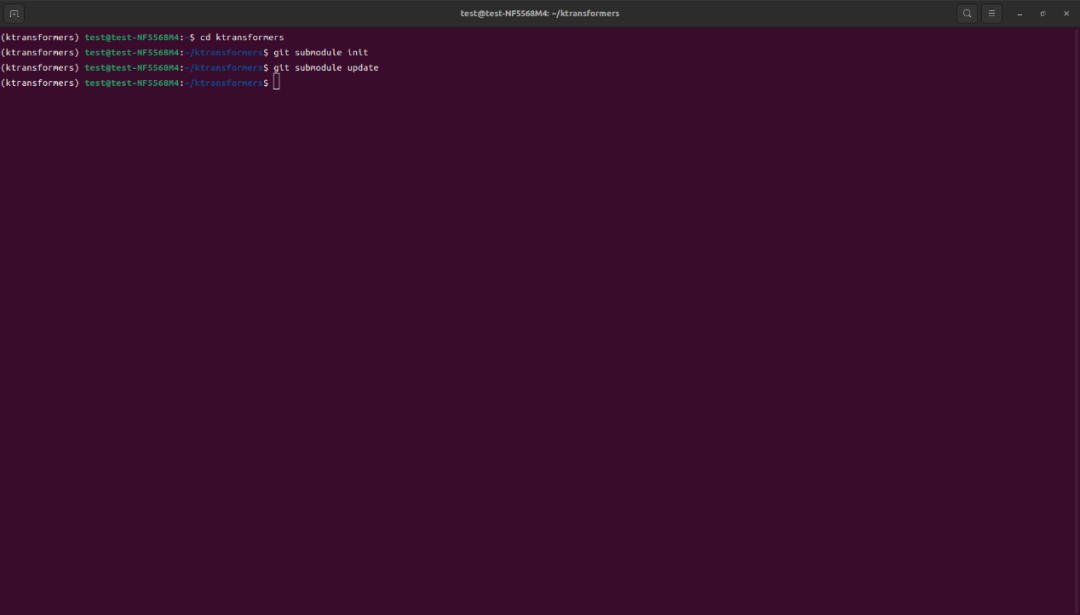

cd ktransformersgit submodule initgit submodule update

运行安装脚本:

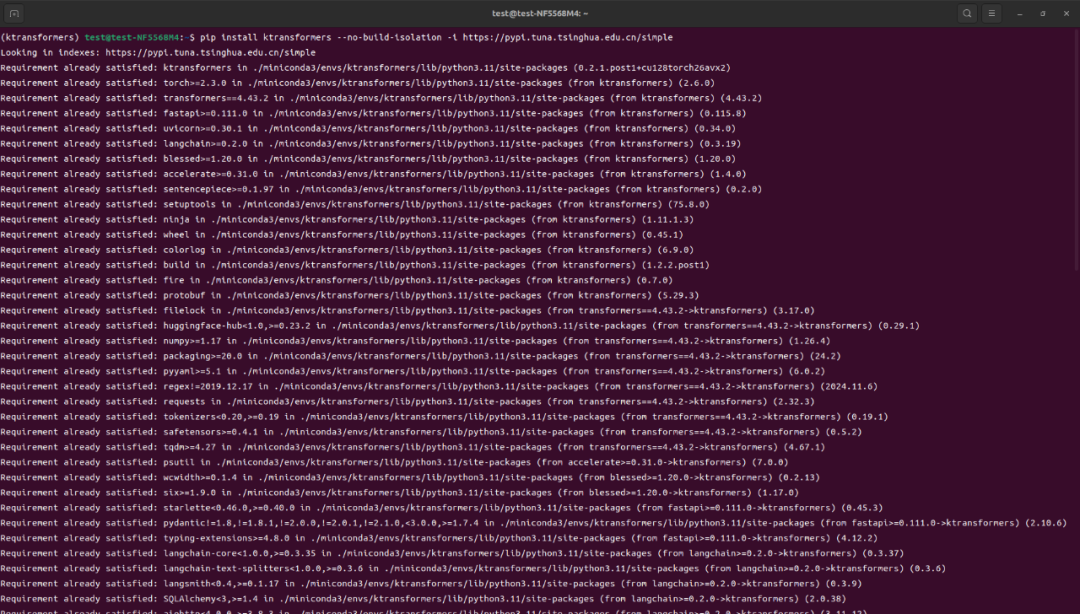

pip install ktransformers --no-build-isolation -ihttps://pypi.tuna.tsinghua.edu.cn/simple

如果使用双插槽 CPU,需设置 `USE_NUMA=1`:

export USE_NUMA=1继续进行编译:

make dev_install四,安装 FlashAttn

下载并安装 flashattn:

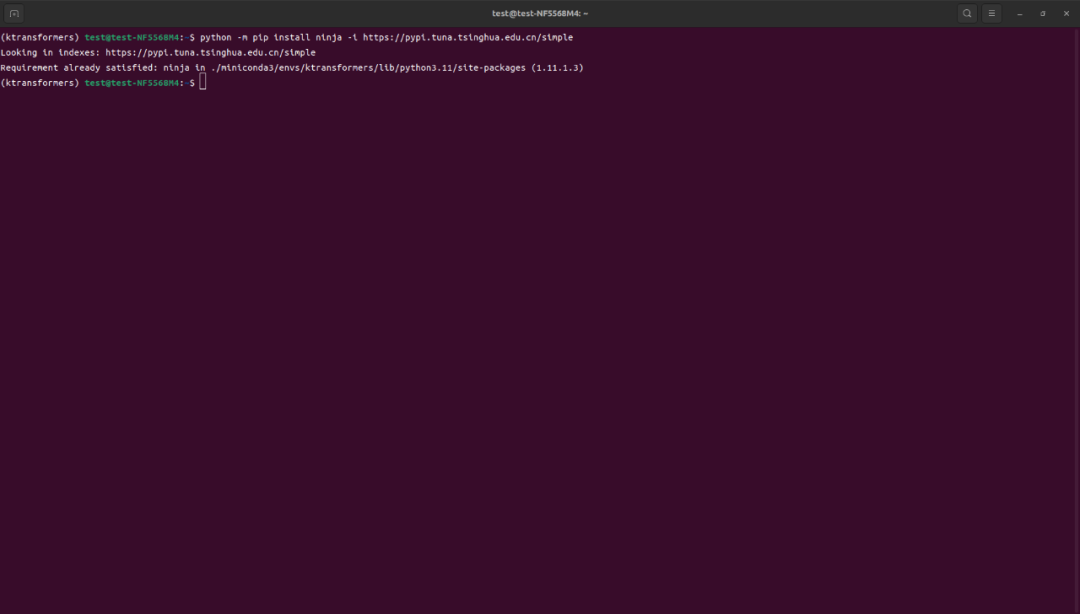

python -m pip install ninja -i https://pypi.tuna.tsinghua.edu.cn/simple

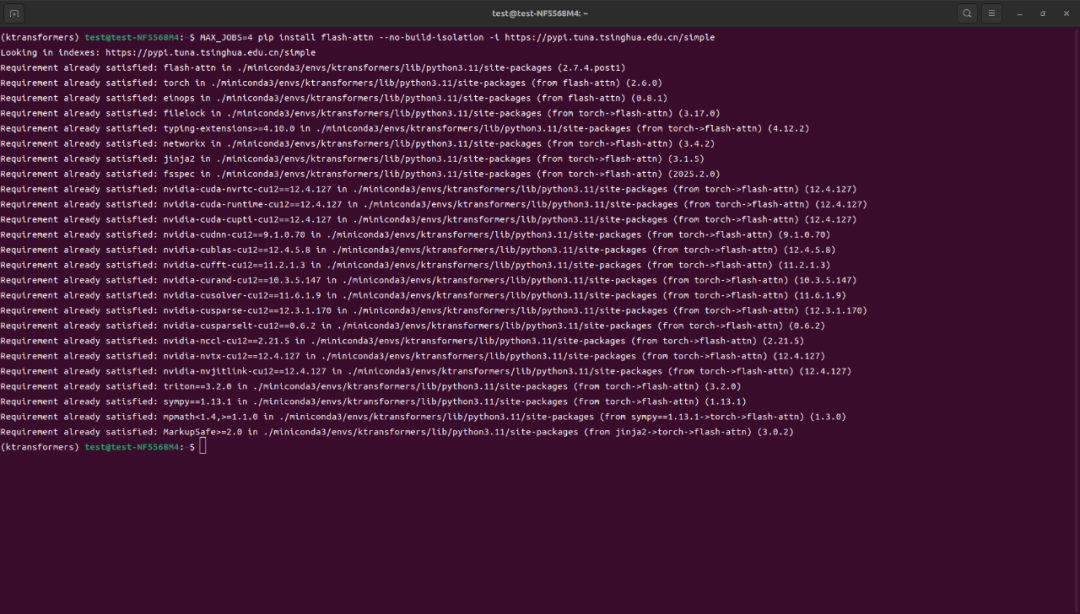

MAX_JOBS=4 pip install flash-attn --no-build-isolation -i https://pypi.tuna.tsinghua.edu.cn/simple💡小提示:首次编译可能会很慢,请耐心等待。

五,模型下载与测试运行

从 Hugging Face 下载模型:

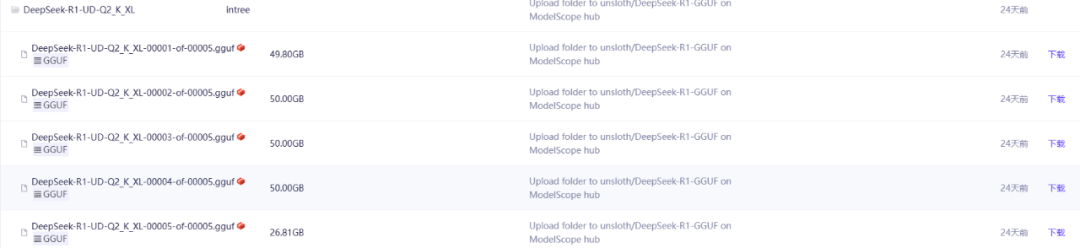

1,下载 DeepSeek-R1-Q2_K_XS 模型文件:

从以下链接下载模型文件:

https://modelscope.cn/models/unsloth/DeepSeek-R1-GGUF

2,将模型文件放置到指定目录,例如 `/data/path/DeepSeek-R1/`。

运行测试脚本:

export HF_ENDPOINT=https://hf-mirror.compython ./ktransformers/local_chat.py --model_pathdeepseek-ai/DeepSeek-R1 --gguf_path /your models path/ --cpu_infer 32

六,总结

恭喜你!通过以上步骤,你已经成功安装并运行了 KTransformers。如果你在安装过程中遇到任何问题,可以随时参考官方文档或社区资源获取帮助。

https://github.com/kvcache-ai/ktransformersKTransformers 是一个强大的工具,它不仅帮助你节省成本,还能让你快速进入 AI 推理优化的世界。如果你觉得这篇文章对你有帮助,别忘了点赞、收藏和分享哦!

👇 关注我们,获取更多 AI 部署和优化的干货内容!👇

如果你有更好的文章,欢迎投稿!

稿件接收邮箱:nami.liu@pasuntech.com

更多精彩内容请关注“算力魔方®”!

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)