10秒钟拥有自己的知识库!DeepSeek + siliconflow + Anything LLM

相信你工作生活了这么多年,肯定手上有很多关于你自己职业工作的一些文档和和工作成果,或者一些沉淀的知识书籍。上传成功后,需要吧 My Documents 中的文件,点击Move to Workspace 移动到我们的当前工作区中。下次想用的时候直接搜索一些相关的想法或者直接输入你想要得到的结果,再也不用一个一个去找资料查找了,专门属于自己的知识库!使用的siliconflow硅基流动的云端API,来

为什么要有自己的知识库?

相信你工作生活了这么多年,肯定手上有很多关于你自己职业工作的一些文档和和工作成果,或者一些沉淀的知识书籍。那你有想过把这些同类型的知识全部做整理归纳蒸馏吗?

下次想用的时候直接搜索一些相关的想法或者直接输入你想要得到的结果,再也不用一个一个去找资料查找了,专门属于自己的知识库!

那么建议你跟着这篇教程,赶紧搭建一套个人知识库,来快速检自己想要的信息。

流的个人知识库软件有 MaxKB,Dify,FastGPT,AnythingLLM。

MaxKB、Dify、FastGPT和Anything LLM都是致力于提升个人和企业智能化水平的工具,它们各有特色,适用于不同的业务场景和开发需求。我们今天使用的是 AnythingLLM。

主流知识库有哪些

四个主流知识库之间的区别和使用场景:

| 维度 | MaxKB | Dify | FastGPT | AnythingLLM |

|---|---|---|---|---|

| 核心功能 | 企业知识库+工作流引擎 | AI应用开发+Agent框架 | 轻量级知识库问答 | 文档聊天机器人+隐私控制 |

| 部署方式 | 开源/私有化 | 开源/云托管 | 云服务/私有化 | Docker/本地/云托管 |

| 模型兼容 | 主流API+自研模型 | 多模型生态(开源/闭源) | 依赖集成模型 | Ollama本地模型+API服务 |

| 数据安全 | 依赖部署环境 | 依赖部署环境 | 依赖部署环境 | 本地存储+离线运行 |

| 开发门槛 | 中(需配置工作流) | 高(需熟悉AI开发) | 低(可视化操作) | 中(需配置模型/数据库) |

| 典型场景 | 企业内网知识查询 | 自动化客服/内容生成 | 电商FAQ/技术支持 | 法律文档/医疗记录问答 |

前置条件

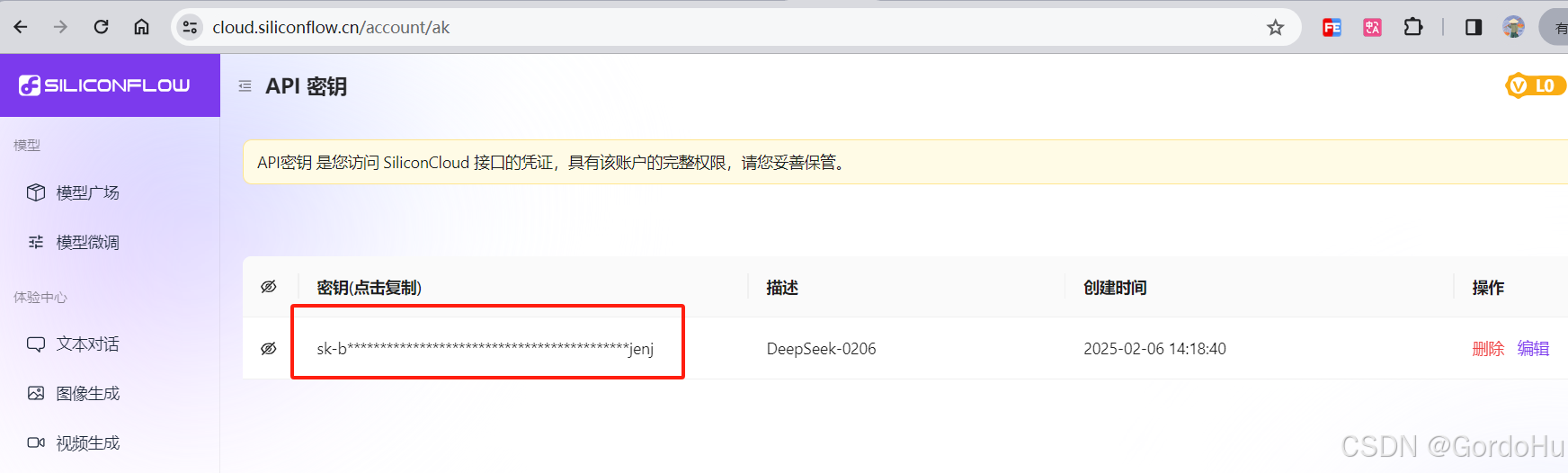

1:需要先注册硅基流动获取自己的DeepSeek-R1的 API之前有说过(硅基流动注册和API获取)

使用的siliconflow硅基流动的云端API,来做我们的自然语言处理大模型的调用。

💡使用链接注册可或者2000万tokens:https://cloud.siliconflow.cn/i/2VC6bioj

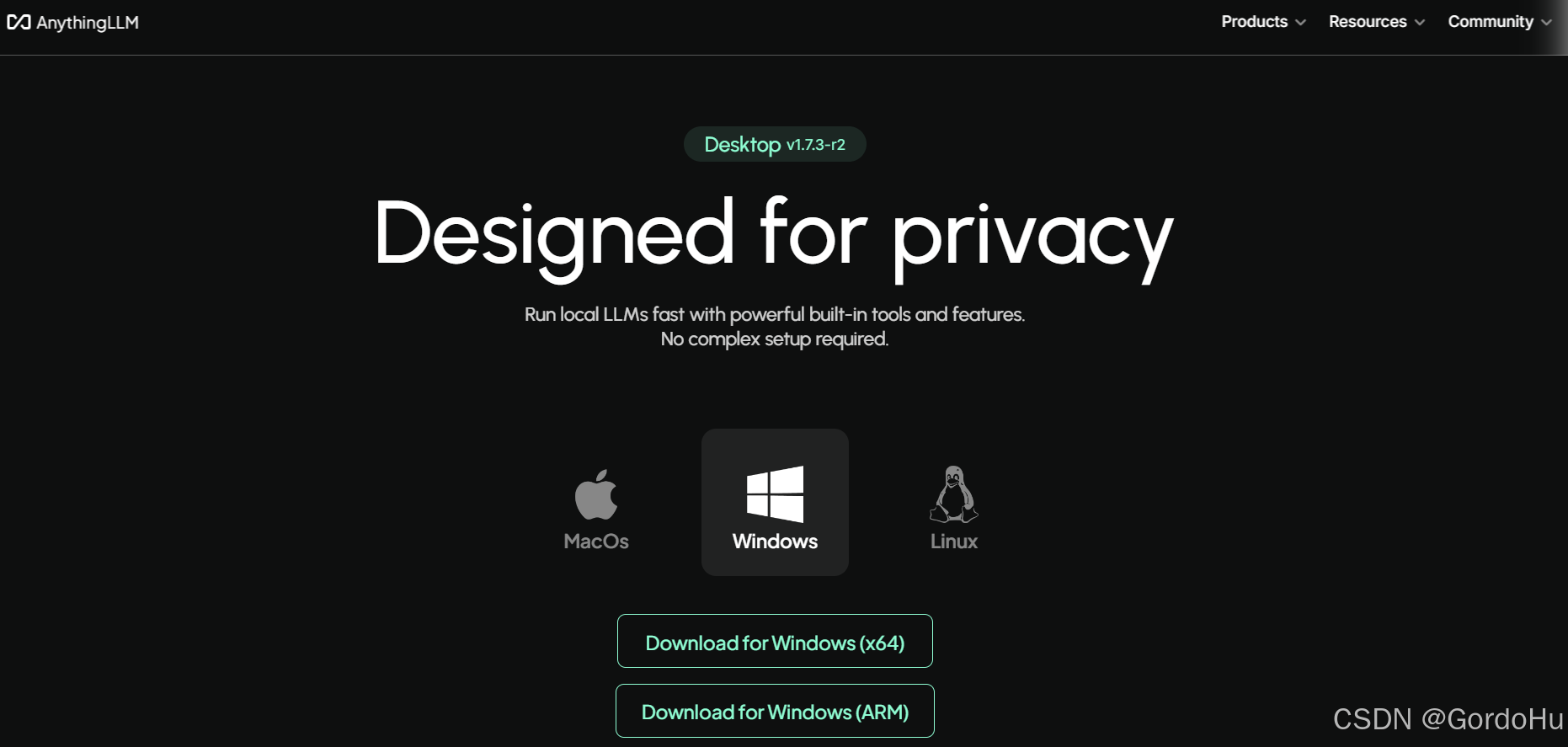

2:下载安装Anything LLM 地址:https://anythingllm.com

Anything LLM 安装步骤如下:选择合适自己的系统下载

傻瓜式一键安装后,如下界面:点击 Get started

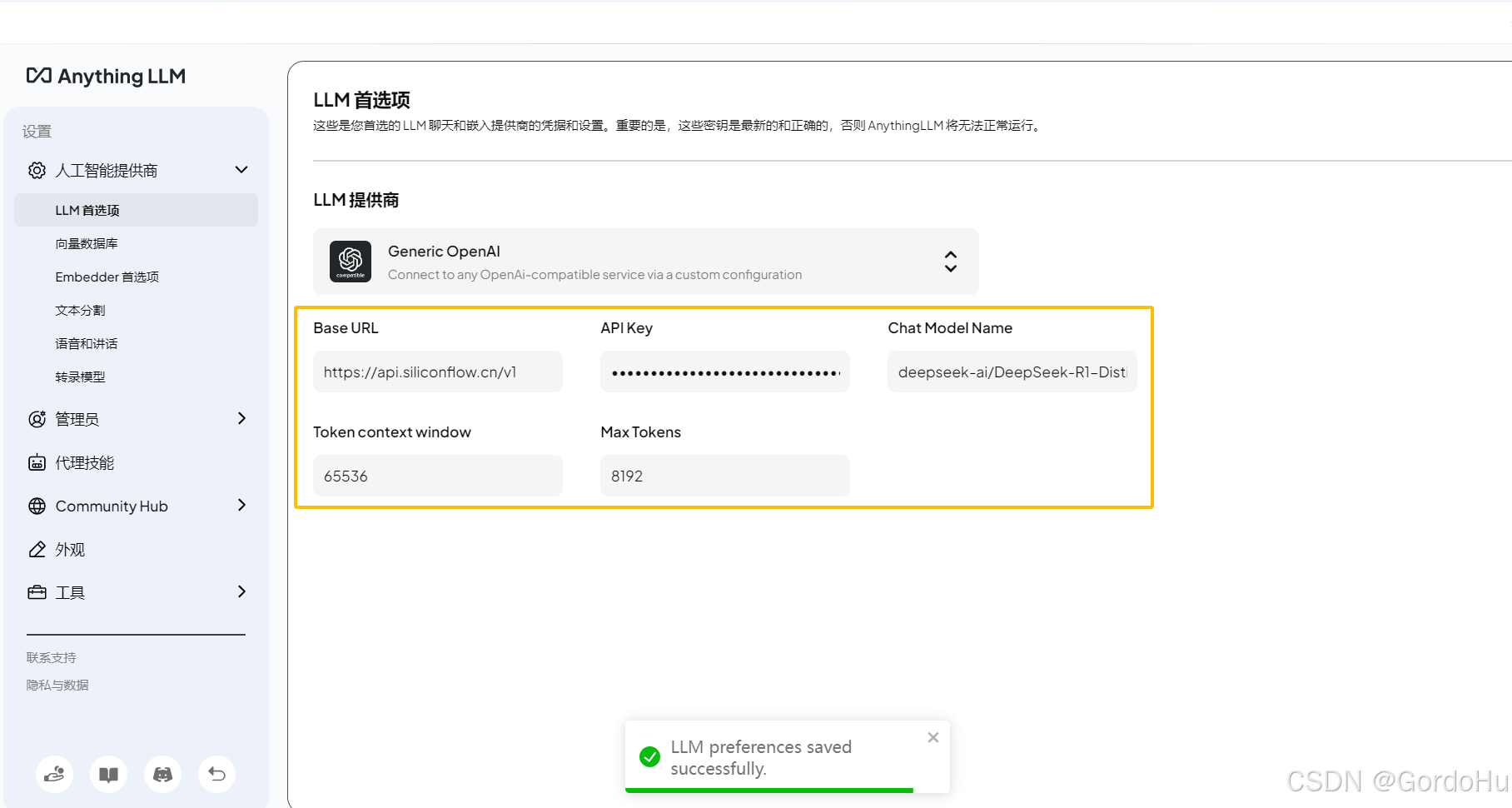

在 LLM Preference 中,根据自己的需求配置大语言模型。

以 siliconflow 硅基流动中获取DeepSeek-R1的模型为例,下图是硅基流动中的秘钥。

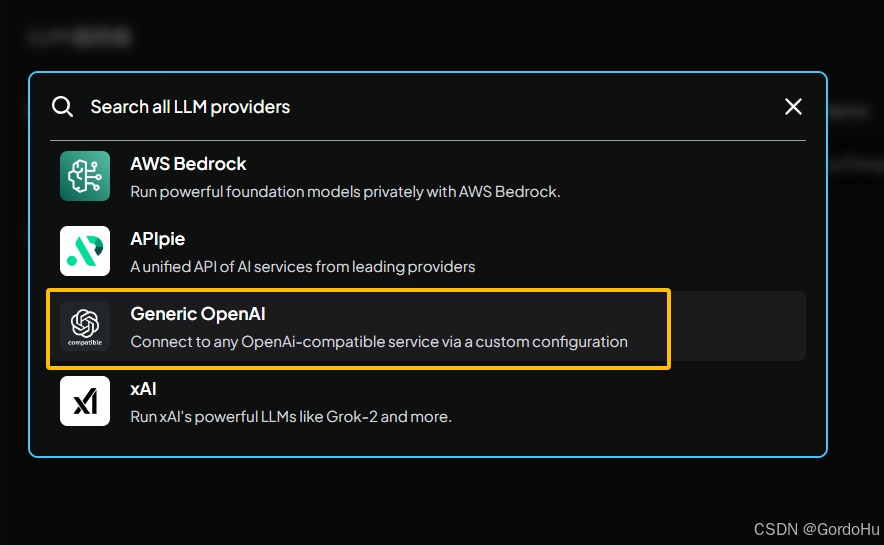

选择 Generic OpenAI 通用AI

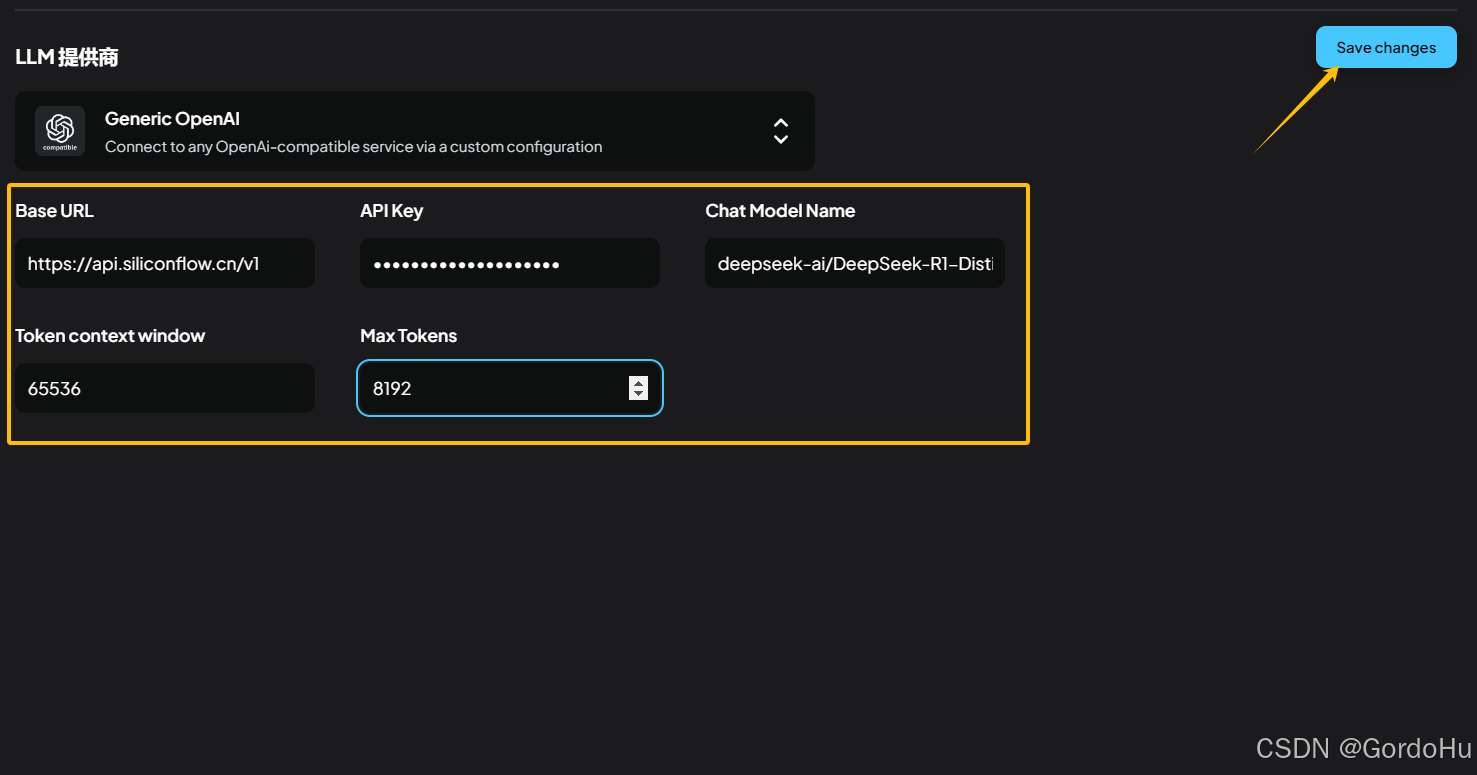

复制 key 粘贴到下图的 API key 输入框中。

Base URL:https://api.siliconflow.cn/v1

Chat Model Name:想要使用的模型的名称:deepseek-ai/DeepSeek-R1

Token context window:令牌上下文窗口容量 上下文长度最大为 64k,所以这里直接写 65536

Max Tokens:查看硅基流动文档知,deepseek-ai/DeepSeek-R1 最大 token 为 8192。

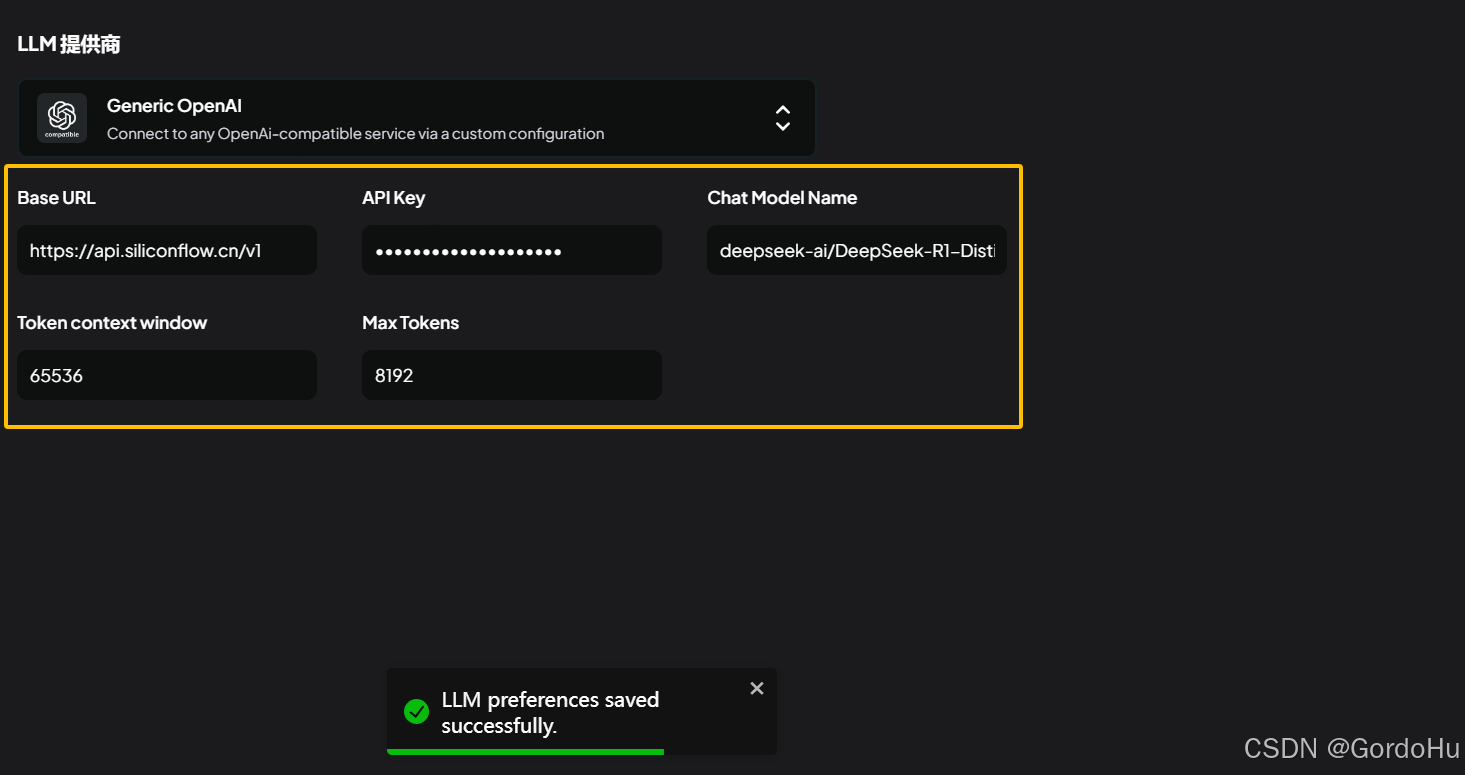

点击 Save changes,保存。

到此为止,DeepSeek-R1的API已经和Anything LLM 集成了。可以进行对话使用了。

然后配置工作区名称,点击下一步完成配置。

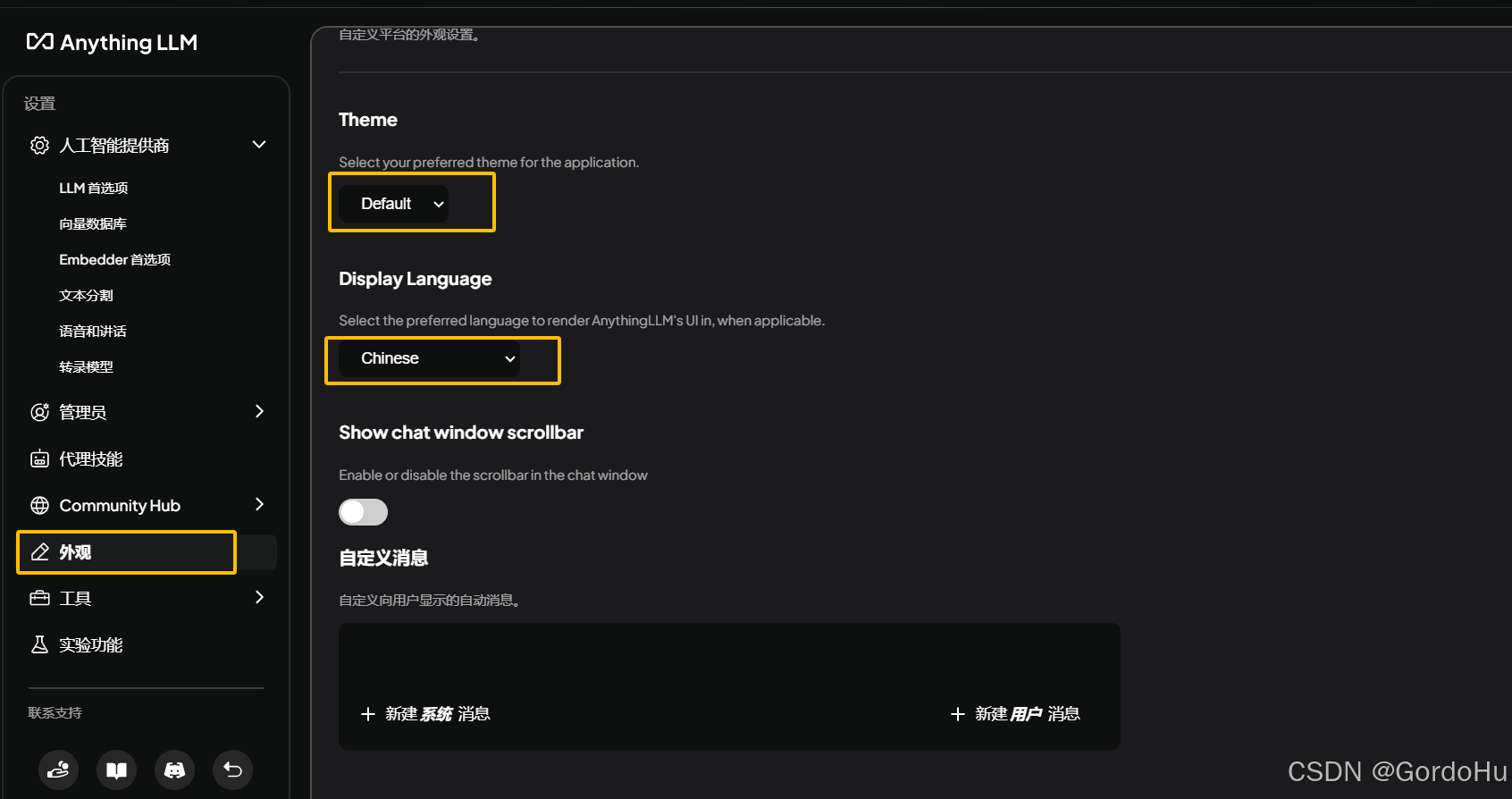

进入主页面后,我们再进行一些通用设置,如修改主题色,修改展示语言为中文。

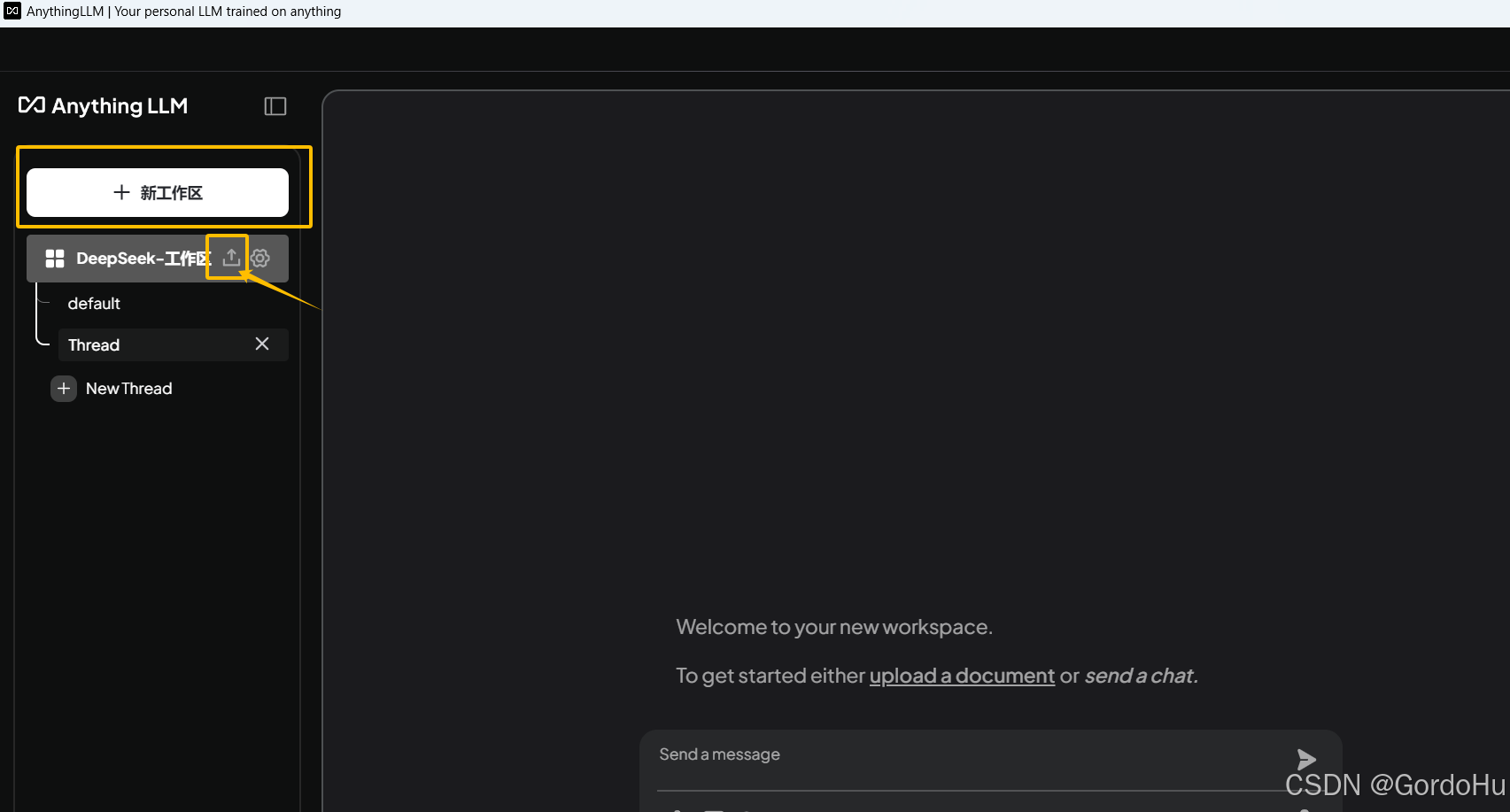

下面就是新建自己的工作区,点击上传按钮,为该工作区上传知识库。

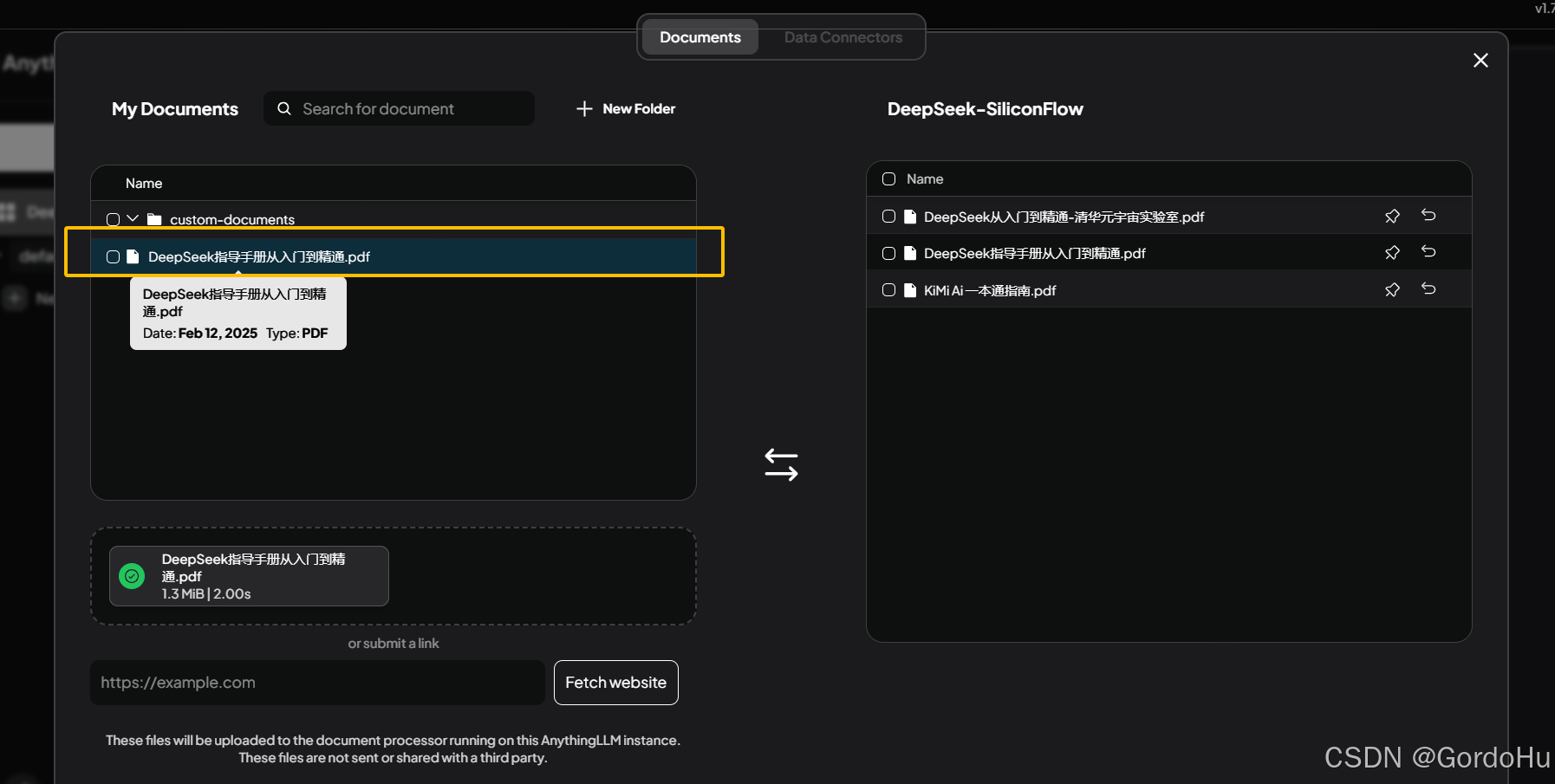

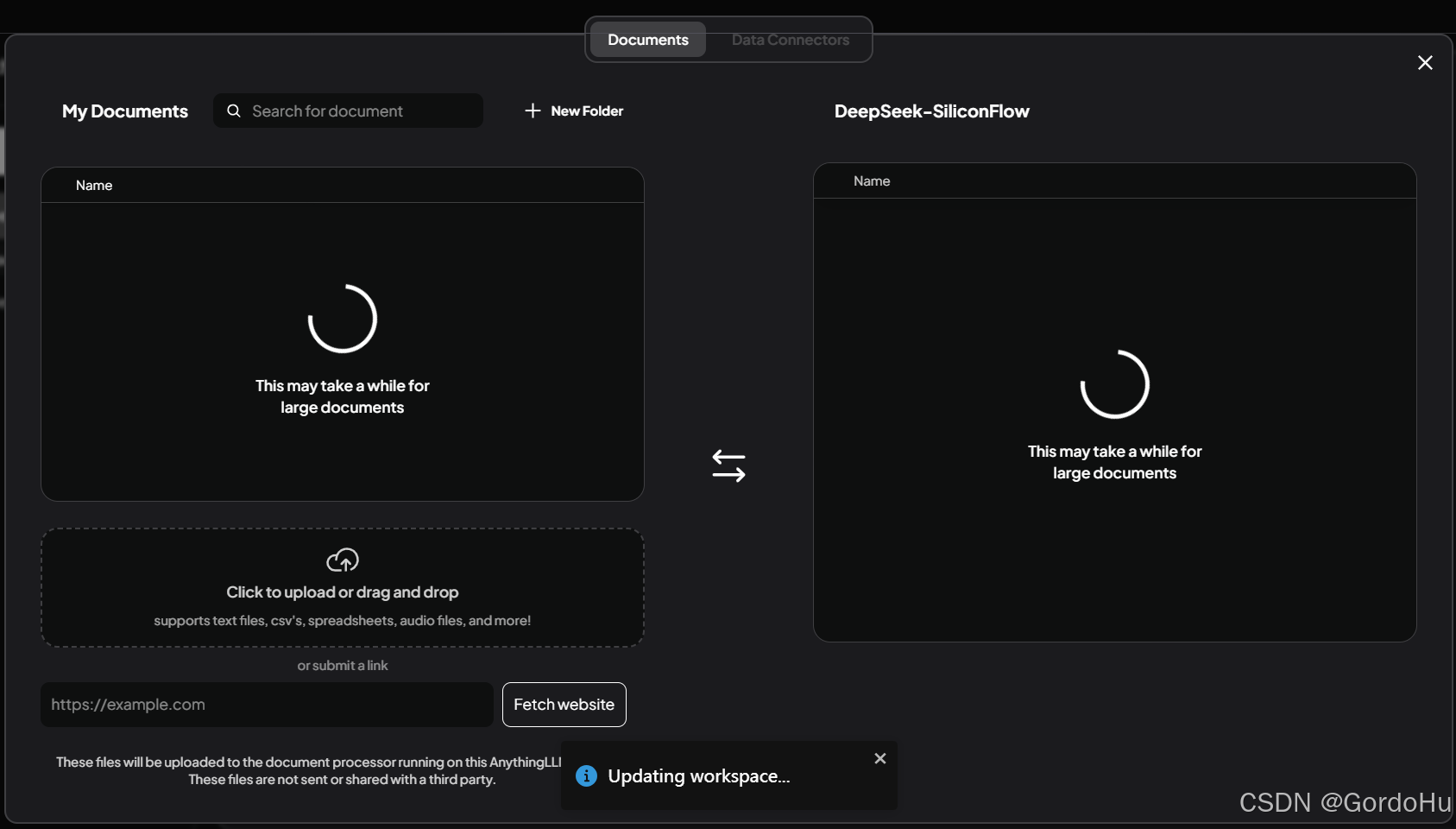

点击Click to upload or drag and drop 上传非结构性的知识文件,这里举几个例子。

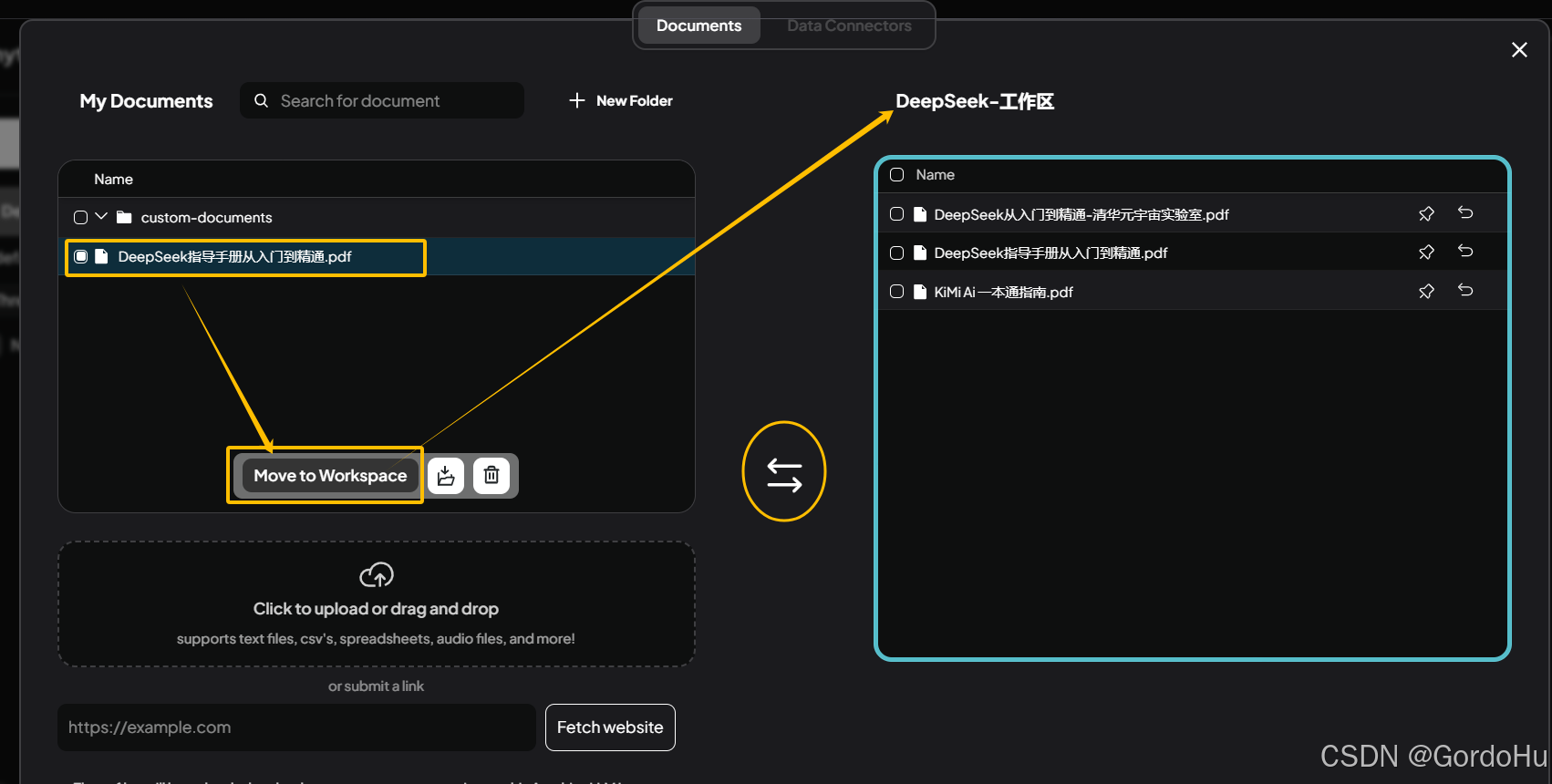

上传成功后,需要吧 My Documents 中的文件,点击Move to Workspace 移动到我们的当前工作区中。

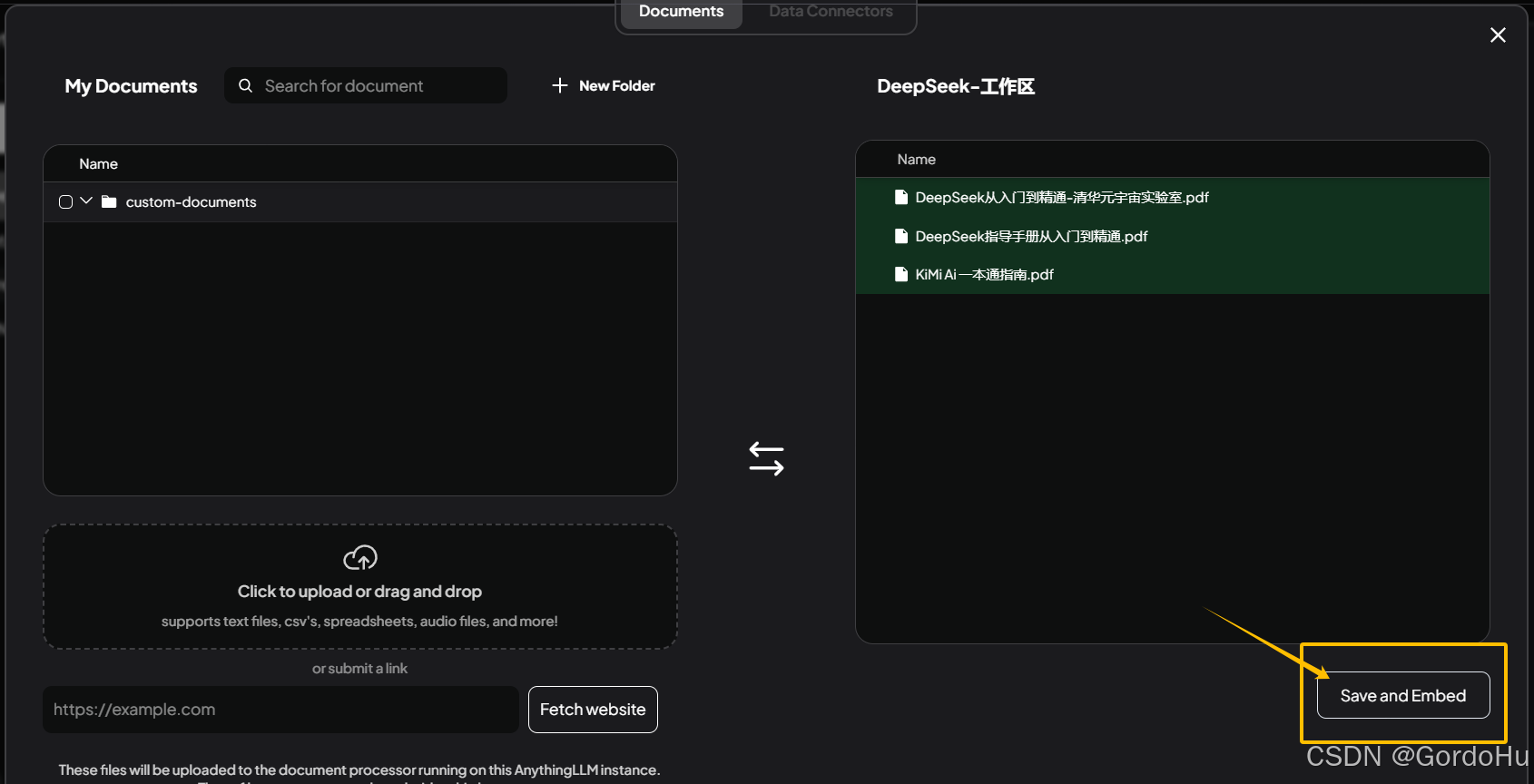

点击 Save and Embed,等待数据向量化完成

文件的大小会影响非结构性量化的时间,耐心等待一下。

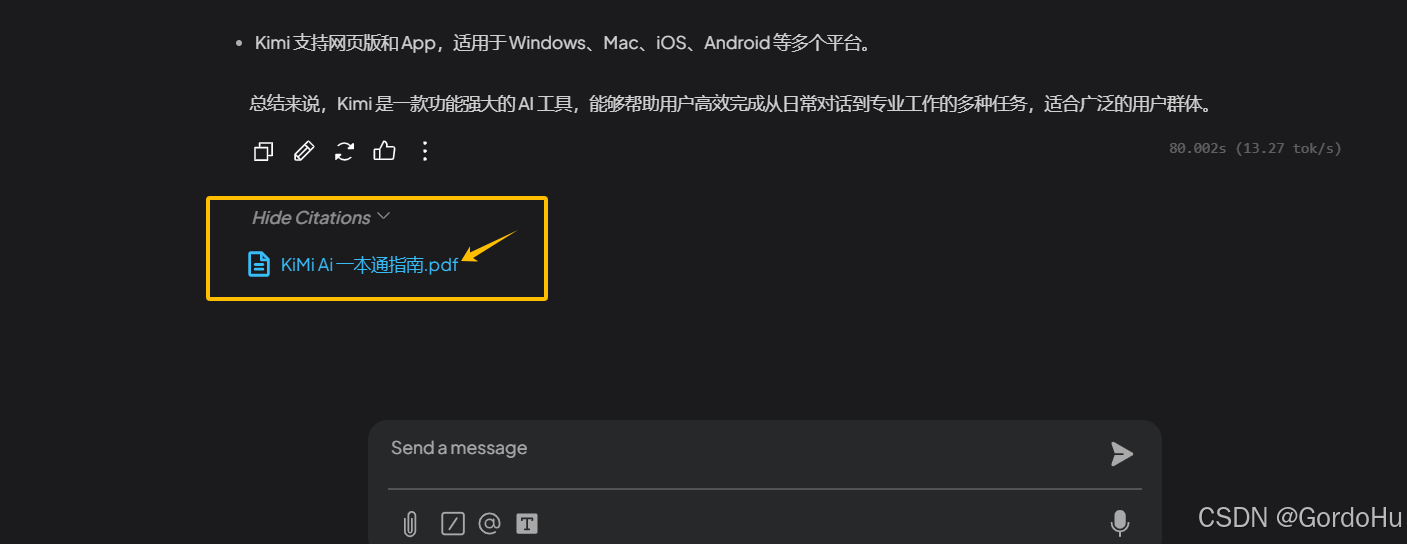

这里成功后可以做一下测试,看一下是相关知识是否是从我们上传的文件中获取总结得到的。

回答的末尾还会显示引用来源。

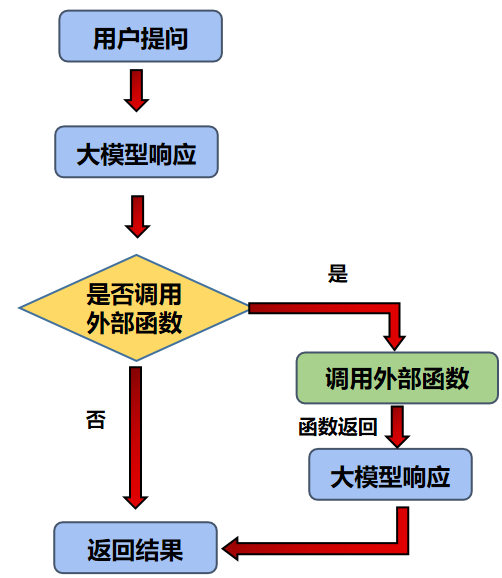

还有其他功能,大家自己研究一下,主要可以用来做很多事情。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)