从零开始到成功:如何在本地部署DeepSeek R1并集成Chatbox智能对话界面

Deepseek R1 是⽀持复杂推理、多模态处理、技术⽂档⽣成的⾼性能通⽤⼤语⾔模型。本文将详细介绍如何在本地环境中部署 DeepSeek R1 模型。以上就是本地部署DeepSeek+Chatbox智能对话界面的教程,整体分三步走:第一步:下载大语言模型工具 Ollama第二步:通过Ollama运行DeepSeek R1第三步:搭建智能对话界面,连接自己的私有模型。本地部署 可靠,没有网络延迟

从零开始到成功:如何在本地部署DeepSeek R1并集成Chatbox智能对话界面

文章目录

前言

Deepseek R1 是⽀持复杂推理、多模态处理、技术⽂档⽣成的⾼性能通⽤⼤语⾔模型。本文将详细介绍如何在本地环境中部署 DeepSeek R1 模型。

一、前提条件

在开始之前,请确保您的系统满足以下要求:

- 操作系统:建议使用最新版本的 Windows、macOS 或 Linux。

- 网络连接:需要稳定的互联网连接以下载模型文件。官网下载Ollama需要魔法,不过本教程已经准备好安装包,开箱即用。

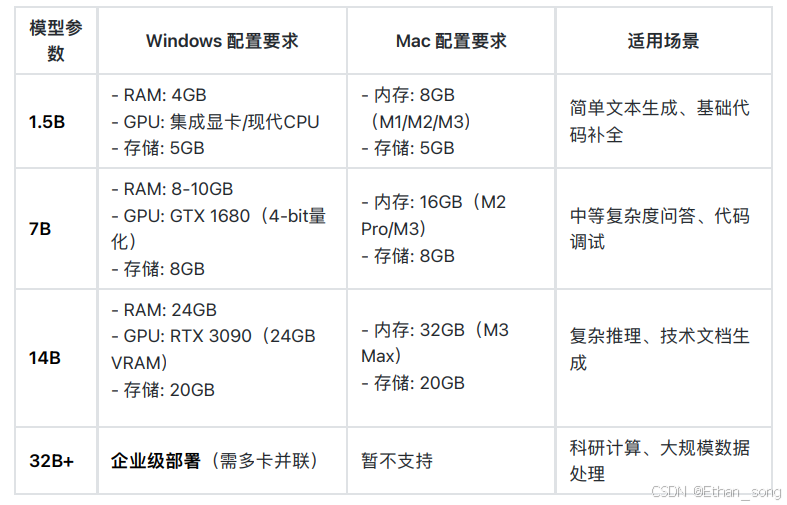

- 硬件要求:根据您选择的模型版本,硬件要求会有所不同。例如,DeepSeek R1 的 8B 参数版本需要至少 8GB 的显存。请根据所选模型版本调整您的硬件配置。

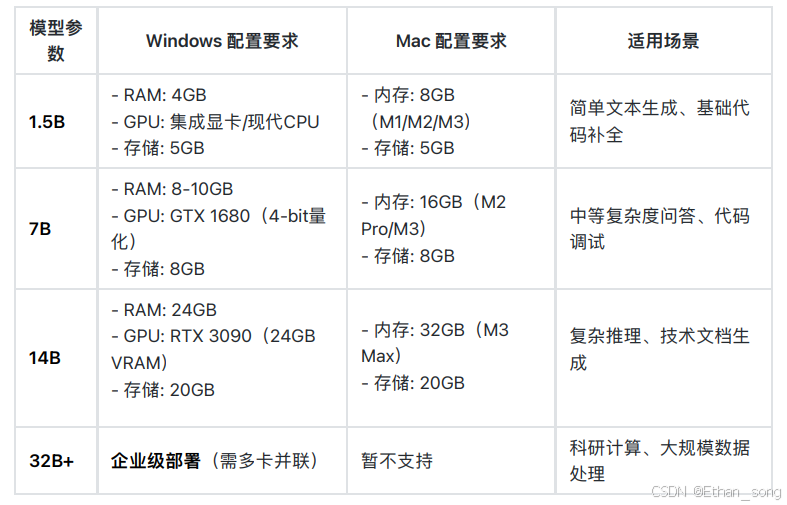

- 电脑配置与模型参数对照表

二、保姆级安装步骤

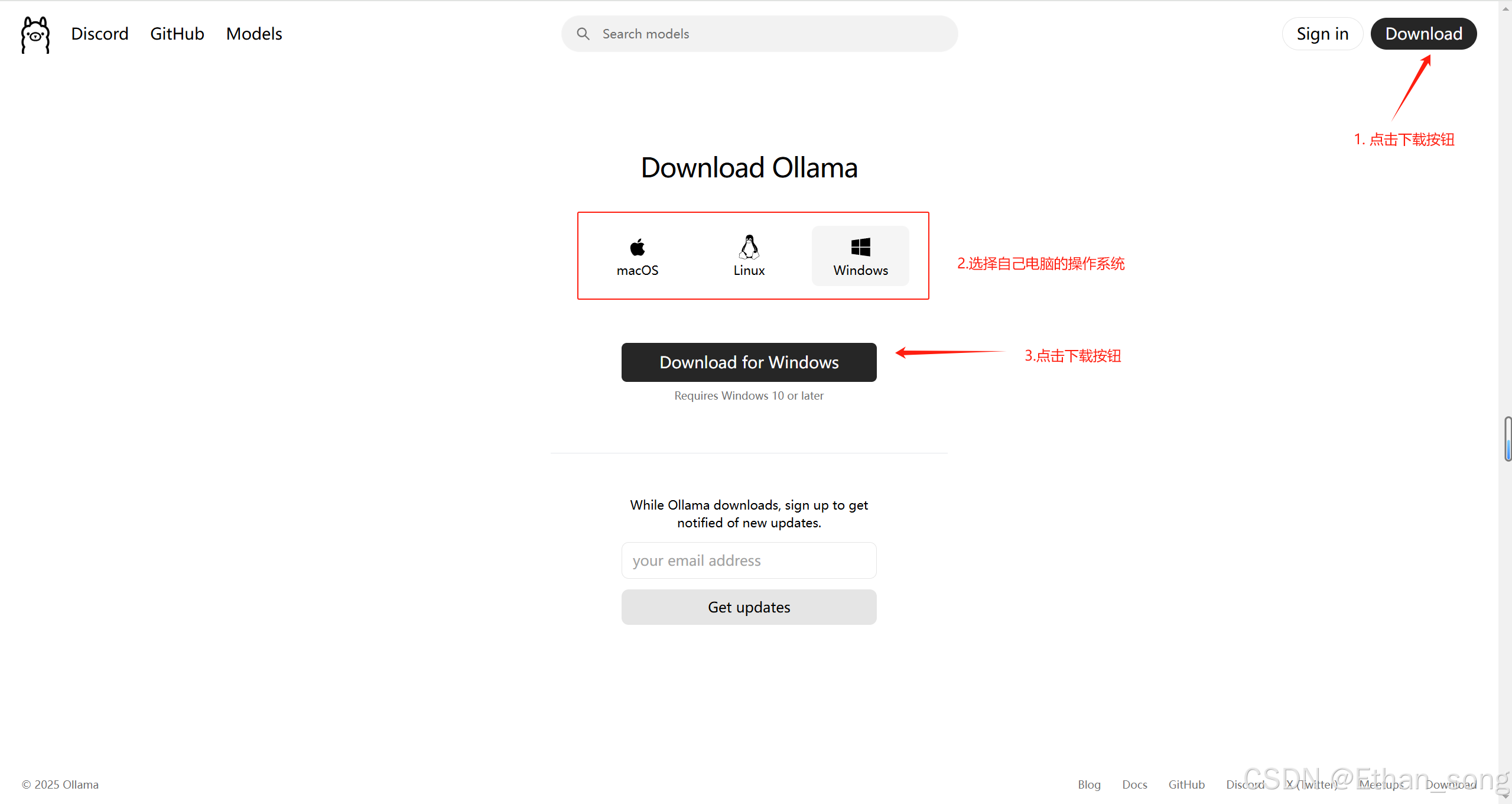

1.下载运行大型语言模型的工具 Ollama

- 访问 Ollama 官方网站 https://ollama.com/

注意:此步骤需要魔法上网,嫌麻烦的朋友,可以直接下载,我这里已经准备好了。

- 阿里云盘提取

链接: https://www.alipan.com/s/BuByQQEesFL

提取码: a10d- 夸克网盘提取

链接:https://pan.quark.cn/s/fe2817c36fb7

提取码:JkVG

操作图示

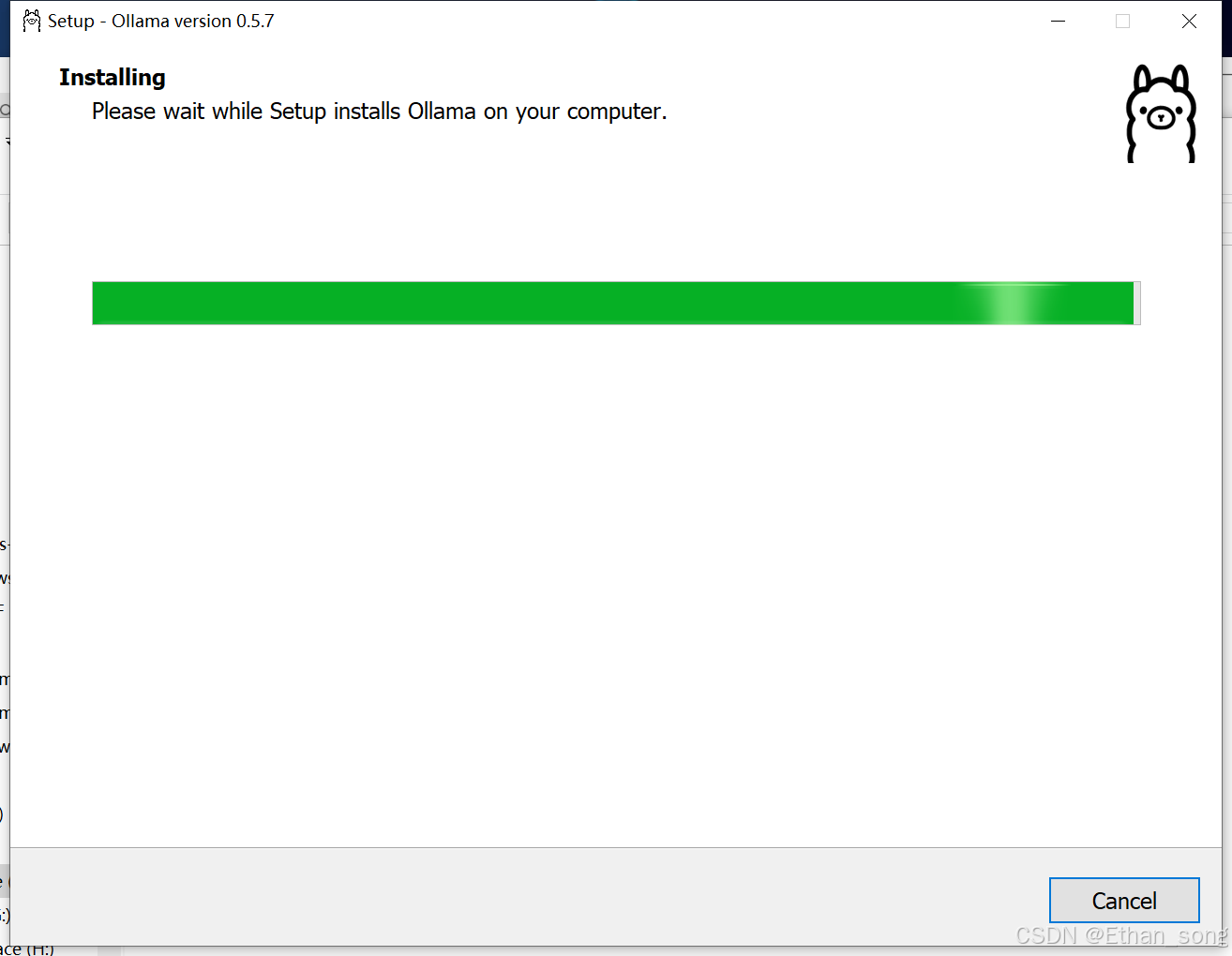

- 下载好后,安装Ollama

- 双击OllamaSetup.exe安装 默认安装路径是C盘 其默认安装路径为C:\Users\XX\AppData\Local\Programs\Ollama,

XX为你的电脑登录用户名 - 安装完成显示此界面

- 双击OllamaSetup.exe安装 默认安装路径是C盘 其默认安装路径为C:\Users\XX\AppData\Local\Programs\Ollama,

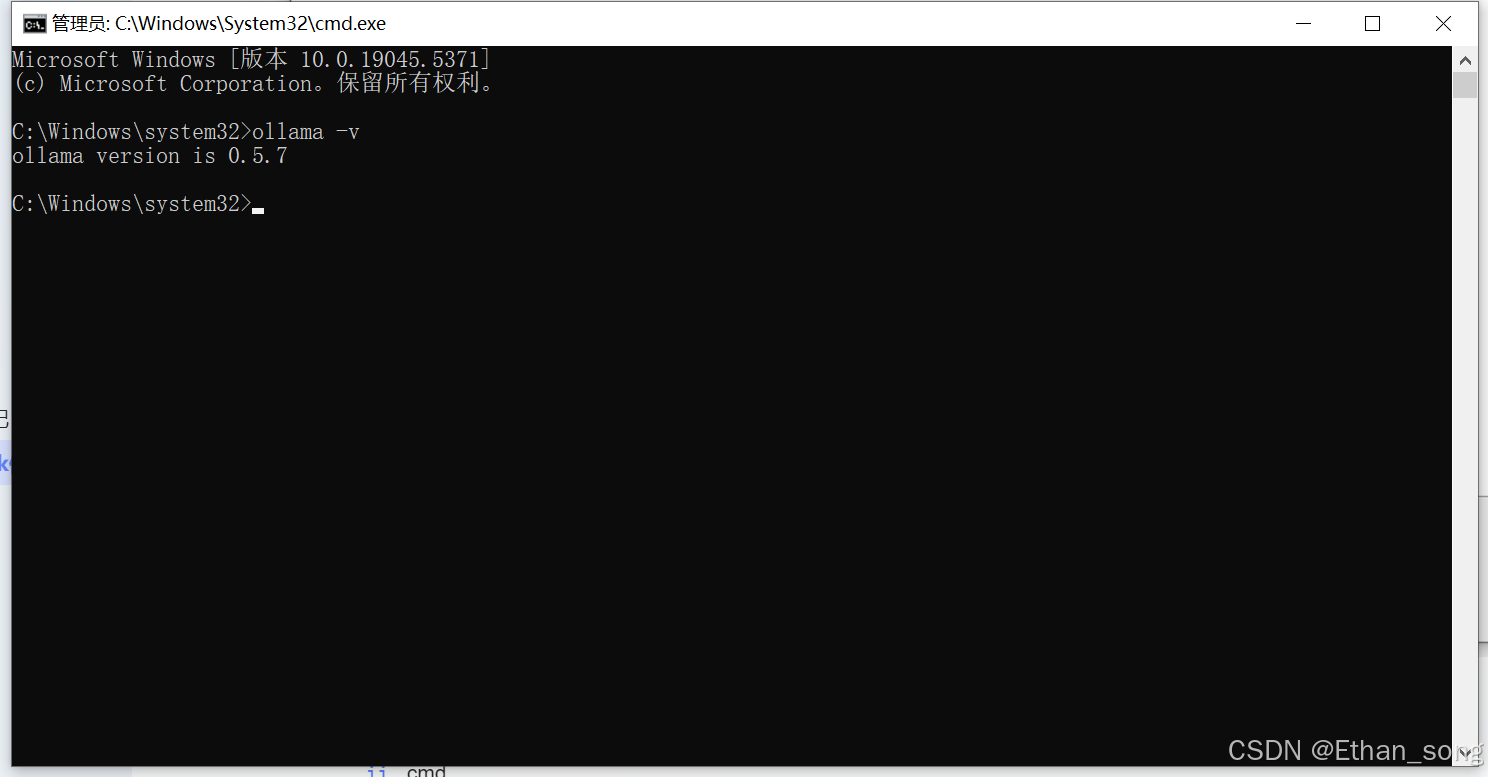

- d.验证 Ollama安装是否成功

- Win+R

- 输入cmd 调出终端

- 输入代码

ollama -v

- 成功安装将显示版本号.

操作图示

可选操作如果需要修改Ollama所在磁盘,进行以下操作:- 将C:\Users\XX\AppData\Local\Programs\Ollama这个文件夹拷贝到D盘,例如移动后的文件夹为D:\Program\Ollama。

- 同时,将模型文件所在的目录C:\Users\XX.ollama也移动到D盘,例如改为D:\Program\Ollama.ollama。

- 修改环境变量,使得Ollama能够正确找到新的安装位置

- 重启电脑

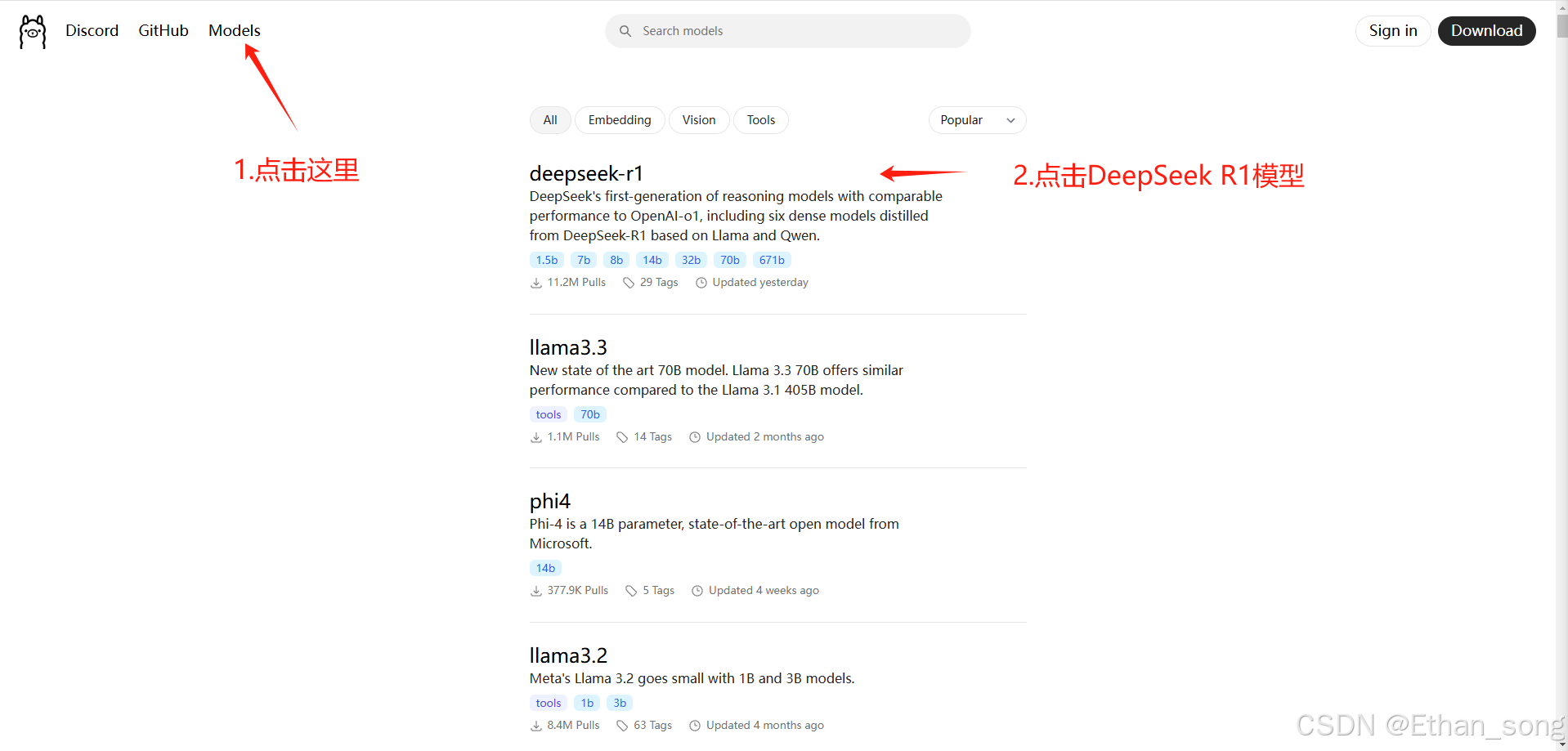

2.选择你要安装的大模型 DeepSeek R1

可以在Ollama的官网选择支持的大模型进行下载. 网址: https://ollama.com/search

我们以DeepSeek R1为例: 这里选择模型参数, 参数越大,越吃电脑配置,根据自己的电脑配置进行选择,这里整理出配置对照表

这里选择模型参数, 参数越大,越吃电脑配置,根据自己的电脑配置进行选择,这里整理出配置对照表

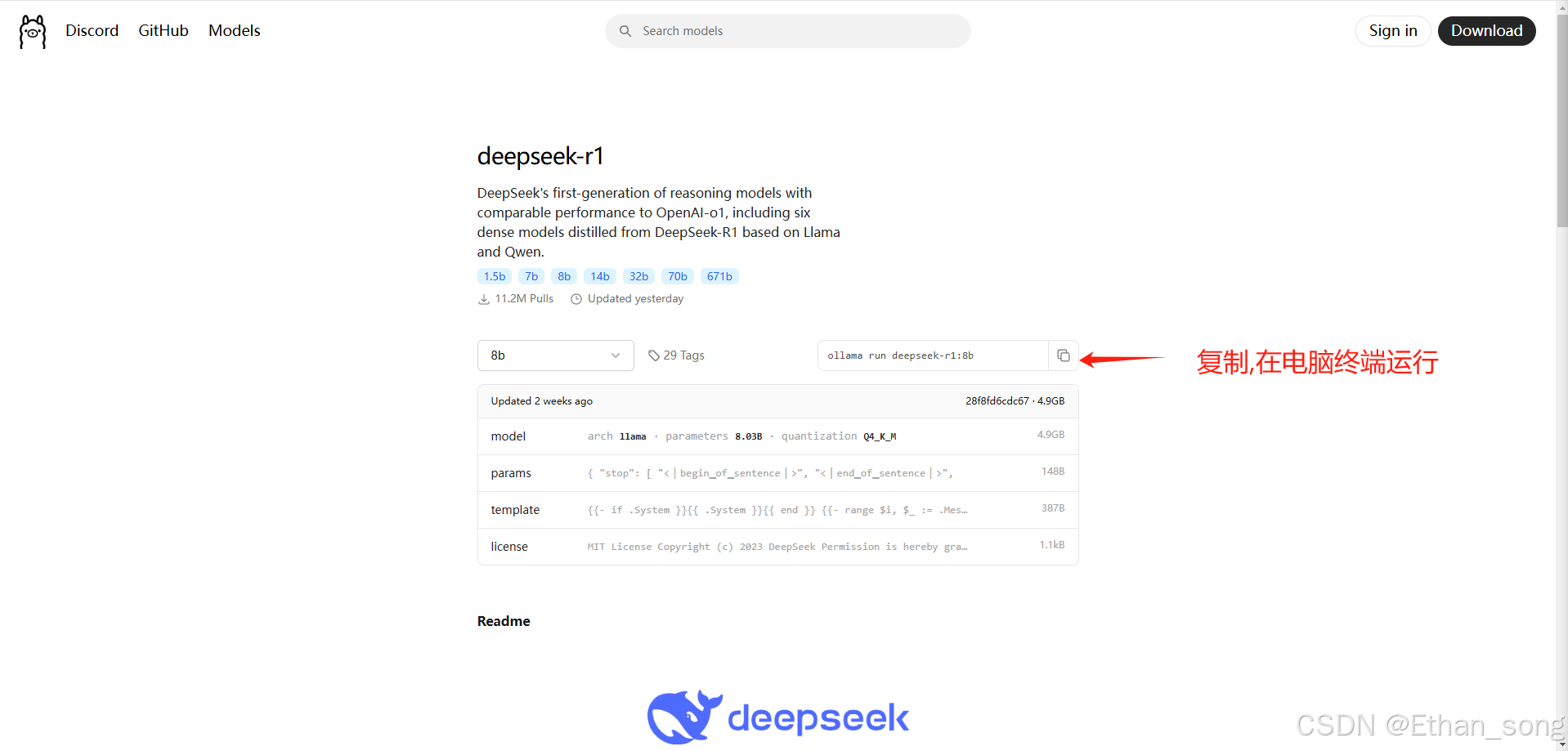

复制命令进行安装DeepSeek R1模型,我这里使用的是 8b参数模型

在终端输入

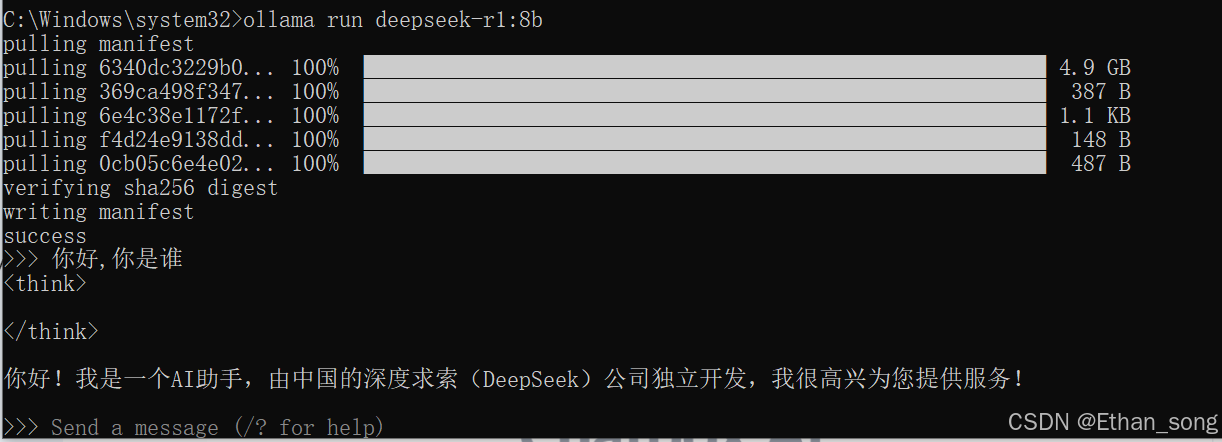

ollama run deepseek-r1:8b

此时ollama 开始安装大模型

操作图示

安装成功! 此时,您可以在终端与模型进行交互,输入您的问题或任务,模型将提供相应的响应!

3.高级用法:使用 Chatbox 进行页面交互

终端不好看,我们需要一个美观的页面进行使用。

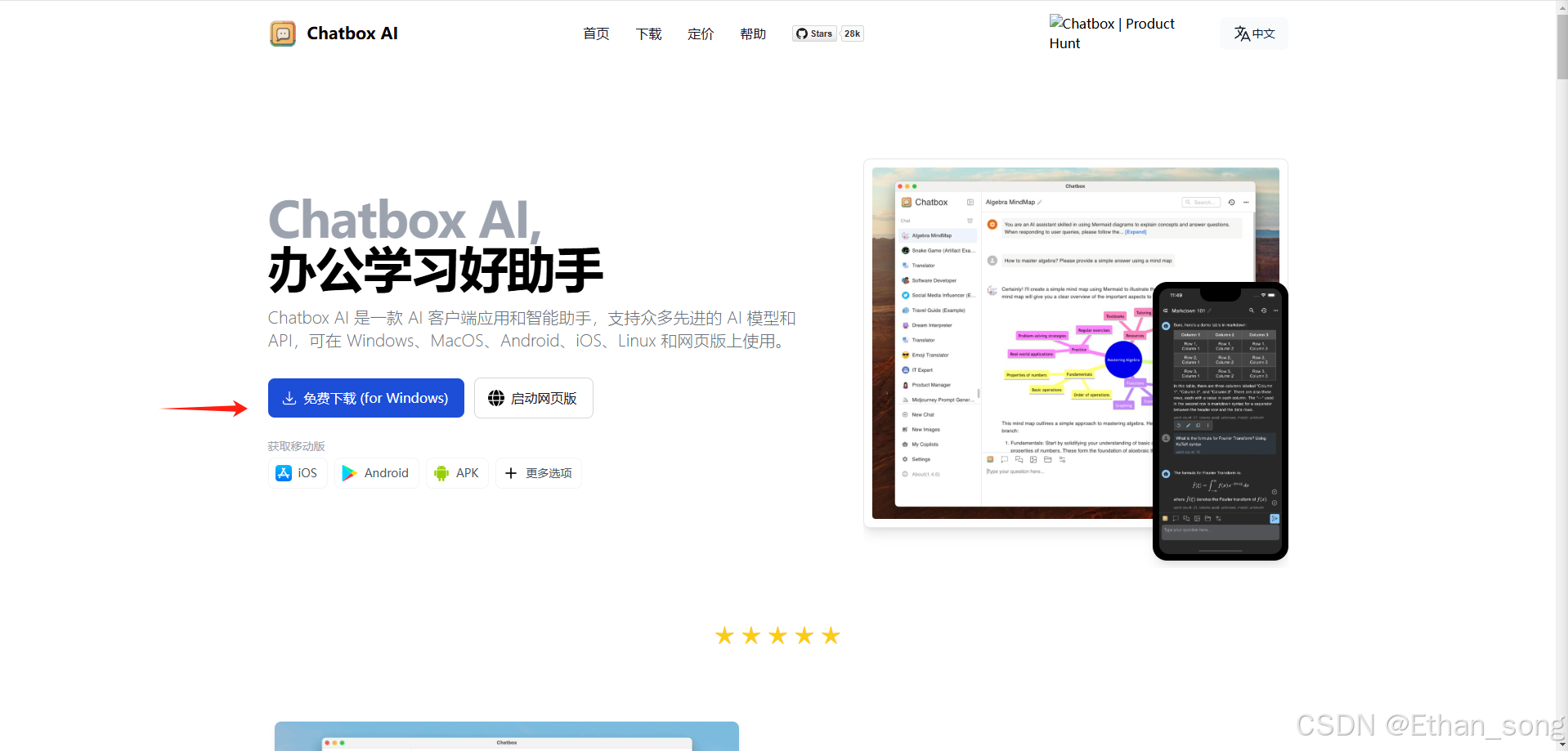

- 下载 Chatbox 访问 https://chatboxai.app/ 下载适用于您操作系统的版本。

- 安装Chatbox,双击Chatbox-1.9.8-Setup.exe

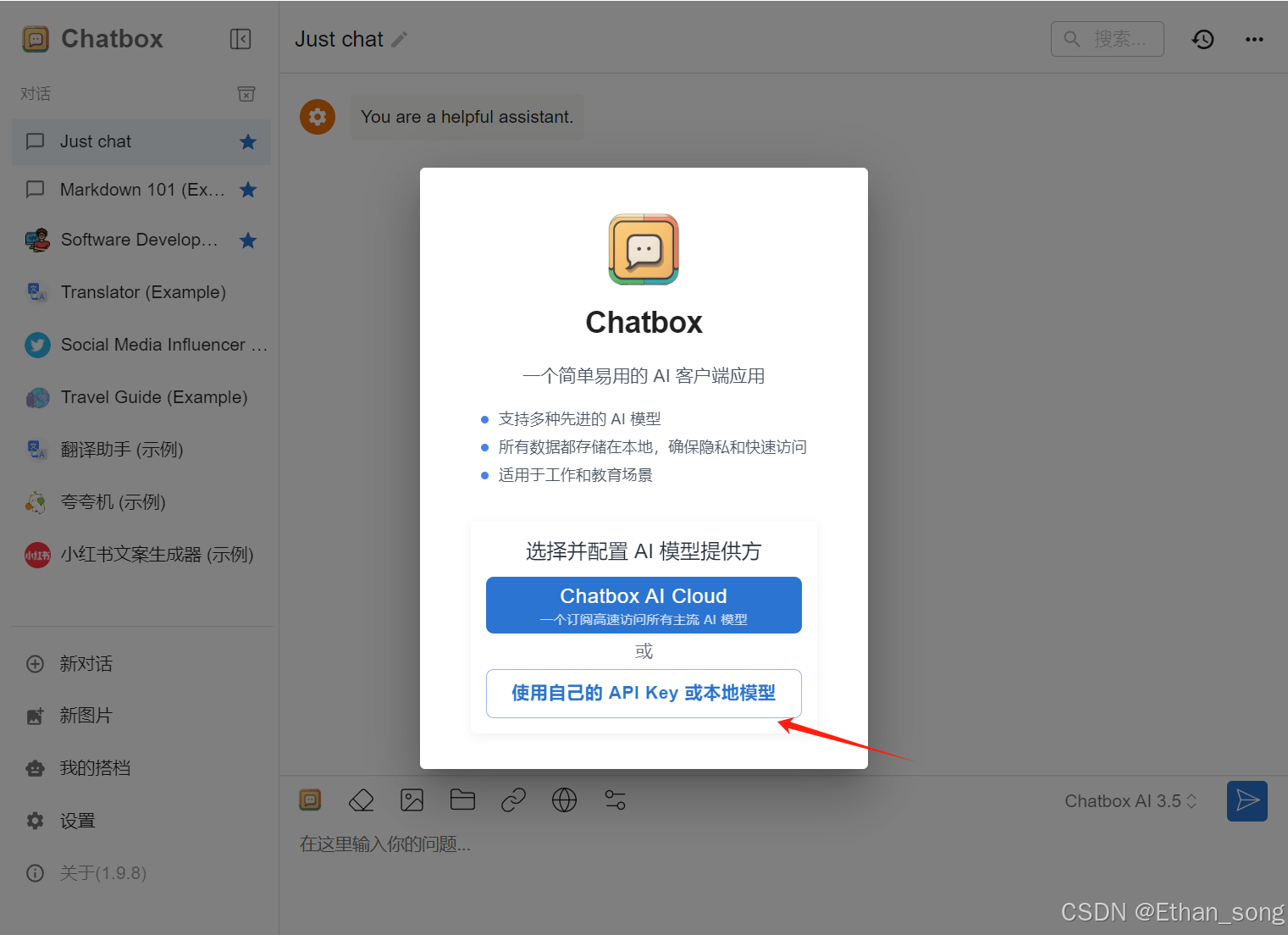

- 安装完成后进入程序,选择自己的DeepSeek R1模型

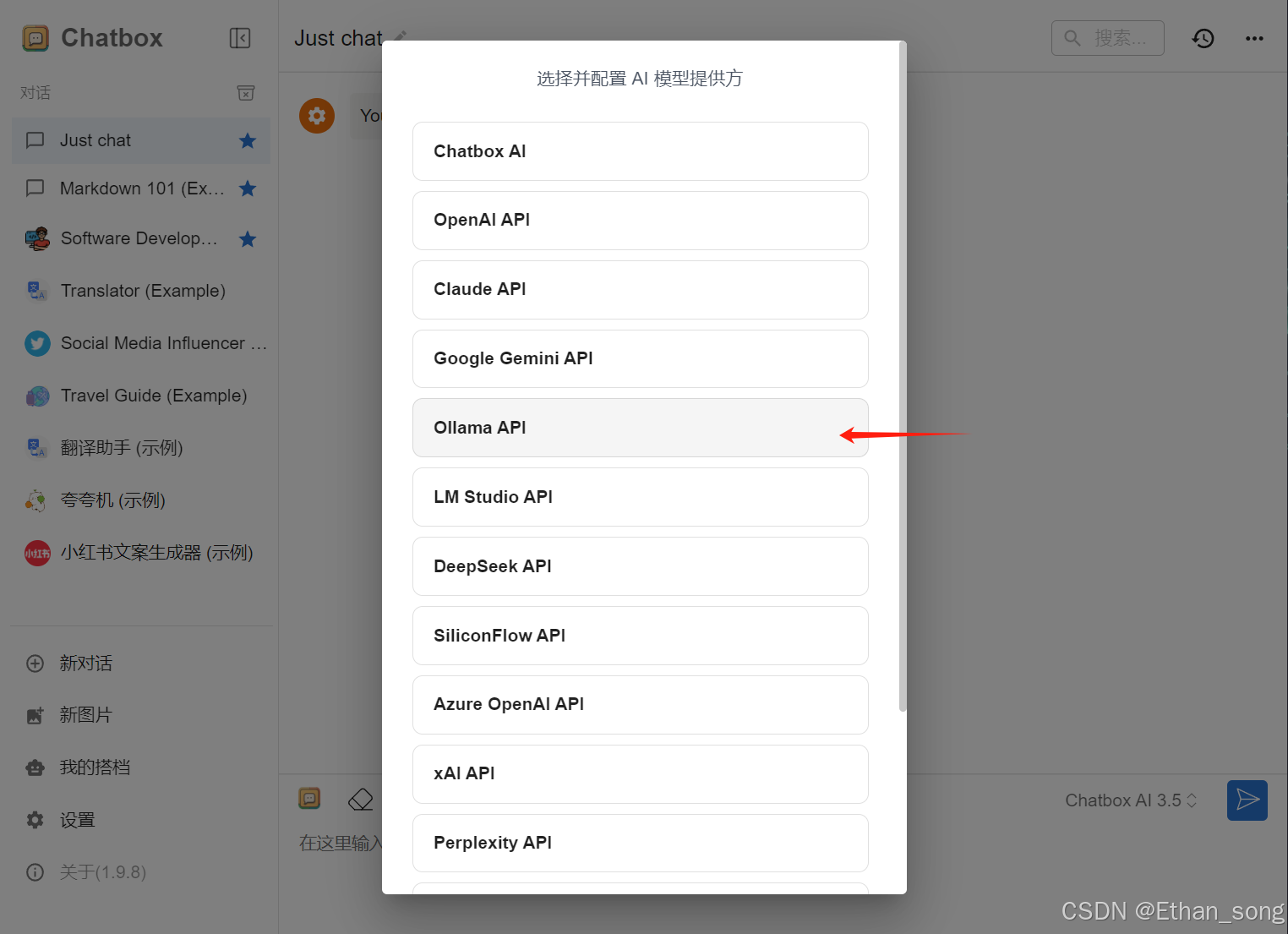

- 因为我们通过Ollama部署,所以选择Ollama API

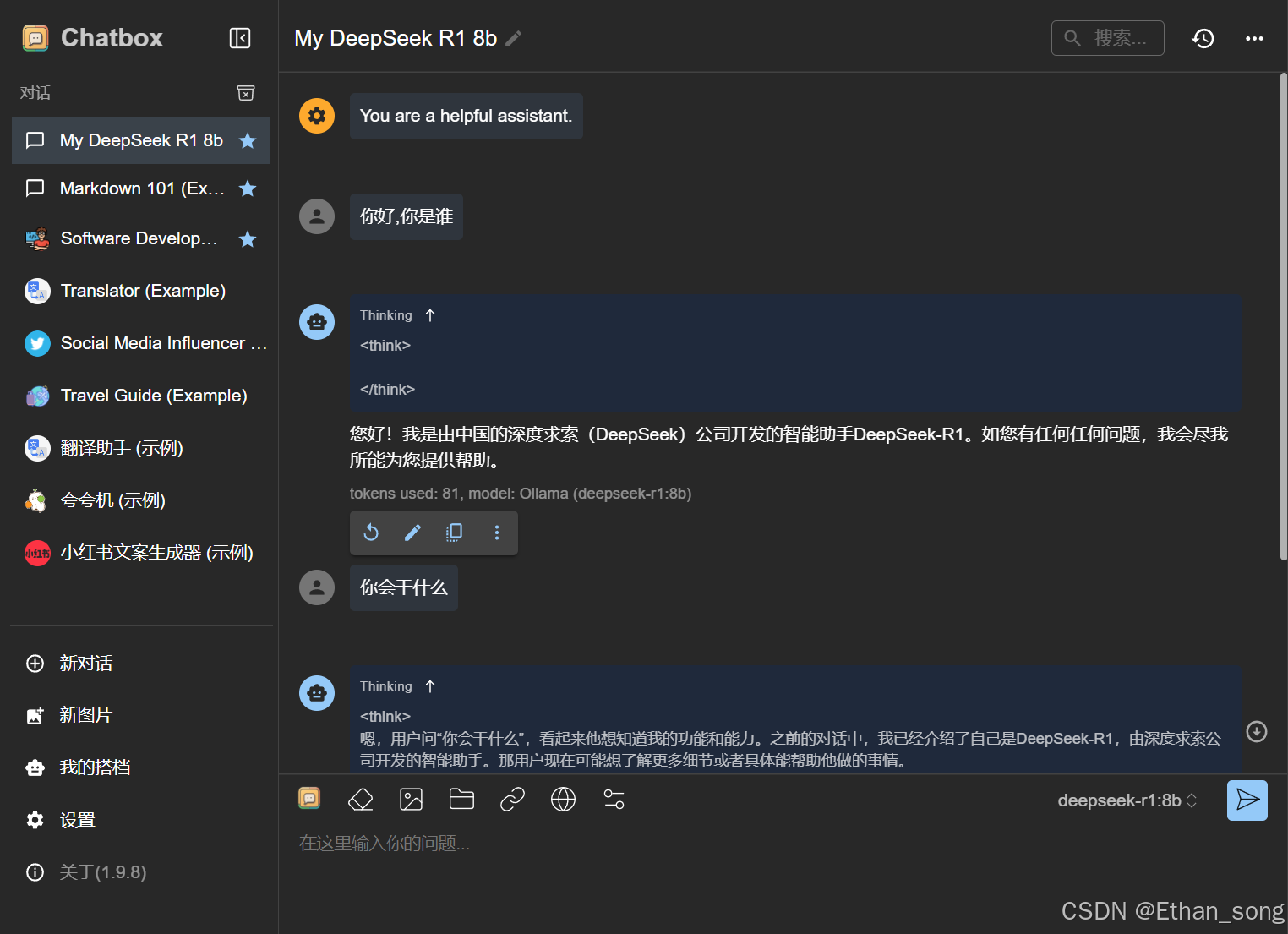

API域名无需修改,模型选择自己安装的模型,依照图示即可 点击保存, 此时,前端界面就搭建完成了! 让我们试试看!

点击保存, 此时,前端界面就搭建完成了! 让我们试试看!

总结

以上就是本地部署DeepSeek+Chatbox智能对话界面的教程,整体分三步走:

第一步:下载大语言模型工具 Ollama

第二步:通过Ollama运行DeepSeek R1

第三步:搭建智能对话界面,连接自己的私有模型。

本地部署 可靠,没有网络延迟,数据安全,你有更好的硬件就可以部署更大参数的模型,你可以尽情使用独属于你的AI啦!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)