一文学会!Deepseek-R1 + Ollama本地部署全攻略

家人们,还在为使用高级 AI 模型支付高昂订阅费而肉疼吗?今天就给大家带来一个好消息,免费、开源且隐私性强的 Deepseek-R1 模型了解一下!它的性能可与 OpenAI 每月 200 美元的 o1 模型媲美,重点是咱们能在本地部署,自己掌控,不仅省钱还安心。下面就跟着这篇文章,一步步把 Deepseek-R1 “请” 到自家电脑上!

家人们,还在为使用高级 AI 模型支付高昂订阅费而肉疼吗?今天就给大家带来一个好消息,免费、开源且隐私性强的 Deepseek-R1 模型了解一下!它的性能可与 OpenAI 每月 200 美元的 o1 模型媲美,重点是咱们能在本地部署,自己掌控,不仅省钱还安心。下面就跟着这篇文章,一步步把 Deepseek-R1 “请” 到自家电脑上!

一、认识 Deepseek-R1

Deepseek-R1 可不简单,它堪称推理 AI 模型界的革新者。和 OpenAI 依赖标记数据集不同,它运用纯强化学习(RL)来培养推理能力,就像一个不断自我尝试、自我提升的学霸,能在没有详细指导的情况下找到问题的解决办法。

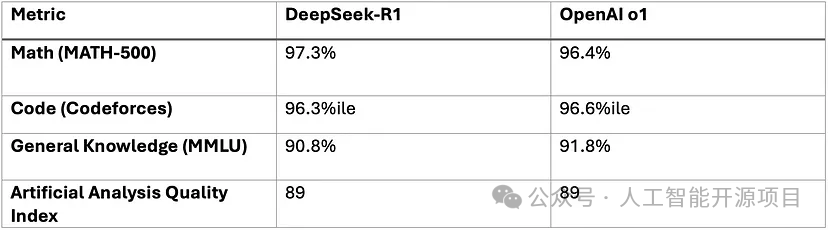

从性能对比上看,在数学(MATH - 500)测试中,Deepseek-R1 达到了 97.3% 的准确率,OpenAI-o1 为 96.4%;在编程(Codeforces)方面,Deepseek-R1 处于 96.3% ile 的水平,OpenAI-o1 是 96.6% ile;在常识(MMLU)测试里,Deepseek-R1 为 90.8% ,OpenAI-o1 是 91.8%。不难看出,Deepseek-R1 在推理密集型任务上表现十分亮眼,对于专注数学、编程领域的小伙伴来说,是个绝佳选择。

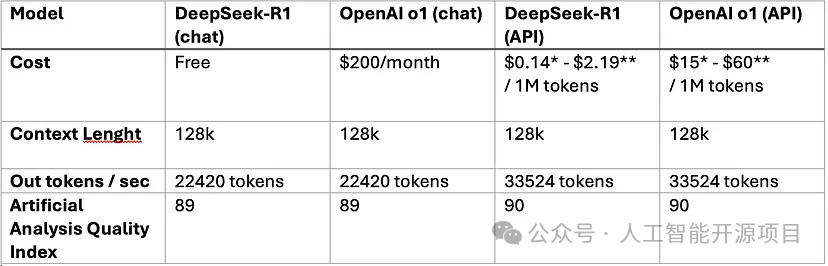

而且在成本方面,Deepseek-R1 优势明显。它的 API 每百万输入令牌仅需 0.55 美元,相比 OpenAI-o1 的 15 美元,便宜了 96.4%。要是选择本地部署,还能完全省去云服务费用,这对开发者来说,简直太友好了。

二、本地部署 Deepseek-R1 详细步骤

咱们借助 Ollama 这个工具来实现 Deepseek-R1 的本地部署,同时还会用到 Open Web UI 让交互更直观。下面就是具体操作:

(一)安装 Ollama

打开终端(macOS/Linux 系统适用),输入以下代码:

curl -fsSL https://ollama.com/install.sh | sh``ollama -v # 这一步是检查Ollama的版本,看看是否安装成功

windwos用户比较简单,直接官网下载exe程序安装好后即可

这一步就像是给咱们的电脑装上一个专门管理 AI 模型的 “小管家”,方便后续操作。安装好以后,在终端输入ollama

(二)下载 Deepseek-R1 模型

根据自己电脑的配置,选择合适的提炼模型。如果是普通消费级 GPU,4.7GB 大小的 7B 模型就很合适;要是电脑有 24GB 以上的 VRAM(显存),可以选择 70B 的模型;追求完整 R1 功能且电脑具备 336GB 以上 VRAM(用于 4 位量化)的话,那就选 671B 的模型。

DeepSeek-R1 与 OpenAI-o1 之间的性能对比

DeepSeek-R1 与 OpenAI-o1 之间的性能对比

# 默认7B模型(4.7GB - 适合消费级GPU) ollama run deepseek-r1 # 更大的70B模型(需要24GB以上VRAM) ollama run deepseek-r1:70b # 完整功能的Deepseek-R1(4位量化需要336GB以上VRAM) ollama run deepseek-r1:671b

输入对应的命令后,耐心等待模型下载完成,这个过程可能会根据网络情况花费一些时间。

(三)设置 Open Web UI

在部署之前,确保你的电脑已经安装了 docker。如果还没安装,可以去 docker 官网按照指引进行安装。安装好 docker 后,在终端输入以下命令来安装 Open Web UI:

docker run -d -p 3000:8080 \ --add-host=host.docker.internal:host-gateway \ -v open-webui:/app/backend/data \ --name open-webui \ --restart always \ ghcr.io/open-webui/open-webui:main

这段命令有点复杂,简单来说就是在 docker 容器里运行 Open Web UI,并把它映射到本地的 3000 端口。以后咱们就能通过浏览器访问这个端口来和模型交互啦。

(四)访问并使用模型

打开浏览器,在地址栏输入http://localhost:3000,进入页面后选择deepseek-r1:latest。到这里,就可以开始愉快地和 Deepseek-R1 对话啦,所有的数据都保存在本地,不用担心隐私泄露的问题。

三、将 Deepseek-R1 集成到项目中

(一)本地部署集成(隐私优先)

如果想在自己的项目里使用本地部署的 Deepseek-R1,可以借助 OpenAI 的 Python 库,把本地的 Ollama 实例当作 OpenAI 兼容的端点。具体代码如下:

import openai # 连接到本地的Ollama实例 client = openai.Client( base_url="http://localhost:11434/v1", api_key="ollama"# 无需认证的私有访问 ) response = client.chat.completions.create( model="deepseek-r1:XXb",# 根据选择的提炼模型更改“XX” messages=[{"role":"user","content":"Explain blockchain security"}], temperature=0.7# 控制生成内容的创造性和准确性 )

在这段代码里,base_url指定了本地 Ollama 实例的地址,api_key设置为ollama就可以实现本地私有访问。model参数根据之前下载的模型版本进行调整,比如选了 7B 模型,就改成deepseek-r1:7b 。

(二)使用官方云 API 集成

要是项目有可扩展性的需求,还可以使用 Deepseek-R1 的官方云 API。首先得去 Deepseek 官网创建账户,生成 API 密钥。然后在项目代码里这样引入:

import openai from dotenv import load_dotenv import os load_dotenv() client = openai.OpenAI( base_url="https://api.deepseek.com/v1", api_key=os.getenv("DEEPSEEK_API_KEY") ) response = client.chat.completions.create( model="deepseek-reasoner", messages=[{"role":"user","content":"Write web scraping code with error handling"}], max_tokens=1000# 限制长响应的成本 )

这里用dotenv库读取环境变量里的 API 密钥,保证密钥的安全性。max_tokens参数可以控制生成内容的长度,避免产生过高的费用。

DeepSeek-R1本地测试

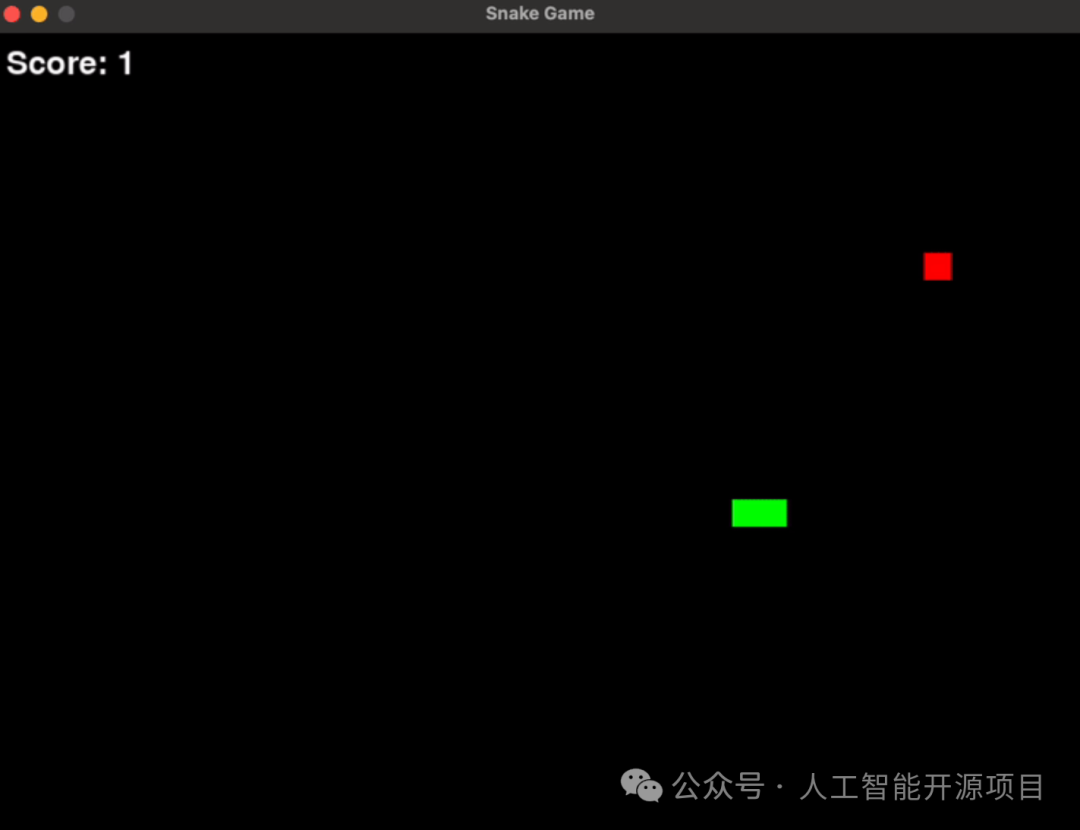

让我们尝试让模型创建一个贪吃蛇游戏。如下图所示,模型执行了所有思路以获得最佳响应。确实,它所花费的时间不是很好,但至少我们得到了模型更高效的响应。

DeepSeek-R1 7B 在 Python 中创建贪吃蛇游戏

它做得很不错,但花了将近 3 分钟!

DeepSeek-R1 用 Python 创建的贪吃蛇游戏

按照上面这些步骤,无论是想体验 Deepseek-R1 的强大功能,还是打算把它集成到自己的项目里,都能轻松实现。赶紧动手试试吧,开启属于自己的高效 AI 之旅!要是在部署过程中遇到问题,欢迎在留言区交流讨论哦~

零基础如何学习AI大模型

领取方式在文末

为什么要学习大模型?

学习大模型课程的重要性在于它能够极大地促进个人在人工智能领域的专业发展。大模型技术,如自然语言处理和图像识别,正在推动着人工智能的新发展阶段。通过学习大模型课程,可以掌握设计和实现基于大模型的应用系统所需的基本原理和技术,从而提升自己在数据处理、分析和决策制定方面的能力。此外,大模型技术在多个行业中的应用日益增加,掌握这一技术将有助于提高就业竞争力,并为未来的创新创业提供坚实的基础。

大模型典型应用场景

①AI+教育:智能教学助手和自动评分系统使个性化教育成为可能。通过AI分析学生的学习数据,提供量身定制的学习方案,提高学习效果。

②AI+医疗:智能诊断系统和个性化医疗方案让医疗服务更加精准高效。AI可以分析医学影像,辅助医生进行早期诊断,同时根据患者数据制定个性化治疗方案。

③AI+金融:智能投顾和风险管理系统帮助投资者做出更明智的决策,并实时监控金融市场,识别潜在风险。

④AI+制造:智能制造和自动化工厂提高了生产效率和质量。通过AI技术,工厂可以实现设备预测性维护,减少停机时间。

…

这些案例表明,学习大模型课程不仅能够提升个人技能,还能为企业带来实际效益,推动行业创新发展。

学习资料领取

如果你对大模型感兴趣,可以看看我整合并且整理成了一份AI大模型资料包,需要的小伙伴文末免费领取哦,无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]👈

更多推荐

已为社区贡献125条内容

已为社区贡献125条内容

所有评论(0)