【2026最新版|必收藏】大模型优化算法详解(GRPO/PPO/DPO)

对于小白和程序员而言,想要入门大模型、抢占技术风口,首先要吃透核心优化算法——GRPO、PPO、DPO作为当前大模型后训练阶段的主流方案,直接决定了模型的性能与部署效率。GRPO是由DeepSeek团队重磅推出的2026年大模型Post-training优化算法,核心目标是解决传统强化学习方案(如PPO)存在的训练效率低、资源浪费严重等痛点。它创新采用组内样本相对比较的方式,替代传统的绝对价值估计

对于小白和程序员而言,想要入门大模型、抢占技术风口,首先要吃透核心优化算法——GRPO、PPO、DPO作为当前大模型后训练阶段的主流方案,直接决定了模型的性能与部署效率。本文专为2026年想要深耕大模型的学习者打造,用通俗语言拆解三大算法核心,规避专业壁垒,同时附上全套可直接领取的学习资源,建议收藏备用,助力快速入门、高效进阶!

GRPO是由DeepSeek团队重磅推出的2026年大模型Post-training优化算法,核心目标是解决传统强化学习方案(如PPO)存在的训练效率低、资源浪费严重等痛点。它创新采用组内样本相对比较的方式,替代传统的绝对价值估计,大幅简化训练流程,提升计算效率,同时保证策略优化的稳定性。GRPO由策略模型、参考模型和奖励模型三大核心模块组成,有效规避了PPO算法中复杂的调度问题,成为2026年大模型优化领域的核心研究方向,也是小白入门进阶的重点知识点。

2026大语言模型主流强化学习方案RLHF:两大核心技术路线拆解

RLHF(基于人类反馈的强化学习)是当前大模型对齐人类偏好的核心技术,2026年其主流路线依然分为两大分支,小白和程序员可根据学习目标和应用场景重点掌握:

路线一:以PPO为代表的On Policy技术路线(小白易懂版)

PPO(Proximal Policy Optimization,近端策略优化)由OpenAI于2017年提出,是策略梯度类算法的经典代表,核心解决了传统策略梯度算法(如TRPO)更新步长敏感、样本利用率低的痛点,至今仍是2026年大模型后训练的常用方案。

通俗来说,PPO引入了“裁剪目标函数”,相当于给模型的更新幅度“设了一道防线”,确保新策略与旧策略的差异在可控范围内,避免因更新幅度过大导致模型训练崩溃。

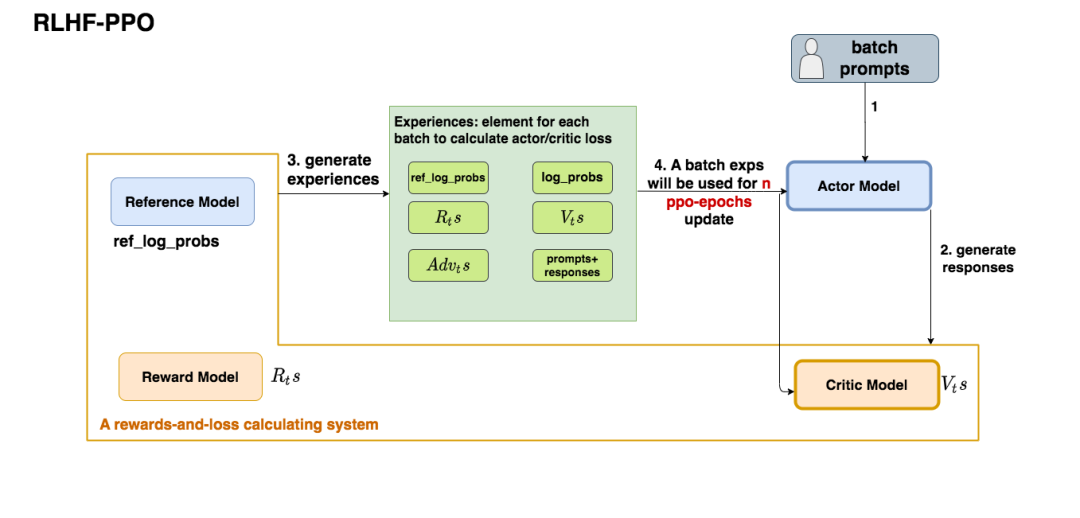

PPO训练过程中,会同步训练两个独立的神经网络——Actor Model(执行者)和Critic Model(评判者),二者分工明确、协同工作:Actor Model负责“执行任务”,生成模型响应;Critic Model负责“打分评判”,对Actor的表现给出奖励,随后两者共同计算损失函数,通过不断迭代优化模型参数。

路线二:以DPO为代表的偏好优化路线(高效进阶版)

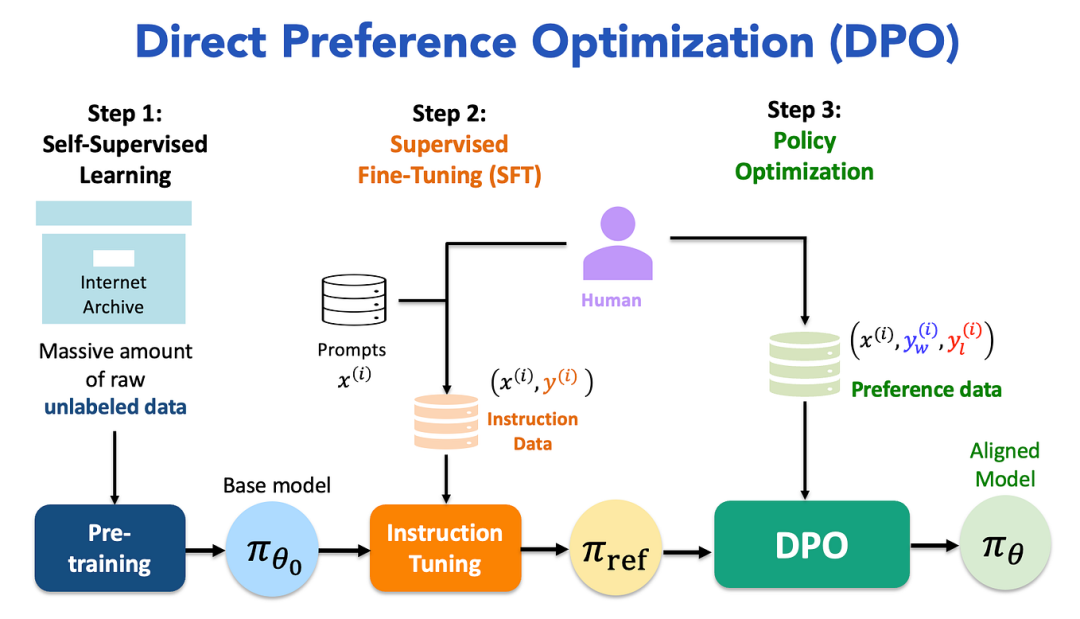

DPO(Direct Preference Optimization,直接偏好优化)由斯坦福大学等研究团队于2023年提出,经过两年迭代,已成为2026年大模型优化的高效方案。它最大的优势的是精简了强化学习的中间环节,无需额外训练复杂的Reward Model(奖励模型),直接利用标注好的偏好数据,通过排序正确的损失进行模型学习,既提升了训练效率,又避免了训练Reward Model带来的性能损失。

小白可这样理解:DPO就像“借鉴过去的经验做决策”——它基于模型过去行为策略收集的数据,评估并改进当前的行为策略,无需额外搭建“评判体系”,上手难度更低,适合新手快速掌握。

2026重点:GRPO算法深度解析(解决PPO痛点,小白必学)

一、GRPO算法的诞生背景(为什么2026年必学GRPO?)

在DeepSeek GRPO推出之前,2025年及以前,大部分大语言模型的后训练方案都以PPO算法为主。如前文所述,PPO需要同时训练Actor Model(运动员)和Critic Model(裁判员),当Actor的表现不断提升时,Critic也需要同步更新、提高评判标准。

这一模式存在一个致命痛点:需要投入大量资源训练Critic Model(相当于额外请一位“裁判员”),尤其是在万卡集群大规模并行训练场景中,Actor和Critic的同步调度会产生大量冗余操作,导致资源浪费、训练效率低下。

更关键的是,PPO训练中还需要额外搭建“教师模型”,而教师模型与实际任务高度绑定,只能从零开始训练,对于小白和初级程序员而言,训练难度极高。为解决这一痛点,DeepSeek团队推出GRPO算法,成为2026年大模型优化的“效率神器”。

二、GRPO算法核心原理(小白通俗解读)

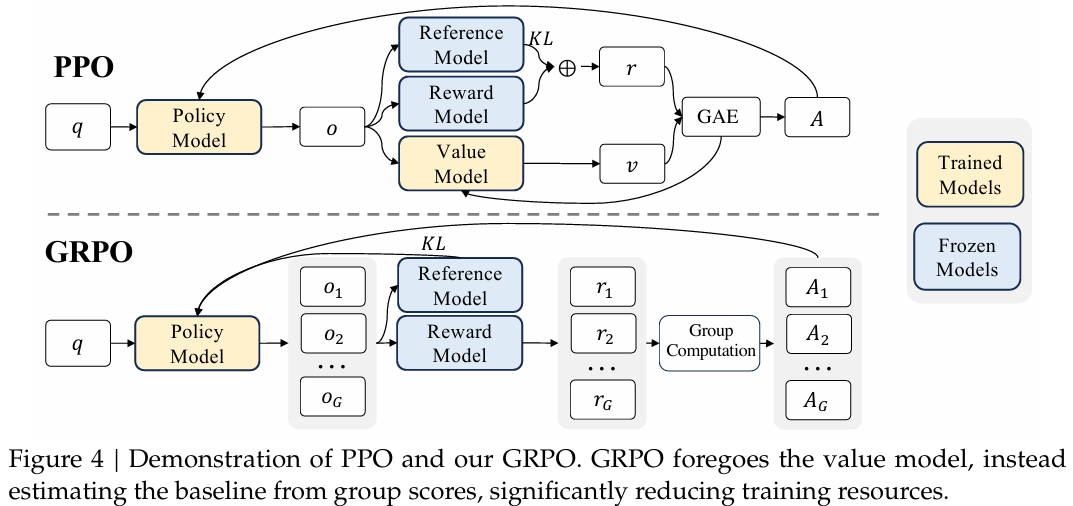

GRPO的核心创新的是:用组内样本的相对比较,替代传统强化学习中的绝对价值估计,直接去掉了PPO中繁琐的Value Model(即Critic Model),大幅简化训练流程,同时提升计算效率。

大模型训练中,通常只有最后一个token会被奖励模型打分,很难对训练中的每个中间token进行评判——这也是PPO需要Critic Model的核心原因。而GRPO则巧妙规避了这一问题:它通过Policy Model(策略模型),借助Reward Model(打分器)生成多个答案和效果,通过n次采样求均值的方式,得到奖励基线,无需额外的Critic Model,就能完成模型优化,让大规模并行训练变得更简单,小白也能快速上手理解。

三、GRPO三大核心模块(2026面试高频考点)

对于程序员和备考面试的学习者而言,GRPO的三大模块是2026年大模型面试的高频考点,务必牢记:

- Policy Model(策略模型):核心是需要优化的目标模型,其权重处于“打开训练”的状态,会根据训练过程中的反馈不断更新参数,相当于PPO中的Actor Model。

- Reference Model(参考模型):与Policy Model的初始权重完全一致,但核心区别是——整个训练过程中,Reference Model的权重是“冻结”的,不参与更新,主要用于对比Policy Model的优化效果,避免模型更新偏离方向。

- Reward Model(打分器):可灵活选择启发式规则或模型评分,核心作用是对Policy Model生成的回答进行打分,输出一个标量(即具体分数),为模型优化提供反馈依据。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。我们整理出这套 AI 大模型突围资料包:

- ✅ 从零到一的 AI 学习路径图

- ✅ 大模型调优实战手册(附医疗/金融等大厂真实案例)

- ✅ 百度/阿里专家闭门录播课

- ✅ 大模型当下最新行业报告

- ✅ 真实大厂面试真题

- ✅ 2026 最新岗位需求图谱

所有资料 ⚡️ ,朋友们如果有需要 《AI大模型入门+进阶学习资源包》,下方扫码获取~

① 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

② 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。这里我给大家准备了一份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

③ 大模型学习书籍&文档

学习AI大模型离不开书籍文档,我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

④ AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

⑤ 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

⑥ 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

以上资料如何领取?

为什么大家都在学大模型?

最近科技巨头英特尔宣布裁员2万人,传统岗位不断缩减,但AI相关技术岗疯狂扩招,有3-5年经验,大厂薪资就能给到50K*20薪!

不出1年,“有AI项目经验”将成为投递简历的门槛。

风口之下,与其像“温水煮青蛙”一样坐等被行业淘汰,不如先人一步,掌握AI大模型原理+应用技术+项目实操经验,“顺风”翻盘!

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

以上全套大模型资料如何领取?

更多推荐

已为社区贡献77条内容

已为社区贡献77条内容

所有评论(0)