使用vLLM部署Qwen3.6-35B-A3B/Qwen3.6-27B并且支持在Claude Code中调用

Qwen/Qwen3.6-35B-A3B在智能体编码(Agentic Coding):模型现在能以更高的流畅度和精确度处理前端工作流和仓库级推理。思维保留(Thinking Preservation):可保留历史消息中的推理上下文,从而简化迭代开发并降低开销。看来非常适合在智能体工具中使用呀!

前言

随着各种智能体工具(claude code, opencode, qwen code...)所展现出的越来越强的能力,越来越多人意识到,智能体工具是真的能在日常工作中提高自己的效率。普通人只要花一点钱就能买到一个“聪明的大脑”,但是随着需求的不断释放,模型厂商的算力也出现了瓶颈导致各家的Coding plan 越来越贵而且额度给的越来越少。好在昨晚阿里千万团队开源了Qwen/Qwen3.6-35B-A3B,这款相对轻量高效的模型,让普通实现token自由成为可能!(消费级显卡可以等量化模型,非量化版本权重也大概在71.93GB)今天我就讲讲如何使用VLLM部署这个令人激动的Qwen/Qwen3.6-35B-A3B!

模型简介

Qwen/Qwen3.6-35B-A3B在Qwen/Qwen3.5-35B-A3B的基础上着重提升了以下几种能力:

- 智能体编码(Agentic Coding):模型现在能以更高的流畅度和精确度处理前端工作流和仓库级推理。

- 思维保留(Thinking Preservation):可保留历史消息中的推理上下文,从而简化迭代开发并降低开销。

看来非常适合在智能体工具中使用呀!

硬件配置

本文所使用的GPU为H20 96GB VRAM,由于Qwen/Qwen3.6-35B-A3B的权重大概在72GB左右,请确保你有足够的GPU。

模型部署

创建环境

在创建环境之前先创建一个目录

mkdir qwen_3_6

cd qwen_3_6使用uv创建并激活环境,如果没有安装过uv可以查看 uv安装

安装完uv后创建并激活环境

uv venv --python=3.12

source .venv/bin/activate安装modelscope

modelscope是一个魔搭社区推出的用于便利管理魔搭社区平台上的模型权重和数据集的工具。

uv pip install modelscope安装vLLM

vLLM是一个先进的大模型推理服务框架,支持大量的开源模型。

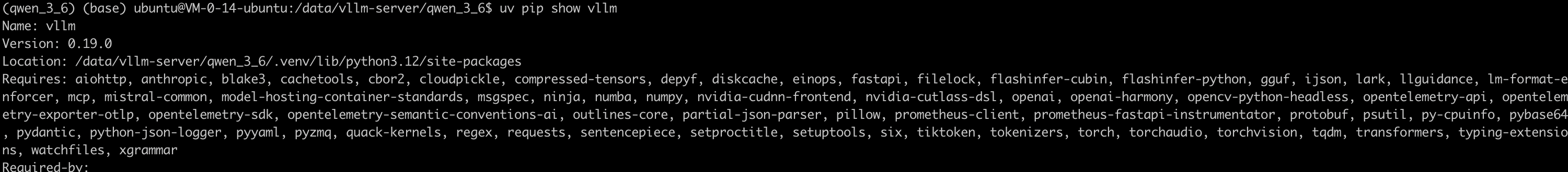

uv pip install vllm --torch-backend=auto安装完vLLM后查看一下vllm版本需要>=0.19.0

下载模型

使用modelscope下载模型

modelscope download Qwen/Qwen3.6-35B-A3B启动服务

配置文件

准备vllm serve配置文件,注意将配置文件中的"your-api-key"替换成你自己的api key,你可以随意指定一串字符串。

model: Qwen/Qwen3.6-35B-A3B

served_model_name: qwen3.6-flash

host: 0.0.0.0

port: 8000

tensor-parallel-size: 1

gpu-memory-utilization: 0.90

api-key: your-api-key

disable_fastapi_docs: true

enable_auto_tool_choice: true

tool_call_parser: qwen3_xml

reasoning-parser: qwen3

max-model-len: 131072

max_num_seqs: 1024

max_num_batched_tokens: 65536

enable_chunked_prefill: True

trust-remote-code: true启动

export VLLM_USE_MODELSCOPE=true

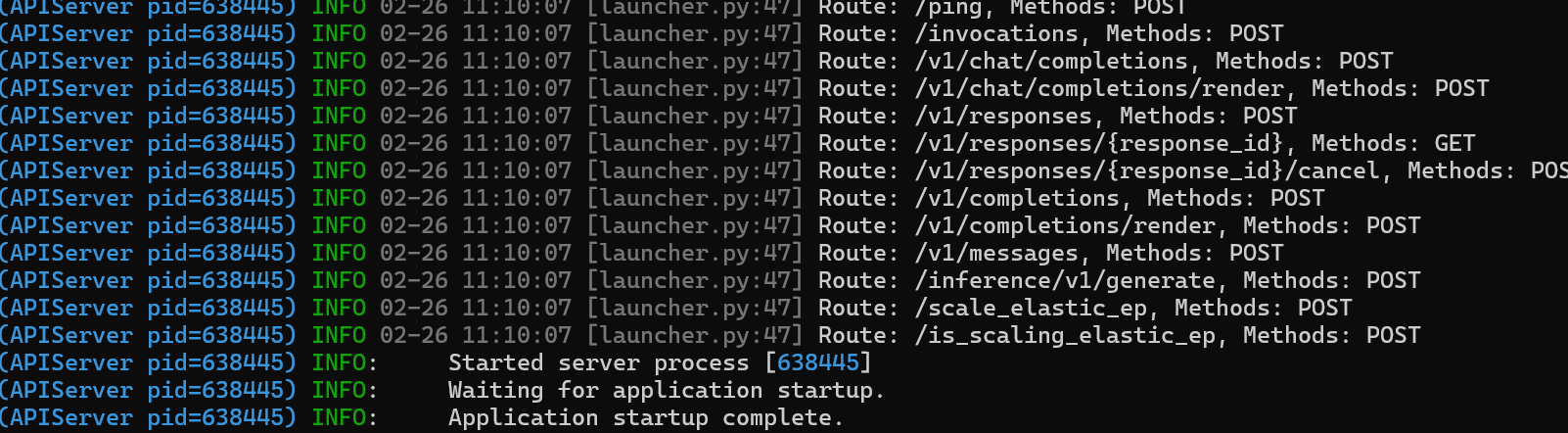

vllm serve --config config.yaml等待服务启动完成,出现如下图所示的日志代表服务成功启动:

在Claude Code中使用模型

安装claude code

npm install -g @anthropic-ai/claude-code运行以下命令,如果输出版本信息则代表安装成功

claude --version新增或编辑配置文件

- MacOS & Linux 为 ~/.claude/settings.json

- Windows 为 用户目录/.claude/settings.json

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "your-api-key",

"ANTHROPIC_BASE_URL": "http://vllm-host:8000",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "qwen3.6-flash",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "qwen3.6-flash",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "qwen3.6-flash",

"ANTHROPIC_MODEL": "qwen3.6-flash",

"API_TIMEOUT_MS": "3000000",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1"

}

}注意替换里面的`your-api-key`和`vllm-host`为你运行vllm 服务器地址。

编辑或新增 `.claude.json` 文件

- MacOS & Linux 为 `~/.claude.json`

- Windows 为`用户目录/.claude.json`

{

"hasCompletedOnboarding": true

}运行测试

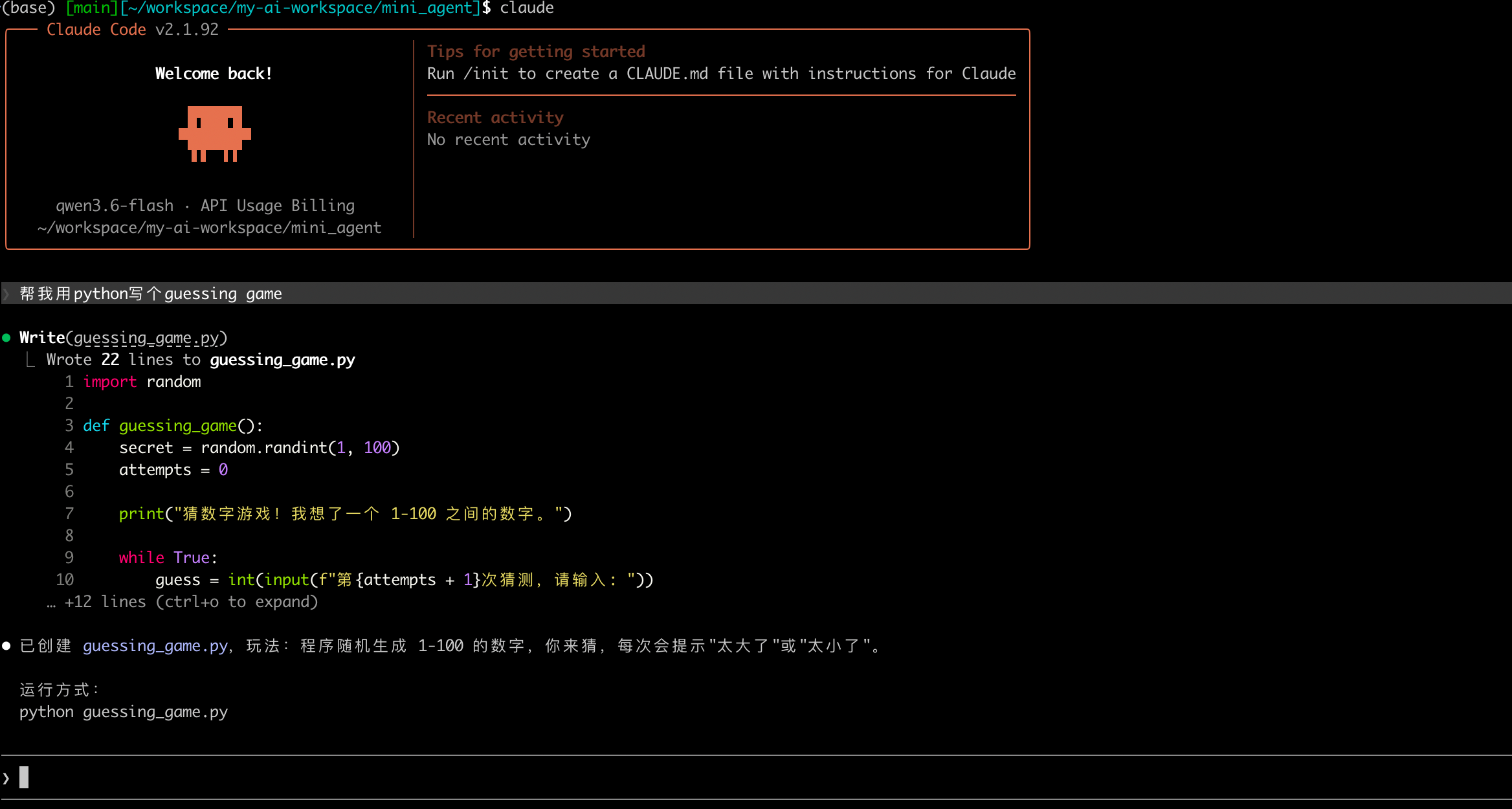

claude

2026-04-23更新

就在昨晚(2026-04-22)阿里千问团队开源了Qwen/Qwen3.6-27B,Qwen3.6-27B依然支持多模态思考与非思考模式,在智能体编程方面达到了旗舰级表现,全面超越前代开源旗舰Qwen3.5-397B-A17B(总参数397B/激活参数17B的MoE模型)。

本部署教程同样适用于Qwen3.6-27B,只需要把模型替换即可。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)