Qwen3-4B-Thinking Gemini蒸馏效果:5440万token数据带来的质变

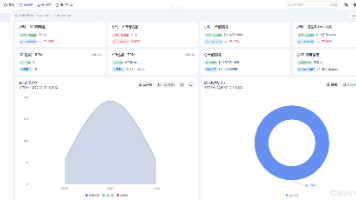

本文介绍了如何在星图GPU平台上自动化部署Qwen3-4B-Thinking-2507-Gemini-2.5-Flash-Distill镜像,该镜像基于通义千问Qwen3-4B官方模型优化,通过5440万token数据蒸馏显著提升推理效率。用户可快速搭建智能对话系统,应用于客服问答、知识检索等场景,实现高效AI交互。

·

Qwen3-4B-Thinking Gemini蒸馏效果:5440万token数据带来的质变

1. 模型概述与技术亮点

Qwen3-4B-Thinking-2507-Gemini-2.5-Flash-Distill是基于通义千问Qwen3-4B官方模型进行深度优化的版本。这个4B参数的稠密(Dense)模型通过5440万token的Gemini 2.5 Flash蒸馏数据训练,在保持原始模型能力的同时显著提升了推理效率。

1.1 核心特性

- 超长上下文:原生支持256K tokens,可扩展至1M tokens

- 思考模式:独特的Thinking模式可输出推理链,增强可解释性

- 高效量化:支持GGUF格式(Q4_K_M等),4-bit量化后仅需约4GB显存

- 蒸馏优化:基于Gemini 2.5 Flash的大规模高质量蒸馏数据训练

2. 部署与快速上手

2.1 服务基本信息

| 项目 | 内容 |

|---|---|

| 模型名称 | Qwen3-4B-Thinking (Gemini 2.5 Flash Distill) |

| 访问地址 | http://localhost:7860 |

| 服务端口 | 7860 |

| 托管方式 | Supervisor守护进程 |

2.2 三步快速使用指南

-

访问服务界面:

http://your-server-ip:7860 -

开始对话:

- 左侧输入框输入问题

- 点击"发送"按钮

- 系统会自动保存对话历史

-

参数调整(右侧面板):

| 参数 | 功能说明 | 推荐设置 |

|---|---|---|

| 系统提示词 | 定义AI角色和行为 | "你是一个有用的AI助手。" |

| 最大生成长度 | 单次回复最大token数 | 1024 |

| Temperature | 控制回答随机性 | 0.6 |

| Top P | 控制采样范围 | 0.95 |

3. 服务管理与维护

3.1 常用管理命令

-

查看状态:

supervisorctl status -

重启服务:

supervisorctl restart qwen3-122b -

停止服务:

supervisorctl stop qwen3-122b -

查看日志:

tail -f /root/Qwen3.5-122B-A10B-MLX-9bit/service.log

3.2 常见问题排查

服务无法启动:

# 检查端口冲突

ss -tlnp | grep 7860

# 查看错误日志

tail -100 /root/Qwen3.5-122B-A10B-MLX-9bit/service.log

模型加载缓慢:

- 首次启动需要7-10秒加载时间

- 确保有足够内存/显存(建议16GB+)

网页无法访问:

- 检查防火墙7860端口是否开放

- 确认服务状态:

supervisorctl status

4. 技术架构与实现细节

4.1 系统架构

- 推理框架:Gradio + Transformers组合

- 模型精度:bfloat16浮点格式

- 硬件需求:

- GPU推荐:NVIDIA显卡(8GB+显存)

- 也支持CPU推理模式

4.2 关键文件路径

| 文件路径 | 用途说明 |

|---|---|

/root/Qwen3.5-122B-A10B-MLX-9bit/app.py |

Gradio应用主程序 |

/root/Qwen3.5-122B-A10B-MLX-9bit/start.sh |

服务启动脚本 |

/etc/supervisor/conf.d/qwen3-122b.conf |

Supervisor配置文件 |

/root/ai-models/TeichAI/Qwen3-4B-Thinking-2507-Gemini-2___5-Flash-Distill/ |

模型存储目录 |

5. 使用注意事项

- 数据持久性:对话数据仅保存在内存中,重启后丢失

- 资源监控:运行时占用8-16GB内存,建议定期检查

- 并发限制:当前配置为单用户模式

- 网络配置:默认仅限本地访问,外网需配置反向代理

6. 总结与展望

Qwen3-4B-Thinking-Gemini蒸馏版通过5440万token的高质量数据训练,在保持原始模型强大能力的同时,显著提升了推理效率和资源利用率。4-bit量化后仅需4GB显存的特性使其能够在更多边缘设备上部署,而256K的超长上下文支持则为复杂任务处理提供了可能。

未来,随着蒸馏技术的不断优化,我们期待看到更多轻量化但性能不打折的模型变体出现,推动大模型技术在实际业务场景中的普及应用。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)