LLM系列之指令微调

在完成第一阶段的预训练后,就可以开始进到指令微调阶段了。由于预训练任务的本质在于「续写」,而「续写」的方式并一定能够很好的回答用户的问题。因为训练大多来自互联网中的数据,我们无法保证数据中只存在存在规范的「一问一答」格式,这就会造成预训练模型通常无法直接给出人们想要的答案。不过,这种需要用户精心设计从而去「套」答案的方式,显然没有那么优雅。既然模型知道这些知识,只是不符合我们人类的对话习惯,那么我

在完成第一阶段的预训练后,就可以开始进到指令微调阶段了。

由于预训练任务的本质在于「续写」,而「续写」的方式并一定能够很好的回答用户的问题。

例如:

| 用户问题 | 用户预期回答 | 模型续写结果 |

|---|---|---|

| 《无间道》的主演有哪些? | 刘德华、梁朝伟 | 《无间道》的主演有哪些?不少观众期待看到阵容公告,今天小编... |

因为训练大多来自互联网中的数据,我们无法保证数据中只存在存在规范的「一问一答」格式,

这就会造成预训练模型通常无法直接给出人们想要的答案。

但是,这并不代表预训练模型「无知」,只是需要我们用一些巧妙的「技巧」来引导出答案:

| 用户问题 | 用户预期回答 | 模型续写结果 |

|---|---|---|

| 《无间道》的主演有 | 刘德华、梁朝伟 | 《无间道》的主演有刘德华、梁朝伟和黄秋生,而这部电影也是香港警匪片的代表作之一。 |

不过,这种需要用户精心设计从而去「套」答案的方式,显然没有那么优雅。

既然模型知道这些知识,只是不符合我们人类的对话习惯,那么我们只要再去教会模型「如何对话」就好了。

这就是 Instruction Tuning 要做的事情,即指令对齐。

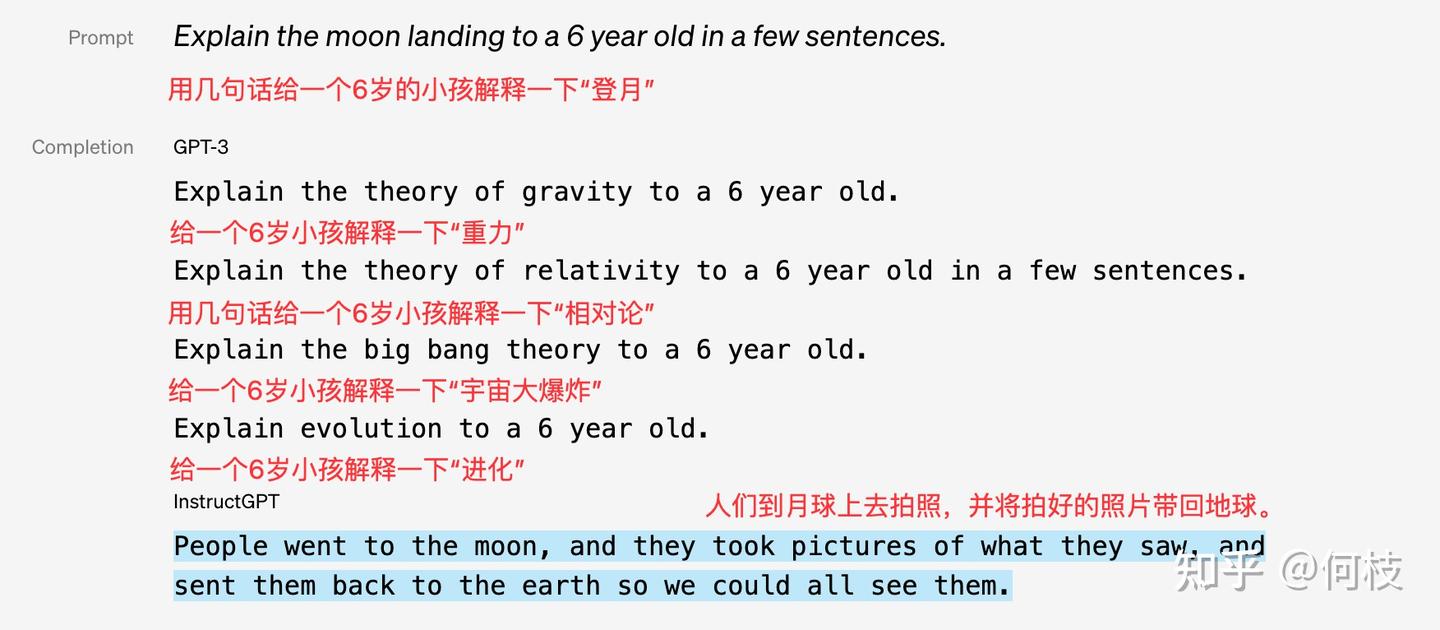

OpenAI 在 [instruction-following] 中展示了 GPT-3 和经过指令微调前后模型的区别:

GPT-3 只是在做续写任务,InstructGPT 则能够回答正确内容

2.1 Self Instruction

既然我们需要去「教会模型说人话」,

那么我们就需要去精心编写各式各样人们在对话中可能询问的问题,以及问题的答案。

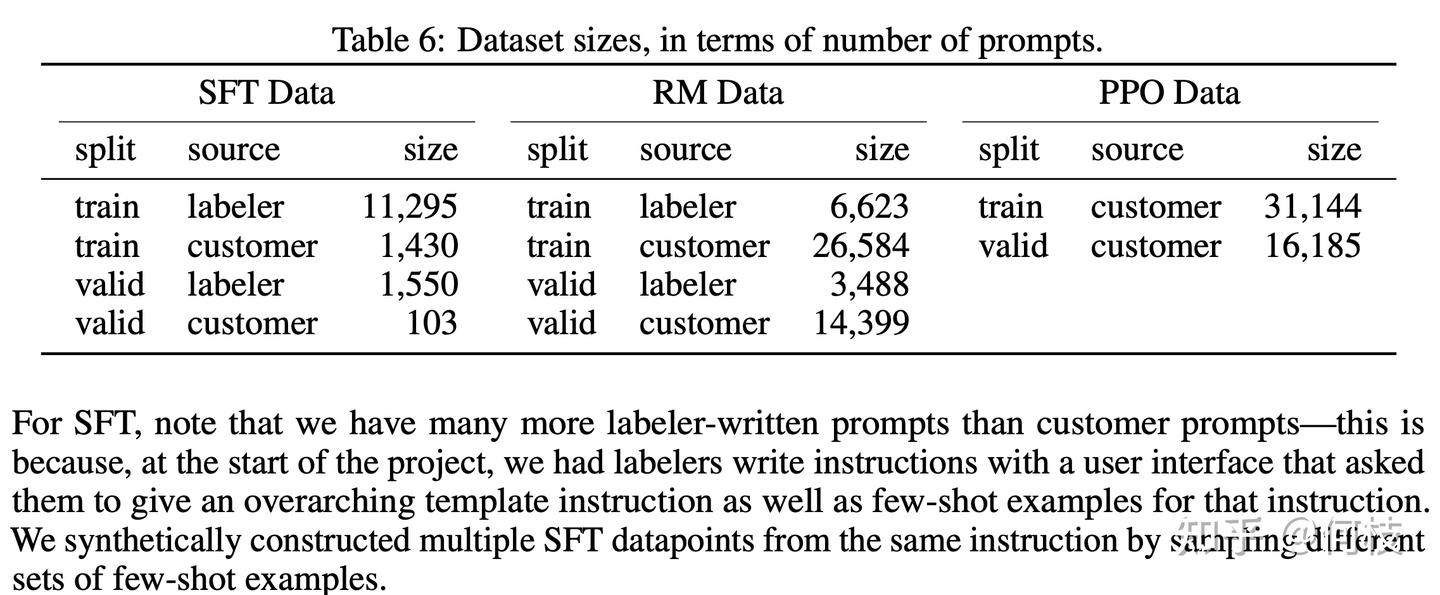

在 [InstructGPT Paper] 中,使用了 1.3w 的数据来对 GPT-3.5 进行监督学习(下图中左 SFT Data):

InstructGPT Paper 训练数据集预览

可以观察到,数据集中人工标注(labeler)占大头,

这还仅仅只是 InstructGPT,和 ChatGPT 远远不是一个量级。

可见,使用人工标注是一件成本巨大的事情,

除了找到足够的人数,还需要保持团队中每个人的「专业」且「认知一致」。

如果这件事从头开始做自然很难(OpenAI 确实厉害),但今天我们已经有了 ChatGPT 了,

我们让 ChatGPT 来教我们自己的模型不就好了吗?

这就是 Self Instruction 的思路,即通过 ChatGPT 的输入输出来蒸馏自己的模型。

一个非常出名的项目是 [stanford_alpaca]。

如果从 ChatGPT 「套」数据,那么我们至少需要「套」哪些数据。

Instruction Tuning 中的「输入」(问题)和「输出」(答案)是训练模型的关键,

答案很好得到,喂给 ChatGPT 问题根据返回结果就能获得,

但「问题」从哪里获得呢?

(靠人想太累了,屏幕前的你不妨试试,看看短时间内能想出多少有价值的问题)

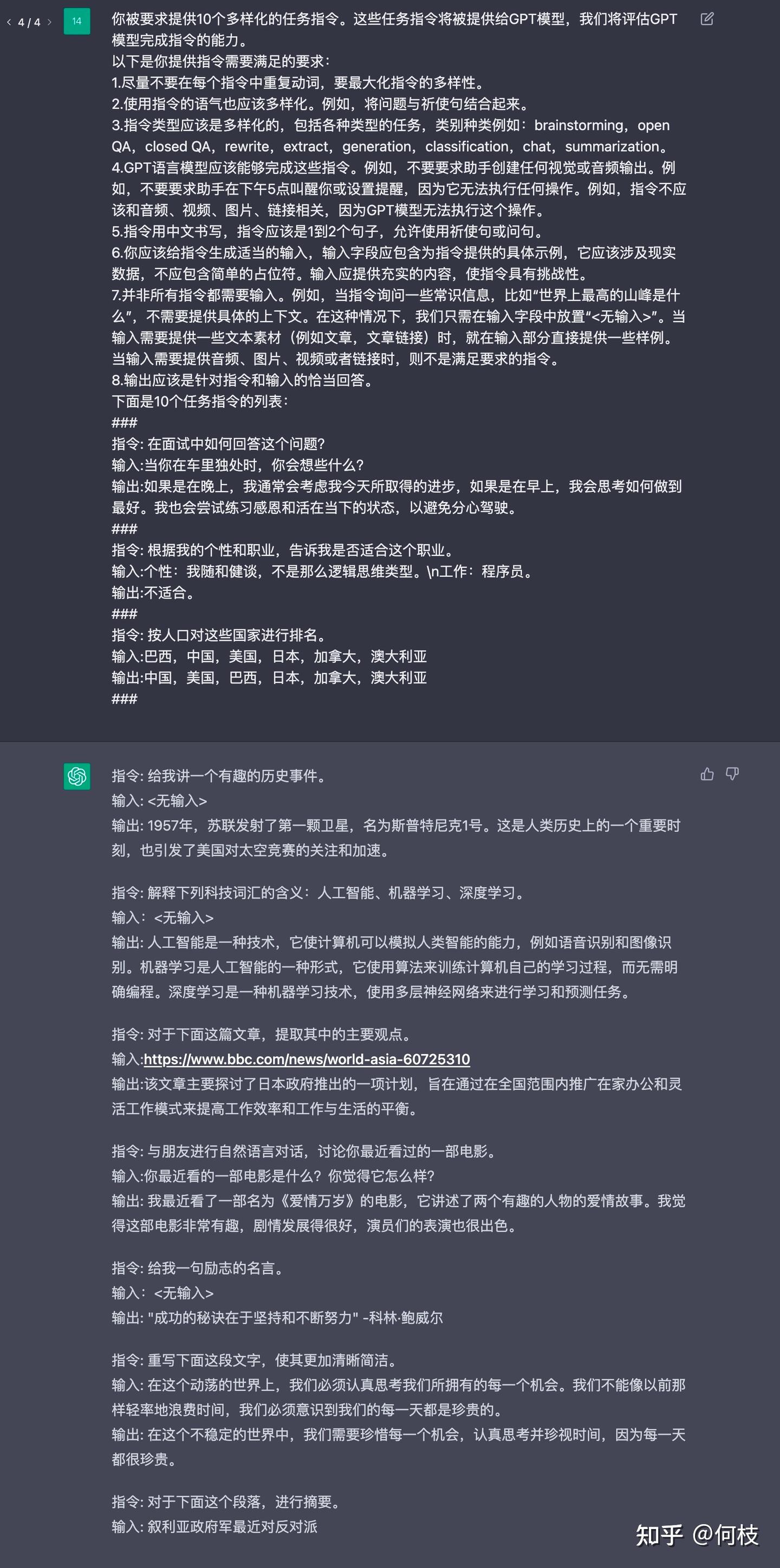

Alpaca 则是使用「种子指令(seed)」,使得 ChatGPT 既生成「问题」又生成「答案」。

由于 Alpaca 是英文项目,为了便于理解,我们使用相同思路的中文项目 [BELLE] 作为例子。

通俗来讲,就是人为的先给一些「训练数据样例」让 ChatGPT 看,

紧接着利用 ChatGPT 的续写功能,让其不断地举一反三出新的训练数据集:

你被要求提供10个多样化的任务指令。这些任务指令将被提供给GPT模型,我们将评估GPT模型完成指令的能力。

以下是你提供指令需要满足的要求:

1.尽量不要在每个指令中重复动词,要最大化指令的多样性。

2.使用指令的语气也应该多样化。例如,将问题与祈使句结合起来。

3.指令类型应该是多样化的,包括各种类型的任务,类别种类例如:brainstorming,open QA,closed QA,rewrite,extract,generation,classification,chat,summarization。

4.GPT语言模型应该能够完成这些指令。例如,不要要求助手创建任何视觉或音频输出。例如,不要要求助手在下午5点叫醒你或设置提醒,因为它无法执行任何操作。例如,指令不应该和音频、视频、图片、链接相关,因为GPT模型无法执行这个操作。

5.指令用中文书写,指令应该是1到2个句子,允许使用祈使句或问句。

6.你应该给指令生成适当的输入,输入字段应包含为指令提供的具体示例,它应该涉及现实数据,不应包含简单的占位符。输入应提供充实的内容,使指令具有挑战性。

7.并非所有指令都需要输入。例如,当指令询问一些常识信息,比如“世界上最高的山峰是什么”,不需要提供具体的上下文。在这种情况下,我们只需在输入字段中放置“<无输入>”。当输入需要提供一些文本素材(例如文章,文章链接)时,就在输入部分直接提供一些样例。当输入需要提供音频、图片、视频或者链接时,则不是满足要求的指令。

8.输出应该是针对指令和输入的恰当回答。

下面是10个任务指令的列表:

###

1. 指令: 在面试中如何回答这个问题?

1. 输入:当你在车里独处时,你会想些什么?

1. 输出:如果是在晚上,我通常会考虑我今天所取得的进步,如果是在早上,我会思考如何做到最好。我也会尝试练习感恩和活在当下的状态,以避免分心驾驶。

###

2. 指令: 按人口对这些国家进行排名。

2. 输入:巴西,中国,美国,日本,加拿大,澳大利亚

2. 输出:中国,美国,巴西,日本,加拿大,澳大利亚

###

3. 指令:如上述例子所示,我们先给出 2 个样例,并让 ChatGPT 进行续写:

ChatGPT 续写结果

关于 BELLE 的更多细节可以参考这篇文章:

编辑何枝:让ChatGPT生成训练ChatGPT的训练数据149 赞同 · 7 评论 文章

2.2 开源数据集整理

在这一章中,我们将梳理一些开源的 Instruction Tuning 的数据集,

除了直接拿来用以外,我们期望通过分析这些已有数据集,从而学习如何构建一个指令数据集。

- Alpaca

[stanford_alpaca] 采用上述的 self instruction 的方式采集了 5200 条指令训练数据集。

数据样例如下:

{

"instruction": "Arrange the words in the given sentence to form a grammatically correct sentence.",

"input": "quickly the brown fox jumped",

"output": "The quick brown fox jumped quickly."

}其中,instruction 代表要求模型做的任务,input 代表用户输入, output 代表喂给模型的 label。

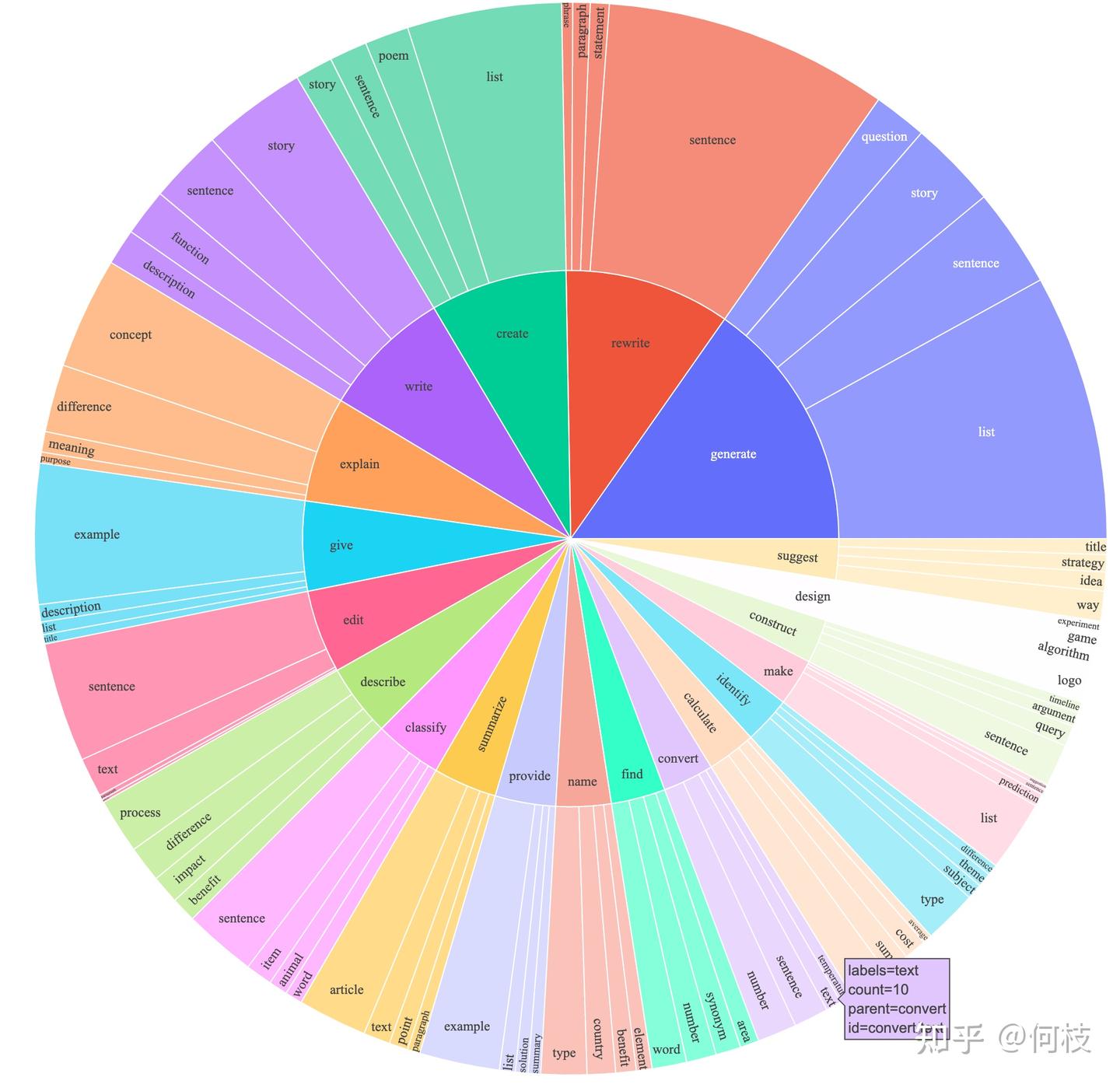

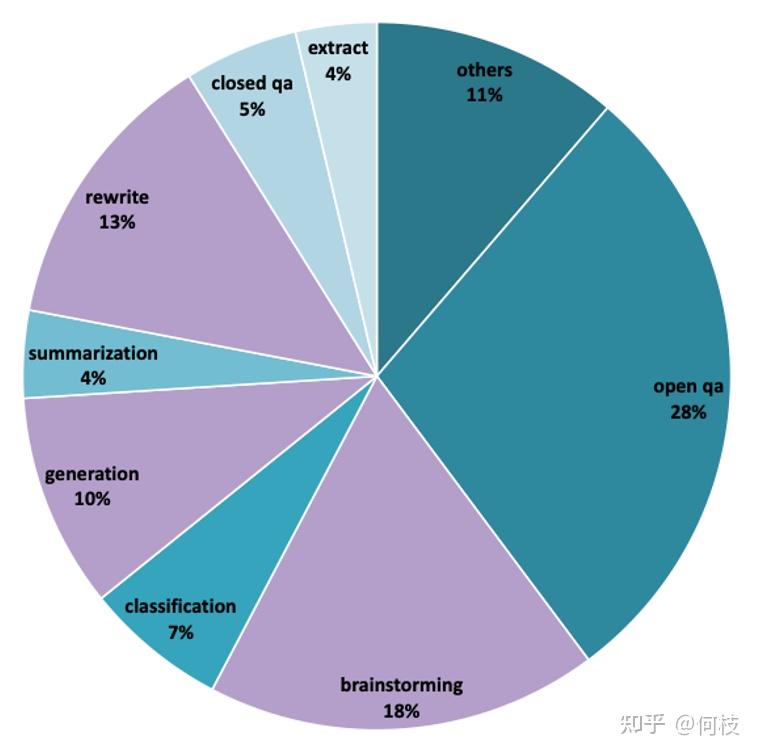

Alpaca 覆盖了多种类型的指令,其数据分布如下:

Alpaca 数据分布图

包含写作、描述、分类、摘要等多种类型的任务集合。

- BELLE

BELLE 开放了好几种规模的数据集,[100万]、[200万]、[350万] 等。

训练数据集样例如下:

{

"instruction": "判断给定的文章是否符合语法规则。如果不符合,请提供修改建议。 下面是一篇文章的开头: ‘为了探讨这个主题,本文将提供一系列数据和实例,以证明这一观点。’",

"input": "",

"output": "这个开头符合语法规则。"

}由于数据量很大,我们无法统计出训练数据集中各任务的真实占比,

但从 [1000条评测集] 数据分布可以推测出,训练数据集中同样包含:摘要、问答、分类等任务。

BELLE - 评测集分布

我们按照类别对评测数据进行采样,结果如下:

| 任务名称 | 例子 |

|---|---|

| 文本生成 | 为一种智能手表编写用户手册,包括详细的使用说明和操作步骤。 |

| 头脑风暴 | 针对给定的主题,进行头脑风暴并记录所有想法。 如何提高公司的销售额? |

| 开放域问答 | 用一两句话描述著名的尼罗河是如何形成的。 |

| 封闭域问答 | 从以下选项中选择正确的词汇填空以完整下面的句子。 他喜欢去_______看电影。A) 邮局 B)超市 C)电影院 D)音乐会 |

| 分类 | 请将以下这篇文章分类为新闻报道、科学文章或社论。 据媒体新闻援引美国福克斯新闻网报道,美国伯克希尔哈撒韦公司首席执行官、著名投资人巴菲特近日就美国银行业危机与总统拜登的团队进行对话。 |

| 抽取 | 基于以下表格,请问张三的考勤情况 员工姓名,日期,上班时间,下班时间,是否迟到,是否早退,是否请假 张三,1月1日,8:30,17:30,否,否,否 李四,1月1日,9:00,18:00,是,否,否 王五,1月1日,8:00,16:30,否,是,否 赵六,1月1日,8:30,17:00,否,否,是 张三,1月2日,8:00,17:00,否,否,否 李四,1月2日,8:30,17:30,否,否,否 王五,1月2日,9:00,18:00,是,否,否 赵六,1月2日,8:30,17:00,否,否,是 |

| 重写 | 根据提供的文本重写其中的一段,使之更加简明扼要,同时不丢失原文本的主要信息。 纽约市,简称“纽约”,通常被称为“大苹果”,是美国最大的城市,也是全世界最大的城市之一。位于美国东海岸,东北部边界是大西洋,在新泽西州的东南部。 |

| 摘要 | 基于下面的这个故事,总结其中最重要的三个事件。 小明是一个好学生,每天早上都要起得很早去上学。有一天,他迟到了,因为他的家里来了一个客人。晚上,他参加了一次班级会议,会议主题是如何提高学习效率。回到家后,他又花了一些时间复习功课。 |

| Code & Math | 按照以下要求,写一个SQL查询语句:从表中查找所有性别为女性的学生的姓名和学号。 SELECT name, id FROM students WHERE gender = '女性' |

- Vicuna

- BAIZE

2.3 模型的评测方法

比起预训练(Pretrain)环节里相对明确的评价指标(如PPL、NLL等),

Instruction 环节中的评价指标比较令人头疼。

鉴于语言生成模型的发展速度,BLEU 和 ROUGH 这样的指标已经不再客观。

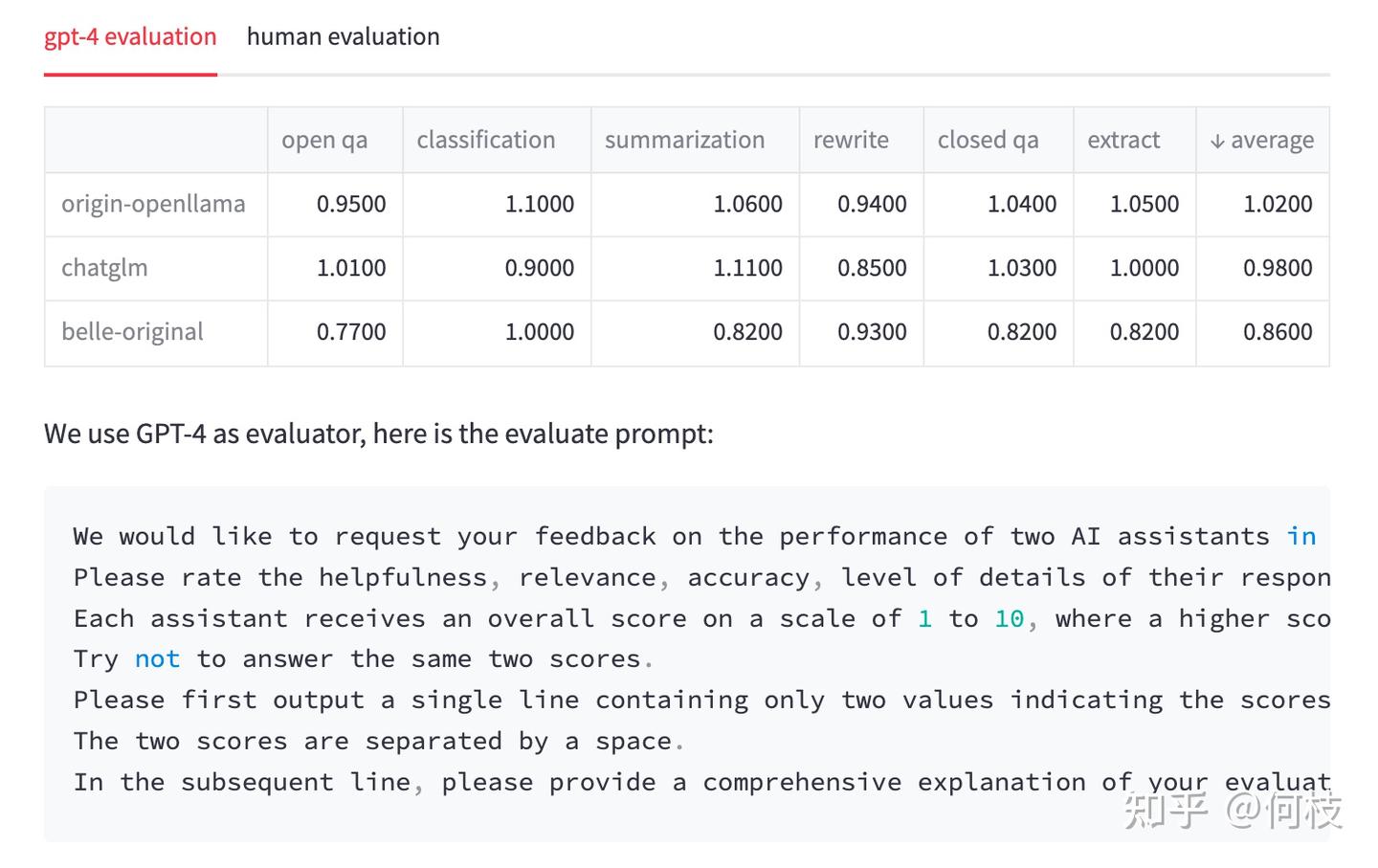

一种比较流行的方式是像 [FastChat] 中一样,利用 GPT-4 为模型的生成结果打分,

我们也尝试使用同样的 Prompt 对 3 种开源模型:OpenLlama、ChatGLM、BELLE 进行测试。

注意:下面的测试结果仅源自我们自己的实验, 不具备任何权威性。

对于每一个问题,我们先获得 ChatGPT 的回复,以及另外 3 种模型的回复,

接着我们将 「ChatGPT 答案 - 候选模型答案」这样的 pair 喂给 GPT-4 打分(满分为 10 分)。

得到的结果如下:

测试结果 & 测试 prompt

我们对每个任务单独进行了统计,并在最后一列求得平均值。

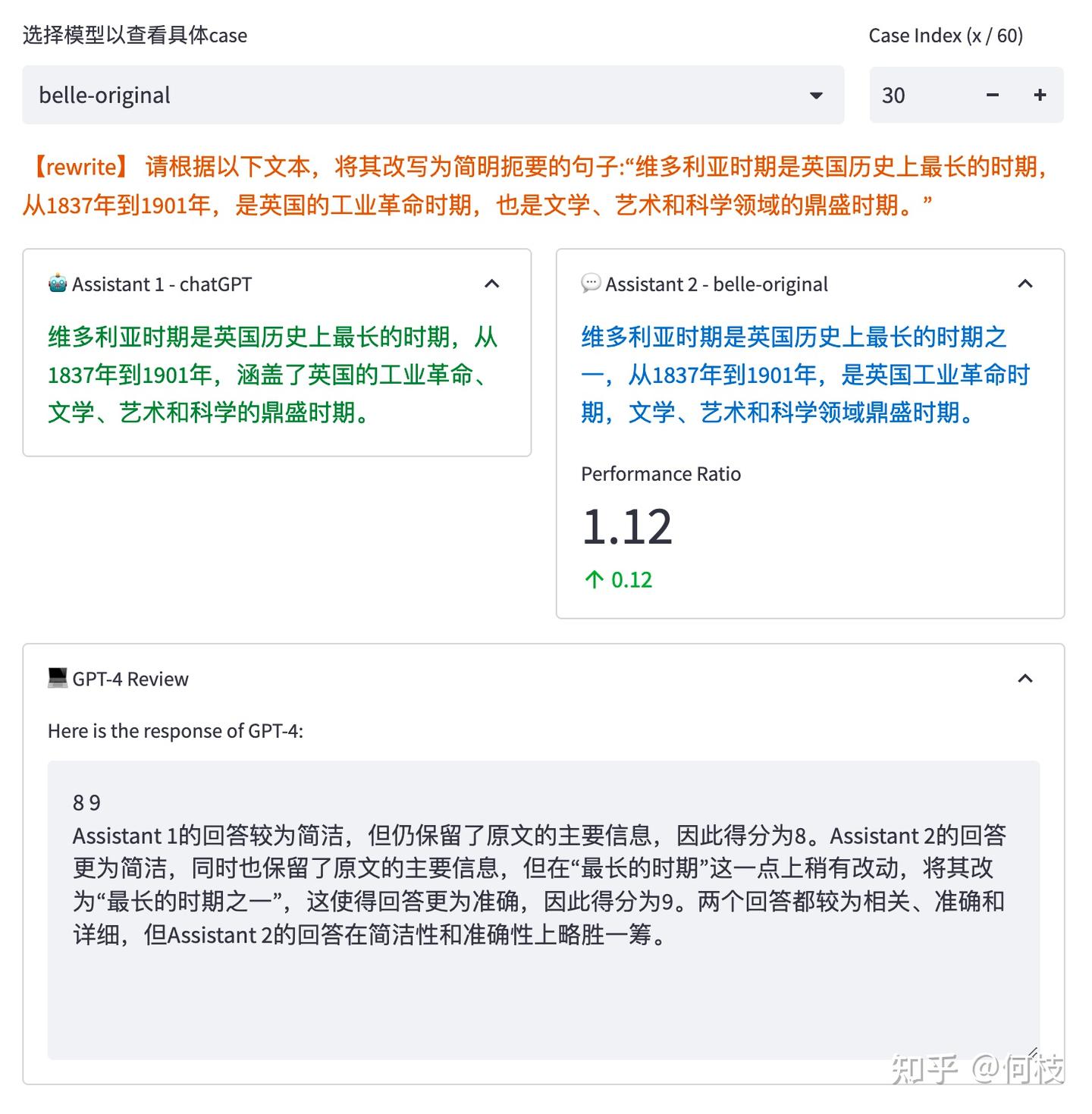

GPT-4 会对每一条测试样本的 2 个答案分别进行打分,并给出打分理由:

GPT-Review 的结果

但是,我们发现,GPT-4 打出的分数和给出理由并不一定正确。

如上图所示,GPT-4 为右边模型的答案打出了更高的分数,给出的理由是:

将「最长时期」改为了「最长时期之一」会更准确。

但事实上,Instruction 中明确设定就是「最长时期」,

这种「给高分」的理由其实是不正确的。

此外,我们还发现,仅仅调换句子顺序也会对最后打分结果产生影响,

针对这个问题,我们考虑「调换句子顺序并求和平均」来缓解。

但不管怎么样,GPT-4 给出的分数或许并没有我们想象中的那么靠谱,

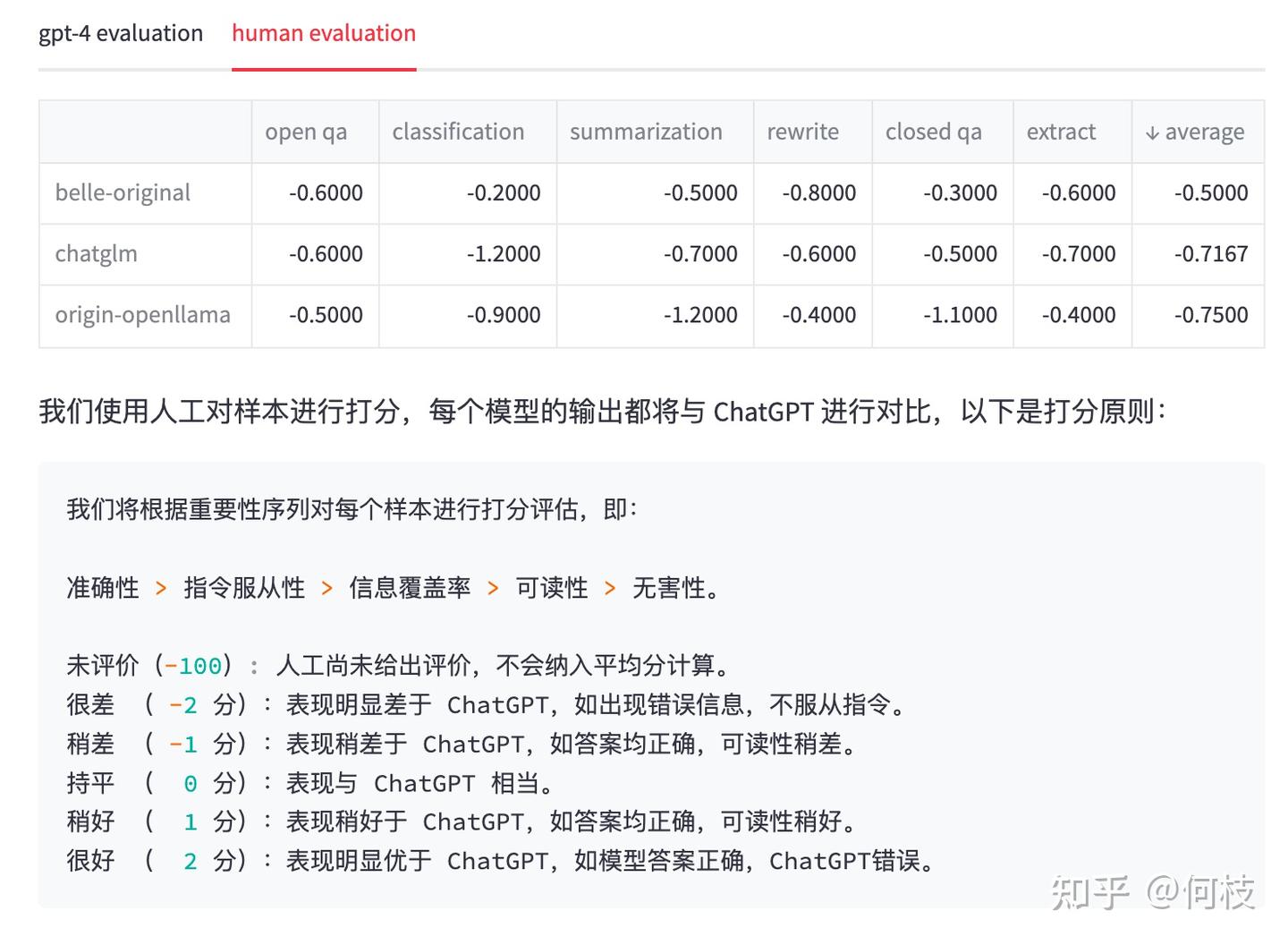

为此,我们通过人工的 Review 的方式对每个答案进行了一次回扫,得到的结果和标准如下:

再次重申:我们只是期望指出 GPT-4 打分可能会和实际产生偏差的问题, 这里排名不具备任何权威性。

人工 Review 结果 & 打分原则

我们可以看到,

在 GPT-4 打分的结果中,已经有模型的效果甚至超过了 ChatGPT(分数为 1.02),

但再经过人工 Review 后,ChatGPT 的答案是我们认为更合理一些的。

体验大模型:

如何安装使用claude code参见:https://blog.csdn.net/mystic_codes/article/details/160501281?spm=1001.2014.3001.5501

# 通过claude code方式,使用deepseek-v4-flash来体验

# 通过https://teniuapi.online,的令牌管理,新建自己的TENIU API Key

# 替换`TENIUAPI_API_KEY` 为您新建的 TENIU API Key

{

"env": {

"ANTHROPIC_BASE_URL": "https://teniuapi.online",

"ANTHROPIC_AUTH_TOKEN": "TENIUAPI_API_KEY",

"API_TIMEOUT_MS": "3000000",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": 1,

"ANTHROPIC_MODEL": "deepseek-v4-flash",

"ANTHROPIC_SMALL_FAST_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash"

}

}更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)