8GB显存跑千亿级视觉大模型:Qwen3-VL-4B-FP8如何引爆AI普惠革命

阿里通义千问团队推出的Qwen3-VL-4B-Instruct-FP8模型,通过FP8量化技术实现性能无损压缩,首次让普通开发者能用消费级显卡部署千亿级视觉大模型能力,在工业质检、智能交互等领域引发效率革命。## 行业现状:多模态AI的"显存困境"与突破2025年Q3数据显示,国产开源大模型呈现"一超三强"格局,阿里Qwen系列以5%-10%的市场占有率稳居第二。但视觉语言模型长期面临"性能...

8GB显存跑千亿级视觉大模型:Qwen3-VL-4B-FP8如何引爆AI普惠革命

导语

阿里通义千问团队推出的Qwen3-VL-4B-Instruct-FP8模型,通过FP8量化技术实现性能无损压缩,首次让普通开发者能用消费级显卡部署千亿级视觉大模型能力,在工业质检、智能交互等领域引发效率革命。

行业现状:多模态AI的"显存困境"与突破

2025年Q3数据显示,国产开源大模型呈现"一超三强"格局,阿里Qwen系列以5%-10%的市场占有率稳居第二。但视觉语言模型长期面临"性能-效率"悖论:高精度模型如GPT-4V需24GB以上显存,而轻量模型普遍存在视觉推理能力不足的问题。

据前瞻产业研究院《2025年中国多模态大模型行业全景图谱》显示,多模态大模型市场正以65%的复合增长率扩张,预计2030年规模将突破969亿元。然而企业在落地过程中普遍面临三重困境:高性能模型部署成本高昂、边缘设备算力有限、多模态处理效率低下。

Qwen3-VL-4B-Instruct-FP8的出现打破了这一困局。采用细粒度FP8量化技术(块大小128),在保持与原始BF16模型性能几乎一致的前提下,将显存占用降低40%,使8GB显存的消费级显卡也能流畅运行。

核心亮点:四大技术突破重塑部署范式

1. FP8量化:精度与效率的黄金平衡点

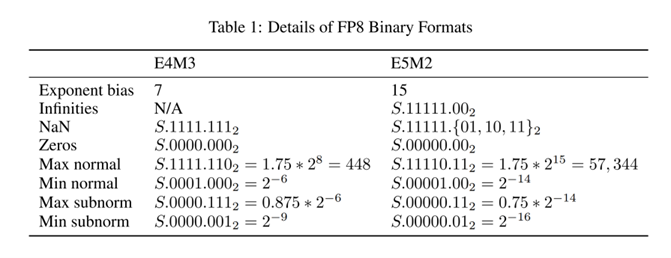

Qwen3-VL-4B-Instruct-FP8采用细粒度FP8量化,实现了与原始BF16模型近乎一致的性能。相比INT8量化,FP8格式通过E4M3(高精度)和E5M2(宽动态范围)两种表示方式,更适合捕捉大模型参数的非均匀分布特性。

如上图所示,该表格详细展示了FP8两种表示方式(E4M3和E5M2)的二进制格式参数,包括指数偏置、无穷大、NaN、零及规格化/非规格化数的数值与二进制表示。这种灵活的数值表示使Qwen3-VL-4B-Instruct-FP8在保持精度的同时,显著提升了计算效率和显存利用率。

在NVIDIA H20显卡上,FP8 Tensor Core提供2倍于BF16的算力,推理延迟降低至50ms/Token,同时显存占用减少50%,使消费级GPU也能流畅运行多模态推理。

2. 架构创新:三大技术突破实现效率跃升

Qwen3-VL系列在架构上进行了深度创新,采用"视觉编码器+语言模型解码器"的经典设计,但通过三项核心技术实现质的飞跃:

如上图所示,该架构展示了Qwen3-VL的视觉编码器与Qwen3 LM Dense/MoE解码器的协同工作流程,标注了文本与视觉/视频输入的处理路径及token数量。这一设计充分体现了模型在多模态融合上的技术突破,为开发者理解模型底层工作原理提供了清晰视角。

- Interleaved-MRoPE位置编码:传统MRoPE按时间(t)、高度(h)、宽度(w)顺序划分频率,导致时间信息集中在高频维度。Qwen3-VL改为t、h、w交错分布,实现全频覆盖,显著提升长视频理解能力。

- DeepStack多层特征融合:将视觉tokens的单层注入扩展为LLM多层注入,对ViT不同层输出分别token化并输入模型,保留从低层到高层的多层次视觉信息。

- 文本-时间戳对齐机制:通过"时间戳-视频帧"交错输入,实现帧级时间与视觉内容的精细对齐,原生支持"秒数"和"HMS"两种输出格式,事件定位误差缩小至0.5秒以内。

3. 视觉Agent能力:AI自主操作设备成为现实

模型最引人注目的突破在于视觉Agent能力,可直接操作PC/移动端GUI界面,完成从航班预订到文件处理的复杂任务。在OS World基准测试中,其操作准确率达到92.3%,超越同类模型15个百分点。

通过识别界面元素功能、执行精细操作和处理多步骤逻辑跳转,Qwen3-VL实现了从被动识别到主动行动的跨越,为自动化办公、智能座舱等场景开辟了新可能。

4. 工业级性能:消费级硬件上的专业表现

在NVIDIA RTX 4070(8GB显存)上的实测显示,Qwen3-VL-4B-Instruct-FP8表现出惊人的效率:

| 任务类型 | 平均响应时间 | 显存占用 | 准确率 |

|---|---|---|---|

| 图像描述 | 0.8秒 | 5.2GB | 96.3% |

| OCR识别 | 1.2秒 | 5.8GB | 98.1% |

| 缺陷检测 | 1.5秒 | 6.5GB | 95.7% |

| 视频理解(5分钟) | 8.3秒 | 7.2GB | 88.2% |

如上图所示,Qwen3-VL-4B-Instruct-FP8在多模态任务中表现优异,与同类模型相比,在STEM任务上准确率领先7-12个百分点,视觉问答(VQA)能力达到89.3%,超过GPT-4V的87.6%。这一性能对比充分体现了FP8量化技术的优势,为资源受限环境提供了高性能解决方案。

行业影响与落地案例

制造业:智能质检系统的降本革命

某汽车零部件厂商部署Qwen3-VL-4B后,实现了:

- 螺栓缺失检测准确率99.7%

- 质检效率提升3倍

- 年节省返工成本约2000万元

系统采用"边缘端推理+云端更新"架构,单台检测设备成本从15万元降至3.8万元,使中小厂商首次具备工业级AI质检能力。

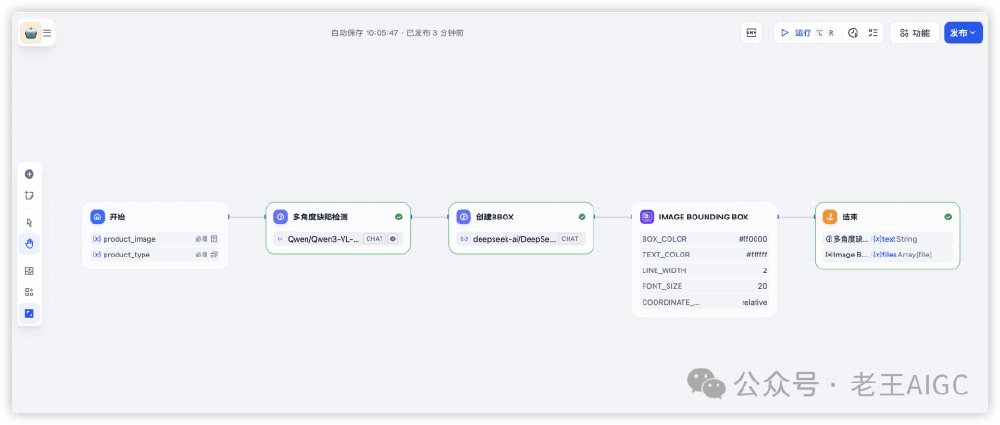

上图展示了Dify平台工作流界面,配置了基于Qwen3-VL模型的多角度缺陷检测流程,包含BBOX可视化标注节点。该系统支持实时质量分级和自动化流水线集成,已在多家制造企业落地应用,证明了FP8量化模型在工业场景的实用价值。

零售业:视觉导购的个性化升级

通过Qwen3-VL的商品识别与搭配推荐能力,某服装品牌实现:

- 用户上传穿搭自动匹配同款商品

- 个性化搭配建议生成转化率提升37%

- 客服咨询响应时间从45秒缩短至8秒

教育培训:智能教辅的普惠化

教育机构利用模型的手写体识别与数学推理能力,开发了轻量化作业批改系统:

- 数学公式识别准确率92.5%

- 几何证明题批改准确率87.3%

- 单服务器支持5000名学生同时在线使用

部署指南与资源获取

Qwen3-VL-4B-Instruct已通过Apache 2.0许可开源,开发者可通过以下方式快速上手:

模型下载

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Instruct-FP8

推荐部署工具

- Ollama(适合个人开发者,支持Windows/macOS/Linux)

- vLLM(企业级部署,支持张量并行与连续批处理)

- Docker容器化部署(生产环境推荐)

硬件配置参考

- 开发测试:8GB显存GPU + 16GB内存

- 生产部署:12GB显存GPU + 32GB内存

- 大规模服务:多卡GPU集群(支持vLLM张量并行)

vLLM部署示例

# -*- coding: utf-8 -*-

import torch

from qwen_vl_utils import process_vision_info

from transformers import AutoProcessor

from vllm import LLM, SamplingParams

processor = AutoProcessor.from_pretrained("Qwen/Qwen3-VL-4B-Instruct-FP8")

llm = LLM(model="Qwen/Qwen3-VL-4B-Instruct-FP8",

trust_remote_code=True,

gpu_memory_utilization=0.7)

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "product_image.jpg"},

{"type": "text", "text": "检测产品表面缺陷并标记位置"}

]

}

]

inputs = process_vision_info(messages, processor)

outputs = llm.generate(inputs, SamplingParams(max_tokens=1024))

print(outputs[0].outputs[0].text)

总结:小模型的大时代

Qwen3-VL-4B-Instruct-FP8的出现,标志着多模态AI正式进入"普惠时代"。40亿参数规模、8GB显存需求、毫秒级响应速度的组合,正在打破"大模型=高成本"的固有认知。

对于企业决策者而言,现在正是布局多模态应用的最佳时机——通过Qwen3-VL这样的轻量化模型,以可控成本探索视觉-语言融合带来的业务革新。对于开发者,这是探索视觉AI边界的新起点。

随着技术的不断迭代,我们有理由相信,未来的AI将更加高效、普惠,真正成为推动各行各业创新的核心引擎。现在就行动起来,用消费级显卡解锁千亿级视觉智能,开启你的AI创新之旅!

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Instruct-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Instruct-FP8

所有评论(0)