开源RAG工具Verba,快速搭建个人知识库问答系统

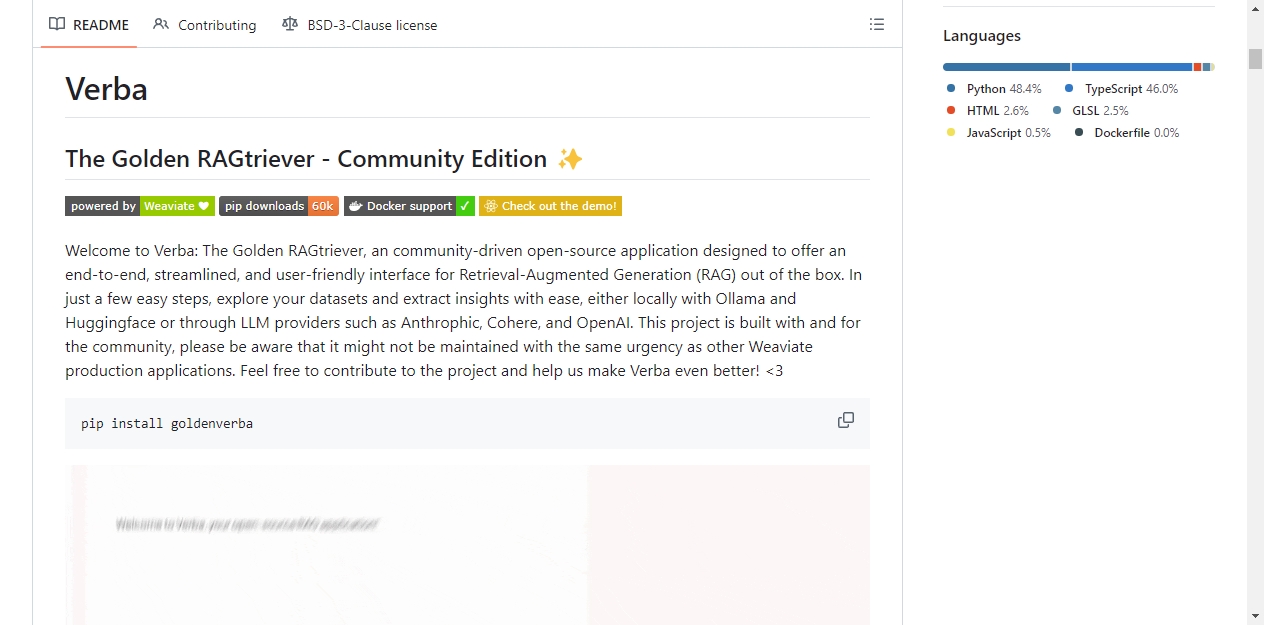

Verba是一款开源RAG工具(GitHub Star 7688),可快速搭建个人知识库问答系统。它支持多种数据源导入(PDF/CSV/DOCX等)和主流大模型接入(OpenAI/Claude/Ollama等),提供混合搜索、自动补全等RAG功能。部署方式灵活,支持pip安装、Docker和源码构建,适合个人或小团队使用。项目社区驱动,暂不支持多用户协作权限控制,但具备二次开发能力。通过简单配置即

开源RAG工具Verba,快速搭建个人知识库问答系统

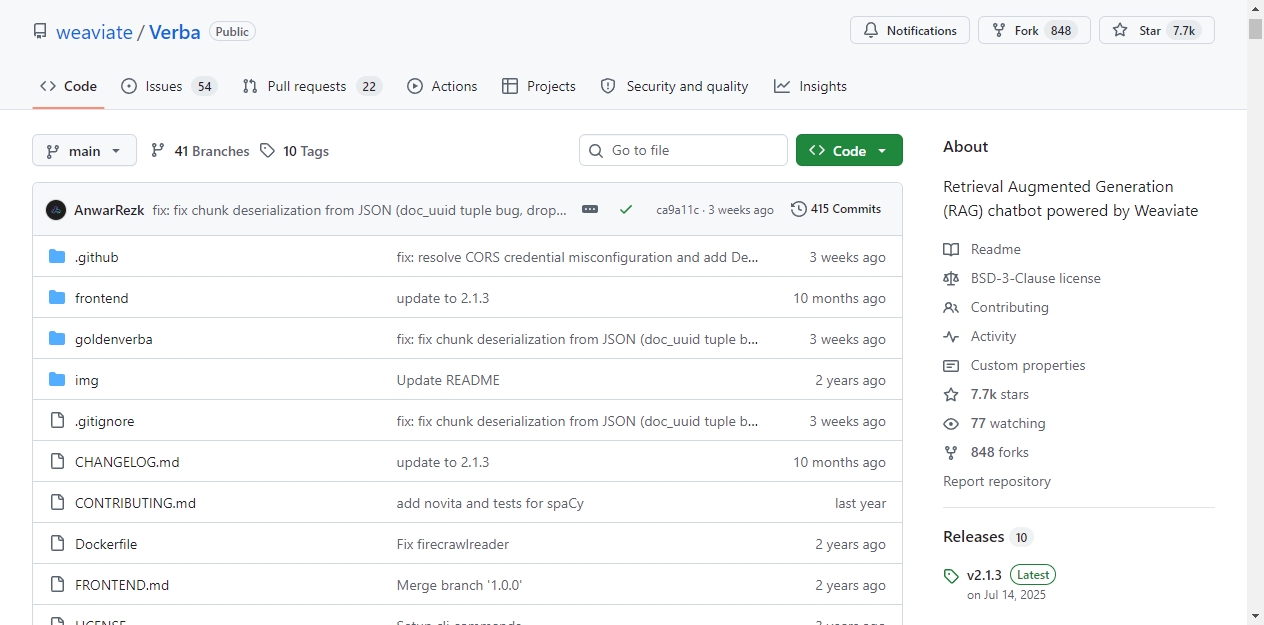

GitHub项目weaviate/Verba当前Star数7688,是面向社区的开源检索增强生成应用,开箱即可提供端到端的RAG交互界面。用户可通过几步操作,实现对自有数据集的查询和信息提取,支持本地部署对接Ollama、Huggingface模型,也可接入Anthropic、Cohere、OpenAI等主流大模型服务。

Verba的核心功能围绕RAG全流程设计,支持多类模型接入。生成模型包含Ollama本地模型、Cohere、Anthropic Claude系列、OpenAI GPT系列、Groq、Novita AI等选项。嵌入模型支持Weaviate内置、Ollama本地、SentenceTransformers、Cohere、VoyageAI、OpenAI等方案,用户可根据使用场景灵活选择。

数据导入方面,Verba支持UnstructuredIO、Firecrawl、Upstage Document AI等数据源接入,可直接导入PDF、CSV、DOCX、GitHub/GitLab仓库文件,也可通过AssemblyAI导入并转录音频文件。内置的RAG特性包含混合搜索、自动补全建议、查询前过滤、自定义元数据、异步导入等功能,满足多数个人和小团队的知识库使用需求。

分块技术支持Token、句子、语义、递归、HTML、Markdown、代码、JSON等多种分块策略,用户可根据文档类型选择合适的分块方式,提升检索准确率。额外提供Docker部署支持、可自定义前端、3D向量查看器等功能,方便有开发能力的用户进行二次调整。

部署方式提供三种选项。通过pip安装的用户,只需执行pip install goldenverba,再运行verba start即可启动服务,访问localhost:8000使用。从源码构建的用户,克隆仓库后在虚拟环境中执行pip install -e .,再启动服务即可。使用Docker部署的用户,可直接拉取官方镜像,或克隆仓库后通过docker compose启动。

环境变量配置方面,用户可在.env文件中设置各服务商的API密钥,也可直接在前端界面输入。支持的配置项包含Weaviate连接信息、各模型服务商密钥、Ollama连接地址、默认部署模式、系统提示词等,可满足不同部署场景的需求。

连接Weaviate实例时,用户可选择本地嵌入式部署、Docker部署、Weaviate云服务部署,或自定义部署地址。需要注意的是,Weaviate嵌入式部署暂不支持Windows系统,Windows用户可选择Docker或云服务部署方案。

项目定位为社区驱动的开源工具,维护节奏可能慢于官方生产级应用,接受社区贡献。适合个人用户搭建私有知识库,或小团队内部文档查询使用。对于需要多用户协作、角色权限控制的场景,当前版本暂不支持。

作、角色权限控制的场景,当前版本暂不支持。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)