【亲测有效】DeepSeek极简入门与应用_51.[第2章 DeepSeek基础] 新手最常问的20个问题:DeepSeek使用FAQ大全

DeepSeek新手避坑指南(150字摘要) 本文针对DeepSeek AI工具新手常见问题,总结6大核心模块解决方案:1.账号与访问需区分网页版与API的免费/付费机制,合理控制Token消耗;2.提示词工程强调结构化提问,通过角色定义、任务拆解和格式控制提升输出质量;3.模型选择场景化,V3适合日常任务,R1专攻复杂推理;4.输出质量可通过参数调节优化;5.工作流整合推荐IDE插件分段处理文件

从"这玩意儿咋用"到"真香警告":DeepSeek新手避坑全指南,20个灵魂拷问一次性解决,看完少踩80%的坑,效率直接翻倍!

目录速览

- 账号与访问:从注册到额度,新手第一关

- 提示词工程:别让烂Prompt毁了你的体验

- 模型选择:V3和R1,用对场景才真香

- 输出质量:回答不满意?可能是你不会"调教"

- 工作流整合:让DeepSeek真正融入你的开发环境

- 安全与隐私:程序员最关心的底线问题

嗨,大家好呀,我是你的老朋友精通代码大仙。接下来我们一起学习 《DeepSeek极简入门与应用》,震撼你的学习轨迹!

“工欲善其事,必先利其器”——这话咱程序员都听腻了,但真到了用AI工具的时候,多少人拿着"神器"当"板砖"使?

我见过太多新手了:兴冲冲注册DeepSeek,噼里啪啦敲了一堆问题,结果得到的回答要么太啰嗦、要么看不懂、要么直接跑偏。然后就开始怀疑人生:“网上吹得那么神,咋到我这儿就不行了呢?”

兄弟,问题不在工具,在用法。

今天这篇,我把新手最常问的20个问题,按场景归类成6大模块,一次性给你讲透。看完你会发现:不是DeepSeek不行,是你还没掌握打开它的正确方式。

一、账号与访问:从注册到额度,新手第一关

点题

这是每个新手的起点:账号怎么注册?API额度够不够用?免费版和付费版到底差在哪?

痛点分析

痛点1:注册时的各种"拦路虎"

有些小伙伴卡在手机号验证,有些发现网页版卡顿就以为"这玩意儿不行",还有些一上来就冲API,结果没搞清楚额度规则,调用两次就报错"余额不足",当场心态爆炸。

更典型的误区是"额度焦虑"——听说DeepSeek便宜,但没搞明白Token怎么算,写个Prompt测试几下,看着数字往下掉,手都在抖:“这不会把我工资烧没吧?”

痛点2:免费与付费的边界模糊

很多人不知道:网页版免费对话和API调用是完全两套体系。网页版你聊到天荒地老(只要服务器扛得住),API是按Token计费。结果有人网页版用得爽,一转API就懵:“怎么还要钱?”

真实踩坑案例:

小王想做个自动总结文档的工具,抄了网上一段API代码,跑了个100页的PDF,结果账单出来傻眼了——原来他把整个PDF当Prompt塞进去,Token数直接爆炸。正确的做法应该是分段处理,或者用文件上传接口。

解决方案/正确做法

第一,搞清楚你的使用场景

| 场景 | 推荐方式 | 原因 |

|---|---|---|

| 日常问答、学习、灵感 | 网页版/APP | 免费、即开即用 |

| 自动化脚本、批量处理 | API | 可编程、可集成 |

| 企业级应用、高并发 | 官方企业服务 | 稳定、有SLA保障 |

第二,Token计算心里有数

简单说:1个中文汉字≈1-2个Token,1个英文单词≈1个Token。DeepSeek的定价大概是百万Token几块钱,日常调试花不了多少。但记住:输入+输出都算Token,长文档别一次性塞。

# 省钱小技巧:先估算再调用

def estimate_tokens(text):

# 粗略估算:中文字符数 + 英文单词数

chinese_chars = len([c for c in text if '\u4e00' <= c <= '\u9fff'])

english_words = len(text.split()) - chinese_chars # 简化估算

return chinese_chars * 1.5 + english_words

# 超过8000 Token就考虑分段

if estimate_tokens(long_document) > 8000:

chunks = split_document(long_document) # 自己实现分段逻辑

第三,额度管理三板斧

- 设置消费上限(控制台里可以配)

- 测试阶段用短文本验证逻辑

- 正式跑批量任务前,先用小样本估算总成本

小结

账号和额度不是技术问题,是成本意识问题。先用透免费版,再按需上API,别一上来就"火力全开",钱包会感谢你的。

二、提示词工程:别让烂Prompt毁了你的体验

点题

同样的DeepSeek,有人用得像"人工智障",有人用得像"赛博导师"——差距就在Prompt怎么写。

痛点分析

痛点1:提问太笼统,回答太宽泛

“帮我写个爬虫”——这种提问,DeepSeek只能给你个通用模板,根本不符合你的具体需求。然后你觉得"这AI不行",其实是你没给够信息。

痛点2:不会用格式控制输出

想要JSON格式?想要表格?想要分步骤?你不说,DeepSeek就按自己最舒服的方式回答,结果你还得手动整理,费时费力。

痛点3:多轮对话不会"带节奏"

新手常犯的错:每轮对话都从零开始,不引用之前的上下文。结果DeepSeek"失忆",反复问同样的问题,你越用越烦躁。

典型翻车现场:

用户:Python怎么连接数据库?

DeepSeek:(给出通用pymysql示例)

用户:那怎么查数据?

DeepSeek:(又给一个通用示例,但和上面的连接代码风格不一致)

用户:刚才的连接代码呢?

DeepSeek:什么连接代码?我们不是在聊查询吗?

解决方案/正确做法

技巧1:结构化Prompt公式

【角色】你是一位有10年经验的后端架构师

【任务】帮我设计一个用户登录接口

【背景】使用Python FastAPI框架,需要支持JWT token,用户表已有字段:id, username, password_hash

【输出要求】

1. 给出完整的router代码

2. 包含输入校验(pydantic模型)

3. 密码使用bcrypt加密

4. 用代码注释说明关键逻辑

技巧2:格式控制三板斧

| 想要的效果 | 写法 |

|---|---|

| JSON输出 | “请用JSON格式返回,包含status和data字段” |

| 表格对比 | “用Markdown表格对比方案A和方案B的优缺点” |

| 分步骤 | “分3步说明:①环境准备 ②核心代码 ③测试验证” |

| 代码块 | “只返回代码,不要解释,代码用```python包裹” |

技巧3:多轮对话的"记忆术"

# 伪代码示意:维护对话上下文

conversation_history = [

{"role": "user", "content": "我要用FastAPI做登录接口..."},

{"role": "assistant", "content": "好的,建议用JWT方案..."},

# 关键:把历史记录带着一起发

]

# 新一轮提问时,先总结上下文

new_prompt = f"""基于我们之前的讨论({summary}),我现在想问:

怎么给这个接口加限流保护?"""

实战案例对比:

❌ 烂Prompt:

“写个排序算法”

✅ 好Prompt:

“用Python实现快速排序,要求:①处理包含重复元素的列表 ②空间复杂度O(log n) ③给出3个测试用例及预期输出 ④在代码注释中说明pivot的选择策略”

小结

Prompt不是"说话",是编程。越具体、越结构化、越带约束条件,DeepSeek的表现就越稳。记住: garbage in, garbage out,这话对AI同样适用。

三、模型选择:V3和R1,用对场景才真香

点题

DeepSeek有两个主力模型:V3(通用版)和R1(推理版)。选错了,事倍功半;选对了,如虎添翼。

痛点分析

痛点1:根本不知道有两个模型

很多新手压根没注意模型切换选项,一直用默认的V3,遇到数学推理、代码调试等复杂任务时,觉得"DeepSeek也就这样"。

痛点2:该用R1的时候舍不得

R1推理时间长一点、成本高一点点,但有些人为了省那几毛钱,硬用V3解复杂算法题,结果得反复追问,时间成本远超模型差价。

痛点3:对模型能力边界有误解

以为R1"无所不能",结果扔给它一个需要实时信息的任务(比如"今天北京天气"),它照样抓瞎——R1强在推理,不是强在联网。

解决方案/正确做法

场景对照表

| 场景 | 推荐模型 | 原因 |

|---|---|---|

| 写业务代码、改Bug | R1 | 能追踪复杂逻辑,定位深层问题 |

| 解算法题、数学证明 | R1 | 思维链展示,方便你学习思路 |

| 日常问答、翻译、总结 | V3 | 响应快,成本低,足够用 |

| 创意写作、头脑风暴 | V3 | 发散性强,不会过度"较真" |

| 需要实时信息的任务 | V3+RAG/联网 | 模型本身不带实时数据 |

R1的正确打开方式

R1最大的价值不是"答案",是思维过程。看它是怎么一步步拆解问题的,这比答案本身更值钱。

示例:用R1调试一个递归函数

你:这个快速排序递归栈溢出了,帮我看看

[粘贴代码]

R1的思考过程(会显示出来):

1. 首先检查递归终止条件... 发现当数组全为相同元素时,pivot选择导致无限划分

2. 问题定位:第15行的partition函数,没有处理等于pivot的情况

3. 建议修改:采用三向切分(Dutch National Flag)算法...

你:不仅得到了答案,还学到了"三向切分"这个知识点

成本控制技巧

开发调试阶段用R1,确认方案后批量执行可切回V3;或者先用R1生成高质量示例,再用V3做变体生成。

小结

V3是"瑞士军刀",R1是"手术刀"。日常用V3,攻坚上R1,别让模型错配拖慢你的进度。

四、输出质量:回答不满意?可能是你不会"调教"

点题

DeepSeek的回答质量不稳定?先别急着骂,学会这几招"调教"技巧,让它从"还行"变"真香"。

痛点分析

痛点1:回答太啰嗦,抓不住重点

尤其是R1,思维链一长,输出动辄几千字,你想找个关键代码片段,得翻半天。

痛点2:代码能跑但有"隐形bug"

AI生成的代码往往"看起来对",但边界条件、异常处理、性能陷阱一个不少。新手直接复制粘贴,上线就翻车。

痛点3:专业领域"一本正经地胡说"

问一些冷门技术细节,DeepSeek可能会"脑补"不存在的API或参数,你还以为学到了新知识,其实是被带偏了。

血泪案例:

小李让DeepSeek写个Python多线程爬虫,代码跑得挺顺,结果爬了10万条数据后内存爆炸。后来才发现,AI给的代码没做队列大小限制,生产者消费者严重失衡——这种"能跑但脆弱"的代码,最坑人。

解决方案/正确做法

调教技巧1:输出长度控制

在Prompt末尾加约束:

- "控制在500字以内"

- "分点说明,每点不超过20字"

- "先给结论,再给细节"

- "如果内容超过3点,只列最重要的3点"

调教技巧2:代码质量加固

拿到代码后,强制自己过一遍这个 checklist:

# AI生成代码自检清单

def review_ai_code(code, context):

checks = [

"边界条件:空输入、极大值、特殊字符处理了吗?",

"异常处理:网络超时、文件不存在、权限不足?",

"资源释放:文件句柄、数据库连接、线程池关闭?",

"并发安全:多线程/多进程下的竞态条件?",

"性能陷阱:是否有O(n²)嵌套循环?大数据量会卡吗?",

"可测试性:关键逻辑能单独测试吗?"

]

# 逐条问DeepSeek,或者自己检查

return [c for c in checks if not satisfied(c, code)]

调教技巧3:事实核查 workflow

对于技术细节,养成"双源验证"习惯:

Step 1: 让DeepSeek给出答案

Step 2: 追问"这个API的参数有哪些?官方文档链接是?"

Step 3: 交叉验证:去官方文档、Stack Overflow、GitHub Issues确认

Step 4: 小范围测试验证后再大规模使用

调教技巧4:迭代优化对话

别指望一次Prompt就完美,学会"打补丁":

第一轮:给出基础实现

第二轮:"在第X行加异常处理"

第三轮:"把重复逻辑抽成函数"

第四轮:"给这个函数加单元测试"

小结

DeepSeek是副驾驶,不是自动驾驶。输出质量=你的提问质量+你的审核质量。学会"调教",它才能持续进化成你的专属助手。

五、工作流整合:让DeepSeek真正融入你的开发环境

点题

在网页版聊天只是起步,把DeepSeek嵌进IDE、自动化脚本、团队协作,才是效率的质变。

痛点分析

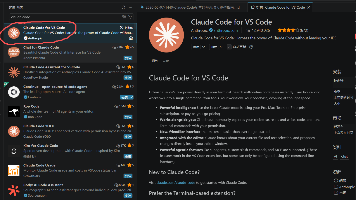

痛点1:IDE插件配置踩坑

VS Code、JetBrains的DeepSeek插件,API key配不对、模型选不了、快捷键冲突——配置半小时,coding五分钟,热情全消磨。

痛点2:文件上传的隐形限制

想传个代码库让AI分析,发现大小超限、格式不支持、上下文截断,只能一段段复制粘贴,效率暴跌。

痛点3:团队知识库无法沉淀

个人用着爽,团队没法共享Prompt、没法复用对话历史,每个人都在重复造轮子。

解决方案/正确做法

整合方案1:IDE深度集成

以VS Code为例,推荐配置流程:

1. 安装 Continue 或 Cline 插件(支持DeepSeek API)

2. 配置config.json:

{

"models": [{

"title": "DeepSeek V3",

"provider": "deepseek",

"model": "deepseek-chat",

"apiKey": "your-key"

},{

"title": "DeepSeek R1",

"provider": "deepseek",

"model": "deepseek-reasoner",

"apiKey": "your-key"

}]

}

3. 设置快捷键:Ctrl+Shift+L 唤起对话,Ctrl+Shift+K 解释选中代码

4. 关键:配置代码片段引用,让AI能看到当前文件的上下文

整合方案2:文件处理的正确姿势

| 场景 | 方案 | 工具/技巧 |

|---|---|---|

| 单个大文件 | 分段+摘要 | 先让AI总结每段,再整体分析 |

| 整个代码库 | 构建RAG知识库 | 用Codebase索引工具,如repomix |

| 结构化数据 | 转Markdown/JSON | 保持格式清晰,方便AI解析 |

| 图片/Diagram | 用支持多模态的版本 | 或先用OCR提取文字 |

实战:批量代码审查脚本

# 用DeepSeek API做自动化Code Review

import os

from deepseek import DeepSeekAPI

def review_file(file_path):

with open(file_path, 'r', encoding='utf-8') as f:

code = f.read()

# 控制Token:只审函数级别的代码

if len(code) > 8000:

return "文件过大,建议拆分后审查"

prompt = f"""作为资深工程师,审查以下代码:

```python

{code}

关注:安全性、性能、可读性、Pythonic写法。

输出格式:问题行号 | 严重程度 | 具体建议"“”

response = client.chat.completions.create(

model="deepseek-reasoner",

messages=[{"role": "user", "content": prompt}]

)

return response.choices[0].message.content

批量处理src目录

for root, dirs, files in os.walk(‘./src’):

for file in files:

if file.endswith(‘.py’):

result = review_file(os.path.join(root, file))

save_review_result(file, result)

**整合方案3:团队知识库建设**

推荐工具链:

- Prompt管理:LangChain Hub / 自建Git仓库

- 对话历史:Notion/飞书文档,按场景分类(Debug/设计/学习)

- 最佳实践:定期Review高频Prompt,提炼成团队模板

示例模板库结构:

/prompts

/debug

- python_exception.md

- sql_performance.md

/design

- api_design.md

- db_schema.md

/learning

- concept_explain.md

- code_review.md

### 小结

工具的价值在**流动**,DeepSeek要从"网页上的聊天框"变成"你工作流里的基础设施"。配置一次,受益良久,这笔时间投资绝对划算。

---

## 六、安全与隐私:程序员最关心的底线问题

### 点题

代码能不能传?公司数据会不会泄露?商业使用合法吗?这些问题不搞清,用得再爽也是埋雷。

### 痛点分析

**痛点1:"代码洁癖"与"效率焦虑"的冲突**

想请AI帮忙看代码,又怕泄露公司机密;不传吧,问题解决慢;传吧,心里不踏实。左右为难,效率卡在半空中。

**痛点2:对服务条款一知半解**

听说"数据会被用于训练",就吓得什么都不敢用;或者听说"完全安全",就大胆传核心算法——**两种极端都危险**。

**痛点3:商业使用的灰色地带**

个人学习随便用,做成产品卖钱行不行?给客户交付的代码里包含AI生成部分,版权算谁的?

### 解决方案/正确做法

**安全策略1:数据分级处理**

```mermaid

pie title 代码上传决策树

"绝对禁止上传" : 25

"脱敏后可上传" : 35

"放心上传" : 40

| 级别 | 示例 | 处理方式 |

|---|---|---|

| 🔴 核心机密 | 加密算法、密钥管理、商业逻辑 | 绝不上传,本地部署或不用 |

| 🟡 业务代码 | 具体业务规则、数据库Schema | 脱敏:变量名替换、表名泛化 |

| 🟢 通用代码 | 工具函数、标准算法、配置模板 | 可直接上传 |

脱敏实操示例:

# 原始代码(有风险)

def calculate_vip_discount(user_id, order_amount):

vip_level = db.query(f"SELECT level FROM users WHERE id={user_id}")

if vip_level == 'gold':

return order_amount * 0.85 # 公司核心折扣策略

# 脱敏后(可上传)

def calculate_discount(user_type, amount):

# 某类用户的折扣计算逻辑

level = get_user_level(user_type) # 泛化查询方式

if level == 'TYPE_A':

return amount * DISCOUNT_RATE_A # 用常量代替具体数值

安全策略2:厘清服务条款

DeepSeek官方的关键承诺(截至2025年初):

- API数据:默认不用于模型训练(网页版对话可能用于改进)

- 数据存储:有保留期,非永久存储

- 商业使用:生成的内容可商用,但建议关注最新条款更新

自保原则:定期查看官方文档的"隐私政策"和"服务条款"页面,重大决策前截图留档。

安全策略3:商业使用的合规框架

个人/小团队建议:

1. 核心算法自己写,AI辅助生成外围代码

2. AI生成代码加注释标记,便于审计

3. 关键模块保留人工Review记录

4. 对外交付前,用工具检测是否含敏感信息

企业级建议:

- 签订企业版服务协议,明确数据归属

- 考虑私有化部署或本地大模型方案

- 建立AI生成代码的合规审查流程

小结

安全和效率不是单选题,分级管理、脱敏处理、条款知情,这三板斧能让你既享受AI红利,又不踩红线。记住:谨慎不是保守,是专业。

写在最后

看完这20个问题的拆解,你会发现:DeepSeek的上手门槛其实不高,但用好用深需要方法。

从账号额度的精打细算,到Prompt的结构化表达;从V3和R1的场景选择,到输出质量的迭代调教;从IDE的深度整合,到安全隐私的底线守护——每一步都是新手到高手的必经之路。

编程之路从来不易,但好在现在有了AI这个"外挂"。它不是来替代你的,是来放大你的——放大你的学习效率,放大你的问题解决能力,放大你的技术视野。

最后送大家三句话:

“工具是死的,用法是活的。” 同样的DeepSeek,不同人手里效果天差地别,差距就在你是否愿意花10分钟学技巧,而不是10小时硬怼。

“焦虑源于未知,踏实来自实践。” 看完这篇别只收藏,打开DeepSeek,挑一个你最头疼的问题,用文中的方法试一遍。实践一次,胜过阅读十遍。

“保持好奇,持续进化。” AI发展太快了,今天的最佳实践明天可能过时。但只要你保持学习的姿态,就能始终站在浪潮之巅。

DeepSeek只是开始,更大的AI世界在等你探索。加油,咱们下篇见!

关注私信备注:“资料代找获取”,全网计算机学习资料代找:例如:

《课程:2026 年多模态大模型实战训练营》

《课程:AI 大模型工程师系统课程 (22 章完整版 持续更新)》

《课程:AI 大模型系统实战课第四期 (2026 年开课 持续更新)》

《课程:2026 年 AGI 大模型系统课 23 期》

《课程:2026 年 AGI 大模型系统课 21 期》

《课程:AI 大模型实战课 8 期 (2026 年 2 月最新完结版)》

《课程:AI 大模型系统实战课三期》

《课程:AI 大模型系统课程 (2026 年 2 月开课 持续更新)》

《课程:AI 大模型全阶课程 (2025 年 12 月开课 2026 年 6 月结课)》

《课程:AI 大模型工程师全阶课程 (2025 年 10 月开课 2026 年 4 月结课)》

《课程:2026 年最新大模型 Agent 开发系统课 (持续更新)》

《课程:LLM 多模态视觉大模型系统课》

《课程:大模型 AI 应用开发企业级项目实战课 (2026 年 1 月开课)》

《课程:大模型智能体线上速成班 V2.0》

《课程:Java+AI 大模型智能应用开发全阶课》

《课程:Python+AI 大模型实战视频教程》

《书籍:软件工程 3.0: 大模型驱动的研发新范式.pdf》

《课程:人工智能大模型系统课 (2026 年 1 月底完结版)》

《课程:AI 大模型零基础到商业实战全栈课第五期》

《课程:Vue3.5+Electron + 大模型跨平台 AI 桌面聊天应用实战 (2025)》

《课程:AI 大模型实战训练营 从入门到实战轻松上手》

《课程:2026 年 AI 大模型 RAG 与 Agent 智能体项目实战开发课》

《课程:大模型训练营配套补充资料》

更多推荐

已为社区贡献61条内容

已为社区贡献61条内容

所有评论(0)