DeepSeek 版 Claude Code:专为 DeepSeek 打造的终端编程 Agent,11.4K+ Stars 说明了这一切。

DeepSeek-TUI 是专为 DeepSeek V4 打造的终端编程 Agent,用 Rust 实现,支持流式 Reasoning 展示、1M 上下文、Auto 模式智能路由、工作区快照回滚和实时费用追踪。本文完整介绍其安装使用,并深度对比 Claude Code 的区别与各自适用场景。

你有没有想过,一个 AI 编程工具,如果从底层就专门为某个模型设计,体验会差多少?今天我体验了一下 DeepSeek-TUI,答案出乎意料。

这是什么东西?

简单来说:DeepSeek-TUI 是一个跑在终端里的 AI 编程 Agent,专为 DeepSeek V4 设计。

它能读写文件、执行 shell 命令、搜索网页、管理 git,还能协调多个子 Agent 并发工作。

全部通过一个键盘驱动的 TUI 界面完成,类似于终端AI Agent 【Claude Code】。

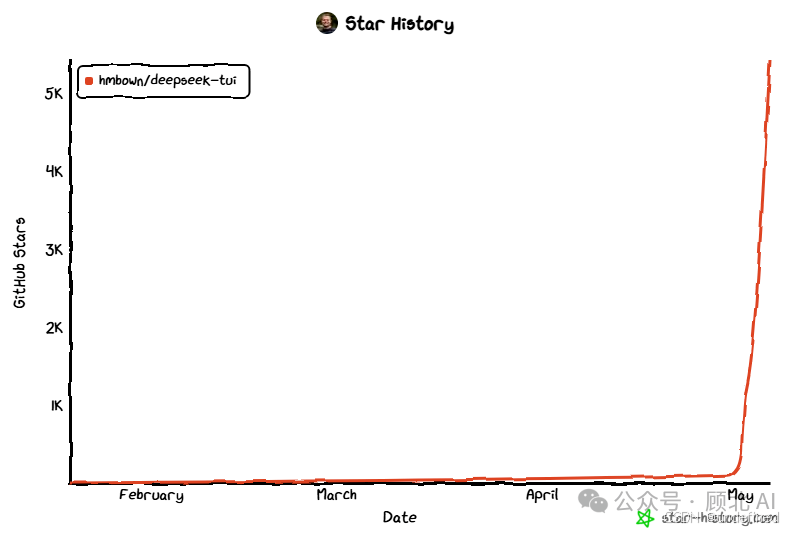

项目在 2026 年 1 月上线,目前 GitHub 11,499 Stars,70 个版本迭代,最新版是 v0.8.14。用 Rust 写的,启动极快,没有 Node.js 或 Python 运行时依赖。

安装,3 秒搞定

四种安装方式随意选:

# npm(最省事)

npm install -g deepseek-tui

# Cargo(不用 Node)

cargo install deepseek-tui-cli --locked

cargo install deepseek-tui --locked

# macOS Homebrew

brew tap Hmbown/deepseek-tui && brew install deepseek-tui

# Windows Scoop

scoop install deepseek-tui

国内网速慢?npm 加镜像:

--registry=https://registry.npmmirror.com,或用清华的 Cargo 镜像。

装完之后:

deepseek --version

deepseek auth set --provider deepseek # 输入 API Key

deepseek doctor # 验证环境

deepseek # 启动

第一次启动会引导你配置 API Key,保存在 ~/.deepseek/config.toml,之后任何目录都能直接用。

核心功能拆解

🧠 Auto 模式:让 AI 决定用哪个模型

这是我觉得最聪明的设计之一。

deepseek --model auto "帮我重构这个函数"

执行前,工具会先用 deepseek-v4-flash 做一次轻量路由判断:这个问题需要用 Pro 还是 Flash?需要开启深度思考吗?

然后再用选出来的模型+思考级别真正处理请求。

简单问题用 Flash + 关闭思考(省钱),复杂的架构设计或 debug 就上 Pro + Max 思考。成本和效果都帮你平衡好了。

用 Shift+Tab 可以手动在 off → high → max 三档思考强度之间切换。

📂 三种工作模式

|

模式 |

行为 |

|---|---|

| Plan

🔍 |

只读探索,模型先制定计划再提交执行 |

| Agent

🤖 |

默认交互模式,每次工具调用需要你审批 |

| YOLO

⚡ |

自动批准所有工具调用,适合信任的工作区 |

Tab 键在三种模式之间循环切换。

YOLO 模式说人话就是:你说完需求,它自己跑,不问你。对于跑批量处理或者你完全信任它的改动时,非常爽。

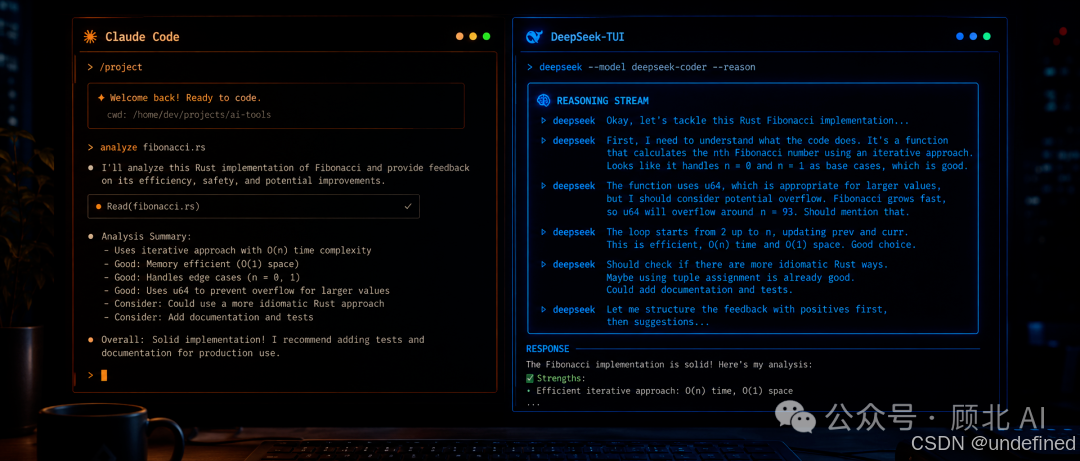

💡 思考过程可视化

DeepSeek V4 的 Reasoning 特性(流式输出思考过程)在 TUI 里有专门的视觉区分显示。

你能实时看到模型"在想什么",不只是等结果出来。

对于复杂 debug 场景,这个很有价值。

🔄 会话保存 & 工作区回滚

deepseek sessions # 列出所有会话

deepseek resume --last # 恢复上次的会话

deepseek fork <SESSION_ID> # 从某个节点分叉

还有一个 工作区快照回滚:工具在每次 turn 前后自动做 git snapshot(用的是独立的 side-git,不影响你的 .git),用 /restore 或 revert_turn 一键还原。

改坏了?一行命令回退,不慌。

💸 实时费用追踪

每次对话都有 token 用量和成本估算,还有缓存命中/未命中的明细。

当前 DeepSeek V4 Pro 有 75% 折扣(到 2026 年 5 月 31 日),折后价格:

|

模型 |

缓存命中 |

缓存未命中 |

输出 |

|---|---|---|---|

|

V4 Pro |

$0.003625/1M |

$0.435/1M |

$0.87/1M |

|

V4 Flash |

$0.0028/1M |

$0.14/1M |

$0.28/1M |

相比其他模型,DeepSeek 的价格已经很有竞争力了,加上 1M 大上下文,长代码库的分析场景非常适合。

🔌 MCP 协议支持

deepseek mcp list # 查看已配置的 MCP 服务

deepseek mcp validate # 验证连接

支持标准 MCP 协议,可以接入各种外部工具服务。

🧩 Skills 系统

和 Claude Code 类似,也有 Skills 机制——每个 Skill 是一个 .md 文件,描述特定工作流指令:

/skills # 列出所有 skill

/skill install github:<用户>/<仓库> # 从 GitHub 安装社区 skill

从工作区的 .agents/skills、skills、.claude/skills 以及全局 ~/.deepseek/skills 中自动发现。

🖥️ LSP 诊断集成

每次编辑后,工具会调用相关语言的 LSP(rust-analyzer、pyright、typescript-language-server、gopls、clangd),把诊断信息注入上下文,模型下一步就能看到你刚才改的代码有没有类型错误。

和 Claude Code 的区别是什么?

这个问题很多人会有,毕竟 Claude Code 也是终端里跑的 AI 编程工具,Claude Code 还可以通过配置接入 DeepSeek API。

所以它们是竞品吗?说是,也说不是。让我捋一下:

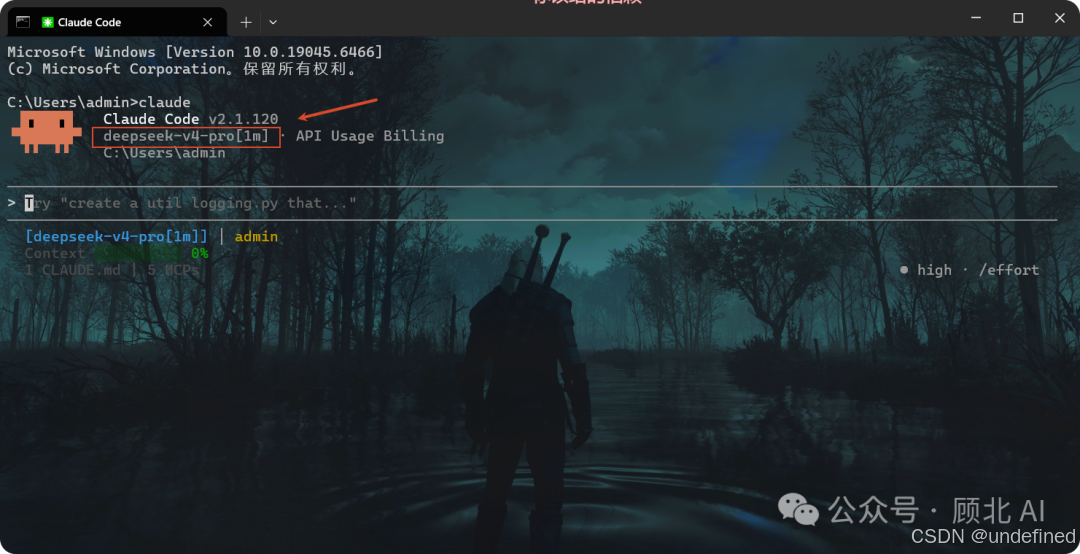

先说 Claude Code 能用 DeepSeek 这件事

Claude Code 支持自定义 API endpoint,通过环境变量可以把底层模型替换成 DeepSeek:

# 在你Claude code 的 settings.json 文件中替换成DeepSeek对应的API、key、model

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "your_deepseek_key",

"ANTHROPIC_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro[1m]",

"ANTHROPIC_REASONING_MODEL": "deepseek-v4-pro[1m]"

claude # 启动 Claude Code,实际调用 DeepSeek

👉小技巧:模型后面必须要加

[1m],这样1M的上下文窗口才能生效,否则会默认采用 Claude 原始[200k]上下文窗口大小。

这让一些人觉得:"既然 Claude Code 能用 DeepSeek,为啥还要 DeepSeek-TUI?"

答案是:工具可以调用同一个 API,但能用好是两回事。

核心定位不同

|

维度 |

Claude Code |

DeepSeek-TUI |

|---|---|---|

| 原生支持的模型 |

Claude (Opus/Sonnet/Haiku) |

DeepSeek V4 (Pro/Flash) |

| Reasoning 支持 |

通过 extended thinking 参数 |

原生流式展示 Thinking Blocks |

| 上下文窗口 |

取决于 Claude 模型(200K) |

原生支持 DeepSeek 1M token |

| 价格感知 |

无内置成本估算 |

实时费用追踪 + 缓存命中明细 |

| Auto 模式 |

无 |

内置路由判断,自动选模型+思考档位 |

| 运行时 |

Node.js |

Rust 二进制,无依赖 |

| 工作区回滚 |

无内置快照 |

side-git 每轮快照, |

| 项目感知 |

CLAUDE.md 深度集成 |

.deepseek/config.toml

项目覆盖 |

| IDE 集成 |

VS Code、JetBrains 插件 |

Zed(ACP 协议) |

| 多模型路由 |

不支持 |

NVIDIA NIM、Fireworks、SGLang、vLLM |

Claude Code 的优势在哪里

1. 与 Claude 模型的深度原生适配

Claude Code 是 Anthropic 官方出品,和 Claude 模型的 extended thinking、tool use 格式、CLAUDE.md 上下文注入等机制是协同设计的。如果你主要用 Claude,体验上有天然的完整性。

2. 生态更成熟

Hooks 系统(pre/post 工具调用钩子)、VS Code/JetBrains IDE 插件、CLAUDE.md 全局/项目配置层级。这套生态对工程化使用场景支持更完善。

3. 不需要额外账号

Claude Code 一个账号/API Key 搞定,DeepSeek-TUI 需要单独申请 DeepSeek API Key(虽然很容易)。

DeepSeek-TUI 的优势在哪里

1. 对 DeepSeek V4 特性的原生支持

DeepSeek V4 的 Reasoning 流式输出(Thinking Blocks)、1M token 上下文、Prefix Cache 的缓存命中追踪。这些特性如果通过兼容层使用,效果会打折扣。DeepSeek-TUI 是为这些特性量身打造的。

你在 Claude Code 里通过 custom endpoint 接 DeepSeek,拿到的是"能用";在 DeepSeek-TUI 里,拿到的是"用好了"。

2. Auto 模式的智能路由

Claude Code 没有自动根据任务复杂度选模型的功能。DeepSeek-TUI 的 auto 模式能根据每个 turn 的内容决定用 Flash 还是 Pro、要不要开深度思考,等于帮你做了一层 cost/quality 的权衡。

3. 极低的运行时负担

Rust 二进制,单文件,没有 Node 或 Python 依赖,内存占用低,启动快。对于服务器环境或资源受限场景更友好。

4. 价格优势更透明

DeepSeek 本来就比 Claude 便宜,加上实时的 cache hit/miss 费用追踪,你能精确看到每次对话花了多少钱、省了多少。

怎么选?

选 Claude Code 如果:

-

你的主力模型是 Claude,不想切换

-

需要 IDE 插件深度集成(VS Code/JetBrains)

-

工程化使用场景多,需要 Hooks 等进阶功能

-

已有 Anthropic 订阅,不想再申请新 API Key

选 DeepSeek-TUI 如果:

-

你主用 DeepSeek V4,想充分利用其 Reasoning 和 1M 上下文

-

在意成本,需要精细的费用感知和 Auto 模式优化

-

需要工作区快照回滚(改坏代码一键恢复)

-

在资源受限环境(服务器、轻量 Linux)部署 AI Agent

当然,也可以两个都用。 工具不互斥。复杂架构分析用 DeepSeek-TUI 的 1M 上下文跑,日常写代码用 Claude Code 配 IDE 插件——看场景选最顺手的。

键盘快捷键速查

|

按键 |

功能 |

|---|---|

Tab |

切换模式 / 补全 |

Shift+Tab |

切换思考强度:off → high → max |

F1 |

帮助 overlay |

Ctrl+K |

命令面板 |

Ctrl+R |

恢复历史会话 |

Ctrl+S |

暂存草稿 |

@path |

在输入框附加文件/目录上下文 |

Alt+R |

搜索 Prompt 历史 |

自定义 Skill:把工作流打包复用

DeepSeek-TUI 的 Skill 机制和 Claude Code Skills 很像,本质是用 Markdown 描述一套指令集:

~/.deepseek/skills/my-code-review/

└── SKILL.md

---

name: my-code-review

description: 执行标准化的 Code Review,重点检查安全性和性能问题。

---

# Code Review Checklist

每次 review 前先看:

1. 有没有 SQL 注入风险

2. 有没有未处理的异常路径

3. 关键路径有没有日志

...

然后:

/skill install github:某用户/某仓库 # 安装社区 skill

/skill my-code-review # 激活

模型会自动识别任务上下文,在合适的时候触发对应的 skill。

当前阶段值不值得用?

项目还在快速迭代,v0.8.14 是今天刚发的,Open Issues 有 108 个。说明活跃,也说明有坑。

坑点记录一下:

-

长会话不自动压缩(v0.6.6 后默认关闭了 auto-compaction),跑久了 context 会膨胀,需要手动

/compact -

Token/成本估算在部分场景下可能偏高(reasoning token 计费逻辑的已知 bug)

-

Windows 上个别 UI 交互细节 v0.8.14 才修复

但整体体验来说:如果你是 DeepSeek 用户,这是目前最完整的终端 Agent 实现。

总结

DeepSeek-TUI 不是"又一个 AI 编程工具"。它是专门为 DeepSeek V4 的核心优势(Reasoning、1M 上下文、低价格)而设计的终端 Agent,在这个赛道上,没有比它更契合的选项。

如果你还在把 DeepSeek 当作一个"便宜点的 Claude"来用,DeepSeek-TUI 可能会改变你的想法。

项目地址:https://github.com/Hmbown/DeepSeek-TUI

我是顾北,关注我,获取更多好玩有趣的AI工具!

谢谢你阅读我的文章~

我们下期再见!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)