DeepSeek V4 解析 + PyCharm API 实战,国产大模型平价平替顶级闭源

就在OpenAI重磅发布GPT-5.5的次日,国产大模型领域迎来强势反击——DeepSeek V4预览版正式上线,且同步开源!两款顶级模型同台亮相,一边是GPT-5.5的性能领先但定价翻倍,一边是DeepSeek V4的“高性能+低价格+全开源”,对于广大学生和AI编程开发者而言,后者无疑是更具性价比的新选择。本文将先详解DeepSeek V4的核心特性、双版本差异及技术优势,为后文API调用实操

前言:就在OpenAI重磅发布GPT-5.5的次日,国产大模型领域迎来强势反击——DeepSeek V4预览版正式上线,且同步开源!两款顶级模型同台亮相,一边是GPT-5.5的性能领先但定价翻倍,一边是DeepSeek V4的“高性能+低价格+全开源”,对于广大学生和AI编程开发者而言,后者无疑是更具性价比的新选择。本文将先详解DeepSeek V4的核心特性、双版本差异及技术优势,为后文API调用实操指南做好铺垫。

一、双版本布局:覆盖不同开发场景需求

DeepSeek V4并非单一模型,而是推出了V4-Pro(旗舰版)和V4-Flash(轻量高效版)两个版本,核心共性是均原生支持百万token上下文,彻底打破了长上下文仅为高端闭源模型专属的局限,让普通开发者也能轻松处理整本书、大型代码库、长篇学术论文等长文本场景,无需依赖天价算力。

1. V4-Pro(旗舰性能版):对标国际顶级闭源模型

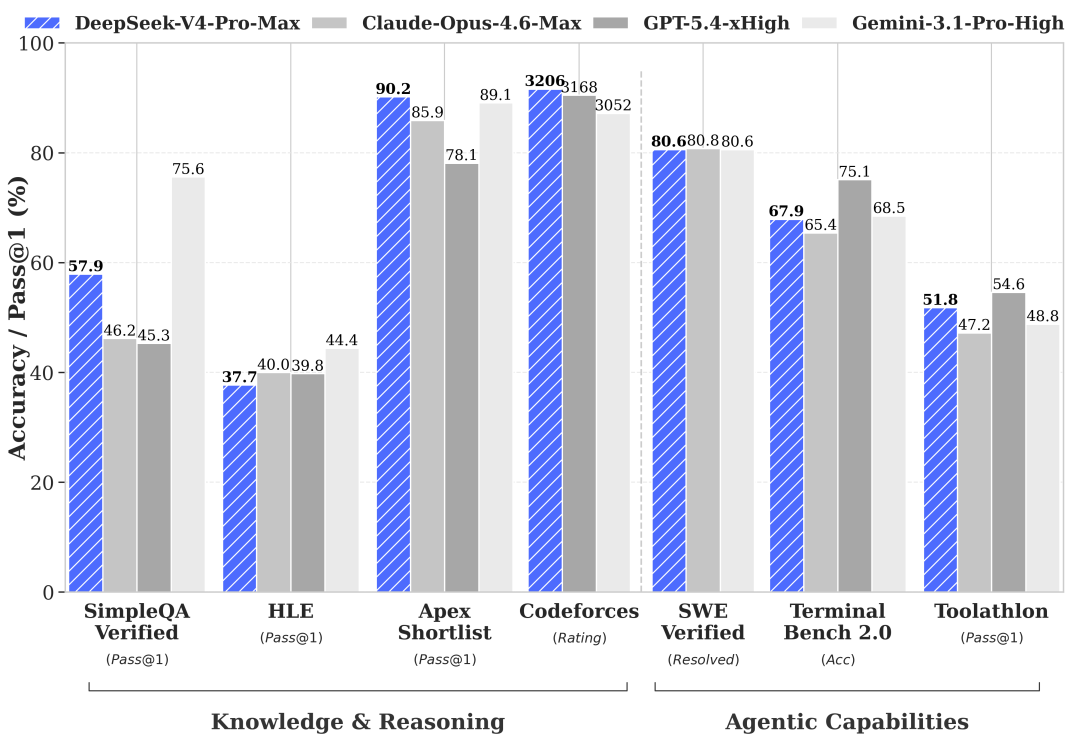

作为系列旗舰,V4-Pro的定位是冲击国际顶级闭源模型水平。据DeepSeek官方内部反馈,其Agent能力已超越Claude Sonnet 4.5,接近Claude Opus 4.6非思考模式(官方坦诚,与Opus 4.6思考模式仍有一定差距,这份务实态度值得肯定)。在核心性能评测中,V4-Pro在数学、STEM、竞赛型代码等场景下,超越了目前所有已公开评测的开源模型,真正实现了国产开源模型与国际顶级闭源模型的比肩。

2. V4-Flash(轻量高效版):性价比首选,适配日常开发

V4-Flash主打“轻量、快速、低成本”,核心推理能力与V4-Pro接近,仅在世界知识储备和高难度复杂任务处理上稍逊一筹。得益于更小的模型参数和激活量,V4-Flash的响应速度更快、使用成本更低,非常适合日常对话、轻量AI开发、简单代码辅助等场景,是学生党和个人开发者的性价比首选。

二、核心技术突破:百万上下文普惠的关键

DeepSeek V4能实现百万token上下文的普惠化,核心在于其创新的技术架构——采用全新注意力机制,在token维度进行高效压缩,结合DSA稀疏注意力(DeepSeek Sparse Attention)技术,大幅降低了长文本场景下的计算量和显存需求。

这一技术突破的核心价值的是:让百万上下文不再是“高端付费功能”,普通开发者无需配置高端算力,就能轻松体验长文本处理能力。此外,模型还专门针对Claude Code、OpenClaw、OpenCode等主流Agent产品进行了适配优化,AI编程用户可直接切换使用,无需额外进行适配调试,上手成本极低。

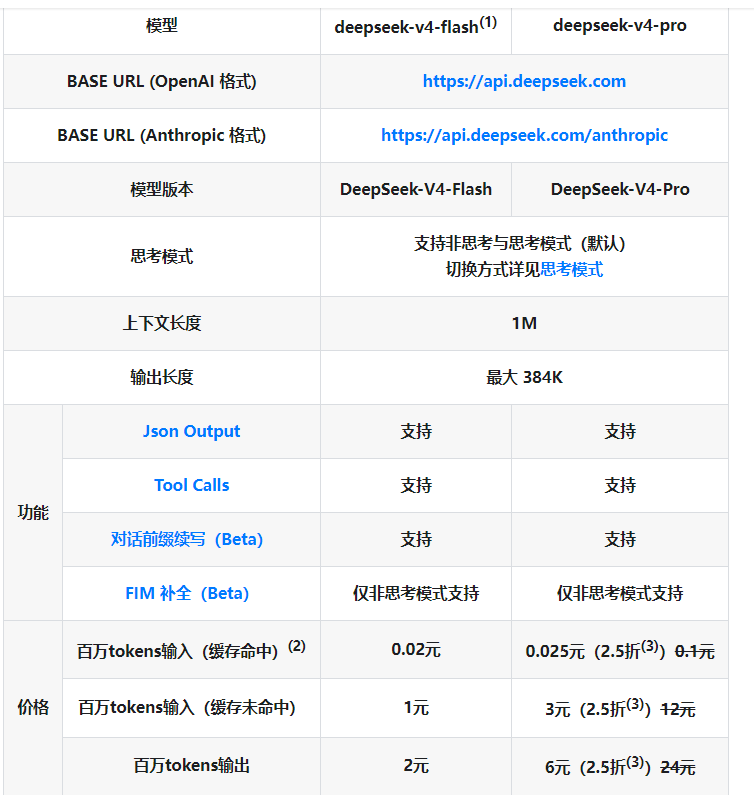

三、价格碾压:学生党/开发者的“福音级”定价

相较于GPT-5.5的“高价门槛”(输入$5、输出$30每百万token),DeepSeek V4的定价堪称“普惠级”:API调用输入仅$0.3、输出$0.5每百万token,缓存命中后输入更是低至$0.03。换算下来,GPT-5.5的输出价格是DeepSeek V4的60倍——用GPT-5.5花60块钱能完成的工作,用DeepSeek V4仅需1块钱。并且最近deepseek全系列模型,输入缓存命中的价格已降至首发价格的 1/10,当前 deepseek-v4-pro 模型 2.5 折,优惠期延长至北京时间 2026/05/31 23:59,价格也是十分亲民了。

更重要的是,DeepSeek V4实现了全开源,模型权重可直接在Hugging Face、ModelScope等平台下载,支持本地部署和二次开发,彻底打破了“前沿性能与亲民价格对立”的固有认知,让更多预算有限的学生和个人开发者,有机会接触到顶尖大模型,真正实现“用得起AI、学得会AI编程”。

四、PyCharm中使用continue实现deepseekapi接入

在项目中可以有多种方式导入api的接口,具体可参考deepseek官方网站的接口文档:

https://api-docs.deepseek.com/zh-cn/quick_start/agent_integrations/claude_code

本文主要介绍在PyCharm中使用continue实现对deepseekapi的接入

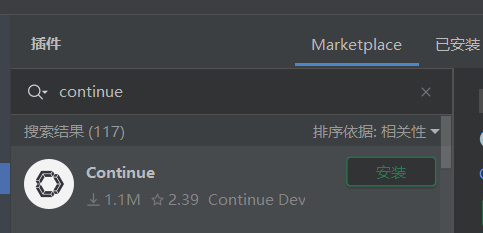

1.安装Continue插件

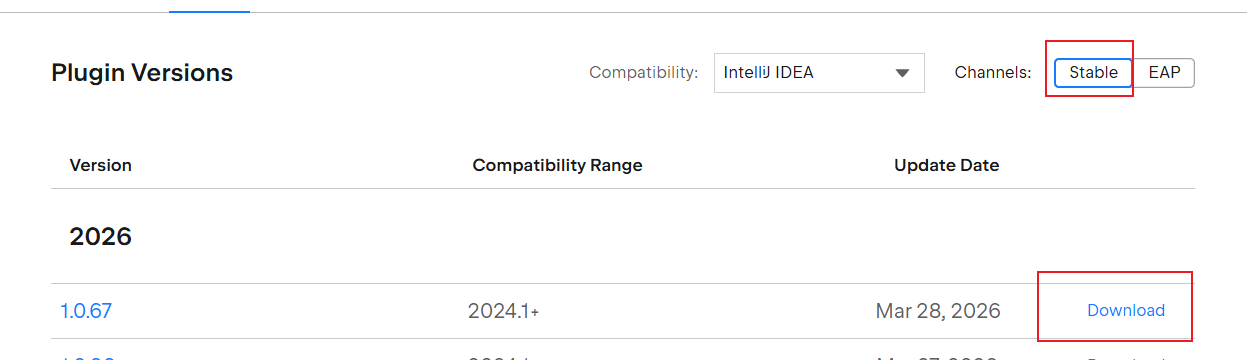

下载continue插件(网站才能下载最新的)

https://plugins.jetbrains.com/plugin/22707-continue/versions/eap

打开设置(Ctrl + Alt + S),选择插件Plugins

点击小齿轮配置,选择从磁盘安装:

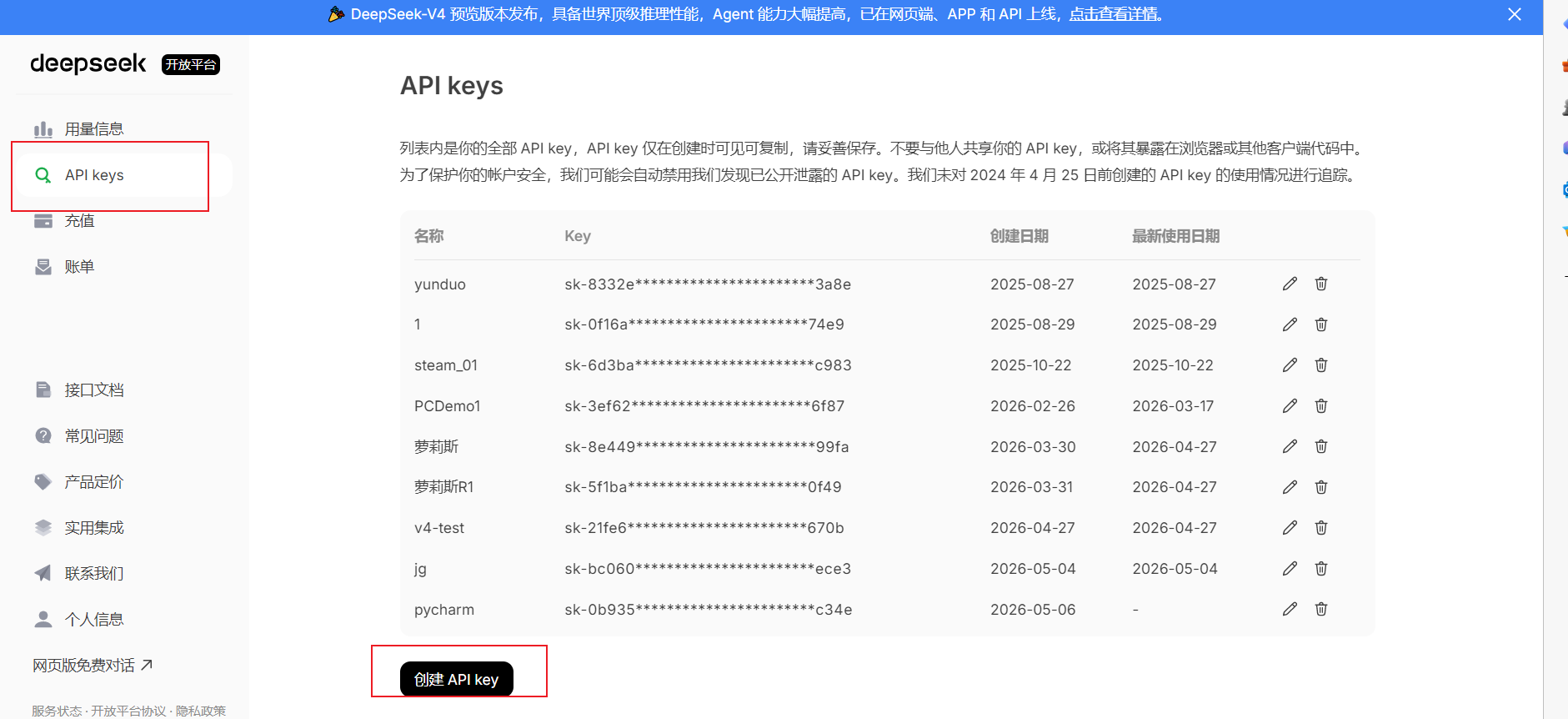

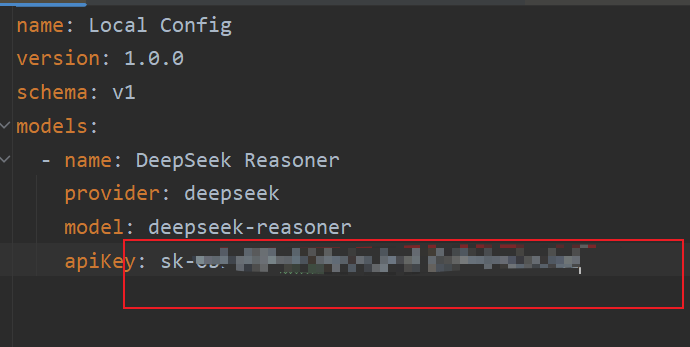

2.配置DeepSeek API key

打开DeepSeek官网:https://www.deepseek.com/(直接复制跳转)

登录/注册账号(支持手机号快捷登录,超方便)

进入「API开放平台」,找到「API Keys」选项

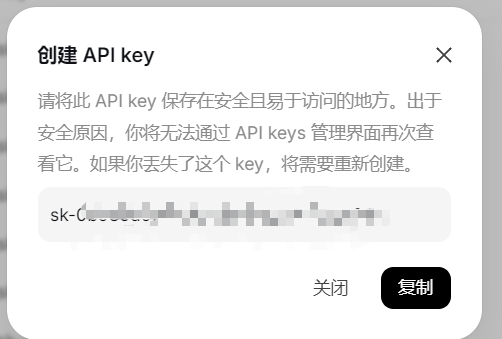

点击「创建API Key」,生成后立即复制保存(格式为sk-xxx,只显示一次,别弄丢啦!)

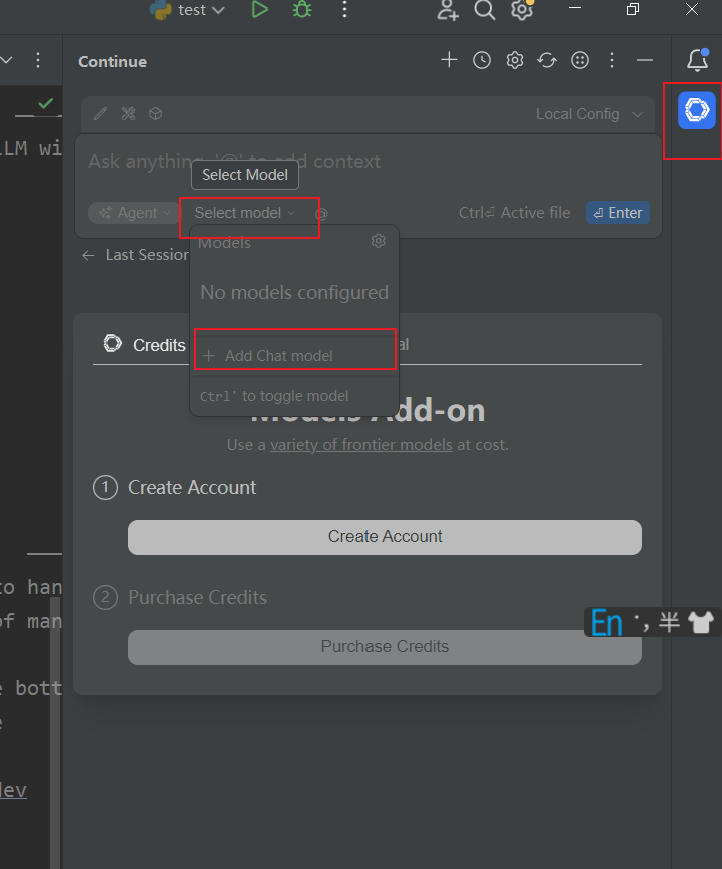

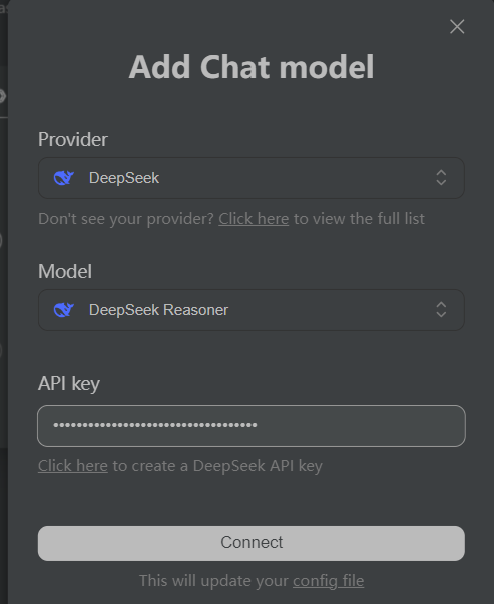

3.Continue添加chat模型

将生成的API Key填入Continue配置中,选择对应的模型版本: deepseek-v4-pro(高性能)、deepseek-v4-flash(高性价比) Coder 专注编码、Chat 通用对话、Reasoner 强推理,按需选择即可。

三个版本的模型,Coder是编码、Chat是V3聊天、Reasoner是R1推理。

五、简单使用

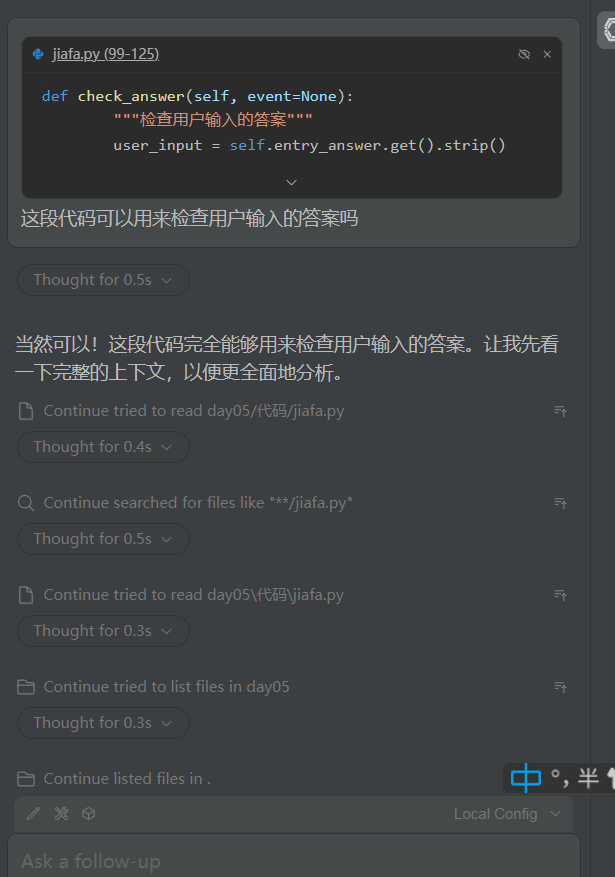

1. 对话

Ctrl + J 快速打开对话框,直接与AI对话。 选中代码后按 Ctrl + J,可基于上下文进行代码解释、优化。

插入、复制相关代码:

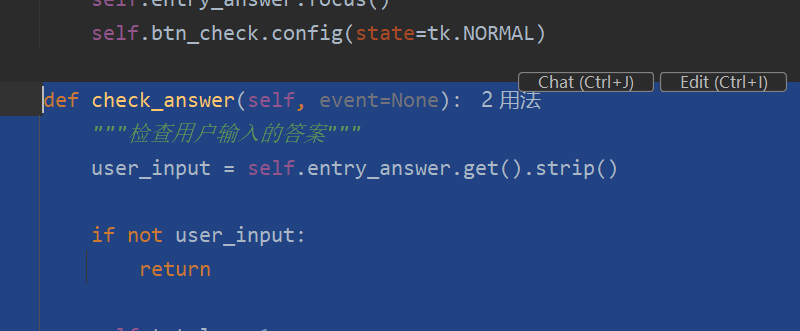

2. 编辑代码

选中目标代码,直接让AI生成注释、重构逻辑、补全功能,一键应用到文件中。

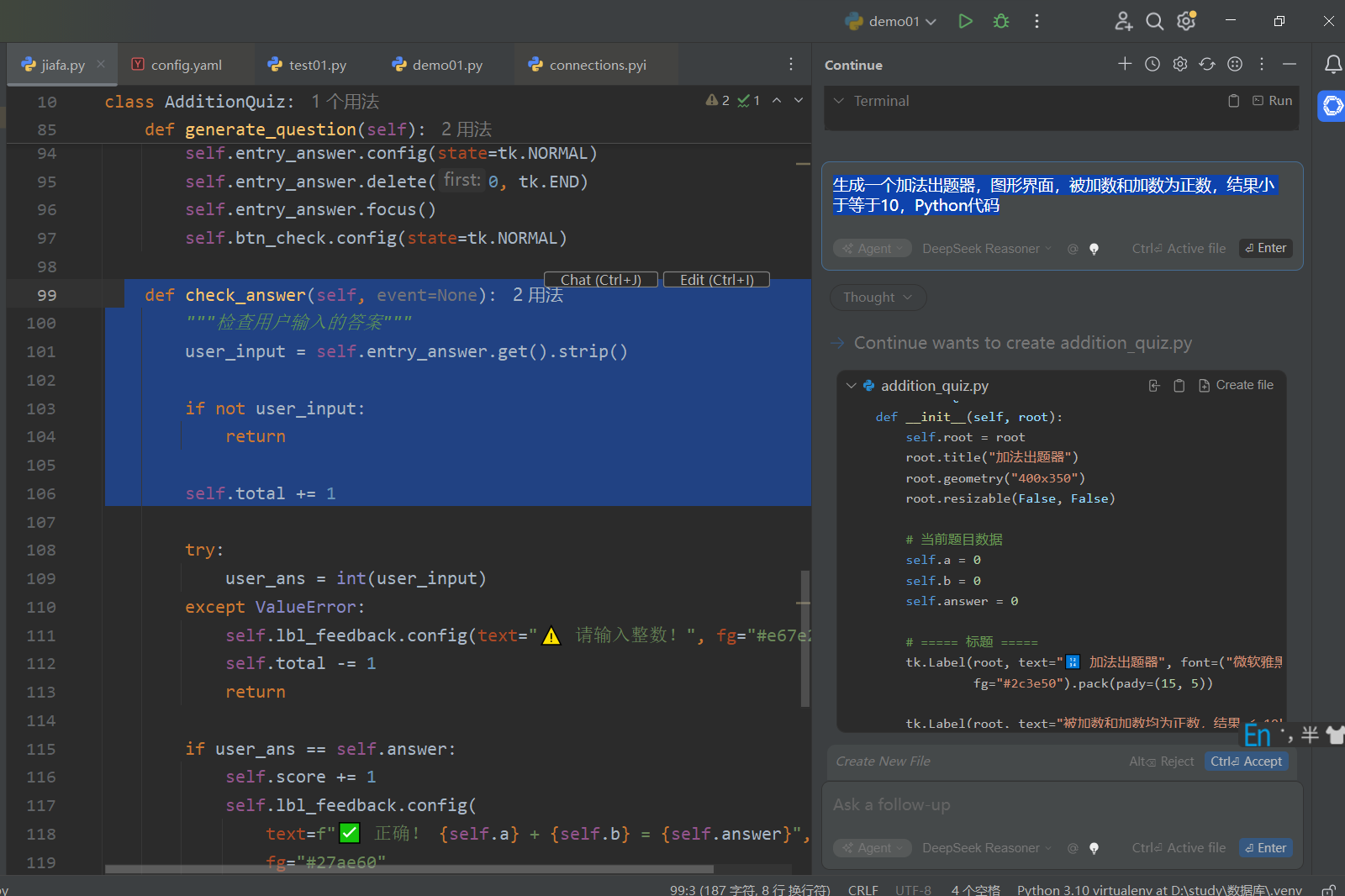

六、实战演示:

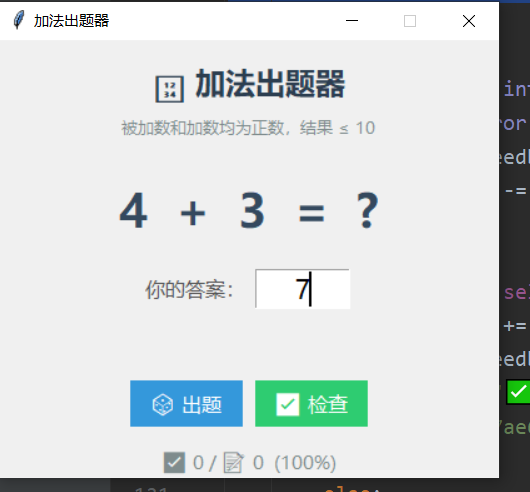

让DeepSeek V4写一个Python小程序 需求:生成加法出题器,带图形界面,被加数和加数均为正数,结果≤10

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)