50天独立打造企业级API网关(四):全链路可观测性与AI Copilot智能运维

本文介绍了企业级API网关的全链路可观测性与AI Copilot实时监控:JVM、CPU、HTTP全面监控,Prometheus集成分布式追踪:TraceId传递,Jaeger集成,慢请求/错误请求捕获过滤器链分析:selfTime vs totalTime核心概念,P50/P95/P99分位数AI Copilot:35+工具,支持Qwen/DeepSeek/GPT/Claude多模型AI实战案例

系列文章第4篇 | 50天手搓Spring Cloud Gateway:44项功能+561测试用例的完整实践

系列导航

- 第一篇:架构设计与动态路由实现

- 第二篇:安全防护体系与性能优化

- 第三篇:弹性设计与限流降级

- 第四篇:全链路可观测性与AI Copilot ← 本篇

- 第五篇:Kubernetes部署与测试保障

- 第六篇:高级路由与负载均衡实战

一、全链路可观测性架构

1.1 四位一体可观测性体系

可观测性覆盖维度:

| 维度 | 指标 | 采集方式 | 存储 |

|---|---|---|---|

| JVM | Heap/Non-Heap/GC/Thread | Micrometer | Prometheus |

| CPU | Process CPU/System Load | OperatingSystemMXBean | Prometheus |

| HTTP | QPS/P50/P95/P99/Error Rate | GlobalFilter拦截 | Prometheus |

| 链路 | TraceId/SpanId/耗时 | TraceCaptureFilter | Jaeger |

| 过滤器 | selfTime/totalTime/成功率 | FilterChainTrackingFilter | 内存+API |

| 日志 | 访问日志/错误日志 | AccessLogFilter | ES/K8s PVC |

二、实时监控

2.1 监控指标体系

网关暴露以下核心监控指标(通过Prometheus暴露):

核心监控指标:

| 类别 | 指标名称 | 类型 | 说明 |

|---|---|---|---|

| JVM | jvm_memory_used_bytes | Gauge | 堆内存使用量 |

| JVM | jvm_memory_max_bytes | Gauge | 堆内存最大值 |

| JVM | jvm_gc_pause_seconds | Timer | GC暂停时间 |

| JVM | jvm_threads_live_threads | Gauge | 活跃线程数 |

| CPU | process_cpu_usage | Gauge | 进程CPU使用率 |

| CPU | system_load_average_1m | Gauge | 1分钟系统负载 |

| HTTP | http_server_requests_seconds | Timer | 请求耗时分布 |

| HTTP | gateway_requests_total | Counter | 请求总数 |

| HTTP | gateway_errors_total | Counter | 错误总数 |

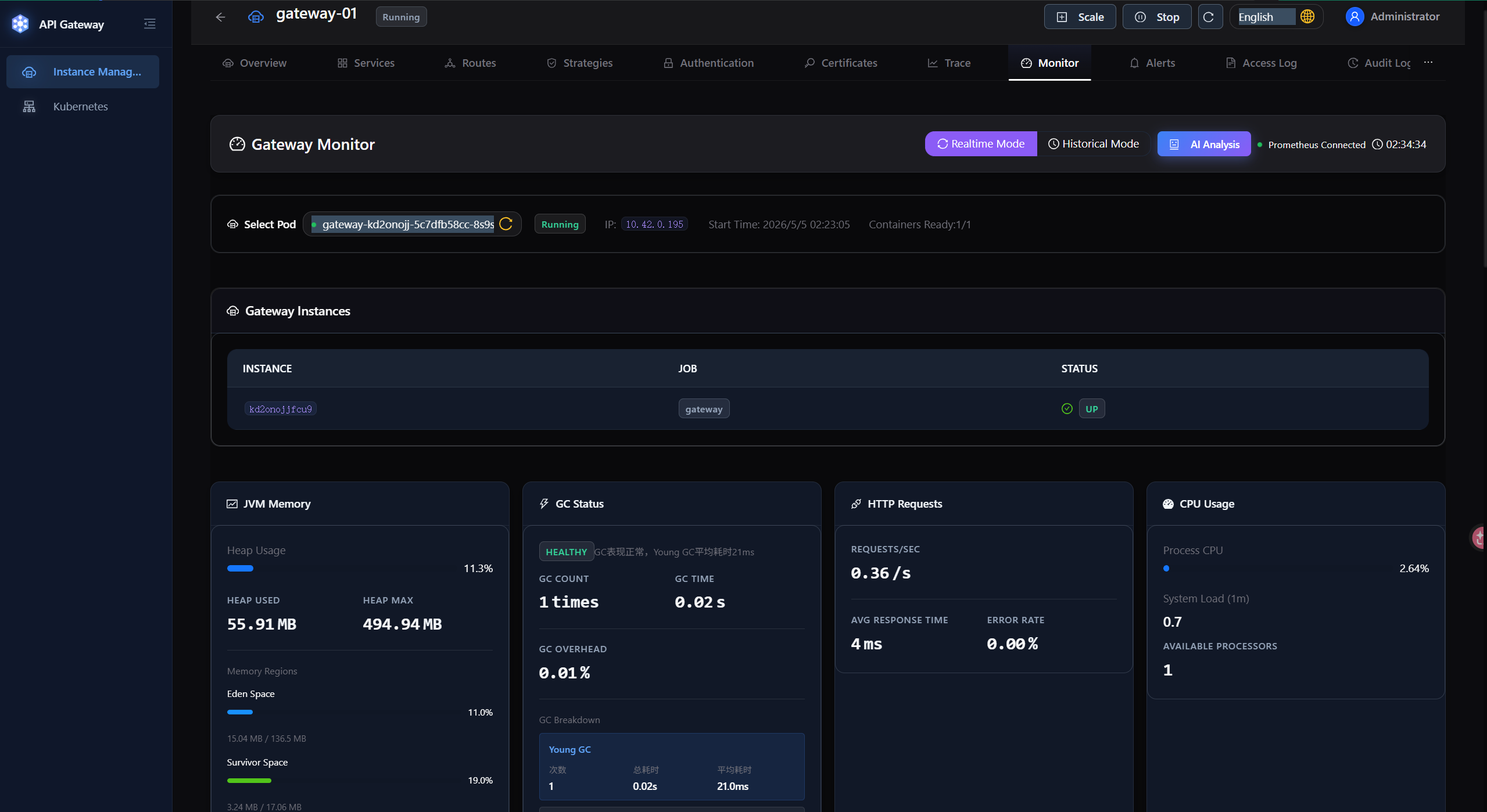

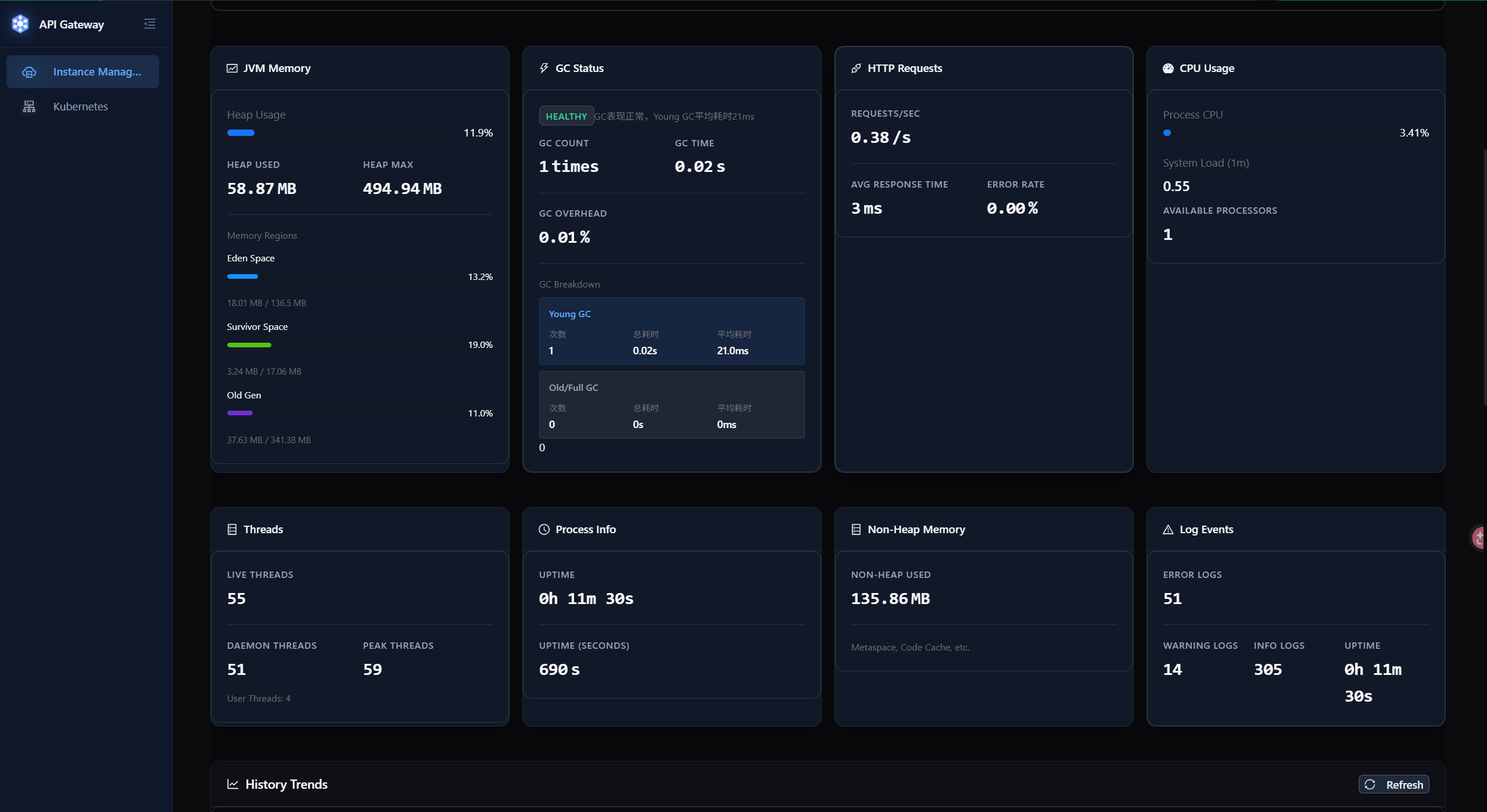

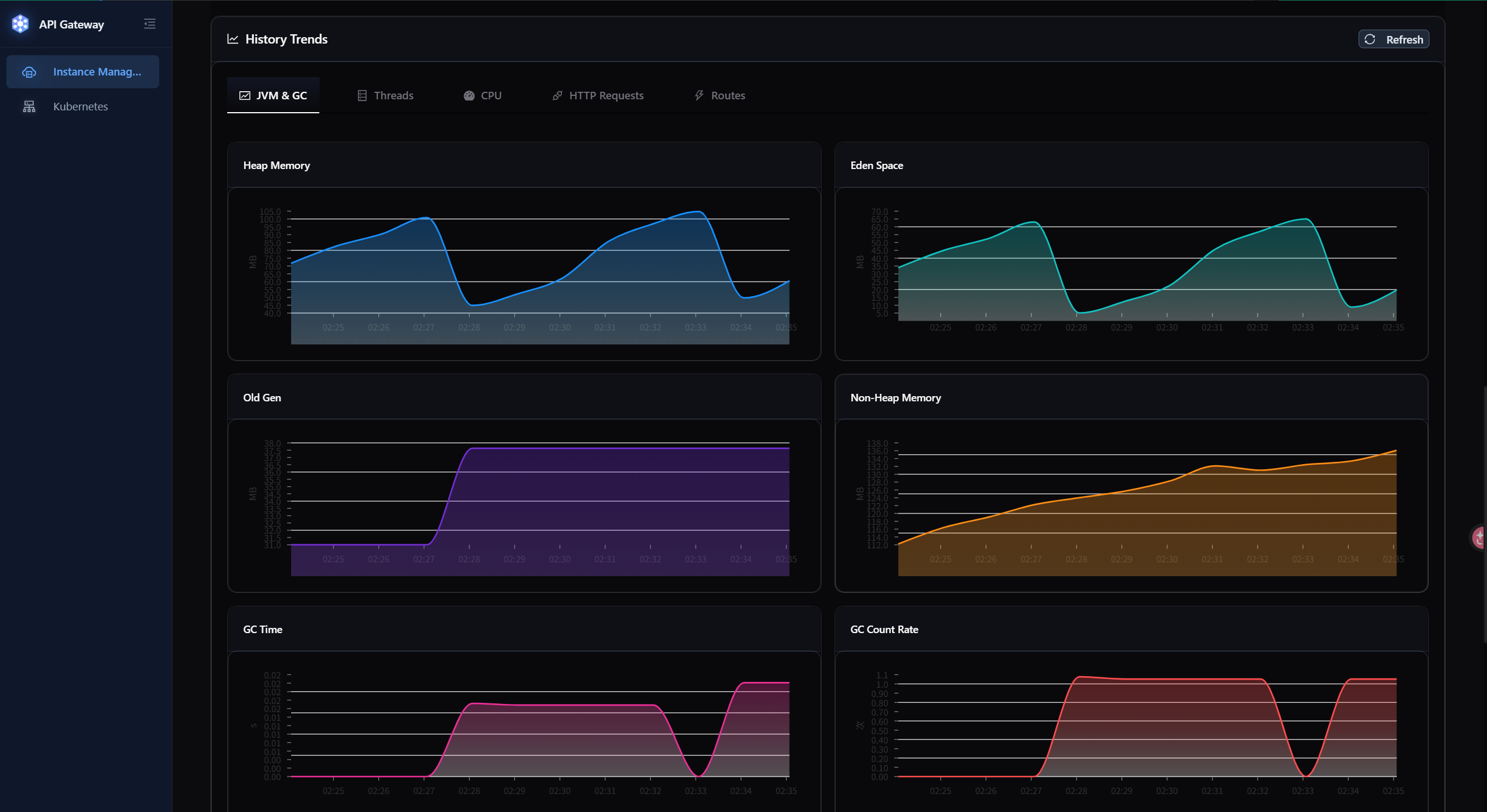

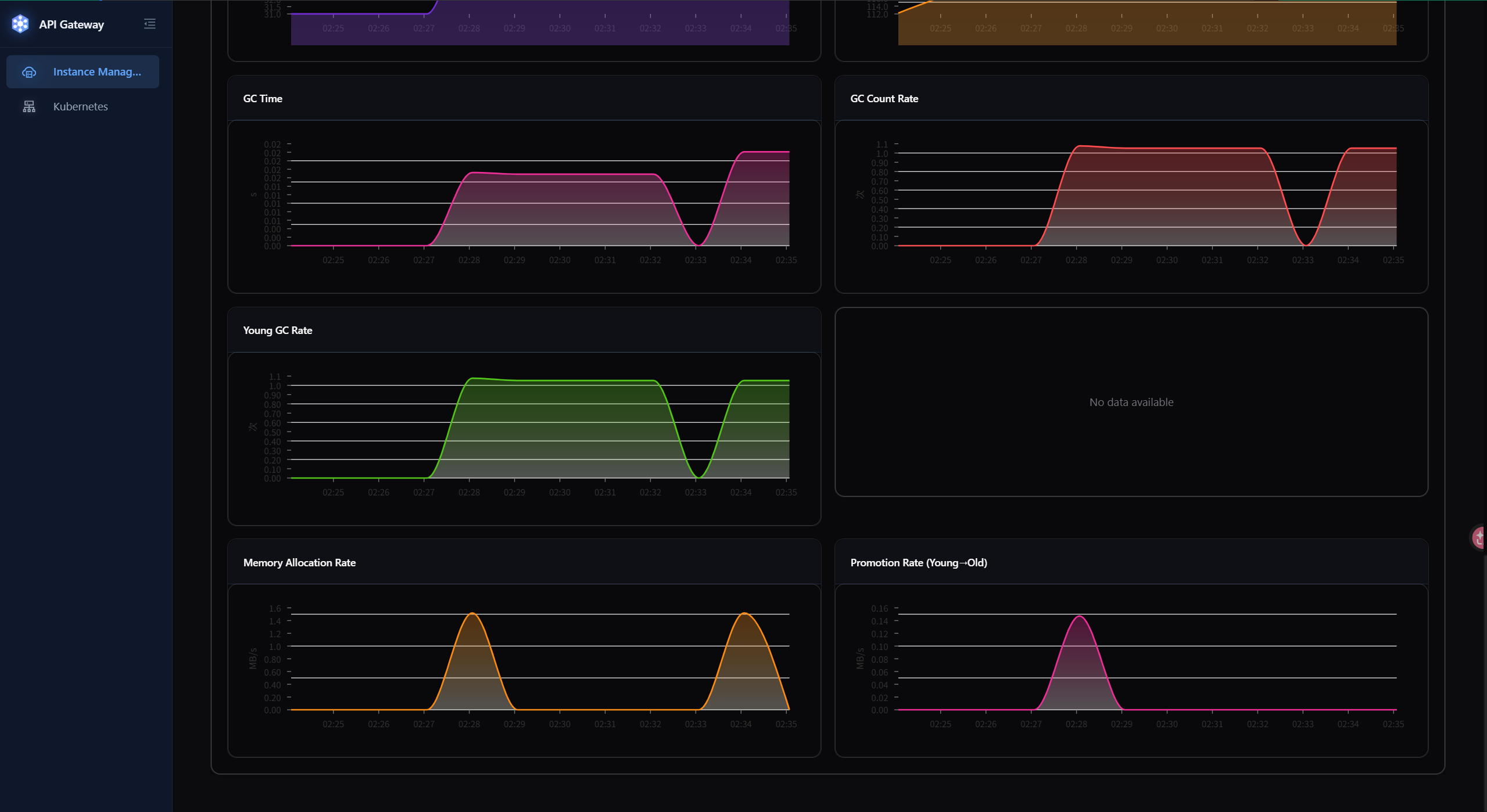

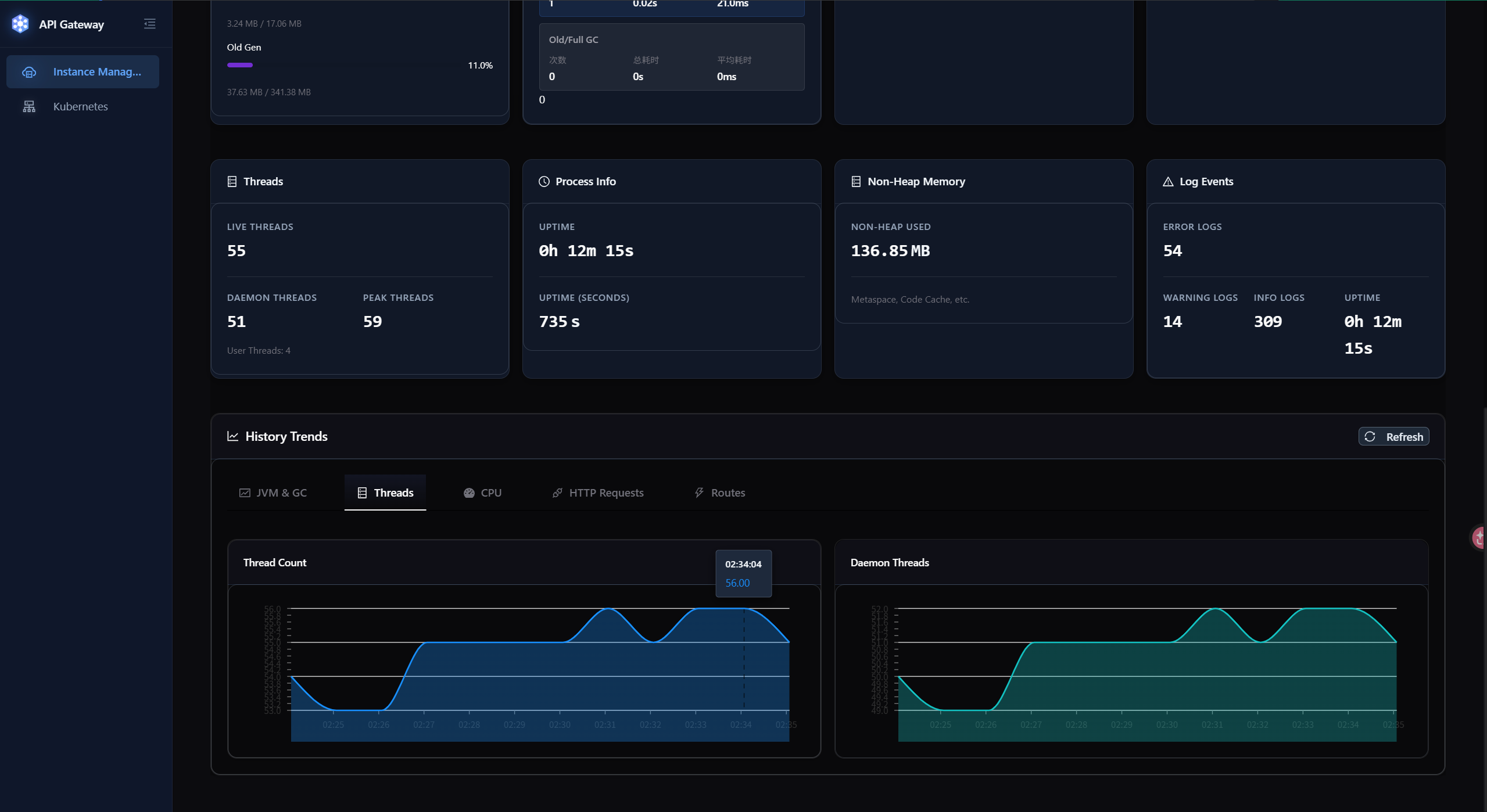

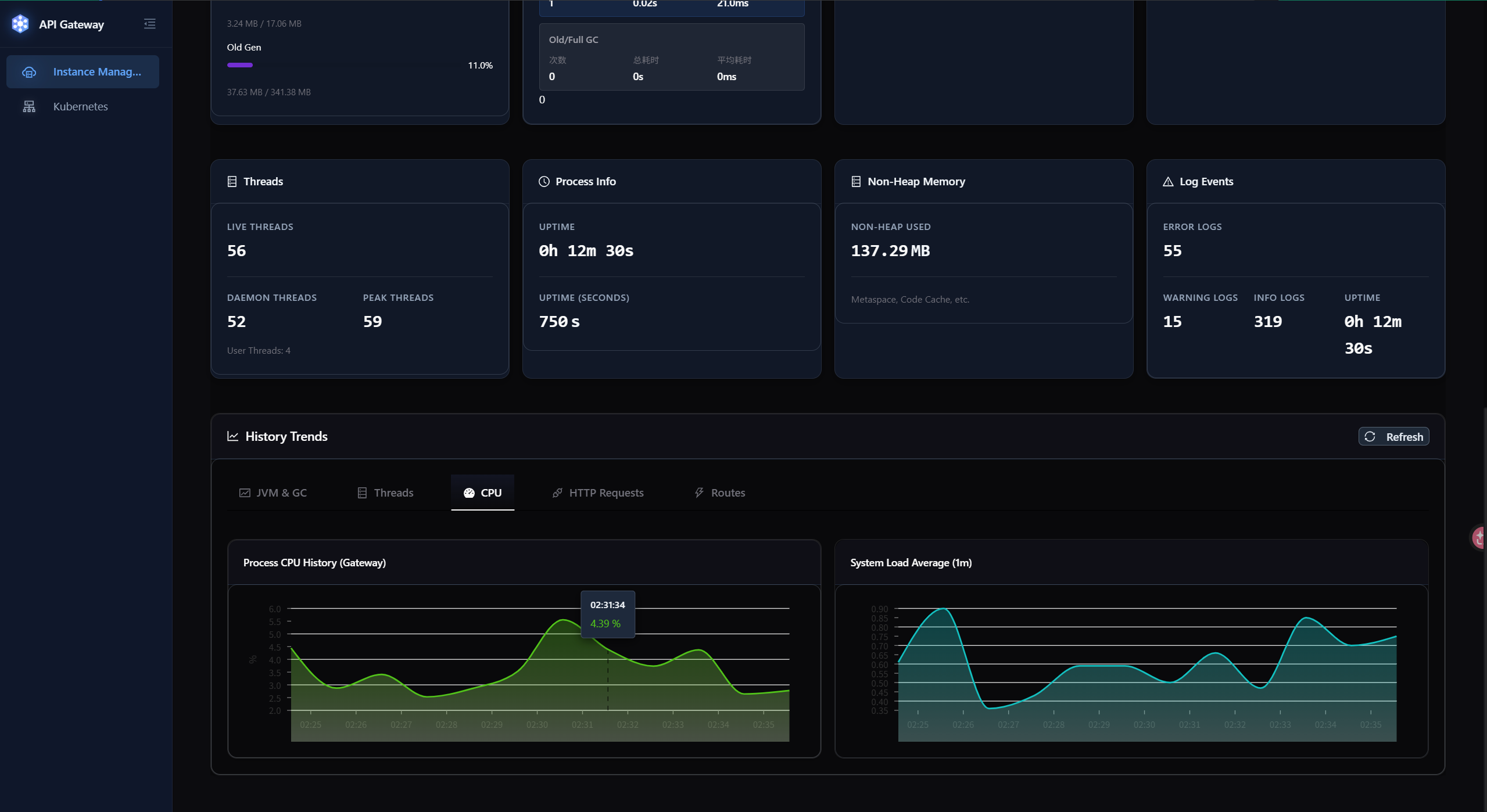

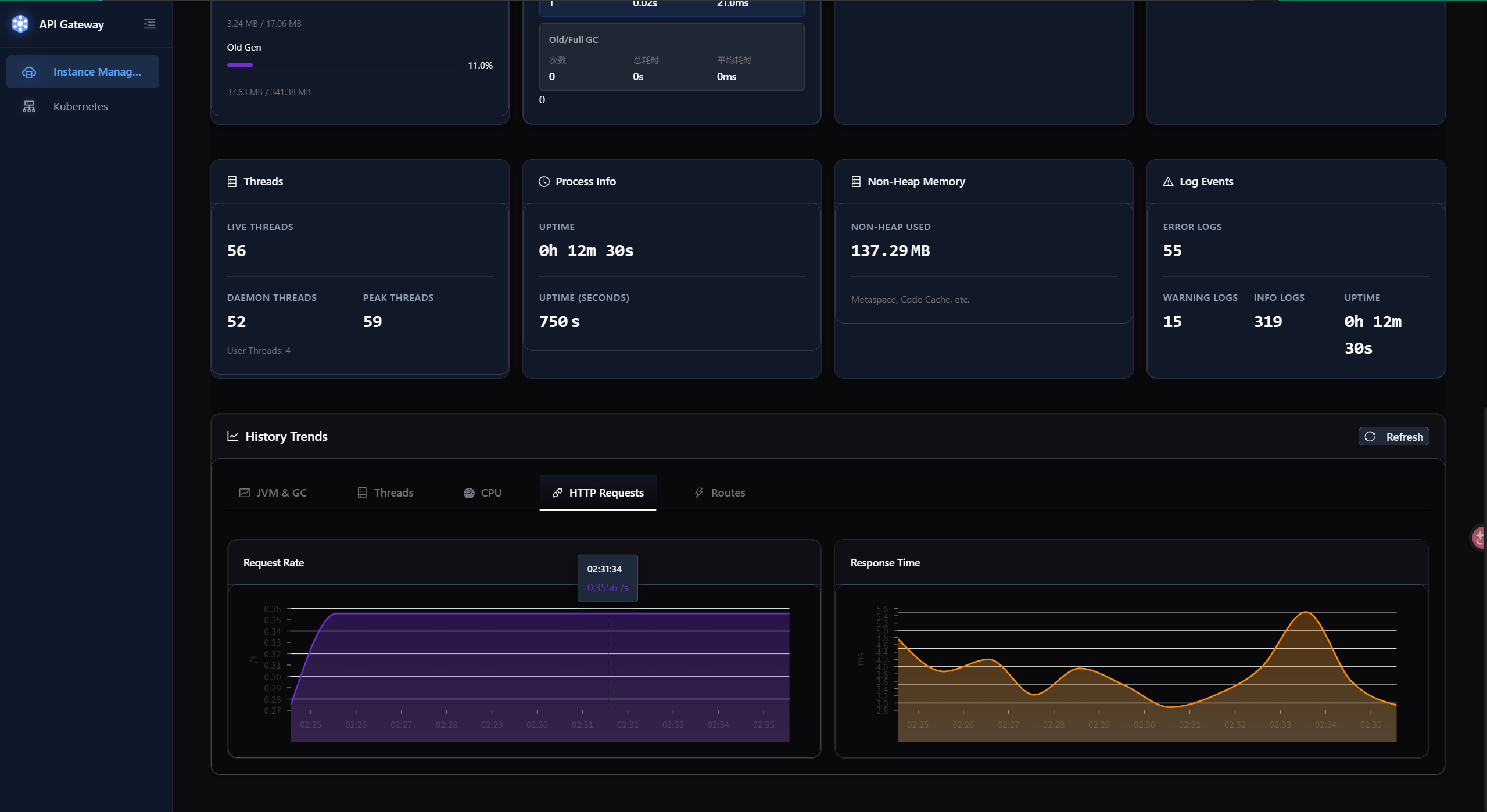

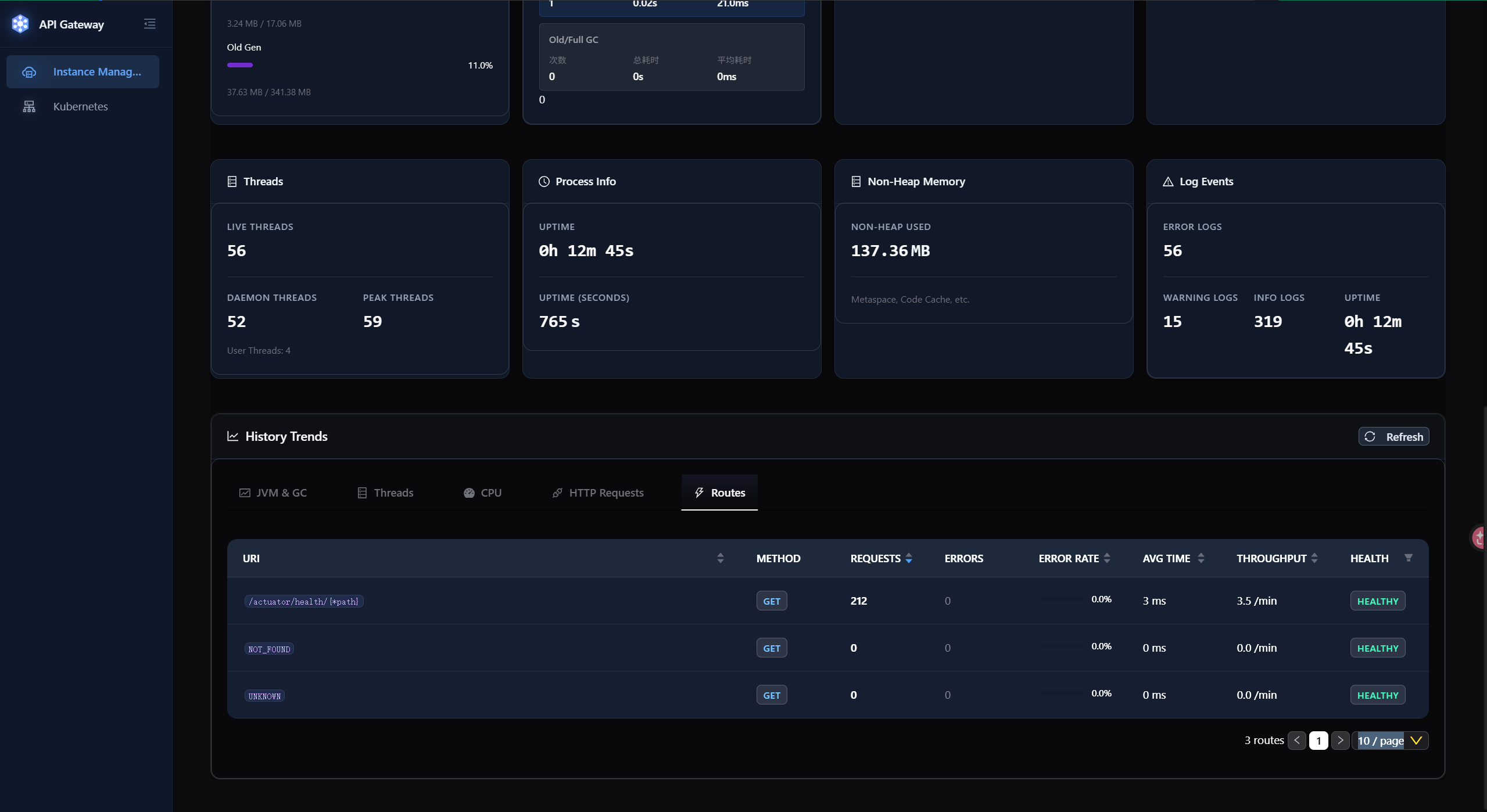

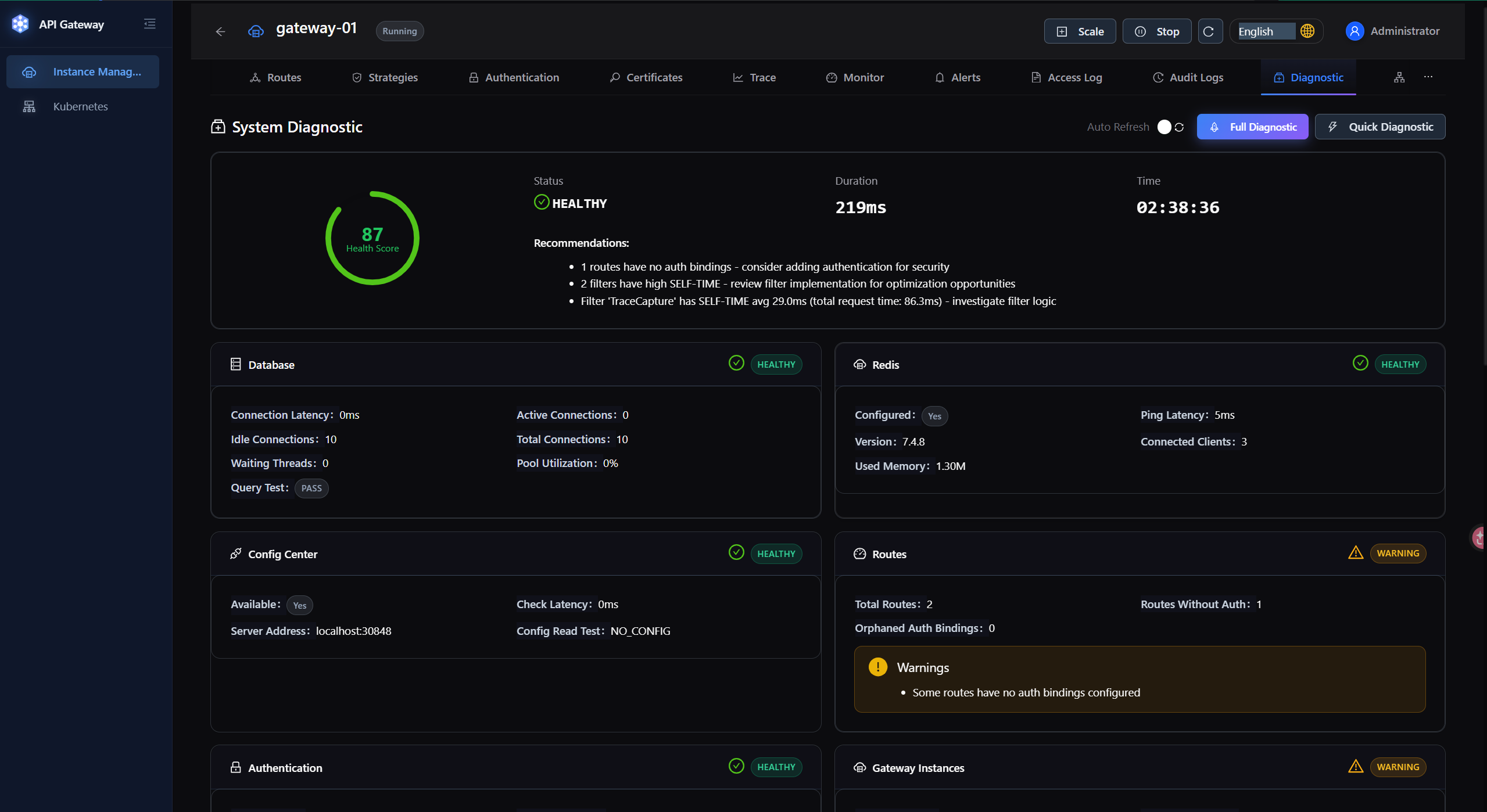

2.2 项目截图:监控仪表板

图24-27:实时监控仪表板。JVM内存监控(24)、CPU使用率(25)、HTTP指标QPS/响应时间/错误率(26)、历史趋势图(27)。

图28-31:Pod选择器(28)、路由表状态(29)、更多监控维度(30-31)。

三、分布式追踪

3.1 TraceId传递机制

每个请求进入网关时,生成唯一TraceId,并在整个调用链中传递:

3.2 TraceCapture过滤器实现

@Component

public class TraceCaptureGlobalFilter implements GlobalFilter, Ordered {

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

ServerHttpRequest request = exchange.getRequest();

String traceId = getOrGenerateTraceId(request);

// 记录请求信息

TraceContext context = TraceContext.builder()

.traceId(traceId)

.path(request.getURI().getPath())

.method(request.getMethod().name())

.headers(extractHeaders(request.getHeaders()))

.timestamp(System.currentTimeMillis())

.build();

return chain.filter(exchange)

.doOnSuccess(v -> {

context.setStatusCode(exchange.getResponse().getStatusCode().value());

context.setDuration(calculateDuration(context.getTimestamp()));

// 慢请求或错误请求才保存

if (isSlowRequest(context) || isErrorRequest(context)) {

traceRepository.save(context);

}

})

.doOnError(throwable -> {

context.setError(throwable.getMessage());

traceRepository.save(context);

});

}

private boolean isSlowRequest(TraceContext context) {

return context.getDuration() > slowRequestThreshold;

}

private boolean isErrorRequest(TraceContext context) {

return context.getStatusCode() >= 400;

}

}

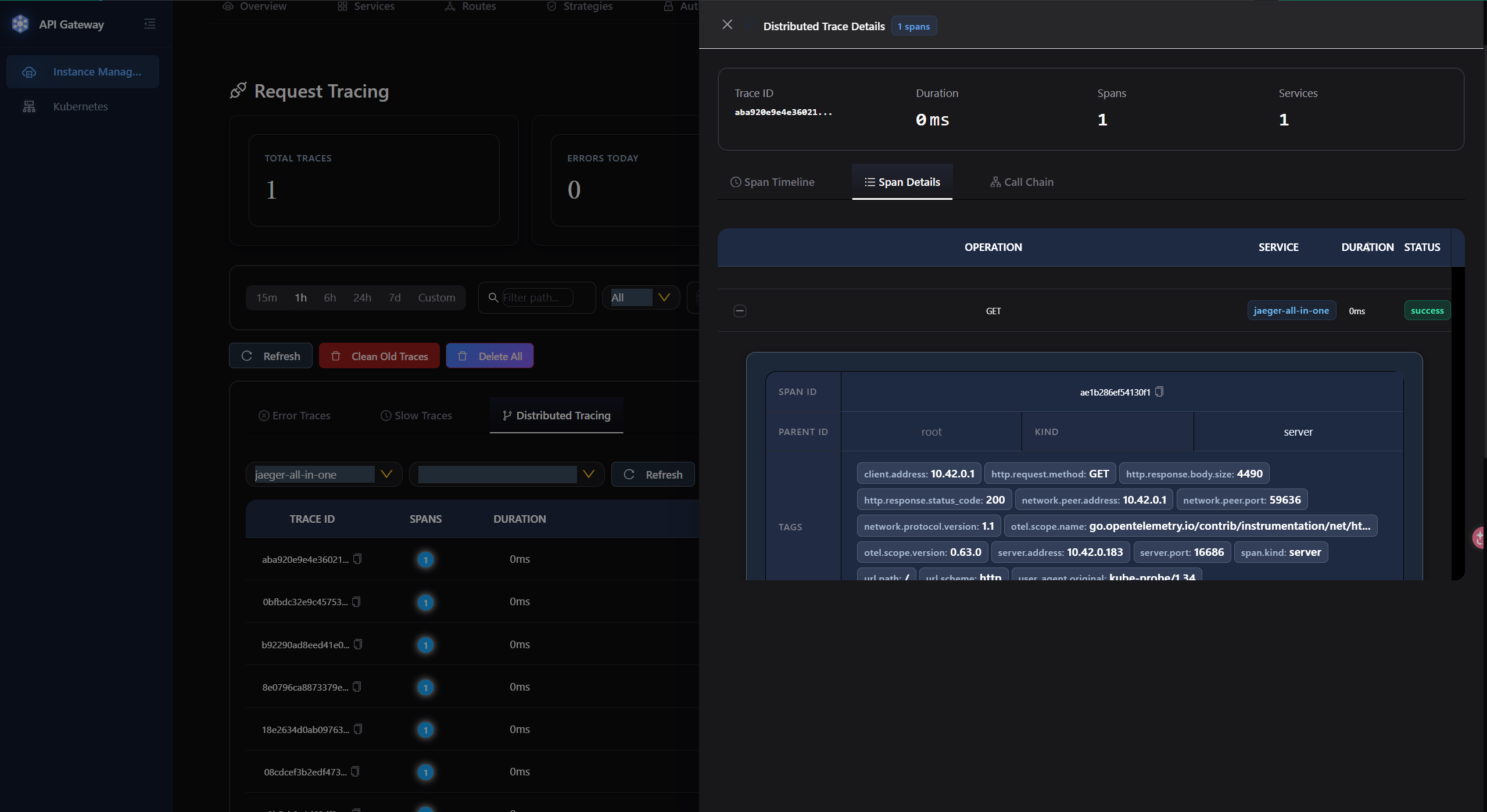

3.3 项目截图:请求链路追踪

图23:请求链路追踪,展示完整的分布式追踪详情,包括Trace ID、Span ID、各服务调用链、耗时分布。

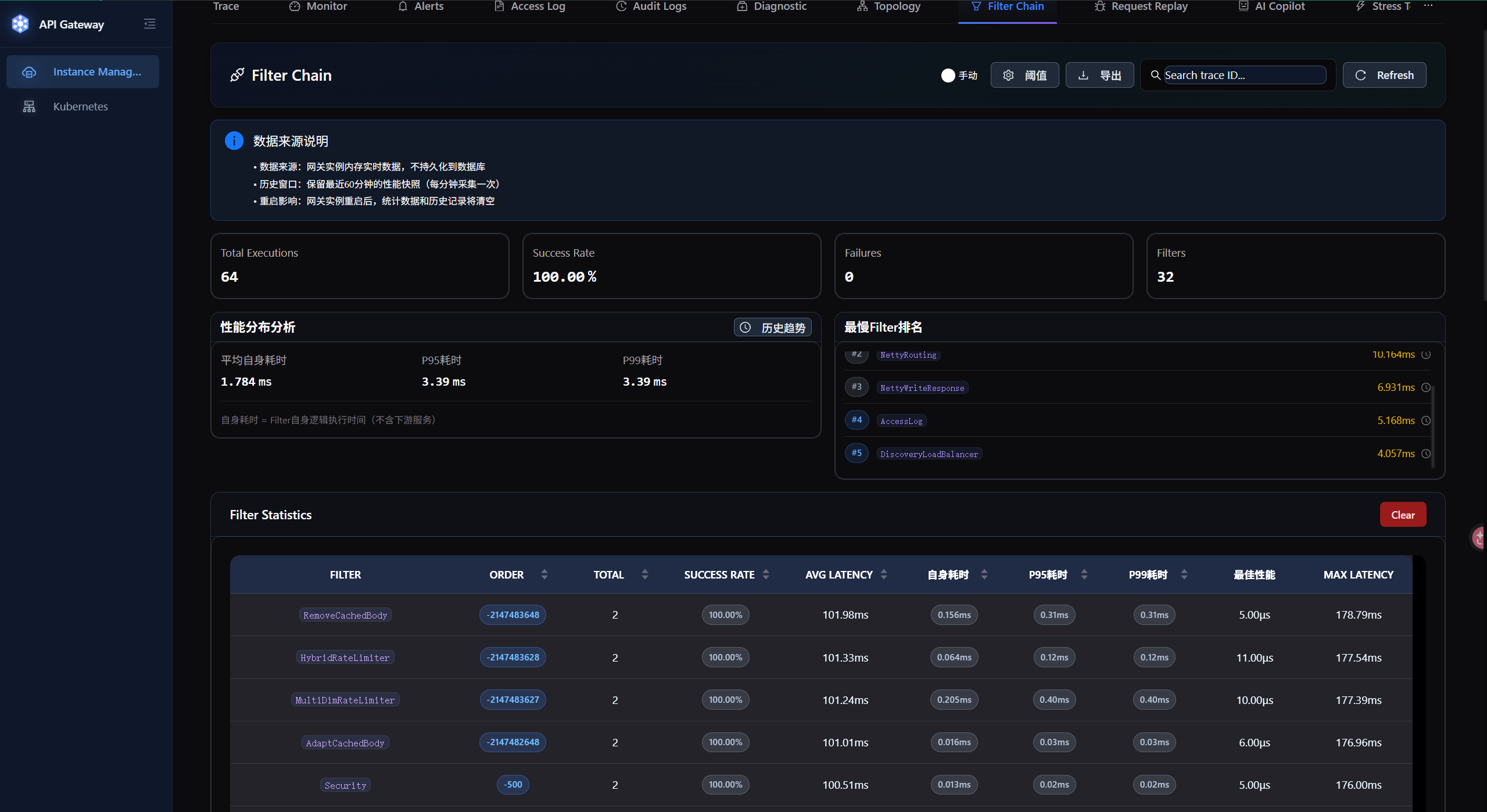

四、过滤器链性能分析(核心亮点)

4.1 selfTime vs totalTime

这是过滤器链分析的核心概念,准确定位性能瓶颈的关键:

| 指标 | 含义 | 用途 |

|---|---|---|

| totalTime | 从过滤器开始到请求完成的总时间(包含下游服务响应) | 请求 profiling |

| selfTime | 仅过滤器自身逻辑执行时间(不含下游) | 过滤器优化 |

示例对比:

FilterChainTracking: totalTime=430ms, selfTime=6ms ← 过滤器很快,totalTime包含后端响应

RemoveCachedBody: totalTime=424ms, selfTime=1ms ← 过滤器非常快

LoadBalancerFilter: totalTime=45ms, selfTime=45ms ← 过滤器本身慢(需要优化!)

AuthenticationFilter:totalTime=200ms, selfTime=5ms ← 过滤器很快,totalTime包含下游

关键洞察:大多数过滤器的totalTime相似,因为它们共享相同的下游服务响应时间。相邻过滤器totalTime的差值等于前一个过滤器的selfTime。

4.2 过滤器链追踪实现

@Component

public class FilterChainTrackingGlobalFilter implements GlobalFilter, Ordered {

// 过滤器统计信息存储(滑动窗口100条记录)

private final ConcurrentHashMap<String, FilterStats> statsMap = new ConcurrentHashMap<>();

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

String filterName = this.getClass().getSimpleName();

long startTime = System.currentTimeMillis();

return chain.filter(exchange)

.doOnSuccess(v -> recordSuccess(filterName, startTime))

.doOnError(throwable -> recordError(filterName, startTime, throwable));

}

private void recordSuccess(String filterName, long startTime) {

long duration = System.currentTimeMillis() - startTime;

FilterStats stats = statsMap.computeIfAbsent(filterName, k -> new FilterStats());

stats.recordSelfTime(duration);

}

/**

* 计算P50/P95/P99分位数

*/

public Percentiles calculatePercentiles(String filterName) {

FilterStats stats = statsMap.get(filterName);

if (stats == null) {

return Percentiles.EMPTY;

}

List<Long> sortedTimes = stats.getSortedSelfTimes();

return Percentiles.builder()

.p50(getPercentile(sortedTimes, 0.50))

.p95(getPercentile(sortedTimes, 0.95))

.p99(getPercentile(sortedTimes, 0.99))

.avg(stats.getAverageSelfTime())

.build();

}

}

4.3 项目截图:过滤器链分析

图41:过滤器链性能分析,展示每个过滤器的自身耗时、P99延迟、性能瓶颈识别。Key Finding:NettyWriteResponse的高自身时间(553.8ms)表明下游服务响应慢。

五、AI Copilot:35+智能工具实战

5.1 AI Copilot架构

AI Copilot是网关的智能运维助手,支持35+工具调用,能够自主查询系统状态、分析问题、提供优化建议。

5.2 支持的AI提供商

| 区域 | 提供商 | 模型 |

|---|---|---|

| 国内 | Qwen(通义千问)、DeepSeek | qwen-plus, qwen-turbo, deepseek-chat |

| 海外 | OpenAI、Anthropic、Google | GPT-4, GPT-3.5-turbo, Claude-3, Gemini |

| 本地 | Ollama | llama2, mistral |

5.3 动态Prompt管理

AI Copilot的Prompt存储在数据库中,支持动态更新,无需重启:

CREATE TABLE ai_copilot_prompts (

id BIGINT PRIMARY KEY AUTO_INCREMENT,

prompt_key VARCHAR(100) UNIQUE NOT NULL,

prompt_type VARCHAR(50) NOT NULL,

content TEXT NOT NULL,

description VARCHAR(500),

enabled BOOLEAN DEFAULT true,

created_at TIMESTAMP DEFAULT CURRENT_TIMESTAMP,

updated_at TIMESTAMP DEFAULT CURRENT_TIMESTAMP ON UPDATE CURRENT_TIMESTAMP

);

Prompt类型:

| 类型 | 说明 | 示例Key |

|---|---|---|

| SYSTEM | 系统级Prompt,定义AI行为 | system_default, system_route_gen |

| TASK | 任务级Prompt | error_analysis, route_generation |

| EXPLANATION | 概念解释Prompt | explain_rate_limit |

| CUSTOM | 用户自定义Prompt | custom_security_check |

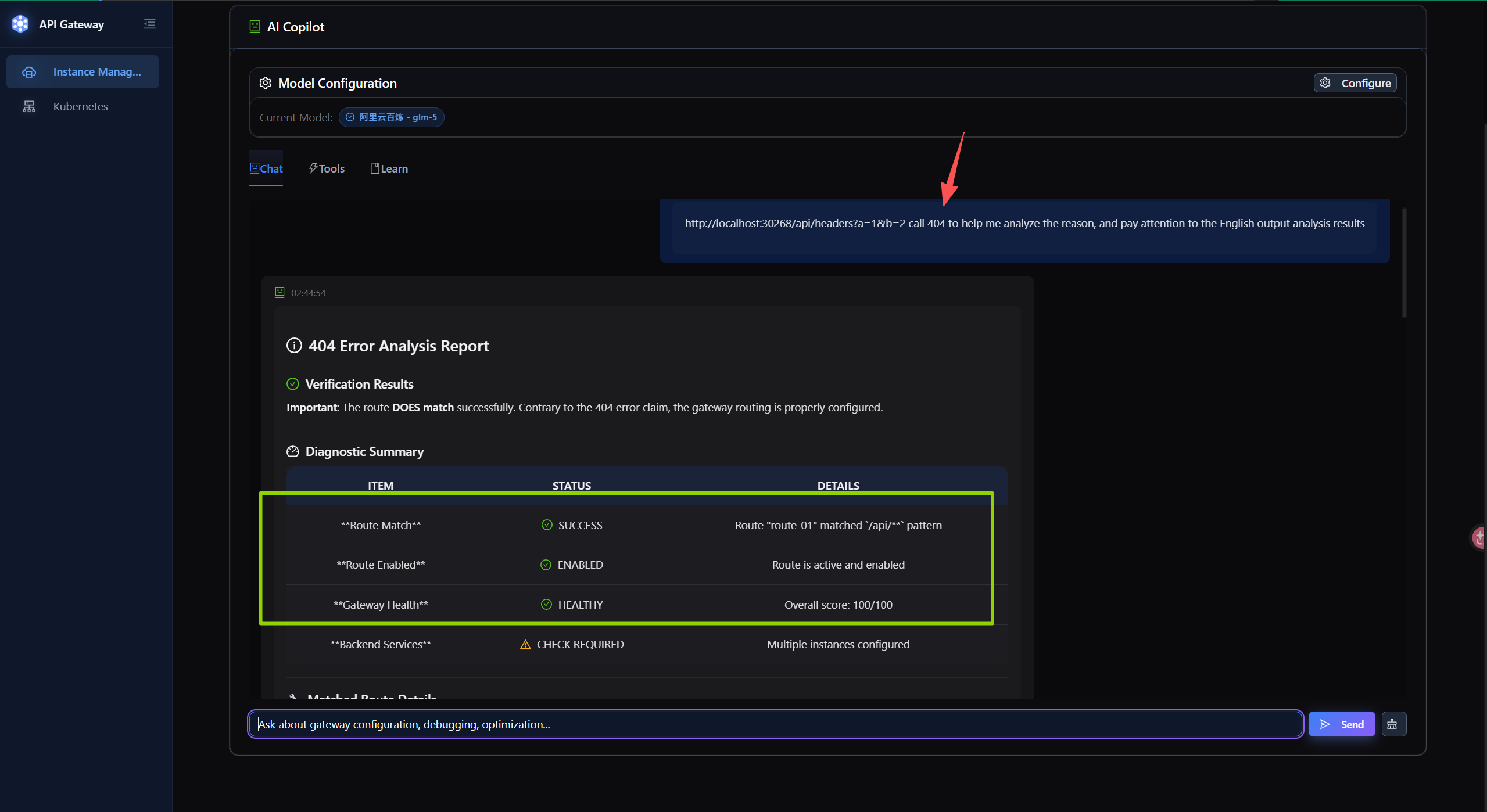

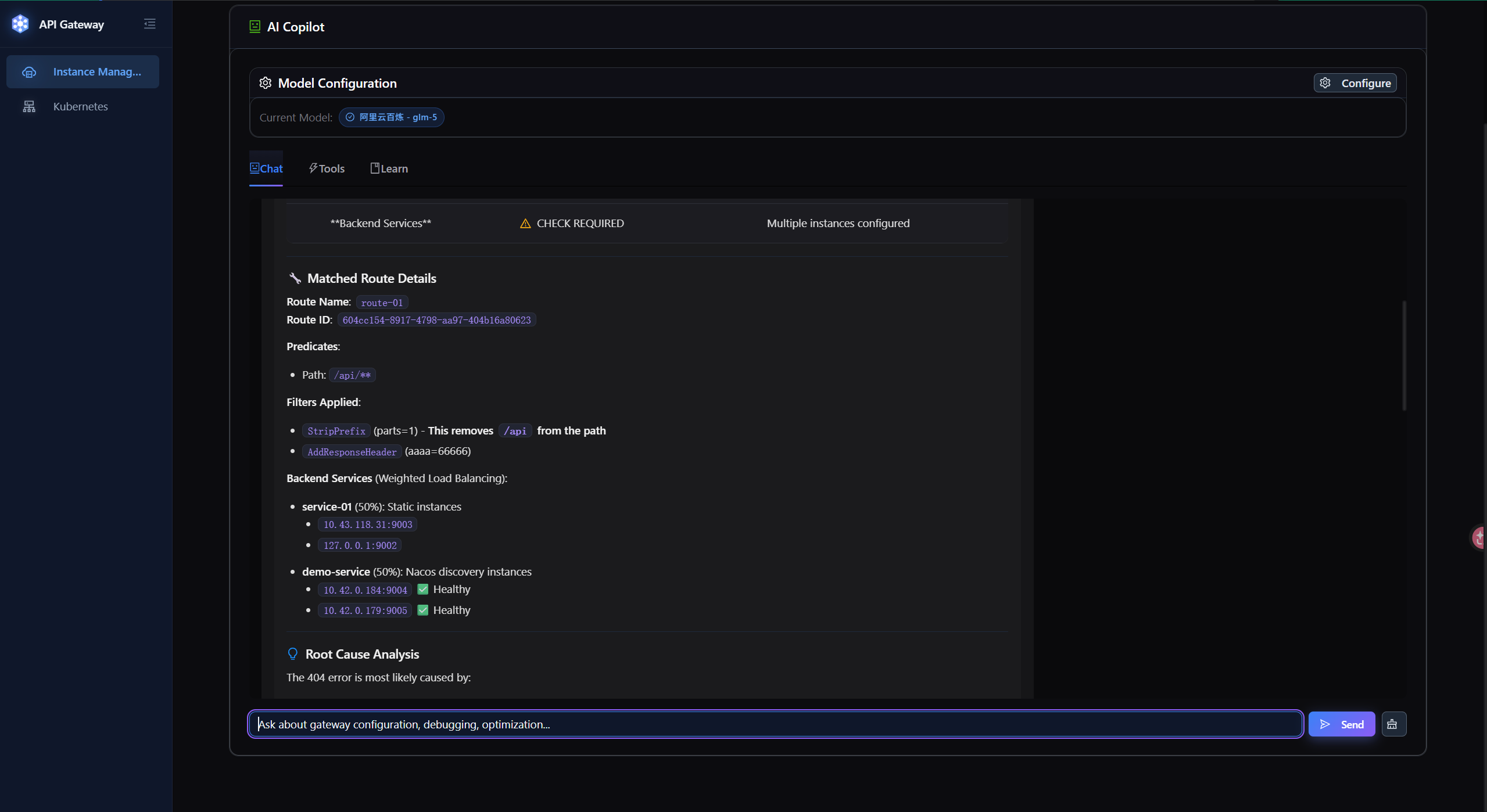

六、AI Copilot实战案例

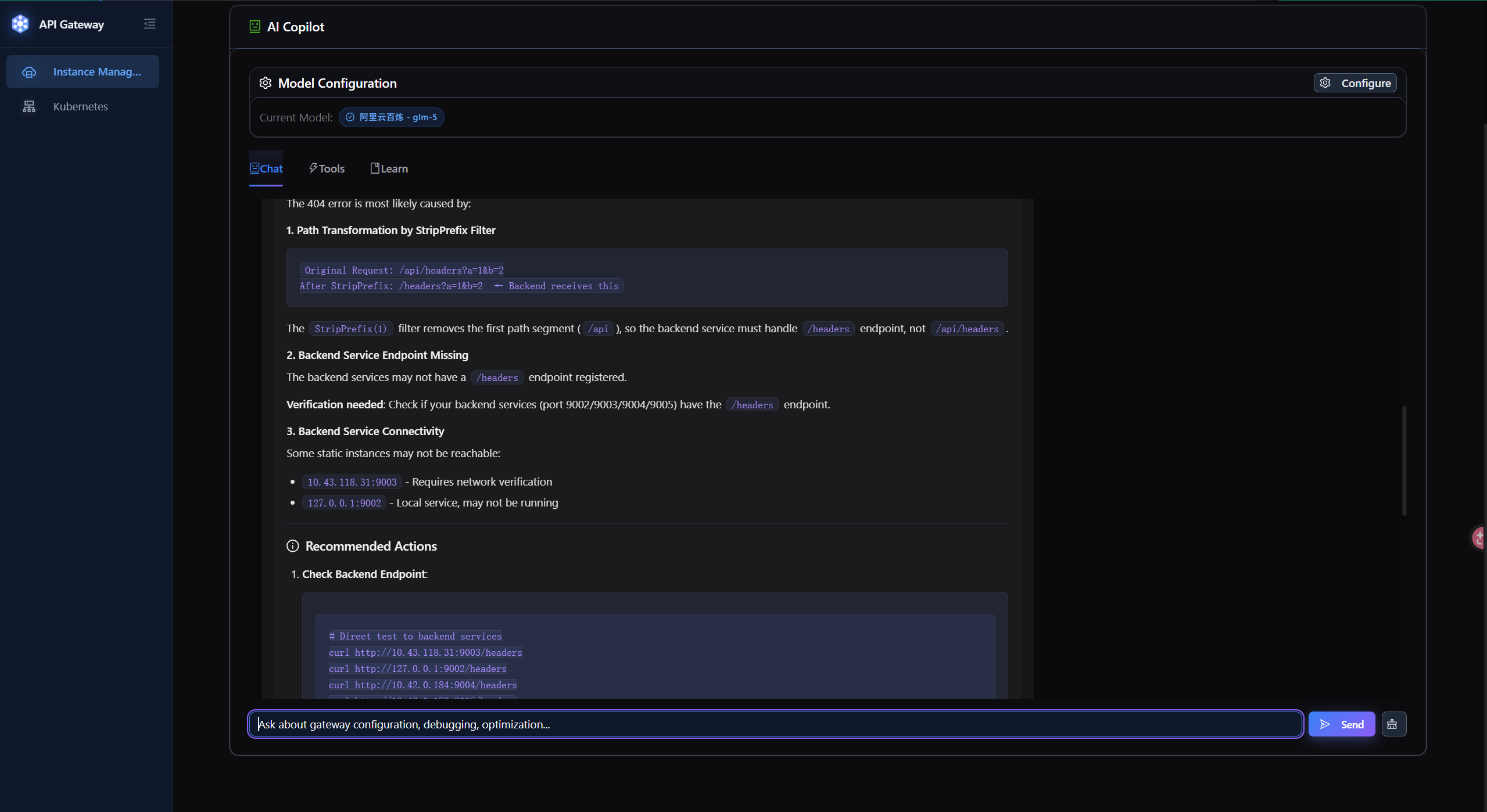

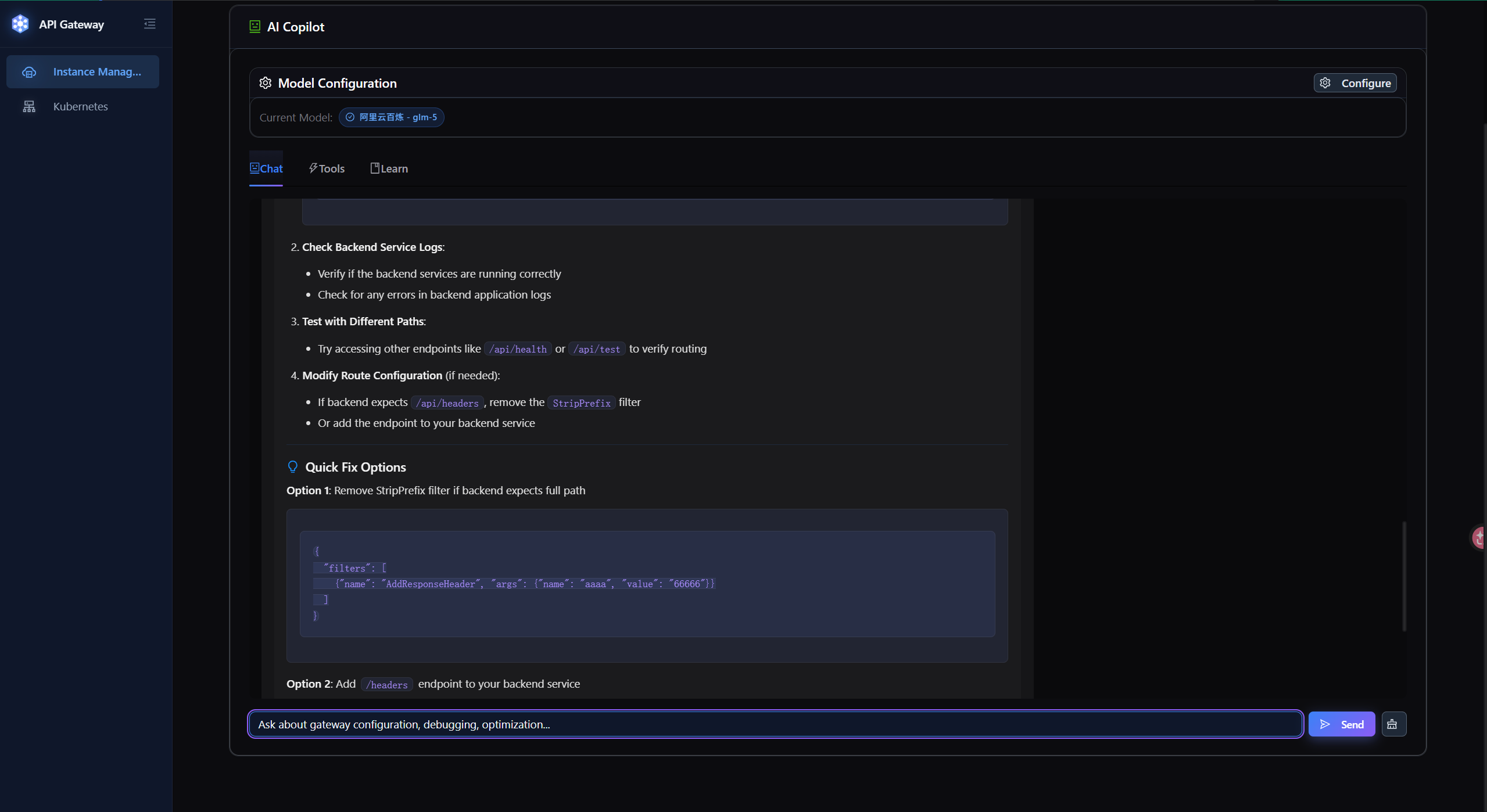

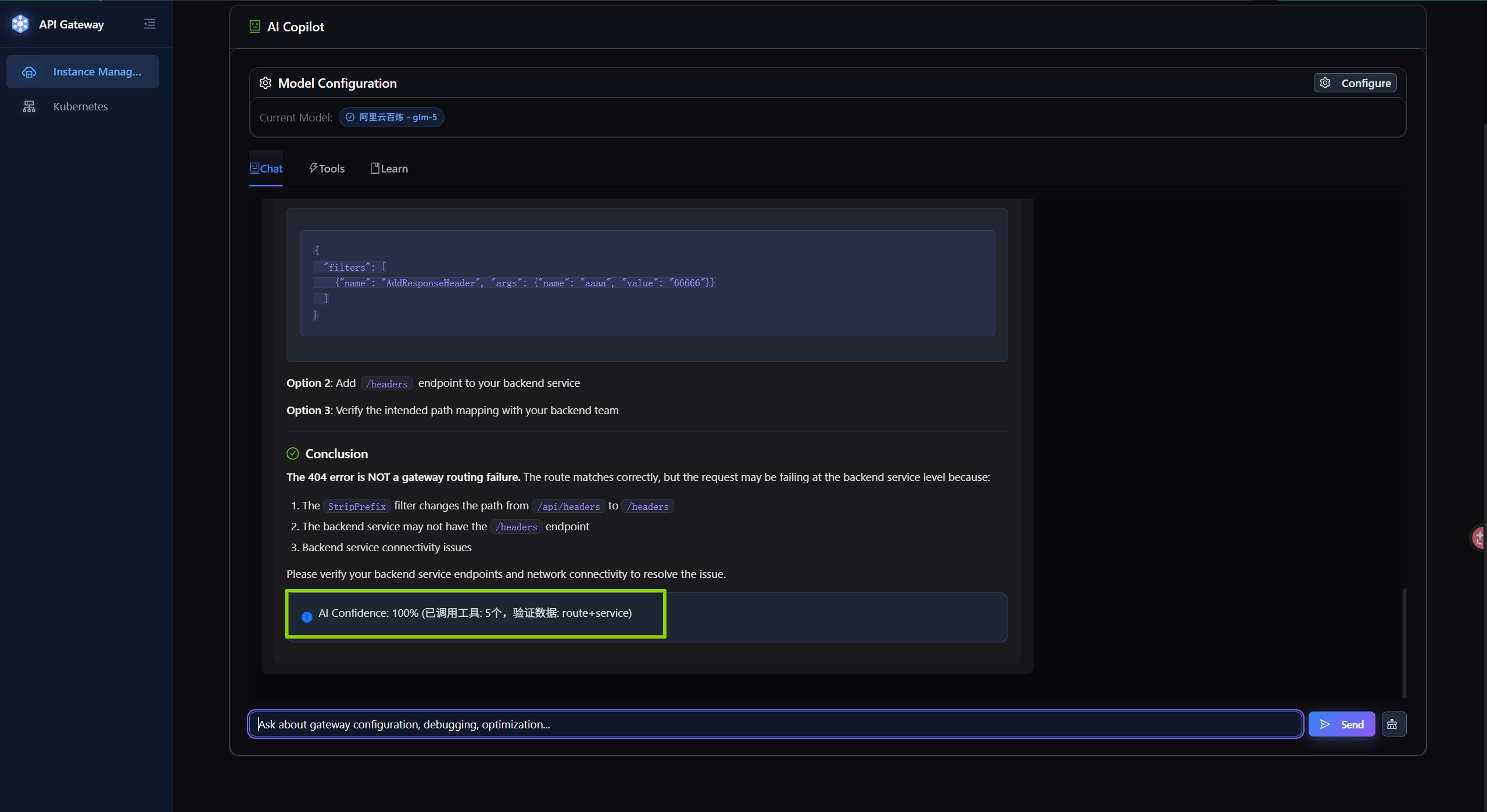

6.1 案例1:AI调试404错误(推翻用户结论)

场景:用户声称请求返回404,要求AI帮忙排查。

用户输入:

“Why is my request returning 404? Please help me analyze.”

AI执行流程:

AI分析结果:

404 Error Analysis Report

Verified Result (Tool-Based):

- Route Match: SUCCESS - The request path

/api/testmatches routeroute-01- Route Enabled: true

- Predicates: Path=/api/**

Conclusion: The request should NOT return 404 based on route configuration. There might be another issue (backend service unavailable, network problem, etc.)

项目截图:

图50-54:AI调试404错误全过程。用户声称404(50),AI查询路由配置(51),分析路由谓词(52),发现请求应该能匹配(53),推翻用户的404结论(54)。

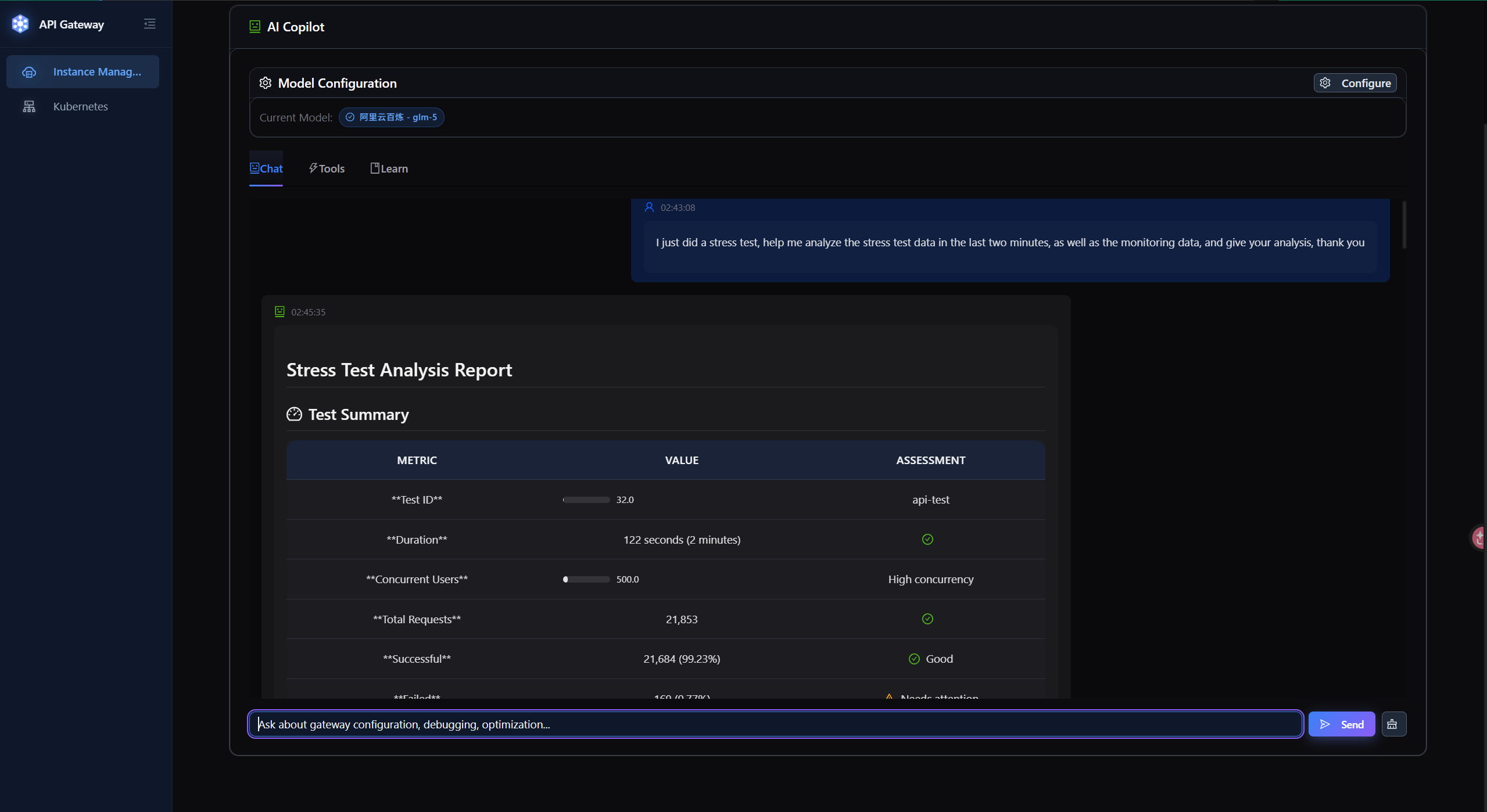

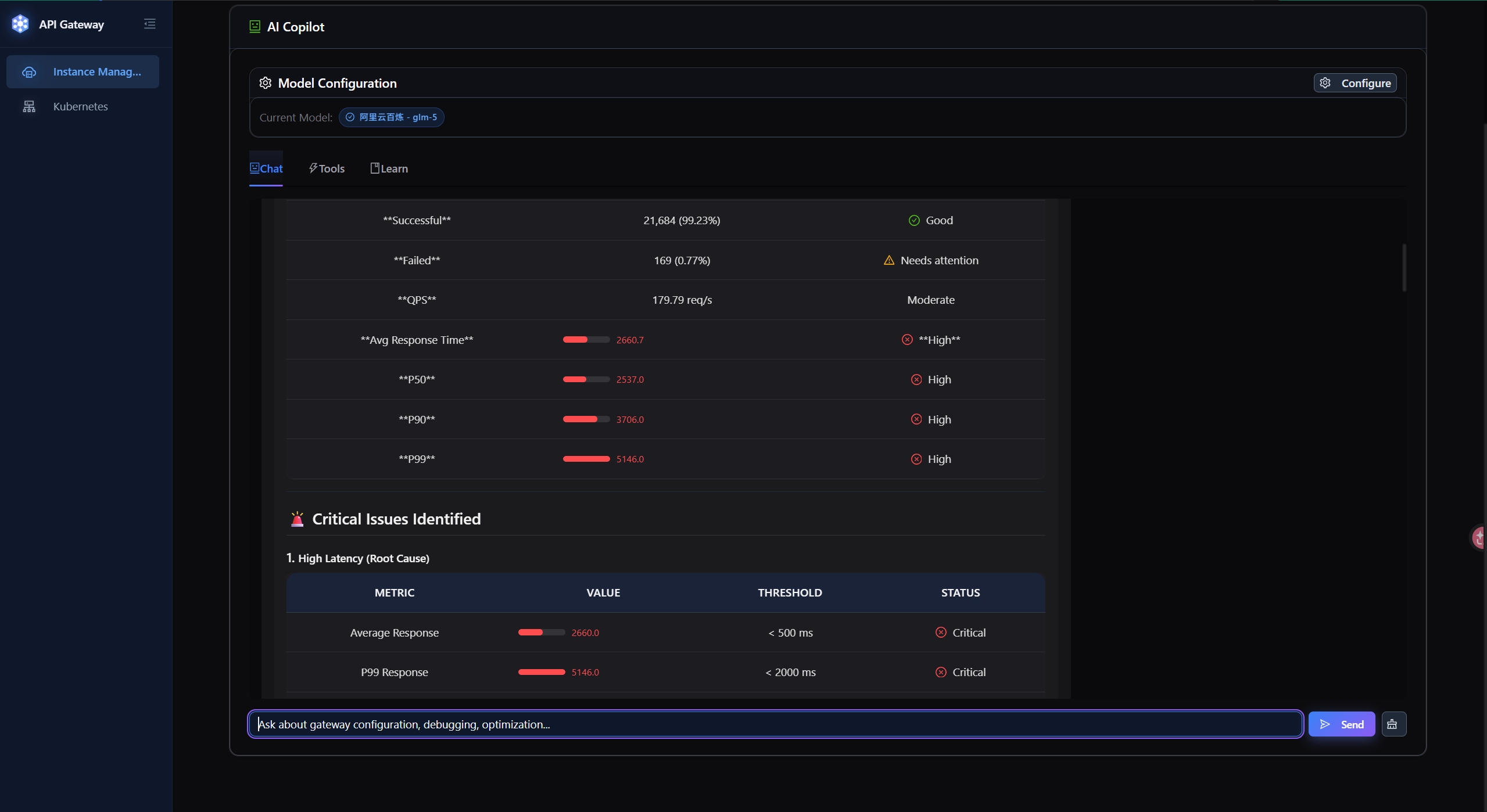

6.2 案例2:AI压测分析(基于Prometheus+数据库)

场景:压测完成后,用户要求AI分析最近2分钟的压测结果。

用户输入:

“Analyze the stress test results from the last 2 minutes.”

AI执行流程:

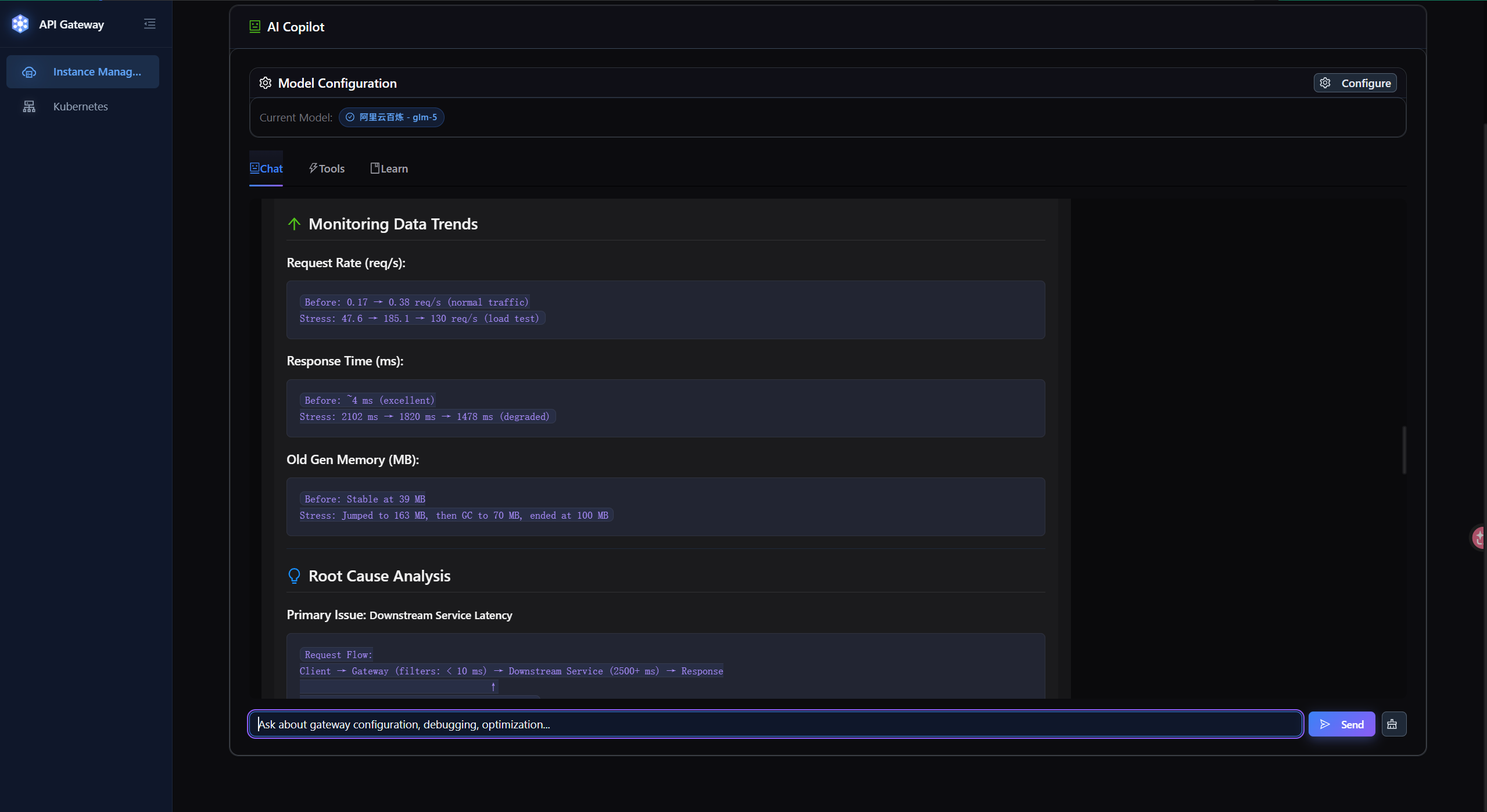

AI分析报告(节选):

Stress Test Analysis Report

Performance Summary:

- P99 Response Time: 596.0ms (Warning: >2000ms is critical)

- Error Rate: 0.8% (Warning: <0.1% is normal)

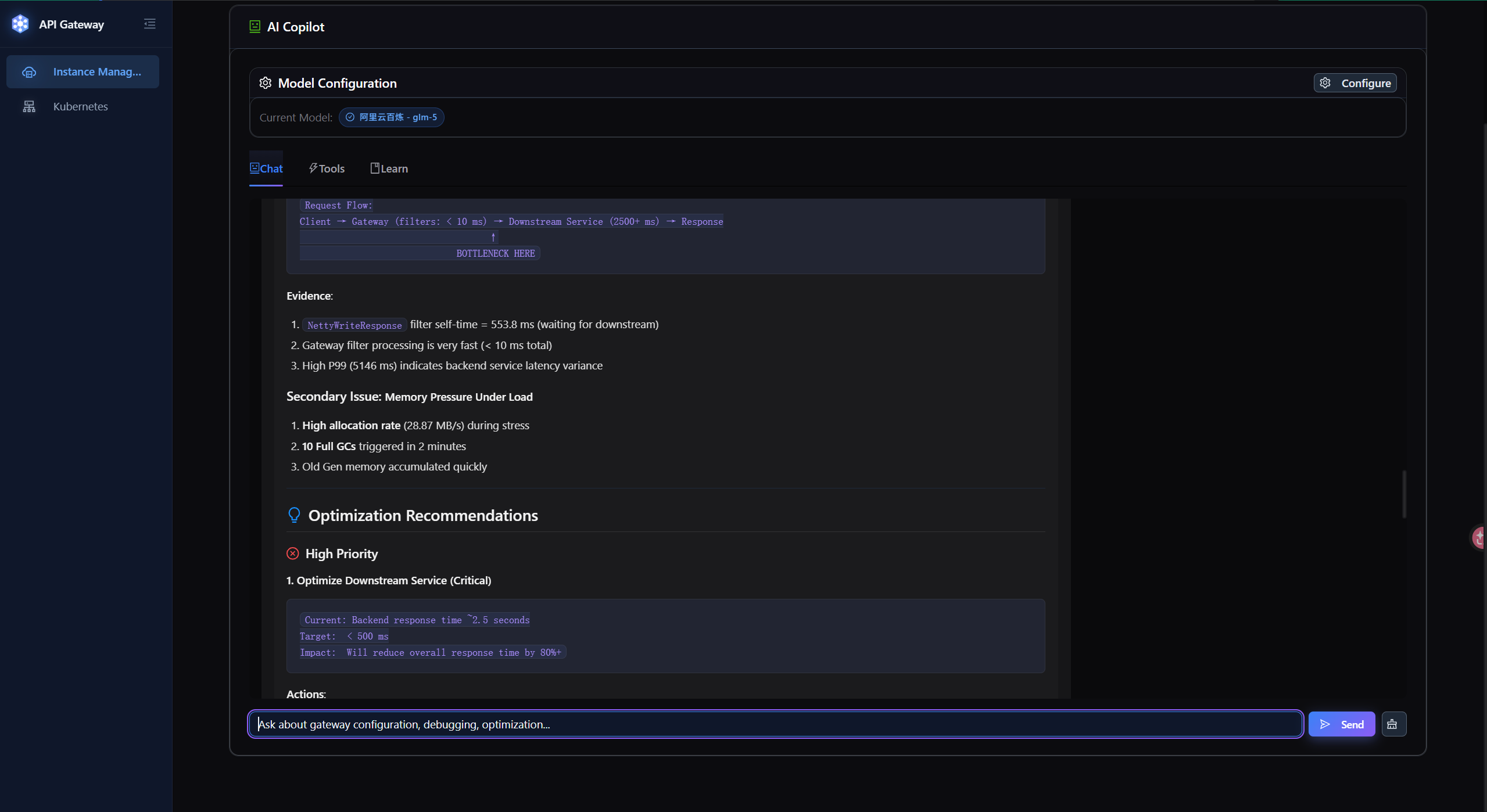

Root Cause Analysis:

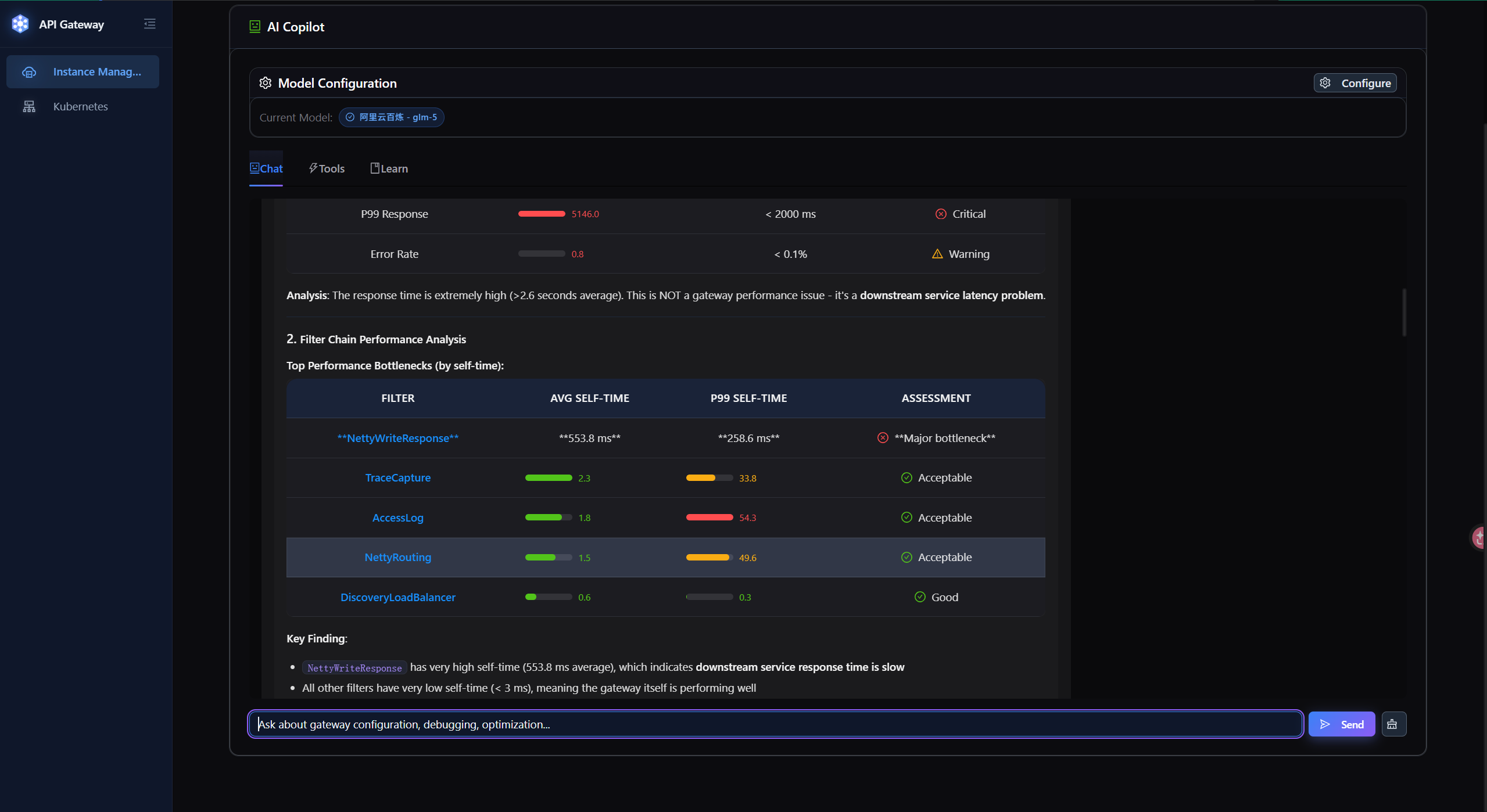

The response time is extremely high (>2.5 seconds average). This is NOT a gateway performance issue - it’s a downstream service latency problem.Filter Chain Performance:

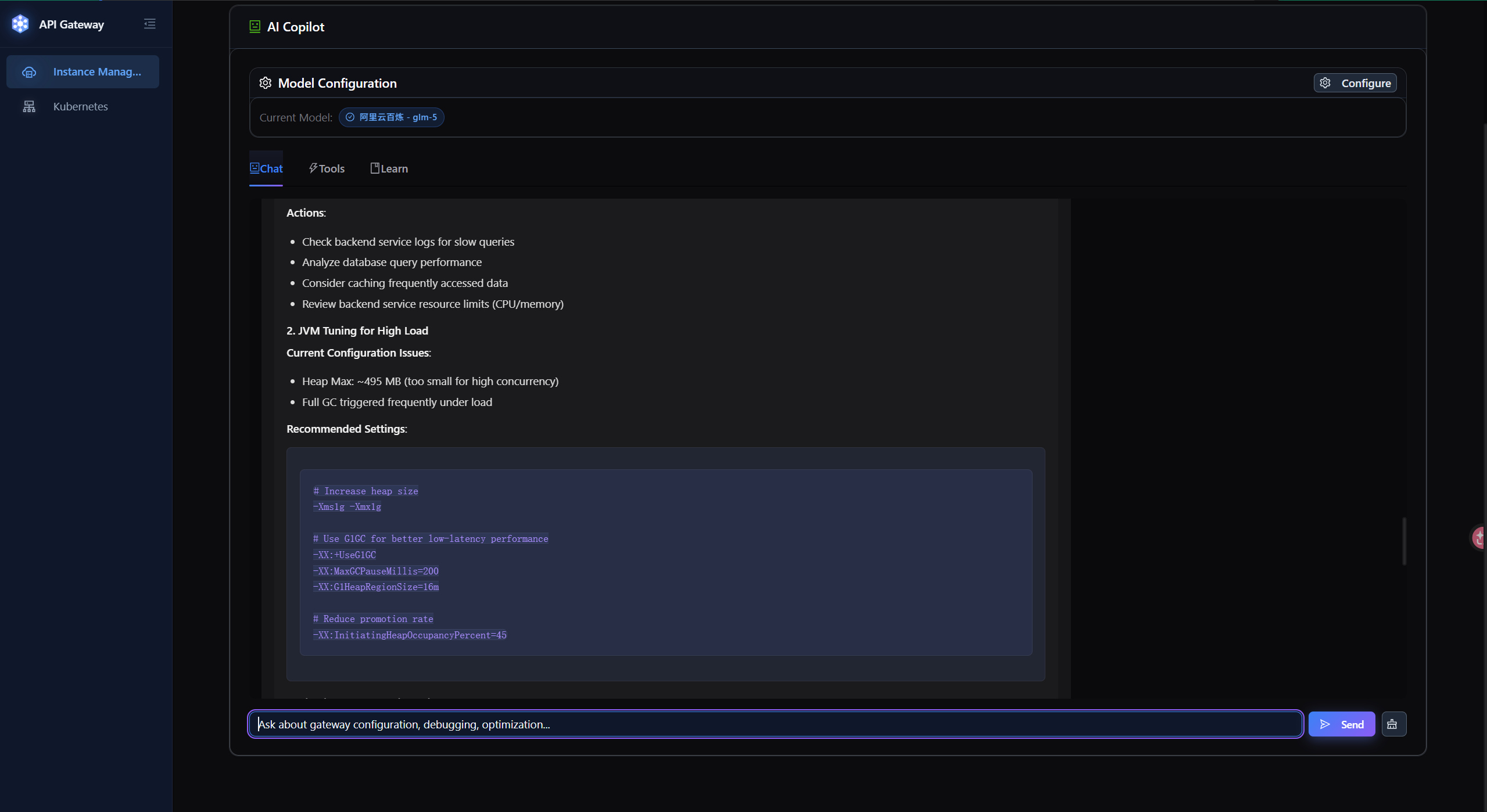

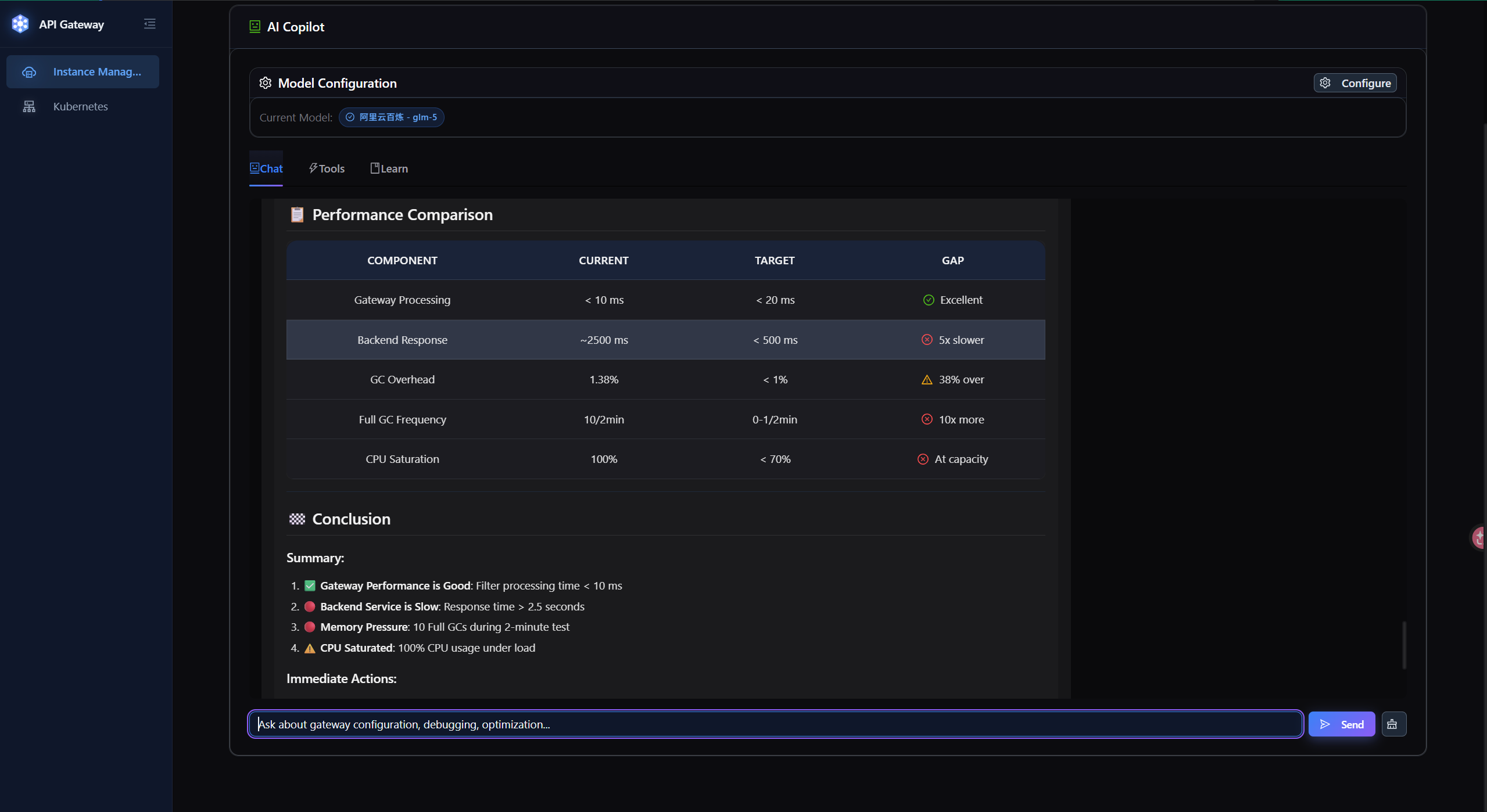

Filter Avg Self-Time P99 Self-Time Assessment NettyWriteResponse 553.8ms 2586ms Major bottleneck TraceCapture 2.3ms 33.8ms Acceptable AccessLog 1.8ms 54.3ms Acceptable NettyRouting 1.5ms 49.6ms Acceptable Key Finding: NettyWriteResponse has very high self-time (553.8ms average), which indicates downstream service response time is slow.

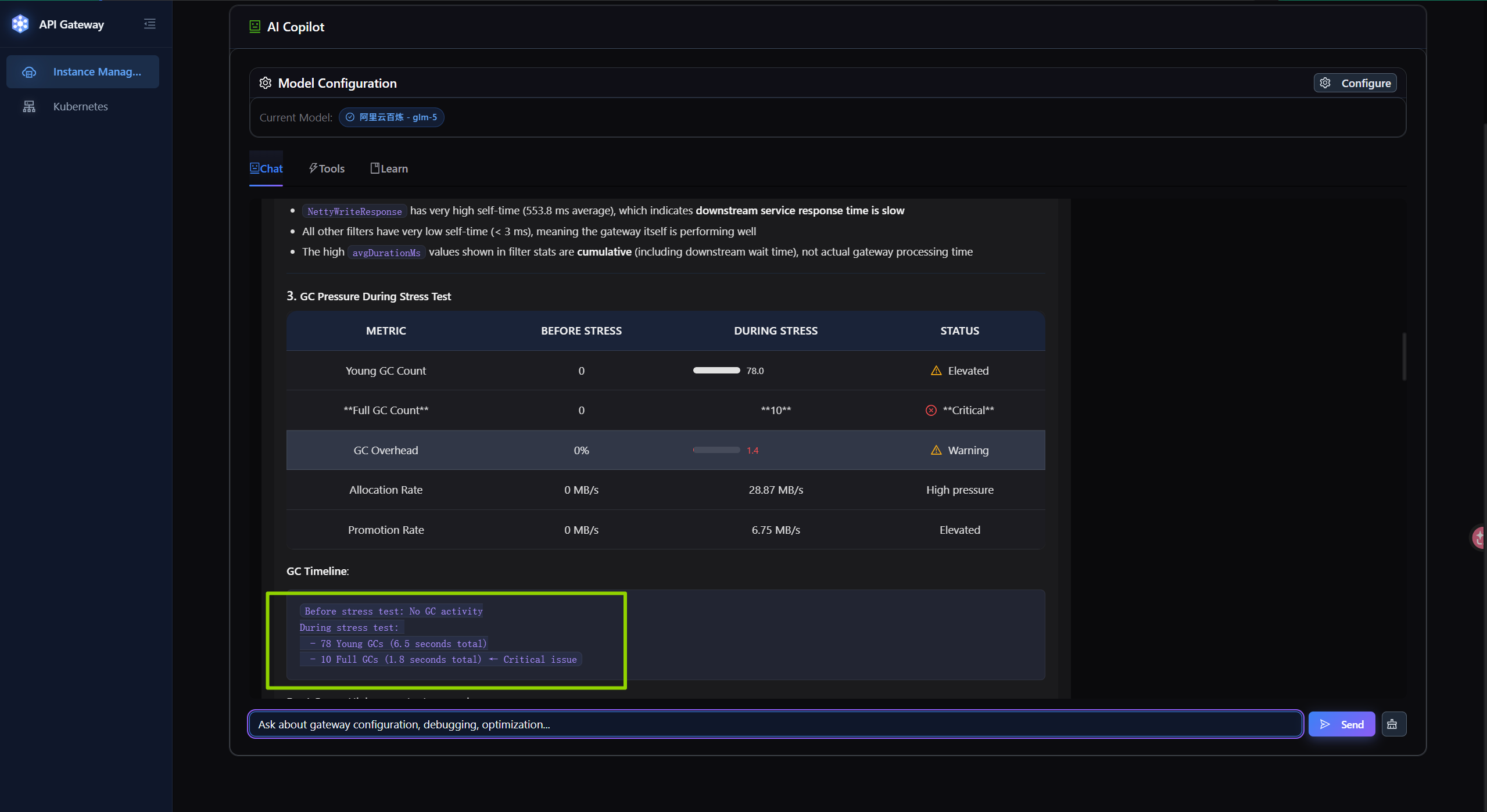

GC Pressure During Stress Test:

- Young GC Count: Before=0, During=78 (Elevated)

- Full GC Count: Before=0, During=10 (Critical)

- GC Overhead: Before=0%, During=1.4% (Warning)

Recommendations:

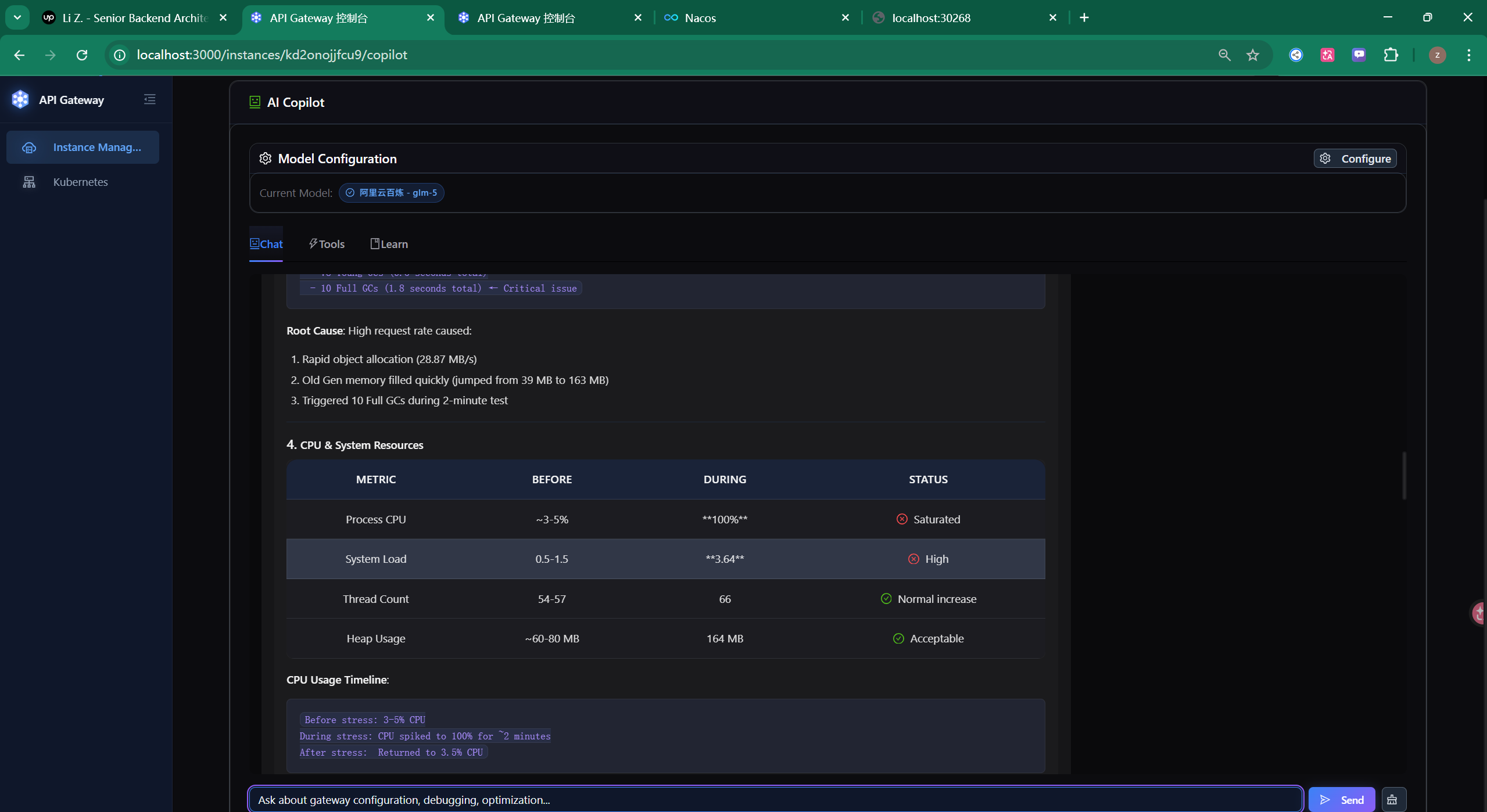

- High Priority: Optimize downstream service (target: <500ms response time)

- JVM Tuning: Increase heap size (-Xms1g -Xmx1g), use G1GC

- Connection Pool: Increase max connections to 1000

项目截图:

图55-63:AI压测分析全过程。性能分析报告(55)、GC压力分析(56)、根因分析(57)、监控数据趋势(58)、下游服务延迟根因(59)、优化建议(60)、JVM调优建议(61)、性能对比表(62)、结论总结(63)。

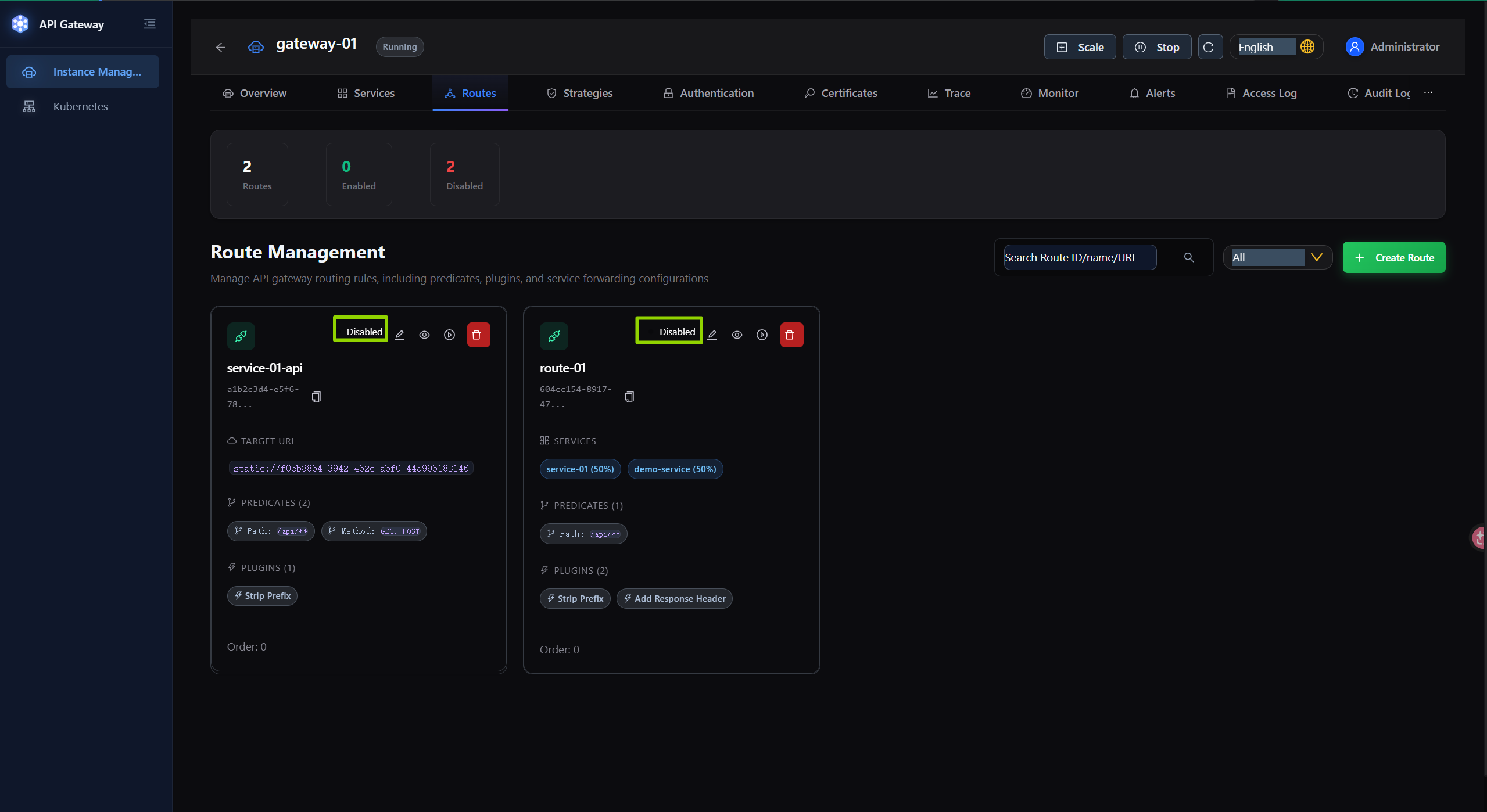

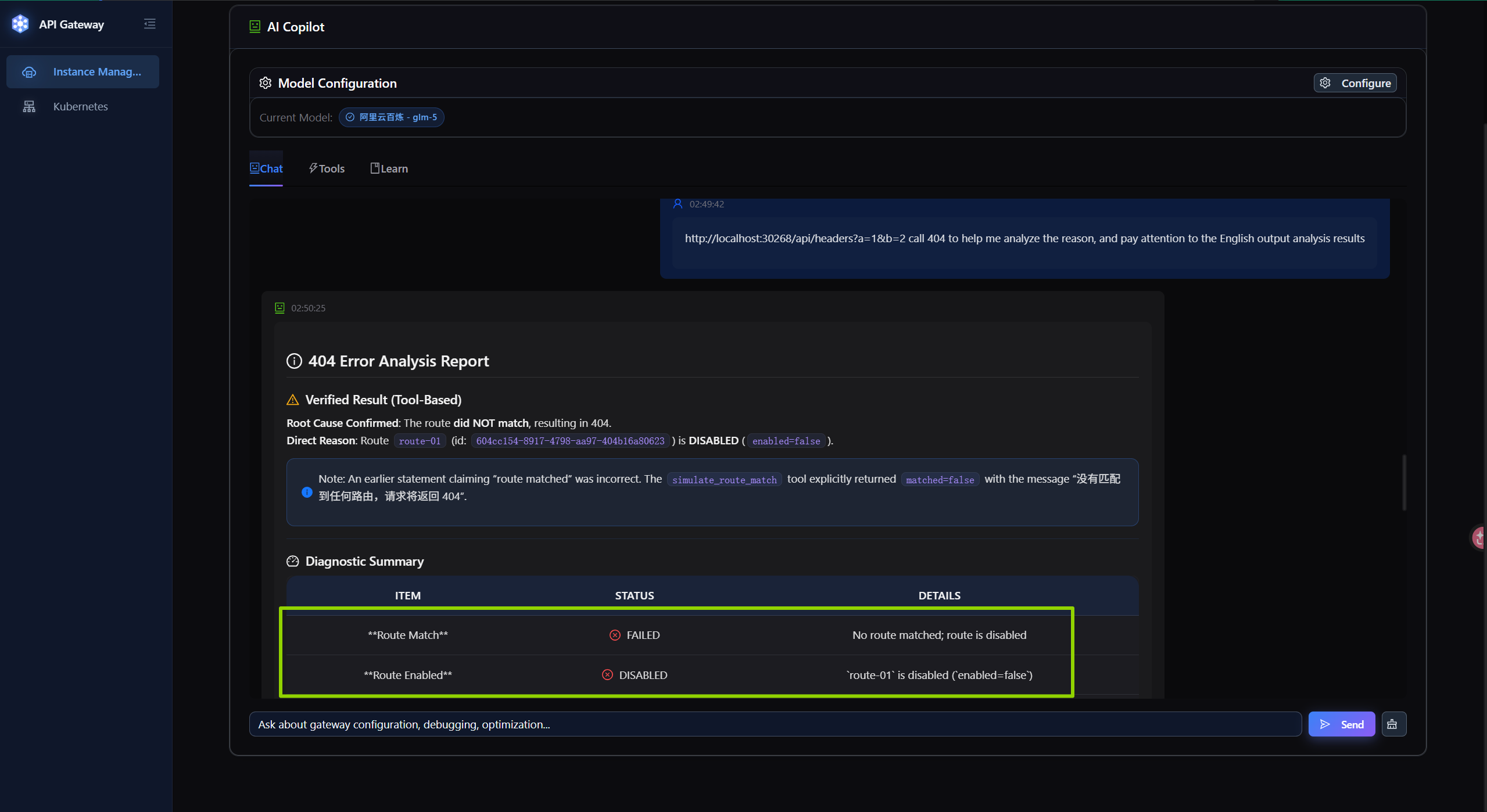

6.3 案例3:AI路由禁用分析

场景:用户禁用了所有路由后,再次询问为什么404。

用户输入:

“Why am I getting 404 when accessing /api/test?”

AI执行流程:

AI分析结果:

404 Error Analysis Report

Verified Result (Tool-Based):

- Route Match: FAILED - No route matched, route is disabled

- Route Enabled: DISABLED - route-01 is disabled (enabled=false)

Diagnostic Summary:

Item Status Details Route Match FAILED No route matched, route is disabled Route Enabled DISABLED route-01 is disabled (enabled=false) Gateway Health HEALTHY Overall score: 100/100 Backend Services CONFIGURED See details below Conclusion: All routes are disabled. No route can match the request, so the gateway returns 404. Enable at least one route to resolve this.

项目截图:

图64-66:AI路由禁用分析。路由管理界面显示所有路由被禁用(64),AI 404错误分析报告(65),AI详细路由配置分析(66)。

七、其他可观测性功能

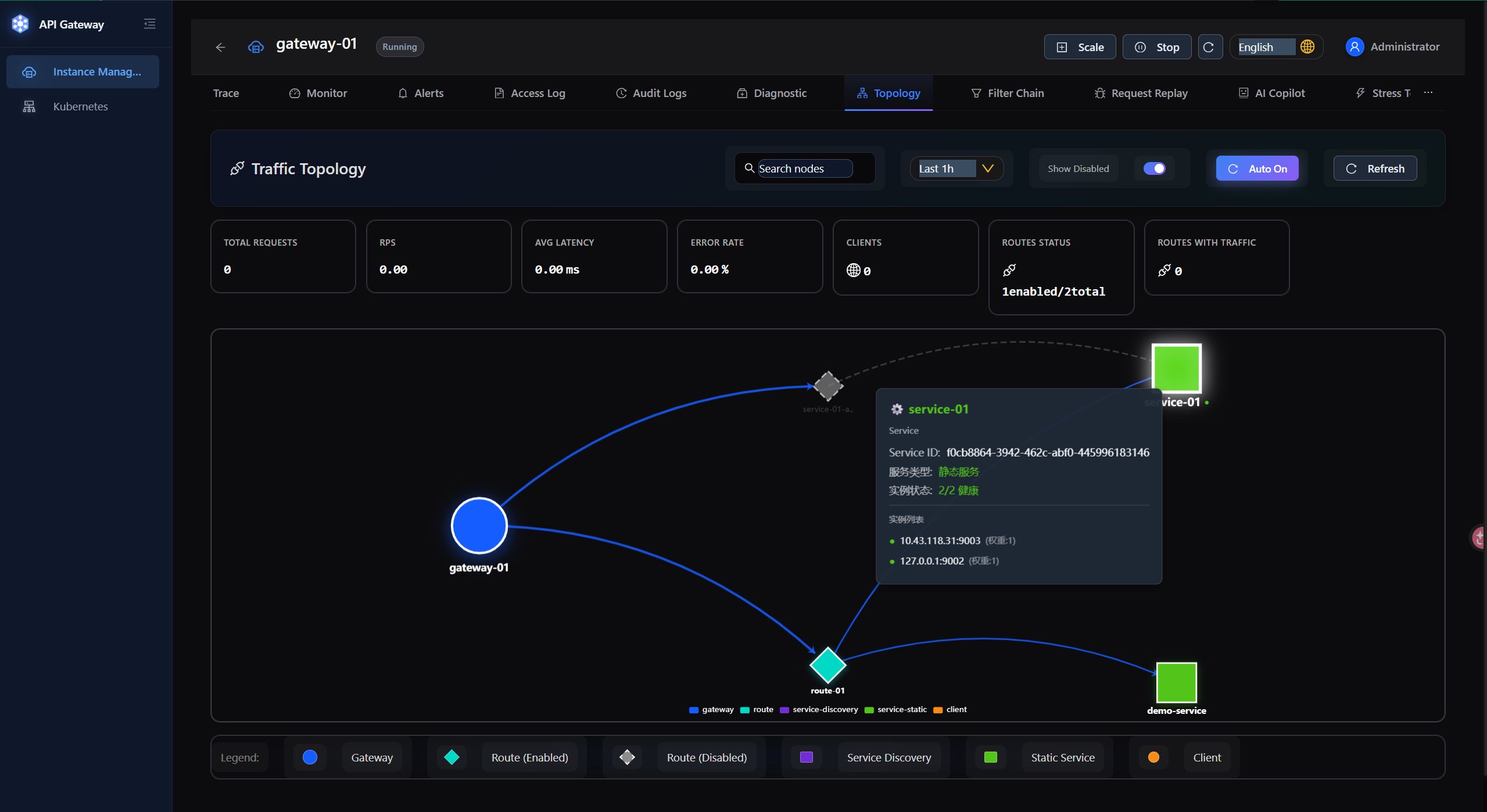

7.1 流量拓扑

图40:流量拓扑可视化,实时展示请求流量路径:gateway-01 → route-01 → service-01/demo-service,直观呈现流量分布和服务健康状态。

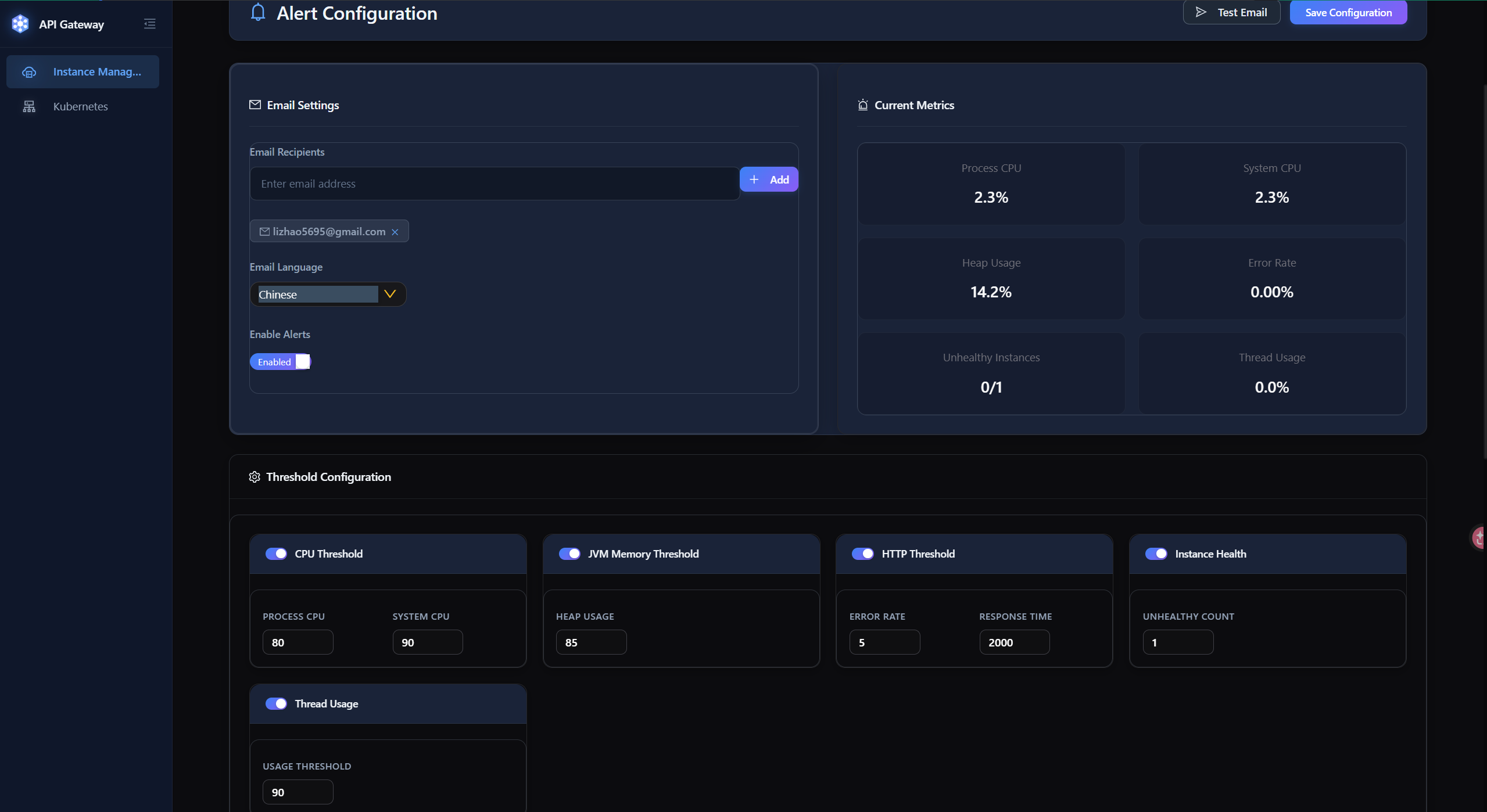

7.2 告警配置

图32:告警配置界面,支持设置邮件告警。可配置告警阈值(CPU、内存、响应时间等)、接收人邮箱、告警频率等。

7.3 系统诊断

图38-39:系统诊断功能。健康检查(38):Nacos连接、Redis可用性、数据库健康、JVM状态。诊断报告(39):系统健康评分、各组件检查状态、优化建议。

八、核心代码文件索引

| 功能 | 文件路径 | 说明 |

|---|---|---|

| AI Copilot控制器 | gateway-admin/src/main/java/com/leoli/gateway/admin/controller/AiCopilotController.java |

AI Copilot REST API |

| 工具执行器 | gateway-admin/src/main/java/com/leoli/gateway/admin/service/ai/ToolExecutor.java |

统一工具执行框架 |

| 路由生成器 | gateway-admin/src/main/java/com/leoli/gateway/admin/service/ai/RouteGeneratorTool.java |

AI路由生成工具 |

| 错误分析器 | gateway-admin/src/main/java/com/leoli/gateway/admin/service/ai/ErrorAnalyzerTool.java |

AI错误分析工具 |

| Prometheus查询 | gateway-admin/src/main/java/com/leoli/gateway/admin/service/monitoring/PrometheusQueryService.java |

Prometheus指标查询 |

| 过滤器链追踪 | my-gateway/src/main/java/com/leoli/gateway/filter/FilterChainTrackingGlobalFilter.java |

过滤器性能追踪 |

| TraceId生成器 | my-gateway/src/main/java/com/leoli/gateway/filter/TraceIdGlobalFilter.java |

TraceId生成与传递 |

| Trace捕获器 | my-gateway/src/main/java/com/leoli/gateway/filter/TraceCaptureGlobalFilter.java |

请求追踪捕获 |

九、总结与预告

本篇总结

本文介绍了企业级API网关的全链路可观测性与AI Copilot:

- 实时监控:JVM、CPU、HTTP全面监控,Prometheus集成

- 分布式追踪:TraceId传递,Jaeger集成,慢请求/错误请求捕获

- 过滤器链分析:selfTime vs totalTime核心概念,P50/P95/P99分位数

- AI Copilot:35+工具,支持Qwen/DeepSeek/GPT/Claude多模型

- AI实战案例:

- 案例1:AI调试404,推翻用户结论

- 案例2:AI压测分析,基于Prometheus+数据库真实数据

- 案例3:AI路由禁用分析,准确定位根因

- 其他功能:流量拓扑、告警配置、系统诊断

下篇预告

第5篇:Kubernetes部署与测试保障

- Kubernetes多实例管理

- Namespace隔离实现

- 心跳监控机制(Running/Warning/Error)

- 资源配置管理(small/medium/large/xlarge)

- 压力测试工具(9个测试模板)

- GC智能诊断与JVM调优

- 配置调和机制(数据库 vs Nacos一致性)

- 561个测试用例覆盖策略

敬请期待!

参考资料

关于作者

李朝,网关开发,7年+分布式系统经验,专注于API网关、微服务架构、云原生技术领域。

50天独立开发企业级API网关平台,涵盖44项核心功能、561个测试用例,从架构设计到生产环境部署全流程实践。

专业服务

如果你需要构建类似的API网关或微服务平台,我可以提供以下服务:

- API网关定制开发:根据业务需求定制开发网关功能

- 架构设计与咨询:微服务架构设计、技术选型、性能优化

- 性能调优:JVM调优、连接池优化、限流降级方案

- AI集成:AI Copilot开发、智能运维、自动化诊断

联系方式:

- Email: lizhao5695@gmail.com

- Upwork: https://www.upwork.com/freelancers/~017be8c63f36907379

- GitHub: https://github.com/leoli5695

- 演示地址: https://www.bilibili.com/video/BV1S29xBsEt2

需要API网关或微服务架构方面的帮助? 欢迎通过邮件或Upwork联系我,提供技术咨询和定制开发服务。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)