【大模型开源与闭源之争】性能差距仅 0.3%,企业到底怎么选?

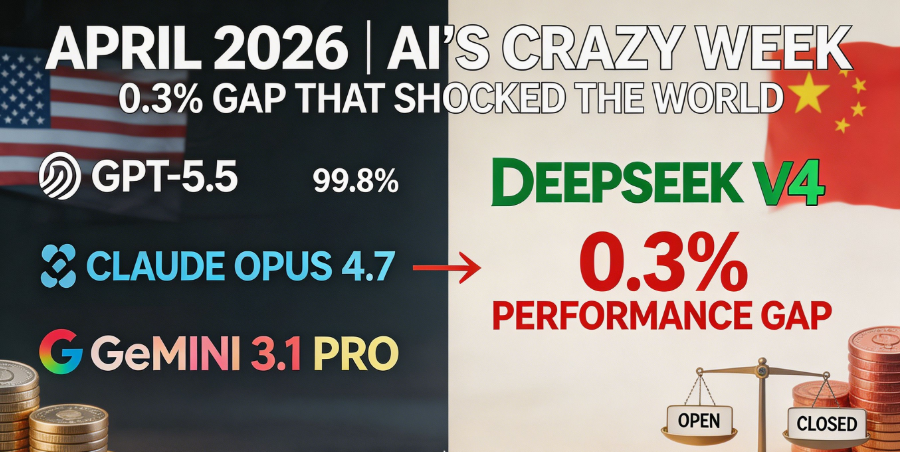

2026 年 4 月,AI 圈经历了"史上最疯狂一周"——OpenAI 发布 GPT-5.5,DeepSeek 开源 V4,Claude Opus 4.7 上线,Gemini 3.1 Pro 更新。但最值得关注的数据不是某个模型的 benchmark 分数,而是一个数字:**0.3%**。根据 Introl 的评测,开源模型(DeepSeek V4、Qwen 3.6、Llama 4)与闭源模型(G

【大模型开源与闭源之争】性能差距仅 0.3%,企业到底怎么选?

写在前面(2026.05.04 首发):2026 年 4 月,AI 圈经历了"史上最疯狂一周"——OpenAI 发布 GPT-5.5,DeepSeek 开源 V4,Claude Opus 4.7 上线,Gemini 3.1 Pro 更新。但最值得关注的数据不是某个模型的 benchmark 分数,而是一个数字:0.3%。根据 Introl 的评测,开源模型(DeepSeek V4、Qwen 3.6、Llama 4)与闭源模型(GPT-5.5、Claude Opus 4.7)之间的性能差距已缩小至 0.3%。两年前这个数字是 30%,一年前是 3%。与此同时,白宫发布了"反蒸馏"政策备忘录,指责中国使用蒸馏技术进行"知识产权窃取"。开源与闭源之争,已经从技术路线之争,升级为地缘政治、商业利益和技术哲学的三重博弈。

这篇文章从性能、成本、安全、生态、监管五个维度,把这场战争讲透。

我之前写过上下文工程、大模型蒸馏详解、GPT-5.5参数与推理深度解析、10道 RAG高频面试题——这篇文章站在更高的视角,看大模型行业的底层格局。

📑 文章目录

- 📌 一、开源 vs 闭源:定义与阵营

- 📊 二、性能差距正在消失:从 30% 到 0.3%

- 💰 三、成本对比:开源的绝对优势

- 🔒 四、数据安全与合规:开源的杀手锏

- 🛠️ 五、定制化能力:开源碾压闭源

- 🌐 六、生态与社区:开源的飞轮效应

- ⚖️ 七、闭源的护城河:还剩什么?

- 🏛️ 八、监管风暴:白宫"反蒸馏"与全球 AI 治理

- 🎯 九、企业选型决策框架

- 🔮 十、未来趋势:2026-2028 预判

- 🎁 总结速查卡

📌 一、开源 vs 闭源:定义与阵营

1.1 什么是开源大模型?

开源大模型是指将模型的权重文件、架构代码、技术文档公开发布,任何人都可以下载、修改、商用的大模型。这里的"开源"和传统软件的开源(如 Linux)有所不同——大模型的开源通常只开放推理权重,不开放训练数据、训练代码和训练基础设施。即便如此,开源大模型已经给行业带来了革命性的变化。

开源阵营核心玩家:

| 模型 | 机构 | 参数量 | 许可证 | 定价 (per M Token) |

|---|---|---|---|---|

| DeepSeek V4 | DeepSeek | 1.6T (49B 激活) | MIT | $0.27 / $1.10 |

| Qwen 3.6 | 阿里 | 全系列 | Apache 2.0 | $0.14 / $0.42 |

| Llama 4 | Meta | 全谱系 | Llama License | 自部署免费 |

| Mistral Large | Mistral | 123B | Apache 2.0 | $0.80 / $2.40 |

| GLM-4 | 智谱 | 全系列 | Apache 2.0 | $0.10 / $0.10 |

MIT 和 Apache 2.0 是最宽松的开源许可证,允许商用、修改、分发,几乎没有限制。Meta 的 Llama License 略有收紧,对月活超过 7 亿的用户需要申请特殊许可,但对绝大多数企业来说等同于完全开源。

1.2 什么是闭源大模型?

闭源大模型是指只通过 API 提供服务,不公开模型权重、架构细节和训练数据的大模型。用户只能通过 API 发送请求、接收响应,无法查看或修改模型内部。

闭源阵营核心玩家:

| 模型 | 机构 | 定价 (per M Token) | 上下文 | 特色 |

|---|---|---|---|---|

| GPT-5.5 | OpenAI | $5 / $30 | 128K+ | Agent 原生 |

| Claude Opus 4.7 | Anthropic | $15 / $75 | 200K | Adaptive Thinking |

| Gemini 3.1 Pro | $1.25 / $10 | 1M+ | 多模态最强 | |

| Grok 4 | xAI | $3 / $15 | 128K | 实时信息 |

| Cohere Command R+ | Cohere | $2.50 / $10 | 128K | 企业级 RAG |

1.3 两大阵营的本质区别

开源和闭源的本质区别不在于技术,而在于商业模式和哲学理念:

-

闭源派(OpenAI、Anthropic、Google)认为:AI 能力过于强大,应该由专业团队控制,通过 API 提供服务,确保安全性和盈利能力。OpenAI 从非营利转为营利性公司,Anthropic 估值超 600 亿美元,Google 通过 Gemini 强化云服务——闭源是他们的核心商业模式。

-

开源派(Meta、DeepSeek、阿里)认为:AI 应该像 Linux 一样成为基础设施,通过开源构建生态、吸引开发者、降低行业门槛。Meta 的策略最清晰——开源模型削弱竞争对手的护城河,同时强化自己的广告和社交业务。DeepSeek 的开源则展示了中国 AI 的技术实力。

📊 二、性能差距正在消失:从 30% 到 0.3%

2.1 四年追赶时间线

大模型开源与闭源的性能差距,在过去四年里经历了断崖式缩小:

2023 年初:GPT-4 时代,差距约 30%

GPT-4 的发布让整个行业震惊——它在推理、编码、数学等任务上远超所有开源模型。当时最强的开源模型是 Llama 1(7B),只能完成最基本的文本生成任务。闭源模型在几乎所有 benchmark 上碾压开源,差距约 30%。

2024 年:Llama 2/3 时代,差距缩小至 15%

Meta 发布 Llama 3(8B/70B),开源模型首次在部分 benchmark 上接近 GPT-4 水平。Hugging Face 生态爆发,vLLM、LLaMA-Factory 等工具链成熟。DeepSeek V2 以 MoE 架构惊艳亮相,展示了开源模型的创新潜力。

2025 年:DeepSeek R1 震撼,差距缩小至 3%

2025 年 1 月,DeepSeek R1 的发布是开源运动的里程碑事件。R1 在 AIME 2024 上拿到 79.8 分(超过 OpenAI o1 的 79.2),在 MATH-500 上拿到 97.3 分。更重要的是,R1 开源了从 1.5B 到 70B 的蒸馏模型,让小模型也能拥有强大的推理能力。Qwen 2.5 全系列开源,Llama 3.1 405B 发布——开源在推理能力上首次追平闭源。

2026 年:DeepSeek V4,差距仅 0.3%

2026 年 4 月,DeepSeek V4 发布,1.6T 参数(49B 激活),MIT 许可证,性能在多项 benchmark 上超越 GPT-4.1。Qwen 3.6 可媲美 Claude Sonnet。Llama 4 覆盖从 8B 到 405B 的全谱系。Introl 的评测显示,开源与闭源的综合性能差距已缩小至 0.3%。

2.2 差距缩小的三个驱动力

驱动力一:开源社区的集体智慧

开源模型不是由单一公司开发的——它们汇聚了全球开发者的智慧。Llama 系列有超过 10 万个衍生模型,Qwen 系列有超过 5 万个微调版本。社区的集体优化能力,远超任何单一公司的研发团队。

驱动力二:蒸馏技术的普及

正如我在大模型蒸馏详解中分析的,蒸馏技术让开源模型能够快速吸收闭源模型的能力。DeepSeek R1 的蒸馏模型就是最好的例子——1.5B 的蒸馏模型在推理任务上远超同尺寸直接 RL 训练的模型。

驱动力三:训练效率的突破

DeepSeek V3/V4 展示了极致的训练效率——用更少的 GPU、更短的时间、更低的成本训练出更强的模型。DeepSeek V4 的训练成本据估计不到 GPT-5.5 的十分之一。这种效率优势让开源团队也能训练出顶级模型。

2.3 但差距真的消失了吗?

需要客观看待"0.3% 差距"这个数字:

- 综合 benchmark 差距 0.3%,但在特定任务上差距仍然显著。GPT-5.5 在 MLE-Bench(Kaggle 竞赛 Agent)上仍然是最高分,Claude Opus 4.7 在深度推理(Adaptive Thinking)上仍然领先。

- 开源模型在"通用能力"上追平,但在"前沿能力"(如超长上下文推理、复杂 Agent 任务、多模态融合)上,闭源仍有优势。

- benchmark 不能代表一切。实际使用中,闭源模型在指令遵循、格式控制、安全性等方面仍然更稳定。

💰 三、成本对比:开源的绝对优势

3.1 API 价格对比

成本是开源模型最大的优势,没有之一。以下是 2026 年 4 月的 API 定价对比:

| 模型 | 输入 (per M Token) | 输出 (per M Token) | 相对 GPT-5.5 |

|---|---|---|---|

| Claude Opus 4.7 | $15 | $75 | 2.5x 贵 |

| GPT-5.5 | $5 | $30 | 基准 |

| Gemini 3.1 Pro | $1.25 | $10 | 4x 便宜 |

| GPT-4o | $2.5 | $10 | 3x 便宜 |

| DeepSeek V4 | $0.27 | $1.10 | 18x 便宜 |

| Qwen 3.6 | $0.14 | $0.42 | 36x 便宜 |

| Llama 4 (自部署) | ~$0 | ~$0 | 无限便宜 |

关键数据:DeepSeek V4 的价格只有 GPT-5.5 的 1/18,Qwen 3.6 只有 1/36。如果你每月调用 1 亿 Token,用 GPT-5.5 需要 $3500,用 DeepSeek V4 只需要 $194,用 Qwen 3.6 只需要 $56。

3.2 自部署的长期成本优势

API 调用只是冰山一角。对于大规模使用场景,自部署开源模型的长期成本更低:

假设每月处理 10 亿 Token(中等规模企业):

| 方案 | 月成本 | 年成本 | 3 年总成本 |

|---|---|---|---|

| GPT-5.5 API | $35,000 | $420,000 | $1,260,000 |

| Claude Opus 4.7 API | $90,000 | $1,080,000 | $3,240,000 |

| DeepSeek V4 API | $1,940 | $23,280 | $69,840 |

| 自部署 Llama 4 70B | ~$5,000 (GPU) | ~$60,000 | ~$180,000 |

| 自部署 Qwen 3.6 7B | ~$800 (GPU) | ~$9,600 | ~$28,800 |

自部署的边际成本趋近于零——硬件投入是一次性的,之后每增加一个请求的成本几乎为零。而 API 调用的成本是线性的,用量越大成本越高。

3.3 但开源也有隐性成本

开源的"免费"是相对的,需要考虑以下隐性成本:

- 硬件成本:部署 70B 模型需要至少 2 张 A100(~$30,000),405B 模型需要 8 张 A100(~$120,000)

- 运维成本:需要 GPU 运维工程师、模型更新、监控告警

- 机会成本:团队花在部署运维上的时间,本可以用来做业务开发

- 技术债务:模型版本升级、兼容性维护、安全补丁

经验法则:月调用量 < 1000 万 Token → 闭源 API 更划算;月调用量 > 1 亿 Token → 开源自部署更划算。

🔒 四、数据安全与合规:开源的杀手锏

4.1 数据不出内网

对于金融、政务、医疗、军工等行业,数据不能离开内网是硬性合规要求。闭源 API 需要将数据发送到第三方服务器,这在很多场景下是不可接受的。

开源模型可以完全本地部署,数据不需要离开企业内网:

- 金融行业:银保监会要求客户数据不得出境,使用 GPT/Claude API 存在合规风险

- 政务系统:政府数据涉及国家安全,必须使用自主可控的 AI 系统

- 医疗行业:患者数据受 HIPAA/个人信息保护法约束,不能上传第三方

- 军工国防:涉密信息绝对不能使用外部 API

4.2 完全可控的审计能力

开源模型的另一个安全优势是完全可审计:

- 可以检查模型的每一层权重,了解模型的行为模式

- 可以对输入输出进行完全的日志记录和审计

- 可以部署内容安全过滤器,确保输出符合企业政策

- 可以进行红队测试,发现和修复安全漏洞

闭源模型是"黑盒"——你不知道模型内部在做什么,无法审计其决策过程。虽然 Anthropic 和 OpenAI 都有安全团队,但你无法验证他们的安全措施是否足够。

4.3 不受供应商政策变化影响

使用闭源 API 意味着你的业务依赖于供应商的政策:

- OpenAI 可能修改 API 定价(GPT-5.5 比 GPT-5.4 贵 3 倍)

- Anthropic 可能修改使用政策(已经发生过多次)

- Google 可能停止某个模型的 API 服务

- 美国政府可能限制 API 对中国企业的访问

开源模型不受这些因素影响——一旦下载了权重,你就拥有永久的使用权。

🛠️ 五、定制化能力:开源碾压闭源

5.1 微调:让模型成为领域专家

开源模型最大的优势之一是可以针对特定领域微调:

- 法律领域:用法律文书微调 Qwen 3.6,使其成为法律问答专家

- 医疗领域:用医学文献微调 Llama 4,使其能准确回答医学问题

- 金融领域:用研报和财报微调 DeepSeek V4,使其成为金融分析师

- 代码领域:用企业内部代码库微调,使其理解公司代码规范

闭源模型只能通过 Prompt 和 System Message 进行有限的定制,无法真正改变模型的行为模式。OpenAI 的 Custom Instructions 和 Anthropic 的 System Prompt 都有字数限制和功能限制。

5.2 蒸馏:打造专属小模型

正如我在大模型蒸馏详解中详细分析的,蒸馏技术让你可以用大模型的能力训练一个小模型:

- 用 GPT-5.5 生成高质量训练数据

- 用这些数据微调一个 7B 的开源模型

- 得到一个性能接近 GPT-5.5 但可以本地部署的小模型

这种"闭源蒸馏到开源"的混合策略,正在成为越来越多企业的选择。

5.3 量化与剪枝:极致压缩

开源模型支持各种压缩技术,可以在几乎不损失性能的情况下大幅降低资源需求:

| 技术 | 压缩效果 | 性能损失 | 适用场景 |

|---|---|---|---|

| INT8 量化 | 2x | < 1% | 通用 |

| INT4 量化 | 4x | 1-3% | 边缘部署 |

| GPTQ | 4x | < 2% | GPU 推理 |

| AWQ | 4x | < 1% | GPU 推理 |

| 剪枝 | 2-10x | 3-10% | 特定硬件 |

一个 70B 模型经过 INT4 量化后,只需要约 35GB 显存,单张 A100 就能运行。经过蒸馏 + 量化后,7B 模型可以在手机上运行。

🌐 六、生态与社区:开源的飞轮效应

6.1 工具链生态

开源模型拥有一个闭源模型无法比拟的优势:繁荣的工具链生态。

微调工具:LLaMA-Factory(一键微调)、PEFT/LoRA(参数高效微调)、Axolotl(分布式微调)

部署工具:vLLM(高性能推理)、TGI(HuggingFace 推理)、Ollama(本地一键部署)、llama.cpp(CPU 推理)

量化工具:GPTQ、AWQ、bitsandbytes、AutoGPTQ

评估工具:OpenCompass、Ragas、LM Eval Harness

编排框架:LangChain、LlamaIndex、CrewAI、AutoGen

监控工具:LangFuse、Phoenix、OpenTelemetry

这些工具几乎全部是开源的、免费的、社区维护的。闭源模型只能使用官方提供的 SDK,灵活性远不如开源生态。

6.2 社区飞轮

开源社区形成了一个强大的飞轮效应:

- 模型开源 → 开发者使用 → 发现问题 → 提交修复

- 开发者微调 → 发布衍生模型 → 社区评估 → 最佳实践沉淀

- 工具开发者 → 针对开源模型优化 → 工具链成熟 → 吸引更多用户

- 企业使用 → 反馈需求 → 模型改进 → 更多企业使用

这个飞轮让开源模型的进化速度越来越快。Llama 系列有超过 10 万个衍生模型,Qwen 系列有超过 5 万个微调版本——这些数字还在指数增长。

6.3 Hugging Face 和魔搭

Hugging Face(国际)和魔搭 ModelScope(国内)是开源模型的两大分发平台:

- Hugging Face 托管了超过 50 万个模型,月下载量超过 10 亿次

- 魔搭 ModelScope 托管了超过 10 万个模型,是国内最大的 AI 模型社区

- 两个平台都提供一键部署、在线体验、API 服务

⚖️ 七、闭源的护城河:还剩什么?

7.1 性能:最后的 0.3%

闭源模型在性能上仍有微弱优势,主要体现在:

- 前沿任务:GPT-5.5 在 MLE-Bench 上仍是最高分,Claude Opus 4.7 在深度推理上领先

- 多模态:Gemini 3.1 Pro 在视频、音频理解上仍然最强

- Agent 能力:GPT-5.5 的原生 Agent 架构、Claude 的 Computer Use 仍然领先开源

- 指令遵循:闭源模型在复杂指令的精确遵循上仍然更稳定

但这 0.3% 的差距,对绝大多数企业应用来说几乎无感知。

7.2 易用性:API 即用的便利

闭源模型最大的优势是开箱即用:

- 不需要 GPU、不需要运维、不需要部署

- 注册账号、获取 API Key、调用接口——3 分钟开始使用

- 官方提供 SLA 保障、技术支持、版本更新

- 适合快速验证、原型开发、小规模使用

对于没有 GPU 运维团队的中小企业,闭源 API 仍然是更务实的选择。

7.3 安全保障:专业团队

闭源模型由专业安全团队维护:

- OpenAI 有 Preparedness Framework,进行生物/化学/核风险评估

- Anthropic 有 Constitutional AI,确保模型输出符合人类价值观

- Google 有 Responsible AI 团队,进行全面的红队测试

开源模型的安全依赖社区——虽然社区也在做安全工作,但规模和专业性不如闭源团队。

7.4 持续更新:永远最新

闭源模型由官方持续更新:

- OpenAI 每 3-6 个月发布新版本

- Anthropic 持续优化 Claude 系列

- Google 快速迭代 Gemini 系列

开源模型的更新依赖发布方——Meta、DeepSeek、阿里的更新频率虽然也在加快,但通常不如闭源频繁。

🏛️ 八、监管风暴:白宫"反蒸馏"与全球 AI 治理

8.1 白宫"反蒸馏"政策

2026 年初,白宫发布了"反蒸馏"政策备忘录,核心内容是:

- 指责中国 AI 公司使用蒸馏技术"窃取"美国 AI 的知识产权

- 要求美国 AI 公司采取措施防止模型被蒸馏

- 可能限制开源模型的发布范围

这一政策在 AI 行业引发了巨大争议:

- 支持方认为:蒸馏确实可以让竞争对手快速复制模型能力,保护知识产权是合理的

- 反对方认为:蒸馏是公开的学术技术,限制蒸馏等于限制科学进步;开源模型(如 Llama)本身就是美国公司发布的,限制蒸馏会伤害美国自身的生态

8.2 开源面临合规挑战

全球 AI 监管趋严,开源模型面临越来越大的合规压力:

- 欧盟 AI Act:对高风险 AI 系统有严格要求,开源模型可能被归类为高风险

- 美国出口管制:可能限制先进 AI 模型的开源发布

- 中国数据安全法:要求 AI 模型通过安全评估才能上线

这些监管压力可能导致:

- 开源许可证收紧(从 MIT/Apache 变为更严格的许可证)

- "有条件开源"增多(仅限研究用途、需要申请等)

- 大型开源模型的发布频率降低

8.3 "反蒸馏"的荒谬性

从技术角度看,"反蒸馏"政策存在明显的矛盾:

- 蒸馏是双向的:开源模型也可以蒸馏闭源模型。DeepSeek R1 的蒸馏模型就是用 R1(开源)蒸馏 Qwen/Llama(开源)得到的。如果禁止蒸馏,OpenAI 的模型同样可以被蒸馏。

- Llama 是美国开源的:Meta 主动开源 Llama 系列,如果限制蒸馏,等于限制了 Llama 的生态发展。

- 蒸馏是学术共识:Hinton 2015 年的蒸馏论文被引用超过 1 万次,是 AI 领域最基础的技术之一。限制蒸馏等于限制基础研究。

🎯 九、企业选型决策框架

9.1 选开源的场景

数据安全是硬需求:金融、政务、医疗、军工等行业,数据不能出内网 → 必须开源

需要深度定制:领域微调、专属模型、私有化部署 → 开源碾压

大规模调用:月调用量 > 1 亿 Token,成本敏感 → 开源更便宜

需要完全可控:不受供应商政策变化影响,长期运营 → 开源更稳

混合部署:多模型路由、边缘部署、离线场景 → 开源更灵活

9.2 选闭源的场景

需要最强性能:前沿任务、复杂 Agent、多模态 → 闭源领先

快速验证:MVP、原型、概念验证 → 闭源更快

无运维团队:不想管 GPU、不想做运维 → 闭源更省心

需要 SLA:生产关键路径,需要 99.9% 可用性保障 → 闭源更可靠

预算充足:不差钱,追求最好 → 闭源最强

9.3 混合方案(推荐)

对于大多数企业,混合方案是最优解:

| 业务类型 | 推荐方案 | 原因 |

|---|---|---|

| 核心业务(高价值) | 闭源 API | 最强性能,值得花钱 |

| 通用业务(大规模) | 开源自部署 | 成本低,性能足够 |

| 敏感数据 | 开源本地 | 数据不出内网 |

| 快速迭代 | 闭源 API | 开箱即用,快速验证 |

| 离线场景 | 开源边缘 | 无网络依赖 |

| 智能路由 | 混合 | 按需分配,最优性价比 |

智能路由是混合方案的关键——根据请求类型、数据敏感度、性能需求,自动选择最合适的模型。简单问题用开源(便宜),复杂问题用闭源(最强),敏感数据用本地开源(安全)。

🔮 十、未来趋势:2026-2028 预判

趋势一:性能全面趋同(2027)

开源将在 2027 年全面追平闭源。差距从 0.3% 趋向 0%,闭源的"性能护城河"将完全消失。竞争将从"谁的模型更强"转向"谁的服务更好"。

趋势二:混合成为默认方案(2026-2027)

纯开源或纯闭源的企业将越来越少。混合架构(多模型路由 + 智能分配)将成为默认方案。企业不再问"用开源还是闭源",而是问"哪个任务用哪个模型"。

趋势三:监管加剧(2026-2028)

全球 AI 监管将持续收紧。开源面临合规挑战,许可证可能收紧,"有条件开源"增多。但开源社区的力量也在增长,监管与反监管的博弈将持续。

趋势四:开源生态爆发(2026-2027)

工具链越来越成熟,一键部署成为标准,微调成本持续下降。开源 Agent 框架(如 CrewAI、AutoGen)将让开源模型也能构建复杂的 Agent 系统。

趋势五:闭源转向服务(2027-2028)

闭源不再只卖 API,转向企业级解决方案:定制化 + 咨询 + SLA + 安全审计。"模型即服务"深化,价值从模型本身转向服务层。

趋势六:终局猜想——Linux vs Red Hat 模式

开源模型成为基础设施(像 Linux),闭源成为增值服务(像 Red Hat)。模型本身商品化,价值在应用层。这不是"谁赢谁输"的零和博弈,而是分工协作的共生关系。

🎁 总结速查卡

核心数据

| 维度 | 开源 | 闭源 | 胜者 |

|---|---|---|---|

| 性能 | 93-97 分 | 95-100 分 | 闭源(0.3%) |

| 成本 | $0.14-1.10/M | $5-75/M | 开源(10-100x) |

| 数据安全 | 本地部署 | 数据上传 | 开源 |

| 定制化 | 微调/蒸馏/剪枝 | Prompt/System | 开源 |

| 易用性 | 需部署运维 | API 即用 | 闭源 |

| 生态 | 社区驱动 | 官方维护 | 平手 |

| 稳定性 | 自行维护 | SLA 保障 | 闭源 |

| 透明度 | 白盒可审计 | 黑盒 | 开源 |

企业选型一句话

数据敏感 → 开源 | 预算充足 → 闭源 | 大规模 → 开源 | 快速验证 → 闭源 | 最优解 → 混合

六大趋势

性能趋同 | 混合主流 | 监管加剧 | 生态爆发 | 闭源转服务 | 终局: Linux vs Red Hat

关键判断

2026 年,开源与闭源的性能差距已缩小至 0.3%,成本差距 10-100 倍。对于绝大多数企业,混合方案是最优解——核心业务用闭源,通用业务用开源,敏感数据用本地。这场战争的终局不是"谁消灭谁",而是"分工协作"。

系列文章:

- 深入浅出上下文工程:比 Prompt Engineering 更重要的下一代 AI 工程范式

- 大模型蒸馏详解

- GPT-5.5 参数与推理深度解析

- 10 道 RAG 高频面试题

- Claude Code 到底强在哪?

参考链接:

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)