2026 实战指南:在 C++ 应用中深度集成 AI 的架构艺术

2026 实战指南:在 C++ 应用中深度集成 AI 的架构艺术

在 2026 年,将 AI 集成到 C++ 应用程序中已不再是简单的 API 调用,而是一场关于协议抽象、资源管控与工程化思维的综合考验。对于追求极致性能和稳定性的开发者(特别是 Qt 阵营)来说,如何优雅地将大模型(LLM)“串”进业务流,决定了产品的工业级水准。

一、 AI 接口全景图:主流生态与 EAIInterfaceType 选型

在构建集成层之前,我们需要识别当前市场上的几大“门派”。通过定义 EAIInterfaceType 枚举,我们可以实现一套代码适配多种生态:

- OpenAI 兼容阵营:包括 GPT-5、DeepSeek、Groq 以及私有部署模型。共享

/v1/chat/completions标准。 - Anthropic (Claude) 阵营:采用 Messages API,在处理复杂代码编写和 XML 结构化输出时表现卓越。

- Google Gemini 阵营:原生多模态的王者,适合直接处理音视频流或 2M+ 极长上下文的场景。

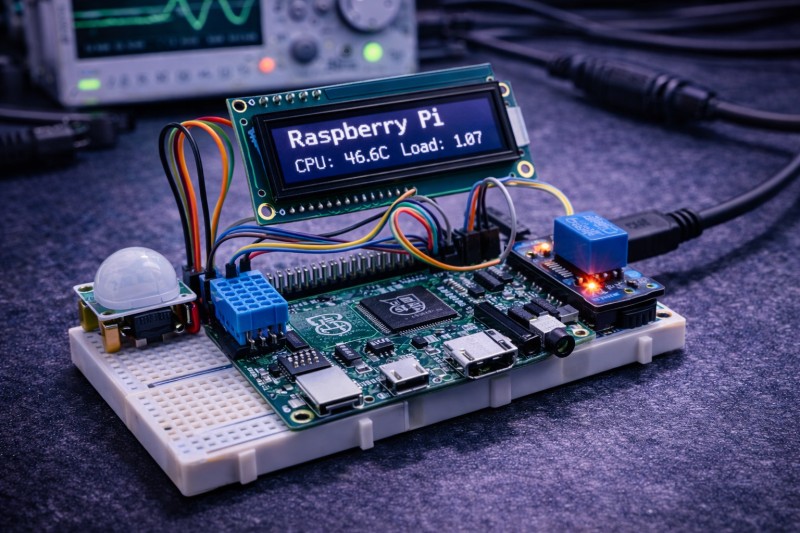

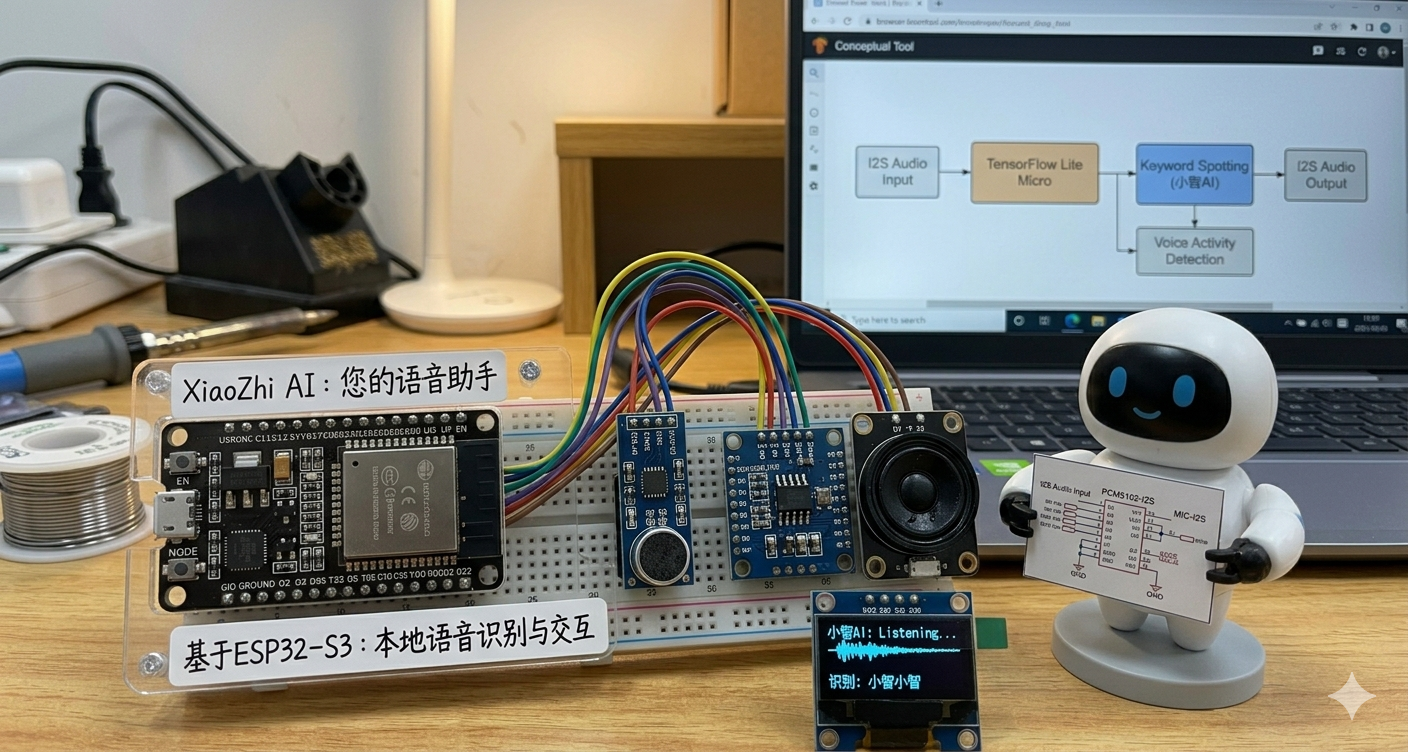

- Ollama (本地化) 阵营:隐私与成本的避风港。在 RTX 50 系列普及的今天,本地推理已成为核心业务的保底方案。

二、 MCP (Model Context Protocol):AI 的“万能适配器”

2026 年集成领域最具颠覆性的技术莫过于 MCP。它解决了 N 个模型与 M 个应用工具之间的集成难题。

2.1 从“写死插件”到“即插即用”

以往我们要让 AI 读一个数据库,需要为不同模型写不同的 Tool Call 逻辑。而在 MCP 框架下:

- 宿主 (Host):您的 C++/Qt 应用作为 Host。

- MCP Server:将应用内部功能(如 SQL 查询、文件操作、硬件状态监控)封装为标准的 MCP Server。

- 连接器:利用 JSON-RPC 2.0 协议,AI 能够通过标准化的协议直接发现并调用这些工具,而无需您手动编写粘合代码。

三、 Token 窗口管理:在性能与成本的刀尖上起舞

Token 是 2026 年 AI 时代的“数字燃料”。忽视 Token 管理会导致两个后果:天价账单或模型失忆。

3.1 本地计数与预警

不要等待服务器返回 usage。为了实现秒级的用户反馈,您必须在 C++ 客户端集成高性能的 Tiktoken 库。

- 实时估算:在用户输入的同时计算 Token,如果超过预设阈值(如限制的 80%),立即在 UI 上预警。

- 微秒级分词:利用 C++20 的高性能字符串处理能力,在本地完成 BPE 分词计数。

3.2 滑动窗口 (Sliding Window) 策略

当对话进入深度长考时,必须实施“滑动窗口”策略:

- 核心锚点:永久保留

System Prompt。 - 语义蒸馏:将中间不再重要的历史对话通过轻量级模型(如本地 Ollama)总结为“语义摘要”,从而节省 50% 以上的上下文空间。

四、 提示词 (Prompt) 去硬编码化:逻辑与配置的分离

把 Prompt 直接写在 .cpp 的字符串里是维护的噩梦。

4.1 模板化管理

将 Prompt 存储在外部的 YAML 或加密的 JSON 配置文件中。这样,即使不重新编译程序,也可以通过更新云端配置来快速优化 AI 的回答效果。

4.2 动态变量注入

在运行时动态注入业务变量,例如:

// 推荐做法:动态注入上下文

auto promptTemplate = PromptRegistry::load("diagnostics_tool");

QString finalPrompt = promptTemplate.inject({

{"device_logs", currentLogs},

{"error_code", lastError}

});

五、 开发此类应用的核心注意事项 (C++/Qt 实务)

将 AI 集成到工业级应用中,细节决定成败:

1. 异步 SSE 流式处理

AI 响应通常是 Server-Sent Events (SSE)。在 Qt 中,严禁使用同步请求。

- 必须连接

QNetworkReply::readyRead()信号。 - 由于网络切片,收到的 JSON 片段可能是截断的。必须建立一个 Buffer,确保解析到完整的

data: {...}\n\n结构后再进行 JSON 反序列化。

2. 安全性与密钥管理

- 严禁明文存储 API Key:在桌面端应结合系统级安全存储(如 Windows Credential Manager 或 macOS Keychain)。

- 数据脱敏:在发送到云端前,利用正则表达式或本地模型对用户输入的敏感信息(如内部 IP、个人密码)进行过滤。

3. 频率限制 (Rate Limiting) 与重试

- 令牌桶算法:在客户端实现请求频率控制,防止因用户点击过快导致被厂商封禁。

- 指数退避 (Exponential Backoff):面对 429 错误(请求过多)或 503 错误,应实现带有随机抖动的自动重试机制。

4. UI 响应与交互体验

- 打字机效果:这是缓解用户等待焦虑的核心方案。

- 非阻塞架构:确保 AI 的所有计算、解析、计数逻辑都在工作线程中完成,保持 UI 线程 60FPS。

5. 多级回退机制 (Fallback)

- 构建“混合动力”架构:首选高性能云端模型,当检测到断网或高延迟时,自动 fallback 到本地运行的 Ollama 模型(如 Llama-3-8B),确保应用的基础功能始终可用。

结语

在 2026 年,卓越的 AI 应用不看你接入了哪个模型,而看你如何经营上下文。通过 MCP 实现工具打通,通过 Token 计数实现成本可控,通过提示词分离实现业务灵活,再辅以稳健的 C++/Qt 异步架构,这才是通往未来 AI 应用的必经之路。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)