DeepSeek-TUI:基于 DeepSeek V4 的终端编程

DeepSeek-TUI 是一个终端原生的编程 Agent,基于 DeepSeek V4 模型构建。本文从技术角度分析其架构特点、能力边界和适用场景。

DeepSeek-TUI 是一个终端原生的编程 Agent,基于 DeepSeek V4 模型构建。本文从技术角度分析其架构特点、能力边界和适用场景。

01. 项目背景与要解决的问题

当前终端 AI Agent 工具普遍存在两个问题:运行时依赖复杂、上下文窗口受限。

运行时依赖方面,主流方案如 Claude Code 依赖 Node.js 运行时,需要配置 npm 环境并安装多个依赖包。对于追求轻量部署的场景,这增加了环境准备成本。

上下文窗口方面,多数模型的上下文长度在 128K-256K token 级别,处理大型代码库或长对话历史时容易出现信息截断。

DeepSeek-TUI 针对这两个问题提供了对应的解决方案:将运行时打包为单一二进制文件,以及基于 DeepSeek V4 模型提供 1M token 的上下文窗口。

02. 关键能力与实现方式

单二进制架构

项目采用 Rust 语言开发,编译为单一二进制文件。安装通过 npm 分发,但运行时无需 Node.js 环境:

npm i -g deepseek-tui

二进制文件内置了 MCP 客户端、沙箱环境和持久化任务队列,减少了外部依赖。

1M Token 上下文处理

基于 DeepSeek V4 模型(v4-pro 和 v4-flash 两个版本),提供 1M token 的上下文窗口。实现层面包含两个机制:

前缀缓存:对重复的上下文前缀进行缓存,减少重复计算和 API 费用。

智能压缩:对长对话历史进行自动总结,保留最近对话的原始内容,将压缩后的摘要作为上下文前缀。

三种交互模式

项目提供三种操作模式,对应不同的风险控制需求:

Plan 模式:只读分析,不执行任何写操作。

Agent 模式:交互式执行,每个操作需用户确认。

YOLO 模式:自动执行,无需确认。

MCP 协议支持

内置 MCP (Model Context Protocol) 客户端,支持扩展工具链。当前已实现的工具包括:文件读写、Shell 执行、Git 操作、Web 搜索、apply-patch、子 Agent 调用。

成本追踪

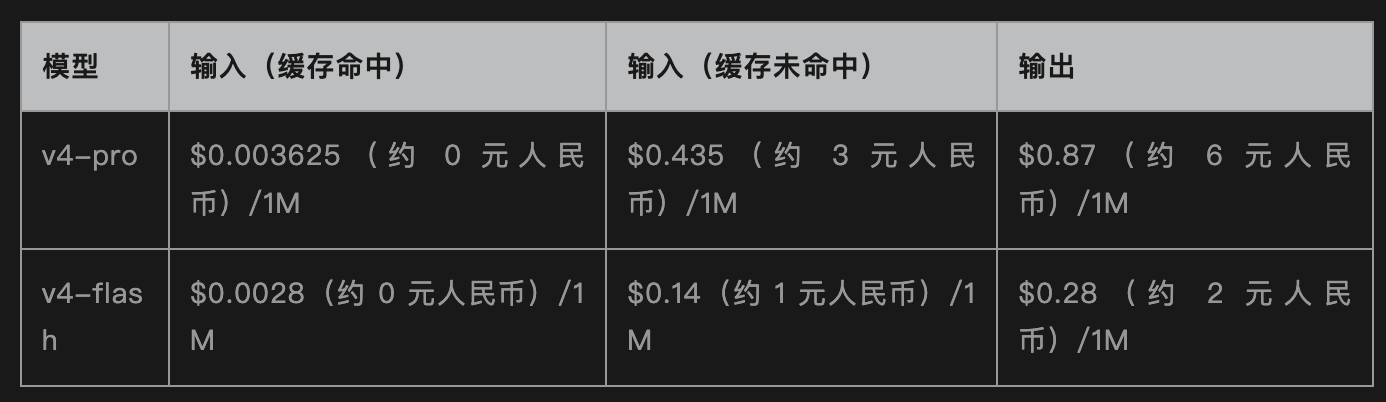

界面实时显示 API 调用成本。DeepSeek V4 的定价如下:

03. 使用边界与适用场景

适用场景

-

终端工作流为主的开发者,需要在命令行环境中使用 AI 辅助

-

对运行时依赖敏感的场景,希望减少环境配置

-

处理大型代码库,需要较长上下文窗口

-

需要通过 HTTP API 集成到自动化工作流

不适用场景

-

需要 IDE 深度集成的场景,当前仅支持终端交互

-

对模型有多样化需求的场景,当前仅支持 DeepSeek V4 系列模型

-

需要丰富插件生态的场景,MCP 工具链相对有限

使用注意事项

-

API Key 需要通过

deepseek login --api-key命令配置,或设置环境变量 -

YOLO 模式下 AI 自动执行操作,建议在受控环境中使用

-

长上下文会话会消耗较多 token,需关注成本

-

项目基于 Rust 开发,如需自行编译需配置 Rust 工具链

04. 中立结论与风险提示

DeepSeek-TUI 在架构设计上追求轻量化和长上下文,适合终端工作流为主、对环境依赖敏感的开发者。

与 Claude Code 相比,优势在于单二进制部署和 1M token 上下文;局限在于模型选择单一(仅 DeepSeek V4)、工具生态相对有限、无 IDE 集成。

风险提示: - API 调用会产生费用,建议通过 deepseek doctor 检查配置后再使用 - YOLO 模式下 AI 自动执行操作,可能产生非预期的文件修改 - 项目处于活跃开发阶段,API 和功能可能发生变化

技术栈:Rust + DeepSeek V4 API,MIT 协议开源。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)