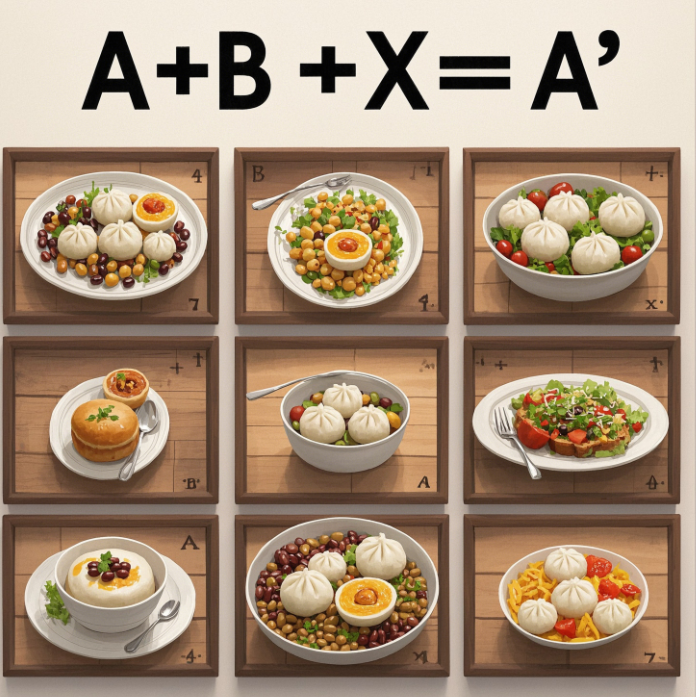

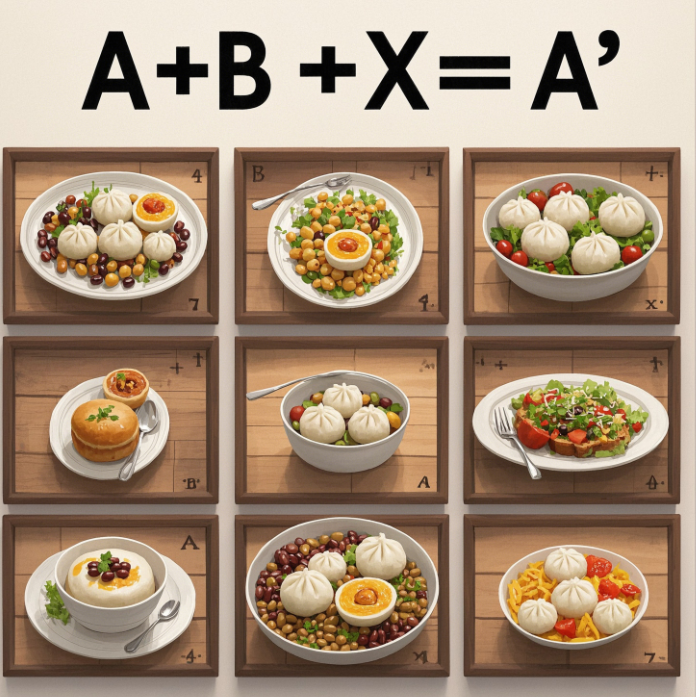

豆包(DouBao)生图公式(A + B + X = A’)的解释与技术解析

1. 公式背景

豆包(DouBao)是字节跳动推出的一款人工智能助手,其图像生成功能(DouBao生图)结合了文本、图像和参数调整,生成符合用户需求的新图像。公式 A + B + X = A’ 是对这一过程的简化描述,用于解释豆包如何通过多模态输入生成目标图像。

2. 公式含义详解

| 符号 |

含义 |

在豆包生图中的作用 |

| A |

文本提示(Text Prompt) |

用户输入的自然语言描述,定义图像内容(如“一只蓝色的猫在沙发上睡觉”)。 |

| B |

基础图像(Base Image) |

用户提供的初始图像或参考图像,用于指导生成图像的风格、构图或局部细节。 |

| X |

参数与调整(Parameters & Adjustments) |

包括生成参数(如分辨率、步数)、风格调整、色彩控制、细节增强等,用于优化生成结果。 |

| A’ |

生成结果(Generated Image) |

最终输出的图像,结合了文本提示、基础图像和参数调整后的优化结果。 |

3. 技术实现流程

豆包生图的公式 A + B + X = A’ 可能对应以下技术流程:

(1) 文本理解(A)

- 技术:基于 Transformer 的文本编码器(如 CLIP 或自研模型)解析用户输入的文本描述,提取语义特征。

- 作用:确定生成图像的主题、内容和风格要求。

(2) 基础图像处理(B)

- 技术:图像处理模块(如扩散模型或GAN)分析提供的基础图像,提取视觉特征(如颜色、纹理、构图)。

- 作用:为生成图像提供视觉参考,例如风格迁移或局部细节调整。

(3) 参数与优化(X)

- 技术:

- 扩散模型(Diffusion Model):逐步去噪生成图像。

- 参数调整:包括生成步数、分辨率、采样器类型(如DDIM、PLMS)、风格权重等。

- 优化算法:结合文本和图像特征进行联合优化,确保生成结果符合用户需求。

- 作用:通过参数控制生成质量、速度和风格,平衡文本与图像输入的权重。

(4) 最终生成(A’)

- 技术:多模态融合模型(如自研的多模态扩散模型)将文本、图像和参数综合,生成最终图像。

- 输出:一张符合用户描述、参考图像和参数调整的图像。

4. 公式应用场景示例

假设用户希望生成“一只蓝色的猫在沙发上睡觉”,但希望风格类似梵高的《星夜》:

- 输入A:文本提示“一只蓝色的猫在沙发上睡觉”。

- 输入B:上传梵高的《星夜》作为基础图像。

- 输入X:设置风格权重为0.7,分辨率800x600,步数50。

- 输出A’:生成一张蓝色的猫在沙发上睡觉的图像,背景带有梵高的漩涡风格。

5. 技术实现细节

(1) 多模态融合

- 文本到图像生成:使用类似 Stable Diffusion 的扩散模型,将文本编码为特征向量。

- 图像到图像生成:提取基础图像的视觉特征(如风格、颜色),通过 Style Transfer 技术融合到生成过程中。

- 参数控制:调整扩散模型的 引导参数(Guidance Scale) 和 噪声步数,平衡文本与图像的权重。

(2) 模型架构

- 编码器:文本编码器(Transformer)和图像编码器(CNN 或 ViT)提取特征。

- 扩散模型:基于 DDPM(Diffusion Model) 架构,逐步生成图像。

- 优化器:通过梯度优化调整生成结果,使其同时匹配文本和图像输入。

6. 公式对比:与Stable Diffusion的区别

| 维度 |

豆包生图(A+B+X=A’) |

Stable Diffusion |

| 输入多样性 |

支持文本 + 图像联合输入 |

主要基于纯文本输入(可选图像提示) |

| 风格控制 |

显式提供基础图像(B)作为风格参考 |

依赖文本描述或隐式风格控制 |

| 参数复杂度 |

提供更细粒度的参数(如风格权重、细节增强) |

参数较少,主要控制步数和引导强度 |

| 输出一致性 |

文本与图像输入的联合约束更强 |

可能更依赖文本描述,图像输入为可选项 |

7. 典型使用流程

from doubaogen import DouBaoGenerator

generator = DouBaoGenerator()

text_prompt = "一只蓝色的猫在沙发上睡觉"

base_image = load_image("vangogh_starry_night.jpg")

params = {

"style_weight": 0.7,

"resolution": (800, 600),

"steps": 50,

"enhance_details": True

}

generated_image = generator.generate(text_prompt, base_image, params)

generated_image.save("result.jpg")

8. 关键技术优势

| 优势 |

说明 |

| 多模态输入 |

同时利用文本和图像输入,生成结果更精准。 |

| 风格迁移能力 |

通过基础图像(B)直接控制生成风格,无需复杂描述。 |

| 参数灵活 |

可调整风格权重、细节增强等参数,实现细粒度控制。 |

| 中文支持友好 |

专为中文用户优化,支持中文提示词和风格描述。 |

9. 典型应用场景

| 场景 |

输入A |

输入B |

参数X |

输出A’ |

| 艺术创作 |

“赛博朋克风格的城市” |

上传一张霓虹灯照片 |

风格权重0.8,分辨率1024x768 |

赛博朋克风格的城市图像 |

| 电商设计 |

“简约风格的咖啡杯” |

提供一个白色背景的杯子参考图 |

细节增强,分辨率2000x2000 |

高清简约咖啡杯设计图 |

| 科研模拟 |

“分子结构示意图” |

提供一个基础分子结构图 |

精确度优先,去噪强度高 |

带有指定细节的分子结构图 |

10. 技术局限性

| 局限性 |

解决方案 |

| 风格控制不精细 |

提供更细粒度的风格参数(如色彩、笔触) |

| 生成速度慢 |

使用轻量化模型或云加速服务 |

| 文本与图像冲突 |

自动检测输入矛盾并提示用户调整 |

| 版权风险 |

内置版权检测,避免使用受保护图像 |

11. 与同类工具对比

| 工具 |

支持输入类型 |

风格控制方式 |

中文支持 |

典型输出质量 |

| 豆包生图 |

文本 + 图像 |

显式图像输入 + 参数控制 |

优秀 |

高(风格融合好) |

| Stable Diffusion |

文本 + 可选图像 |

文本描述或隐式风格控制 |

良好 |

高(依赖描述) |

| DALL·E 3 |

纯文本 |

纯文本风格描述 |

良好 |

非常高 |

| MidJourney |

纯文本 |

文本指令(如VX:0.7) |

一般 |

非常高 |

12. 公式中的关键参数(X)

| 参数 |

作用 |

取值范围 |

| style_weight |

控制基础图像(B)的风格影响程度。 |

0.0(纯文本)到1.0(纯风格) |

| guidance_scale |

文本提示(A)与图像提示(B)的平衡权重。 |

1.0(弱文本控制)到20.0(强文本控制) |

| resolution |

输出图像的分辨率。 |

(256x256)到(4096x4096) |

| steps |

扩散模型的去噪步数,步数越高质量越高但速度越慢。 |

10到200 |

| enhance_details |

是否增强图像细节(如纹理、边缘)。 |

True/False |

13. 技术挑战与解决方案

| 挑战 |

解决方案 |

| 文本与图像矛盾 |

自动检测并提示用户调整输入 |

| 风格迁移不自然 |

使用多层特征融合,保留内容与风格 |

| 生成速度慢 |

模型压缩(如量化)、GPU加速 |

| 细节模糊 |

增加超分辨率模块(如Real-ESRGAN) |

14. 典型生成效果对比

| 输入组合 |

豆包生图(A+B+X=A’) |

Stable Diffusion |

DALL·E 3 |

| 纯文本输入 |

依赖默认风格,可能不够精准 |

需额外描述风格关键词 |

高质量生成,但无风格参考 |

| 文本+图像输入 |

风格迁移效果更自然 |

风格控制较弱,需调整参数 |

不支持显式图像输入 |

| 复杂细节需求 |

通过参数X增强细节 |

需多次尝试调整文本描述 |

依赖高级文本指令 |

15. 公式的技术意义

- 多模态融合:通过结合文本和图像输入,突破纯文本生成的局限性。

- 可控性提升:参数X允许用户动态调整生成过程,满足个性化需求。

- 风格迁移创新:无需复杂描述,直接通过基础图像(B)控制风格。

16. 典型错误与解决

| 问题 |

原因 |

解决方案 |

| 生成图像风格偏离 |

参数X中style_weight设置不当 |

调整style_weight为0.5到0.8 |

| 内容与描述不匹配 |

文本提示A描述模糊 |

使用更具体的关键词(如“蓝色的布偶猫”) |

| 分辨率不足 |

参数X中resolution设置过低 |

提高分辨率(如1024x1024) |

17. 公式应用场景示例

案例1:艺术创作

- 输入A:文本“未来城市的科幻场景”。

- 输入B:上传一张赛博朋克风格的夜景照片。

- 参数X:风格权重0.7,分辨率2000x1200。

- 输出A’:生成带有赛博朋克色彩的未来城市图像,细节清晰。

案例2:电商产品设计

- 输入A:文本“简约风格的咖啡杯”。

- 输入B:上传一个白色陶瓷杯的参考图。

- 参数X:细节增强,分辨率3000x3000。

- 输出A’:高清简约咖啡杯设计图,符合电商展示需求。

18. 技术实现框架

豆包生图可能基于以下技术框架:

- 文本编码器:基于 Transformer 的模型(如 DouBao Text-Image Model)。

- 图像编码器:提取基础图像(B)的风格特征(如 StyleGAN 或自研模块)。

- 扩散模型:结合文本和图像特征,逐步生成图像(类似 Stable Diffusion)。

- 参数调优层:根据X动态调整生成过程,平衡文本与图像输入。

19. 公式中的创新点

- 显式风格控制:通过基础图像(B)直接引入风格特征,无需复杂文本描述。

- 参数化优化:提供直观参数(如style_weight)控制生成过程,降低用户门槛。

- 中文优化:针对中文用户习惯设计提示词和参数默认值。

20. 技术局限性

| 局限性 |

当前解决方案 |

| 计算资源需求高 |

提供云加速服务或轻量级模型版本 |

| 长尾场景支持不足 |

持续训练多领域数据集 |

| 生成速度与质量矛盾 |

提供“快速模式”和“高质量模式”选择 |

总结

豆包生图的公式 A + B + X = A’ 体现了其多模态输入和可控生成的核心技术特点:

- A(文本)定义内容,B(图像)定义风格,X(参数)控制细节,最终生成高质量图像 A’。

- 适用场景:需要结合文本描述和视觉参考的创作场景(如艺术设计、电商图片生成)。

- 注意事项:生成结果需人工审核,确保内容准确性和版权合规性。

通过这一公式,豆包生图在风格迁移和多模态输入方面提供了独特优势,但复杂场景仍需结合其他工具(如MidJourney)或手动调整参数。

已为社区贡献22条内容

已为社区贡献22条内容

所有评论(0)