手把手教学:通义千问2.5-7B镜像部署,附演示账号

本文介绍了如何在星图GPU平台上自动化部署通义千问2.5-7B-Instruct镜像,实现高效的大语言模型应用。该镜像支持代码生成、文本理解和多语言处理等任务,特别适用于企业知识库问答和内容创作场景,用户可通过简单配置快速搭建AI服务环境。

·

手把手教学:通义千问2.5-7B镜像部署,附演示账号

1. 引言

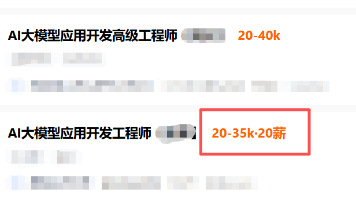

1.1 为什么选择通义千问2.5-7B

通义千问2.5-7B-Instruct是阿里云2024年9月发布的中等规模开源大模型,具有以下突出优势:

- 全能型选手:在代码生成、数学推理、长文本理解等任务上表现优异

- 商用友好:采用宽松的开源协议,可直接用于商业项目

- 资源高效:70亿参数规模,RTX 3060显卡即可流畅运行

- 中文优化:针对中文场景深度优化,理解表达更自然

1.2 本教程能帮你实现什么

通过本文,你将学会:

- 使用vLLM+Open-WebUI一键部署通义千问2.5-7B

- 通过Web界面与模型交互

- 利用演示账号快速体验模型能力

- 了解模型的核心技术特点

全程无需编写代码,适合所有技术水平的开发者。

2. 部署准备

2.1 硬件要求

建议配置:

- GPU:NVIDIA RTX 3060及以上(显存≥12GB)

- 内存:32GB及以上

- 存储:至少50GB可用空间(模型文件约28GB)

最低配置:

- 可使用CPU模式运行,但推理速度较慢

- 内存≥16GB,支持量化版本(GGUF/Q4_K_M仅需4GB)

2.2 软件环境

确保已安装:

- Docker(版本20.10+)

- NVIDIA驱动(如使用GPU)

- 网络连接畅通(需下载约28GB模型文件)

3. 镜像部署步骤

3.1 获取镜像

镜像已预置以下组件:

- vLLM:高性能推理引擎

- Open-WebUI:用户友好的Web界面

- 通义千问2.5-7B-Instruct:FP16精度的完整模型

启动命令:

docker run -d --gpus all -p 7860:7860 -v /path/to/models:/models registry.cn-hangzhou.aliyuncs.com/qwen/qwen2.5-7b-instruct:latest

参数说明:

--gpus all:启用所有可用GPU-p 7860:7860:将容器7860端口映射到主机-v /path/to/models:/models:模型存储路径(可选)

3.2 启动过程

部署后会发生:

- 自动下载模型文件(首次运行)

- 初始化vLLM推理引擎

- 启动Open-WebUI服务

典型启动时间:

- 下载模型:视网速而定(约28GB)

- 加载模型:5-10分钟(取决于硬件)

- WebUI启动:1-2分钟

可通过日志查看进度:

docker logs -f <容器ID>

4. 使用指南

4.1 访问Web界面

服务启动后,通过浏览器访问:

http://<服务器IP>:7860

4.2 演示账号登录

为方便体验,提供测试账号:

账号:kakajiang@kakajiang.com

密码:kakajiang

登录后即可开始与模型交互。

4.3 基础功能演示

4.3.1 文本生成

输入:

请用200字介绍量子计算的基本原理

模型将生成结构清晰、专业准确的科普内容。

4.3.2 代码辅助

输入:

用Python实现快速排序算法,并添加详细注释

输出将包含可运行的代码和解释性注释。

4.3.3 长文本理解

支持上传txt/pdf文档(≤128K tokens),模型能:

- 总结核心内容

- 回答细节问题

- 提取关键信息

5. 高级功能探索

5.1 工具调用(Function Calling)

模型支持结构化输出,便于构建AI Agent。示例:

用户输入:

查询北京今天的天气

模型可能返回:

{

"function": "get_weather",

"parameters": {

"city": "北京"

}

}

5.2 JSON格式强制输出

通过提示词控制输出格式:

以JSON格式返回:书名、作者、出版年份

《三体》的基本信息

输出示例:

{

"书名": "三体",

"作者": "刘慈欣",

"出版年份": 2008

}

5.3 多语言支持

尝试用不同语言提问:

Quels sont les avantages de l'apprentissage automatique? (法语)

机器学习有哪些优势?

模型能流畅处理30+种语言。

6. 性能优化建议

6.1 提升推理速度

| 方法 | 效果 | 实施步骤 |

|---|---|---|

| 启用vLLM | 吞吐量提升3-5倍 | 已预置在镜像中 |

| 使用量化模型 | 显存占用降低75% | 下载GGUF/Q4_K_M版本 |

| 批量处理 | 提高GPU利用率 | 通过API发送多个请求 |

6.2 长文本处理技巧

- 分块处理:超长文档可分块输入

- 关键信息提取:先获取摘要再深入询问

- 启用StreamingLLM:优化内存管理(需额外配置)

7. 常见问题解答

7.1 模型加载失败

现象:CUDA out of memory

解决:

- 尝试量化版本

- 减少

max_seq_len参数 - 使用CPU模式(添加

--device cpu参数)

7.2 WebUI无法访问

检查:

- 容器是否正常运行:

docker ps - 端口是否冲突:修改

-p参数映射其他端口 - 防火墙设置:确保7860端口开放

7.3 响应速度慢

优化建议:

- 确认GPU是否正常工作:

nvidia-smi - 降低生成长度:设置

max_tokens=512 - 升级硬件配置

8. 总结

8.1 核心价值回顾

通过本教程,你已经:

- 成功部署通义千问2.5-7B-Instruct镜像

- 掌握Web界面的基本使用方法

- 体验了模型的多样化能力

- 了解性能优化方向

8.2 应用场景建议

该模型特别适合:

- 企业知识库问答

- 代码辅助开发

- 多语言内容生成

- 教育辅导场景

- 数据分析与报告撰写

8.3 后续学习路径

建议进一步探索:

- 接入LangChain构建复杂应用

- 尝试模型微调(LoRA/P-Tuning)

- 结合RAG实现知识增强

- 开发自定义插件扩展功能

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)