通义千问图像模型:Qwen-Image-Edit-2509全面评测

本文介绍了通义千问图像编辑模型Qwen-Image-Edit-2509的核心功能与评测。该模型支持基于多张图片的复杂编辑与合成,用户可在星图GPU平台上实现该镜像的一键自动化部署,快速搭建AI图像编辑环境。其典型应用场景包括电商商品与模特图的快速组合、社交媒体创意配图生成等,能有效提升视觉内容创作效率。

通义千问图像模型:Qwen-Image-Edit-2509全面评测

最近,阿里通义千问团队推出了一个挺有意思的新玩意儿——Qwen-Image-Edit-2509。光看名字就知道,这是个专门用来编辑图片的AI模型。但和之前那些只能修修补补的工具不同,它主打一个“多图编辑”的概念,听起来就有点意思。

简单来说,你可以同时上传好几张图片,然后告诉AI你想怎么组合它们。比如,把A照片里的人物和B照片里的背景拼在一起,或者给一个商品换个模特。这对于做电商、搞设计或者玩社交媒体的朋友来说,应该是个挺实用的功能。

正好,CSDN星图镜像广场上架了这个模型的镜像,我花了一些时间上手体验了一番。这篇文章,我就从一个普通用户的角度,带大家看看这个Qwen-Image-Edit-2509到底好不好用,能玩出什么花样,以及在实际操作中需要注意些什么。

1. 核心能力初探:不止于“修图”

在深入操作之前,我们先来搞清楚这个模型到底能干什么。如果只是把它当成一个“美图秀秀”的AI版,那就太小看它了。Qwen-Image-Edit-2509的核心,在于理解和执行基于多张图片的复杂编辑指令。

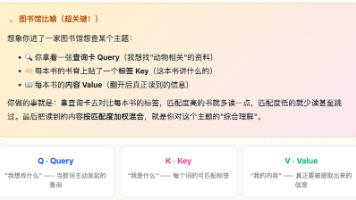

1.1 理解“多图编辑”

传统的图像编辑AI,通常是你给一张图,然后告诉它“把天空换成蓝色”或者“把这个人去掉”。但Qwen-Image-Edit-2509的思路更开阔。它允许你上传多张图片作为“素材库”,然后通过文字描述,指挥它从这些素材中提取元素,合成一张全新的图片。

举个例子:

- 人物+场景:上传一张你的个人照,再上传一张埃菲尔铁塔的风景照,然后输入“请把我放到埃菲尔铁塔前面”。模型就会尝试把你从第一张照片里“抠”出来,合理地放到第二张照片的背景下。

- 商品+模特:上传一张纯白背景的商品图(比如一个包包),再上传一张模特的照片,输入“请让模特拿着这个包包”。模型会尝试让模特的手以自然的姿势“握住”包包,并处理好光影和遮挡关系。

- 元素替换与融合:上传一张客厅的图片,再上传一张新沙发的图片,输入“用这张新沙发替换掉客厅里的旧沙发”。模型不仅要替换,还得调整透视、阴影,让新沙发看起来就像是原本就在那里一样。

这种能力,让图片编辑从“修改”升级到了“创作”和“合成”的层面。

1.2 技术亮点与上手感受

从官方信息和实际体验来看,这个模型有几个让我印象比较深的地方:

首先是对复杂指令的理解能力。 你不用像对早期AI那样,把指令拆解得特别细。比如,你说“创造一个夏日海滩场景,要有椰子树、遮阳伞和快乐的人群”,它就能结合你上传的相关素材图(比如单独的椰子树图片、遮阳伞图片),去尝试构建这个场景。当然,指令越清晰,效果通常越好。

其次是生成图片的连贯性和合理性。 在多图合成时,最怕的就是“拼贴感”太重,各个元素之间光影不搭、透视不对。Qwen-Image-Edit-2509在这方面做了不少优化。在我测试的案例中,它对于人物与场景的融合、物体之间的遮挡关系处理得还算自然,不会出现特别明显的“穿帮”镜头。

最后是操作界面相对友好。 通过CSDN星图镜像部署后,它提供了一个基于ComfyUI的工作流界面。虽然ComfyUI对于新手来说有一点点学习成本,但这个镜像已经预设好了常用的流程节点,你基本上只需要做三件事:上传图片、输入描述、点击生成。我们下一章就来看看具体怎么操作。

2. 手把手实战:从部署到生成第一张图

理论说得再多,不如亲手试一下。我们这就来看看如何快速在CSDN星图镜像上使用Qwen-Image-Edit-2509。

2.1 环境准备与镜像部署

这一步非常简单,几乎可以说是“一键部署”:

- 访问CSDN星图镜像广场。

- 在搜索框中输入“Qwen-Image-Edit-2509”,找到对应的镜像。

- 点击“部署”按钮。系统会自动为你分配计算资源并启动环境。

- 等待几分钟,状态变为“运行中”后,点击“访问”按钮,就会打开ComfyUI的操作界面。

整个过程不需要你配置任何复杂的Python环境或下载巨大的模型文件,非常适合想快速体验的用户。

2.2 认识工作流界面

打开后的界面就是ComfyUI的工作流画布。初次看到可能觉得有点复杂,但别担心,这个镜像已经帮你把常用的节点都连接好了,你不需要自己搭建。

界面上主要有几个关键区域:

- 左侧节点面板:这里有各种可用的功能模块(节点),但预设工作流已经够用,初期可以不用管。

- 中间画布:显示当前的工作流。你会看到几个已经连好的节点框,比如加载图片的节点、输入提示词的节点、运行生成的按钮等。

- 右侧预览/输出区域:这里会显示你上传的图片和最终生成的结果。

我们的所有操作,都将在这个预设好的工作流上进行。

2.3 分步操作指南

现在,我们通过一个具体的例子,来走一遍完整的流程。假设我想把一张个人照片的背景,换成另一张风景照的背景。

第一步:上传原始图片 在工作流中找到名为“Load Image”或类似名称的节点。点击上面的“选择文件”或拖拽区域,上传你的个人照片(我们称之为图A)。上传后,图片会显示在该节点下方或右侧预览区。

第二步:上传参考图片 在画布上找到另一个用于加载参考图片的节点(可能标注为“Reference Image”或第二个“Load Image”)。点击它,上传你想要的风景照(图B)。

第三步:输入编辑指令 找到“CLIP Text Encode (Prompt)”或“文本输入”节点。在文本框里,用清晰的语言描述你的需求。例如:“将人物从第一张图片中提取出来,背景替换为第二张图片的风景,保持人物比例协调,光影匹配新背景。”

小技巧:指令可以更具体,比如“人物保持微笑表情,背景虚化处理,整体是温馨的午后色调”。

第四步:调整参数(可选) 工作流中可能有一些参数设置节点,比如:

- 采样步数 (Steps):通常20-30步就能有不错的效果,增加步数可能提升细节,但也会更慢。

- 提示词相关性 (CFG Scale):控制AI听从你指令的程度。一般在7-9之间比较合适,太高可能导致图片失真。

- 分辨率:可以设置最终输出图片的大小。注意,分辨率越高,生成时间越长,对显存要求也越高。

初次尝试,可以先用默认参数。

第五步:生成图片 确认图片已上传、指令已填写后,点击画布右上角或顶部的 【运行】 按钮。界面通常会显示一个进度条,提示“生成中”。

第六步:查看与保存结果 生成完成后,最终图片会出现在专门的“Save Image”或“Preview Image”节点处。你可以直接右键点击图片预览,选择保存到本地。

至此,你就完成了第一次多图编辑。整个过程的核心就是:提供素材(图A、图B),下达指令(文字描述),然后等待AI“施展魔法”。

3. 效果深度评测:它能做什么,做得好不好?

部署和操作都搞明白了,接下来才是重头戏:这个模型的实际效果到底怎么样?我针对几个宣传的主要功能点,进行了一系列测试。

3.1 功能一:人物与场景融合

这是最常用,也最能体现实力的场景。

测试案例:我上传了一张在室内拍的半身人像(光线均匀),和一张黄昏时分的城市天际线风景照。

- 指令1:“将人物放入第二张图的黄昏场景中,人物站在楼顶,面向远方。”

- 效果:模型成功地将人物“抠”了出来,并放置在了楼顶位置。人物的边缘处理得比较干净,没有明显的白边或残留。黄昏的光线也一定程度上映照在了人物的衣服和侧脸上,有了初步的光影融合感。不足的是,人物脚下的“站立感”稍弱,与楼顶栏杆的透视关系可以更精准。

- 指令2(进阶):“同场景,给人物加上被风吹动的头发和衣角效果。”

- 效果:这个要求就有点挑战性了。模型尝试添加了一些动态模糊的效果在头发和衣服边缘,但看起来更像是整体模糊,而非精准的“风吹动”质感。这说明对于特别细致和动态的物理效果,它目前的理解和生成能力还有限。

小结:人物与静态场景的融合是它的强项,效果自然,抠图准确。但对于涉及复杂物理交互(如风、水、手持物体)的融合,效果会打折扣。

3.2 功能二:商品与模特组合

对电商从业者来说,这个功能可能非常有用。

测试案例:上传一个纯色背景的咖啡杯商品图,和一张模特在办公室喝咖啡的生活照。

- 指令:“请让第二张照片中的模特,用手握住第一个咖啡杯,做出正在品尝的样子。”

- 效果:这个任务相当复杂,需要解决“握持”这个具体的动作和交互。生成的结果让我有些惊喜。模型确实生成了模特手指弯曲“握住”杯柄的图像,杯子的角度也基本匹配手持的透视。最大的问题是“接触点”的阴影和质感处理不够真实,杯子看起来像是轻微“浮”在手上,而不是被紧紧握住。此外,咖啡杯的logo和光影没有根据新环境做调整,显得有些突兀。

小结:能理解“组合”的意图,并做出大胆的尝试,在构图和姿势上表现不错。但在处理需要精确物理接触和材质交互的合成时,细节的真实性还有待提高。用于生成创意广告概念图或快速预览是足够的,但作为最终的精修商品图可能还需要人工后期。

3.3 功能三:多元素场景构建

这才是“多图编辑”的完全体,考验的是AI的“导演”能力。

测试案例:我上传了四张素材图:一张空房间图、一张沙发图、一张盆栽图、一张猫的图片。

- 指令:“用第二张沙发替换房间里的旧沙发(假设原图有),把第三张盆栽放在沙发旁边的角落,让第四张猫趴在沙发上。”

- 效果:这是一个综合性很强的测试。模型的表现可圈可点:

- 沙发替换:成功识别了房间内的沙发区域,并用新沙发图进行了替换,调整了大小和透视,融合度较好。

- 盆栽放置:将盆栽放到了沙发旁边的地面角落,比例基本合适,但盆栽的阴影方向与房间主光源不太一致。

- 猫的添加:这是最有趣的部分。模型生成的猫确实“趴”在了沙发的新靠垫上,姿势放松,并且身体有一部分被沙发靠背遮挡,有了空间层次感。猫的毛发质感与沙发面料也做了初步的融合。

小结:处理这种多指令、多元素的复杂场景时,Qwen-Image-Edit-2509展现出了较强的全局理解和构图能力。它能理清各个元素与主场景的关系,并进行合理的空间安排。虽然在细节光影统一上还有瑕疵,但已经能快速构建出一个视觉上连贯、有故事感的场景草图,这对于头脑风暴、场景预览或概念设计来说,价值巨大。

3.4 性能与稳定性

- 生成速度:在CSDN星图镜像提供的标准GPU环境下,生成一张1024x1024的图片,大约需要15-30秒。速度取决于图片复杂度、参考图数量和采样步数。这个速度对于创意工作流来说是可以接受的。

- 稳定性:在多次测试中,没有遇到崩溃或卡死的情况。对于无法理解或执行的指令,它通常会生成一张与指令部分相关但效果不佳的图,而不会报错。

- 可控性:目前主要通过文字指令控制,可控性取决于你描述的精确程度。它不像专业PS那样可以精确到像素级调整,更像是一个理解你意图的创意合作伙伴。

4. 总结:谁适合用它?怎么用更好?

经过一番详细的测试,我们可以给Qwen-Image-Edit-2509做一个用户画像了。

4.1 它的优势与最适合的场景

核心优势:

- 创意激发利器:当你只有一个模糊的想法时,上传几张参考图,用语言描述你的构思,它能快速给出一个视觉化的草案,打破创意僵局。

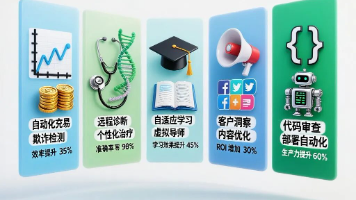

- 效率提升工具:对于电商、新媒体、设计等需要大量产生图片创意的行业,它可以快速生成商品场景图、社交媒体配图、广告概念图等,节省寻找素材和初步合成的时间。

- 低门槛图像合成:让没有专业PS技能的用户,也能实现复杂的多图合成效果,降低了图像创作的门槛。

最适合的三大场景:

- 电商内容制作:快速制作商品与不同场景、不同模特组合的预览图,测试营销效果。

- 社交媒体与内容创作:为博客、视频、社交媒体帖子快速生成独特的封面图或插图。

- 概念设计与头脑风暴:建筑师、游戏设计师、影视创作者可以用它快速拼接灵感素材,可视化初期概念。

4.2 使用建议与注意事项

要想用好它,而不是被它气到,有几个小建议:

- 素材质量是关键:尽量上传高清、主体明确、背景相对简洁的图片。AI不是魔术师,模糊的、杂乱的照片会严重影响它的识别和合成效果。

- 指令要具体,但别太“贪心”:像“把人物放进去,换个好看的背景,天气晴朗,表情开心”这样的指令是好的。但不要一次性要求它完成十几种复杂的修改,分步进行成功率更高。

- 理解它的边界:它擅长的是元素的组合、替换和风格调整。对于需要高度精确性(如产品细节)、复杂物理模拟(如流体、破碎)或完全无中生有的创造,目前还力有不逮。把它当作你的“创意副驾驶”,而不是“全自动流水线”。

- 迭代优化:很少有一次生成就完美的结果。如果第一次效果不理想,可以基于生成的图片,微调你的描述词,或者更换更合适的参考图,进行第二次、第三次生成。

4.3 最后的看法

Qwen-Image-Edit-2509不是一个完美的、能替代专业设计师的工具,但它是一个强大且有趣的“创意加速器”。它将多图编辑的门槛大大降低,把曾经需要专业软件和技能才能完成的操作,变成了几句简单的描述。

它的价值不在于生成一张“完美无瑕”的最终作品,而在于它能以惊人的速度,将你脑海中的混合想法视觉化,提供一个可继续加工和深化的优秀起点。对于内容创作者、营销人员和任何需要频繁与图像打交道的人来说,它都值得一试。随着技术的迭代,相信这类工具的理解力和精细度会越来越高,人机协作的创意工作流也会越来越顺畅。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)