【本地部署】千问开源Qwen3,开源模型卷起来~小模型能力强-尝鲜

Qwen3凭借混合推理架构和分层参数激活策略,在性能和成本效率上实现突破。本文介绍如何在Win11系统上本地部署最小版本qwen3:0.6b模型:通过ollama工具下载模型后,使用chatbox进行交互。若遇报错需检查ollama版本,升级后即可正常运行。该方案适合资源受限场景的快速部署体验。

·

Qwen3 通过 混合推理架构 和 分层参数激活策略,在性能超越 DeepSeek-R1 的同时实现 成本与效率的颠覆性突破,尤其适合需要平衡性能与资源的场景。

趁着刚刚发布的千问3,赶快本地部署一下,体验一吧

本地化部署开始:

用ollama工具

笔记本电脑:轻薄本,win11系统,核显

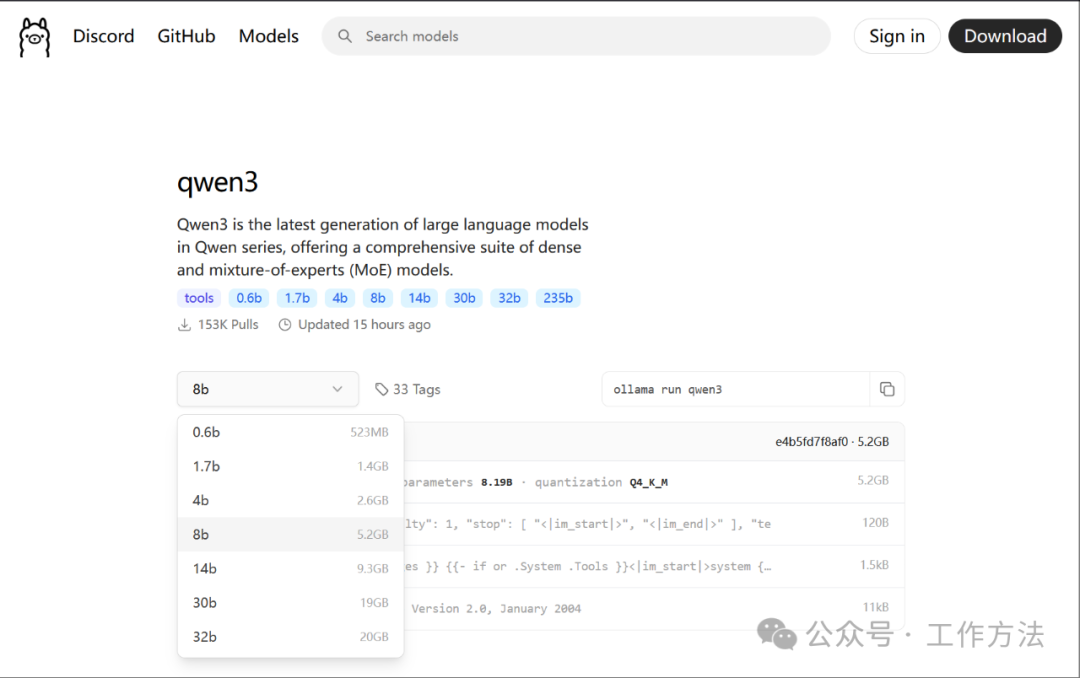

第一步:选择模型版本

ollama官网:https://ollama.com/library/qwen3

我这里用个最小的“qwen3:0.6b”小模型演示

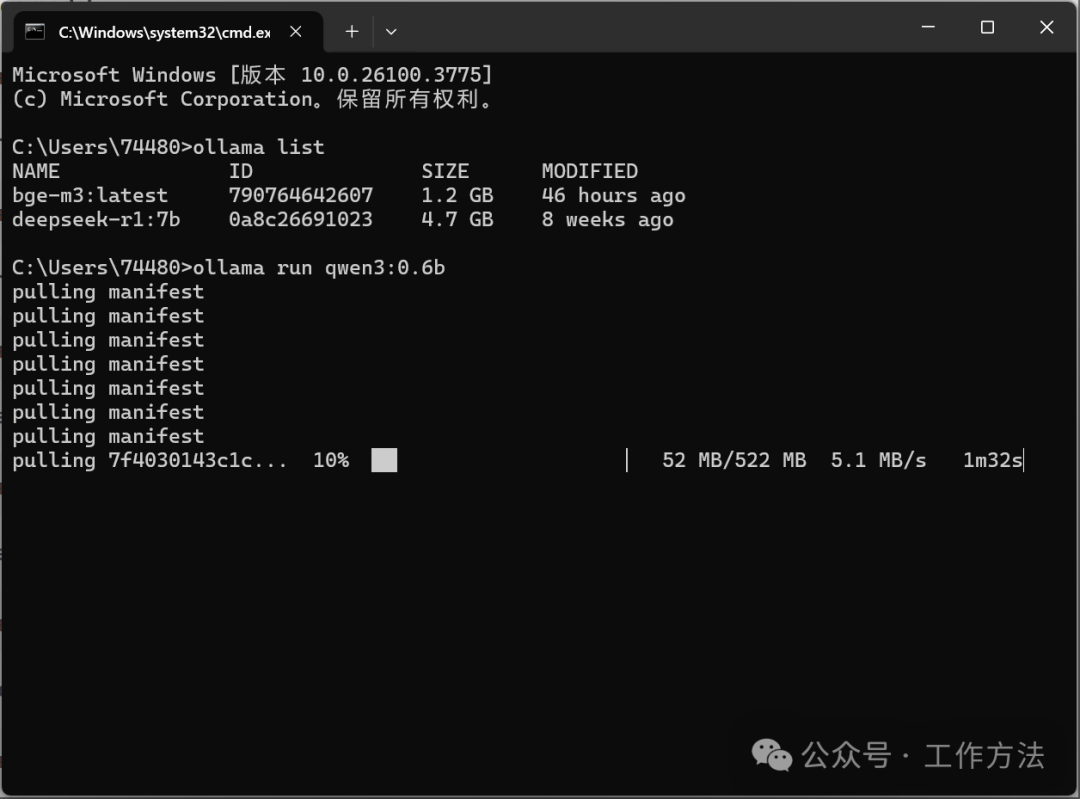

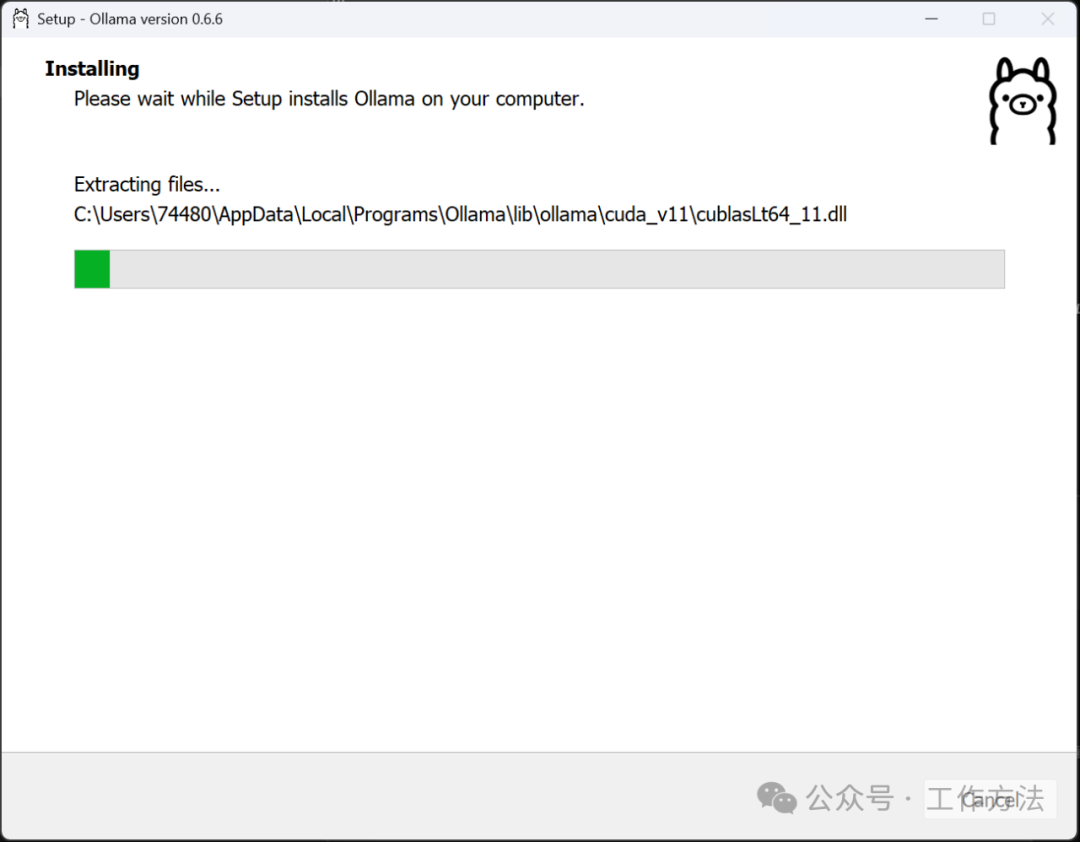

第二步:确认本机已经安装ollama;

第三步:安装模型

win+r,打开命令提示符输入

ollama run qwen3:0.6b用ollama安装qwen3:0.6b模型

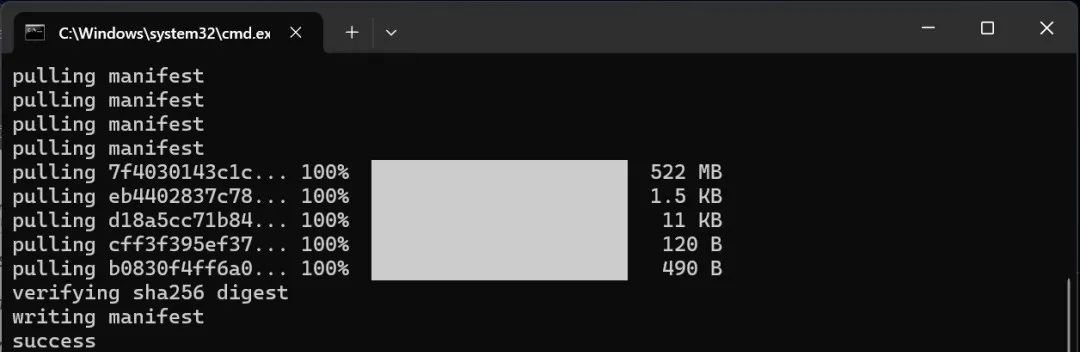

等待几分钟,

安装完成

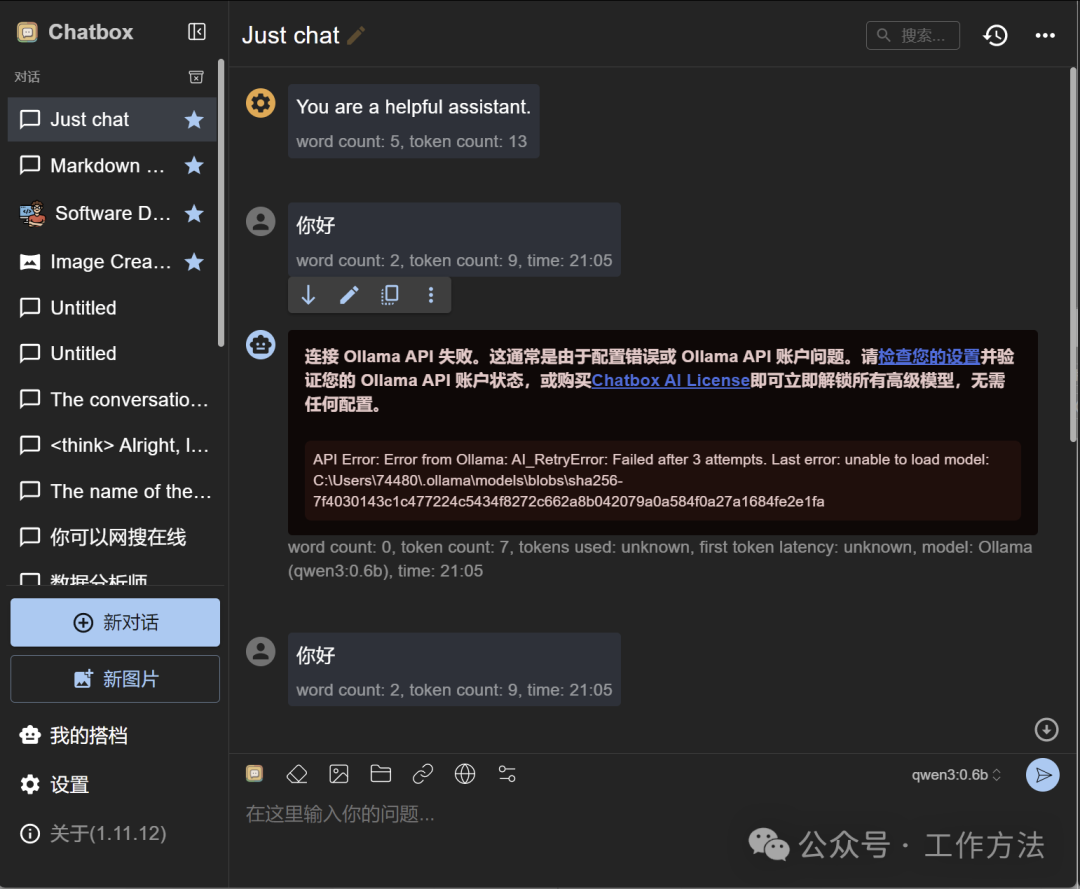

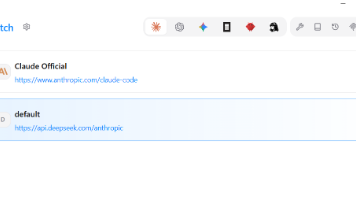

第四步:chatbox设置

用chatbox设置模型

现在可以使用了~

直接在chatbox中提问就可以了~

异常情况:

如果按照设置出现报错,👇

检查ollama版本,因为千问新开源的模型,旧版本ollama无法驱动,需要升级一下就可以,

升级完成就可以。

更多推荐

已为社区贡献284条内容

已为社区贡献284条内容

所有评论(0)