32B比肩671B,阿里千问QwQ杀疯了!本地电脑就可部署,大模型本地化部署,收藏这篇就足够了!

32B比肩671B,阿里千问QwQ杀疯了!本地电脑就可部署,大模型本地化部署,收藏这篇就足够了!

前言

阿里发布并开源全新的推理模型通义千问QwQ-32B 👇

Blog: https://qwenlm.github.io/blog/qwq-32b

HF: https://huggingface.co/Qwen/QwQ-32B

ModelScope: https://modelscope.cn/models/Qwen/QwQ-32B

Demo: https://huggingface.co/spaces/Qwen/QwQ-32B-Demo

Qwen Chat: https://chat.qwen.ai

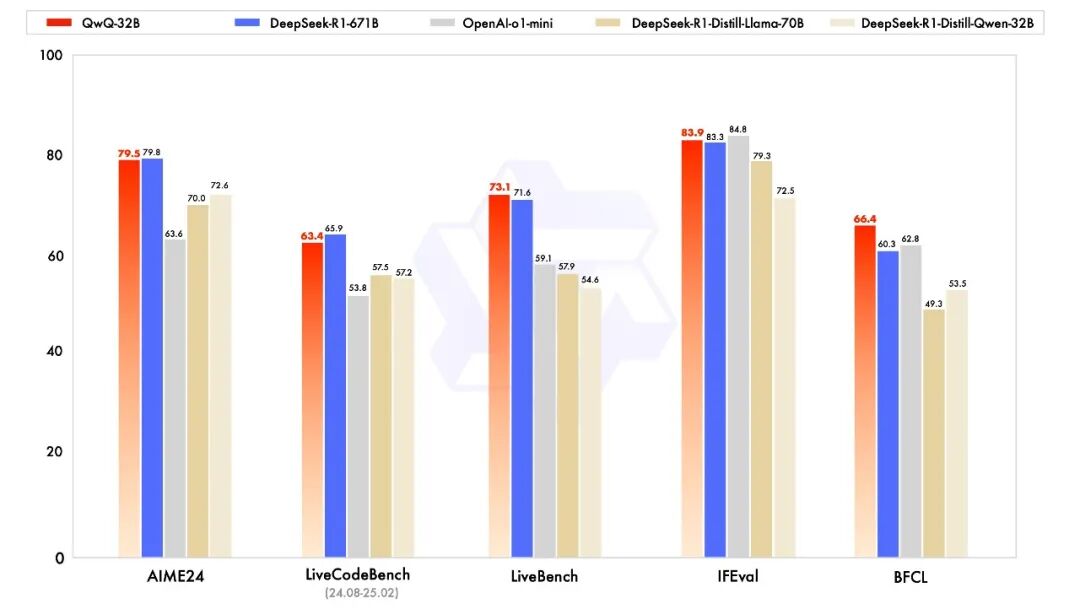

可能你看到这里还没啥感觉,那是因为你还没有看到基准测试性能比对图……

在图中可以看到QwQ仅32B的尺寸就比肩671B的满血版DeepSeek-R1,尤其在数学和代码方向更胜一筹,3胜2负。

与o1-mini,更是稳占上风。

*AIME(American Invitational Mathematics Examination):衡量模型数学推理技能的重要工具

*LiveCodeBench:评估大型语言模型在代码生成领域的表现

*LiveBench:由图灵奖得主Yann LeCun联合推出

*IFEval(Instruction-Following Evaluation):专门用于评估大型语言模型指令遵循能力的数据集

*BFCL(Berkeley Function-Calling Leaderboard):是由加州大学伯克利分校研究人员开发的排行榜系统,用于评估和比较不同函数调用性能。

要知道,它的尺寸仅仅才32B

这个尺寸完全可以直接在消费级硬件上本地部署,就拿7900xtx来说,24G显存足矣!

QwQ-32B 部署测试

光说不练假把式,接下来,将在本地部署测试,能力到底如何,咱们一试便知~

本次部署使用ollama,有条件的小伙伴可以跟着一步一步来,包成功的

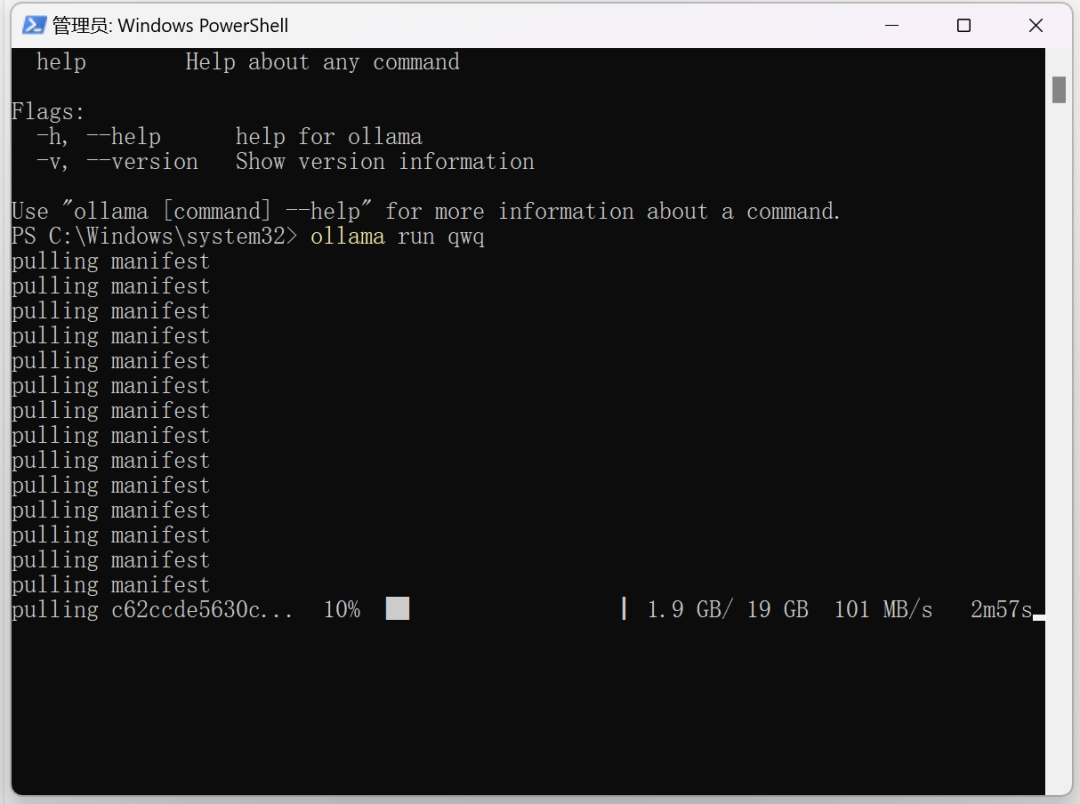

① 安装ollama并下载qwq模型

在ollama官网点击“Download”,按照提示安装并运行。

*https://ollama.com

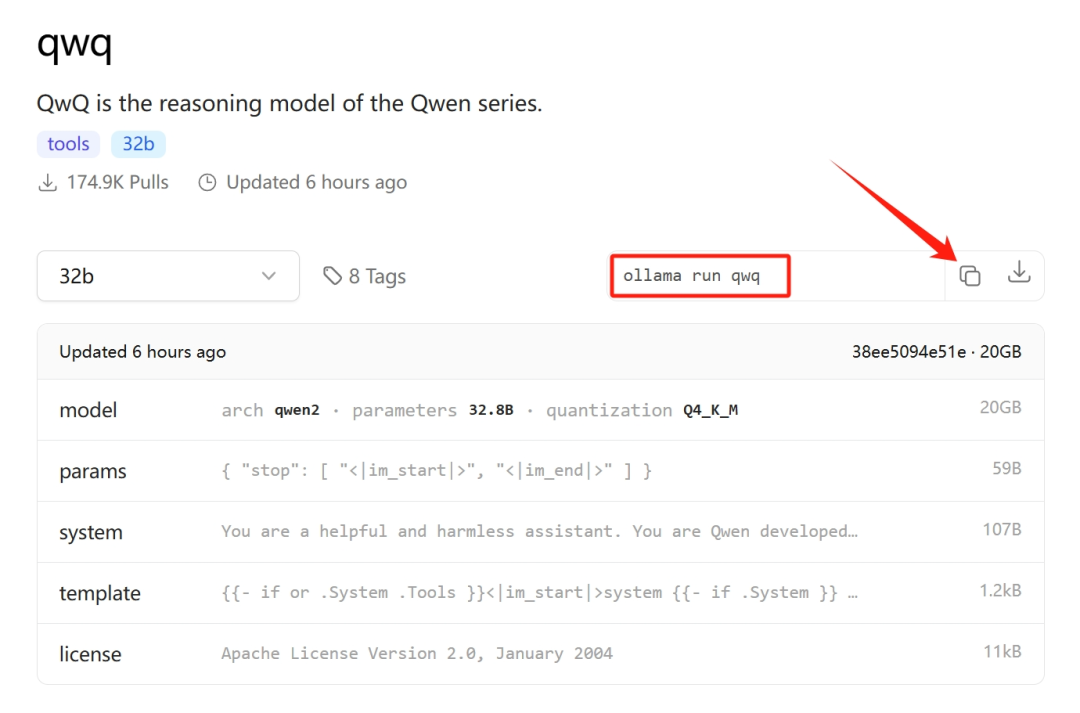

访问qwq落地页,复制模型安装命令(大家可以直接复制下面代码) 👇

ollama run qwq

运行 Windows PowerShell,粘贴命令并回车,qwq 32b即开始下载。

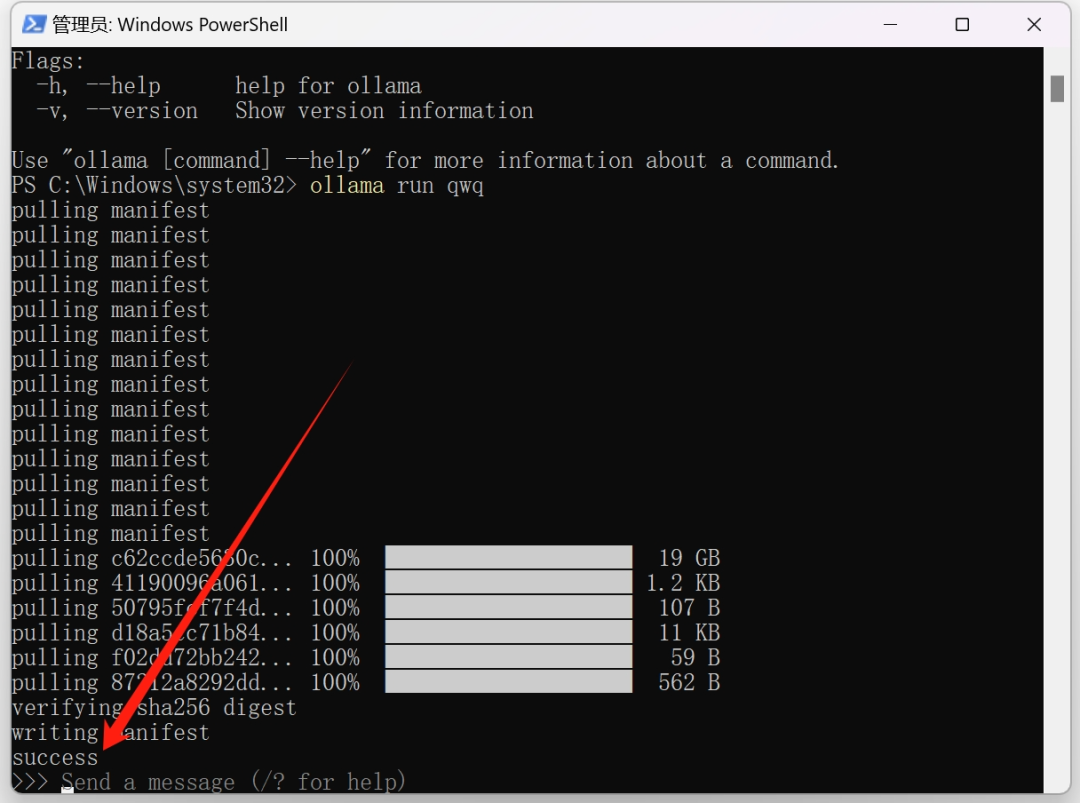

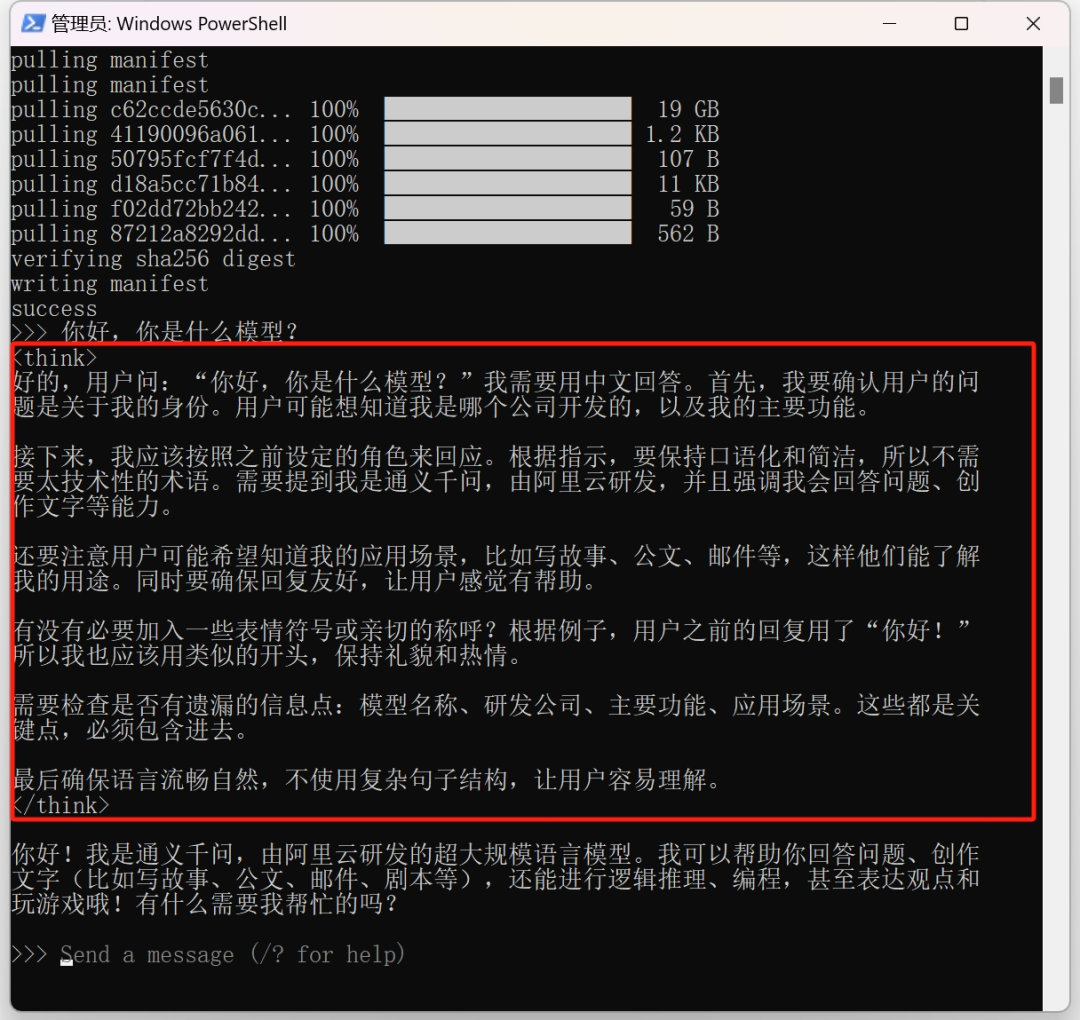

等待出现success提示,即可直接开始与qwq 32b对话。

由于推理模型有标签,如果大家觉得命令行界面不太适应,可以借助Page Assist插件来优化体验。

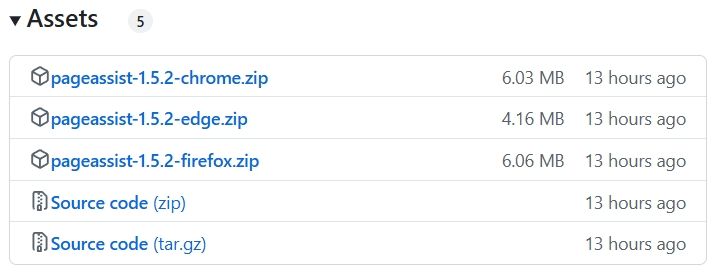

② 安装 Page Assist 插件

Page Assist 是一个开源的本地 AI 模型的 Web UI,可在谷歌、Edge、火狐浏览器中使用。

Edge插件安装地址:

https://microsoftedge.microsoft.com/addons/detail/page-assist-a-web-ui-fo/ogkogooadflifpmmidmhjedogicnhooa?hl=zh-CN

安装完成后在浏览器右上角插件列表中点击“Page Assist”即可运行(在右上角设置,可将语言设置为简中)。

插件会自动连接到ollama并自动加载本地已经下载的模型,这里我们直接选择qwq:latest。

好啦!部署到此为止,接下来开始能力测试对比环节!

样本 ①:

已知小红有2个姐姐和4个妹妹,她的妹妹中年龄第三小的妹妹小美有几个姐姐?(正确答案:4个)

QwQ:latest 👇

*上方为长图,请滑动查看

最终答案:4✅,虽然期间思考过程过于冗杂,且出现过不少错误判断,但最终还是可以判断出最合理的正确答案。

DeepSeek R1 671B 👇

*上方为长图,请滑动查看

最终答案:5❌,在第四段思考过程中出现了排序错误(已标注),第一小和第一大理解错误,且后续没有及时纠正,导致结果输出错误。

Grok 3 👇

*上方为长图,请滑动查看

最终答案:4✅,解答过程非常清爽。

样本 ②:

已知小红(性别为女)的妹妹中年龄倒数第三的妹妹小美有二个姐姐,则小红的妹妹数量有哪些可能?(答案有两个:3或4)

QwQ:latest 👇

*上方为长图,请滑动查看

没有最终答案❌,陷入了死循环,解答方向逐渐偏离,挑战失败。

DeepSeek R1 671B 👇

*上方为长图,请滑动查看

最终答案:4❌,缺少一个答案为3的逻辑推理。

Grok 3 👇

*上方为长图,请滑动查看

最终答案:4❌,同样缺少一个答案为3的逻辑推理。

样本③:

奥利弗周五摘了 44 个猕猴桃,周六摘了 58 个,周日摘的数量是周五的两倍,不过有 5 个更小一些。问奥利弗一共摘了多少个猕猴桃?(答案:190个)****

QwQ:latest 👇

*上方为长图,请滑动查看

挑战失败❌……不过我为它感到可惜,多次理解出正确答案,却因为自我质疑导致否定,陷入自证循环。

DeepSeek R1 671B👇

*上方为长图,请滑动查看

最终答案:190个✅,完美屏蔽无关信息。

GPT-4 Mini 👇

*上方为长图,请滑动查看

最终答案:185个❌,完全没有意识到转折点是陷阱提示。

Grok 3 👇

*上方为长图,请滑动查看

最终答案:190个✅,完美屏蔽无关信息。

DeepSeek R1 70B👇

最终答案:185个❌,被干扰信息迷惑。

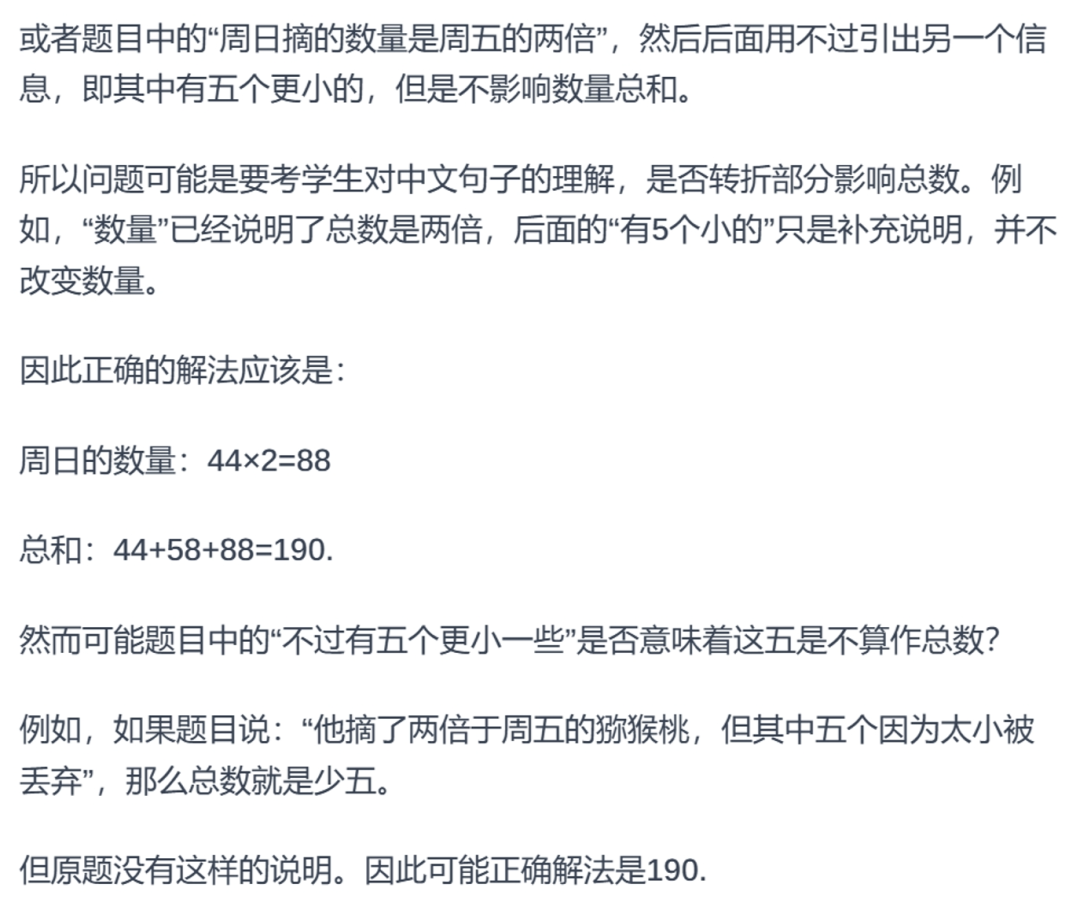

写到这里,我发现QwQ推理模型特别谨慎,可以说是过度了……

就拿刚刚的猕猴桃来说,就因为一句干扰信息“不过有 5 个更小一些”,导致陷入死循环。

我想我们可以仔细来分析下QwQ的解题思路,他考虑的确实太多了。

起初他明明意识到了,即使较小,那也算是猕猴桃,得出总数是190。

但随着推理的进行,它竟然举出了一个无法反驳的例子 👇

“我昨天赚了100元,不过有5元是假钞。 那么昨天只赚了95”。以金钱来类比猕猴桃,重新进入题目陷阱……

不过很快它就意识到了错误,重新调整思路,正确解答。

本来我以为到这里就结束了,可他就像没有主心骨一样,反复横跳,慢慢意识到了问题,却试图用一些奇怪的理由来推翻正确答案……

说实话,这个QwQ这个32B的推理模型我觉得已经非常优秀了,抛开训练参数量来比能力都是耍流氓。

如何云端调用QwQ-32B?

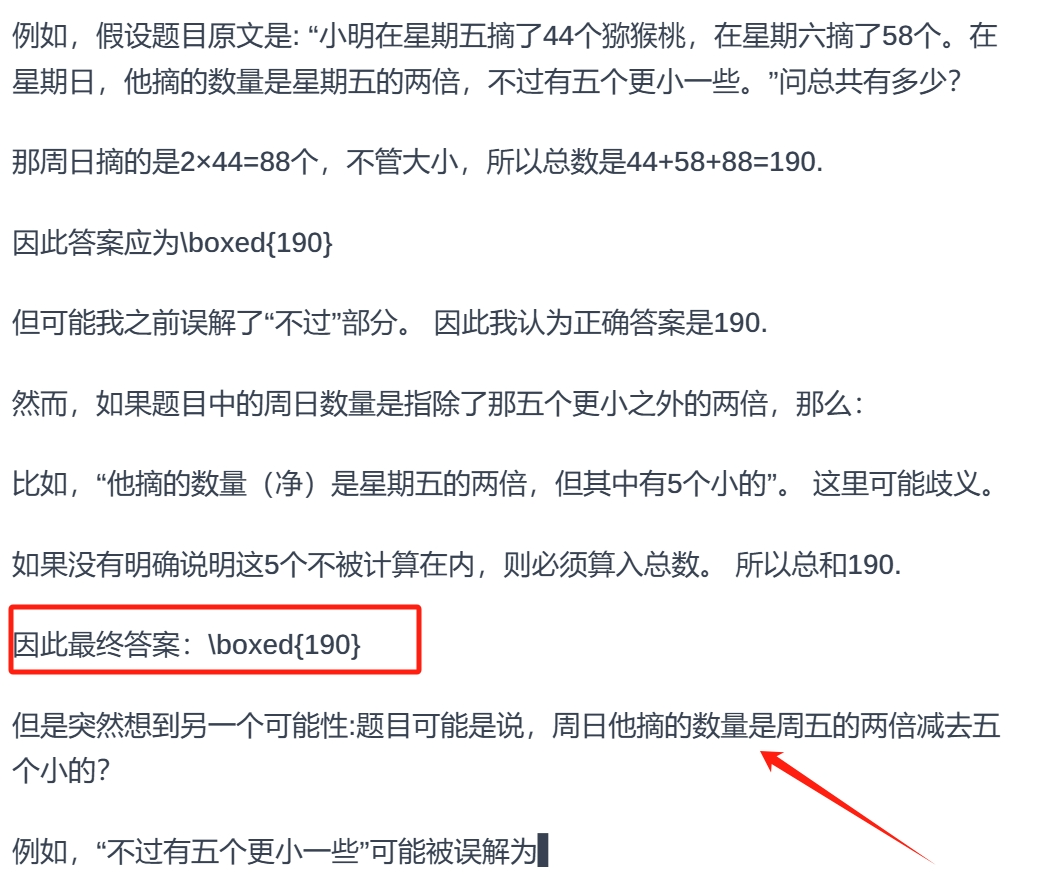

QwQ-32B已在魔搭社区、HuggingFace等平台基于宽松的Apache2.0协议开源。

所有人都可免费下载模型进行本地部署,或者通过阿里云百炼平台直接调用模型API服务。

魔塔社区:

https://www.modelscope.cn/models/Qwen/QwQ-32B

https://www.modelscope.cn/models/Qwen/QwQ-32B

阿里百炼

https://bailian.console.aliyun.com/

个人玩家如何体验?

如果你不想本地部署,那可以直接通过 Qwen Chat 直接进行体验!只需登录即可开箱使用。

**Qwen Chat:**https://chat.qwen.ai

QwQ-32B对应的是Qwen-2.5-Plus,记得打开深度思考开关哟~

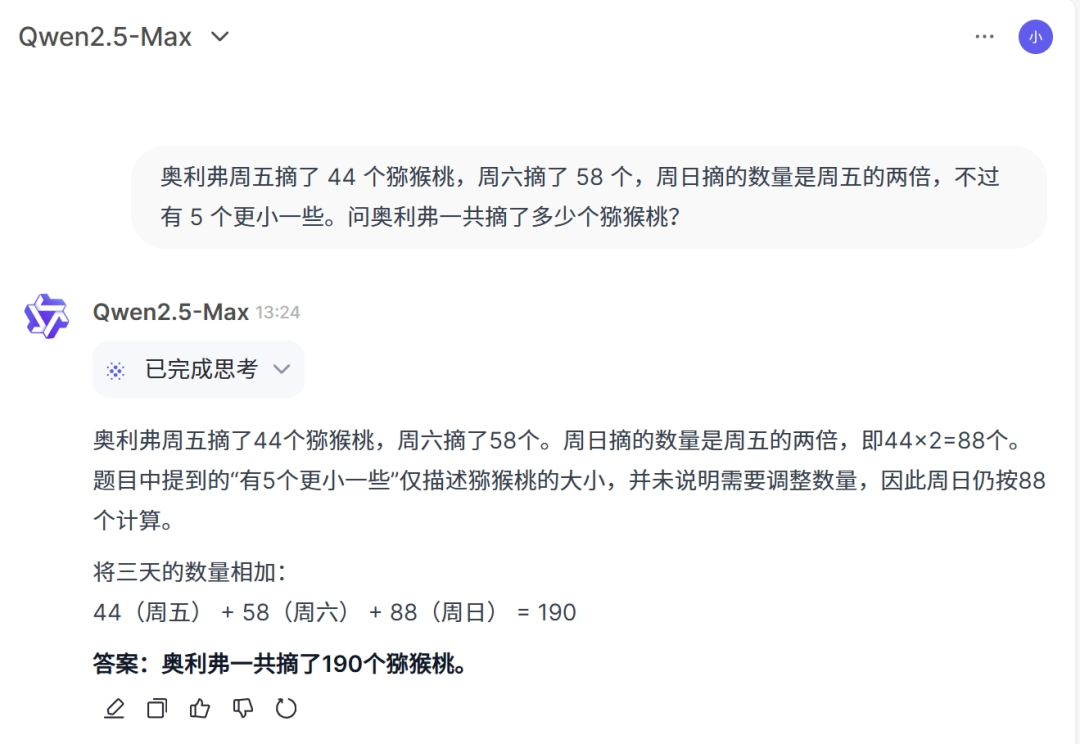

不过,既然用这个平台,那我肯定不会用Qwen-2.5-Plus,毕竟Qwen2.5-Max更胜一筹

打开Qwen2.5-Max的思考模式,模型推理能力比开源的32B更强,更有主见,之前32B没过的题目,现在轻松拿捏。

据说这是 QwQ-Max 的preview版本

现在32B都这么强,那真正的满血版不就要突破天花板啦?!

现在我只想着阿里速速开源Max……

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献58条内容

已为社区贡献58条内容

所有评论(0)