deepseek r1完全本地部署实战教程10

Ollama使用环境变量来进行配置,允许用户根据需要调整其行为。通过合理配置这些环境变量,用户可以优化Ollama的性能、安全性以及功能适应性,使其更好地服务于特定的应用场景或开发需求。

·

摘要:

Ollama使用环境变量来进行配置,允许用户根据需要调整其行为。常见的环境变量包括:

- OLLAMA_API_KEY:用于认证和授权,确保API请求的安全性。

- OLLAMA_PORT: 指定Ollama服务监听的端口号,默认值可能为11434,但可以通过设置此变量修改。

- OLLAMA_MODEL_PATH: 定义模型文件的位置,用户可以根据需要指定不同的模型路径,以加载所需的AI模型。

- OLLAMA_GPU_ENABLED: 启用或禁用GPU加速。如果您的系统支持GPU计算并希望加快推理速度,可以设为true;反之,则可设为false。

- OLLAMA_LOG_LEVEL: 设置日志记录的详细程度,如调试、信息、警告、错误等,帮助开发者排查问题和了解运行状态。

通过合理配置这些环境变量,用户可以优化Ollama的性能、安全性以及功能适应性,使其更好地服务于特定的应用场景或开发需求。

一、ollama常用环境变量

Ollama 提供了多种环境变量以供配置:

OLLAMA_DEBUG:是否开启调试模式,默认为 false。

OLLAMA_FLASH_ATTENTION:是否闪烁注意力,默认为 true。

OLLAMA_HOST:Ollama 服务器的主机地址,默认为空。

OLLAMA_KEEP_ALIVE:保持连接的时间,默认为 5m。

OLLAMA_LLM_LIBRARY:LLM 库,默认为空。

OLLAMA_MAX_LOADED_MODELS:最大加载模型数,默认为 1。

OLLAMA_MAX_QUEUE:最大队列数,默认为空。

OLLAMA_MAX_VRAM:最大虚拟内存,默认为空。

OLLAMA_MODELS:模型目录,默认为空。

OLLAMA_NOHISTORY:是否保存历史记录,默认为 false。

OLLAMA_NOPRUNE:是否启用剪枝,默认为 false。

OLLAMA_NUM_PARALLEL:并行数,默认为 1。

OLLAMA_ORIGINS:允许的来源,默认为空。

OLLAMA_RUNNERS_DIR:运行器目录,默认为空。

OLLAMA_SCHED_SPREAD:调度分布,默认为空。

OLLAMA_TMPDIR:临时文件目录,默认为空。Here is the optimized list in the desired format:

OLLAMA_DEBUG:是否开启调试模式,默认为 false。

OLLAMA_FLASH_ATTENTION:是否闪烁注意力,默认为 true。

OLLAMA_HOST:Ollama 服务器的主机地址,默认为空。

OLLAMA_KEEP_ALIVE:保持连接的时间,默认为 5m。

OLLAMA_LLM_LIBRARY:LLM 库,默认为空。

OLLAMA_MAX_LOADED_MODELS:最大加载模型数,默认为 1。

OLLAMA_MAX_QUEUE:最大队列数,默认为空。

OLLAMA_MAX_VRAM:最大虚拟内存,默认为空。

OLLAMA_MODELS:模型目录,默认为空。

OLLAMA_NOHISTORY:是否保存历史记录,默认为 false。

OLLAMA_NOPRUNE:是否启用剪枝,默认为 false。

OLLAMA_NUM_PARALLEL:并行数,默认为 1。

OLLAMA_ORIGINS:允许的来源,默认为空。

OLLAMA_RUNNERS_DIR:运行器目录,默认为空。

OLLAMA_SCHED_SPREAD:调度分布,默认为空。

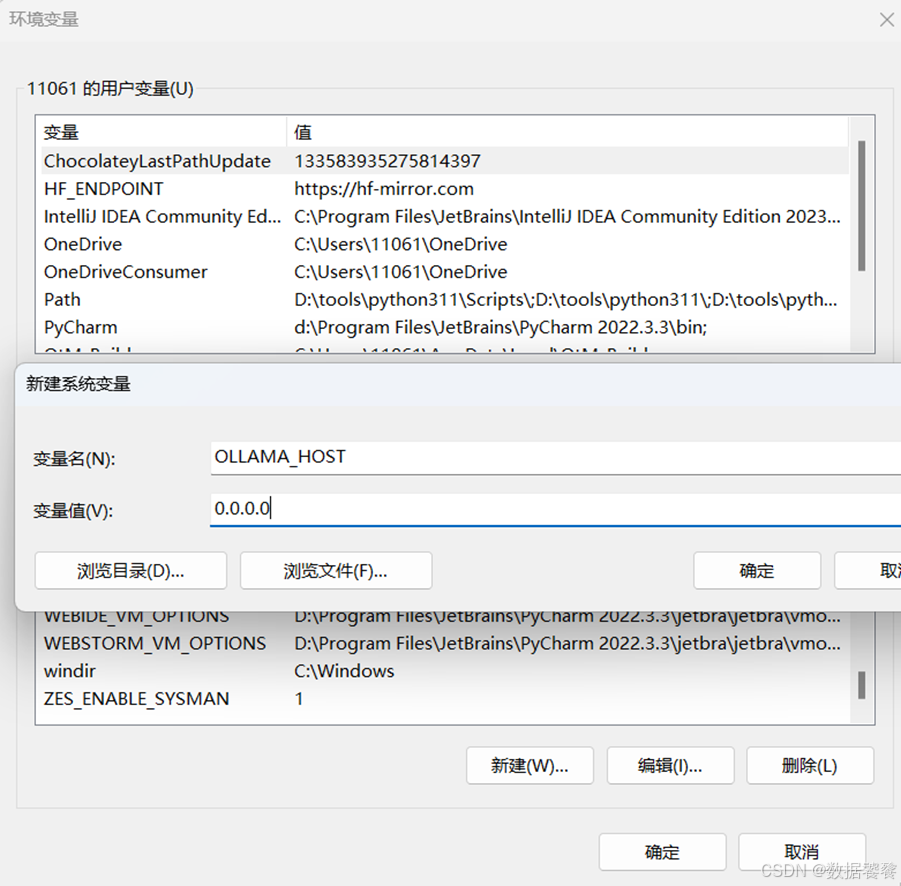

OLLAMA_TMPDIR:临时文件目录,默认为空。二、windows配置方法

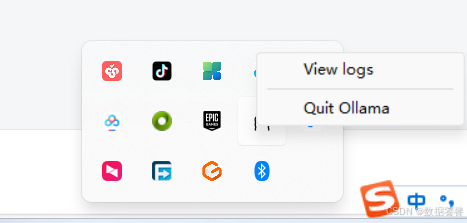

三、注意事项

环境变量设置以后,需要重启服务

四、常用操作指令

ollama serve #启动ollama

ollama create #从模型文件创建模型

ollama show #显示模型信息

ollama run #运行模型

ollama pull #从注册表中拉取模型

ollama push #将模型推送到注册表

ollama list #列出模型

ollama cp #复制模型

ollama rm #删除模型

ollama help #获取有关任何命令的帮助信息更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)