使用Ollama实现一键本地部署deepseek-v3.1:671b超级大模型,太阳照进现实里!

摘要:Ollama现支持在本地部署deepseek-v3.1:671b等大型语言模型,突破硬件限制。通过简单安装Ollama并登录认证,用户可轻松拉取云模型到本地运行,支持多机同时使用。提供两种调用方式:本地部署(使用OpenAI库)或直接调用Ollama云API(需Python库)。目前支持12个云模型,包括glm-4.6、gpt-oss:120b等四大高性能模型。该方案解决了用户硬件不足的痛点

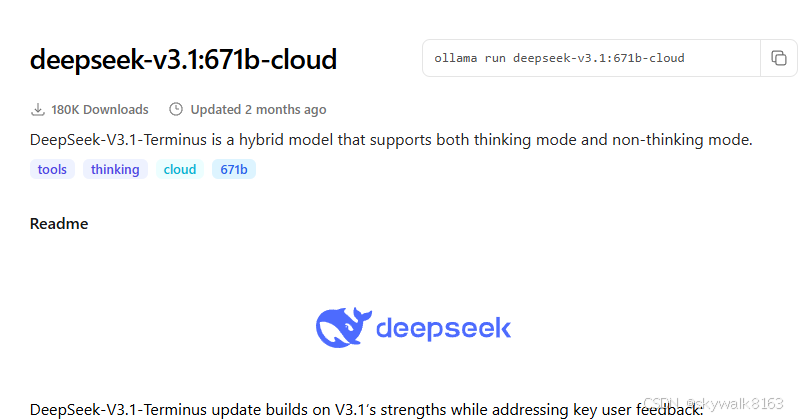

本地部署deepseek-v3.1:671b大模型,以前想都不敢想。手里没有卡啊!刚开始还奢望等V100退役了,弄点V100组群跑。后来看到V100很多新技术都不支持,能不能跑现在的llm还不一定呢,就更加不敢奢望了。但是现在阳光照进现实了!Ollama就支持部署deepseek-v3.1:671b-cloud 模型到本地!

当然官网也说了:Ollama’s cloud is currently in preview.,所以现在还是预览版,具体见手册:Cloud - Ollama

安装启动Ollama

安装

按部就班,到Ollama官网,安装提示安装即可,比如Linux下直接一键执行:

curl -fsSL https://ollama.com/install.sh | sh启动ollama serve

ollama serve启动模型

下载拉取模型

到ollama官网,找到想要的模型,按照右上角的命令,直接执行即可,比如

启动deepseek-v3.1:671b-cloud模型

按照右上角的提示,执行:

ollama run deepseek-v3.1:671b-cloud

# 或拉取模型

ollama pull deepseek-v3.1:671b-cloud这时候它会自动pull拉取模型,几秒钟拉取好后,就进入了交互界面,可以直接进行交互。这时候也可以远程api调用这个模型。

后面不用了退出即可。因为已经拉取了,所以不需要一直在交互界面。退出交互界面,也不影响api的调用。

登录

这是跟本地模型不一样的地方,第一次使用需要登录认证

ollama signin

登录后显示

You need to be signed in to Ollama to run Cloud models.

To sign in, navigate to:

https://ollama.com/connect?name=xxxx&key=xxxxx安装上面提示,打开网页,登录Ollama官网的账户,就ok了。以后就不需要重复输入signin了。

可以多台机器同时启动Ollama的云模型,多台机器同时登录。

列出模型

比如我们的服务器是放置在192.168.1.12上面的,浏览器用这个网址列出模型列表:

http://192.168.1.12:11434/v1/models只安装一个模型的列表:

{"object":"list","data":[{"id":"deepseek-v3.1:671b-cloud","object":"model","created":1764780337,"owned_by":"library"}]}安装了4个常用模型的列表:

{"object":"list","data":[{"id":"gpt-oss:120b-cloud","object":"model","created":1764781563,"owned_by":"library"},

{"id":"glm-4.6:cloud","object":"model","created":1764781456,"owned_by":"library"},

{"id":"qwen3-vl:235b-instruct-cloud","object":"model","created":1764781352,"owned_by":"library"},

{"id":"deepseek-v3.1:671b-cloud","object":"model","created":1764780337,"owned_by":"library"}]}

直接远程登录调用

也可以直接远程登录Ollama官方服务器,这样就不需要本地再拉取、转发了。

Cloud API access

Cloud models can also be accessed directly on ollama.com’s API. In this mode, ollama.com acts as a remote Ollama host.

Authentication

For direct access to ollama.com’s API, first create an API key.

Then, set the OLLAMA_API_KEY environment variable to your API key.

Copy

export OLLAMA_API_KEY=your_api_key

Listing models

For models available directly via Ollama’s API, models can be listed via:

Copy

curl https://ollama.com/api/tags

云调用,就不是用openai库了,而是用ollama库,先安装

pip install ollama

再调用

import os

from ollama import Client

client = Client(

host="https://ollama.com",

headers={'Authorization': 'Bearer ' + os.environ.get('OLLAMA_API_KEY')}

)

messages = [

{

'role': 'user',

'content': 'Why is the sky blue?',

},

]

for part in client.chat('gpt-oss:120b', messages=messages, stream=True):

print(part['message']['content'], end='', flush=True)Ollama官方直接调用云模型的好处是本地不用再安装Ollama软件了,这个软件也差不多1G大小呢,但是需要用ollama python库调用。本地云部署的好处是,一次认证,后面本地调用都不用认证了,而且用的是openai库,省时省力。

Ollama云部署最牛的四个大模型

当前Ollama支持12个云模型部署,其中最牛的四个如下:

glm-4.6:cloud gpt-oss:120b-cloud deepseek-v3.1:671b-cloud qwen3-vl:235b-instruct-cloud

更多推荐

已为社区贡献42条内容

已为社区贡献42条内容

所有评论(0)