如何在个人电脑上搭建和使用deepseek大模型(入门篇)

搭建/部署大模型,听起来很像是程序员才会干的事,实际上,有很多项目已经帮我们封装好常用功能,我们要做的只是在电脑上安装一个软件。

大家好,很久没更新了,今天来聊聊最近很火的人工智能大模型和DeepSeek。

在某些情况下,我们可能需要在自己的电脑上搭建大模型,比如担心隐私泄露、服务器访问失败、提示词限制,或者仅仅是为了学习人工智能。搭建/部署大模型,听起来很像是程序员才会干的事,实际上,有很多项目已经帮我们封装好常用功能,我们要做的只是在电脑上安装一个软件。

接下来文章介绍如何在个人电脑上完成以下操作:

-

运行一个大模型

-

使用本地大模型的 HTTP API 测试模型

-

使用 Python 代码创建一个 Web 应用访问本地大模型

第一点,即使没有代码基础也能轻松操作;第二点和第三点,安装几个开发者工具后,AI 会帮你完成大部分工作。

以下操作用到软件如下:

PyCharm安装通义灵码插件:

一、运行一个大模型

运行大模型的软件有很多,比较著名的有 Ollama 和 LM Studio。

-

Ollama 更适合喜欢敲命令行的小伙伴。

-

LM Studio 的图形界面很友好,适合不喜欢命令行操作的用户。

无论选择哪一种,去官网下载适合自己系统版本的安装包即可。

-

Ollama 官网:https://ollama.com

-

LM Studio 官网:https://lmstudio.ai/

我的电脑系统是 Windows 10,我不太喜欢在 Windows 上敲命令,因为一不小心就会敲出“ls”“grep”,然后系统提示命令无法识别……所以这里我选择用 LM Studio 做示范。

安装 LM Studio

-

下载安装包

访问 LM Studio 官网,下载与你的系统匹配的安装包。 -

安装软件

按照安装向导完成安装。

下载并运行模型

-

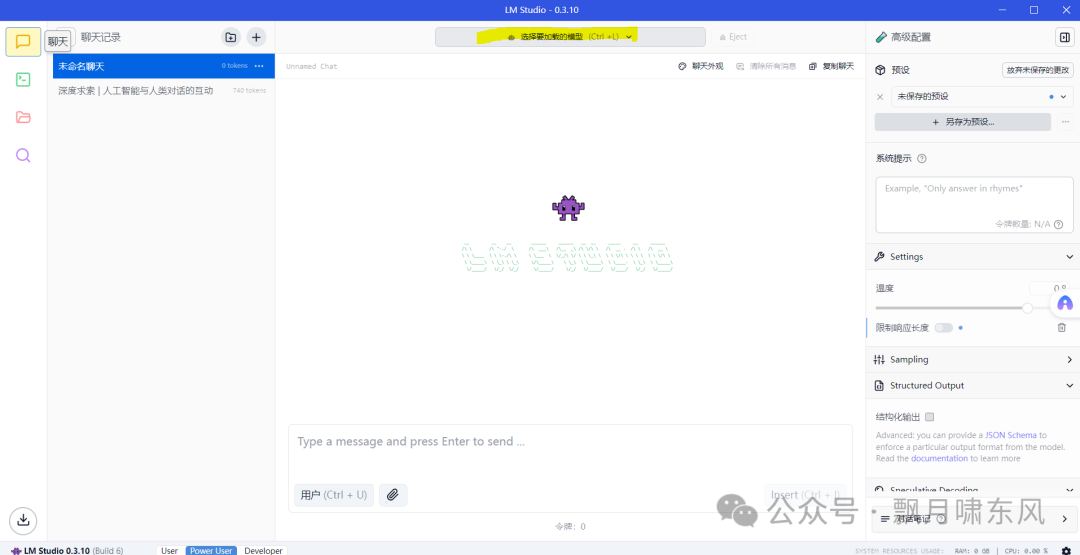

打开 LM Studio

安装完成后,打开 LM Studio,左侧有四个菜单:聊天、开发者、我的模型 和 发现。 -

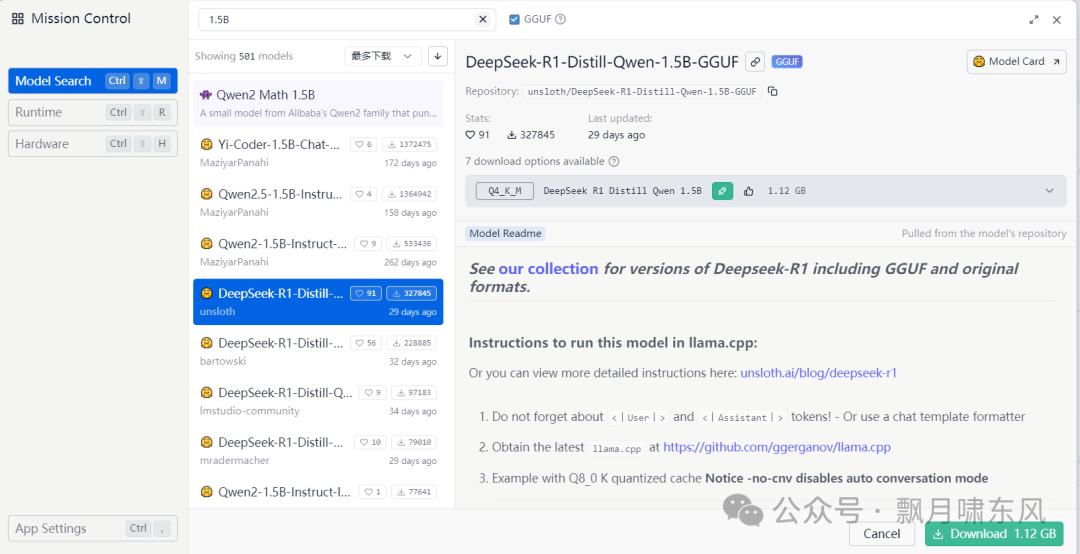

下载模型

在 发现 菜单中,根据你的硬件情况选择一个适合运行的模型。我的电脑只有 4GB 显存,所以我下载了最小的 1.5B 的 Deepseek 蒸馏模型。 -

加载模型

安装完成后,点击 聊天 菜单顶部的“选择要加载的模型”,将模型选上并开始聊天。

解决下载问题

对于大多数国内电脑,下载模型时可能会卡住,因为 LM Studio 默认从 HuggingFace(一个大模型社区,可以看作免费下载模型文件的集市)下载模型文件,而国内网络访问 HuggingFace 通常会失败。

- HuggingFace 社区:https://huggingface.co

解决办法是将 LM Studio 中的 HuggingFace 官网地址替换为国内镜像地址。

-

替换文件

打开 LM Studio 安装目录,找到两个需要替换的文件(每个文件约十几 MB)。推荐使用 PyCharm 或 VS Code 等开发工具进行全局替换。 -

修改地址

将文件中的huggingface.co替换为hf-mirror.com,然后重启应用,发现菜单的Model Search就能显示模型列表,点右下角Download前可以去我的模型菜单,修改模型保存路径,节约C盘空间。

回到聊天菜单加载本地模型后就可以进行聊天了,除了输入文字外,还可以上传文本文件用于检索,相当于创建简单的知识库,图片和语音不支持。如果你觉得它跟其他在线大模型比笨笨的,你可以尝试购买一个强劲的显卡,安装参数量大的模型重复测试(当然,体验度跟人民币成正比……)。

二、使用本地大模型的 HTTP API 测试模型

通常,我们使用大模型时,会通过一个 APP 或 Web 应用来提交请求。APP 或 Web 应用会将我们发送的文字封装成消息,发送给模型处理,然后返回结果并显示。我们也可以跳过 APP 或 Web 应用,直接给模型发送消息。比较常用的工具是 Postman。

测试步骤

-

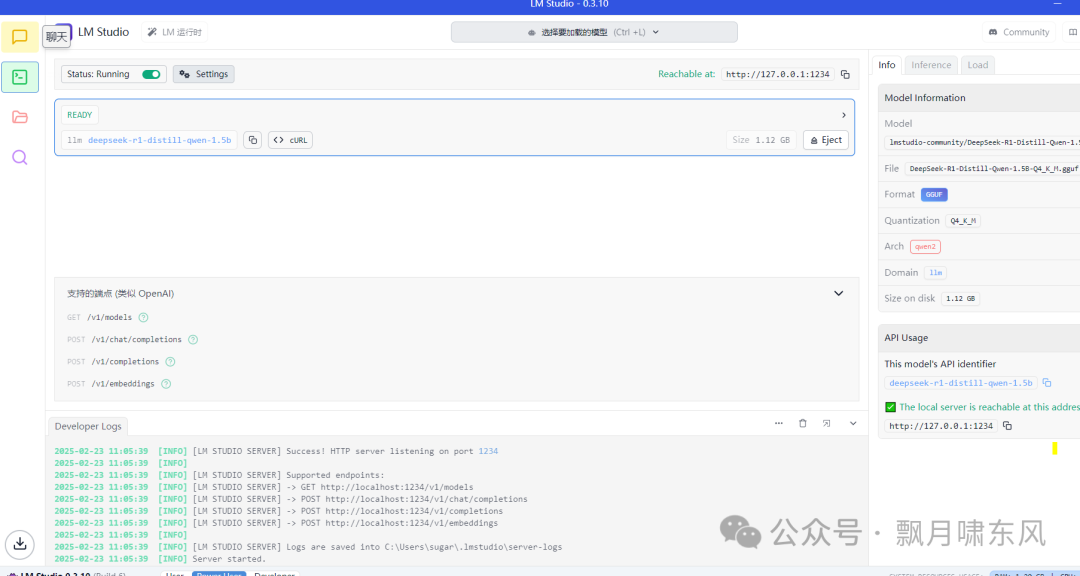

启动模型

打开 LM Studio,进入 开发者 菜单。如果模型状态不是“running”,先将其启动。然后从“Developer log”中找到模型的地址,例如:

复制

2025-02-23 08:51:31 [INFO] [LM STUDIO SERVER] -> POST http://localhost:1234/v1/chat/completions -

生成请求消息

打开任意一个 AI 工具(不要用你本地部署的那个),比如 Kimi,输入以下内容:编写一个 POST 消息,消息内容是‘你好’,模型地址为 POST

http://localhost:1234/v1/chat/completions,使用工具 Postman。AI 工具会生成如下消息内容:

JSON复制

{ "messages": [ { "role": "user", "content": "你好" } ] } -

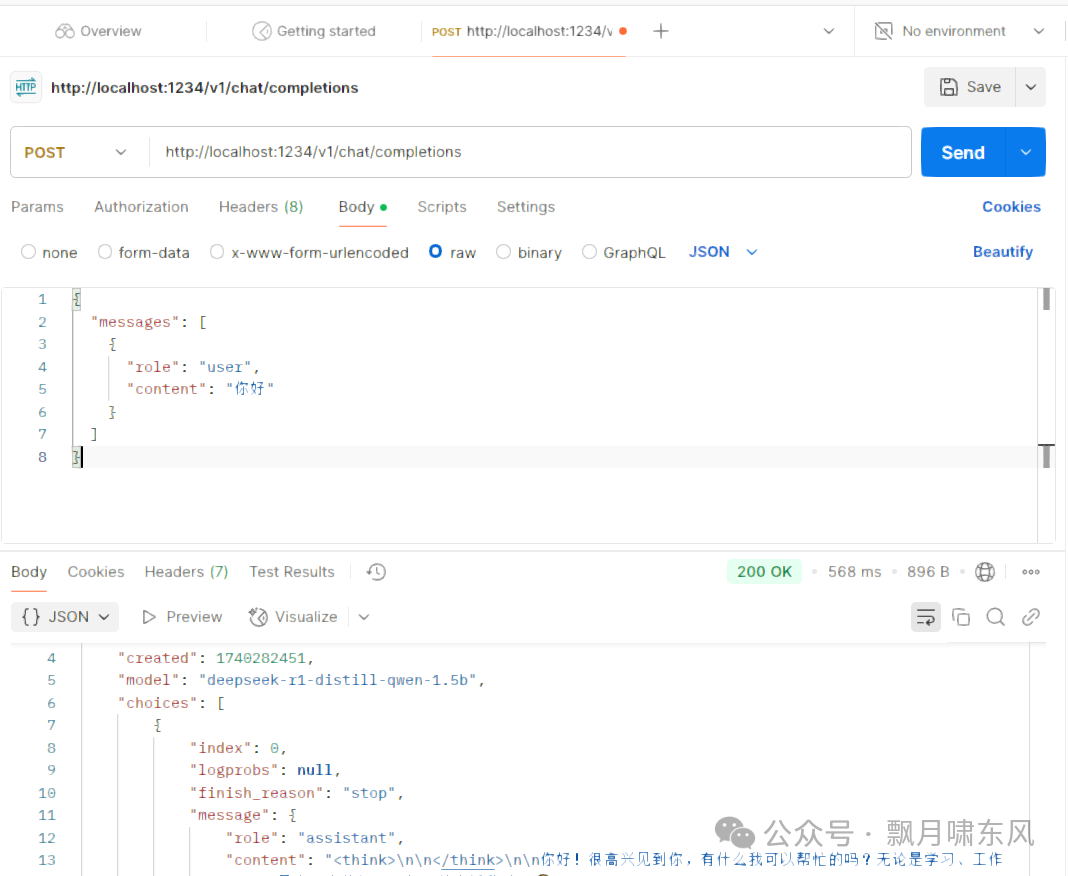

发送请求

打开 Postman(免费的,首次使用需注册,也可以安装绿色版),点击“Send an API Request”,填入模型地址,选择方法为 POST,在 body-raw 中填入上述消息内容,点击发送。下方即可显示模型返回的内容,LM Studio“开发者”菜单的“Developer log”中也会显示消息收发记录。

这种测试方法同样适用于公有的大模型,但由于涉及用户管理,消息的 Headers 中需要加上 API Key。这里就不示范了,有兴趣可以咨询 Kimi,它会给出详细指引。

三、使用 Python 代码创建一个 Web 应用访问本地大模型

上一步提到,我们通常通过一个 APP 或 Web 应用访问模型。现在,我们尝试在电脑上开发这个 Web 应用。虽然我们一行代码也不用写,但是要准备好以下工具:Python、PyCharm 和 通义灵码。如何安装这些依赖可以问 Kimi。

创建 Web 应用

- 安装依赖

确保你已经安装了 Python 和 PyCharm。

-

Python 官网:https://python.org

-

PyCharm 官网:https://www.jetbrains.com/pycharm/

-

通义灵码官网:https://lingma.aliyun.com/download

-

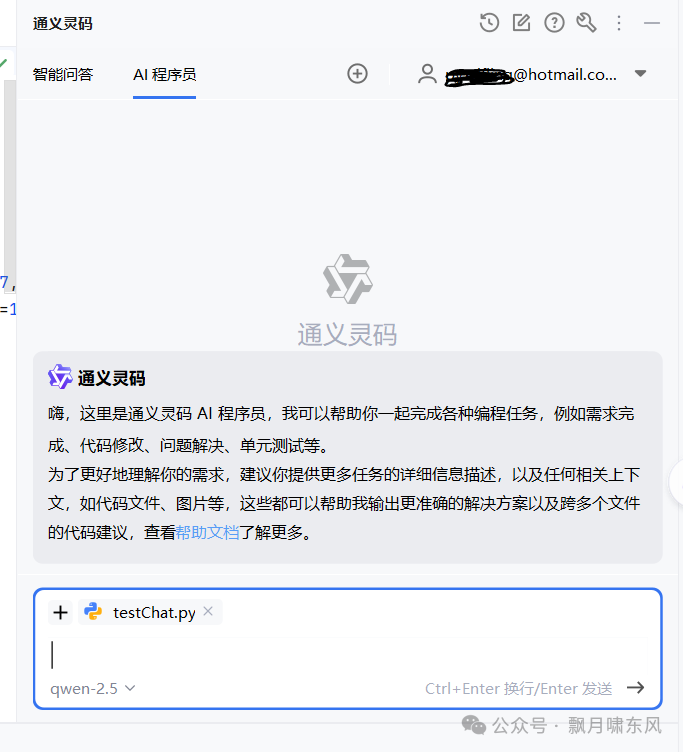

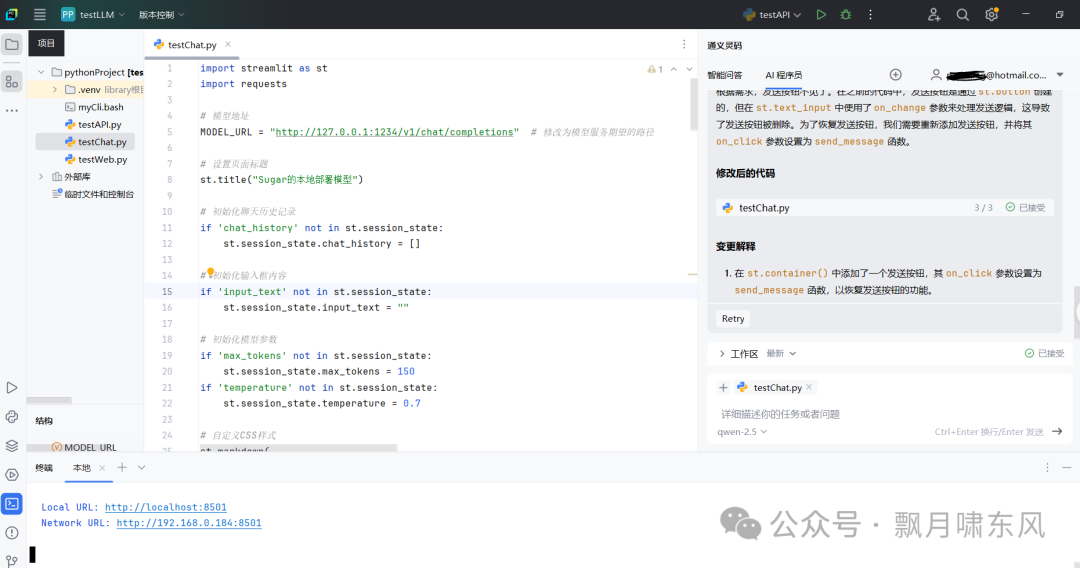

创建API测试代码

打开 PyCharm,在测试项目中创建一个名为testAPI.py的 Python 文件。在 通义灵码 的 AI 程序员框中输入第二步测试 API 的提示词,通义灵码会将代码生成到

testAPI.py文件中。点击“接受”后,运行该代码。一开始可能不符合用户要求,调整几次后就能得到正确结果,比如告诉它“打印输出结果”“缺乏主函数”等。运行代码后模型返回的内容会在命令行中显示。 -

创建 Web 应用代码

确定 Python 能正确调用本地大模型的 API 后,创建一个名为

testChat.py的 Python 文件,让通义灵码的 AI 编程功能为我们写一个简单的 Web 应用。

示例提示词

帮我写一个用Streamlit创建的Python程序,作用是与本地的deepseek模型做交互,聊天框左侧加入模型参数调节的界面,模型地址http://127.0.0.1:1234/v1/chat/completions。

Note:Streamlit 是一个用于快速构建数据应用的开源 Python 库,由 Streamlit 公司开发并维护。它极大地简化了从数据脚本到交互式 Web 应用的转化过程。

- Streamlit 官网:https://streamlit.io

运行 Web 应用

-

运行代码

在命令行中使用以下命令运行程序:cmd

streamlit run testChat.py -

调试代码

如无意外,最初几次运行你会收获一堆报错,把错误信息贴给 AI 编程工具,调试几轮后,就能得到一个简陋但可用的聊天框。后续可以慢慢设计界面和增加功能。

Pycharm界面:

代码比较长就不贴了,有需要可后台索取。

效果如下:

总结

通过上述步骤,你可以在个人电脑上轻松运行大模型,并通过 HTTP API 或 Web 应用与模型进行交互。今天的内容就先分享到这里了,谢谢!

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献110条内容

已为社区贡献110条内容

所有评论(0)