使用ollama本地部署deepseek,并实现接口调用,大模型入门到精通,收藏这篇就足够了!

学习大模型的本地部署能够让你对模型的运行流程更加了解,帮助你了解不同平台和部署环境的优劣以及适用场景。

“ 学习大模型的本地部署能够让你对模型的运行流程更加了解,帮助你了解不同平台和部署环境的优劣以及适用场景。”

在大模型应用中,本地部署模型可以说是一个非常重要的环节,特别是对一些数据安全性较高的企业;因为使用第三方模型服务,会存在数据泄露的问题,因此很多企业选择本地部署模型。

而且很多企业在招人时,也会要求有大模型本地部署的经验;所以,今天我们就来学习一些大模型的本地部署,使用ollama部署工具。

大模型的本地部署

关于大模型的部署问题,目前市场上有很多部署推理工具,如vllm,sglang,ollama,LLMStudio等等;不同的部署框架适合不同的应用场景,有些框架适合学习和小规模开发测试使用,如ollama,LLMStudio等;而有些适合企业级生成部署,如vllm,DeepSpeed等。

以我们今天使用的ollma框架为例,由于其小巧简单,因此很适合学习和测试使用;并且,其提供了多种交互接口,包括命令行——cli,GUI和API接口。

官网地址如下:https://ollama.com/

并且,ollama支持多种系统平台,如window,mac,linux等;直接选择自己的系统平台点击下载即可。

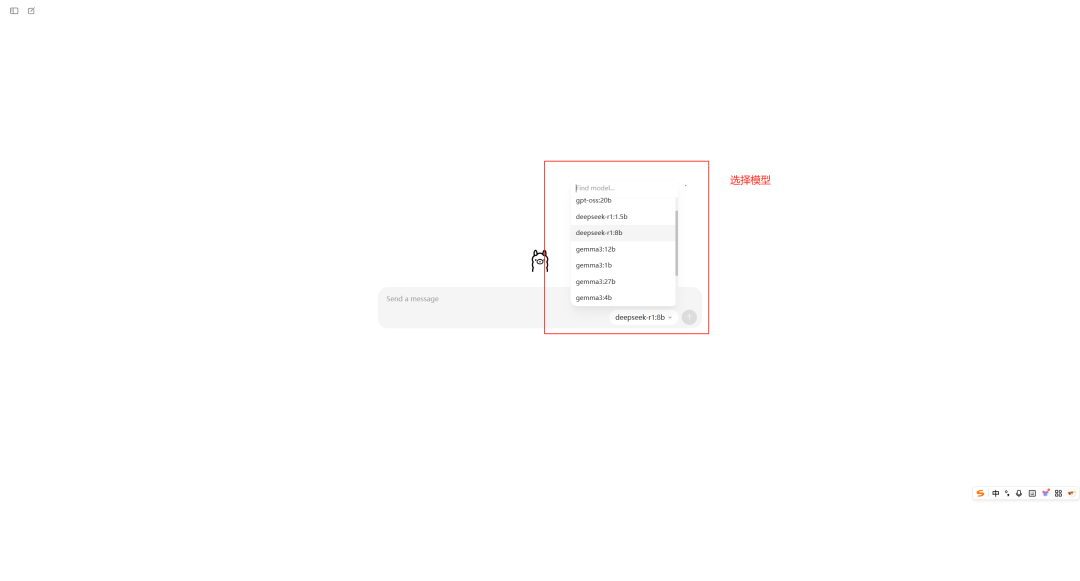

下载之后直接启动就是一个GUI的页面,用户可以在右下角选择需要使用的模型,然后下载即可;当然也可以在命令行进行操作。

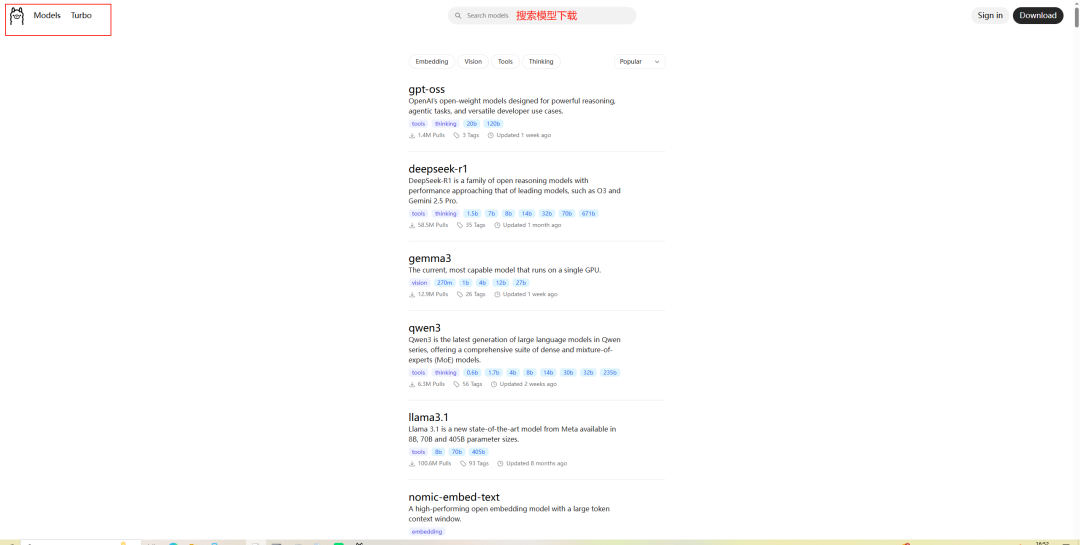

而ollama支持的模型,也可以点击右上角的Models查看,里面支持大量 的模型。

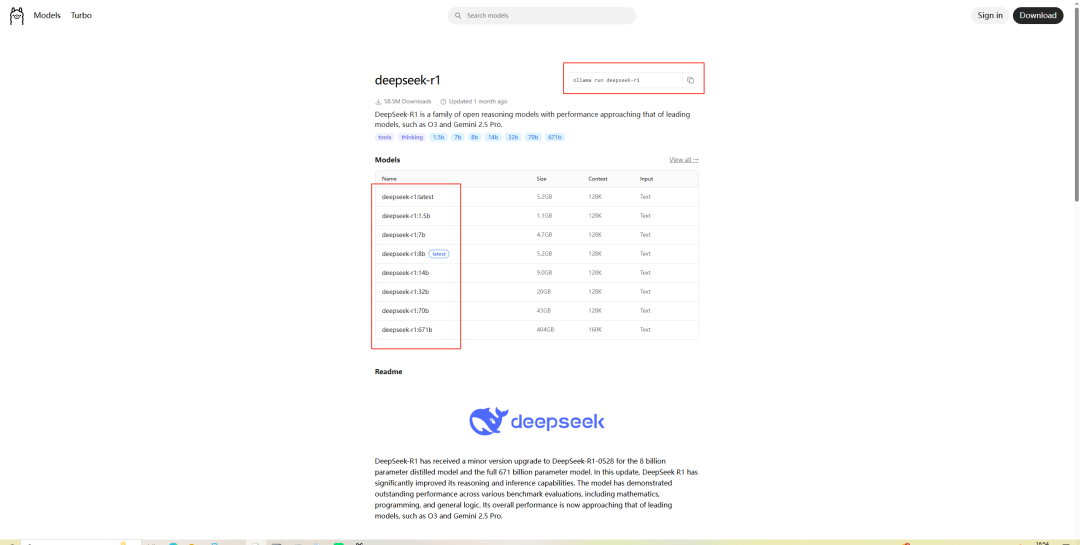

搜索模型之后点击进去就能看到模型具体的下载命令,可以根据自己需要的版本进行选择:

由于作者的电脑没有GPU,因此就选择deepseek的小模型进行测试,ollama run命令会直接从ollama仓库下载模型,当然用户也可以自己手动下载之后直接启动,这样就不用等待下载时间了。

模型会在第一次加载时需要下载,如果已经下载过就不会在此下载;不过这里有一个注意点就是,由于模型较大,少则几个G起步,多则几十个G,上不封顶,因此一定要选择一个大的磁盘才行。

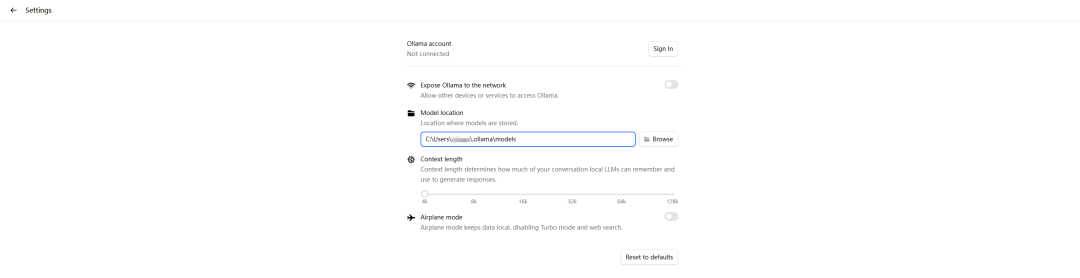

ollama默认下载地址:C:\Users\用户名.ollama\models,用户可以自行修改, 左上角选择setting即可进入设置页面:

当模型下载成功之后,就可以通过ollama ps命令查看运行中的模型。

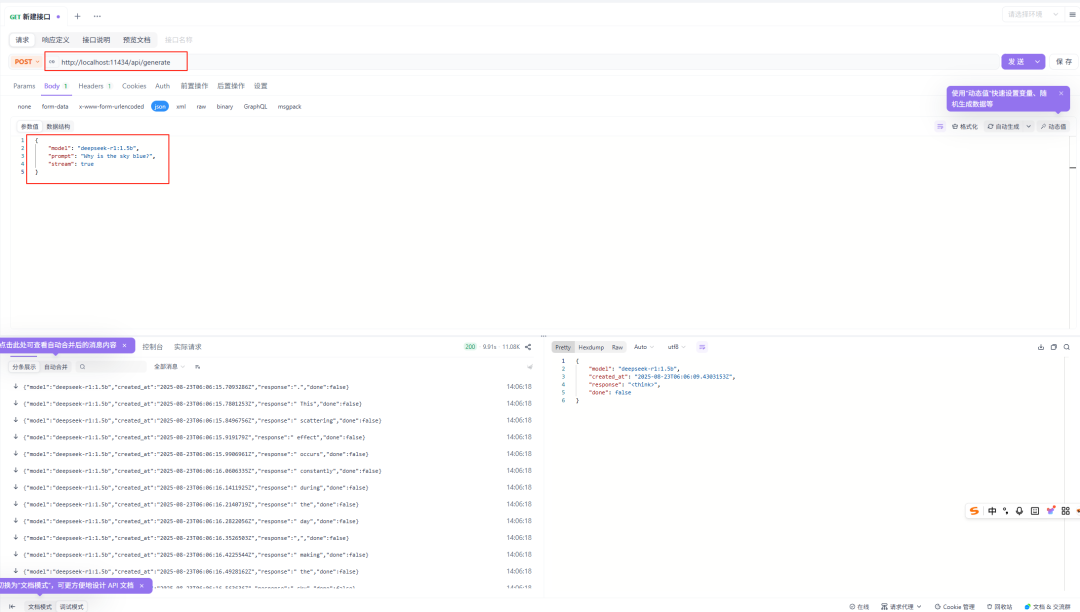

前面讲了ollama的基本使用和下载方式,但对于开发者来说,我们需要的是通过API来访问模型,因此怎么使用API服务才是最重要的。

在ollama中封装了模型的API服务,不需要我们编写任何服务端代码;

这个是ollama的api文档:

英文版: https://github.com/ollama/ollama/blob/main/docs/api.md

中文版: https://ollama.readthedocs.io/api/

ollama的默认启动地址是 http://localhost:11434,可以使用curl对接口进行测试:

curl http:

//localhost:11434/api/generate -d

'{

"model"

:

"llama3.2"

,

"prompt"

:

"Why is the sky blue?"

,

"stream"

:

false

}'

当然,也可以通过apifox等api测试工具进行测试,不过这里需要注意的一点是ollama默认启动的api服务只能本地访问,如果想通过网络进行远程访问,在保证网络通的前提下,还需要对ollama的环境进行配置。

环境变量配置:

OLLAMA_HOST=0.0.0.0:11434

windows中ollama的环境变量配置和java sdk的配置相同;而mac和linux用户可以自行搜索。

开发人员可以根据ollama提供的接口文档,基于ollama做业务开发。

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献35条内容

已为社区贡献35条内容

所有评论(0)