DeepSeek‑V4预览版正式发布:百万上下文普惠时代来临

2026 年 4 月 24 日,DeepSeek 全新系列模型 DeepSeek‑V4 预览版正式上线并同步开源,以百万字超长上下文、顶尖 Agent 能力、世界知识与推理性能,宣告开源大模型迈入高效普惠的长上下文新纪元。

DeepSeek‑V4预览版正式发布:百万上下文普惠时代来临

2026 年 4 月 24 日,DeepSeek 全新系列模型 DeepSeek‑V4 预览版正式上线并同步开源,以百万字超长上下文、顶尖 Agent 能力、世界知识与推理性能,宣告开源大模型迈入高效普惠的长上下文新纪元。

一、双版本齐发:性能与效率兼顾

DeepSeek‑V4 推出两大版本,覆盖专业级与轻量化场景,均原生支持1M 上下文,并开放对话、API 与开源部署,满足不同用户的多样化需求。

| 模型 | 总参数 | 激活参数 | 预训练数据 | 上下文长度 | 定位 |

|---|---|---|---|---|---|

| DeepSeek‑V4‑Pro | 1.6T | 49B | 33T | 1M | 专业旗舰,比肩顶级闭源 |

| DeepSeek‑V4‑Flash | 284B | 13B | 32T | 1M | 高效轻量,经济快捷之选 |

用户可登录chat.deepseek.com或官方 App 体验;API 服务同步更新,将 model_name 设为对应版本即可调用。

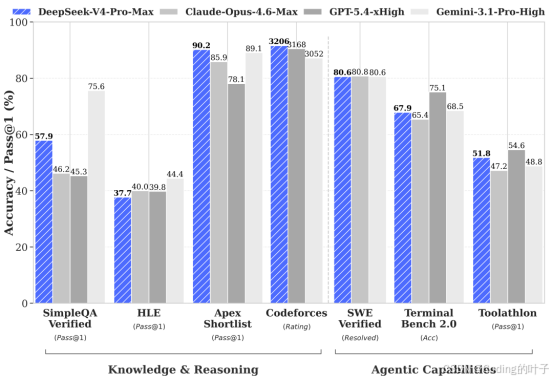

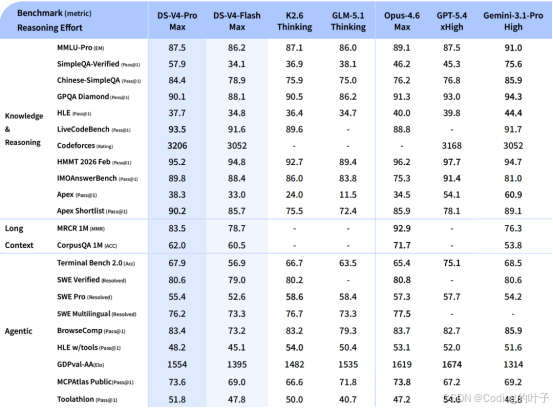

二、Pro 版:性能登顶,对标国际闭源第一梯队

1. Agent 能力全面跃升

Agentic Coding 达开源模型最佳水平,内部实测体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,适配主流 Agent 生态,代码与文档生成能力显著强化。

2. 世界知识储备领先

知识测评大幅领跑开源阵营,仅小幅落后 Gemini‑3.1‑Pro,知识准确性与覆盖度再上新台阶,能更好地满足各类知识查询与应用需求。

3. 推理性能突破天花板

数学、STEM、竞赛代码、SWE Bench 等基准超越所有公开开源模型,MMLU‑Pro、SimpleQA‑Verified、Codeforces 等关键指标跻身全球第一梯队,与 GPT‑5.4、Claude‑Opus‑4.6、Gemini‑3.1‑Pro 同台竞技,展现出强劲的推理实力。

4. Agent 能力专项优化

DeepSeek-V4针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent产品进行了专项适配和优化,摒弃了“让生态适配模型”的传统思路,转而让模型主动适配生态,背后是对Agent场景真实需求的深入理解,也是开源模型在商业化路径上逐渐成熟的体现。下图为 V4-Pro 在某 Agent 框架下生成的 PPT 内页示例:

三、Flash 版:轻量高效,普惠首选

V4‑Flash 知识储备略低于 Pro 版,但推理能力接近 Pro,参数与激活更小,响应更快、成本更低,是轻量化场景的最优选择。

-

简单 Agent 任务与 Pro 版旗鼓相当,能高效完成基础 Agent 操作

-

高难度任务存在合理差距,更适合基础场景使用

-

适合批量推理、轻量化集成与普惠场景,性价比突出

四、技术突破:百万上下文低成本普惠

DeepSeek‑V4 以创新架构破解长上下文 “算力瓶颈”,让百万上下文能力实现低成本普惠,推动长文本应用场景升级:

-

首创Token 维度压缩+DSA 稀疏注意力,长文本计算与显存占用大幅下降,降低使用门槛

-

1M 上下文成为官方服务标配,无需额外付费升级,真正实现普惠

-

兼顾长文本理解精度与推理效率,法律、科研、政企文档等场景体验革命,解锁更多长文本应用可能

五、API 与开源:开放生态,全面落地

1. API 服务与定价

兼容 OpenAI ChatCompletions、Anthropic 接口,base_url 不变,仅修改 model_name,方便用户快速切换使用。

| 模型 | 输入(缓存命中) | 输入(缓存未命中) | 输出 | 上下文 |

|---|---|---|---|---|

| V4‑Pro | 1 元 | 12 元 | 24 元 | 1M |

| V4‑Flash | 0.2 元 | 1 元 | 2 元 | 1M |

注意事项:Pro 版当前吞吐有限,下半年昇腾 950 超节点批量上线后价格将大幅下调;旧接口 deepseek‑chat、deepseek‑reasoner 将于 2026 年 7 月 24 日停用,现阶段分别映射 V4‑Flash 非思考 / 思考模式。

2. 开源与本地部署

模型权重已在 Hugging Face、魔搭开放,技术报告同步发布,支持企业私有化部署与社区二次创新,助力开发者快速落地应用。

六、写在最后

从长上下文技术突破到双版本普惠,DeepSeek‑V4 以技术创新推动大模型从 “可用” 走向 “好用、易用、安全用”,打破长上下文应用的算力与成本壁垒。

未来,团队将持续深耕推理、Agent 与长文本能力,以长期主义迈向 AGI,与开发者、用户共筑开放、高效、安全的 AI 生态,让大模型技术真正服务于各类场景、惠及更多用户。

本文参考:https://mp.weixin.qq.com/s/8bxXqS2R8Fx5-1TLDBiEDg。详细介绍来源于“龙虾实验室”社区(longxialab.cn)。龙虾实验室包含大量入门教程和龙虾应用资源,是个很不错的龙虾资源聚合平台。

我们也可以在字节的扣子平台调用DeepseekV4或者部署龙虾。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)