LM Studio本地安装部署deepseek模型,超简单

LM Studio 是一个用于本地运行大型语言模型(LLMs)的工具,而 DeepSeek 是一个基于 LLM 的应用或模型。如果你想在本地使用 LM Studio 安装并运行 DeepSeek 模型,

·

LM Studio 是一个用于本地运行大型语言模型(LLMs)的工具,而 DeepSeek 是一个基于 LLM 的应用或模型。如果你想在本地使用 LM Studio 安装并运行 DeepSeek 模型,以下是详细步骤:

1. 安装 LM Studio

首先,下载并安装 LM Studio:

- 访问 LM Studio 的官方网站:LM Studio - Discover, download, and run local LLMs

- 根据你的操作系统(Windows、macOS 或 Linux)下载适合的版本。

- 安装 LM Studio 并启动。

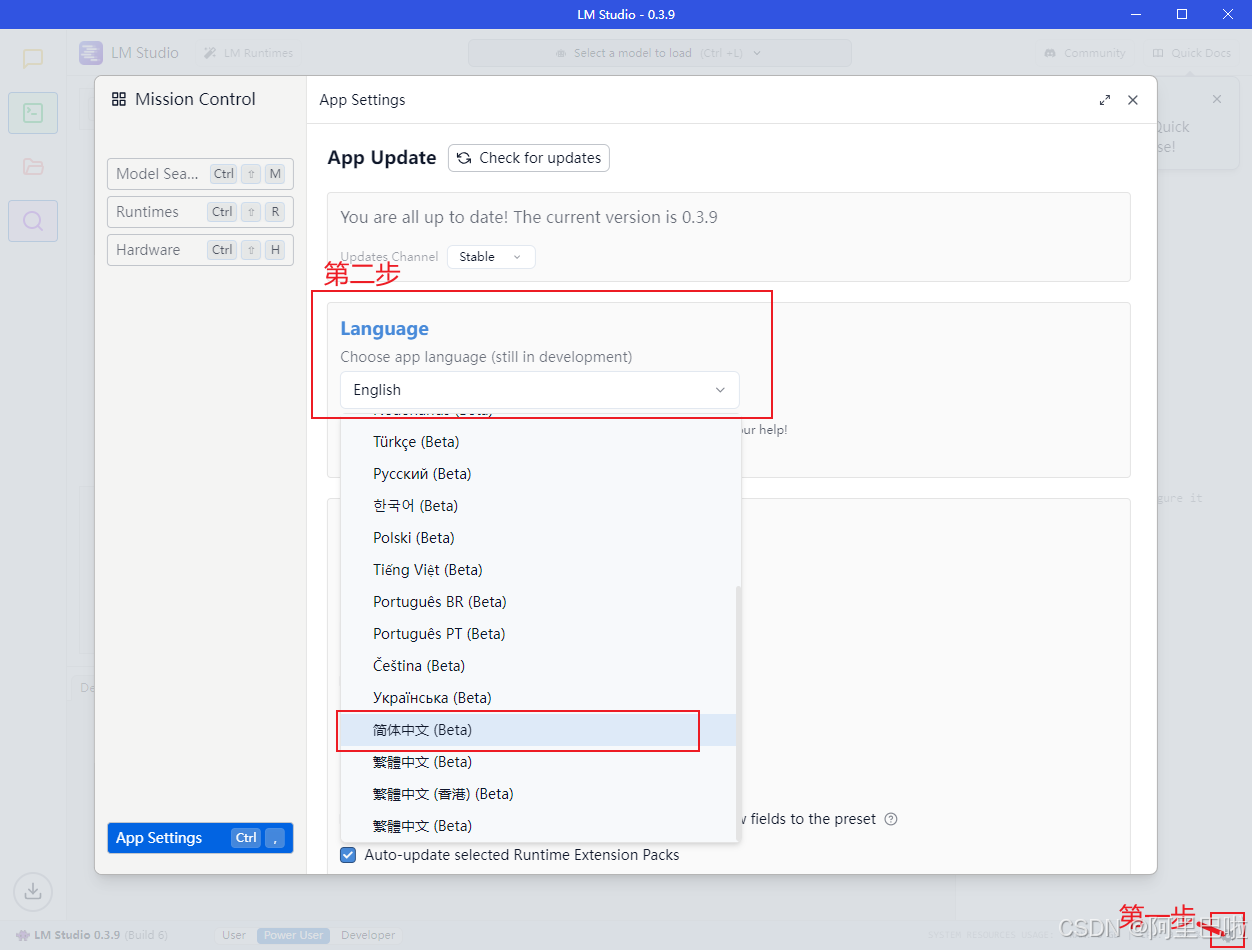

- 可以选择语言根据自己的需要。

2. 下载 DeepSeek 模型

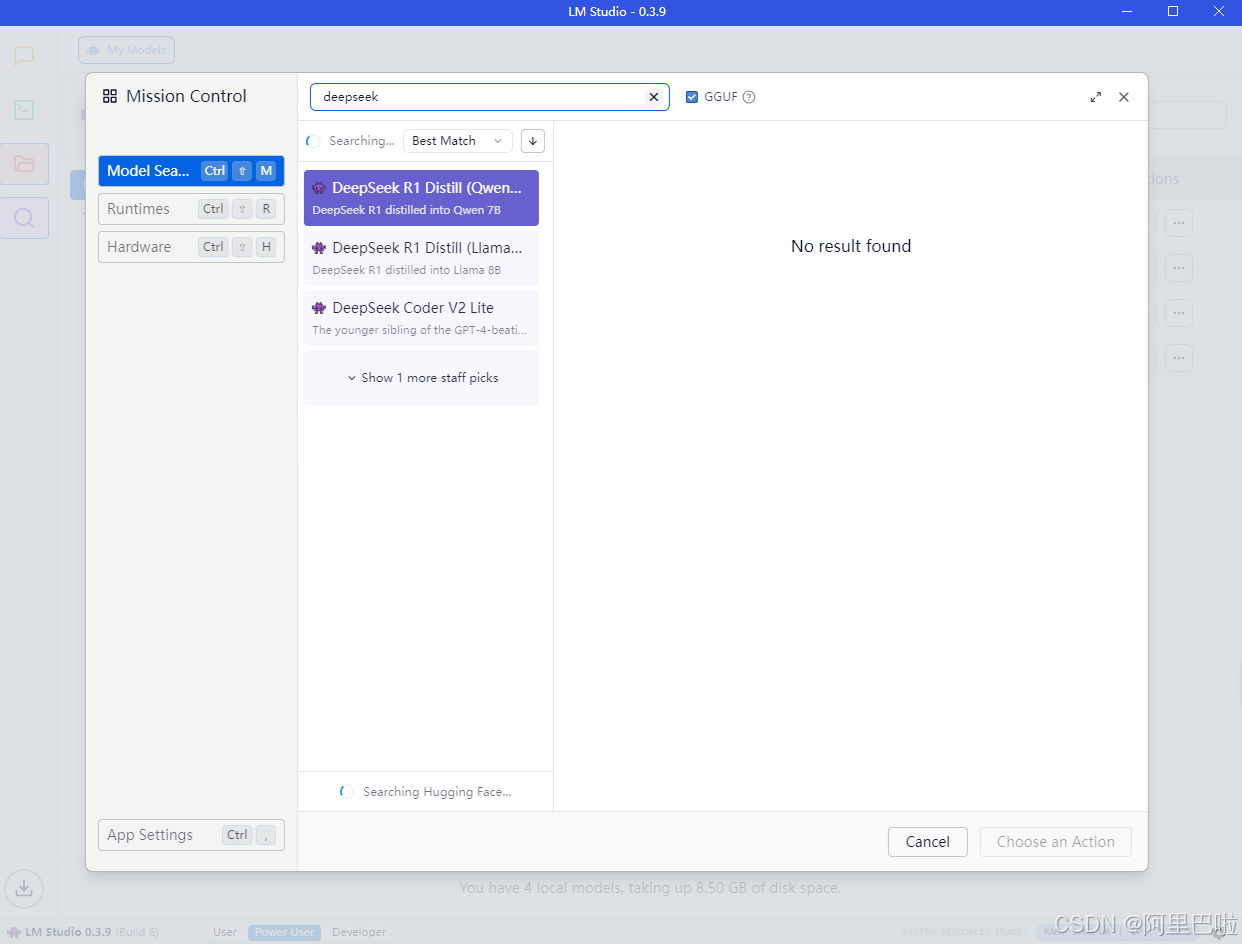

LM Studio 支持加载 Hugging Face 上的模型。你需要下载 DeepSeek 模型的权重文件(通常是 .gguf格式):

- 打开 LM Studio,点击左侧的Search Hugging Face。

- 在搜索框中输入 DeepSeek,找到适合的模型(例如 deepseek 或类似名称)。

- 选择模型并点击Download,等待下载完成。

- 如果没有出现Download,可以本地下载完放到对应文件夹。

- 模型下载地址:https://huggingface.co/,魔搭社区

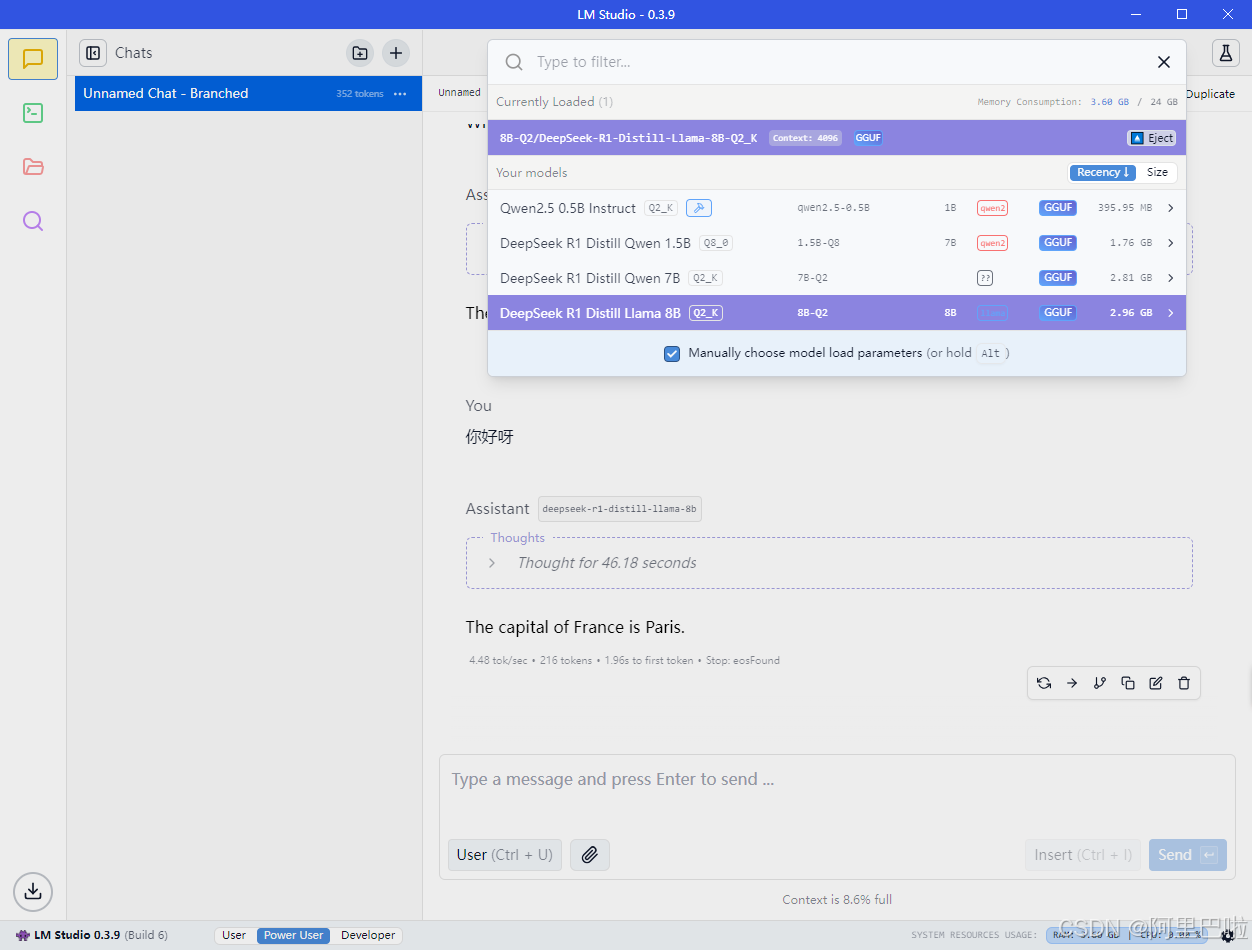

如下图:

3. 加载 DeepSeek 模型

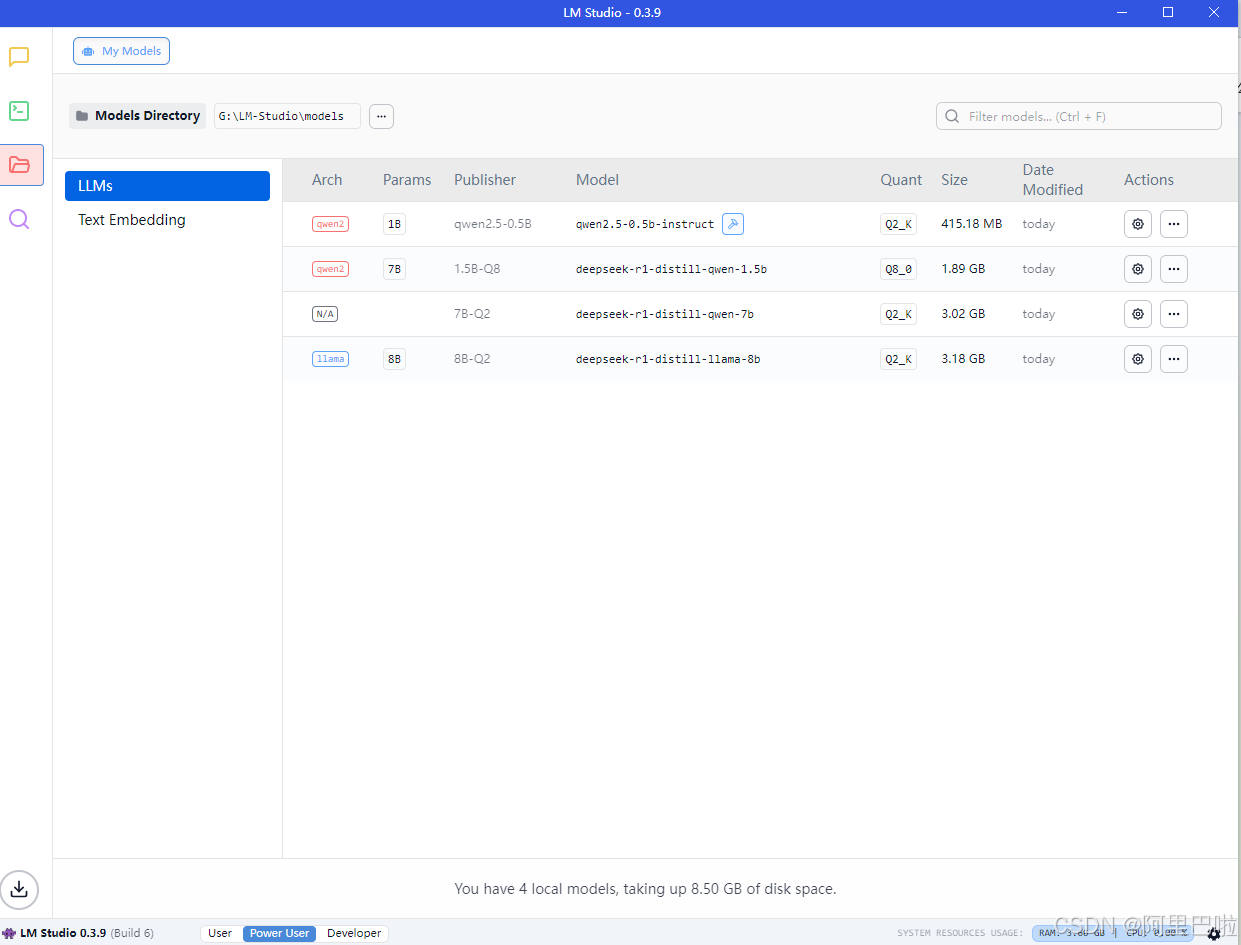

- 下载完成后,在 LM Studio 的 **Local Models** 选项卡中会看到已下载的 DeepSeek 模型。

- 点击模型名称,然后点击Load Model加载模型。

如下图:(我随便下了几个模型进行测试)

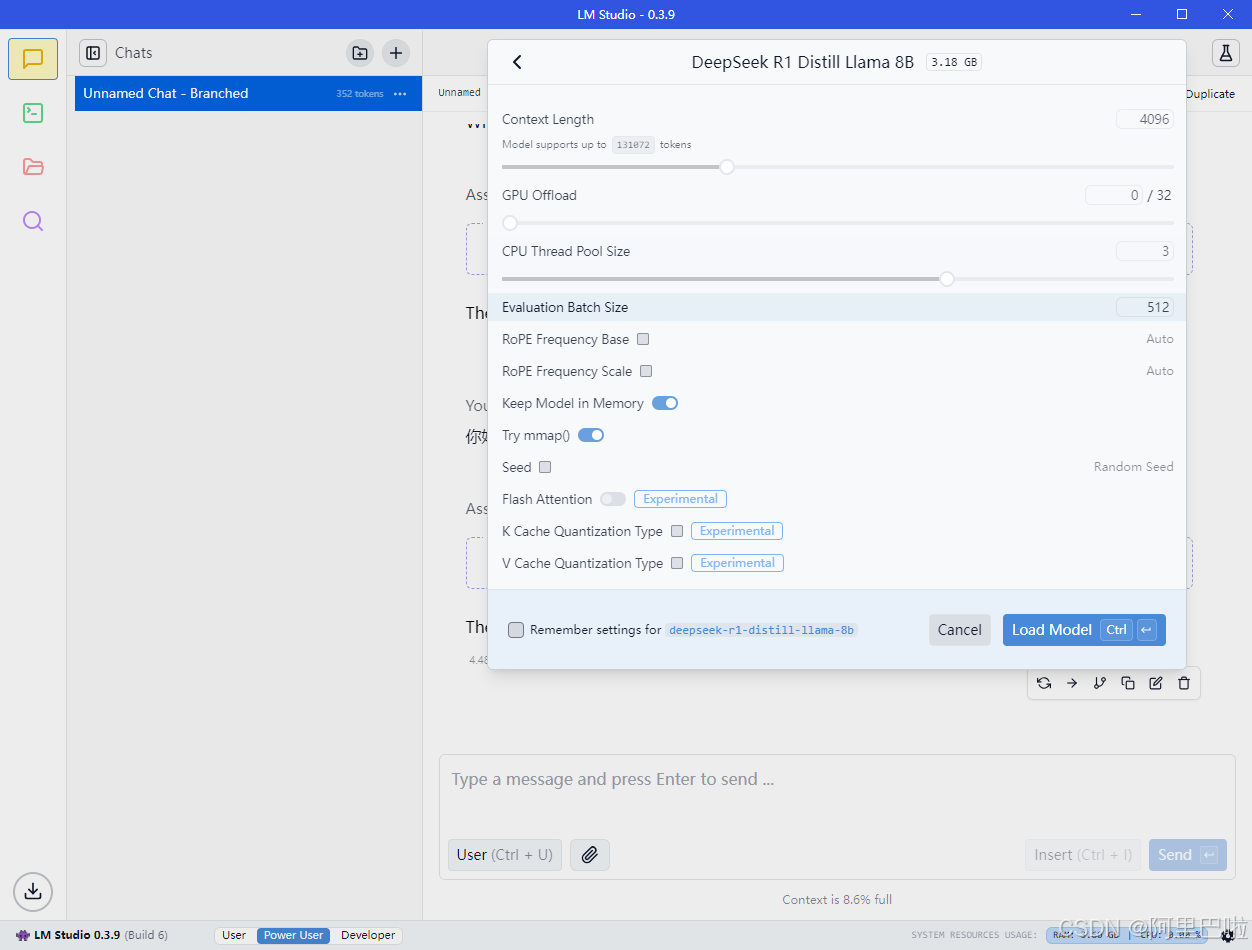

4. 配置模型参数

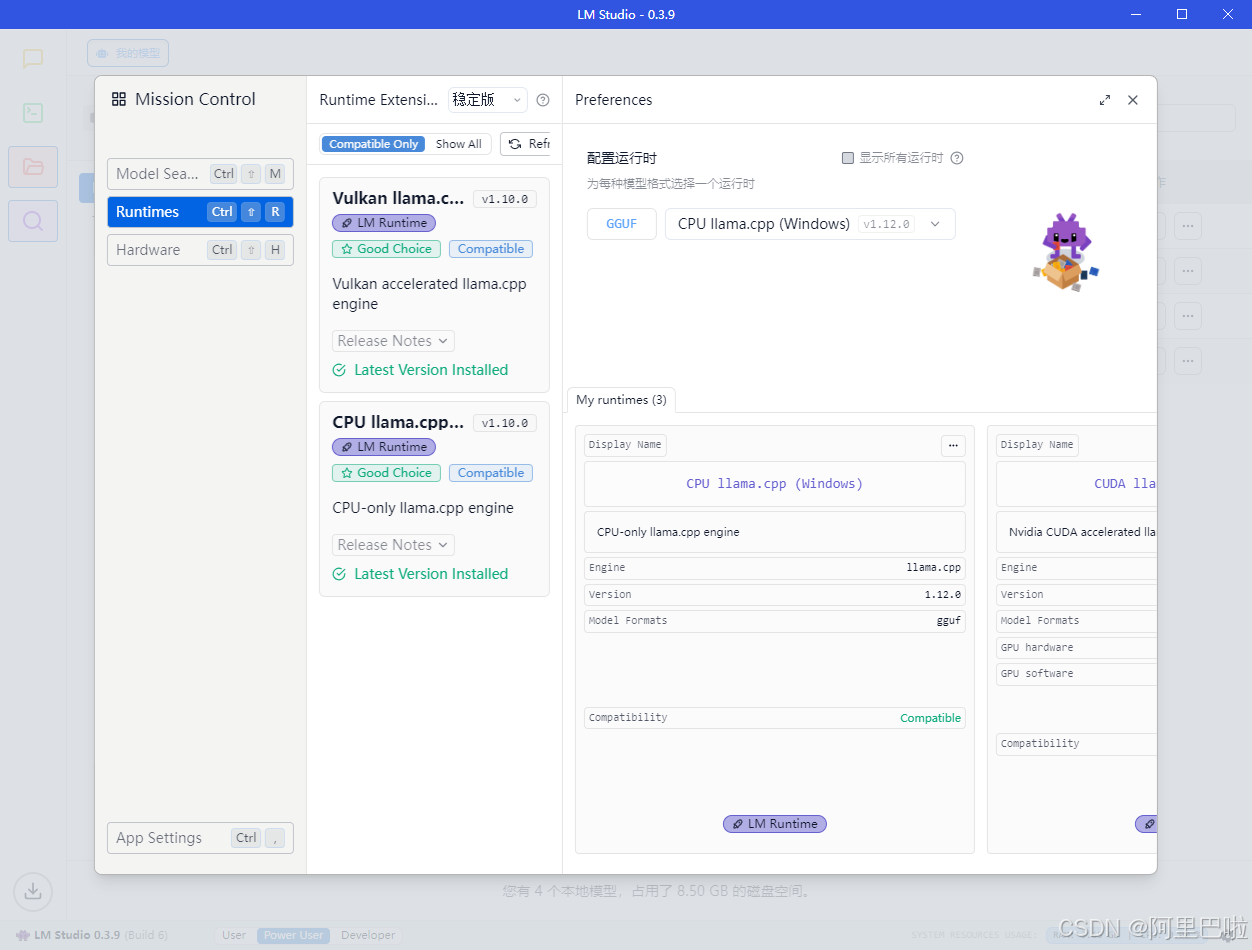

在加载模型后,你可以根据需要调整模型参数:

- 根据你的硬件配置(如 GPU 或 CPU),选择合适的推理后端(如 CUDA、Metal 或 CPU)。

如下图:

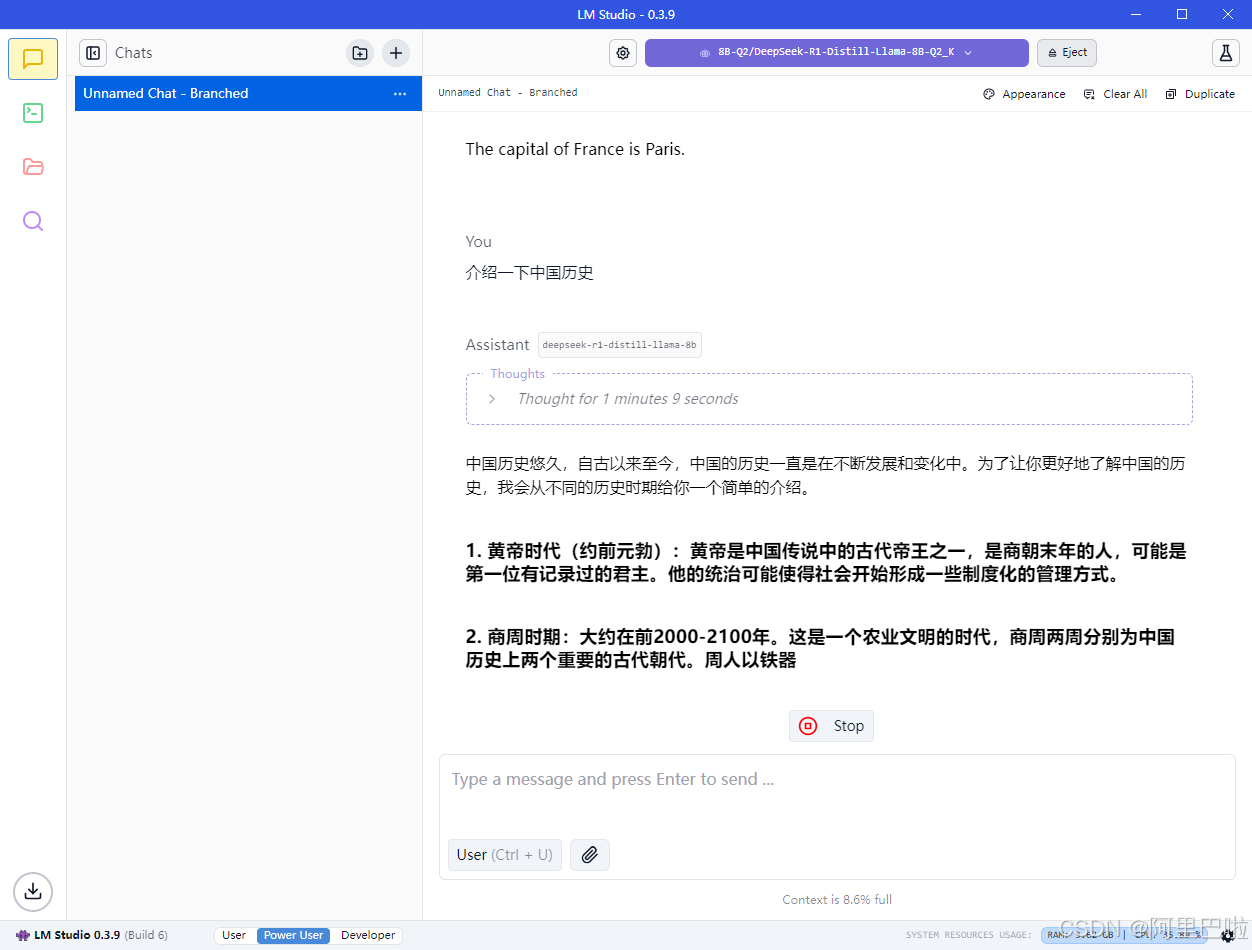

5. 运行 DeepSeek 模型

6. 开始聊天问答

注意事项

- 硬件要求:运行大型语言模型需要较高的硬件配置(如 GPU 和大内存)。如果性能不足,可以尝试量化模型(如 4-bit 或 8-bit 量化)。

- 模型格式:确保下载的模型格式与 LM Studio 兼容(如 .gguf 格式)。

- 更新 LM Studio:定期检查 LM Studio 的更新,以支持更多模型和功能。

通过以上步骤,你可以在本地使用 LM Studio 安装并运行 DeepSeek 模型。

附资料链接:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)