【AI论文】Mask-DPO:大型语言模型的通用化细粒度事实性对齐

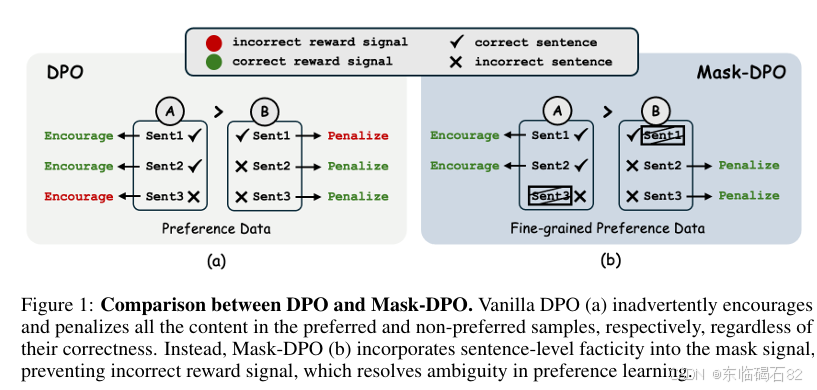

大型语言模型(LLMs)在作为各领域人工智能助手时会出现幻觉现象(即生成不忠实或无意义的信息)。由于LLM的回应中真实内容与幻觉内容总是并存,以往基于回应级别偏好学习的事实性对齐方法不可避免地在训练过程中引入了噪声。因此,本文提出了一种基于直接偏好优化(DPO)的细粒度事实性对齐方法,名为Mask-DPO。该方法将句子级别的事实性作为掩码信号,仅从优选样本中的事实正确句子中学习,并避免对非优选样本

摘要:大型语言模型(LLMs)在作为各领域人工智能助手时会出现幻觉现象(即生成不忠实或无意义的信息)。由于LLM的回应中真实内容与幻觉内容总是并存,以往基于回应级别偏好学习的事实性对齐方法不可避免地在训练过程中引入了噪声。因此,本文提出了一种基于直接偏好优化(DPO)的细粒度事实性对齐方法,名为Mask-DPO。该方法将句子级别的事实性作为掩码信号,仅从优选样本中的事实正确句子中学习,并避免对非优选样本中的事实内容进行惩罚,从而解决了偏好学习中的模糊性问题。大量实验结果表明,尽管训练过程中未见过这些问题及其对应主题,Mask-DPO仍能显著提升LLM对领域内和领域外数据集问题的回应事实性。仅在ANAH训练集上训练后,Llama3.1-8B-Instruct在ANAH测试集上的得分从49.19%提高到77.53%,甚至超过了Llama3.1-70B-Instruct的得分(53.44%),同时其在领域外的Biography数据集上的FactScore也从30.29%提高到39.39%。我们进一步研究了使用不同训练样本缩放策略时Mask-DPO的泛化性能,发现增加数据集中的主题数量比增加问题数量更为有效。我们就事实性对齐在LLM中的作用、这一现象的含义提出了假设,并进行了概念验证实验加以证实。我们希望本文提出的方法和发现能为未来事实性对齐的扩展研究奠定基础。Huggingface链接:Paper page,论文链接:2503.02846

一、引言

大型语言模型(LLMs)在各种任务中展现了令人印象深刻的性能,但它们仍面临一个关键问题:幻觉现象。幻觉现象指的是LLMs生成听起来合理但实际上不准确或无意义的信息,特别是在需要广泛知识的用户查询中。幻觉现象的两个主要特征显著阻碍了LLMs在现实世界中的应用:一是幻觉信息总是与真实内容并存于LLM的回应中,这使得准确有效地检测和缓解幻觉变得具有挑战性;二是LLMs在不同领域和任务中都会出现幻觉,但彻底缓解所有现实世界知识中的幻觉是不切实际且困难的。因此,开发有效且通用化的细粒度事实性对齐方法来减少LLMs中的幻觉现象变得尤为重要。

二、背景与相关工作

1. 事实性对齐方法

现有方法主要应用基于偏好学习的方法,特别是直接偏好优化(DPO),来对齐LLMs的内部知识与事实。这些方法利用回应级别的事实性来构建成对偏好数据,旨在最大化具有更高事实性的优选样本的概率,同时最小化具有较低事实性的非优选样本的概率。然而,由于事实正确和错误的句子通常混合在同一个回应中,传统的DPO方法会不经意地鼓励优选样本中的错误信息,并惩罚非优选样本中的正确信息,从而导致训练过程中的模糊性,降低了事实性对齐的有效性。

2. 强化学习从人类反馈(RLHF)

RLHF是一种强大的对齐方法,用于微调语言模型以增强其鲁棒性、事实性和安全性。然而,训练一个奖励模型并将其集成到整体管道中可能非常复杂。为了避免这一问题,Rafailov等人提出了DPO,它直接使用成对偏好数据来优化策略模型。

3. 幻觉缓解技术

为了缓解幻觉现象,研究人员探索了多种技术,包括多任务学习、模型编辑和事实性对齐等。然而,这些方法大多只检测问题而不提供解决方案,或者只使用回应级别的事实性作为稀疏奖励信号,导致事实性对齐效果有限。

三、Mask-DPO方法

为了解决传统DPO方法的局限性,本文提出了一种基于DPO的细粒度事实性对齐方法,名为Mask-DPO。该方法通过结合句子级别的事实性作为掩码信号,实现了对优选样本中事实正确句子的学习,并避免了对非优选样本中事实内容的惩罚,从而解决了偏好学习中的模糊性问题。

1. 细粒度偏好数据构建

在偏好数据构建阶段,Mask-DPO使用细粒度的幻觉注释器(如ANAH-v2)来确定每个句子的事实正确性,这将用于指导后续的偏好学习。回应中包含更多和更少事实正确句子的回应将分别被选择为优选和非优选样本,形成偏好对进行学习。

2. 细粒度偏好学习

在偏好学习阶段,Mask-DPO使用构建好的细粒度偏好数据对策略模型进行微调。通过忽略训练中的模糊性句子,即优选样本中的错误句子和非优选样本中的正确句子,Mask-DPO避免了鼓励错误信息和惩罚正确信息的风险。具体来说,Mask-DPO设计了一个掩码方案,该方案仅对优选样本中的事实正确句子和非优选样本中的事实错误句子应用KL散度损失。

四、实验与结果

1. 实验设置

实验采用Llama3.1-8B-Instruct作为基线模型,ANAH-v2作为细粒度奖励模型来注释事实性。实验数据集包括领域内的ANAH-v2子集和领域外的Biography子集。评价指标包括ANAH-v2和FactScore,分别用于领域内和领域外数据的评价。

2. 实验结果

领域内数据评价

在领域内数据上,Mask-DPO显著提高了LLMs回应的事实性。在ANAH-v2评价指标下,Mask-DPO的得分从49.19%提高到77.53%,超过了所有开源模型和事实性对齐方法FactTune。在FactScore评价指标下,Mask-DPO也达到了最高的事实性得分(25.56%)。

领域外数据评价

在领域外数据上,Mask-DPO同样表现出色。尽管没有使用对应的训练集,Mask-DPO仍然将Llama3.1-8B-Instruct在Biography数据集上的FactScore从30.29%提高到39.39%,接近最佳开源模型Llama3.1-70B-Instruct的得分(40.47%)。

3. 消融研究

掩码方案的影响

实验结果表明,使用掩码方案的Mask-DPO在两种评价指标下均显著优于不使用掩码方案的DPO,证明了掩码方案的有效性。

采样策略的影响

实验还研究了不同数据采样策略对模型性能的影响。结果显示,从策略模型(Llama)中采样数据构建偏好对的效果最好,而从非策略模型(InternLM)中采样数据的效果较差。此外,当为优选和非优选样本使用不同的上下文时,模型性能甚至低于基线模型。

五、Mask-DPO的泛化性能研究

为了研究Mask-DPO的泛化性能,实验分析了不同训练样本缩放策略的效果。结果显示,增加数据集中的主题数量比增加问题数量对模型性能的提升更为显著。这表明主题的多样性对于提高模型的事实性和泛化能力更为重要。

六、假设与验证

基于实验结果,本文提出了一个假设:LLMs在训练过程中学习了一个模型特定的图状知识结构,其中不同的主题和对应的信息可以看作是图中的节点,节点之间的亲密度决定了当LLMs回答与某个主题相关的问题时,它们各自知识混淆的概率。事实性对齐对某个主题的影响会通过图结构传播到其他主题,特别是与之相近的主题。

为了验证这一假设,本文设计了概念验证实验。实验结果表明,当对某个主题进行事实性对齐时,与之相近的主题上的事实性得分提高更为显著。此外,通过比较模型在训练前后的最佳N个回应的性能,发现事实性对齐确实对LLMs的内部知识结构产生了影响,而不仅仅是改变了生成正确内容的概率分布。

七、结论与未来工作

本文提出了一种基于DPO的细粒度事实性对齐方法Mask-DPO,通过结合句子级别的事实性作为掩码信号,显著提高了LLMs回应的事实性。实验结果表明,Mask-DPO在领域内和领域外数据上均表现出色,并且具有良好的泛化性能。此外,本文还提出了一个关于LLMs内部知识结构的假设,并通过概念验证实验加以证实。

未来工作可以进一步探索更细粒度的幻觉注释器,如基于子句、名词短语或动词短语的注释器,以进一步提高事实性对齐的效果。同时,也可以研究如何将Mask-DPO应用于其他类型的LLMs和更大规模的数据集上。此外,还可以深入探究Mask-DPO对其他LLM能力的影响,如数学推理和代码生成等。

更多推荐

已为社区贡献76条内容

已为社区贡献76条内容

所有评论(0)