组织中代理型人工智能的感知:负责任AI和投资回报率的影响

随着人工智能(AI)系统迅速获得自主性,建立强大的负责任AI框架变得至关重要。本文研究了组织在日益复杂的代理型AI出现时如何感知和适应这些框架。通过采用解释性定性方法,该研究探讨了AI专业人士的生活经历。研究结果表明,代理型AI系统的固有复杂性及其负责任的实施方式,源于负责任AI维度和主题框架(从数据中开发出的分析结构)之间的复杂相互联系,再加上代理型AI的新颖性,导致组织适应过程中面临重大挑战,

Lee Ackerman*

人工智能与社会硕士,媒体应用科学大学

2025年4月17日

摘要

随着人工智能(AI)系统迅速获得自主性,建立强大的负责任AI框架变得至关重要。本文研究了组织在日益复杂的代理型AI出现时如何感知和适应这些框架。通过采用解释性定性方法,该研究探讨了AI专业人士的生活经历。研究结果表明,代理型AI系统的固有复杂性及其负责任的实施方式,源于负责任AI维度和主题框架(从数据中开发出的分析结构)之间的复杂相互联系,再加上代理型AI的新颖性,导致组织适应过程中面临重大挑战,表现为知识差距、对利益相关者参与的重视不足以及对控制的强烈关注。这些因素通过阻碍有效的适应和实施,最终影响了负责任AI的潜力和投资回报率(ROI)的实现。

关键词:代理型AI,负责任AI,AI伦理,组织影响,投资回报率(ROI),组织感知,解释性定性研究

1 组织中的代理型AI感知:负责任AI和投资回报率的影响

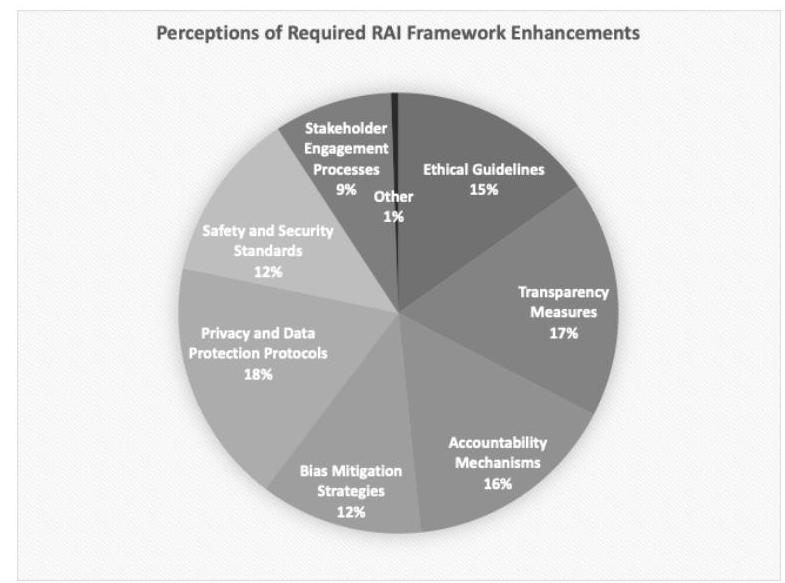

随着人工智能(AI)系统迅速获得自主性,确保其与人类价值观的一致性变得至关重要(Bostrom & Yudkowsky, 2018)。本文探讨了组织如何应对代理型AI的复杂性。负责任AI框架指导AI的道德发展和部署,包括道德准则、透明度措施、问责机制、偏见缓解策略、隐私和数据保护协议、安全和安全标准以及利益相关者参与流程。这些框架受到道德原则(例如,经合组织AI原则;经济合作与发展组织(OECD),2024)和风险管理指南(例如,NIST AI风险管理框架;国家标准与技术研究院,2023)的指导,并将继续根据更广泛的社会技术环境进行演变(Dignum, 2019; Floridi, 2023; MacKenzie & Wajcman, 1999)。

本研究采用解释性定性方法,探索组织如何在日益复杂的代理型AI系统背景下感知和适应这些框架。该研究重点在于解释AI专业人士对在线调查的回应。

代理型AI是一种新型的高度自主和适应性强的AI代理,利用大型语言模型(LLMs)和多模态AI能力展现出以下特点:涌现行为,生成新颖解决方案并适应不可预见的挑战;多模态推理,使其能够处理来自各种来源的信息,如文本、图像和音频;主动性规划,赋予其自主规划和执行复杂任务的能力;持续学习,允许其基于新信息进行适应。本文探讨了组织如何调整其负责任AI框架以适应这一新技术及其独特挑战和机遇。

在AI技术快速发展的背景下,本文研究的核心问题是:组织对代理型AI的感知如何影响其负责任AI实践的实施及其后续的投资回报率(ROI)计算,包括对劳动力技能和能力的考虑?

1.1 叙事背景:文献综述

生成式AI的采用速度超过了过去的个人电脑和互联网技术(Bick, Blandin, & Deming, 2024)。鉴于这种增长和潜在影响,我们的伦理观念——关于对错的理念以及支持性的规范、规则和原则——变得越来越重要(Pflanzer, Traylor, Lyons, Dubljević, & Nam, 2022)。

深入探讨AI与伦理,需要考虑AI的影响,包括其机会和风险(Floridi et al., 2018)。然而,从业者发现伦理理念抽象、开放于解释,并且难以应用于AI,鉴于AI的自主性和对其内部运作缺乏理解(Buijsman, Klenk, & van den Hoven, 2025)。随着AI承担具有社会维度的工作——以前由人类完成的认知工作——继承了相应的人类责任,并引发了关于高级AI潜力的讨论(Bostrom, 2014)。

负责任AI框架指导AI系统的开发、部署和使用,以最大限度地减少潜在危害(Dehghani et al., 2024)。尽管共享诸如透明度、公平性、责任和隐私等共同的伦理原则,但从业者仍在努力解决与解释、重要性和实施相关的细节差异(Jobin, Ienca, & Vayena, 2019)。负责任AI模式目录强调了识别反复问题的已证明解决方案的努力,同时提供可扩展和适应的结构,以实现从原则到行动的过渡(Lu et al., 2024)。立法在塑造负责任AI实践中起着关键作用。一个关键例子是欧盟人工智能法案(European Union, 2024),它采取基于风险的方法来监管AI系统的开发和部署。然而,伦理考量超越法律合规。尽管长期讨论潜在危害如偏见,有效行动仍然具有挑战性,导致技术债务(Cunningham, 1992)、伦理债务(如Field, 2024所讨论的),指的是伦理妥协的积累,以及治理债务(Meskarian, 2023),涉及忽视治理结构的长期后果。从理论转向影响并克服这些债务需要大量工作和投资,涵盖组织策略、利益相关者管理和技术方法等领域(Rakova, Yang, Cramer, & Chowdhury, 2021)。

生成式AI作为代理型AI的基础,在可靠性、学习、安全挑战和风险方面存在不足,如偏见、隐私问题和过度依赖(Bengio et al., 2025; OpenAI, 2024)。文化力量也塑造了希望和恐惧,人们在追求便利的同时平衡对过时的恐惧,并寻求克服对AI的焦虑描绘(Bo, Ma’rof, & Zaremohzzabieh, 2024)。这种新旧交织可以通过修复理论(Bolter, 2001)来理解,其中新媒体重新设计和重塑旧形式。代理型AI修复了人类的自主性、沟通和自动化,既带来兴奋也引发焦虑。在理解和不确定性之间导航,需要理解从AI助手到代理型AI的进步,包括其在自主性、推理、适应性、规划和涌现行为方面的进步(IBM公司, 2025; NVIDIA公司, 2023; Russell & Norvig, 2021; Thomas, 2024; 世界经济论坛, 2024)。此外,考察代理型AI的新兴特征——自主性、不完美、动机、创造力——并考虑其作为“行动者”(关系网络中的参与者)在与人类和数字世界的复杂互动中的角色(Kolt, 2025; Li & Zhu, 2024),将引发关于劳动力构成和人类与数字工作者经验的问题(Biilmann, 2025)。

代理型AI为企业提供了变革性机会——以精确和高效的方式实现独特的工作(Bousetouane, 2025)。这种变革价值体现在组织部署众多适应性强、智能且领域特定的代理以支持其需求的过程中(麦肯锡咨询公司, 2024)。尽管可以通过成本节约、收入增长或效率来衡量投资回报率(ROI)(Chia, 2024),但为负责任的代理型AI投资正名需要更广泛的视角,包括重要的工作、时间和资源投入(Bevilacqua, Berente, Domin, Goehring, & Rossi, 2023)。

然而,理解从业者如何在面对代理型AI的独特挑战时实施和调整负责任AI框架存在关键差距。本研究通过考察那些从理论走向实践者的感知和见解,探讨代理型AI创新对工作、企业和社会的影响,解决了这一差距。具体而言,它研究从业者如何感知这一环境,如何推动其组织行动,以及如何衡量其负责任代理型AI实施的ROI。

2 故事讲述过程:研究方法

2.1 研究方法和理由

选择了解释性定性方法以捕捉行业专业人士的丰富视角,优先考虑深入洞察而非统计普遍性。在这个快速发展的领域,这些实际应用提供了有价值的指导,并可能为未来的定量研究提供信息。

本研究通过Microsoft Forms进行了简短的调查,匿名收集数据。采用目的抽样方法针对在北美工作的AI专业人士(员工数5000+或营收$1B+的企业),通过专业网络和LinkedIn招募参与者。目标样本量为40-60名参与者,优先考虑主题饱和和深入洞察而非统计普遍性。

2.2 伦理考量

参与者给予知情同意,并充分了解研究目的、时间投入和数据使用情况。保持匿名,未收集PII,数据存储安全。去标识化、汇总的数据集将通过GitHub共享,结果将以汇总形式呈现。调查避免使用带有偏见的语言,并努力确保多样化的参与。关键术语,包括代理型AI,在调查和词汇表中明确定义。研究设计和伦理考量经过非正式同行评审。

2.3 研究局限性:所选方法的优势与劣势

虽然有助于捕捉深入见解,但定性方法存在局限性。从专业网络中招募意味着研究可能无法捕捉更广泛的观点,缺乏统计普遍性。参与者可能会给出反映组织政策而非个人观点的回答。AI和代理型AI的动态性质及其早期阶段可能限制这些见解的长期价值。此外,围绕数据保护、风险缓解和隐私的负责任AI实践可能以无法量化的方式影响回答。然而,解释性定性方法具有显著优势。它能够在深度和广度之间取得平衡,捕捉细微体验,从而更深入地理解主题。

2.4 研究工具与AI协作

本研究采用了一种协作方法,包括人类研究员、传统方法和生成式AI工具。文献综述使用了Google Scholar、Consensus、arXiv和EBSCO等平台。Gemini、ChatGPT、Copilot和Julius等AI工具协助设计、分析、起草和审查。引用管理使用LaTeX中的apacite包。这种集成方法展示了AI作为研究合作者的潜力,提高了效率和洞察力。

2.5 研究员立场与偏差减轻

作为主要研究员,我负责研究设计和解释,将AI工具作为合作者使用。我的技术从业背景和AI与社会的研究影响了我的方法。为了减轻我和AI生成输出中的偏差,我采用了多种策略。AI生成内容经过学术和行业来源的批判性审查,事实核查解决了AI生成的不准确性和偏差。人类监督确保了定性数据的准确表示,AI协作提供了多样化视角以减少个人偏差。

2.6 伦理研究承诺

本研究坚定致力于伦理实践和学术诚信,重点关注AI协作的伦理意义。承认我的立场,解决AI偏差,保持反思态度,确保负责任的AI协作,我旨在负责任、透明和实用地为代理型AI时代的负责任AI理解做出贡献。

3 调查对象的故事:研究发现

3.1 调查对象

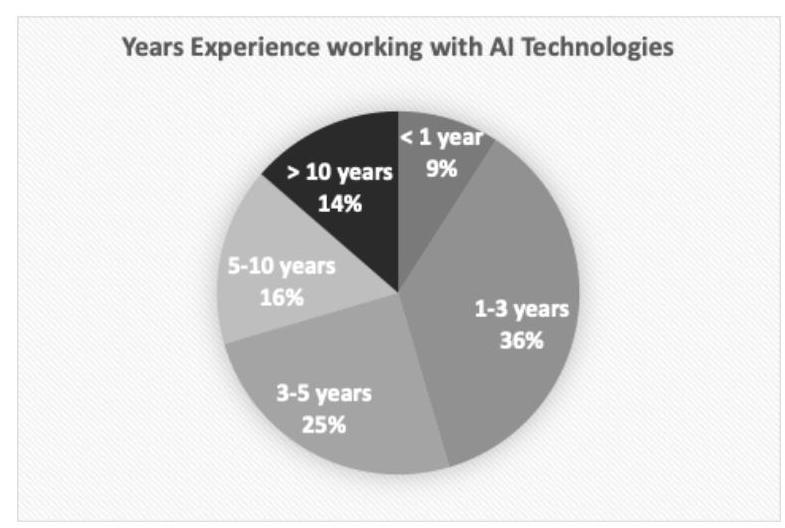

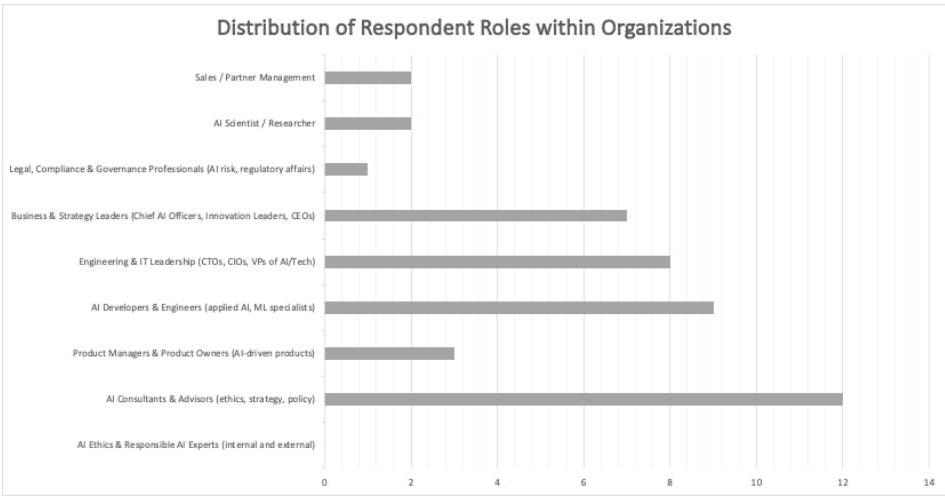

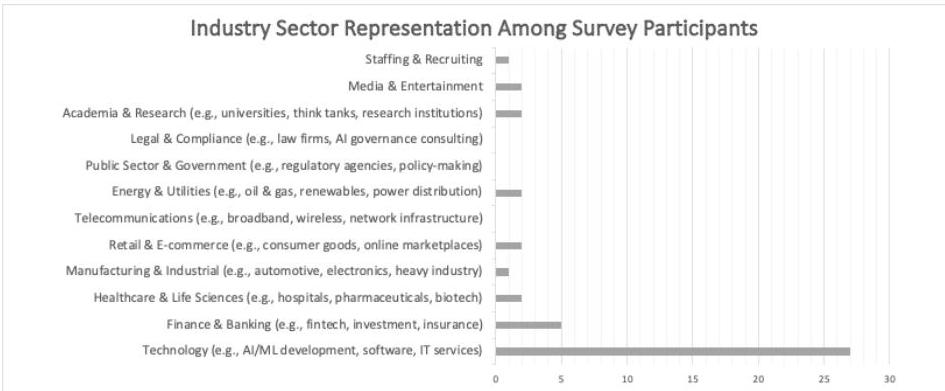

本研究收集了44名在大型北美组织工作的专业人士的见解(5000+员工或1B+美元营收)。大多数受访者(约60%)来自科技行业,其他行业也有代表。参与者包括AI顾问、开发者、商业领袖和研究人员,提供了多样化的观点。超过70%的受访者从事AI技术工作不到5年(16人有1-3年经验,11人有3-5年经验),反映了代理型AI领域的新兴性质。他们的集体经验构成了本研究发现的基础。

3.2 解释基础

AI领域,特别是代理型AI,提出了一个多方面的挑战——整合技术进步、社会技术考虑和不断发展的组织实践。代理型AI系统本质上是复杂的2{ }^{2}2,即使单独来看也是如此,这种复杂性在多代理系统中会加剧,组织面临的风险包括协调失误、冲突、共谋、操控以及错误、偏见和隐私损失的传播,还有安全措施的失效(Hammond et al., 2025)。理解个体的生活经历至关重要,因为他们的叙述提供了技术分析中经常被忽略的见解。本研究探讨了人类与AI互动的复杂动态,认识到这些经验在负责任创新中的关键作用。

责任在伦理讨论中至关重要。正如哈维尔(1990)所说,“……我们所有行动唯一真正的支柱——如果它们是道德的——就是责任。责任比我的家庭、我的国家、我的公司、我的成功更高。” 在代理型AI中,伦理考虑至关重要,哈维尔的话促使我们将责任和道德置于首位,使我们的努力基于超越个人或组织利益的伦理原则。这些叙述提供了情境化的见解,指导我们的理解,确保我们对AI的方法基于人类经验和伦理考虑的现实。

虽然承认这些叙述提供了44名受访者经验的选择性视图,并需要进一步探索,但它们也提供了情境化的见解,支持未来基于人类经验和伦理考虑的AI方法。本研究旨在提供信息和

2{ }^{2}2 区分“复杂”和“复杂”系统很重要。复杂系统,比如汽车引擎,可能有许多部件,但其行为是可以预测的,可以通过分析其个别组件来理解。而复杂系统,比如雨林或多代理AI系统,则以相互关联性、涌现性和不可预测性为特征。在复杂系统中,组件之间的相互作用是关键,系统的整体行为不能通过单独检查各个部分轻易预测或控制。Cynelin框架(Snowden & Boone, 2007)为理解这些差异及适当的管理方法提供了有用的模型。

刺激进一步研究,为全面理解AI的影响做出贡献。

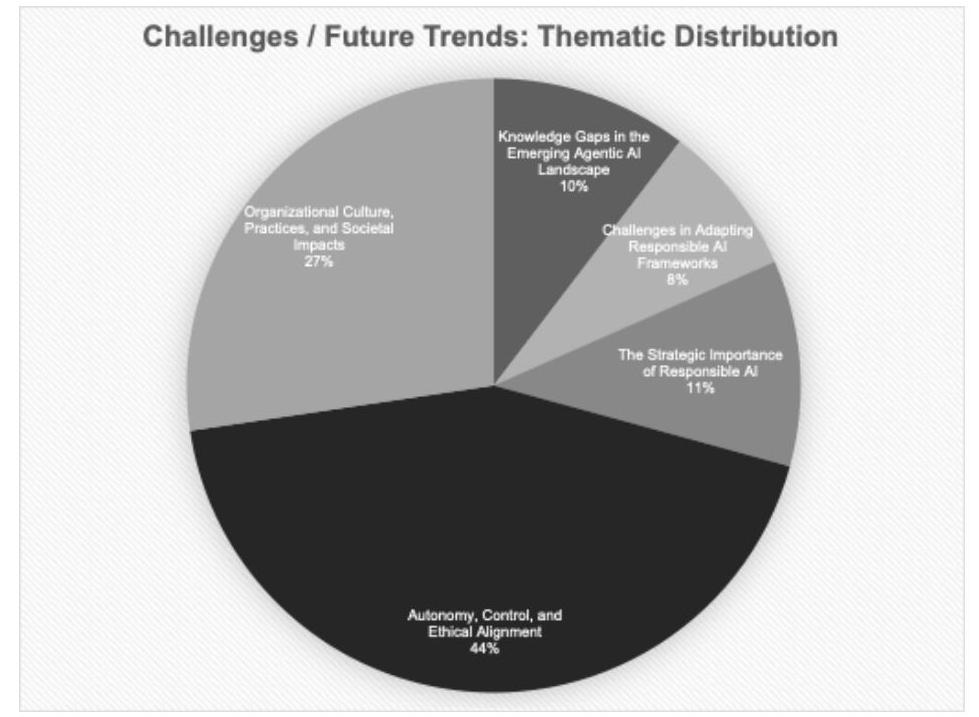

3.3 解释综合

图1的热图说明了解释综合框架,Y轴为负责任AI维度,X轴为浮现主题4{ }^{4}4。热图探讨了主题和维度的相互联系,这是一个影响负责任AI实施的复杂网络。例如,控制欲望与知识差距交织在一起,影响领导力、伦理债务和组织变革。以下各节探讨每个主题,突出关键联系和含义。

3.4 自主性、控制和伦理一致性

自主性、控制和伦理一致性揭示了代理型AI开发和部署中的核心张力:在确保与人类价值观和监督一致的同时,利用其力量。一名受访者分享道:“组织必须应对监管不确定性,确保透明度,并开发安全机制以保持对自主系统的控制。如何保持安全、可持续和规模?” 这种张力在对“控制”、“规则”、“指南”、“护栏”、“保持人类控制”、“关闭开关”、“红队测试”、“安全机制”、“稳健监督”、“伦理一致性”和“道德代码整合”的关注中得到体现。

3{ }^{3}3 在本文中,负责任AI被定义为以符合道德、透明和与社会价值观一致的方式设计、开发和部署AI系统。它涵盖了诸如公平性、责任、透明度、隐私和包容性等原则,旨在最小化偏见和伤害,同时促进信任。此定义和负责任AI维度的观点参考了以下来源:

Google AI. (n.d.). AI Principles. Retrieved from https://ai.google/responsibility/ principles/

Gartner, Inc. (n.d.). Responsible AI. [Gartner Glossary]. Retrieved from https://www .gartner.com/en/information-technology/glossary/responsible-ai

International Business Machines Corporation (IBM). (n.d.). Responsible AI. Retrieved from https://www.ibm.com/think/topics/responsible-ai

Microsoft. (n.d.). Responsible AI. Retrieved from https://learn.microsoft.com/en-us/ azure/machine-learning/concept-responsible-ai

https://openai.com/charter/

https://openai.com/safety/

${ }^{4}$ 主题框架基于开放式问卷回复,并通过额外数据进行细化,指导编码与负责任AI维度。所得数据被扁平化并用于生成热图。以下是每个维度的快速总结:

自主性、控制和伦理一致性:在确保伦理一致性的同时平衡代理自主性和人类控制。

组织文化、实践和社会影响:探讨人类-AI互动以及代理型AI如何重塑或被组织和社会重塑。

负责任AI的战略重要性:将代理型AI计划与战略对齐。

新兴代理型AI景观中的知识差距:通过构建必要能力来识别和解决知识差距。

适应负责任AI框架的挑战:克服适应负责任AI框架以应对代理型AI快速演变的挑战。

| 负责任AI维度 vs. 调查回复中的浮现主题 | | | | | |

| :--: | :--: | :--: | :--: | :--: | :--: |

| | 自主性,<br> 控制,和<br> 伦理一致性 | 组织文化,<br> 实践,和<br> 社会影响 | 负责任AI的<br> 战略重要性 | 新兴代理型AI<br> 领域中的知识差距 | 适应负责任AI<br> 框架的挑战 |

| 透明度<br> 措施 | 22 | 9 | 3 | 3 | 2 |

| 问责机制 | 20 | 9 | 3 | 3 | 1 |

| 伦理指南 | 11 | 15 | 3 | 3 | 3 |

| 安全和安全<br> 标准 | 15 | 9 | 2 | 4 | 1 |

| 无 | 3 | 3 | 10 | 8 | 7 |

| 隐私和数据<br> 保护协议 | 8 | 5 | 1 | 2 | |

| 偏见缓解<br> 策略 | 8 | 5 | 1 | | 1 |

| 利益相关者<br> 参与流程 | 2 | 3 | 1 | 1 | 2 |

图1:显示负责任AI维度与关键主题交叉的热图。

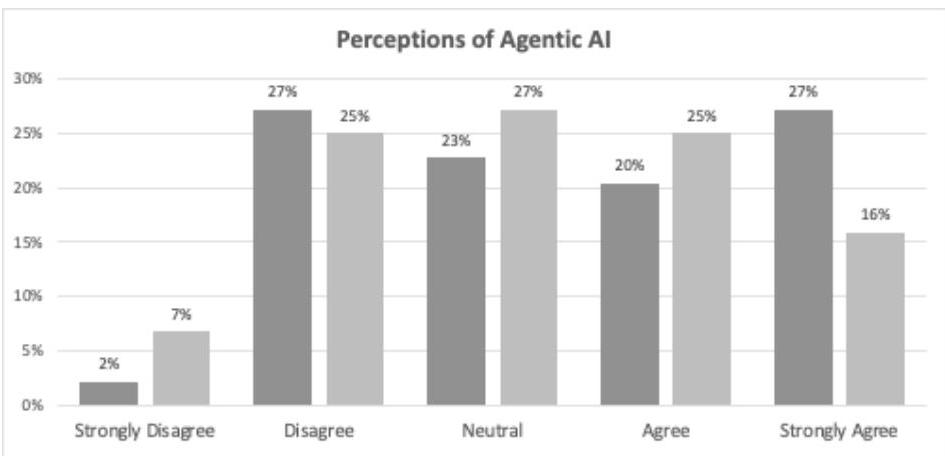

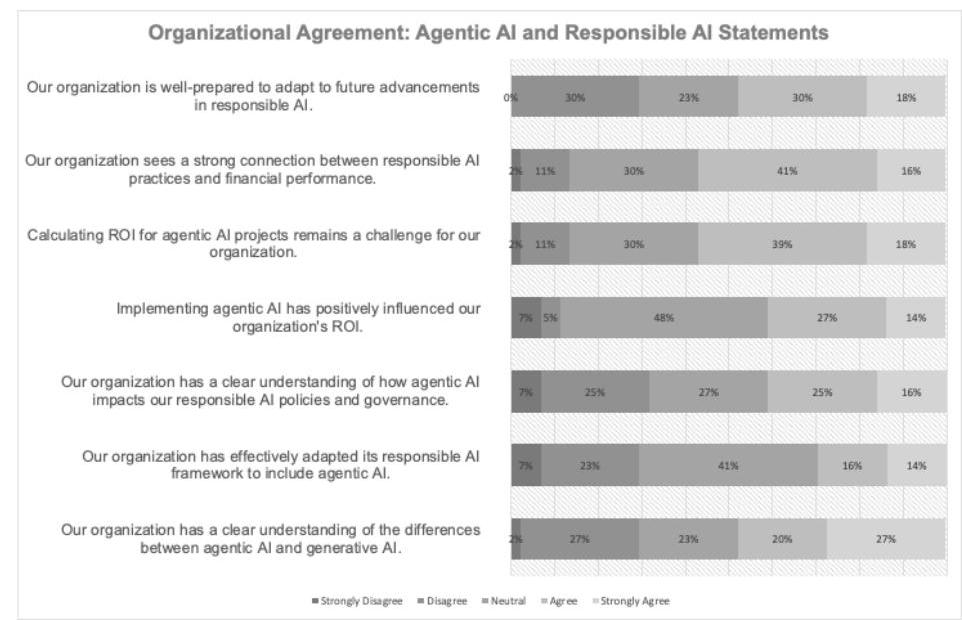

我们的组织清楚了解代理型AI与生成式AI之间的区别。

- 我们的组织清楚了解代理型AI如何影响我们的负责任AI政策和治理。

图2:组织对代理型AI的感知——李克特问题响应分布

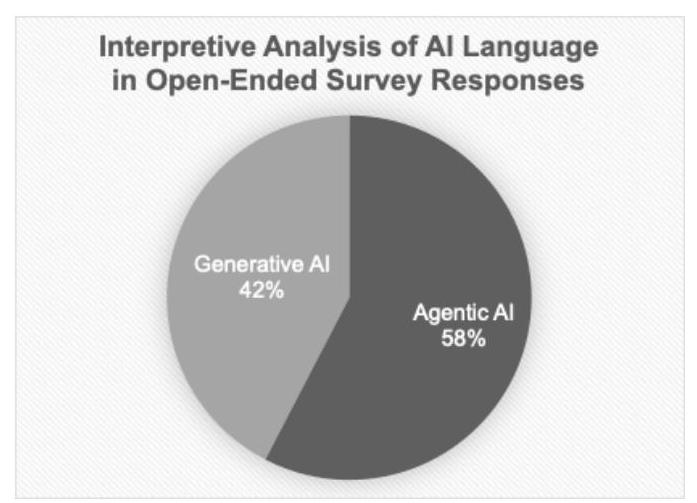

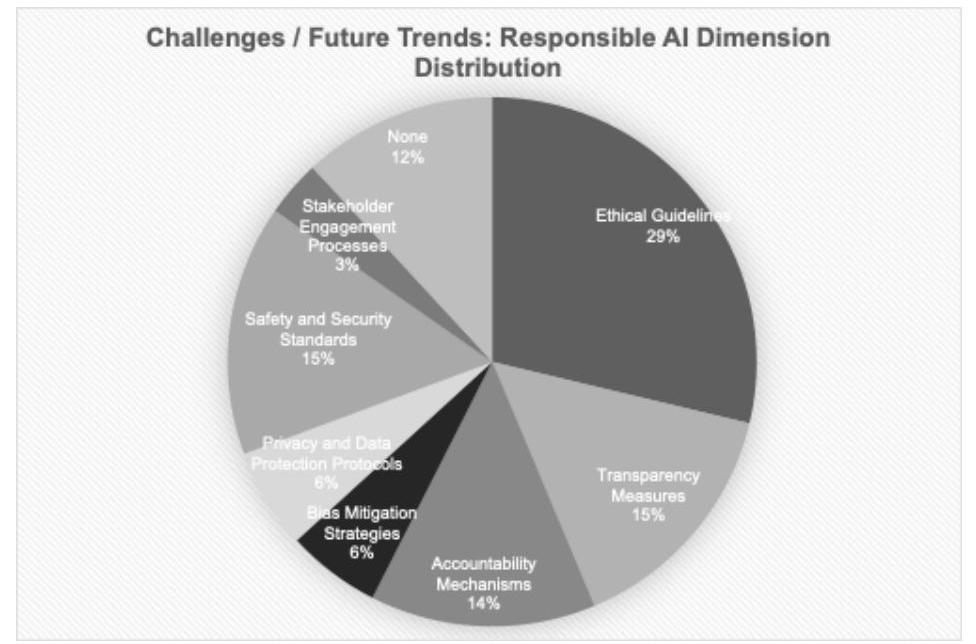

图3:此饼图代表了对开放式问题中与AI相关语言进行解释性分析的结果。

组织不清楚代理型AI与生成式AI之间的区别(图2),这表明知识差距影响了负责任AI政策和治理。这被代理型AI的新颖性(NVIDIA公司,2023)以及诸如“理解AI和用途”、“消除误解和恐惧”、“克服学习曲线”甚至“供应商将代理标签贴在不是代理的东西上”等问题所复杂化,正如一位受访者指出的那样。这种不确定性在图3中得到了回响,开放式回复通常反映了生成式AI概念。

复杂性源于多层次的知识差距:首先是底层LLM本身的难解性——即使是对其开发者来说也是如此,正如“这些模型的内部运作很大程度上是难解的,包括对模型开发者来说”(Bengio等人,2025);其次是有效构建和部署代理型AI所需的知识。这种控制欲望与这些基本知识差距的结合在多代理设置中放大风险的情况下尤为显著,如协调失误、冲突和偏见传播,这些可能被低估(Hammond等人,2025)。

除此之外,一个问题浮现——组织是否具备足够的领导力、战略、专业知识和基础设施,以有效地创建和操作负责任的代理型AI?这引出了一个核心问题:我们如何有效应对?限制自主性是答案吗?或者我们能否引导AI在拥有显著自主性时仍保持伦理一致性?风险规避者可能更倾向于更多控制,而寻求先发优势者可能会加速推动自主性。

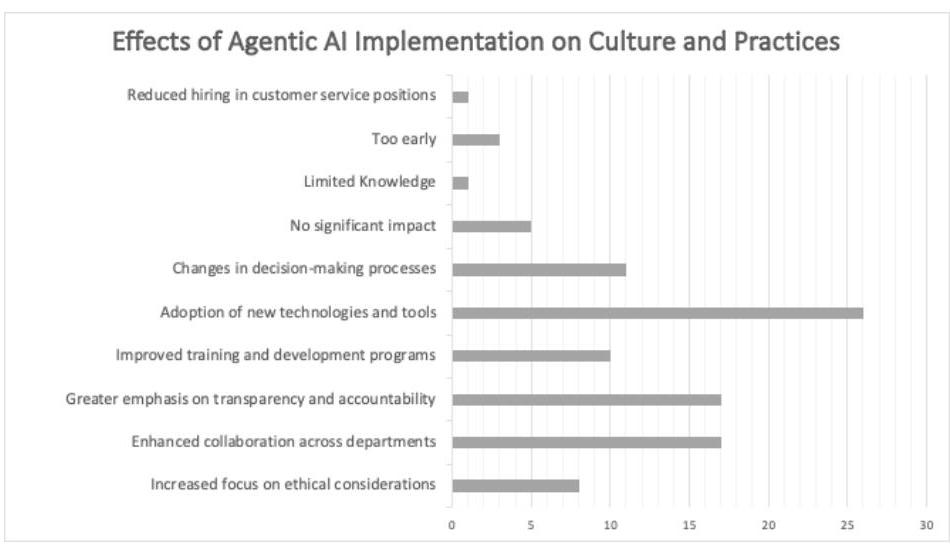

3.5 组织文化、实践和社会影响

Gruenert和Whitaker(2015)关于组织文化的观察促使我们定义代理型AI时代可容忍的行为。受访者强调“人在环路中”不仅限于技术控制,还影响工作和决策。对AI输出未经反思便使用的担忧凸显了对明确框架和伦理指南的需求。一位参与者分享了对未来乐观的看法:“通过识别和积极减少偏见,我们可以充分利用数据的全部潜力,同时维持道德标准并在AI驱动的决策中促进公平。” 一种优先考虑公平和偏见减少的文化必须投资于支持性实践。

社会影响超出了工作场所,引发了对劳动力替代、隐私和信任侵蚀的担忧。受访者担心“霸主”视角,突显了监控和控制问题。强调了自动化与人类自主权之间的微妙平衡,关注AI取代基本人类决策的问题。透明度和信任被认为是至关重要的,要求用户体验避免“黑箱”场景。一位受访者分享道:

最大的挑战是确保这些AI系统清晰说明它们如何做出决策,并且有人可以在出现问题时承担责任。因为代理型AI可以自主做出选择,有时很难确切看到它是如何得出这些选择的。这使得修正错误或阻止不公平行为变得困难。对AI所做的事情保持公开和负责对于维持人们的信任非常重要。

控制AI系统,包括停用,引发了关于责任和决策的问题,尤其是当这些决策使某些用户受益而使另一些用户受损时。正如前一节关于自主性、控制和伦理一致性所讨论的,实施如红队测试和安全机制等安全机制对于维持控制和减轻潜在危害至关重要。然而,除了问责之外,还需要采取主动措施以维持信任。这包括保护数据,确保AI访问不会泄露或滥用敏感信息,并实施实践、审计、培训和标准操作程序。偏见缓解策略和利益相关者参与对于伦理指南和控制机制至关重要。为了培养负责任的AI,组织必须营造一种优先考虑伦理、安全、安保、隐私、包容性和问责的文化,并投资于支持性实践。

最终,数据显示了人类适应和伦理探索。组织正在应对文化变革和社会责任,而不仅仅是部署技术。社会对AI的看法受负面媒体报道影响,可能塑造受访者的先入之见(Bo等人,2024)。通过修复理论(Bolter, 2001),这种在AI中表现的老技术焦虑可以理解为新旧技术相互重塑的拉锯战。

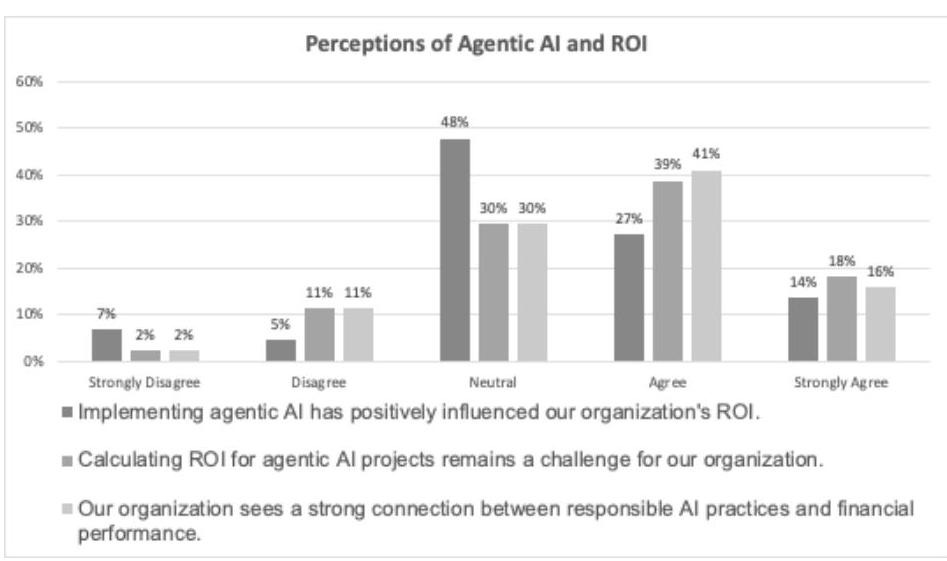

图4:对代理型AI对财务绩效和ROI影响的感知。

代理型AI在工作和社会中体现了这一点。挑战在于培育以人类价值观和社会福祉为核心的负责任创新。

3.6 负责任AI的战略重要性

负责任AI的战略重要性超越了道德合规,成为关键的业务需求。然而,领导层的知识差距限制了战略收益。一位受访者指出,“组织内领导者之间的信息不对称。在他们能够引领变革之前,他们需要理解AI代理的价值主张,甚至是AI的基本知识。” 这种缺乏理解阻碍了系统级的代理型AI方法,鉴于其复杂性和相互连接的架构,这一点尤为重要。领导者必须理解技术,战略性地调整组织,并管理由数字和人类工作者组成的劳动力(Somers, 2025)。

图4展示了受访者对代理型AI和ROI的感知,揭示了可能存在冲突的观点。尽管41%(27%同意,14%非常同意)认为实施代理型AI对组织的ROI产生了积极影响,但相当大的60%(7%非常不同意,5%不同意,48%中立)要么不同意要么对这一主题持中立态度。虽然中立回答难以解释,但积极回答值得怀疑,因为我们刚刚开始部署代理型AI,存在知识差距,并且对许多组织来说——计算代理型AI项目的ROI是一个挑战(只有13%不同意这是个挑战)。值得注意的是,相当大的57%(41%同意,16%非常同意)看到了负责任AI实践与财务绩效之间的强烈联系。考虑到对生成式AI与代理型AI的混淆,以及组织与生成式AI打交道的时间更长,可能是受访者基于生成式AI的经验回答了这个问题。这些数据提出了一个关键的战略问题:鉴于领导技能差距,组织能否有效驾驭这一领域,优先考虑跨计划和时间范围的投资,并最终实现代理型AI的ROI?当领导者缺乏对这些计划的基本理解时,他们如何优先考虑投资?

除了这些基础性挑战外,责任和风险已成为关键的战略关注点。忽视负责任AI,特别是在偏见和数据安全领域,可能导致重大财务风险、法律责任和声誉损害(Bengio等人,2025;Bevilacqua等人,2023)。这种忽视导致了“伦理债务”的积累——伦理妥协的长期后果——和“治理债务”——忽视治理结构的长期后果(Field, 2024;Meskarian, 2023)。正如这位受访者的评论所示:

我们公司积累了数十年的数据,这对开发先进AI系统是一项宝贵的资产。然而,这些广泛的数据可能包含内在偏见,这可能影响我们AI模型的性能和公平性。我们在实施AI系统时面临的最大挑战之一是解决和缓解这些偏见,以确保我们的AI解决方案准确、公平和可靠。通过识别和积极减少偏见,我们可以充分利用数据的全部潜力,同时维持道德标准并在AI驱动的决策中促进公平。

负责任AI是一种战略必要,而不仅仅是一个指南。拥抱它能增强信任,提升品牌声誉,吸引和保留人才,促进创新,确保安全,并提供竞争优势(Bevilacqua等人,2023)。相反,忽视它则面临财务损失、法律斗争、品牌损害和社区伤害的风险(Chan等人,2023;Kolt, 2025;国家标准与技术研究院,2023)。这种战略重要性在几位受访者的评论中得到了回响:“我期待AI将越来越受到信任,并帮助我们找到更多效率”和代理型AI将“在保持人类控制的同时提高生产力。” 它提供“全球规模的代理型AI和更多的货币化机会,因为公司甚至个人将在基于结构的市场中拥有竞争代理,提供各种服务。” 然而,忽视负责任AI阻碍了长期可持续性。

3.7 新兴代理型AI领域的知识差距

代理型AI处于起步阶段,发展迅速且信息不断更新。这种动态环境不可避免地导致了个人和组织的知识差距。承认这些差距并非是对受访者专业知识的批评,而是对这一快速发展领域固有挑战的认可。受访者描述了一个“难以预测”的未来,

图5:受访者报告从事AI技术工作的年限

变化持续发生,并且“. . . 我们将在学习中首先遇到挑战。” 当被问及未来趋势时,一位受访者的简单回答“不知道”突显了这一探索时刻。

尽管受访者从事AI技术工作的经验有限(图5),但在热图中(图1)知识差距的表现却令人惊讶地较少。这种不一致被图2的数据放大,图2突显了组织对代理型AI和生成式AI的区别缺乏清晰认识——并且——对代理型AI如何影响AI政策和治理也不清楚。这种不一致进一步被图3放大,图3注意到受访者在生成式AI和代理型AI之间的潜在知识差距。

代理型AI的动态特性加重了知识差距,要求持续学习。随着它继续发展并在规模和复杂性上不断增长,如果不主动解决,知识差距将会扩大。正如一位受访者指出的:

目前我们正在进行一次性代理工作,并谈论数据和集成,这些都是必不可少的,但实际上是入门级的。我认为第二个大趋势是我们将发展代理通信框架,以便代理能够发现彼此并进行通信。可以将其视为代理结构体系的延伸。

这些“入门级”,即进入代理解决方案世界的早期步骤,已经使知识差距显现出来。代理结构体系的概念代表了复杂性的巨大进步,需要进一步增长知识并加快学习步伐。Spiegel(2024)强调了前瞻所需的勇气:

想象未来AI将如何在伦理上挑战我们对人性和世界的认知需要勇气。承认既定的伦理实践、信仰和理论是有限的,因此不仅需要质疑,还需要发展……

快速和持续学习的能力将是组织在代理型AI领域取得成功的关键。正如一位受访者强调的:

最紧迫的挑战是确保劳动力准备好迎接AI代理时代,即人们具备与代理合作、识别其用例、将其集成到日常工作流程中并负责任地做到这一切的必要技能!

解决知识差距应成为领导者和组织文化的首要任务。通过有针对性的教育、培训和对话解决这些差距,对于培育负责任和可持续的AI生态系统以及确保劳动力为AI代理时代做好准备至关重要。

3.8 适应负责任AI框架的挑战

适应负责任AI框架受到代理型AI固有模糊性的阻碍。一位受访者指出:“我认为代理系统将从夸大的聊天机器人开始(今天很多都是如此,因为供应商将代理标签贴在不是代理的东西上),然后逐渐获得能力。” 这引发了问题:与虚假和过度宣传的能力打交道的经历是否会挫伤那些试图支持和参与变革和适应的人?

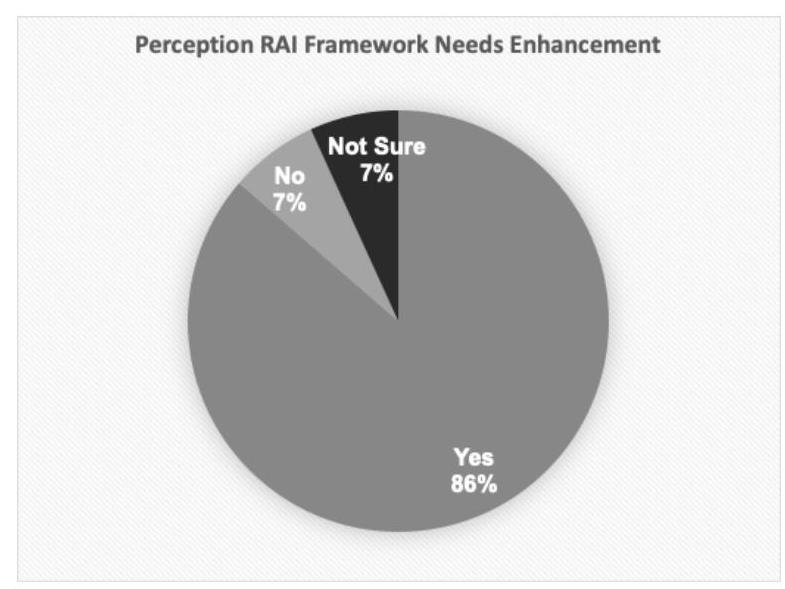

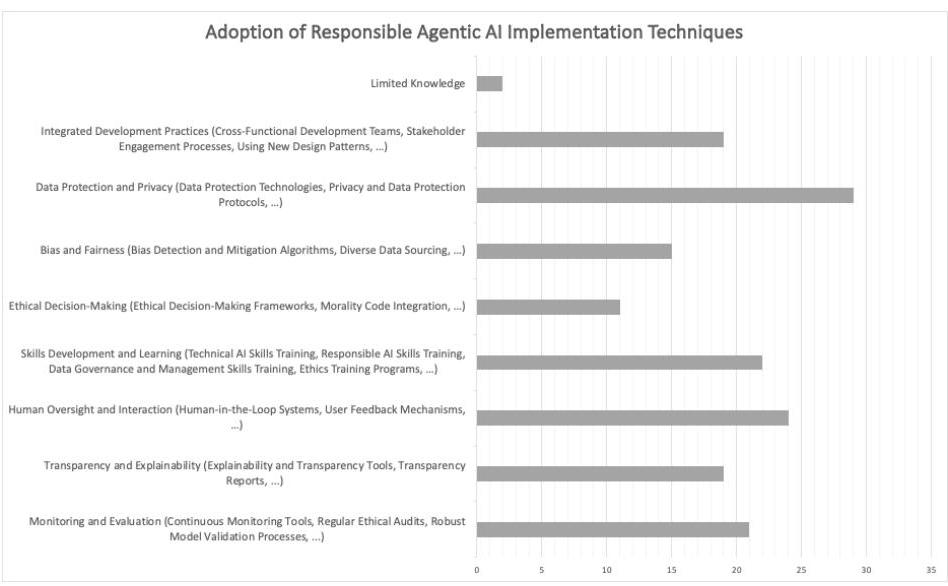

图6显示了惊人的86%共识:组织的负责任AI框架需要增强以应对代理型AI的复杂性。这一明确的改变需求引发了问题:“您认为哪些负责任AI框架维度最有可能需要增强以应对代理型AI?”

如图7所示,“利益相关者参与流程”是最少被选择的选项。这尤其令人担忧,因为这个话题在开放式问卷回复中讨论最少。借鉴设计领导者和设计思想家的合作与创造性实践,强有力的利害关系人参与对于解决方案有效满足用户需求并实现增强的投资回报率至关重要(Lockwood & Papke, 2018)。正如Brown(2019)指出的,“复杂系统有复杂的利益相关者,” 因为代理型AI系统是复杂的,它们也将有复杂的利益相关者。还值得注意的是,“您的伦理噩梦部分取决于您所在的行业、您所属的特定类型的组织,以及您需要与客户、顾客和其他利益相关者建立的关系,以确保一切顺利。” (Blackman, 2022)。成功的和负责任的代理型AI发展需要解决方案,这些解决方案纳入多元视角,积极支持预期受众,并赋予权力给那些将维护和操作这些系统的人(Floridi等人,2018;经济合作与发展组织

图6:对问题的回答分解:“您是否认为有必要增强组织的负责任AI框架以应对代理型AI的复杂性?(选择最佳答案)”

图7:您认为哪些负责任AI框架维度最有可能需要增强以应对代理型AI?(适用的都选)

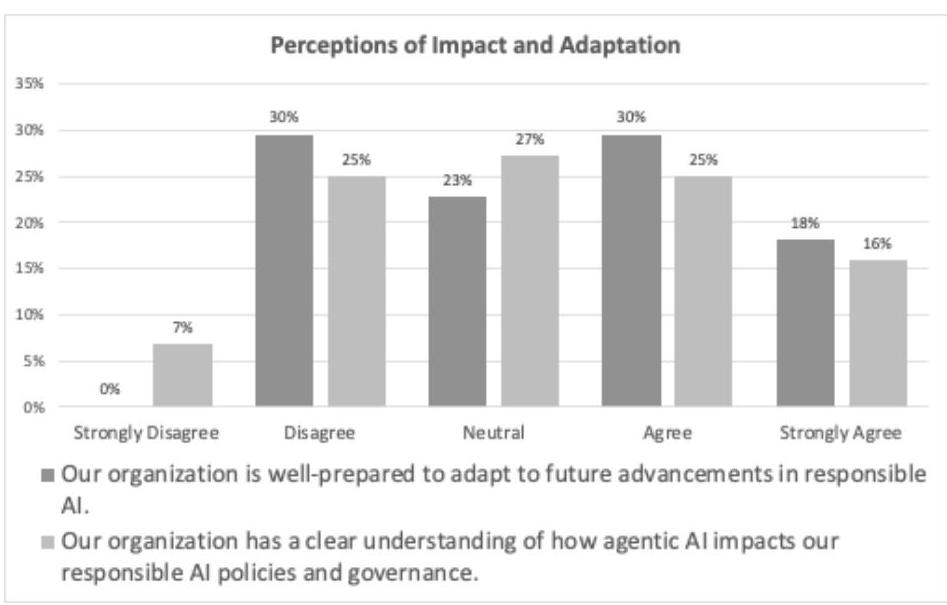

图8:对组织变革能力和影响理解的感知

(OECD), 2022)。此外,“利益相关者的输入是有价值的,负责任的决策制定涉及它。但是你不能仅仅从利益相关者的输入中推导出一个伦理决策。无论你是否屈服或违背(一部分)利益相关者的输入,这都是一个定性的伦理决策。”(Blackman, 2022)。

需要进一步研究以探讨利益相关者参与的低优先级原因。这种低优先级可能源于组织文化、资源分配或与代理型AI和参与流程相关的知识差距。理想情况下,像《人+AI指南》(Google AI, 2025)和参与式AI(Berditchevskaia, Peach, & Malliaraki, 2021)这样的方法,强调以人为中心的设计和利益相关者共创,会获得更多关注。然而,必须认识到利益相关者参与只是更大伦理AI战略的一部分。

图8进一步强调了适应挑战:仅48%的受访者感到“为未来的发展做好了充分准备”,类似比例的41%承认对“代理型AI如何影响负责任AI政策和治理”有“清晰的理解”。这表明受访者对其组织适应变化能力的信心和清晰度严重不足。结合共享的感知,即需要改变,显然存在成果与能力之间的差距。正如Blackman(2022)指出的,负责任AI需要一种全面的方法,涵盖AI伦理标准、组织意识、专门团队和流程、专家监督(如AI伦理委员会)、问责制、AI伦理风险计划及其KPIs,以及高管所有权。其他

研究者提出需要新的技术和法律基础设施,并由基于包容性、可见性和责任原则的治理策略支持(Kolt, 2025)。再次,我们看到我们的主题和维度是相互关联的——领导力、战略和实践汇聚在对强大利益相关者参与的基础需求上。

4 方法论考虑和数据分析:捕捉一个时刻

这项为期两周的在线调查捕捉了44位北美专业人士对代理型AI的感知。虽然有价值,但地理分散的样本和有限的时间框架存在固有限制。强大的科技行业和AI顾问代表,加上1-5年的AI技术工作经验范围,提供了当前早期经验视角的快照。

数据分析揭示了生成式AI和代理型AI之间的频繁混淆。为解决此问题,回复被分类为使用代理型AI特定术语如“自主决策”。然而,潜在的误解、过度报告和社会期望偏差仍然是整个问题中的关注点。

未来研究应使用更清晰的定义和具体问题以区分预期和实际影响。参与者可以定义关键构念以揭示观点和知识差距。定性方法,如访谈和焦点小组,将提供细致入微的见解。更广泛的行业代表将验证发现,识别偏差并引入新视角。

5 故事的重要性:结论

代理型AI复杂且随着多代理解决方案的扩展变得更加复杂。挑战因不成熟的领域而加剧,该领域快速变化意味着我们都在学习。虽然存在差距、挑战和摩擦领域,但也明显有对负责任解决方案的渴望和健康的谨慎态度。

负责任AI框架承认AI系统的转型潜力,并指导这些系统的开发、部署和使用,以最小化潜在危害(Dehghani等人,2024)。但正如引言中所强调的,从业者在解释、优先排序和实施框架方面面临挑战(Jobin等人,2019)。我们需要填补差距。理论与实践之间的差距、潜力与实践之间的差距、设计者与预期用户之间的差距,当然还有知识差距。共享的叙述是朝着促进负责任和道德代理型AI迈出的重要一步。虽然本研究捕捉了这一动态领域的某个时刻,但未来探索和研究仍有无数途径。

例如,组织可以从热图(图2)中汲取灵感,定义对其组织重要的主题矩阵和负责任AI框架维度。此类工具可以帮助他们识别自己的差距,然后优先考虑并规划其负责任代理型AI努力。为有效应对代理型AI系统中自主性和控制之间的紧张关系,可以专注于教育和解决知识差距的努力。注意到变化的惊人速度,学习应该是轻量级的、动手实践的,并且与战略对齐。也就是说,学习投资必须完全与组织的优先事项对齐。应着重于对话和协作。此类倡议可以通过参与式AI的努力启动,包括领导者,并与组织文化和实践的调整挂钩。这条前进的道路应优先考虑以人为中心的设计,强调在整个开发、业务和受影响社区中的有意义的利益相关者参与。此外,随着代理型AI的发展,至关重要的是批判性地审视其新兴特征——自主性、不完美、创造力——并考虑其作为“行动者”(关系网络中的参与者)的角色,与我们日益数字化的世界进行复杂互动(Kolt, 2025;Li & Zhu, 2024)。将AI视为不仅仅是“工具”,对于推进其作为数字劳动力一部分的潜力以及整个劳动力的潜力而言,是一个重要的调整。

通过这些努力的结合,随着我们更好地理解技术、失败模式、风险因素和影响,对控制(和自主性)的更细致方法将会出现(Hammond等人,2025)。引导我们找到一种负责任的方式,同时推进人类体验和代理体验(Biilmann, 2025)。

致谢

我要向以下个人和机构表达诚挚的感谢,感谢他们对本研究的宝贵贡献:

- 媒体应用科学大学MA AI和Societies项目教职员工和工作人员,为本项目提供了学术基础和支持。

-

- Smith教授博士和Raff教授博士,在研究设计和发展阶段提供了指导和反馈。

-

- Stefan Thissen,在本研究初期阶段提供了深刻的讨论和同行评审,以及其他同学在研究初期阶段的讨论中做出了贡献。

-

- TEKsystems Global Services的同事们,分享了他们的专业知识,对研究设计提供了反馈,并协助招募研究参与者。

-

- 作为本研究的一部分,并反映项目对AI和社会的重视,我使用了AI工具(Gemini、ChatGPT、Copilot和Julius)来辅助研究设计、分析和草稿撰写。这种亲身实践让我获得了这些技术能力和局限性的实际见解。

-

- 最后,我要感谢研究参与者分享他们的经验、见解和时间。

6 参考文献

参考文献

Bengio, Y., Mindermann, S., Privitera, D., Besiroglu, T., Bommasani, R., Casper, S., et al. (2025). 国际AI安全报告。arXiv预印本 arXiv:2501.17805 [cs.CY]。检索自 https://arxiv.org/abs/2501 . 17805

Berditchevskaia, A., Peach, K., & Malliaraki, E. (2021). 参与式AI用于人道主义创新(技术报告)。伦敦,英国:Nesta。检索自 https://www.nesta.org.uk/documents/2487/ Nesta_Participatory_AI_for_humanitarian_innovation_Final.pdf

Bevilacqua, M., Berente, N., Domin, H., Goehring, B., & Rossi, F. (2023). AI伦理的投资回报:一个整体框架。arXiv:2309.13057 [cs.CY]。检索自 https://arxiv.org/abs/2309.13057

Bick, A., Blandin, A., & Deming, D. J. (2024, 九月). 生成式AI的快速采用(NBER工作论文系列)。剑桥,马萨诸塞州,美国:国家经济研究局。检索自 https://www .nber.org/system/files/working_papers/w32966/w32966.pdf

Biilmann, M. (2025, 1月28日). 引入AX:为什么代理体验很重要。博客文章。检索自 https://biilmann.blog/articles/introducing-ax/ (检索自 https://biilmann.blog/articles/introducing-ax/)

Blackman, R. (2022). 伦理机器:您的简洁指南,完全无偏见、透明和尊重的AI。哈佛商业评论出版社。

Bo, D., Ma’rof, A. A., & Zaremohzzabieh, Z. (2024). 科幻和奇幻中的负面刻板印象对公众人工智能感知的影响:系统综述。科学、测量与文化,13(1),1-13。检索自 https://doi.org/10.11114/smc.v13i1.7212 doi: 10.11114/smc.v13i1.721210.11114 / \mathrm{smc} . \mathrm{v} 13 \mathrm{i} 1.721210.11114/smc.v13i1.7212

Bolter, J. D. (2001). 写作空间:计算机、超文本和印刷品的修复。Routledge.

Bostrom, N. (2014). 超级智能:路径、危险、策略。牛津大学出版社。

Bostrom, N., & Yudkowsky, E. (2018). 人工智能伦理。在人工智能安全与保障(第57-69页)。Chapman and Hall/CRC.

Bousetouane, F. (2025, 1月1日). 代理系统:垂直AI代理转换行业的指南。arXiv:2501.00881v1 [cs.MA]。检索自 https://arxiv.org/abs/2501.00881v1

Brown, T. (2019). 设计驱动变革,修订更新版:设计思维如何转变组织并激发创新(功能版)。Currency.(Kindle版)

Buijsman, S., Klenk, M., & van den Hoven, J. (2025). AI伦理:迈向“为价值观而设计”的方法。在《剑桥人工智能法律、伦理和政策手册》。剑桥大学出版社。

Cave, S., & Dihal, K. S. (2019). 小说与现实中智能机器的希望与恐惧。检索自 https://doi.org/10.17863/CAM.36203 doi: 10.17863/10.17863 /10.17863/ CAM. 36203

Chan, A., Salganik, R., Markelius, A., Pang, C., Rajkumar, N., Krasheninnikov, D., … others (2023). 日益代理化算法系统的危害。在2023年ACM公平性、问责制和透明度会议论文集(第651-666页)。计算机协会。检索自 https://doi.org/10.1145/3593013.3594033 doi: 10 .1145/3593013.3594033.1145 / 3593013.3594033.1145/3593013.3594033

Chia, A. (2024, 十一月). AI的投资回报率:关键驱动因素、KPIs & 挑战。DataCamp博客。检索自 https://www.datacamp.com/blog/roi -of-ai

Cunningham, W. (1992). Wycash投资组合管理系统。检索自 https://c2.com/doc/oopsla92.html (OOPSLA '92经验报告)

Dehghani, F., et al. (2024). 以人类为中心的自主决策系统的可信和负责任AI。arXiv:2408.15550v2 [cs.AI]。检索自 https://arxiv.org/abs/2408.15550v2

Dignum, V. (2019). 负责任的人工智能:如何以负责任的方式开发和使用AI。Springer.

欧洲联盟. (2024, 六月). 欧洲议会和理事会条例(EU)2024/1689号,于2024年6月12日通过,制定关于人工智能的协调规则(人工智能法案),并修正某些联盟立法行为[计算机软件手册]。EURLex. 检索自 https://eur-lex.europa.eu/legal-content/EN/ TXT/HTML/?uri=0J:L_202401689

Field, M. (2024, 五月15日). 克服伦理债务。约翰霍普金斯惠廷工程学院新闻。检索自 https://engineering.jhu.edu/ news/overcoming-ethical-debt/

Floridi, L. (2023). 人工智能伦理:原则、挑战和机遇。

Floridi, L., et al. (2018). AI4People——一个良好的AI社会的伦理框架:机会、风险、原则和建议。心智与机器,28,689-707.

Google AI. (2025). 人+AI指南书(第3版)[计算机软件手册]。检索自 https://pair.withgoogle.com/guidebook/

Gruenert, S., & Whitaker, T. (2015). 学校文化重塑:如何定义、评估和转变它。ASCD.

Hammond, L., et al. (2025, 二月). 高级AI的多代理风险。检索自 https://arxiv.org/abs/2502.14143

Havel, V. (1990, 二月22日). 在美国国会的演讲。瓦茨拉夫·哈维尔图书馆。检索自 https://havelcenter.org/2015/05/04/speech -to-the-u-s-congress/

国际商业机器公司(IBM). (2025, 二月). AI代理与AI助手。IBM Think博客。检索自 https:// www.ibm.com/think/topics/ai-agents-vs-ai-assistants

Jobin, A., Ienca, M., & Vayena, E. (2019). 全球AI伦理准则景观。自然机器智能,1(9),389-399.

Kolt, N. (2025). 管理AI代理。arXiv:2501.07913 [cs.AI]。检索自 https://arxiv.org/abs/2501.07913

Li, Y., & Zhu, J. (2024, 二月). 从行动者网络理论视角对生成式AI的伦理研究。国际控制论与信息学杂志(IJCI),13(1)。检索自 https://arxiv.org/abs/ 2406.11860 (也可作为arXiv:2406.11860 [cs.CY]获取)

Lockwood, T., & Papke, E. (2018). 设计驱动创新。Career Press.

Lu, Q., Zhu, L., Xu, X., Whittle, J., Zowghi, D., & Jacquet, A. (2024). 负责任AI模式目录:AI治理和工程的最佳实践集合。ACM计算调查,56(7),文章173。检索自 https://doi.org/10.1145/3626234 doi: 10.1145/ 3626234

MacKenzie, D., & Wajcman, J. (Eds.). (1999). 技术的社会塑造(第二版)。开放大学出版社。

麦肯锡公司。 (2024, 十二月). IT现代化中的AI:更快、更便宜、更好(技术报告)。纽约,纽约,美国:麦肯锡公司。检索自 https://www.mckinsey.com/capabilities/ quantumblack/our-insights/ai-for-it-modernization-faster -cheaper-and-better

Meskarian, M. A. (2023, 九月18日). 导航雷区:AI/ML和生成式AI模型中的技术、伦理和治理债务。Medium。检索自 https://medium.com/@m.a.meskarian/ navigating-the-minefield-technical-ethical-and-governance -debt-in-ai-ml-and-generative-ai-models-fd7fa83861e7

国家标准与技术研究院。 (2023, 一月26日). 人工智能风险管理框架(AI RMF 1.0)(技术报告)。NIST。检索自 https://www.nist.gov/system/files/documents/ 2023/01/26/AI%20Risk%20Management%20Framework_1.0.pdf

英伟达公司。 (2023, 八月22日). 什么是代理型AI?Nvidia博客。检索自 https://blogs.nvidia.com/blog/what-is-agentic-ai/

OpenAI. (2024). GPT-4技术报告(技术报告)。arXiv:2303.08774v6 [cs.CL]。检索自 https://arxiv.org/abs/2303.08774

经济合作与发展组织(OECD)。 (2022). OECD AI系统分类框架(技术报告编号323)。巴黎。检索自 https://doi.org/10.1787/cb6d9eca-en doi: 10.1787/cb6 d9eca−en10.1787 / \mathrm{cb} 6 \mathrm{~d} 9 \mathrm{eca}-\mathrm{en}10.1787/cb6 d9eca−en

经济合作与发展组织(OECD)。 (2024, 五月). AI原则。OECD网站。检索自 https://oecd.ai/en/ ai-principles (检索自 https://oecd.ai/en/ai-principles)

Pflanzer, M., Traylor, Z., Lyons, J. B., Dubljević, V., & Nam, C. S. (2022). 人-AI团队伦理:原则与视角。AI & 社会。检索自 https://doi.org/10.1007/s00146-022-01538-2 doi: 10.1007/s00146−022−01538−210.1007 / \mathrm{s} 00146-022-01538-210.1007/s00146−022−01538−2

Rakova, B., Yang, J., Cramer, H., & Chowdhury, R. (2021). 当负责任AI遇到现实:从业者对改变组织实践促进者的看法。ACM关于人机交互的会议记录,5(CSCW1),文章7。检索自 https://doi.org/ 10.1145/344908110.1145 / 344908110.1145/3449081 doi: 10.1145/344908110.1145 / 344908110.1145/3449081

Russell, S., & Norvig, P. (2021). 人工智能:现代方法(第四版)。Pearson.

Snowden, D. J., & Boone, M. E. (2007). 领导者决策框架。哈佛商业评论,85(11),68-76.

Somers, D. (2025, 2月11日). 代理浪潮:新的劳动力管理时代。Workday博客。检索自 https://blog.workday.com/ en-us/the-agentic-wave-new-era-workforce-management.html

Spiegel, I. (2024, 8月9日). 根据人工智能批评伦理。arXiv:2408.04609v1 [cs.CY]。检索自 https://arxiv.org/abs/ 2408.04609v1

Thomas, H. (2024, 十二月). 什么是代理型AI,它将如何改变工作?哈佛商业评论。检索自 https://hbr.org/2024/12/ what-is-agentic-ai-and-how-will-it-change-work

世界经济论坛。 (2024, 十二月16日). 导航AI前沿:AI代理演变和影响的入门指南。世界经济论坛出版物。检索自 https://www.weforum.org/publications/navigating-the-ai -frontier-a-primer-on-the-evolution-and-impact-of-ai-agents/

7 附录 - 额外数据可视化

图9:条形图显示受访者回答:“您在组织中的角色是什么?(选择最佳答案)”。请注意,对“其他”字段提供的答案进行了一些分类和分组。

图10:条形图显示受访者回答:“哪个行业最能描述您组织的主要部门?(选择最佳答案)”。请注意,对“其他”字段提供的答案进行了一些分类和分组。

图11:受访者回答的问题:“以下哪些实施技术和技术已被您的组织采用以确保代理型AI负责任地运行?(适用的都选)”。请注意,一些答案从“其他”重新分类。

图12:受访者回答的问题:“代理型AI的实施如何影响您组织的文化和实践?(适用的都选)”。请注意,一些答案从“其他”重新分类。

图13:饼图显示了关于当前挑战和未来趋势的开放式问题的回答主题分布。

图14:饼图显示了关于挑战和未来趋势的开放式问题中负责任AI维度的回答分布。

图15:组织对代理型AI的感知 - 李克特问题的回答分布

参考论文:https://arxiv.org/pdf/2504.11564

更多推荐

已为社区贡献80条内容

已为社区贡献80条内容

所有评论(0)