langchain-nextjs-template 模板安装与配置

在基本聊天模式中,修改中的TEMPLATE常量:const TEMPLATE = `你是一个有帮助的助手。请用简洁明了的语言回答问题。当前对话:用户: {input}AI:`;在代理模式中,修改中的常量:const AGENT_SYSTEM_TEMPLATE = `你是一个有帮助的助手,能够使用工具来解决问题。

·

前提条件:

- node安装

- yarn 安装:

npm install -g yarn

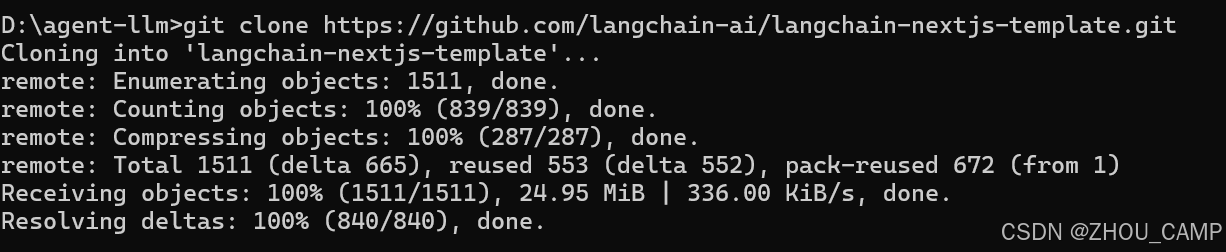

1. 克隆项目

首先,从 GitHub 克隆 LangChain Next.js 模板项目:

d:\agent-llm> git clone https://github.com/langchain-ai/langchain-nextjs-template.git

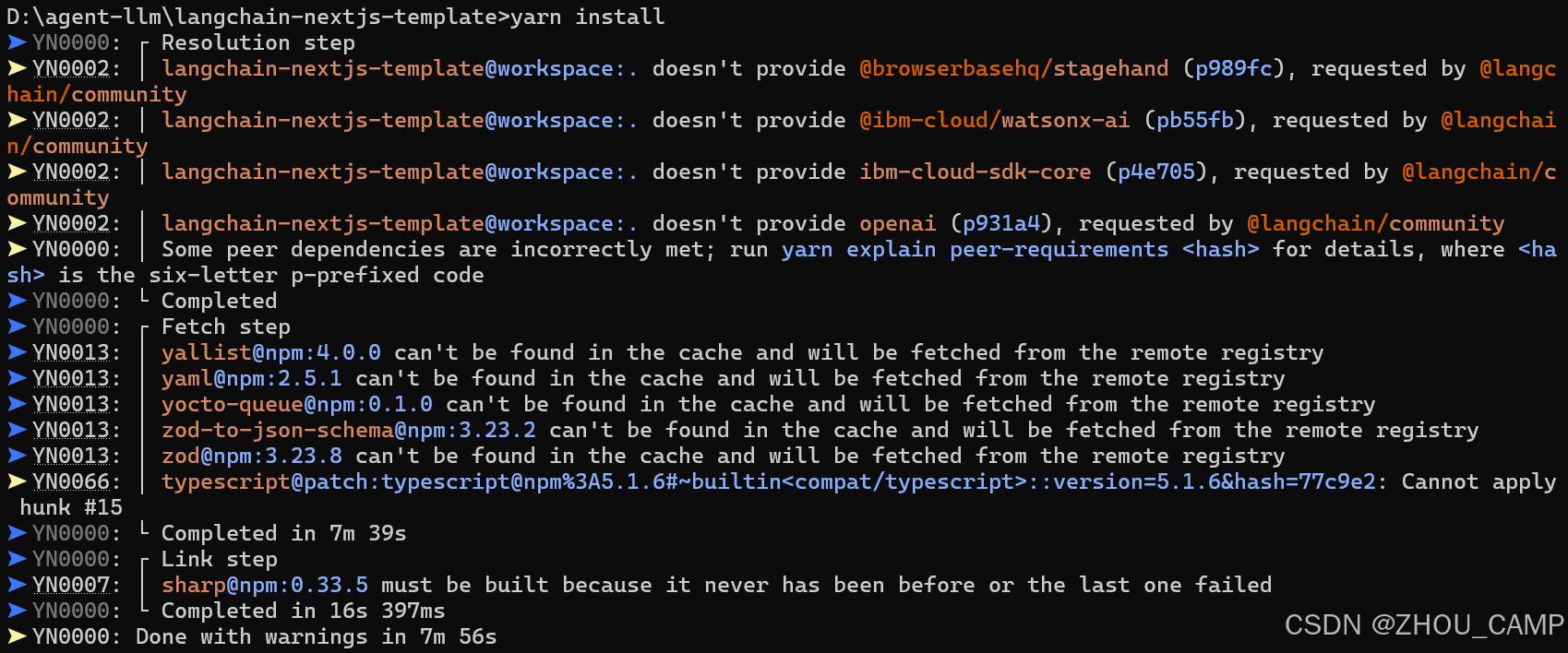

2. 安装依赖

进入项目目录并安装依赖:

d:\agent-llm> cd langchain-nextjs-template

d:\agent-llm\langchain-nextjs-template> yarn install

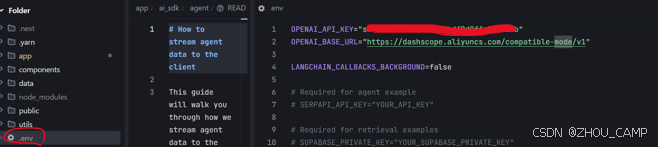

3. 配置环境变量

在项目根目录创建或编辑 .env 文件,配置必要的 API 密钥:

OPENAI_API_KEY="你的API密钥"

OPENAI_BASE_URL="https://dashscope.aliyuncs.com/compatible-mode/v1"

LANGCHAIN_CALLBACKS_BACKGROUND=false

# 如果需要使用 SerpAPI 功能(用于 agents 示例)

# SERPAPI_API_KEY="你的SERPAPI_API_KEY"

# 如果需要使用检索功能示例

# SUPABASE_PRIVATE_KEY="你的SUPABASE_PRIVATE_KEY"

# SUPABASE_URL="你的SUPABASE_URL"

注意:这里使用了阿里云的 DashScope 作为 OpenAI API 的兼容接口。

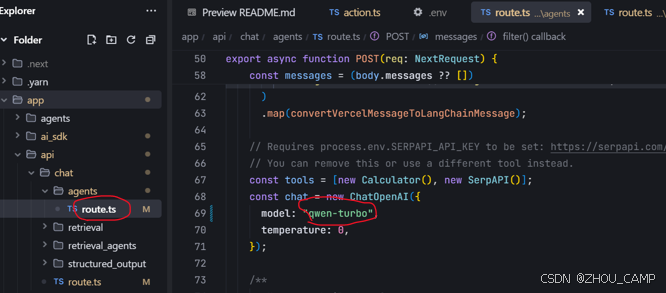

4. 修改模型配置

根据你的需求,可以修改代码中使用的模型。在项目中有两个主要的路由文件需要修改:

- 在

app/api/chat/route.ts文件中,修改模型为 “qwen-turbo”:

const model = new ChatOpenAI({

temperature: 0.8,

model: "qwen-turbo",

});

- 在

app/api/chat/agents/route.ts文件中,同样修改模型:

const chat = new ChatOpenAI({

model: "qwen-turbo",

temperature: 0,

});

5. 启动开发服务器

配置完成后,启动开发服务器:

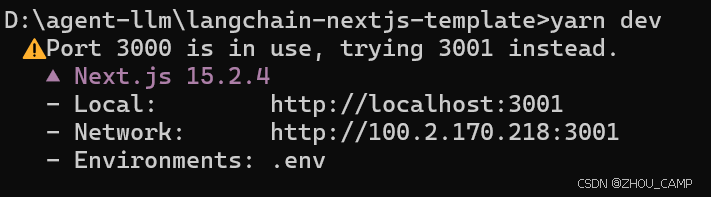

d:\agent-llm\langchain-nextjs-template> yarn dev

服务器将在 http://localhost:3000 启动。

6. 项目结构说明

该项目的主要结构如下:

/app- Next.js 应用程序代码/api- API 路由/chat- 聊天相关 APIroute.ts- 基本聊天 API/agents- 代理相关 APIroute.ts- 使用工具的代理 API

/components- UI 组件/data- 数据文件/public- 静态资源

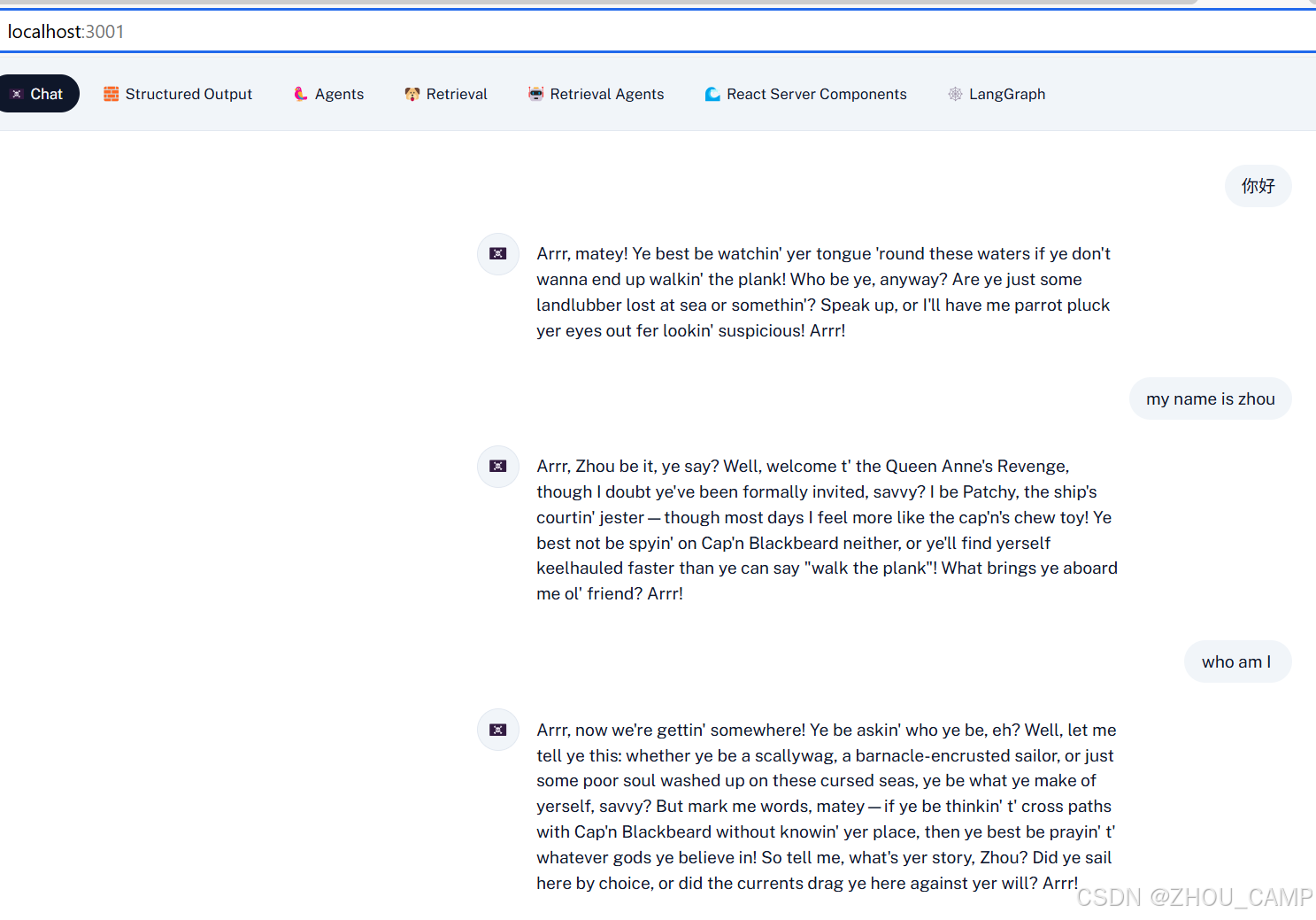

7. 功能说明

该模板提供了两种主要的聊天模式:

- 基本聊天模式:使用

app/api/chat/route.ts中的配置,提供基本的聊天功能。 - 代理模式:使用

app/api/chat/agents/route.ts中的配置,提供带有工具调用能力的代理功能,如计算器和网络搜索。

8. 自定义提示模板

你可以根据需要修改聊天机器人的角色和风格:

- 在基本聊天模式中,修改

app/api/chat/route.ts中的TEMPLATE常量:

const TEMPLATE = `你是一个有帮助的助手。请用简洁明了的语言回答问题。

当前对话:

{chat_history}

用户: {input}

AI:`;

- 在代理模式中,修改

app/api/chat/agents/route.ts中的AGENT_SYSTEM_TEMPLATE常量:

const AGENT_SYSTEM_TEMPLATE = `你是一个有帮助的助手,能够使用工具来解决问题。`;

部分过程文件截图

安装

api 与 url 修改

启动

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)